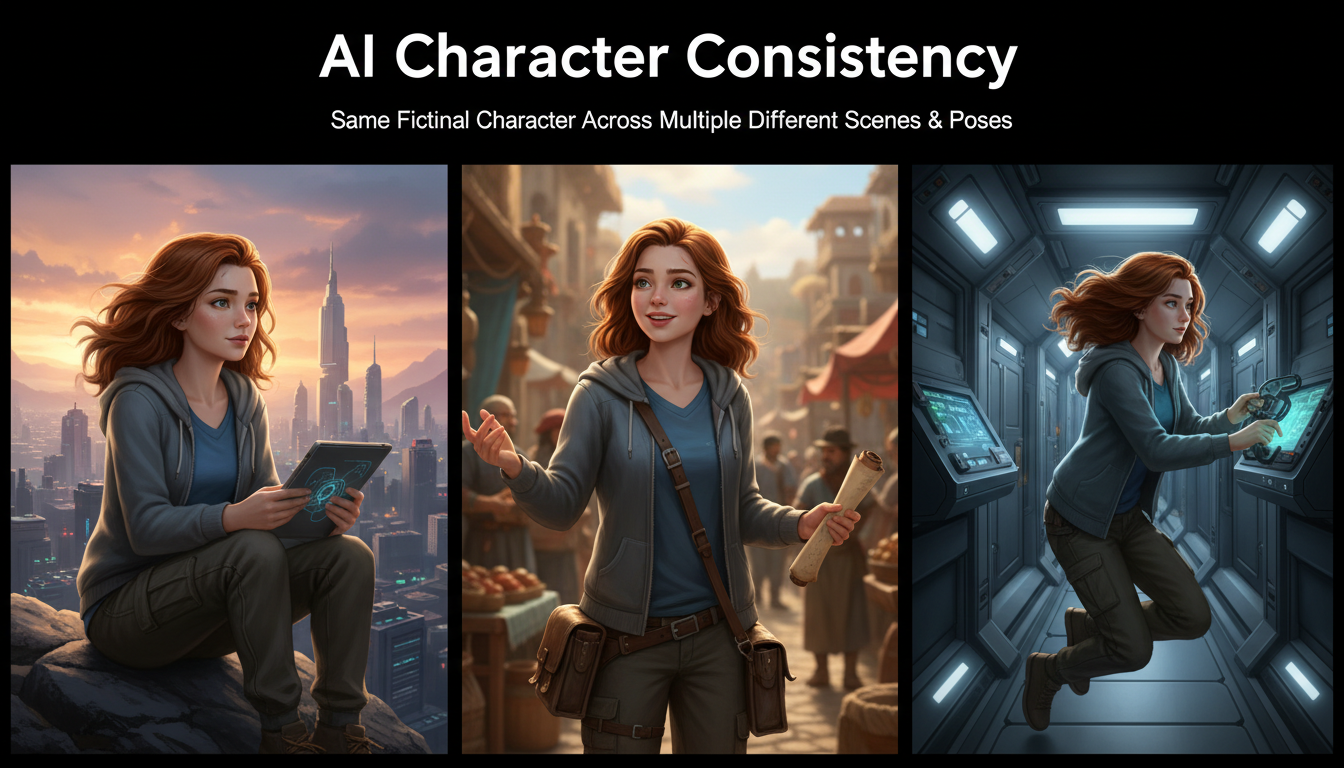

Gerador de Personagens Consistentes em IA: Como Manter o Mesmo Personagem em Múltiplas Imagens

Aprenda como gerar o mesmo personagem de IA em múltiplas cenas usando treinamento LoRA, IPAdapter, Midjourney cref e técnicas de imagens de referência. Guia completo de 2026.

Se você já tentou contar uma história visual com imagens geradas por IA, já conhece a dor. Você cria uma primeira imagem perfeita do seu personagem, segue para a próxima cena, e de repente a IA te dá alguém que se parece com um primo distante no máximo. O cabelo é diferente, o formato do rosto mudou, e a roupa bem poderia pertencer a uma pessoa completamente diferente. Esta é a maior frustração para qualquer um que construa quadrinhos, romances visuais, storyboards ou conteúdo de mídia social com ferramentas de arte IA.

Resposta Rápida: Um gerador de personagem consistente em IA usa técnicas como ajuste fino LoRA, incorporação de rosto IPAdapter, parâmetro cref do Midjourney ou imagens de referência estruturadas para manter a mesma identidade de personagem em múltiplas imagens geradas. Os melhores resultados vêm da combinação de pelo menos dois métodos. O treinamento LoRA em 15 a 30 imagens de referência oferece a consistência mais alta (cerca de 90%), enquanto métodos baseados em referência como cref ou IPAdapter oferecem configuração mais rápida com fidelidade ligeiramente menor (70 a 85%). Sua escolha depende se você precisa de consistência perfeita para projetos profissionais ou "boa o suficiente" para exploração criativa rápida.

- O treinamento LoRA fornece a melhor consistência de personagem, mas requer investimento inicial de tempo (2 a 4 horas de configuração e treinamento)

- IPAdapter e InstantID oferecem um meio termo sem treinamento necessário, apenas imagens de referência

- O parâmetro cref do Midjourney é o ponto de entrada mais fácil, mas oferece o mínimo controle

- Combinar métodos (LoRA mais IPAdapter, por exemplo) produz os resultados mais confiáveis

- Fichas de personagem e referências de turnaround melhoram drasticamente a consistência independentemente do método usado

- Ferramentas como Apatero lidam com a complexidade técnica nos bastidores para criadores que querem resultados sem construir pipelines

Por Que a Consistência de Personagem É o Problema Mais Difícil na Geração de Imagens em IA

A consistência de personagem é fundamentalmente contraditória ao funcionamento dos modelos de difusão. Esses modelos geram imagens começando a partir de ruído e refinando gradualmente em algo que corresponda à sua descrição de texto. Cada geração começa com um padrão de ruído diferente, o que significa que cada saída é única. Isso é ótimo para variedade, mas terrível para manter uma identidade consistente.

Primeiro encontrei esse problema há cerca de dois anos quando tentei construir uma história em quadrinhos curta usando Stable Diffusion. Tinha um personagem que eu realmente gostava de minha geração inicial: uma mulher ruiva em um jaqueta de couro com uma cicatriz distintiva acima da sua sobrancelha esquerda. O próximo painel exigia dela em uma pose diferente, e depois de 80 gerações não consegui ninguém que parecesse remotamente com ela. Esse projeto me ensinou uma lição crítica: prompts de texto sozinhos não podem resolver consistência de personagem, não importa o quão detalhado você os torne.

A razão é simples. Quando você escreve "mulher ruiva com cicatriz acima da sobrancelha esquerda," o modelo interpreta essa descrição fresca cada vez. Sua representação interna de "mulher ruiva" varia entre gerações porque o espaço latente é enorme. Duas imagens que correspondem ao mesmo prompt de texto podem parecer muito diferentes enquanto ainda sendo tecnicamente interpretações corretas das suas palavras.

É por isso que técnicas dedicadas para consistência de personagem em IA se tornaram tão importantes. Se você está construindo uma biblioteca de personagem de romance visual em IA, criando materiais de marketing com um mascote de marca, ou desenvolvendo arte conceitual para um jogo, você precisa de ferramentas que vão além de prompts simples.

As Quatro Principais Abordagens para Geração de Personagem em IA Consistente

Antes de mergulhar em fluxos de trabalho específicos, ajuda compreender o cenário. Existem quatro abordagens principais para manter um personagem de IA consistente em múltiplas cenas, e cada uma se posiciona em um ponto diferente do espectro esforço-versus-qualidade.

1. Ajuste Fino LoRA (Qualidade Mais Alta, Maior Esforço)

O treinamento LoRA ensina ao modelo de IA como é seu personagem específico em um nível profundo. Você alimenta com 15 a 30 imagens curadas do seu personagem, e cria um pequeno arquivo adaptador (tipicamente 10 a 150MB) que modifica o comportamento do modelo. Quando você ativa este LoRA durante a geração, o modelo "conhece" seu personagem e pode renderizá-lo em qualquer pose ou cena enquanto mantém sua identidade principal.

Considero o treinamento LoRA inegociável para qualquer projeto de personagem sério. A consistência que você obtém é incomparável a qualquer outro método. Se você quer entender os fundamentos de como isso funciona, confira nosso guia completo para iniciantes em treinamento LoRA.

Melhor para: Projetos de personagem de longo prazo, romances visuais, quadrinhos, mascotes de marca, pipelines de conteúdo profissional.

Desvantagens: Requer um conjunto de dados do seu personagem (problema galinha-e-ovo para novos personagens), leva 1 a 3 horas de tempo de treinamento, precisa de uma GPU decente ou computação em nuvem.

2. IPAdapter e InstantID (Qualidade Boa, Esforço Moderado)

IPAdapter funciona extraindo características faciais e estilísticas de uma imagem de referência e injetando essas características no processo de geração. Você fornece uma ou mais fotos de referência do seu personagem, e IPAdapter condiciona o processo de difusão para corresponder a essas características. InstantID é uma abordagem semelhante especificamente otimizada para preservação de identidade facial.

A vantagem aqui é velocidade. Você não precisa treinar nada. Apenas forneça uma imagem de referência e comece a gerar. O trade-off é que a consistência cai comparado ao LoRA, especialmente para características não-faciais como roupas, tipo de corpo e acessórios.

Melhor para: Prototipagem rápida, personagens baseados em pessoas reais (com consentimento), projetos onde a consistência facial é o mais importante.

Desvantagens: Luta com mudanças de pose extremas, pode perder detalhes de roupas e acessórios, às vezes produz um efeito "vale da morte" onde o rosto é consistente mas tudo mais muda.

3. Midjourney cref (Mais Fácil, Menos Controle)

O parâmetro de referência de personagem do Midjourney (cref) é a opção mais acessível para iniciantes. Você simplesmente passa uma URL de imagem de referência com a flag --cref, e Midjourney tenta manter a aparência desse personagem em novas gerações. O parâmetro --cw (peso de personagem) permite controlar o quão fortemente ele adere à referência.

Opinião controversa: Midjourney cref é exagerado para trabalho sério. É fantástico para exploração casual e conteúdo de mídia social, mas a consistência se quebra significativamente quando você precisa seu personagem em poses complexas, diferentes condições de iluminação ou cenas estilisticamente diferentes. Testei extensivamente e acho que funciona cerca de 70% do tempo para transferências simples retrato-para-retrato, mas cai para cerca de 40% de confiabilidade quando você muda a cena dramaticamente. Para narrativa visual profissional, você vai bater na parede rápido.

Melhor para: Conteúdo de mídia social, exploração casual de personagem, arte conceitual rápida, usuários do Midjourney que não querem aprender novas ferramentas.

Desvantagens: Bloqueado no ecossistema Midjourney, controle limitado sobre quais aspectos do personagem são preservados, sem capacidade de ajuste fino-grained.

4. Imagens de Referência Estruturada e Fichas de Personagem (Suplementar)

Uma ficha de turnaround de personagem em IA é uma imagem única mostrando seu personagem de múltiplos ângulos: frente, lateral, costas e visualizações de três quartos. Essas fichas servem como referências abrangentes que você pode usar com qualquer um dos métodos acima para melhorar consistência. Não são uma solução independente, mas sim um multiplicador de força.

Criar uma boa ficha de personagem envolve gerar seu personagem em uma pose neutra de múltiplos ângulos, então compor essas vistas em uma imagem de referência única. Isso dá qualquer método de consistência que você esteja usando mais informações para trabalhar.

Passo-a-Passo: Construindo um Personagem LoRA para Máxima Consistência

Este é o fluxo de trabalho padrão ouro para qualquer um que precise de consistência de personagem confiável e repetível. Vou caminhar através do processo inteiro desde criação de conjunto de dados até implantação.

Passo 1: Crie o Design Inicial do Seu Personagem

Se seu personagem não existe ainda, você precisa gerá-lo primeiro. Este é o desafio de bootstrap. Aqui está minha abordagem recomendada.

Comece gerando um lote grande de imagens (50 a 100) com um prompt detalhado descrevendo seu personagem. Use um modelo base de alta qualidade como Flux, SDXL, ou um dos melhores geradores de imagem IA disponíveis em 2026. Revise o lote e escolha a imagem única que melhor representa sua visão.

A partir da imagem escolhida, use img2img ou IPAdapter para gerar variações em diferentes poses e expressões. O objetivo é construir um conjunto de dados de 15 a 30 imagens onde o personagem é reconhecivelmente a mesma pessoa, mas mostrado em variedade suficiente para que o LoRA aprenda a identidade do personagem em vez de memorizar uma pose única.

Passo 2: Curar e Preparar Seu Conjunto de Dados

Qualidade importa muito mais que quantidade para conjuntos de dados de treinamento LoRA. Tentei uma vez treinar um LoRA com 200 imagens de um personagem e obtive piores resultados que um conjunto cuidadosamente curado de 20. O grande conjunto de dados tinha muitas inconsistências, e o modelo aprendeu a média de todas essas variações em vez da "verdadeiro" personagem.

Eis o que seu conjunto de dados deve incluir:

- 5 a 8 retratos em close-up com expressões variadas (neutra, sorridente, séria, surpresa)

- 5 a 8 planos médios mostrando o tronco superior de diferentes ângulos

- 3 a 5 planos gerais com poses diferentes

- 2 a 3 imagens em trajes diferentes (se você quer flexibilidade de traje)

- Todas as imagens devem ter fundos limpos (cores sólidas funcionam melhor)

- A resolução deve ser pelo menos 512x512, idealmente 1024x1024

Marque cada imagem com uma palavra-chave de acionamento consistente para seu personagem (algo único como "chrNAME" ou "sks_character") e descrições precisas da pose, expressão e roupas.

Passo 3: Configure e Execute o Treinamento

Para configuração de treinamento, essas configurações funcionam bem como ponto de partida para LoRAs de personagem em modelos Flux ou SDXL:

- Taxa de aprendizado: 1e-4 para Flux, 5e-5 para SDXL

- Passos de treinamento: 1.500 a 3.000 (mais nem sempre é melhor)

- Rank de rede: 32 a 64 (maior captura mais detalhes, mas riscos de sobreajuste)

- Alpha de rede: Metade do seu valor de rank (16 a 32)

- Resolução: 1024x1024

- Tamanho do lote: 1 a 2 (limitado por VRAM)

- Otimizador: AdamW ou Prodigy (Prodigy auto-ajusta taxa de aprendizado)

Sempre executo uma geração de teste no meio do caminho. Se o personagem já é reconhecível no passo 1.500, você provavelmente não precisa treinar até 3.000. Treinamento excessivo torna o LoRA rígido, significando que reproduzirá suas imagens de treinamento muito literalmente e lutará com poses novas. Para uma mergulha mais profunda neste processo, nosso guia para criar modelos virtuais de IA cobre o pipeline de treinamento em detalhes.

Passo 4: Teste e Itere

Após o treinamento, teste seu LoRA com prompts que diferem significativamente dos seus dados de treinamento. Gere seu personagem em cenas e poses que não estavam no conjunto de treinamento. Isso lhe diz o quão bem o LoRA generalizou versus memorizou.

Problemas comuns e correções:

- O rosto parece certo, mas o corpo está errado: Adicione mais imagens de corpo inteiro ao seu conjunto de dados e retreine

- Personagem funciona apenas em uma pose: Seus dados de treinamento careciam de variedade, adicione poses mais diversas

- A saída se parece "queimada" ou super-saturada: Você treinou em excesso, reduza passos ou abaixe a taxa de aprendizado

- LoRA não tem efeito visível: Verifique sua palavra-chave de acionamento, aumente o peso do LoRA, ou verifique que o LoRA é compatível com seu modelo base

Passo-a-Passo: Usando IPAdapter para Consistência Rápida de Personagem

Quando você precisa de resultados rápidos e não quer investir horas em treinamento LoRA, IPAdapter é seu melhor amigo. Este fluxo de trabalho o leva de zero a personagens consistentes em menos de 30 minutos.

Configurando IPAdapter em ComfyUI

IPAdapter requer uma configuração específica em ComfyUI com nós personalizados IPAdapter Plus instalados. Você precisará do modelo de rosto especificamente para trabalho de consistência de personagem.

Fluxos de Trabalho ComfyUI Gratuitos

Encontre fluxos de trabalho ComfyUI gratuitos e de código aberto para as técnicas deste artigo. Open source é poderoso.

- Instale os nós personalizados ComfyUI-IPAdapter-Plus do GitHub

- Baixe o modelo IPAdapter de rosto (ip-adapter-faceid-plusv2_sd15.bin para SD 1.5 ou a variante SDXL)

- Baixe o modelo de análise InsightFace necessário

- Coloque modelos nos diretórios corretos dentro de sua instalação ComfyUI

O Fluxo de Trabalho

Uma vez instalado, o fluxo de trabalho é simples. Você fornece uma imagem de referência do seu personagem, e IPAdapter extrai características faciais que são injetadas no processo de difusão em camadas de atenção específicas.

Os parâmetros-chave para ajustar:

- Peso: Comece em 0.7 e ajuste. Valores mais altos (0.85+) produzem correspondências de rosto mais próximas, mas podem reduzir qualidade da imagem. Valores mais baixos (0.5 a 0.6) dão mais liberdade criativa mas consistência mais solta.

- Percentual de Início/Fim: Controla quando no processo de difusão a influência do IPAdapter começa e termina. Começar em 0% e terminar em 80% geralmente produz os melhores resultados.

- Modo de ID de Rosto: Use isso especificamente para consistência facial em vez do modo geral IPAdapter, que também transfere estilo e composição.

Opinião controversa: A maioria das pessoas usa peso IPAdapter muito alto. Definir em 0.9+ porque você quer "máxima consistência" na verdade degrada a saída. Você obtém artefatos de rosto, texturas de pele estranhas, e aquele "rosto colado" distintivo. Um peso de 0.65 a 0.75 fornece 90% da consistência sem nenhum artefato. Confie no modelo para fazer seu trabalho.

Combinando IPAdapter com um LoRA

É aqui que as coisas ficam poderosas. Use seu LoRA treinado para lidar com a identidade geral do personagem (forma de rosto, cabelo, proporções gerais) e camada IPAdapter no topo para trancar características faciais específicas para consistência extra. O LoRA fornece o "quem" enquanto IPAdapter reforça o "exatamente o que eles parecem."

Em meus testes, essa combinação empurrou consistência de cerca de 85% (apenas LoRA) para mais de 95%. O fluxo de trabalho em ComfyUI encadeia o carregador LoRA antes do condicionamento IPAdapter, então ambos influenciam a geração simultaneamente.

Em Apatero, esse tipo de pipeline de consistência multi-camadas executa automaticamente quando você cria um personagem e gera variações. A plataforma lida com empilhamento de modelo e ajuste de parâmetro nos bastidores, o que economiza tempo considerável comparado a construir o fluxo de trabalho ComfyUI do zero.

Passo-a-Passo: Usando Midjourney cref para Referências de Personagem

Para usuários do Midjourney que querem consistência de personagem sem sair da plataforma, o sistema cref é o caminho mais rápido.

Uso Básico

A sintaxe é simples. Gere ou forneça imagem de referência do seu personagem, então inclua em prompts futuros:

/imagine prompt: [descrição do personagem], [descrição da cena] --cref [URL da imagem] --cw 100

O parâmetro --cw controla peso de personagem:

- 100 (padrão): Corresponde rosto, cabelo, roupas e aparência geral

- 50 a 75: Corresponde rosto e cabelo, mas permite variações de roupa

- 0 a 25: Corresponde apenas estilo geral, referência de personagem solta

Dicas para Melhores Resultados do cref

Depois de passar semanas testando cref do Midjourney com vários tipos de personagem, encontrei vários padrões que consistentemente melhoram resultados.

Primeiro, sua imagem de referência importa enormemente. Um retrato limpo, bem iluminado com o personagem centralizado no quadro funciona dez vezes melhor que uma cena complexa onde o personagem é parcialmente obscurecido. Se sua melhor imagem de personagem os tem em uma pose de ação contra um fundo ocupado, reserve tempo para gerar uma versão de retrato limpo primeiro e use isso como sua fonte cref.

Segundo, seja explícito sobre o que deve mudar versus o que deve permanecer igual. Se você quer seu personagem em um novo traje, mas com o mesmo rosto, abaixe o peso de personagem para cerca de 50 e descreva o novo traje em seu prompt. Se você quer tudo idêntico exceto a cena, mantenha peso de personagem em 100 e apenas descreva o novo ambiente.

Terceiro, Midjourney lida com consistência de mesmo-estilo melhor que consistência de cross-estilo. Se sua referência é uma imagem fotorrealista e você tenta gerar uma versão de desenho animado desse personagem, a consistência cai drasticamente. Mantenha o mesmo estilo geral de sua referência para melhores resultados.

Criando Fichas de Personagem de IA Efetivas e Referências de Turnaround

Uma ficha de personagem é sua arma secreta independentemente de qual abordagem de gerador de personagem consistente em IA você usa. Pense nela como um dicionário visual para seu personagem que qualquer método pode referenciar.

O Que Vai em uma Ficha de Personagem

Uma boa ficha de turnaround de personagem em IA inclui várias vistas essenciais.

Quer pular a complexidade? Apatero oferece resultados profissionais de IA instantaneamente sem configuração técnica.

A vista frontal deve ser uma pose em pé neutra, braços ligeiramente afastados do corpo para que a roupa inteira seja visível. Esta é sua referência "padrão" que captura a versão mais reconhecível do seu personagem. Inclua uma vista de close-up de rosto com expressão neutra, mostrando características faciais distintivas claramente.

Perfis laterais (esquerdo e direito) revelam a silhueta do personagem, estilo de cabelo de outro ângulo, e qualquer característica específica do perfil como jóias, cicatrizes ou ornamentos de cabelo. Uma vista traseira é essencial se seu personagem tem detalhes distintivos nas costas como comprimento de cabelo, capa, mochila ou tatuagens.

Folhas de expressão mostrando o mesmo personagem com diferentes emoções (feliz, triste, zangado, surpreso, determinado) ajudam quando você precisa de range emocional em suas cenas de história. Essas também fornecem dados de treinamento excelentes para LoRAs porque ensinam ao modelo que a identidade do seu personagem persiste em diferentes estados emocionais.

Gerando uma Ficha de Personagem com IA

Aqui está uma abordagem prática que uso ao criar fichas de personagem para novos personagens originais.

Comece gerando sua imagem de personagem definitiva. Uma vez que você travou o design, use uma combinação de seu método preferido (LoRA, IPAdapter ou cref) com prompting específico para gerar cada vista de ficha. Uma estrutura de prompt como essa funciona bem:

character sheet, multiple views, front view, side view, back view,

three-quarter view, [sua descrição de personagem], white background,

reference sheet, concept art, clean linework

Se a abordagem de prompt único não produzir bons resultados (frequentemente não produz), gere cada vista separadamente e componha-as manualmente em um editor de imagem. Isso leva mais tempo, mas dá muito melhor controle sobre cada vista.

Devo notar que este processo ficou dramaticamente mais fácil em 2026 comparado até um ano atrás. Modelos como Flux e os últimos ajustes finos SDXL lidam com geração multi-vista muito mais confiável do que modelos mais antigos faziam. Se você tentou essa abordagem em 2024 e desistiu, vale a pena revisitar.

Comparando Todas as Abordagens: Qual Método Você Deve Escolher?

Vou ser direto sobre o que funciona e o que não funciona, baseado em testes extensivos em todos os quatro métodos.

| Método | Escore de Consistência | Tempo de Configuração | Velocidade Por-Imagem | Melhor Para |

|---|---|---|---|---|

| Treinamento LoRA | 85-95% | 2-4 horas | Rápido (uma vez treinado) | Projetos longos, trabalho profissional |

| IPAdapter/InstantID | 70-85% | 30 minutos | Médio | Prototipagem rápida, referência de rosto real |

| Midjourney cref | 60-80% | 5 minutos | Rápido | Uso casual, conteúdo de mídia social |

| Apenas Fichas de Personagem | 40-60% | 1 hora | Varia | Material de referência suplementar |

Opinião controversa: O método "melhor" depende completamente do escopo do seu projeto, e a maioria das pessoas escolhe errado. Iniciantes gravitam para cref porque é fácil, então ficam frustrados quando a consistência se quebra depois de 10 imagens. Usuários experientes às vezes sobre-engineram pipelines LoRA para projetos que precisam apenas de cinco imagens consistentes. Combine seu método com suas necessidades reais. Se você está fazendo um quadrinho de 50 páginas, invista em treinamento LoRA. Se você está fazendo um post social de três imagens, cref ou IPAdapter o servirão bem.

Para projetos envolvendo personagens de anime em IA, requisitos de consistência são ainda mais altos porque estilos de anime têm características mais exageradas e específicas que são mais difíceis de manter. Pequenas variações no tamanho dos olhos, estilo de cabelo ou saturação de cor são mais nítidas em anime que em estilos fotorrealistas.

Dicas Avançadas para Manter Consistência de Personagem em IA

Além dos métodos principais, várias técnicas avançadas podem empurrar sua consistência ainda mais. Essas são as dicas que aprendi de centenas de horas de trabalho de geração de personagem.

Use Trancamento de Seed Estrategicamente

Fixar a seed aleatória não garante consistência de personagem (não é um botão mágico), mas pode ajudar quando usado ao lado de outros métodos. Uma seed fixa com o mesmo prompt produzirá a mesma imagem, mas mudar o prompt mesmo ligeiramente produzirá um resultado diferente. O truque é mudar apenas as partes da sua descrição relevantes à cena enquanto mantém descrições de personagem idênticas, então trancar a seed para minimizar a variação de padrão de ruído.

Construa um Modelo de Prompt

Crie uma estrutura de prompt padronizada para seu personagem e use-a como modelo para cada geração. Algo como isto:

[DESCRIÇÃO DA CENA], [PALAVRA-CHAVE DE ACIONAMENTO DE PERSONAGEM], [bloco de descrição de personagem fixo],

[pose/ação], [ângulo de câmera], [iluminação]

O bloco de descrição de personagem deve ser idêntico em todos os prompts. Copie e cole cada vez. Prompting inconsistente é uma das maiores fontes de desvio de personagem, e capturei a mim mesmo cometendo esse erro mais vezes do que eu gostaria de admitir.

Ganhe Até $1.250+/Mês Criando Conteúdo

Junte-se ao nosso programa exclusivo de afiliados criadores. Seja pago por vídeo viral com base no desempenho. Crie conteúdo no seu estilo com total liberdade criativa.

Gere em Lotes, Não Um de Cada Vez

Ao criar múltiplas cenas para uma história ou projeto, gere lotes para cada cena e escolha a dedo os melhores resultados em vez de tentar fazer cada imagem perfeita em sequência. Isso oferece mais controle sobre qualidade e permite escolher as saídas onde o personagem parece mais consistente com sua referência estabelecida.

Aproveite Pós-processamento de Correção de Rosto

Às vezes você obtém uma imagem quase-perfeita onde o rosto do personagem está ligeiramente errado. Ferramentas como CodeFormer ou GFPGAN podem limpar detalhes faciais sem mudar a identidade do personagem. Em ComfyUI, você pode integrar essas como passos de pós-processamento em seu fluxo de trabalho para que cada saída obtenha refinamento facial automático.

Use Iluminação Consistente e Ângulos de Câmera

Isso é subestimado. Se sua cena muda dramaticamente a iluminação (indo de luz do dia para luz de vela, por exemplo), o personagem parecerá naturalmente diferente mesmo com técnicas de consistência perfeitas. Ao testar sua configuração, mantenha iluminação consistente primeiro para validar que seu método de personagem está funcionando, então introduza variações de iluminação gradualmente.

Armadilhas Comuns e Como Evitá-las

Nos últimos dois anos trabalhando com consistência de personagem em IA, vi os mesmos erros repetirem-se continuamente. Aqui está o que observar.

Armadilha 1: Sobre-descrever seu personagem em prompts. Quando as pessoas lutam com consistência, seu instinto é adicionar mais detalhes ao prompt. "Olhos azuis com flocos de ouro, nariz em botão com leve inclinação para cima, rosto em formato de coração com maçãs do rosto altas..." Este nível de detalhe na verdade prejudica porque o modelo não pode reproduzir consistentemente tantas características faciais específicas. Mantenha descrições de personagem para 3 a 5 características de identificação chave e deixe o LoRA ou sistema de referência lidar com o resto.

Armadilha 2: Misturar métodos incompatíveis. Nem todas as técnicas de consistência funcionam bem juntas. Usar IPAdapter com um peso muito alto ao lado de um LoRA forte pode criar sinais conflitantes que produzem saídas confusas. Ao combinar métodos, comece com pesos baixos para ambos e gradualmente aumente até encontrar o ponto de equilíbrio.

Armadilha 3: Ignorar consistência de razão de aspecto. Alternar entre razões de aspecto retrato, paisagem e quadrado entre cenas introduz mais variação do que você pode esperar. Seu personagem foi provavelmente gerado e treinado em uma razão de aspecto específica, e se desviar dela muda como o modelo aloca pixels para o personagem versus o fundo.

Armadilha 4: Treinar LoRAs em dados inconsistentes. Se suas imagens de treinamento já mostram variação significativa na aparência do personagem, o LoRA aprenderá essa variação. Lixo entra, lixo sai. Gaste o tempo para curar seu conjunto de dados implacavelmente. Remova qualquer imagem onde as características do personagem diferem do seu design pretendido.

Armadilha 5: Não salvar suas configurações de trabalho. Quando você finalmente obtém um pipeline de geração que produz resultados consistentes, documente cada configuração: o modelo, peso do LoRA, peso do IPAdapter, seed, prompt, sampler, passos, escala CFG, tudo. Seu eu futuro agradecerá seu eu presente quando precisar gerar mais imagens seis meses depois.

Serviços como Apatero resolvem muitas dessas armadilhas padronizando o pipeline e armazenando suas configurações de personagem automaticamente. Se você se encontra gastando mais tempo debugando sua configuração de consistência do que criando conteúdo na verdade, pode valer a pena explorar soluções gerenciadas.

Aplicações do Mundo Real de Personagens de IA Consistentes

Compreender por que as pessoas precisam de um gerador de personagem consistente em IA ajuda a esclarecer qual abordagem encaixa seu caso de uso.

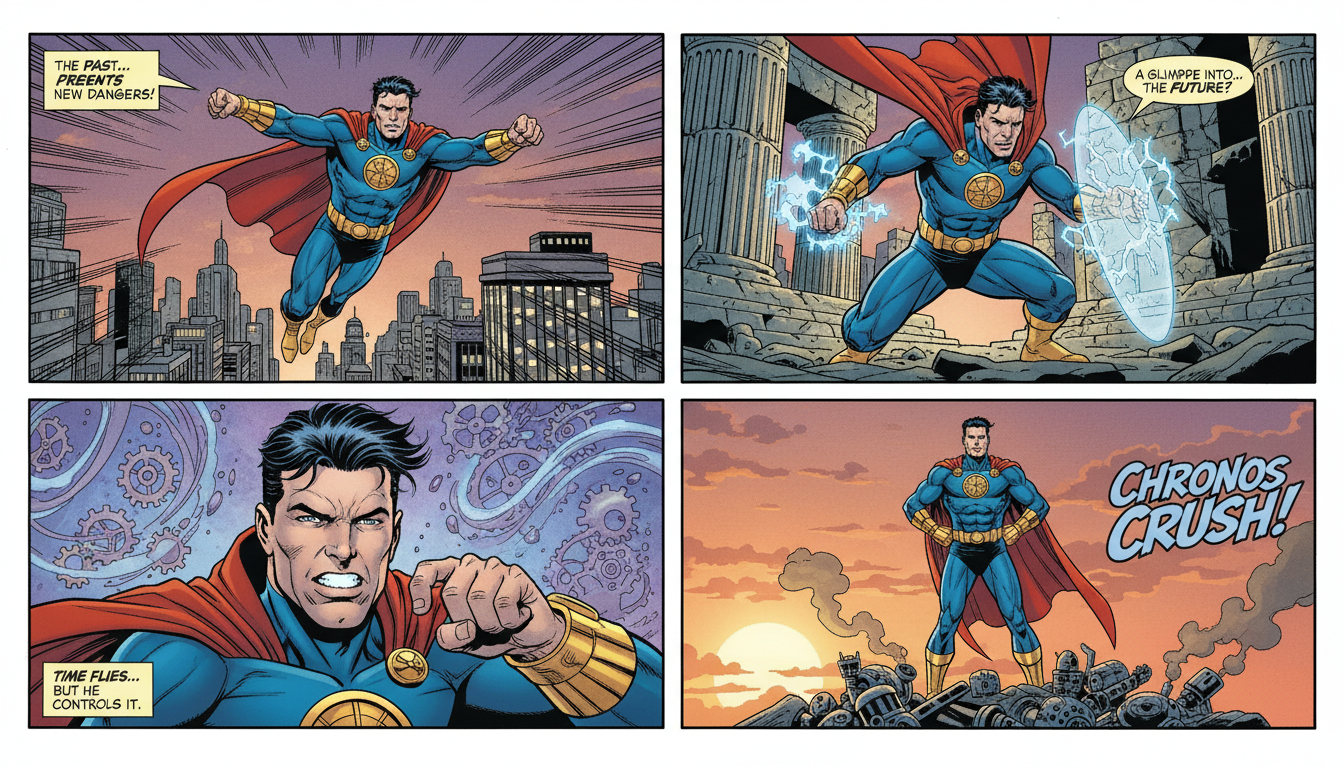

Criação de Romance Visual e Quadrinho

Esta é uma das aplicações mais exigentes porque leitores notarão imediatamente se aparência de personagem muda entre painéis. Um único romance visual pode requerer centenas de imagens dos mesmos personagens em cenas diferentes, expressões e trajes. Treinamento LoRA é praticamente obrigatório aqui, frequentemente combinado com IPAdapter para controle de expressão. Os requisitos de consistência de personagem da história de IA são os mais altos nesta categoria.

Influenciadores de IA de Mídia Social

Influenciadores de IA precisam parecer a mesma pessoa em cada post. Seguidores se envolvem com uma personalidade, e a consistência visual é o que torna essa personalidade parecer real. Esta é uma área onde a combinação de treinamento LoRA e modelos de prompt cuidadosos brilha. Para um guia abrangente para esta aplicação específica, confira nosso guia de gerador de modelo de IA.

Pré-produção de Jogo e Animação

Artistas conceituais usam ferramentas de consistência de personagem em IA para iterar rapidamente designs de personagem em múltiplos ambientes e cenários. A consistência não precisa ser pixel-perfeita aqui já que a saída de IA é material de referência que será refinado por artistas humanos. IPAdapter ou até cref funciona bem para este caso de uso porque velocidade importa mais que perfeição.

Ilustração de Livro Infantil

Personagens consistentes em 20 a 30 ilustrações, frequentemente em cenas dramaticamente diferentes e com várias expressões emocionais. Este é um ponto ideal para a abordagem LoRA mais ficha de personagem, onde você treina um LoRA e também mantém uma folha de referência que você usa para verificações manuais de consistência.

O Futuro da Consistência de Personagem em IA

O campo está se movendo rápido. Quando primeiro escrevi sobre técnicas de consistência de personagem em 2024, treinamento LoRA era a única opção confiável e exigia habilidade técnica significativa. Agora em 2026, temos múltiplas abordagens em diferentes níveis de acessibilidade, e a brecha de qualidade entre elas está encolhendo.

Várias tendências valem observação. Primeiro, características nativas de consistência de personagem estão sendo construídas nos modelos de geração em si em vez de requerer ferramentas externas. O sistema cref do Midjourney foi um exemplo inicial, e modelos mais novos da Stability AI e Black Forest Labs estão incorporando preservação de identidade diretamente em suas arquiteturas.

Segundo, treinamento está ficando mais rápido e barato. O que costumava levar 3 horas em uma GPU A100 alugada agora leva 45 minutos em hardware do consumidor. Esta democratização significa mais criadores podem acessar consistência de nível LoRA sem quebrar o banco.

Terceiro, e isso talvez seja o desenvolvimento mais emocionante, consistência de múltiplos personagens está se tornando viável. Manter dois ou três personagens consistentes na mesma cena era quase impossível um ano atrás, mas avanços recentes em manipulação de atenção e carregamento de múltiplos LoRAs estão tornando prático. Você pode agora contar uma história com um elenco inteiro, não apenas um protagonista único.

Em Apatero.com, temos estado rastreando esses desenvolvimentos closely e integrando novas técnicas de consistência conforme elas amadurecem. O objetivo é tornar consistência de personagem algo que você configure uma vez e então esqueça, deixando você focar no trabalho criativo de contar histórias e construir mundos.

Perguntas Frequentes

Qual é o melhor gerador de personagem consistente em IA para iniciantes?

Midjourney com o parâmetro cref é o ponto de entrada mais fácil porque não requer configuração técnica. Carregue uma imagem de referência, adicione --cref [URL] ao seu prompt, e você obterá resultados razoavelmente consistentes. Para melhor qualidade com mais controle, tente IPAdapter em ComfyUI. Para consistência de nível profissional, invista em treinamento LoRA.

Posso manter o mesmo rosto em imagens de IA sem qualquer treinamento?

Sim, IPAdapter e InstantID permitem manter consistência facial usando apenas uma imagem de referência, sem treinamento necessário. A consistência não é tão alta quanto um LoRA treinado (aproximadamente 70 a 85% versus 85 a 95%), mas funciona bem para muitos casos de uso. Midjourney cref também consegue isto sem treinamento, embora com menos controle.

Quantas imagens de referência eu preciso para um personagem LoRA?

Entre 15 e 30 imagens funcionam melhor. Menos de 10 imagens geralmente não dá ao modelo informação suficiente para generalizar seu personagem a poses novas. Mais de 50 imagens introduz muita variação a menos que cada imagem seja extremamente consistente. Foque em qualidade e variedade de ângulos em vez de quantidade bruta.

Por que meu personagem de IA parece diferente em cada imagem apesar de usar o mesmo prompt?

Prompts de texto sozinhos não podem garantir consistência porque modelos de difusão geram a partir de ruído aleatório cada vez. O mesmo prompt produz interpretação válida mas diferente com cada geração. Você precisa de um método de condicionamento (LoRA, IPAdapter, cref ou imagens de referência) que fornece informação de identidade visual além do que o texto pode expressar.

O que é Midjourney cref e como funciona?

O parâmetro cref (referência de personagem) do Midjourney permite passar uma imagem de referência que o modelo usa para manter aparência de personagem. Você adiciona --cref [URL da imagem] ao seu prompt, e --cw [0-100] para controlar o quão fortemente segue a referência. Em cw 100, tenta corresponder rosto, cabelo e roupa. Em valores mais baixos, foca principalmente no rosto.

Vale a pena treinamento LoRA para apenas algumas imagens?

Se você precisa apenas de 3 a 5 imagens consistentes, treinamento LoRA é provavelmente excessivo. Use IPAdapter ou cref em vez disso para projetos rápidos. Treinamento LoRA compensa quando você precisa de 20+ imagens do mesmo personagem, planeja usar o personagem longo-termo, ou precisa da máxima consistência possível para trabalho profissional.

Posso usar o mesmo personagem em diferentes estilos de arte em IA?

Este é um dos desafios de consistência mais difíceis. Um personagem projetado em um estilo fotorrealista parecerá diferente quando renderizado em anime, aquarela ou pixel art. Treinamento LoRA lida com consistência cross-estilo melhor que métodos baseados em referência porque aprende a identidade do personagem em nível mais profundo. Porém, você pode precisar LoRAs separados para estilos dramaticamente diferentes.

Como faço para criar uma ficha de personagem em IA para referência?

Gere seu personagem de múltiplos ângulos (frente, lateral, costas, três quartos) e componha essas vistas em uma imagem única. Use um prompt contendo "character sheet, multiple views, reference sheet, white background" junto com sua descrição de personagem. Gere cada vista separadamente se o modelo tem dificuldade produzindo todas as vistas em uma imagem.

Qual é a diferença entre IPAdapter e InstantID?

Ambos extraem características de imagens de referência, mas focam em diferentes aspectos. IPAdapter captura características visuais gerais incluindo estilo, composição e rosto. InstantID é especificamente projetado para preservação de identidade facial, usando embeddings InsightFace para corresponder geometria facial precisamente. Para consistência de personagem, InstantID tipicamente produz correspondências de rosto melhores enquanto IPAdapter oferece consistência geral de estilo melhor.

Posso manter consistência de personagem em vídeos gerados em IA?

Sim, mas é mais desafiador que imagens estáticas. Modelos de geração de vídeo como Wan e Kling estão melhorando em consistência temporal, e você pode usar LoRAs com alguns modelos de vídeo. A abordagem mais confiável atual é gerar quadros-chave com técnicas de imagem estática consistente de personagem e então interpolar entre eles com um modelo de vídeo.

Resumindo

Obter um personagem de IA consistente em múltiplas imagens não é mais a tarefa impossível que era até um ano atrás. As ferramentas amadureceram, as técnicas são bem-documentadas, e há opções em cada nível de habilidade e orçamento.

Se você levar uma coisa deste guia, que seja isto: combine seu método com o escopo do seu projeto. Não sobre-engineer uma solução para um projeto simples, e não sub-invista em consistência para um projeto que o exige. Comece com a abordagem mais simples que atende suas necessidades e adicione complexidade apenas quando os resultados a exigem.

A paisagem de gerador de personagem consistente em IA continuará evoluindo, e o que se parece inovador hoje provavelmente será rotina em um ano. Mas os fundamentos de boas imagens de referência, prompting consistente e escolher a ferramenta certa para o trabalho permanecerão relevantes independentemente de quais novas técnicas surgirem.

Para atualizações contínuas sobre ferramentas e técnicas de consistência de personagem em IA, continue verificando aqui. E se você quiser pular a configuração técnica inteiramente e focar em criar personagens, tente Apatero. Foi construído especificamente para esse tipo de fluxo de trabalho criativo.

Pronto para Criar Seu Influenciador IA?

Junte-se a 115 alunos dominando ComfyUI e marketing de influenciadores IA em nosso curso completo de 51 lições.

Artigos Relacionados

Arte com IA para Desenvolvedores de Jogos: Guia Completo de Criação de Assets

Aprenda como desenvolvedores indie usam IA para concept art, sprites, backgrounds e UI. Fluxos de trabalho práticos para integrar IA em pipelines de assets de jogos.

Como Criar Capas de Livro Profissionais com IA para Auto-Publicação

Projete capas de livro deslumbrantes usando geradores de imagem com IA. Guia completo para autores auto-publicados cobrindo todos os gêneros de fantasia a romance a thriller.

Criando Personagens Consistentes para Quadrinhos com IA: Tutorial Completo

Aprenda como gerar personagens consistentes em múltiplos painéis e páginas usando geradores de imagem em IA. Domine técnicas de prompting para criação de quadrinhos.