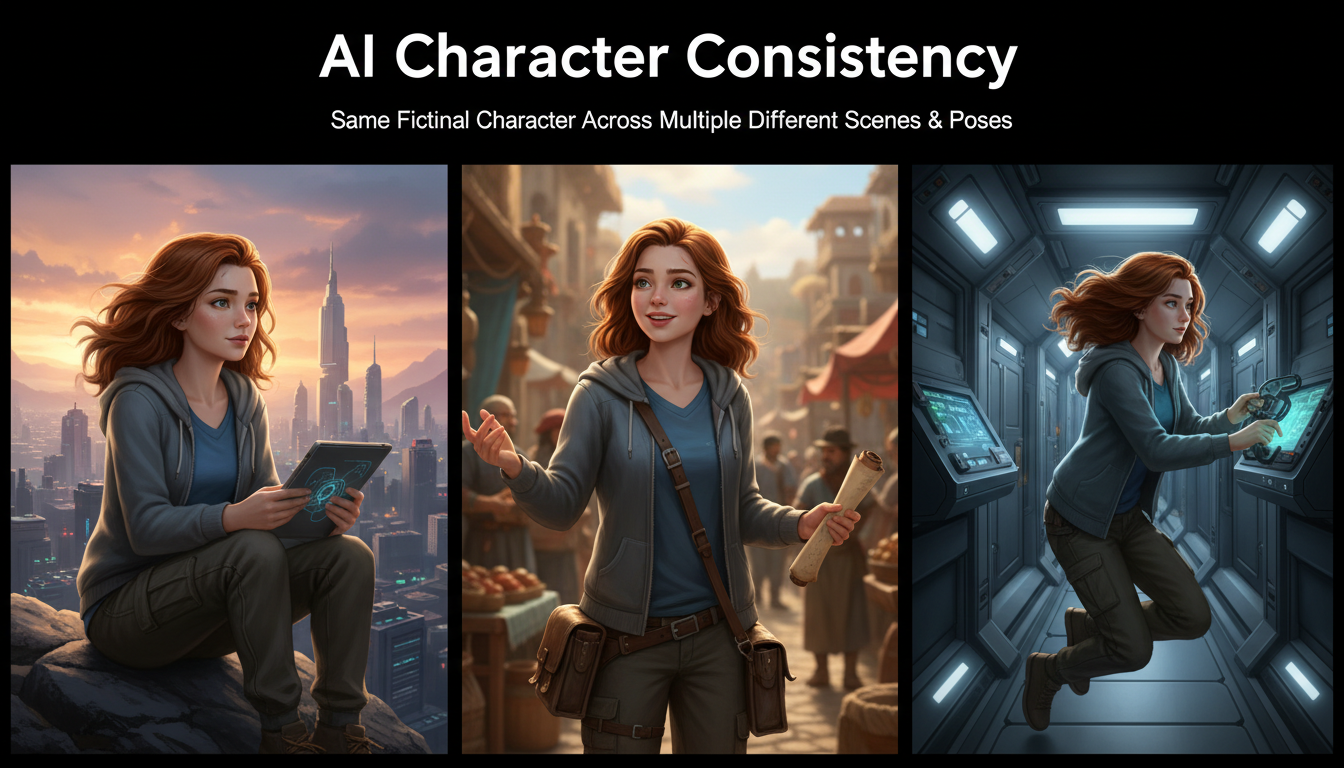

Générateur de Personnages Cohérents par IA : Comment Garder le Même Personnage sur Plusieurs Images

Apprenez à générer le même personnage par IA sur plusieurs scènes en utilisant l'entraînement LoRA, IPAdapter, cref Midjourney et les techniques d'images de référence. Guide complet 2026.

Si vous avez jamais essayé de raconter une histoire visuelle avec des images générées par IA, vous connaissez déjà la douleur. Vous créez une première image parfaite de votre personnage, passez à la scène suivante, et soudain l'IA vous donne quelqu'un qui ressemble à un cousin au mieux. Les cheveux sont différents, la forme du visage a changé, et la tenue pourrait tout aussi bien appartenir à une personne complètement différente. C'est la plus grande frustration unique pour quiconque construit des BD, des romans visuels, des storyboards ou du contenu de médias sociaux avec des outils d'art IA.

Réponse Rapide : Un générateur de personnages cohérents par IA utilise des techniques comme l'affinage LoRA, l'intégration faciale IPAdapter, le paramètre cref de Midjourney, ou des images de référence structurées pour maintenir l'identité du personnage sur plusieurs images générées. Les meilleurs résultats proviennent de la combinaison d'au moins deux méthodes. L'entraînement LoRA sur 15 à 30 images de référence offre la cohérence la plus élevée (environ 90%), tandis que les méthodes basées sur les références comme cref ou IPAdapter offrent une mise en place plus rapide avec une fidélité légèrement inférieure (70 à 85%). Votre choix dépend de vos besoins : cohérence parfaite pour les projets professionnels ou « assez bien » pour l'exploration créative rapide.

- L'entraînement LoRA fournit la meilleure cohérence des personnages mais nécessite un investissement de temps en amont (2 à 4 heures de configuration et d'entraînement)

- IPAdapter et InstantID offrent un milieu de route sans entraînement requis, juste des images de référence

- Le paramètre cref de Midjourney est le point d'entrée le plus facile mais vous donne le moins de contrôle

- La combinaison de méthodes (LoRA plus IPAdapter, par exemple) produit les résultats les plus fiables

- Les feuilles de personnages et les références en turnaround améliorent considérablement la cohérence indépendamment de la méthode que vous utilisez

- Des outils comme Apatero gèrent la complexité technique en arrière-plan pour les créateurs qui veulent des résultats sans construire de pipelines

Pourquoi la Cohérence des Personnages est le Plus Difficile Problème en Génération d'Images IA

La cohérence des personnages est fondamentalement en désaccord avec la façon dont les modèles de diffusion fonctionnent. Ces modèles génèrent des images en commençant par le bruit et en l'affinant graduellement en quelque chose qui correspond à votre description textuelle. Chaque génération commence à partir d'un modèle de bruit différent, ce qui signifie que chaque sortie est unique. C'est excellent pour la variété mais terrible pour maintenir une identité cohérente.

J'ai d'abord rencontré ce problème il y a environ deux ans quand j'ai essayé de construire une courte bande dessinée en utilisant Stable Diffusion. J'avais un personnage que j'aimais beaucoup à partir de ma génération initiale : une femme rousse dans une veste en cuir avec une cicatrice distinctive au-dessus de son sourcil gauche. Le panel très suivant nécessitait qu'elle soit dans une pose différente, et après 80 générations je ne pouvais pas obtenir quelqu'un qui lui ressemble à distance. Ce projet m'a appris une leçon critique : les prompts textuels seuls ne peuvent pas résoudre la cohérence des personnages, peu importe à quel point vous les détaillez.

La raison est simple. Quand vous écrivez « femme rousse avec cicatrice au-dessus du sourcil gauche », le modèle interprète cette description fraîchement à chaque fois. Sa représentation interne d'une « femme rousse » varie entre les générations car l'espace latent est énorme. Deux images correspondant au même prompt textuel peuvent ressembler à des personnages très différents tout en étant techniquement des interprétations correctes de vos paroles.

C'est pourquoi les techniques dédiées à la cohérence des personnages par IA sont devenues si importantes. Que vous construisiez une bibliothèque de personnages de roman visuel par IA, créiez du matériel marketing avec une mascotte de marque, ou développiez de l'art de concept pour un jeu, vous avez besoin d'outils qui vont au-delà du prompt simple.

Les Quatre Approches Principales à la Génération Cohérente de Personnages IA

Avant de plonger dans les flux de travail spécifiques, il aide de comprendre le paysage. Il y a quatre approches principales au maintien d'un personnage cohérent par IA sur les scènes, et chacune siège à un point différent sur le spectre effort-versus-qualité.

1. Affinage LoRA (Qualité Maximale, Plus d'Effort)

L'entraînement LoRA enseigne au modèle d'IA ce que votre personnage spécifique ressemble à un niveau profond. Vous le nourrissez avec 15 à 30 images curées de votre personnage, et il crée un petit fichier d'adaptateur (généralement 10 à 150MB) qui modifie le comportement du modèle. Quand vous activez ce LoRA pendant la génération, le modèle « sait » votre personnage et peut le rendre dans n'importe quelle pose ou scène tout en maintenant l'identité de base.

Je considère l'entraînement LoRA non-négociable pour tout projet sérieux de personnage. La cohérence que vous obtenez est incomparable à toute autre méthode. Si vous voulez comprendre les fondamentaux de la façon dont cela fonctionne, consultez notre guide complet du débutant pour l'entraînement LoRA.

Meilleur pour : Projets de personnages à long terme, romans visuels, BD, mascotes de marque, pipelines de contenu professionnel.

Inconvénients : Nécessite un ensemble de données de votre personnage (problème poulet-et-œuf pour les nouveaux personnages), prend 1 à 3 heures de temps d'entraînement, nécessite un GPU décent ou du compute cloud.

2. IPAdapter et InstantID (Bonne Qualité, Effort Modéré)

IPAdapter fonctionne en extrayant des traits faciaux et stylistiques à partir d'une image de référence et en injectant ces traits dans le processus de génération. Vous fournissez une ou plusieurs photos de référence de votre personnage, et IPAdapter conditionne le processus de diffusion pour correspondre à ces traits. InstantID est une approche similaire spécifiquement optimisée pour la préservation de l'identité du visage.

L'avantage ici est la vitesse. Vous n'avez pas besoin d'entraîner quoi que ce soit. Fournissez juste une image de référence et commencez à générer. Le compromis est que la cohérence baisse par rapport à LoRA, en particulier pour les traits non-faciaux comme les vêtements, le type de corps et les accessoires.

Meilleur pour : Prototypage rapide, personnages basés sur des personnes réelles (avec consentement), projets où la cohérence faciale compte le plus.

Inconvénients : Lutte avec les changements extrêmes de pose, peut perdre les détails des vêtements et des accessoires, parfois produit un effet « vallée contraire » où le visage est cohérent mais tout le reste change.

3. Midjourney cref (Le Plus Facile, Le Moins de Contrôle)

Le paramètre de référence de personnage de Midjourney (cref) est l'option la plus accessible pour les débutants. Vous passez simplement une URL d'image de référence avec le drapeau --cref, et Midjourney tente de maintenir l'apparence du personnage dans les nouvelles générations. Le paramètre --cw (poids du personnage) vous permet de contrôler la force avec laquelle il adhère à la référence.

Mon avis vif : Midjourney cref est sur-estimé pour le travail sérieux. C'est fantastique pour l'exploration casual et le contenu de médias sociaux, mais la cohérence s'effondre significativement quand vous avez besoin de votre personnage dans des poses complexes, des conditions d'éclairage différentes, ou des scènes stylistiquement différentes. J'ai testé cela extensivement et je trouve que cela fonctionne environ 70% du temps pour les transferts simples de portrait à portrait, mais baisse à environ 40% de fiabilité quand vous changez la scène dramatiquement. Pour la narration visuelle professionnelle, vous atteindrez un mur vite.

Meilleur pour : Contenu de médias sociaux, exploration casual de personnages, art de concept rapide, utilisateurs de Midjourney qui ne veulent pas apprendre de nouveaux outils.

Inconvénients : Verrouillé sur l'écosystème Midjourney, contrôle limité sur les aspects du personnage qui sont préservés, pas d'ajustabilité fine-grain.

4. Images de Référence Structurées et Feuilles de Personnage (Supplémentaire)

Une feuille de turnaround de personnage IA est une seule image montrant votre personnage sous plusieurs angles : face, côté, arrière, et vues trois-quarts. Ces feuilles servent de références complètes que vous pouvez utiliser avec l'une des méthodes ci-dessus pour améliorer la cohérence. Elles ne sont pas une solution autonome mais plutôt un multiplicateur de force.

Créer une bonne feuille de personnage implique de générer votre personnage dans une pose neutre sous plusieurs angles, puis de composer ces vues dans une seule image de référence. Cela donne à la méthode de cohérence que vous utilisez plus d'information avec laquelle travailler.

Étape par Étape : Construire un LoRA de Personnage pour la Cohérence Maximale

C'est le flux de travail d'or-standard pour quiconque a besoin d'une cohérence de personnage fiable et répétable. Je vais vous guider à travers l'ensemble du processus du création d'ensemble de données au déploiement.

Étape 1 : Créer le Design Initiale de Votre Personnage

Si votre personnage n'existe pas encore, vous devez d'abord le générer. C'est le défi de bootstrapping. Voici mon approche recommandée.

Commencez par générer un grand lot d'images (50 à 100) avec un prompt détaillé décrivant votre personnage. Utilisez un modèle de base haute qualité comme Flux, SDXL, ou l'un des meilleurs générateurs d'images IA disponibles en 2026. Examinez le lot et choisissez la seule image qui représente le mieux votre vision.

À partir de cette image choisie, utilisez img2img ou IPAdapter pour générer des variations dans des poses et des expressions différentes. L'objectif est de construire un ensemble de données de 15 à 30 images où le personnage est clairement la même personne mais montré dans assez de variété pour que le LoRA apprenne l'identité du personnage plutôt que de mémoriser une seule pose.

Étape 2 : Sélectionner et Préparer Votre Ensemble de Données

La qualité prime sur la quantité pour les ensembles de données d'entraînement LoRA. Une fois, j'ai essayé d'entraîner un LoRA avec 200 images d'un personnage et j'ai obtenu pire résultats qu'un ensemble soigneusement sélectionné de 20. Le grand ensemble de données avait trop d'incohérences, et le modèle a appris la moyenne de toutes ces variations plutôt que le personnage « vrai ».

Voici ce que votre ensemble de données devrait inclure :

- 5 à 8 gros plans avec expressions variées (neutre, souriant, sérieux, surpris)

- 5 à 8 plans moyens montrant le haut du corps sous différents angles

- 3 à 5 plans entiers avec des poses différentes

- 2 à 3 images en tenues différentes (si vous voulez flexibilité de tenue)

- Toutes les images devraient avoir des arrière-plans propres (les couleurs solides fonctionnent le mieux)

- La résolution devrait être au moins 512x512, idéalement 1024x1024

Étiquetez chaque image avec un mot de déclenchement cohérent pour votre personnage (quelque chose d'unique comme « chrNAME » ou « sks_character ») et des descriptions précises de la pose, l'expression et les vêtements.

Étape 3 : Configurer et Exécuter l'Entraînement

Pour la configuration de l'entraînement, ces paramètres fonctionnent bien comme point de départ pour les LoRA de personnages sur les modèles Flux ou SDXL :

- Taux d'apprentissage : 1e-4 pour Flux, 5e-5 pour SDXL

- Étapes d'entraînement : 1 500 à 3 000 (plus n'est pas toujours mieux)

- Rang réseau : 32 à 64 (plus élevé capture plus de détails mais risque le surapprentissage)

- Alpha réseau : Moitié votre valeur de rang (16 à 32)

- Résolution : 1024x1024

- Taille de lot : 1 à 2 (limité par VRAM)

- Optimiseur : AdamW ou Prodigy (Prodigy auto-ajuste le taux d'apprentissage)

J'exécute toujours une génération de test à la marque de mi-parcours. Si le personnage est déjà reconnaissable à l'étape 1 500, vous n'avez probablement pas besoin d'entraîner jusqu'à 3 000. L'surapprentissage rend le LoRA rigide, ce qui signifie qu'il reproduira vos images d'entraînement trop littéralement et lutte avec les nouvelles poses. Pour une plongée plus approfondie dans ce processus, notre guide pour créer des modèles virtuels par IA couvre le pipeline d'entraînement en détail.

Étape 4 : Tester et Itérer

Après l'entraînement, testez votre LoRA avec des prompts qui diffèrent significativement de vos données d'entraînement. Générez votre personnage dans des scènes et des poses qui n'étaient pas dans l'ensemble d'entraînement. Cela vous dit comment bien le LoRA s'est généralisé par rapport à mémorisé.

Les problèmes communs et les corrections :

- Le visage semble correct mais le corps est mal : Ajoutez plus d'images de corps entier à votre ensemble de données et réentraînez

- Le personnage ne fonctionne que dans une pose : Vos données d'entraînement manquaient de variété, ajoutez plus de poses variées

- La sortie semble « brûlée » ou sur-saturée : Vous avez surappris, réduisez les étapes ou abaissez le taux d'apprentissage

- Le LoRA n'a pas d'effet visible : Vérifiez votre mot de déclenchement, augmentez le poids du LoRA, ou vérifiez que le LoRA est compatible avec votre modèle de base

Étape par Étape : Utiliser IPAdapter pour une Cohérence de Personnage Rapide

Quand vous avez besoin de résultats vite et que vous ne voulez pas investir des heures dans l'entraînement LoRA, IPAdapter est votre meilleur ami. Ce flux de travail vous obtient de zéro à des personnages cohérents en moins de 30 minutes.

Configurer IPAdapter dans ComfyUI

IPAdapter nécessite une configuration spécifique dans ComfyUI avec les nœuds personnalisés IPAdapter Plus installés. Vous aurez besoin du modèle facial spécifiquement pour le travail de cohérence des personnages.

Workflows ComfyUI Gratuits

Trouvez des workflows ComfyUI gratuits et open source pour les techniques de cet article. L'open source est puissant.

- Installez les nœuds personnalisés ComfyUI-IPAdapter-Plus à partir de GitHub

- Téléchargez le modèle de visage IPAdapter (ip-adapter-faceid-plusv2_sd15.bin pour SD 1.5 ou la variante SDXL)

- Téléchargez le modèle d'analyse InsightFace requis

- Placez les modèles dans les répertoires corrects dans votre installation ComfyUI

Le Flux de Travail

Une fois installé, le flux de travail est simple. Vous fournissez une image de référence de votre personnage, et IPAdapter extrait les traits faciaux qui se font injecter dans le processus de diffusion aux couches d'attention spécifiques.

Les paramètres clés à ajuster :

- Poids : Commencez à 0,7 et ajustez. Les valeurs plus élevées (0,85+) produisent des correspondances de visage plus proches mais peuvent réduire la qualité d'image. Les valeurs inférieure (0,5 à 0,6) donnent plus de liberté créative mais une cohérence plus lâche.

- Pourcentage Début/Fin : Contrôle quand dans le processus de diffusion l'influence d'IPAdapter commence et finit. Commencer à 0% et finir à 80% produit généralement les meilleurs résultats.

- Mode ID de Visage : Utilisez cela spécifiquement pour la cohérence du visage plutôt que le mode IPAdapter général, qui transfère également le style et la composition.

Mon avis vif : La plupart des gens utilisent le poids IPAdapter trop élevé. Régler à 0,9+ parce que vous voulez « la cohérence maximale » dégrade réellement la sortie. Vous obtenez des artefacts faciaux, des textures de peau bizarres et ce regard distinctif « visage collé ». Un poids de 0,65 à 0,75 vous donne 90% de la cohérence sans les artefacts. Faites confiance au modèle pour faire son travail.

Combiner IPAdapter avec un LoRA

C'est là que les choses deviennent puissantes. Utilisez votre LoRA entraîné pour gérer l'identité global du personnage (forme du visage, cheveux, proportions générales) et superposez IPAdapter pour verrouiller les traits faciaux spécifiques pour une cohérence supplémentaire. Le LoRA fournit le « qui » tandis que IPAdapter renforce le « exactement ce qu'ils ressemblent ».

Dans mes tests, cette combinaison a augmenté la cohérence d'environ 85% (LoRA seul) à plus de 95%. Le flux de travail dans ComfyUI chaîne le chargeur LoRA avant le conditionnement IPAdapter, donc les deux influencent la génération simultanément.

Sur Apatero, ce type de pipeline de cohérence multi-couches s'exécute automatiquement quand vous créez un personnage et générez des variations. La plateforme gère l'empilement de modèles et l'ajustement de paramètres en arrière-plan, ce qui économise du temps considérable comparé à la construction du flux de travail ComfyUI à partir de zéro.

Étape par Étape : Utiliser Midjourney cref pour les Références de Personnages

Pour les utilisateurs de Midjourney qui veulent une cohérence de personnage sans quitter la plateforme, le système cref est le chemin le plus rapide.

Utilisation Basique

La syntaxe est simple. Générez ou fournissez votre image de référence du personnage, puis incluez-la dans les prompts futurs :

/imagine prompt: [votre description du personnage], [description de la scène] --cref [URL image] --cw 100

Le paramètre --cw contrôle le poids du personnage :

- 100 (défaut) : Correspond au visage, cheveux, vêtements et apparence générale

- 50 à 75 : Correspond au visage et cheveux mais permet les variations de vêtements

- 0 à 25 : Correspond seulement au style général, référence de personnage lâche

Conseils pour de Meilleurs Résultats cref

Après avoir passé des semaines à tester Midjourney cref avec différents types de personnages, j'ai trouvé plusieurs modèles qui améliorent systématiquement les résultats.

D'abord, votre image de référence importe énormément. Un portrait propre et bien éclairé avec le personnage centré fonctionne dix fois mieux qu'une scène complexe où le personnage est partiellement obscurci. Si votre meilleure image de personnage les montre dans une pose d'action contre un arrière-plan occupé, prenez le temps de générer une version de portrait propre d'abord et utilisez celle-ci comme source cref.

Deuxièmement, soyez explicite sur ce qui devrait changer par rapport à ce qui devrait rester le même. Si vous voulez votre personnage en une nouvelle tenue mais avec le même visage, abaissez le poids du personnage à environ 50 et décrivez la nouvelle tenue dans votre prompt. Si vous voulez tout identique sauf la scène, maintenez le poids du personnage à 100 et décrivez seulement le nouvel environnement.

Troisièmement, Midjourney gère la cohérence même-style mieux que la cohérence entre-styles. Si votre référence est une image réaliste photographique et vous essayez de générer une version dessin animé de ce personnage, la cohérence chute nettement. Restez avec le même style général que votre référence pour les meilleurs résultats.

Créer des Feuilles de Personnage IA Efficaces et des Références en Turnaround

Une feuille de personnage est votre arme secrète indépendamment de quelle approche du générateur de personnage cohérent par IA vous utilisez. Pensez-la comme un dictionnaire visuel pour votre personnage que n'importe quelle méthode peut référencer.

Ce Qui Va Sur une Feuille de Personnage

Une bonne feuille de turnaround de personnage IA inclut plusieurs vues essentielles.

Envie d'éviter la complexité? Apatero vous offre des résultats IA professionnels instantanément sans configuration technique.

La vue de face devrait être une pose neutre debout, bras légèrement éloignés du corps pour que la tenue complète soit visible. C'est votre référence « par défaut » qui capture la version la plus reconnaissable de votre personnage. Incluez une vue en gros plan du visage avec une expression neutre, montrant les traits faciaux distinctifs clairement.

Les profils latéraux (gauche et droit) révèlent la silhouette du personnage, le style des cheveux sous un autre angle, et tous les traits spécifiques au profil comme les bijoux, les cicatrices ou les ornements de cheveux. Une vue arrière est essentielle si votre personnage a des détails arrière distinctifs comme la longueur des cheveux, une cape, un sac à dos ou des tatouages.

Les feuilles d'expression montrant le même personnage avec différentes émotions (heureux, triste, fâché, surpris, déterminé) aident quand vous avez besoin d'une gamme émotionnelle dans vos scènes d'histoire. Celles-ci fournissent aussi des données d'entraînement excellentes pour les LoRA parce qu'elles enseignent au modèle que l'identité de votre personnage persiste sur les états émotionnels.

Générer une Feuille de Personnage avec IA

Voici une approche pratique que j'utilise quand je crée des feuilles de personnage pour les nouveaux personnages originaux.

Commencez par générer votre image définitive du personnage. Une fois que vous avez le design verrouillé, utilisez une combinaison de votre méthode préférée (LoRA, IPAdapter ou cref) avec le prompting spécifique pour générer chaque vue de feuille. Une structure de prompt comme celle-ci fonctionne bien :

feuille de personnage, vues multiples, vue de face, vue de côté, vue arrière,

vue trois-quarts, [votre description du personnage], arrière-plan blanc,

feuille de référence, art de concept, dessin au trait propre

Si l'approche à prompt unique ne produit pas de bons résultats (elle souvent non), générez chaque vue séparément et composez-les manuellement dans un éditeur d'image. Cela prend plus de temps mais vous donne beaucoup mieux de contrôle sur chaque vue.

Je devrais noter que ce processus est devenu dramatiquement plus facile en 2026 comparé à même il y a un an. Les modèles comme Flux et les derniers fine-tunes SDXL gèrent la génération multi-vue beaucoup plus fiablement que les modèles plus anciens. Si vous avez essayé cette approche en 2024 et avez abandonné, cela vaut la peine de revisiter.

Comparer Toutes les Approches : Quelle Méthode Devez-Vous Choisir ?

Soyez direct sur ce qui fonctionne et ce qui ne fonctionne pas, basé sur les tests approfondis sur les quatre méthodes.

| Méthode | Score de Cohérence | Temps de Configuration | Vitesse par Image | Meilleur pour |

|---|---|---|---|---|

| Entraînement LoRA | 85-95% | 2-4 heures | Rapide (une fois entraîné) | Projets longs, travail professionnel |

| IPAdapter/InstantID | 70-85% | 30 minutes | Moyen | Prototypage rapide, référence de visage réel |

| Midjourney cref | 60-80% | 5 minutes | Rapide | Utilisation casual, contenu de médias sociaux |

| Feuilles de Personnage Seulement | 40-60% | 1 heure | Varie | Matériel de référence supplémentaire |

Mon avis vif : La méthode « meilleure » dépend entièrement de votre portée de projet, et la plupart des gens choisissent mal. Les débutants gravitent vers cref parce que c'est facile, puis deviennent frustrés quand la cohérence s'effondre après 10 images. Les utilisateurs expérimentés surconçoivent parfois les pipelines LoRA pour les projets qui ont seulement besoin de cinq images cohérentes. Correspondez votre méthode à vos besoins réels. Si vous faites une BD de 50 pages, investissez dans l'entraînement LoRA. Si vous faites un post social de trois images, cref ou IPAdapter vous serviront bien.

Pour les projets impliquant des personnages anime par IA, les exigences de cohérence sont encore plus élevées parce que les styles anime ont des traits plus exagérés et spécifiques qui sont plus remarquables dans les variations. Les petites variations de taille des yeux, de style de cheveux, ou de saturation de couleur sont plus apparentes dans l'anime que dans les styles réalistes photographiques.

Conseils Avancés pour Maintenir la Cohérence des Personnages par IA

Au-delà des méthodes de base, plusieurs techniques avancées peuvent pousser votre cohérence encore plus haut. Ce sont les astuces que j'ai apprises à partir de centaines d'heures de travail de génération de personnages.

Utiliser le Verrouillage de Seed Stratégiquement

Fixer la seed aléatoire ne garantit pas la cohérence du personnage (ce n'est pas un bouton magique), mais cela peut aider quand utilisé à côté d'autres méthodes. Une seed fixe avec le même prompt produira la même image, mais changer le prompt même légèrement produira un résultat différent. L'astuce est de changer seulement les parties du prompt pertinentes à la scène tout en gardant les descriptions de personnages identiques, puis verrouiller la seed pour minimiser la variation du modèle de bruit.

Construire un Modèle de Prompt

Créez une structure de prompt standardisée pour votre personnage et utilisez-la comme modèle pour chaque génération. Quelque chose comme cela :

[DESCRIPTION DE LA SCÈNE], [MOT DE DÉCLENCHEMENT DU PERSONNAGE], [bloc de description de personnage fixe],

[pose/action], [angle de caméra], [éclairage]

Le bloc de description de personnage devrait être identique sur tous les prompts. Copiez et collez-le à chaque fois. Le prompting incohérent est l'une des plus grandes sources de dérive de personnage, et je me suis pris faisant cette erreur plus de fois que j'aimerais l'admettre.

Gagnez Jusqu'à 1 250 $+/Mois en Créant du Contenu

Rejoignez notre programme exclusif d'affiliés créateurs. Soyez payé par vidéo virale selon la performance. Créez du contenu à votre style avec une totale liberté créative.

Générer par Lots, Pas Un à Un

Quand vous créez plusieurs scènes pour une histoire ou un projet, générez les lots pour chaque scène et cherry-pick les meilleurs résultats plutôt que d'essayer d'obtenir chaque image parfaite en séquence. Cela vous donne plus de contrôle sur la qualité et vous permet de choisir les sortie où le personnage semble le plus cohérent avec votre référence établie.

Exploiter le Post-Traitement de Correction de Visage

Parfois vous obtenez une image presque parfaite où le visage du personnage est légèrement mal. Les outils comme CodeFormer ou GFPGAN peuvent nettoyer les détails faciaux sans changer l'identité du personnage. Dans ComfyUI, vous pouvez intégrer ceux-ci comme étapes de post-traitement dans votre flux de travail pour que chaque sortie reçoive un affinement de visage automatique.

Utiliser un Éclairage et des Angles de Caméra Cohérents

Ceci est sous-estimé. Si votre scène change dramatiquement l'éclairage (passant de la lumière du jour à la lumière des bougies, par exemple), le personnage ressemblera naturellement différent même avec des techniques de cohérence parfaites. Quand vous testez votre configuration, gardez l'éclairage cohérent d'abord pour valider que votre méthode de personnage fonctionne, puis introduisez les variations d'éclairage graduellement.

Fausse Route Commune et Comment les Éviter

Au cours des deux dernières années de travail avec la cohérence des personnages par IA, j'ai vu les mêmes erreurs surgir à plusieurs reprises. Voici ce à quoi il faut faire attention.

Fausse Route 1 : Sur-décrire votre personnage dans les prompts. Quand les gens lutte avec la cohérence, leur instinct est d'ajouter plus de détail au prompt. « Yeux bleus avec des paillettes d'or, nez bouton avec légère inclinaison vers le haut, visage en forme de cœur avec pommettes élevées... » Ce niveau de détail hurt réellement parce que le modèle ne peut pas reproduire de manière cohérente autant de traits faciaux spécifiques. Gardez les descriptions de personnages à 3 à 5 traits clés d'identification et laissez le LoRA ou le système de référence gérer le reste.

Fausse Route 2 : Mélanger des méthodes incompatibles. Pas toutes les techniques de cohérence jouent bien ensemble. Utiliser IPAdapter avec un poids très élevé à côté d'une LoRA forte peut créer des signaux conflictuels qui produisent des sorties brouillées. Quand vous combinez des méthodes, commencez avec des poids bas pour les deux et augmentez graduellement jusqu'à ce que vous trouviez le point d'équilibre.

Fausse Route 3 : Ignorer la cohérence du rapport d'aspect. Basculer entre les rapports d'aspect portrait, paysage et carré entre les scènes introduit plus de variation que vous pourriez l'attendre. Votre personnage a probablement été généré et entraîné dans un rapport d'aspect spécifique, et partir de lui change comment le modèle alloue les pixels au personnage par rapport à l'arrière-plan.

Fausse Route 4 : Entraîner des LoRA sur des données incohérentes. Si vos images d'entraînement montrent déjà une variation significative dans l'apparence du personnage, le LoRA apprendra cette variation. Garbage in, garbage out. Passez le temps à sélectionner votre ensemble de données impitoyablement. Supprimez n'importe quelle image où les traits du personnage diffèrent de votre design intendé.

Fausse Route 5 : Ne pas sauvegarder vos configurations de travail. Quand vous finalement obtenez un pipeline de génération qui produit des résultats cohérents, documentez chaque paramètre : le modèle, poids LoRA, poids IPAdapter, seed, prompt, sampler, étapes, échelle CFG, tout. Le futur vous remerciera le vous présent quand vous devrez générer plus d'images six mois plus tard.

Les services comme Apatero résolvent nombre de ces pièges en standardisant le pipeline et en stockant automatiquement vos configurations de personnage. Si vous trouvez que vous passez plus de temps à déboguer votre configuration de cohérence qu'à créer réellement du contenu, cela peut valoir la peine d'explorer les solutions gérées.

Applications du Monde Réel de Personnages Cohérents par IA

Comprendre pourquoi les gens ont besoin d'un générateur de personnages cohérents par IA aide à clarifier quelle approche correspond à votre cas d'usage.

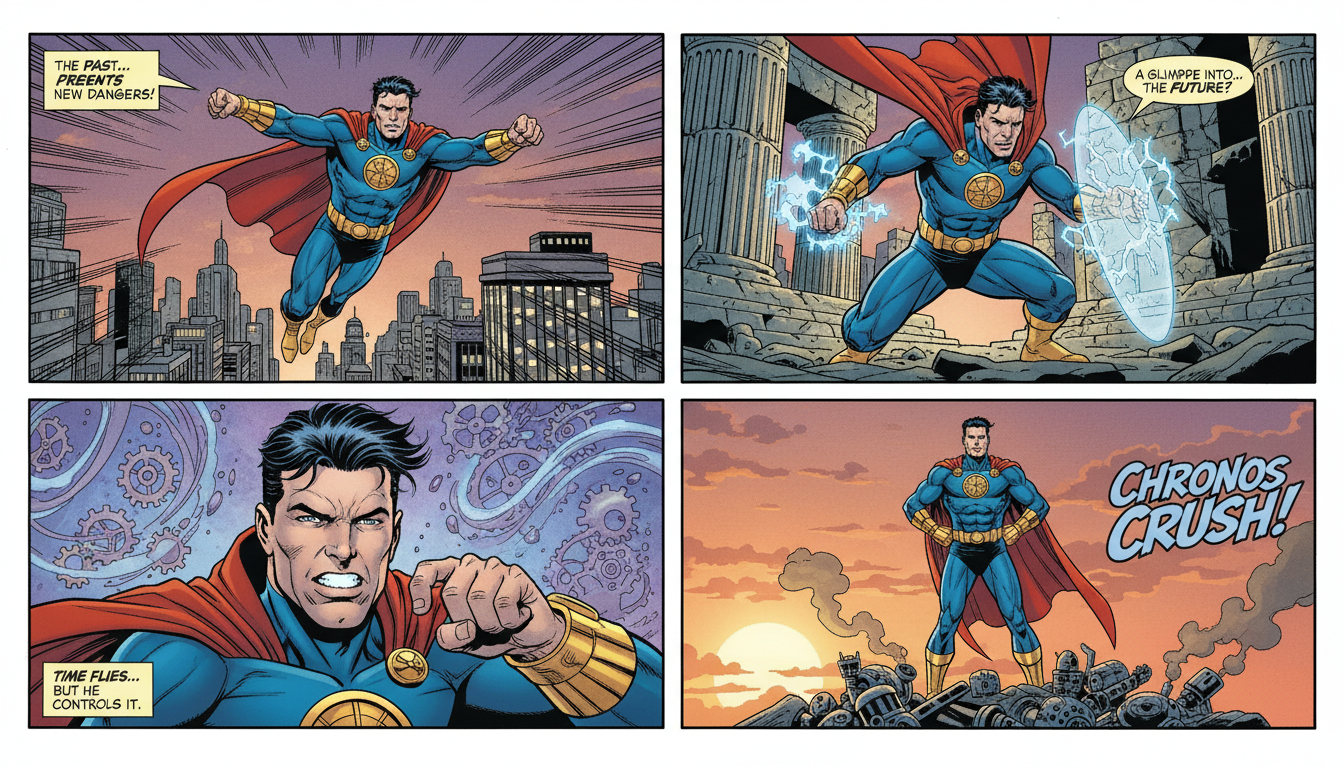

Création de Roman Visuel et BD

C'est l'une des applications les plus exigeantes parce que les lecteurs remarqueront immédiatement si l'apparence d'un personnage change entre les panels. Un seul roman visuel peut nécessiter des centaines d'images des mêmes personnages dans différentes scènes, expressions et tenues. L'entraînement LoRA est pratiquement obligatoire ici, souvent combiné avec IPAdapter pour le contrôle d'expression. Les exigences de cohérence du personnage de l'histoire par IA sont les plus élevées dans cette catégorie.

Influenceurs IA de Médias Sociaux

Les influenceurs IA ont besoin de ressembler à la même personne sur chaque post. Les abonnés s'engagent avec une personnalité, et la cohérence visuelle est ce qui rend cette personnalité feel réelle. C'est une aire où la combinaison d'entraînement LoRA et de modèles de prompt prudents brille. Pour un guide complet pour cette application spécifique, consultez notre guide du générateur de modèles IA.

Préproduction de Jeu et Animation

Les artistes de concept utilisent les outils de cohérence des personnages par IA pour itérer rapidement sur les designs de personnages sur plusieurs environnements et scénarios. La cohérence n'a pas besoin d'être parfaite au pixel près ici puisque la sortie IA est du matériel de référence qui sera affiné par les artistes humains. IPAdapter ou même cref fonctionne bien pour ce cas d'usage parce que la vitesse prime sur la perfection.

Illustration de Livre pour Enfants

Les personnages cohérents sur 20 à 30 illustrations, souvent dans des scènes très différentes et avec diverses expressions émotionnelles. C'est un endroit idéal pour l'approche LoRA plus feuille de personnage, où vous entraînez un LoRA et maintenez aussi une feuille de référence que vous utilisez pour les vérifications de cohérence manuelles.

L'Avenir de la Cohérence des Personnages par IA

Le champ se déplace vite. Quand j'ai d'abord écrit sur les techniques de cohérence des personnages en 2024, l'entraînement LoRA était la seule option fiable et cela nécessitait une compétence technique significative. Maintenant en 2026, nous avons plusieurs approches à différents niveaux d'accessibilité, et l'écart de qualité entre eux rétrécit.

Plusieurs tendances valent l'observation. D'abord, les fonctionnalités de cohérence de personnage native sont construites dans les modèles de génération eux-mêmes plutôt que de nécessiter des outils externes. Le système cref de Midjourney était un exemple précoce, et les modèles plus neufs de Stability AI et Black Forest Labs incorporent la préservation de l'identité directement dans leurs architectures.

Deuxièmement, l'entraînement devient plus rapide et moins cher. Ce qui utilisait prendre 3 heures sur un GPU A100 loué prend maintenant 45 minutes sur du hardware consommateur. Cette démocratisation signifie que plus de créateurs peuvent accéder à la cohérence au niveau LoRA sans casser la banque.

Troisièmement, et c'est peut-être le développement le plus excitant, la cohérence multi-caractère devient viable. Maintenir deux ou trois personnages cohérents dans la même scène était quasi impossible il y a un an, mais les avancées récentes dans la manipulation d'attention et le chargement multi-LoRA le rendent pratique. Vous pouvez maintenant raconter une histoire avec un casting complet, pas seulement un protagoniste unique.

Sur Apatero.com, nous avons suivi ces développements de près et intégré les techniques de cohérence nouvelles à mesure qu'elles mûrissent. L'objectif est de faire la cohérence des personnages quelque chose que vous configurez une fois et puis oubliez, vous laissant vous concentrer sur le travail créatif de raconter les histoires et construire des mondes.

Questions Fréquemment Posées

Quel est le meilleur générateur de personnage cohérent par IA pour les débutants ?

Pour les débutants absolus, je recommande de commencer avec Midjourney avec le paramètre cref car c'est le point de départ le plus facile techniquement. Téléchargez une image de référence, ajoutez --cref [URL] à votre prompt, et vous obtiendrez des résultats raisonnablement cohérents. Pour une meilleure qualité avec plus de contrôle, essayez IPAdapter dans ComfyUI. Pour une cohérence professionnelle de gamme, investissez dans l'entraînement LoRA.

Puis-je garder le même visage sur les images IA sans entraînement ?

Oui, IPAdapter et InstantID vous permettent de maintenir la cohérence faciale en utilisant juste une image de référence, pas d'entraînement requis. La cohérence n'est pas aussi élevée qu'une LoRA entraînée (environ 70 à 85% versus 85 à 95%), mais elle fonctionne bien pour beaucoup de cas d'usage. Midjourney cref réalise aussi ceci sans entraînement, bien qu'avec moins de contrôle.

Combien d'images de référence ai-je besoin pour un LoRA de personnage ?

Entre 15 et 30 images fonctionne le mieux. Moins de 10 images ne donne généralement pas au modèle assez d'information pour généraliser votre personnage aux nouvelles poses. Plus de 50 images introduit trop de variation à moins que chaque image soit extrêmement cohérente. Concentrez-vous sur la qualité et la variété des angles plutôt que la quantité brute.

Pourquoi mon personnage IA semble-t-il différent dans chaque image malgré l'utilisation du même prompt ?

Les prompts textuels seuls ne peuvent pas garantir la cohérence parce que les modèles de diffusion génèrent à partir de bruit aléatoire à chaque fois. Le même prompt produit une interprétation valide mais différente à chaque génération. Vous avez besoin d'une méthode de conditionnement (LoRA, IPAdapter, cref, ou images de référence) qui fournit des informations d'identité visuelle au-delà de ce que le texte peut exprimer.

Qu'est-ce que Midjourney cref et comment cela fonctionne ?

Le paramètre cref de Midjourney (référence de personnage) vous permet de passer une image de référence que le modèle utilise pour maintenir l'apparence du personnage. Vous ajoutez --cref [URL image] à votre prompt, et --cw [0-100] pour contrôler à quel point il suit la référence. À cw 100, cela essaie de correspondre au visage, cheveux et vêtements. À des valeurs inférieure, cela se concentre surtout sur le visage.

Vaut-il l'entraînement LoRA juste pour quelques images ?

Si vous n'avez besoin que de 3 à 5 images cohérentes, l'entraînement LoRA est probablement excessif. Utilisez IPAdapter ou cref à la place pour les projets rapides. L'entraînement LoRA se paie quand vous avez besoin de 20+ images du même personnage, planifiez d'utiliser le personnage à long terme, ou avez besoin de la cohérence la plus élevée possible pour le travail professionnel.

Puis-je utiliser le même personnage sur les différents styles d'art IA ?

C'est l'un des défis de cohérence les plus difficiles. Un personnage conçu dans un style réaliste photographique ressemblera différent quand rendu dans l'anime, aquarelle ou pixel art. L'entraînement LoRA gère la cohérence entre-styles mieux que les méthodes basées sur les références car il apprend l'identité du personnage à un niveau plus profond. Cependant, vous pouvez avoir besoin de LoRA séparés pour les styles dramatiquement différents.

Comment je crée une feuille de personnage IA pour la référence ?

Générez votre personnage sous plusieurs angles (face, côté, arrière, trois-quarts) et composez ces vues dans une seule image. Utilisez un prompt contenant « feuille de personnage, vues multiples, feuille de référence, arrière-plan blanc » avec votre description du personnage. Générez chaque vue séparément si le modèle lutte pour produire toutes les vues en une seule image.

Quelle est la différence entre IPAdapter et InstantID ?

Les deux extraient des traits d'images de référence, mais elles se concentrent sur différents aspects. IPAdapter capture les traits visuels généraux y compris le style, la composition et le visage. InstantID est spécifiquement conçu pour la préservation de l'identité du visage, utilisant les intégrations InsightFace pour correspondre la géométrie faciale précisément. Pour la cohérence des personnages, InstantID produit typiquement meilleures correspondances de visage tandis qu'IPAdapter offre meilleure cohérence globale de style.

Puis-je maintenir la cohérence des personnages sur les vidéos générées par IA ?

Oui, mais c'est plus difficile que les images statiques. Les modèles de génération de vidéo comme Wan et Kling améliorent la cohérence temporelle, et vous pouvez utiliser les LoRA avec certains modèles de vidéo. L'approche actuelle la plus fiable est de générer les images clés avec les techniques de personnage cohérent d'image statique puis d'interpoler entre eux avec un modèle vidéo.

Résumé

Obtenir un personnage IA cohérent sur plusieurs images n'est plus la tâche impossible que c'était même il y a un an. Les outils ont mûri, les techniques sont bien documentées, et il y a des options à chaque niveau de compétence et budget.

Si vous prenez une chose de ce guide, laissez-la être ceci : correspondez votre méthode à votre portée de projet. Ne sur-concevez pas une solution pour un simple projet, et ne sous-investissez pas dans la cohérence pour un projet qui la demande. Commencez avec l'approche la plus simple qui satisfait vos besoins et n'ajoutez de la complexité que quand les résultats la nécessitent.

Le paysage du générateur de personnage cohérent par IA continuera à évoluer, et ce qui se sent avant-garde aujourd'hui se sentira probablement routinier dans un an. Mais les fondamentaux de bonnes images de référence, un prompting cohérent, et choisir l'outil approprié pour le travail resteront pertinent indépendamment de quelles techniques nouvelles émergent.

Pour les mises à jour en cours sur les outils de cohérence des personnages IA et les techniques, continuez à vérifier ici. Et si vous voulez sauter la mise en place technique entièrement et vous concentrer sur la création de personnages, essayez Apatero. C'est construit spécifiquement pour ce type de flux de travail créatif.

Prêt à Créer Votre Influenceur IA?

Rejoignez 115 étudiants maîtrisant ComfyUI et le marketing d'influenceurs IA dans notre cours complet de 51 leçons.

Articles Connexes

L'art IA pour les développeurs de jeux : guide complet de création d'assets

Découvrez comment les développeurs indépendants utilisent l'IA pour créer des concept arts, sprites, arrière-plans et interfaces. Workflows pratiques pour intégrer l'IA dans les pipelines d'assets de jeux.

Comment créer des couvertures de livre professionnelles avec l'IA pour l'auto-édition

Concevez des couvertures de livre magnifiques avec les générateurs d'images IA. Guide complet pour les auteurs auto-édités couvrant tous les genres de la fantasy à la romance au thriller.

Créer des Personnages Cohérents pour les BD avec l'IA : Tutoriel Complet

Apprenez à générer des personnages cohérents sur plusieurs panneaux et pages en utilisant des générateurs d'images IA. Maîtrisez les techniques de prompting pour la création de BD.