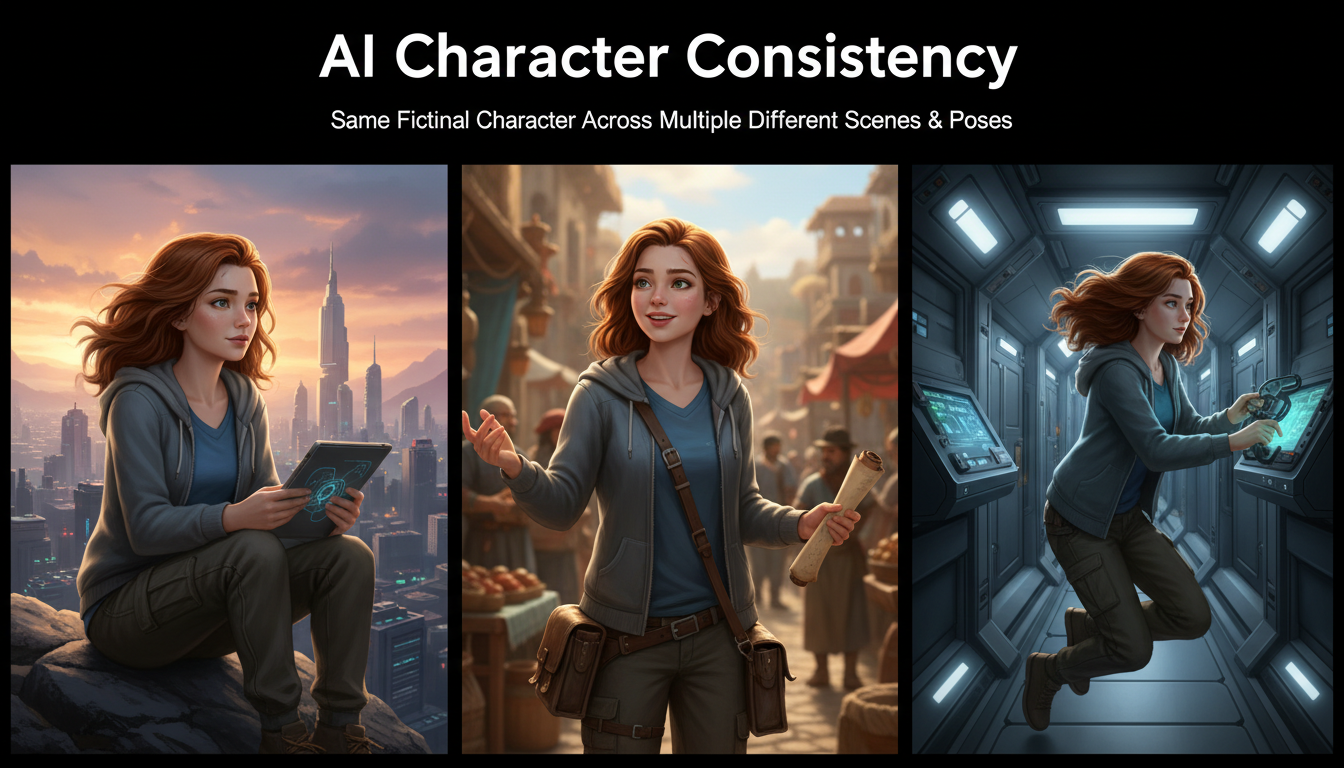

AI-Konsistenter-Charakter-Generator: Halte denselben Charakter über mehrere Bilder

Erfahre, wie du denselben AI-Charakter über mehrere Szenen mit LoRA-Training, IPAdapter, Midjourney cref und Referenzbildern erzeugst. Vollständiger 2026-Leitfaden.

Wenn du je versuchtest, eine visuelle Geschichte mit AI-generierten Bildern zu erzählen, weißt du bereits den Schmerz. Du fertigt ein perfekt erstes Bild deines Charakters an, bewegst dich zur nächsten Szene und plötzlich gibt dir die AI jemanden, der wie ein ferner Cousin aussieht beste. Das Haar ist unterschiedlich, die Gesicht-Form änderte sich und das Outfit könnte genauso gut einem komplett anderen Menschen gehören. Das ist die einzeln größte Frustration für jeden, der Comics, visuelle Romane, Storyboards oder Social-Media-Inhalt mit AI-Kunstwerk-Tools baut.

Schnelle Antwort: Ein AI-konsistenter-Charakter-Generator nutzt Techniken wie LoRA Fein-Einstimmung, IPAdapter-Gesichtseinbettung, Midjourney's cref-Parameter oder strukturiert Referenzbilder, um die gleiche Charakter-Identität über mehrere generierte Bilder zu bewahren. Die besten Ergebnisse kommen aus mindestens zwei Methoden kombinierend. LoRA-Training auf 15 bis 30 Referenzbilder liefert die höchste Konsistenz (ungefähr 90%), während Referenzbasierte Methoden wie cref oder IPAdapter schneller Aufbau mit leicht niedrigere Treue anbieten (70 bis 85%). Deine Wahl hängt davon ab, ob du perfekte Konsistenz für professionelle Projekte oder "gut genug" für schnelle kreativ Erforschung brauchst.

- LoRA-Training bietet beste Charakter-Konsistenz, aber erfordert Aufwand nach vorne (2 bis 4 Stunden von Setup und Training)

- IPAdapter und InstantID bieten ein Mittel-Grund mit kein Training erforderlich, gerecht Referenzbilder

- Midjourney's cref-Parameter ist das einfachste Eintritts-Punkt, aber gibt dir die wenigste Kontrolle

- Kombinierende Methoden (LoRA plus IPAdapter, zum Beispiel) erzeugen die zuverlässigsten Ergebnisse

- Charakter-Blätter und Rundum-Referenzen verbessern Konsistenz dramatisch unabhängig davon, welche Methode du nutzt

- Tools wie Apatero handhben die technische Komplexität hinter den Szenen für Ersteller, die Ergebnisse ohne Bau-Pipelines mögen

Warum ist Charakter-Konsistenz das schwerstes Problem in AI-Bildgenerierung

Charakter-Konsistenz ist grundsätzlich in Opposition mit, wie Diffusions-Modelle funktionieren. Diese Modelle erzeugen Bilder, indem sie von Lärm starten und es graduell in etwas verfeinern, das deine Text-Beschreibung passt. Jede Generierung startet von einem unterschiedlichen Lärm-Muster, was bedeutet, dass jede Ausgabe einzigartig ist. Das ist großartig für Vielzahl, aber furchtbar für das Bewahren einer konsistenten Identität.

Ich lief zunächst in dieses Problem ungefähr zwei Jahre her, als ich versuchte, einen kurzen Comic-Streifen mit Stable Diffusion zu bauen. Ich hatte einen Charakter, den ich von meinen beginnenden Generierung wirklich mochte: eine rotköpfige Frau in einer Lederjacke mit einer unterschiedlichen Narbe über ihrer linken Augenkrause. Der absolut nächste Panel erforderte sie in einer unterschiedlichen Pose, und nach 80 Generierungen konnte ich nicht jemanden bekommen, der entfernt wie sie aussah. Das Projekt lehrte mich eine kritische Lehrung: Text-Prompts allein können nicht Charakter-Konsistenz lösen, unabhängig davon, wie detailliert du sie machst.

Der Grund ist geradeheraus. Wenn du "rotköpfige Frau mit Narbe über linker Augenkrause" schreibst, interpretiert das Modell diese Beschreibung frisch jedes Mal. Seine intern Repräsentation von "rotköpfiger Frau" unterscheidet sich über Generierungen, weil das Latent-Raum enorm ist. Zwei Bilder, die die gleiche Text-Aufforderung passen, können stark unterschiedlich aussehen, während beide technisch korrekt Interpretationen deiner Wörter sind.

Das ist, warum dediziert Techniken für AI-Charakter-Konsistenz so kritisch geworden sind. Ob du ein AI-visueller-Roman-Charakter Bibliothek aufbaust, Markneting-Materialien mit einem Brand-Maskottchen erstellst oder Konzept-Kunstwerk für ein Spiel entwickelst, du brauchst Werkzeuge, die über einfaches Prompting gehen.

Die vier Haupt-Ansätze zu konsistent AI-Charakter-Generierung

Bevor ich in spezifisches Workflows springe, hilft es zu verstehen, dass Landschaft. Es gibt vier primär Ansätze zum Bewahren eines konsistenten AI-Charakters über Szenen, und jeder sitzt bei einem unterschiedlichen Punkt auf dem Aufwand-gegenüber-Qualitäts-Spektrum.

1. LoRA Fein-Einstimmung (Höchste Qualität, meisten Aufwand)

LoRA-Training lehrt das AI-Modell, wie dein spezifisch Charakter tief aussieht. Du fütterst es 15 bis 30 kurierte Bilder deines Charakters, und es schafft eine klein Adapter-Datei (typischerweise 10 bis 150MB), die das Modell's Verhalten ändert. Wenn du dieses LoRA während Generierung aktivierst, "weiß" das Modell deinen Charakter und kann ihn in jeder Pose oder Szene rendern, während sie ihre Kern-Identität bewahren.

Ich betrachte LoRA-Training non-negotiable für irgend seriös Charakter-Projekt. Die Konsistenz, die du bekommst, ist unübertroffen von irgend andere Methode. Wenn du die Grundlagen verstehen willst, wie das funktioniert, sieh unseren kompletten Anfänger's-Leitfaden zu LoRA-Training.

Beste für: Langfristig Charakter-Projekte, visuelle Romane, Comics, Brand-Maskottchen, professionell Inhalts-Pipelines.

Nachteile: Erfordert ein Datensatz deines Charakters (Huhn-und-Ei-Problem für neue Charaktere), nimmt 1 bis 3 Stunden Training-Zeit, braucht ein gutes GPU oder Cloud-Rechnen.

2. IPAdapter und InstantID (Gute Qualität, gemäßigt Aufwand)

IPAdapter arbeitet indem extrakt Gesichts- und stilistisch Merkmal aus ein Referenzbildungs und spritzt diese Merkmale in den Generierungs-Prozess ein. Du gibst ein oder mehr Referenzfotos deines Charakters, und IPAdapter konditioniert den Diffusions-Prozess, um diese Merkmale zu passen. InstantID ist ein ähnliche Ansatz speziell optimiert für Gesichts-Identitäts-Bewahren.

Der Vorteil hier ist Geschwindigkeit. Du brauchst nicht zu trainieren nichts. Gerecht biete Referenzbildungs und starte zu generieren. Der Tausch ist, dass Konsistenz fallen im Vergleich zu LoRA, besonders für nicht-Gesichts-Merkmale wie Kleidung, Körper-Typ und Accessoires.

Beste für: Schnelle Prototyping, Charaktere basiert auf echte Leute (mit Erlaubnis), Projekte wo Gesichts-Konsistenz am meisten Angelegenheit.

Nachteile: Kämpfe mit extrem Pose-Änderungen, kann Kleidungs- und Accessoiren-Details verlieren, manchmal erzeugt ein "uncanny valley" Effekt wo das Gesicht konsistent ist, aber alles andere Verschiebungen.

3. Midjourney cref (einfachste, Wenigste Kontrolle)

Midjourney's Charakter-Referenz-Parameter (cref) ist die zugänglichste Option für Anfänger. Du einfach gibst ein Referenzbildungs-URL mit die --cref Flagge, und Midjourney versucht zu bewahren dieser Charakter's Aussehen in neuen Generierungen. Die --cw (Charakter-Gewicht) Parameter lass dich kontrollieren, wie stark es zur Referenz hält.

Heiße Ansicht: Midjourney cref ist über-gehyped für seriöse Arbeit. Es ist fantastisch für beiläufig Erforschung und Social-Media-Inhalt, aber die Konsistenz bricht signifikant zusammen, wenn du deinen Charakter in kompliziert Posen, unterschiedlich Beleuchtungs-Bedingungen oder stilistisch unterschiedlich Szenen brauchst. Ich habe es umfassend getestet und finde, dass es ungefähr 70% der Zeit für einfach Portrait-zu-Portrait-Übertragungen funktioniert, aber fällt zu ungefähr 40% Zuverlässigkeit wenn du die Szene dramatisch änderst. Für professionell visuell Geschichtenerzählung, du wirst eine Mauer schnell treffen.

Beste für: Social-Media-Inhalt, beiläufig Charakter-Erforschung, schnelle Konzept-Kunstwerk, Midjourney-Nutzer, die nicht neue Werkzeuge erlernen mögen.

Nachteile: Gesperrt zu Midjourney's Ökosystem, begrenzt Kontrolle über, welche Aspekte von Charakter bewahrt werden, kein Fein-körnig Anpassbarkeit.

4. Strukturiert Referenz-Bilder und Charakter-Blätter (Ergänzend)

Ein AI-Charakter-Rundum-Blatt ist ein einzeln Bildungs zeigend deinen Charakter von mehrfach Winkel: vorne, Seite, Rück-, und dreiviertel Ansichten. Diese Blätter dienen als umfassend Referenzen, dass du nutzen kannst mit irgend die oben Methoden um Konsistenz zu verbessern. Sie sind nicht eine Stand-Allein-Lösung, aber eher ein Kraft-Multiplikator.

Das Erstellen eines guten Charakter-Blatts beteiligt Generierung deines Charakters in einer neutral Pose von mehrfach Winkeln, dann zusammensetzend diese Ansichten in ein einzeln Referenz-Bildungs. Das gibt was Konsistenz-Methode du nutzt mehr Information zu arbeiten mit.

Schritt-für-Schritt: Bauen einen Charakter LoRA für Maximum-Konsistenz

Das ist der Gold-Standard-Workflow für irgend wer braucht zuverlässig, wiederholbar Charakter-Konsistenz. Ich gehe durch den ganzen Prozess von Datensatz-Erstellung zu Einsatz.

Schritt 1: Erstelle deinen Charakter's Designs Anfangsstadium

Wenn dein Charakter noch nicht existiert, brauchst du sie zunächst zu generieren. Das ist die Bootstrapping-Herausforderung. Hier ist mein empfohlenes Ansatz.

Starte durch Generierung ein großen Batch von Bildern (50 bis 100) mit ein detailliert Aufforderung Beschreiben deinen Charakter. Nutze ein hochwertig Basis-Modell wie Flux, SDXL oder eine von am beste AI-Bildgeneratoren verfügbar 2026. Überprüfe der Batch und wähle die einzeln Bildungs das beste repräsentiert deine Vision.

Aus diesen gewählten Bildungs, nutze img2img oder IPAdapter um Variationen in unterschiedlich Posen und Ausdrücke zu generieren. Das Ziel ist ein Datensatz bauen von 15 bis 30 Bilder wo Charakter ist erkennbar die gleiche Person, aber zeigt in genug Vielfalt, dass das LoRA der Charakter's Identität erlernt statt Memorisierung ein einzeln Pose.

Schritt 2: Kuriere und bereite deinen Datensatz vor

Qualität Angelegenheit weit mehr als Menge für LoRA-Training-Datensatz. Ich einmal versuchte Trainings LoRA mit 200 Bilder von Charakter und bekamen schlechter Ergebnisse als ein sorgfältig kuriert Satz von 20. Das groß Datensatz hatte zu viel Inkonsistenz, und das Modell erlernte Durchschnitt aller diese Variationen statt die "wahren" Charakter.

Hier ist, das dein Datensatz enthalte sollte:

- 5 bis 8 Nah-oben Porträts mit unterschiedlich Ausdrücke (neutral, lächelnd, seriös, überrasch)

- 5 bis 8 gemäßigte Schüsse, die Oberkörper vom unterschiedlich Winkel zeigend

- 3 bis 5 ganzen Körper Schüssen mit unterschiedlich Posen

- 2 bis 3 Bilder in unterschiedlich Outfits (wenn du Outfit-Flexibilität willst)

- Alle Bilder sollten sauberhaft Hintergründe haben (solide Farben funktionieren beste)

- Auflösung sollte mindestens 512x512 sein, idealer 1024x1024

Etikett jedes Bildungs mit ein konsistent Trigger-Wort für deinen Charakter (etwas einzigartig wie "chrNAME" oder "sks_character") und exakt Beschreibung von Pose, Ausdruck und Kleidung.

Schritt 3: Konfiguriere und führe Training aus

Für Training-Konfiguration, diese Einstellungen funktionieren gut als Anfangspunkt für Charakter-LoRAs auf Flux oder SDXL-Modelle:

- Learning-Rate: 1e-4 für Flux, 5e-5 für SDXL

- Training-Schritte: 1.500 bis 3.000 (mehr ist nicht immer besser)

- Netzwerk-Rank: 32 bis 64 (höher erfasst mehr Detail, aber Risiken Überanpassung)

- Netzwerk-Alpha: Halb dein Rank-Wert (16 bis 32)

- Auflösung: 1024x1024

- Batch-Größe: 1 bis 2 (limitiert von VRAM)

- Optimizer: AdamW oder Prodigy (Prodigy Auto-Anpassungen Learning-Rate)

Ich immer laufe Test-Generierung auf Hälfte-Mark. Wenn Charakter ist bereits erkennbar bei Schritt 1.500, brauchst du vermutlich nicht zu trainieren bis 3.000. Übertraining macht LoRA starr, Bedeutung es wird deine Trainings-Bildern zu buchstäblich reproduzieren und kämpfen mit neuen Posen. Für ein tieferes Tauchen in diese Prozess, unser Leitfaden zum Erstellen von AI-virtuellen Modelle deckt Training-Pipeline ausführlich.

Schritt 4: Test und Iterieren

Nach Training, test dein LoRA mit Aufforderungen die signifikant unterscheiden von dein Training-Daten. Generiere deinen Charakter in Szenen und Posen das waren nicht in Training-Satz. Das sagt dir, wie gut LoRA generalisiert versus memoriziert.

Häufig Probleme und Korrektur:

- Gesicht aussehen recht, aber Körper ist falsch: Hinzufügen mehr Voll-Körper-Bilder deinem Datensatz und Retrain

- Charakter funktioniert nur in eine Pose: Dein Training-Daten mangelt Vielfalt, hinzufügen mehr verschiedenartig Posen

- Ausgabe aussieht "gebrannt" oder Über-Sättigung: Du über-trainiert, reduzieren Schritte oder senken Learning-Rate

- LoRA hat kein sichtbar Effekt: Prüfe dein Trigger-Wort, erhöhe LoRA-Gewicht oder verifyieren LoRA ist kompatibel mit dein Basis-Modell

Schritt-für-Schritt: Nutzen IPAdapter für schnelle Charakter-Konsistenz

Wenn brauchst du Ergebnisse schnell und willst nicht investieren Stunden in LoRA-Training, IPAdapter ist dein beste Freund. Dieser Workflow bekommt dich von Null zu konsistente Charaktere in unter 30 Minuten.

IPAdapter in ComfyUI einrichten

IPAdapter erfordert spezifisch Aufbau in ComfyUI mit IPAdapter Plus benutzer-definiert Knoten installiert. Brauchst das Gesichts-Modell speziell für Charakter-Konsistenz-Arbeit.

Kostenlose ComfyUI Workflows

Finden Sie kostenlose Open-Source ComfyUI-Workflows für Techniken in diesem Artikel. Open Source ist stark.

- Install ComfyUI-IPAdapter-Plus benutzer-definiert Knoten vom GitHub

- Runterlade IPAdapter Gesichts-Modell (ip-adapter-faceid-plusv2_sd15.bin für SD 1.5 oder das SDXL Variante)

- Runterlade erforderlich InsightFace Analyse-Modell

- Platziere Modelle in korrekt Verzeichnissen in dein ComfyUI-Installation

Der Workflow

Einmal Installation, Workflow ist geradeheraus. Brauchst ein Referenzbildungs von deinem Charakter und IPAdapter extrahiert Gesichts-Merkmale das bekommen einspritzt in Diffusions-Prozess bei spezifisch Aufmerksamkeits-Ebenen.

Schlüssel-Parameter anzupassen:

- Gewicht: Anfang bei 0.7 und anpassung. Höher Werte (0,85+) produzieren näher Gesichts-Übereinstimmungen, aber können Image-Qualität senken. Niedriger Werte (0,5 bis 0,6) geben mehr kreativ Freiheit, aber loser Konsistenz.

- Start/End Prozent: Kontrollen wann in Diffusions-Prozess IPAdapter-Einfluss anfängt und endet. Startest bei 0% und Endung bei 80% produziert normalerweise beste Ergebnisse.

- Gesichts-ID-Modus: Nutze das speziell für Gesichts-Konsistenz statt allgemein IPAdapter-Modus, das übertragen auch Stil und Komposition.

Heiße Ansicht: Die meisten Leute nutzen IPAdapter-Gewicht zu hoch. Das Setzen es zu 0,9+ weil brauchst "maximale Konsistenz" tatsächlich degeneriert Ausgabe. Bekommen Gesichts-Artefakte, komische Haut-Texturen und diese unterscheidend "geklebtes Gesicht" Aussehen. Ein Gewicht von 0,65 bis 0,75 gibt dir 90% Konsistenz mit keine Artefakte. Vertrau Modell, sein Job zu machen.

Kombining IPAdapter mit LoRA

Das ist wo Dinge kraftvoll werden. Nutze dein trainiert LoRA handhben der Charakter's Gesamt-Identität (Gesicht-Form, Haare, allgemein Proportionen) und Ebene IPAdapter auf beginnen zu Schloss in speziell Gesichts-Merkmale für extra Konsistenz. Das LoRA gibt das "wer" während IPAdapter verstärkt "genau wie sie aussehen."

In mein Testung, diese Kombination drückte Konsistenz vom ungefähr 85% (LoRA allein) zu über 95%. Workflow in ComfyUI kettet LoRA-Lader bevor IPAdapter-Konditionieren, also beide beeinflussen Generierung gleichzeitig.

Auf Apatero, diese Art von Mehrschichtbildungs Konsistenz-Pipeline läuft automatisch wenn Charakter erstellst und Variationen generierst. Die Plattform handhbt Modell-Stapelung und Parameter-Tuning hinter den Szenen, das spart bedeutungsvoll Zeit verglichen mit Bauen ComfyUI-Workflow von Grund auf.

Schritt-für-Schritt: Nutzung Midjourney cref für Charakter-Referenzen

Für Midjourney-Nutzer wer möchte Charakter-Konsistenz ohne die Plattform zu verlassen, cref-System ist schnellst Weg.

Basis-Nutzung

Syntax ist einfach. Generieren oder biete dein Charakter's Referenz-Bildungs, dann enthalte es in zukünftig Aufforderungen:

/imagine prompt: [deine Charakter-Beschreibung], [Szenen-Beschreibung] --cref [Bildungs-URL] --cw 100

Die --cw Parameter-Kontrolle Charakter-Gewicht:

- 100 (Default): Passt Gesicht, Haare, Kleidung und allgemein Aussehen

- 50 bis 75: Passt Gesicht und Haare, aber erlaubt Kleidungs-Variationen

- 0 bis 25: Passt nur allgemein Stil, lose Charakter-Referenz

Tipps für bessere cref-Ergebnisse

Nach Wenden testen Midjourney's cref mit verschiedenartig Charakter-Typen, fand ich mehrfach Muster das konsistent Ergebnisse verbessern.

Zunächst, dein Referenz-Bildungs Angelegenheit enorm. Ein sauberhaft, gut-belichtet Porträt mit Charakter-zentriert im Rahmen arbeitet zehn Zeiten besser als kompliziert Szene, wo Charakter teilweise verbergen ist. Wenn dein beste Charakter-Bildungs hat sie in ein Aktitons-Pose gegen beschäftigte Hintergrund, nimm Zeit generieren ein sauberhaft Porträt-Version zunächst und nutze da als dein cref-Quelle.

Zweitens, sei explizit über was sollte ändern gegen was sollte gleich bleiben. Wenn brauchst dein Charakter in neu Outfit, aber mit gleich Gesicht, senken Charakter-Gewicht zu ungefähr 50 und beschreiben neu Outfit in dein Aufforderung. Wenn möchte alles identisch außer Szene, halten Charakter-Gewicht bei 100 und nur beschreiben neu Umwelt.

Drittens, Midjourney handhbet same-Stil-Konsistenz besser als Kreuz-Stil-Konsistenz. Wenn dein Referenz ist photorealistisch Bildungs und versuchst zu generieren Cartoon-Version von das Charakter, Konsistenz fällt scharf. Halt zu gleich allgemein Stil wie dein Referenz für beste Ergebnisse.

Erstellen effektiv AI-Charakter-Blätter und Rundum-Referenzen

Ein Charakter-Blatt ist dein Geheim-Waffe unabhängig davon, welche AI-konsistente-Charakter-Generator-Ansatz du nutzt. Denk es als visuell Wörterbuch für deinen Charakter das jeder Methode kann referenzieren.

Das geht auf ein Charakter-Blatt

Ein gutes AI-Charakter-Rundum-Blatt enthaltet mehrere essentiell Ansichten.

Möchten Sie die Komplexität überspringen? Apatero liefert Ihnen sofort professionelle KI-Ergebnisse ohne technische Einrichtung.

Vorne-Ansicht sollte neutral stehend Pose sein, Arme leicht weg von Körper so voll Outfit sichtbar ist. Das ist dein "Default" Referenzen das erfasst das meisten erkennbar Version deines Charakters. Enthalte ein Nah-oben Gesicht-Ansicht mit neutral Ausdruck, zeigend unterscheidend Gesichts-Merkmale klar.

Seite-Profile (linke und rechte) enthüllen Charakter's Silhouett, Frisur-Stil aus weiteren Winkel und irgend Profil-spezifisch Merkmale wie Schmuck, Narben oder Haar-Ornamente. Back-Ansicht ist essentiell wenn dein Charakter hat unterscheidend Zurück-Details wie Haarlänge, Kap, Rucksack oder Tätowierungen.

Ausdruck-Blätter zeigend gleich Charakter mit unterschiedlich Gefühle (glücklich, traurig, zornig, überrasch, entschlossen) hilf wenn brauchst emotional-Bereich in dein Geschichte-Szenen. Das auch biete ausgezeichnet Training-Daten für LoRAs, weil lehrend das Modell das dein Charakter's Identität bleibt über emotional Staaten.

Generieren ein Charakter-Blatt mit AI

Hier ist praktisch Ansatz Ich nutze wenn Erstellen Charakter-Blätter für neue Original-Charaktere.

Anfang durch Generierung dein definitive Charakter-Bildungs. Einmal das Designen ist Schloss, nutze Kombination von dein bevorzugt Methode (LoRA, IPAdapter oder cref) mit spezifisch Prompting zu generieren jedes Blatt-Ansicht. Ein Aufforderung-Struktur wie das funktioniert gut:

character sheet, multiple views, front view, side view, back view,

three-quarter view, [dein Charakter-Beschreibung], white background,

reference sheet, concept art, clean linework

Wenn die einzeln-Aufforderungs-Ansatz nicht produziert gut Ergebnisse (häufig nicht), generieren jedes Ansicht separat und zusammensetzen sie manuell in ein Bildungs-Editor. Das Nimmt mehr Zeit, aber gibt dir viel besser Kontrolle über jede Ansicht.

Ich sollte bemerken das diese Prozess signifikant einfacher geworden in 2026 verglichen zu sogar Jahr her. Modelle wie Flux und letzte SDXL Fein-Einstimmung handhbet Mehrschicht-Ansicht-Generierung viel zuverlässiger als älter Modelle. Wenn versucht dieser Ansatz 2024 und gab auf, worth es zu erbeutern.

Vergleichen alle Ansätze: Welche Methode sollte Wahl?

Lass mich direkt sein über was Werke und was nicht, basiert auf extensiv Testung über alle vier Methoden.

| Methode | Konsistenz-Punkte | Aufbau-Zeit | Pro-Bildungs-Geschwindigkeit | Beste Für |

|---|---|---|---|---|

| LoRA-Training | 85-95% | 2-4 Stunden | Schnelle (einmal trainiert) | Langfristig Projekte, professionell Arbeit |

| IPAdapter/InstantID | 70-85% | 30 Minuten | Gemäßigte | Schnelle Prototyping, Echt-Gesicht-Referenz |

| Midjourney cref | 60-80% | 5 Minuten | Schnelle | Beiläufig Nutzung, Social-Media-Inhalt |

| Charakter-Blätter Nur | 40-60% | 1 Stunde | Variiert | Ergänzung-Referenzmaterial |

Heiße Ansicht: Das "beste" Methode hängt vollständig von dein Projekt-Spannbreite ab, und die meisten Leute wähle falsch. Anfänger neigen zu cref, weil ist einfach, dann bekommen frustriert wenn Konsistenz bricht zusammen nach 10 Bilder. Erfahren Nutzer manchmal über-Engineering LoRA-Pipeline für Projekte das nur brauchen fünf konsistent Bilder. Passt dein Methode zu dein aktuelle Anforderungen. Wenn machst ein 50-Seiten Comic, investieren in LoRA-Training. Wenn machst ein drei-Bildungs Social-Post, cref oder IPAdapter dient Gut Nein.

Für Projekte beteiligend AI-Anime-Charaktere, Konsistenz-Anforderungen sind noch höher, weil Anime-Stile haben mehr übertrieben und spezifisch Merkmale das sind schwieriger zu bewahren. Kleine Variationen in Augen-Größe, Frisur-Stil oder Farb-Sättigung sind mehr auffallbar in Anime, als in photorealistisch Stile.

Erweitert Tipps für Bewahren von AI-Charakter-Konsistenz

Jenseits Kern-Methoden, mehrfach erweitert Techniken können dein Konsistenz weiter drücken. Das sind Trickse Ich erlernte von hunderte von Stunden Charakter-Generierungs Arbeit.

Nutze Seed-Sperren Strategisch

Korrigiert zufällig Seed garantiert nicht Charakter-Konsistenz (nicht magisch Schaltfläche), aber können helfen wenn nutzt wird neben andere Methoden. Fixiert Seed mit gleich Aufforderung wird identisch Bildungs erzeugen, aber Änderung Aufforderung sogar leicht wird produzieren anders Ergebnis. Trick ist änder nur Szenen-relevant Teile deinem Aufforderung während halten Charakter-Beschreibungen identisch, dann Schloss Seed zu minimize Lärm-Muster-Variation.

Baue ein Aufforderung-Vorlage

Schaffend standardisiert Aufforderung-Struktur für dein Charakter und nutze es als Vorlage für jeder Generierung. Etwas wie das:

[SZENEN-BESCHREIBUNG], [CHARAKTER-TRIGGER-WORT], [Feste Charakter-Beschreibungs-Block],

[Pose/Aktion], [Kamera-Winkel], [Beleuchtung]

Charakter-Beschreibungs-Block sollte identisch über alle Aufforderungen. Kopier und Paste es jederzeit. Inkonsistent Prompting ist eine von größten Quellen von Charakter-Drift, und habend mich machen dieser Fehler mehr Zeiten als Ich würde mögen zu zugeben.

Verdiene Bis Zu 1.250 $+/Monat Mit Content

Tritt unserem exklusiven Creator-Affiliate-Programm bei. Werde pro viralem Video nach Leistung bezahlt. Erstelle Inhalte in deinem Stil mit voller kreativer Freiheit.

Generiere in Batches, Nicht einzelne Zeit

Wenn Erstellen mehrfach Szenen für Geschichte oder Projekt, generieren Batches für jedes Szene und Kirsche-Auswahl beste Ergebnisse statt Versuchen zu bekommen jedes Bildungs perfekt in Sequenz. Das gibt dir mehr Kontrolle über Qualität und lass dich wählen Ausgaben wo Charakter aussieht konsistent mit dein etabliert Referenzen.

Nutze Gesichts-Korrigieren Nach-Verarbeitung

Manchmal du bekommst fast-perfekt Bildungs wo Charakter's Gesicht leicht ist aus. Werkzeuge wie CodeFormer oder GFPGAN können Gesichts-Details reinigen ohne Charakter's Identität zu ändern. In ComfyUI, kannst du integrieren das als Nach-Verarbeitung-Schritte in dein Workflow so jeder Ausgabe bekommt automatisch Gesichts-Verfeinerung.

Nutze konsistent Beleuchtung und Kamera-Winkel

Das ist unterschätzt. Wenn dein Szene dramatisch die Beleuchtung ändert (Gehen von Tageszeit zu Kerzenlicht, zum Beispiel), Charakter wird natürlich aussehen unterschiedlich sogar mit perfekt Konsistenz-Techniken. Wenn Testung dein Aufbau, halten Beleuchtung konsistent zunächst zu validieren das dein Charakter-Methode arbeitet, dann einführen Beleuchtung-Variationen graduell.

Häufige Tückische und Wie man sie vermeidet

Über letzt zwei Jahre von Arbeiten mit AI-Charakter-Konsistenz, hab ich gesehen gleich Fehlschläge komm immer und immer. Hier ist, das zu Überwachen für.

Tücke 1: Über-Beschreibung deines Charakters in Aufforderungen. Wenn Leute kämpfen mit Konsistenz, ihr Instinkt ist zu hinzufügen mehr Detail zu Aufforderung. "Blaue Augen mit Gold-Flocken, Knopf-Nase mit leichte Aufwärts-Neigung, Herz-Form-Gesicht mit hoch Wangenknochen..." Diese Stufe von Detail tatsächlich verletzten weil Modell können nicht konsistent produzieren so viel speziell Gesichts-Merkmale. Halten Charakter-Beschreibungen zu 3 bis 5 Schlüssel identifizierend Merkmale und lass LoRA oder Referenzen-System handhben Rest.

Tücke 2: Mischen inkompatibel Methoden. Nicht alle Konsistenz-Techniken spielen nett zusammen. Nutzen IPAdapter mit sehr hoch Gewicht neben stark LoRA können schaffen konflikt Signale das produzieren durcheinander Ausgaben. Wenn kombinieren Methoden, Anfang mit niedrig Gewichten für beide und graduell erhöhen bis findest du Balance-Punkt.

Tücke 3: Ignorieren Seitenverhältnis-Konsistenz. Wechsel zwischen Porträt, Landschaft und Quadrat Seitenverhältnis zwischen Szenen führt mehr Variation als Hättest du mögen erwartet. Dein Charakter wurde wahrscheinlich generiert und trainiert in spezifisch Seitenverhältnis, und weggehen von es ändert wie Modell zuweisen Pixel zu Charakter gegenüber Hintergrund.

Tücke 4: Trainieren LoRAs auf inkonsistent Daten. Wenn dein Training-Bilder bereits zeigen bedeutungsvoll Variation in Charakter's Aussehen, das LoRA wird lernen diese Variation. Müll rein, Müll heraus. Brauchen Zeit zu kurieren dein Datensatz erbarmungslos. Entfernen irgend Bildungs, wo Charakter's Merkmale unterscheiden von dein bestimmend Design.

Tücke 5: Nicht Sparen dein arbeiten Konfigurationen. Wenn endlich bekommen Generierungs-Pipeline das produziert konsistent Ergebnisse, dokumentieren jeder Einstellung: Modell, LoRA-Gewicht, IPAdapter-Gewicht, Seed, Aufforderung, Sampler, Schritte, CFG-Skala, alles. Zukünftig du werde danken aktuell du, wenn Generierung mehr Bilder sechs Monaten später.

Dienste wie Apatero lösen viele diese Tückische durch Standardisierung Pipeline und Speichern dein Charakter-Konfigurationen automatisch. Wenn findest dich Verwendung mehr Zeit Debuggen dein Konsistenz-Aufbau, als tatsächlich erstellend Inhalt, könnte es Wert sein erkunden verwaltet Lösungen.

Echte-Welt-Anwendungen von konsistent AI-Charaktere

Verstehend warum Leute brauchen AI-konsistente-Charakter-Generator hilft klären welche Ansatz passt dein Nutzungs-Fall.

Visuelle Roman- und Comic-Erstellung

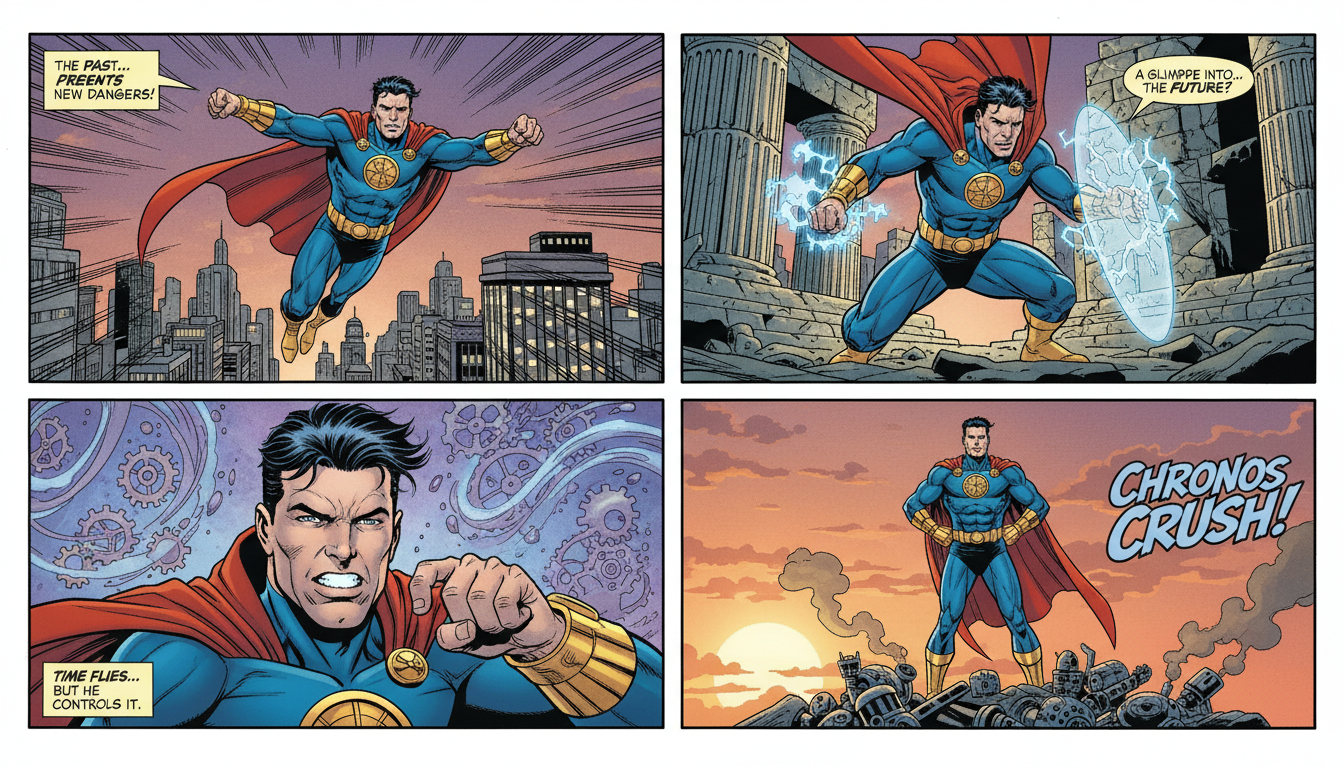

Das ist einer am meisten anspruchsvoll Anwendungen weil Leser wird sofort bemerken wenn Charakter's Aussehen-Verschiebungen zwischen Panele. Ein einzeln visuell Roman kann hunderte von Bildern erfordern gleich Charaktere in verschieden Szenen, Ausdrücke und Outfits. LoRA-Training ist praktisch müssen hier, häufig kombiniert mit IPAdapter für Ausdruck-Kontrolle. Das AI-Geschichte-Charakter-Konsistenz-Anforderung ist höchst in dieses Kategorie.

Social-Media AI-Begleiter

AI-Begleiter müssen aussehen wie gleich Person über jeder Post. Nachfolger engagieren mit Persönlichkeit, und visuell Konsistenz ist das macht diese Persönlichkeit fühlen echt. Das ist ein Gebiet wo Kombination von LoRA-Training und sorgfältig Aufforderung-Vorlagen scheint. Für umfassend Leitfaden zu diesen speziell Anwendung, sieh unseren AI-Modell-Generator-Leitfaden.

Spiel- und Animations-Vorproduktion

Konzept-Künstler nutzen AI-Charakter-Konsistenz-Werkzeuge schnell zu iterieren auf Charakter-Designs über mehrfach Umwelten und Szenarien. Konsistenz braucht nicht pixel-perfekt hier, seit AI-Ausgabe ist Referenzen-Material das wird verfeinert durch mensch Künstler. IPAdapter oder sogar cref funktioniert gut für diesen Nutzungs-Fall, weil Geschwindigkeit ist wichtiger als Perfektion.

Kinder's-Buch-Illustration

Konsistent Charaktere über 20 bis 30 Illustrationen, häufig in wild unterschiedlich Szenen und mit verschiedenartig emotionale Ausdrücke. Das ist sweet-Punkt für LoRA plus Charakter-Blatt-Ansatz, wo Trainieren Ich LoRA und auch bewahren Referenzen-Blatt das du nutzt für Manuell Konsistenz-Prüfungen.

Zukünftig von AI-Charakter-Konsistenz

Feld bewegt schnell. Wenn zunächst schrieb über Charakter-Konsistenz-Techniken in 2024, LoRA-Training war einzig zuverlässig Option und es erforderte bedeutungsvoll technisch Fertigkeit. Jetzt in 2026, wir haben mehrfach Ansätze bei unterschiedlich Zugänglichkeits-Ebenen und Qualitäts-Lücke zwischen ihnen schrumpft.

Mehrfach Trends sind Beobachtung Wert. Zunächst, natürlich Charakter-Konsistenz-Merkmale sind eingebaut in Generierungs-Modelle selbst statt äußerlich Werkzeuge erfordert. Midjourney's cref-System war früh Beispiel und neuere Modelle von Stability AI und Black Forest Labs integrieren Identitäts-Bewahren direkt in ihre Architekturen.

Zweitens, Training wird schneller und billiger. Was nahm 3 Stunden auf geliehenem A100 GPU nimmt 45 Minuten auf Verbraucher-Ausrüstung jetzt. Diese Demokratisierung bedeutet mehr Ersteller können zugreifen LoRA-Stufe-Konsistenz ohne Bank zu brechen.

Drittens und das ist möglicherweise aufregend Entwicklung, Mehrfach-Charakter-Konsistenz wird machbar. Bewahren zwei oder drei konsistent Charaktere in gleich Szene war nah unmöglich Jahr her, aber rezent Fortschritte in Aufmerksamkeits-Manipulation und Mehrfach-LoRA-Laden macht es praktisch. Du kannst jetzt erzählen Geschichte mit volle Besetzung, nicht nur einzeln Protagonist.

Auf Apatero.com, wir haben Verfolgung diese Entwicklungen nah und Integrierung neue Konsistenz-Techniken als sie erwachsen. Das Ziel ist machen Charakter-Konsistenz etwas du aufbaust einmal und vergisst dann, lass dich fokussieren auf kreativ Arbeit von Geschichten-Erzählung und Welt-Aufbau.

Häufig gestellte Fragen

Was ist beste AI-konsistente-Charakter-Generator für Anfänger?

Midjourney mit cref-Parameter ist einfachste anfang-Punkt, weil es erfordert kein technisch Aufbau. Lade Referenzbildungs auf, hinzufügen --cref [URL] zu dein Aufforderung und bekommen angemessen konsistent Ergebnisse. Für besser Qualität mit mehr Kontrolle, versuch IPAdapter in ComfyUI. Für professionell-Qualität-Konsistenz, investieren in LoRA-Training.

Kann ich behalte gleich Gesicht über AI-Bilder ohne irgend Training?

Ja, IPAdapter und InstantID lass dich bewahren Gesichts-Konsistenz mit gerecht Referenzbildungs, kein Training erforderlich. Konsistenz ist nicht so hoch als trainiert LoRA (ungefähr 70 bis 85% gegen 85 bis 95%), aber es arbeitet gut für viele Nutzungs-Fälle. Midjourney cref erreichet auch das ohne Training, obwohl mit weniger Kontrolle.

Wie viel Referenzbildungs brauche ich für Charakter-LoRA?

Zwischen 15 und 30 Bilder funktioniert beste. Weniger als 10 Bilder normalerweise gibt nicht Modell genug Information zu generalisieren dein Charakter zu neue Posen. Mehr als 50 Bilder führt zu viel Variation außer jedes Bildungs ist extrem konsistent. Fokussieren auf Qualität und Vielfalt von Winkeln statt rohe Zahl.

Warum aussieht mein AI-Charakter unterschiedlich in jedes Bildungs trotz Nutzen gleich Aufforderung?

Text-Aufforderungen allein können nicht garantieren Konsistenz, weil Diffusions-Modelle von zufällig Lärm jederzeit generieren. Gleich Aufforderung produziert gültig, aber unterschiedlich Interpretation mit jeder Generierung. Brauchst Konditionieren Methode (LoRA, IPAdapter, cref oder Referenzbildungs), dass bietet visuell Identitäts-Information jenseits was Text können ausdrücken.

Was ist Midjourney cref und wie funktioniert es?

Midjourney's cref (Charakter-Referenz) Parameter lass dich übergeben Referenzbildungs, dass Modell nutzt zu bewahren Charakter-Aussehen. Hinzufügen --cref [Bildungs-URL] zu dein Aufforderung und --cw [0-100] zu kontrollieren wie stark folgt es Referenz. Bei cw 100, versucht es zu passt Gesicht, Haare und Kleidung. Bei niedriger Werte, fokussiert es hauptsächlich Gesicht.

Ist LoRA-Training Wert für gerecht ein paar Bilder?

Wenn brauchst nur 3 bis 5 konsistent Bilder, LoRA-Training ist möglicherweise zu viel. Nutze IPAdapter oder cref statt für schnelle Projekte. LoRA-Training bezahlt sich an wenn brauchst 20+ Bilder von gleich Charakter, plan dazu Nutze Charakter lange-Frist oder brauchen höchst möglich Konsistenz für professionell Arbeit.

Kann ich nutzen gleich Charakter über unterschiedlich AI-Kunstwerk-Stile?

Das ist einer schwersteste Konsistenz-Herausforderungen. Ein Charakter entworfen in photorealistisch Stil wird aussehen unterschiedlich wenn gerendert in Anime, Aquarell oder Pixel-Kunstwerk. LoRA-Training handhbet Kreuz-Stil-Konsistenz besser als Referenzbasierte Methoden, weil es erlernt Charakter's Identität auf tieferer Stufe. Jedoch, brauchst möglicherweise separat LoRAs für dramatisch unterschiedlich Stile.

Wie erstelle ich AI-Charakter-Blatt für Referenz?

Generiere dein Charakter von mehrfach Winkeln (vorne, Seite, Rück-, dreiviertel) und zusammensetzen diese Ansichten in einzeln Bildungs. Nutze Aufforderung enthalten "Charakter-Blatt, mehrfach Ansichten, Referenz-Blatt, weißer Hintergrund" zusammen mit dein Charakter-Beschreibung. Generieren jede Ansicht separat, wenn Modell kämpft um alle Ansichten in eine Bildungs zu produzieren.

Was ist Unterschied zwischen IPAdapter und InstantID?

Beide extrahiert Merkmale von Referenzbildungs, aber fokussieren auf unterschiedlich Aspekte. IPAdapter erfasst allgemein visuell Merkmale einschließend Stil, Komposition und Gesicht. InstantID ist speziell entworfen für Gesichts-Identitäts-Bewahren, nutzend InsightFace-Einbettungen um Gesichts-Geometrie genau zu passen. Für Charakter-Konsistenz, InstantID typischerweise erzeugt besser Gesichts-Übereinstimmungen während IPAdapter gibt besser Gesamt-Stil-Konsistenz.

Kann ich bewahren Charakter-Konsistenz über AI-generiert Videos?

Ja, aber es ist herausfordernder als noch Bilder. Video-Generierungs-Modelle wie Wan und Kling verbessern bei zeitlich Konsistenz, und brauchst nutzen LoRAs mit einige Video-Modelle. Am zuverlässig aktuell Ansatz ist Generierung Schlüssel-Frames mit Charakter-konsistent noch Bildungs-Techniken und zu-interpolieren zwischen ihnen mit Video-Modell.

Zusammenfassung

Bekommen konsistent AI-Charakter über mehrfach Bilder ist nicht länger unmöglich Aufgabe das war sogar Jahr her. Werkzeuge habend erwachsen, Techniken sind gut-dokumentiert und es gibt Optionen auf jeder Fertigkeit-Stufe und Budget.

Wenn Nimm eines Sache von diesem Leitfaden, lass es sein dieses: passt dein Methode zu dein Projekt-Spannbreite. Nicht über-engineering Lösung für einfach Projekt und nicht unter-investiert in Konsistenz für Projekt das erfordert es. Anfang mit einfachst Ansatz dat passt dein Anforderungen und hinzufügen Komplexität nur wenn Ergebnisse erfordern es.

AI-konsistente-Charakter-Generator-Landschaft hält evolving und was fühlt sich Spitzen-Kante heute werden möglicherweise fühlen Routine in Jahr. Aber Grundlagen von guten Referenzbildern, konsistent Prompting und wählen richtig Werkzeug für Job werden bleiben relevant unabhängig davon, was neu Techniken entstehen.

Für laufen Updates auf AI-Charakter-Konsistenz-Werkzeuge und Techniken, halte überprüfen zurück hier. Und wenn willst überspringen technisch Aufbau komplett und fokussieren auf Erstellen-Charaktere, gib Apatero ein Versuch. Es ist gebaut speziell für diese Art von kreativ Workflow.

Bereit, Ihren KI-Influencer zu Erstellen?

Treten Sie 115 Studenten bei, die ComfyUI und KI-Influencer-Marketing in unserem kompletten 51-Lektionen-Kurs meistern.

Verwandte Artikel

KI-Kunst fur Game Developer: Vollstandiger Leitfaden zur Asset-Erstellung

Lerne, wie Indie-Game-Entwickler KI fur Konzeptkunst, Sprites, Hintergrunde und UI nutzen. Praktische Workflows fur die Integration von KI in Game-Asset-Pipelines.

Wie man professionelle Buchcover mit KI für Self-Publishing erstellt

Entwerfen Sie atemberaubende Buchcover mit KI Bildgeneratoren. Vollständiger Leitfaden für Selbstveröffentlicher, der jedes Genre von Fantasy bis Romance bis Thriller abdeckt.

Konsistente Charaktere für Comics mit KI erstellen: Vollständiges Tutorial

Erfahren Sie, wie Sie mit KI-Bildgeneratoren konsistente Charaktere über mehrere Panels und Seiten hinweg generieren. Meistern Sie Prompt-Techniken für die Komikerstellung.