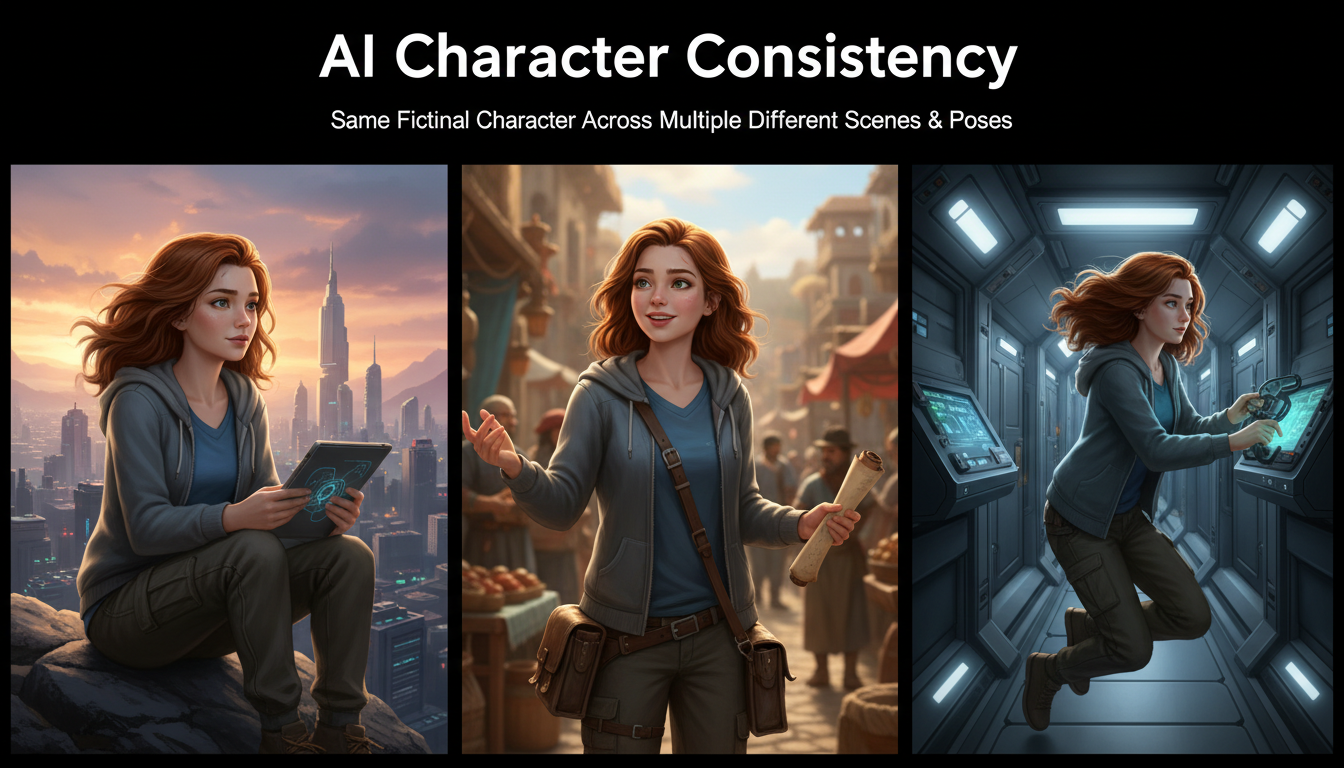

Generador de Personajes IA Consistentes: Cómo Mantener el Mismo Personaje en Múltiples Imágenes

Aprende a generar el mismo personaje de IA en múltiples escenas usando LoRA training, IPAdapter, Midjourney cref y técnicas de imagen de referencia. Guía completa 2026.

Si alguna vez has intentado contar una historia visual con imágenes generadas por IA, ya conoces el dolor. Creas una imagen perfecta de tu personaje en la primera escena, pasas a la siguiente, y de repente la IA te da a alguien que parece un primo lejano en el mejor de los casos. El cabello es diferente, la forma del rostro cambió, y la ropa bien podría pertenecer a una persona completamente diferente. Esta es la frustración más grande para cualquiera que construya cómics, novelas visuales, storyboards o contenido de redes sociales con herramientas de arte IA.

Respuesta rápida: Un generador de personajes IA consistentes utiliza técnicas como fine-tuning de LoRA, embedding facial de IPAdapter, parámetro cref de Midjourney, o imágenes de referencia estructuradas para mantener la misma identidad de personaje en múltiples imágenes generadas. Los mejores resultados provienen de combinar al menos dos métodos. El entrenamiento de LoRA en 15 a 30 imágenes de referencia entrega la consistencia más alta (alrededor del 90%), mientras que los métodos basados en referencias como cref o IPAdapter ofrecen una configuración más rápida con fidelidad ligeramente menor (70 a 85%). Tu elección depende de si necesitas consistencia perfecta para proyectos profesionales o "lo suficientemente buena" para exploración creativa rápida.

- El entrenamiento de LoRA proporciona la mejor consistencia de personaje pero requiere inversión de tiempo inicial (2 a 4 horas de configuración y entrenamiento)

- IPAdapter e InstantID ofrecen un punto intermedio sin necesidad de entrenamiento, solo imágenes de referencia

- El parámetro cref de Midjourney es el punto de entrada más fácil pero te da el menor control

- Combinar métodos (LoRA más IPAdapter, por ejemplo) produce los resultados más confiables

- Las hojas de personaje y referencias de giro dramático mejoran mucho la consistencia sin importar qué método uses

- Herramientas como Apatero manejan la complejidad técnica detrás de las escenas para creadores que desean resultados sin construir pipelines

Por qué la Consistencia de Personaje es el Problema Más Difícil en la Generación de Imágenes IA

La consistencia de personaje es fundamentalmente contraria a cómo funcionan los modelos de difusión. Estos modelos generan imágenes comenzando desde el ruido y refinándolo gradualmente en algo que coincide con tu descripción de texto. Cada generación comienza desde un patrón de ruido diferente, lo que significa que cada salida es única. Eso es excelente para la variedad pero terrible para mantener una identidad consistente.

Primero me encontré con este problema hace unos dos años cuando intenté construir una tira cómica corta usando Stable Diffusion. Tenía un personaje que realmente me gustaba de mi generación inicial: una mujer pelirroja en una chaqueta de cuero con una cicatriz distintiva sobre su ceja izquierda. El panel muy siguiente requería que estuviera en una pose diferente, y después de 80 generaciones no podía encontrar a nadie que se pareciera remotamente a ella. Ese proyecto me enseñó una lección crítica: los prompts de texto solos no pueden resolver la consistencia de personaje, sin importar cuán detallados los hagas.

La razón es directa. Cuando escribes "mujer pelirroja con cicatriz sobre ceja izquierda", el modelo interpreta esa descripción de nuevo cada vez. Su representación interna de "mujer pelirroja" varía entre generaciones porque el espacio latente es enorme. Dos imágenes que coinciden con el mismo prompt de texto pueden verse radicalmente diferentes mientras que ambas son interpretaciones técnicamente correctas de tus palabras.

Por eso las técnicas dedicadas para la consistencia de personaje IA se han vuelto tan importantes. Ya sea que estés construyendo una biblioteca de personajes de novela visual IA, creando materiales de marketing con una mascota de marca, o desarrollando arte de concepto para un juego, necesitas herramientas que vayan más allá del prompting simple.

Los Cuatro Enfoques Principales para la Generación Consistente de Personajes IA

Antes de sumergirte en flujos de trabajo específicos, ayuda entender el panorama. Hay cuatro enfoques principales para mantener un personaje IA consistente en escenas, y cada uno se sitúa en un punto diferente en el espectro esfuerzo-versus-calidad.

1. Fine-Tuning de LoRA (Calidad Más Alta, Máximo Esfuerzo)

El entrenamiento de LoRA enseña al modelo de IA cómo se ve específicamente tu personaje a un nivel profundo. Le das 15 a 30 imágenes curadas de tu personaje, y crea un pequeño archivo adaptador (típicamente 10 a 150MB) que modifica el comportamiento del modelo. Cuando activas este LoRA durante la generación, el modelo "conoce" tu personaje y puede renderizarlo en cualquier pose o escena mientras mantiene su identidad central.

Considero el entrenamiento de LoRA innegociable para cualquier proyecto serio de personaje. La consistencia que obtienes es incomparable con cualquier otro método. Si deseas entender los fundamentos de cómo funciona esto, consulta nuestra guía completa de principiante para LoRA training.

Mejor para: Proyectos de personajes a largo plazo, novelas visuales, cómics, mascotas de marca, pipelines de contenido profesional.

Desventajas: Requiere un conjunto de datos de tu personaje (problema huevo-y-gallina para nuevos personajes), toma 1 a 3 horas de tiempo de entrenamiento, necesita una GPU decente o computación en la nube.

2. IPAdapter e InstantID (Buena Calidad, Esfuerzo Moderado)

IPAdapter funciona extrayendo características faciales y estilísticas de una imagen de referencia e inyectando esas características en el proceso de generación. Proporcionas una o más fotos de referencia de tu personaje, e IPAdapter condiciona el proceso de difusión para que coincida con esas características. InstantID es un enfoque similar específicamente optimizado para preservar la identidad facial.

La ventaja aquí es la velocidad. No necesitas entrenar nada. Solo proporciona una imagen de referencia y comienza a generar. La compensación es que la consistencia baja comparada con LoRA, especialmente para características no faciales como ropa, tipo de cuerpo y accesorios.

Mejor para: Prototipado rápido, personajes basados en personas reales (con consentimiento), proyectos donde la consistencia facial es lo más importante.

Desventajas: Lucha con cambios de pose extremos, puede perder detalles de ropa y accesorios, a veces produce un efecto "uncanny valley" donde la cara es consistente pero todo lo demás se desplaza.

3. Midjourney cref (Más Fácil, Menos Control)

El parámetro de referencia de personaje de Midjourney (cref) es la opción más accesible para principiantes. Simplemente pasas una URL de imagen de referencia con la bandera --cref, y Midjourney intenta mantener la apariencia de ese personaje en nuevas generaciones. El parámetro --cw (character weight) te permite controlar cuán fuertemente se adhiere a la referencia.

Opinión caliente: Midjourney cref está sobre promocionado para trabajo serio. Es fantástico para exploración casual y contenido de redes sociales, pero la consistencia se desmorona significativamente cuando necesitas tu personaje en poses complejas, diferentes condiciones de iluminación, o escenas estilísticamente diferentes. Lo he probado extensamente y encuentro que funciona aproximadamente el 70% del tiempo para transferencias simples de retrato a retrato, pero cae a alrededor del 40% de confiabilidad cuando cambias la escena dramáticamente. Para narrativas visuales profesionales, golpearás un muro rápidamente.

Mejor para: Contenido de redes sociales, exploración casual de personajes, arte conceptual rápido, usuarios de Midjourney que no quieren aprender nuevas herramientas.

Desventajas: Bloqueado en el ecosistema de Midjourney, control limitado sobre qué aspectos del personaje se preservan, sin ajustabilidad de grano fino.

4. Imágenes de Referencia Estructuradas y Hojas de Personaje (Suplementario)

Una hoja de giro de personaje IA es una sola imagen mostrando tu personaje desde múltiples ángulos: frente, lado, espalda y vistas de tres cuartos. Estas hojas sirven como referencias integrales que puedes usar con cualquiera de los métodos anteriores para mejorar la consistencia. No son una solución independiente sino un multiplicador de fuerza.

Crear una buena hoja de personaje implica generar tu personaje en una pose neutral desde múltiples ángulos, luego componer esas vistas en una sola imagen de referencia. Esto le da al método de consistencia que estés usando más información con la que trabajar.

Paso a Paso: Construyendo un LoRA de Personaje para Consistencia Máxima

Este es el flujo de trabajo estándar de oro para cualquiera que necesite consistencia de personaje confiable y repetible. Te guiaré a través de todo el proceso desde la creación del conjunto de datos hasta el despliegue.

Paso 1: Crea el Diseño Inicial de tu Personaje

Si tu personaje aún no existe, necesitas generarlo primero. Este es el desafío de bootstrap. Aquí está mi enfoque recomendado.

Comienza generando un gran lote de imágenes (50 a 100) con un prompt detallado describiendo tu personaje. Usa un modelo base de alta calidad como Flux, SDXL, o uno de los mejores generadores de imágenes IA disponibles en 2026. Revisa el lote y elige la sola imagen que mejor represente tu visión.

Desde esa imagen elegida, usa img2img o IPAdapter para generar variaciones en diferentes poses y expresiones. El objetivo es construir un conjunto de datos de 15 a 30 imágenes donde el personaje sea reconociblemente la misma persona pero mostrado con suficiente variedad que el LoRA aprenda la identidad del personaje en lugar de memorizar una sola pose.

Paso 2: Curación y Preparación del Conjunto de Datos

La calidad importa mucho más que la cantidad para conjuntos de datos de LoRA training. Una vez intenté entrenar un LoRA con 200 imágenes de un personaje y obtuve peores resultados que un conjunto cuidadosamente curado de 20. El conjunto de datos grande tenía demasiadas inconsistencias, y el modelo aprendió el promedio de todas esas variaciones en lugar del personaje "verdadero".

Aquí está lo que tu conjunto de datos debe incluir:

- 5 a 8 retratos cercanos con expresiones variadas (neutral, sonriendo, serio, sorprendido)

- 5 a 8 planos medios mostrando el cuerpo superior desde diferentes ángulos

- 3 a 5 tomas de cuerpo completo con diferentes poses

- 2 a 3 imágenes en diferentes atuendos (si deseas flexibilidad de atuendo)

- Todas las imágenes deben tener fondos limpios (los colores sólidos funcionan mejor)

- La resolución debe ser de al menos 512x512, idealmente 1024x1024

Etiqueta cada imagen con una palabra de activación consistente para tu personaje (algo único como "chrNAME" o "sks_character") y descripciones precisas de la pose, expresión y ropa.

Paso 3: Configura y Ejecuta el Entrenamiento

Para la configuración del entrenamiento, estos ajustes funcionan bien como punto de partida para LoRAs de personaje en modelos Flux o SDXL:

- Tasa de aprendizaje: 1e-4 para Flux, 5e-5 para SDXL

- Pasos de entrenamiento: 1,500 a 3,000 (más no es siempre mejor)

- Rango de red: 32 a 64 (mayor captura más detalle pero riesgo de sobreajuste)

- Alfa de red: La mitad de tu valor de rango (16 a 32)

- Resolución: 1024x1024

- Tamaño de lote: 1 a 2 (limitado por VRAM)

- Optimizador: AdamW o Prodigy (Prodigy ajusta automáticamente la tasa de aprendizaje)

Siempre ejecuto una generación de prueba en la marca de la mitad. Si el personaje ya es reconocible en el paso 1,500, probablemente no necesites entrenar hasta 3,000. El sobreentrenamiento hace que el LoRA sea rígido, lo que significa que reproducirá tus imágenes de entrenamiento demasiado literalmente y lucharás con nuevas poses. Para una inmersión más profunda en este proceso, nuestra guía para crear modelos virtuales IA cubre el pipeline de entrenamiento en detalle.

Paso 4: Prueba e Itera

Después del entrenamiento, prueba tu LoRA con prompts que difieran significativamente de tus datos de entrenamiento. Genera tu personaje en escenas y poses que no estaban en el conjunto de entrenamiento. Esto te dice qué tan bien el LoRA generalizó versus memorizó.

Problemas comunes y correcciones:

- La cara se ve bien pero el cuerpo está mal: Agrega más imágenes de cuerpo completo a tu conjunto de datos y reentrena

- El personaje solo funciona en una pose: Tus datos de entrenamiento carecían de variedad, agrega poses más diversas

- La salida se ve "quemada" o sobre-saturada: Sobreentrenaste, reduce pasos o reduce la tasa de aprendizaje

- LoRA no tiene efecto visible: Verifica tu palabra de activación, aumenta el peso de LoRA, o verifica que el LoRA sea compatible con tu modelo base

Paso a Paso: Usando IPAdapter para Consistencia de Personaje Rápida

Cuando necesitas resultados rápido y no quieres invertir horas en LoRA training, IPAdapter es tu mejor amigo. Este flujo de trabajo te lleva de cero a personajes consistentes en menos de 30 minutos.

Configurando IPAdapter en ComfyUI

IPAdapter requiere una configuración específica en ComfyUI con los nodos personalizados de IPAdapter Plus instalados. Necesitarás el modelo facial específicamente para trabajo de consistencia de personaje.

Flujos de ComfyUI Gratuitos

Encuentra flujos de ComfyUI gratuitos y de código abierto para las técnicas de este artículo. El código abierto es poderoso.

- Instala los nodos personalizados ComfyUI-IPAdapter-Plus desde GitHub

- Descarga el modelo de cara de IPAdapter (ip-adapter-faceid-plusv2_sd15.bin para SD 1.5 o la variante SDXL)

- Descarga el modelo de análisis InsightFace requerido

- Coloca los modelos en los directorios correctos dentro de tu instalación de ComfyUI

El Flujo de Trabajo

Una vez instalado, el flujo de trabajo es directo. Proporcionas una imagen de referencia de tu personaje, e IPAdapter extrae características faciales que se inyectan en el proceso de difusión en capas de atención específicas.

Los parámetros clave para ajustar:

- Peso: Comienza en 0.7 y ajusta. Valores más altos (0.85+) producen coincidencias faciales más cercanas pero pueden reducir la calidad de imagen. Valores más bajos (0.5 a 0.6) dan más libertad creativa pero consistencia más suelta.

- Porcentaje de inicio/fin: Controla cuándo en el proceso de difusión comienza y termina la influencia de IPAdapter. Comenzar en 0% y terminar en 80% usualmente produce los mejores resultados.

- Modo de ID facial: Usa esto específicamente para consistencia facial en lugar del modo general de IPAdapter, que también transfiere estilo y composición.

Opinión caliente: La mayoría de las personas usa el peso de IPAdapter demasiado alto. Configurarlo en 0.9+ porque quieres "máxima consistencia" realmente degrada la salida. Obtienes artefactos faciales, texturas de piel extrañas, y ese look distintivo de "cara pegada". Un peso de 0.65 a 0.75 te da el 90% de la consistencia sin ninguno de los artefactos. Confía en que el modelo haga su trabajo.

Combinando IPAdapter con un LoRA

Aquí es donde las cosas se ponen poderosas. Usa tu LoRA entrenado para manejar la identidad general del personaje (forma facial, cabello, proporciones generales) y superpone IPAdapter para bloquear características faciales específicas para consistencia extra. El LoRA proporciona el "quién" mientras que IPAdapter refuerza el "exactamente cómo se ven".

En mi prueba, esta combinación empujó la consistencia de aproximadamente 85% (solo LoRA) a más del 95%. El flujo de trabajo en ComfyUI encadena el cargador de LoRA antes del acondicionamiento de IPAdapter, así que ambos influyen en la generación simultáneamente.

En Apatero, este tipo de pipeline de consistencia de múltiples capas se ejecuta automáticamente cuando creas un personaje y generas variaciones. La plataforma maneja el apilamiento de modelos y ajuste de parámetros detrás de las escenas, lo que ahorra considerable tiempo comparado con construir el flujo de trabajo de ComfyUI desde cero.

Paso a Paso: Usando Midjourney cref para Referencias de Personaje

Para usuarios de Midjourney que desean consistencia de personaje sin dejar la plataforma, el sistema cref es el camino más rápido.

Uso Básico

La sintaxis es simple. Genera o proporciona la imagen de referencia de tu personaje, luego inclúyela en prompts futuros:

/imagine prompt: [descripción de tu personaje], [descripción de escena] --cref [URL de imagen] --cw 100

El parámetro --cw controla el peso del personaje:

- 100 (predeterminado): Coincide con cara, cabello, ropa y apariencia general

- 50 a 75: Coincide con cara y cabello pero permite variaciones de ropa

- 0 a 25: Coincide solo con estilo general, referencia de personaje suelta

Consejos para Mejores Resultados de cref

Después de pasar semanas probando el cref de Midjourney con varios tipos de personajes, encontré varios patrones que consistentemente mejoran los resultados.

Primero, tu imagen de referencia importa enormemente. Un retrato limpio, bien iluminado con el personaje centrado en el marco funciona diez veces mejor que una escena compleja donde el personaje está parcialmente oscurecido. Si tu mejor imagen de personaje los tiene en una pose de acción contra un fondo ocupado, tómate el tiempo para generar primero una versión de retrato limpio y úsala como tu fuente de cref.

Segundo, sé explícito sobre qué debe cambiar versus qué debe permanecer igual. Si quieres tu personaje en un nuevo atuendo pero con la misma cara, baja el peso del personaje a alrededor de 50 y describe el nuevo atuendo en tu prompt. Si quieres todo idéntico excepto la escena, mantén el peso del personaje en 100 y solo describe el nuevo ambiente.

Tercero, Midjourney maneja la consistencia del mismo estilo mejor que la consistencia de estilo cruzado. Si tu referencia es una imagen fotorrealista e intentas generar una versión de dibujos animados de ese personaje, la consistencia cae bruscamente. Adhiérate al mismo estilo general que tu referencia para mejores resultados.

Creando Hojas de Personaje IA Efectivas y Referencias de Giro Dramático

Una hoja de personaje es tu arma secreta sin importar cuál enfoque de generador de personaje ia consistentes uses. Piénsalo como un diccionario visual para tu personaje que cualquier método puede referenciar.

Qué Va en una Hoja de Personaje

Una buena hoja de giro de personaje IA incluye varias vistas esenciales.

¿Quieres evitar la complejidad? Apatero te ofrece resultados profesionales de IA al instante sin configuración técnica.

La vista frontal debe ser una pose neutral de pie, brazos ligeramente alejados del cuerpo para que el atuendo completo sea visible. Esta es tu referencia "por defecto" que captura la versión más reconocible de tu personaje. Incluye una vista cercana del rostro con una expresión neutral, mostrando características faciales distintivas claramente.

Los perfiles laterales (izquierdo y derecho) revelan la silueta del personaje, peinado desde otro ángulo, y cualquier característica específica de perfil como joyería, cicatrices u ornamentos de cabello. Una vista trasera es esencial si tu personaje tiene detalles distintivos en la espalda como largo de cabello, capa, mochila, o tatuajes.

Las hojas de expresión mostrando el mismo personaje con diferentes emociones (feliz, triste, enojado, sorprendido, decidido) ayudan cuando necesitas rango emocional en tus escenas de historia. Estas también proporcionan datos de entrenamiento excelentes para LoRAs porque enseñan al modelo que la identidad de tu personaje persiste en estados emocionales.

Generando una Hoja de Personaje con IA

Aquí está un enfoque práctico que uso al crear hojas de personaje para nuevos personajes originales.

Comienza generando tu imagen de personaje definitiva. Una vez que tengas el diseño bloqueado, usa una combinación de tu método preferido (LoRA, IPAdapter, o cref) con prompting específico para generar cada vista de la hoja. Una estructura de prompt como esta funciona bien:

character sheet, multiple views, front view, side view, back view,

three-quarter view, [tu descripción de personaje], white background,

reference sheet, concept art, clean linework

Si el enfoque de prompt único no produce buenos resultados (frecuentemente no lo hace), genera cada vista por separado y compónlas manualmente en un editor de imágenes. Esto toma más tiempo pero te da mucho mejor control sobre cada vista.

Debo notar que este proceso se ha vuelto dramáticamente más fácil en 2026 comparado con hace incluso un año. Modelos como Flux y los últimos fine-tunes de SDXL manejan la generación multi-vista mucho más confiablemente que los modelos más antiguos. Si intentaste este enfoque en 2024 y te rendiste, vale la pena revisitarlo.

Comparando Todos los Enfoques: Cuál Método Deberías Elegir

Déjame ser directo sobre qué funciona y qué no, basado en pruebas extensivas en todos los cuatro métodos.

| Método | Puntuación de Consistencia | Tiempo de Configuración | Velocidad Por Imagen | Mejor Para |

|---|---|---|---|---|

| LoRA Training | 85-95% | 2-4 horas | Rápido (una vez entrenado) | Proyectos largos, trabajo profesional |

| IPAdapter/InstantID | 70-85% | 30 minutos | Medio | Prototipado rápido, referencia de cara real |

| Midjourney cref | 60-80% | 5 minutos | Rápido | Uso casual, contenido de redes sociales |

| Hojas de Personaje Solo | 40-60% | 1 hora | Varía | Material de referencia suplementario |

Opinión caliente: El método "mejor" depende completamente de tu alcance de proyecto, y la mayoría de las personas eligen mal. Los principiantes gravitan hacia cref porque es fácil, luego se frustran cuando la consistencia se desmorona después de 10 imágenes. Los usuarios experimentados a veces sobre-ingenierizaban pipelines de LoRA para proyectos que solo necesitaban cinco imágenes consistentes. Haz coincidir tu método con tus necesidades reales. Si estás haciendo un cómic de 50 páginas, invierte en LoRA training. Si estás haciendo una publicación social de tres imágenes, cref o IPAdapter te servirán bien.

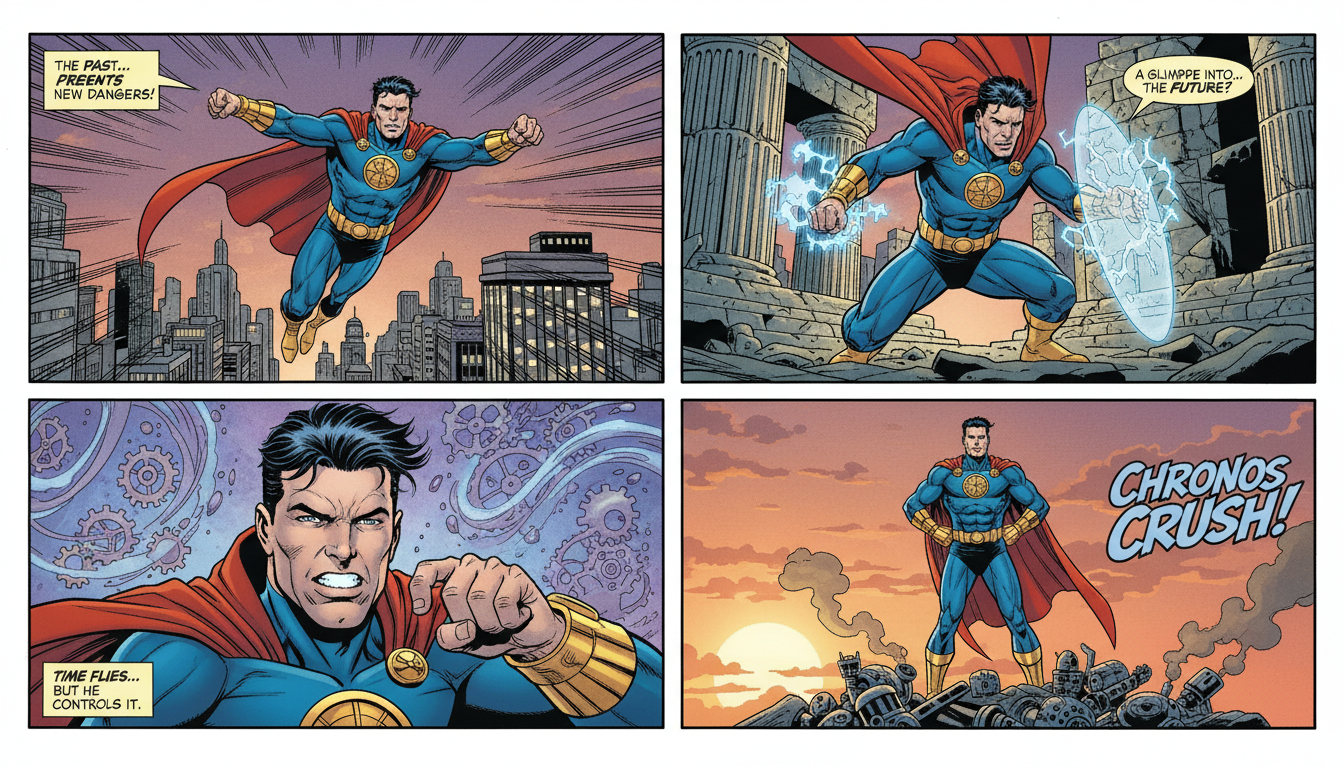

Para proyectos que involucran personajes de anime IA, los requisitos de consistencia son aún más altos porque los estilos de anime tienen características más exageradas y específicas que son más difíciles de mantener. Variaciones pequeñas en tamaño de ojo, estilo de cabello, o saturación de color son más notables en anime que en estilos fotorrealistas.

Consejos Avanzados para Mantener la Consistencia de Personaje IA

Más allá de los métodos principales, varias técnicas avanzadas pueden empujar tu consistencia aún más alto. Estos son los trucos que he aprendido de cientos de horas de trabajo de generación de personajes.

Usa Bloqueo de Semilla Estratégicamente

Fijar la semilla aleatoria no garantiza consistencia de personaje (no es un botón mágico), pero puede ayudar cuando se usa junto a otros métodos. Una semilla fija con el mismo prompt producirá la misma imagen, pero cambiar el prompt incluso ligeramente producirá un resultado diferente. El truco es cambiar solo las partes relevantes de la escena de tu prompt mientras mantienes descripciones de personaje idénticas, luego bloquea la semilla para minimizar la variación del patrón de ruido.

Construye una Plantilla de Prompt

Crea una estructura de prompt estandarizada para tu personaje y úsala como plantilla para cada generación. Algo como esto:

[DESCRIPCIÓN DE ESCENA], [PALABRA DE ACTIVACIÓN DE PERSONAJE], [bloque de descripción de personaje fijo],

[pose/acción], [ángulo de cámara], [iluminación]

El bloque de descripción de personaje debe ser idéntico en todos los prompts. Cópialo y pégalo cada vez. El prompting inconsistente es una de las mayores fuentes de derivación de personaje, y me he atrapado a mí mismo cometiendo este error más veces de las que me gustaría admitir.

Gana Hasta $1,250+/Mes Creando Contenido

Únete a nuestro programa exclusivo de creadores afiliados. Cobra por video viral según rendimiento. Crea contenido a tu estilo con total libertad creativa.

Genera en Lotes, No Uno por Uno

Cuando creas múltiples escenas para una historia o proyecto, genera lotes para cada escena y elige lo mejor de los resultados en lugar de intentar obtener cada imagen perfecta en secuencia. Esto te da más control sobre la calidad y te permite elegir las salidas donde el personaje se ve más consistente con tu referencia establecida.

Aprovecha la Fijación de Cara Post-Procesamiento

A veces obtienes una imagen casi perfecta donde la cara del personaje está ligeramente apagada. Herramientas como CodeFormer o GFPGAN pueden limpiar detalles faciales sin cambiar la identidad del personaje. En ComfyUI, puedes integrar estas como pasos de post-procesamiento en tu flujo de trabajo para que cada salida obtenga refinamiento facial automático.

Usa Iluminación y Ángulos de Cámara Consistentes

Esto está subestimado. Si tu escena cambia dramáticamente la iluminación (pasando de luz de día a luz de vela, por ejemplo), el personaje se verá naturalmente diferente incluso con técnicas de consistencia perfectas. Al probar tu configuración, mantén la iluminación consistente primero para validar que tu método de personaje está funcionando, luego introduce variaciones de iluminación gradualmente.

Pitfalls Comunes y Cómo Evitarlos

En los últimos dos años trabajando con consistencia de personaje IA, he visto los mismos errores surgir repetidamente. Aquí está lo que debes vigilar.

Pitfall 1: Describir excesivamente tu personaje en prompts. Cuando las personas luchan con consistencia, su instinto es agregar más detalle al prompt. "Ojos azules con motas de oro, nariz de botón con inclinación ligeramente hacia arriba, cara en forma de corazón con pómulos altos..." Este nivel de detalle realmente daña porque el modelo no puede reproducir consistentemente tantas características faciales específicas. Mantén descripciones de personaje a 3 a 5 características de identificación clave y deja que el LoRA o sistema de referencia maneje el resto.

Pitfall 2: Mezclar métodos incompatibles. No todas las técnicas de consistencia juegan bien juntas. Usar IPAdapter con un peso muy alto junto a un LoRA fuerte puede crear señales conflictivas que producen salidas confusas. Al combinar métodos, comienza con pesos bajos para ambos e incrementa gradualmente hasta encontrar el punto de equilibrio.

Pitfall 3: Ignorar la consistencia de relación de aspecto. Cambiar entre relaciones de aspecto de retrato, paisaje y cuadrado entre escenas introduce más variación de la que podrías esperar. Tu personaje fue probablemente generado y entrenado en una relación de aspecto específica, y alejarte de ella cambia cómo el modelo asigna píxeles al personaje versus el fondo.

Pitfall 4: Entrenar LoRAs en datos inconsistentes. Si tus imágenes de entrenamiento ya muestran variación significativa en la apariencia del personaje, el LoRA aprenderá esa variación. Basura adentro, basura afuera. Pasa el tiempo para curar tu conjunto de datos sin piedad. Remueve cualquier imagen donde las características del personaje difieran de tu diseño intencionado.

Pitfall 5: No salvar tus configuraciones de trabajo. Cuando finalmente obtienes un pipeline de generación que produce resultados consistentes, documenta cada ajuste: el modelo, peso de LoRA, peso de IPAdapter, semilla, prompt, sampler, pasos, escala CFG, todo. El tú futuro te agradecerá al tú presente cuando necesites generar más imágenes seis meses después.

Servicios como Apatero resuelven muchos de estos pitfalls por estandarizar el pipeline y almacenar automáticamente las configuraciones de tu personaje. Si te encuentras pasando más tiempo depurando tu configuración de consistencia que realmente creando contenido, podría valer la pena explorar soluciones manejadas.

Aplicaciones Reales de Personajes IA Consistentes

Entender por qué las personas necesitan un generador de personaje ia consistentes ayuda a aclarar cuál enfoque se ajusta a tu caso de uso.

Creación de Novelas Visuales y Cómics

Esta es una de las aplicaciones más exigentes porque los lectores notarán inmediatamente si la apariencia de un personaje se desplaza entre paneles. Una sola novela visual puede requerir cientos de imágenes de los mismos personajes en diferentes escenas, expresiones y atuendos. El entrenamiento de LoRA es prácticamente obligatorio aquí, a menudo combinado con IPAdapter para control de expresión. Los requisitos de consistencia de personaje de historia ia son los más altos en esta categoría.

Influencers IA en Redes Sociales

Los influencers IA necesitan verse como la misma persona en cada publicación. Los seguidores se relacionan con una personalidad, y la consistencia visual es lo que hace que esa personalidad se sienta real. Este es un área donde la combinación de LoRA training y plantillas de prompt cuidadosas brilla. Para una guía integral de esta aplicación específica, consulta nuestra guía de generador de modelos IA.

Pre-Producción de Juegos y Animación

Los artistas de concepto usan herramientas de consistencia de personaje IA para iterar rápidamente en diseños de personajes en múltiples ambientes y escenarios. La consistencia no necesita ser pixel-perfecta aquí ya que la salida de IA es material de referencia que será refinado por artistas humanos. IPAdapter o incluso cref funciona bien para este caso de uso porque la velocidad importa más que la perfección.

Ilustración de Libros Infantiles

Personajes consistentes en 20 a 30 ilustraciones, frecuentemente en escenas radicalmente diferentes y con varias expresiones emocionales. Este es un lugar dulce para el enfoque de LoRA más hoja de personaje, donde entrenas un LoRA y también mantienes una hoja de referencia que usas para verificaciones de consistencia manual.

El Futuro de la Consistencia de Personaje IA

El campo se mueve rápido. Cuando escribí por primera vez sobre técnicas de consistencia de personaje en 2024, el LoRA training era la única opción confiable y requerería habilidad técnica significativa. Ahora en 2026, tenemos múltiples enfoques en diferentes niveles de accesibilidad, y la brecha de calidad entre ellos se está reduciendo.

Varios trends valen la pena vigilar. Primero, características nativas de consistencia de personaje están siendo construidas dentro de los modelos de generación mismos en lugar de requerir herramientas externas. El sistema cref de Midjourney fue un ejemplo temprano, y los modelos más nuevos de Stability AI y Black Forest Labs están incorporando preservación de identidad directamente en sus arquitecturas.

Segundo, el entrenamiento se está haciendo más rápido y barato. Lo que solía tomar 3 horas en una GPU A100 alquilada ahora toma 45 minutos en hardware de consumidor. Esta democratización significa que más creadores pueden acceder a consistencia a nivel de LoRA sin romper el banco.

Tercero, y esto es quizás el desarrollo más emocionante, la consistencia multi-personaje se está volviendo viable. Mantener dos o tres personajes consistentes en la misma escena era casi imposible hace un año, pero avances recientes en manipulación de atención y carga de LoRA múltiple lo están haciendo práctico. Ahora puedes contar una historia con un elenco completo, no solo un protagonista.

En Apatero.com, hemos estado rastreando estos desarrollos de cerca e integrando nuevas técnicas de consistencia a medida que maduran. El objetivo es hacer que la consistencia de personaje sea algo que configures una sola vez y luego olvides, permitiéndote enfocarte en el trabajo creativo de contar historias y construir mundos.

Preguntas Frecuentes

¿Cuál es el mejor generador de personaje ia consistentes para principiantes?

Midjourney con el parámetro cref es el punto de entrada más fácil porque no requiere configuración técnica. Carga una imagen de referencia, agrega --cref [URL] a tu prompt, y obtendrás resultados razonablemente consistentes. Para mejor calidad con más control, intenta IPAdapter en ComfyUI. Para consistencia a nivel profesional, invierte en LoRA training.

¿Puedo mantener la misma cara en imágenes IA sin ningún entrenamiento?

Sí, IPAdapter e InstantID te permiten mantener consistencia facial usando solo una imagen de referencia, sin entrenamiento requerido. La consistencia no es tan alta como un LoRA entrenado (aproximadamente 70 a 85% versus 85 a 95%), pero funciona bien para muchos casos de uso. Midjourney cref también logra esto sin entrenamiento, aunque con menos control.

¿Cuántas imágenes de referencia necesito para un LoRA de personaje?

Entre 15 y 30 imágenes funciona mejor. Menos de 10 imágenes usualmente no da al modelo suficiente información para generalizar tu personaje a nuevas poses. Más de 50 imágenes introduce demasiada variación a menos que cada imagen sea extremadamente consistente. Enfócate en calidad y variedad de ángulos en lugar de cantidad cruda.

¿Por qué mi personaje IA se ve diferente en cada imagen a pesar de usar el mismo prompt?

Los prompts de texto solos no pueden garantizar consistencia porque los modelos de difusión generan desde ruido aleatorio cada vez. El mismo prompt produce una interpretación válida pero diferente con cada generación. Necesitas un método de acondicionamiento (LoRA, IPAdapter, cref, o imágenes de referencia) que proporcione información de identidad visual más allá de lo que el texto puede expresar.

¿Qué es Midjourney cref y cómo funciona?

El parámetro cref (referencia de personaje) de Midjourney te deja pasar una imagen de referencia que el modelo usa para mantener la apariencia del personaje. Agregas --cref [URL de imagen] a tu prompt, y --cw [0-100] para controlar cuán fuertemente sigue la referencia. En cw 100, intenta hacer coincidir la cara, cabello y ropa. En valores más bajos, se enfoca principalmente en la cara.

¿Vale la pena el LoRA training para solo algunas imágenes?

Si solo necesitas 3 a 5 imágenes consistentes, el LoRA training es probablemente excesivo. Usa IPAdapter o cref en su lugar para proyectos rápidos. El LoRA training se paga por sí solo cuando necesitas 20+ imágenes del mismo personaje, planeas usar el personaje a largo plazo, o necesitas la consistencia más alta posible para trabajo profesional.

¿Puedo usar el mismo personaje en diferentes estilos de arte IA?

Este es uno de los desafíos de consistencia más difíciles. Un personaje diseñado en un estilo fotorrealista se verá diferente cuando se renderice en anime, acuarela, o arte de píxeles. El LoRA training maneja la consistencia de estilo cruzado mejor que los métodos basados en referencias porque aprende la identidad del personaje a un nivel más profundo. Sin embargo, podrías necesitar LoRAs separados para estilos dramáticamente diferentes.

¿Cómo creo una hoja de personaje IA para referencia?

Genera tu personaje desde múltiples ángulos (frente, lado, espalda, tres cuartos) y compón estas vistas en una sola imagen. Usa un prompt conteniendo "character sheet, multiple views, reference sheet, white background" junto con tu descripción de personaje. Genera cada vista por separado si el modelo lucha para producir todas las vistas en una imagen.

¿Cuál es la diferencia entre IPAdapter e InstantID?

Ambos extraen características de imágenes de referencia, pero se enfocan en aspectos diferentes. IPAdapter captura características visuales generales incluyendo estilo, composición y cara. InstantID está específicamente diseñado para preservación de identidad facial, usando embeddings de InsightFace para hacer coincidir la geometría facial precisamente. Para consistencia de personaje, InstantID típicamente produce coincidencias de cara mejores mientras que IPAdapter da mejor consistencia general de estilo.

¿Puedo mantener consistencia de personaje en videos generados con IA?

Sí, pero es más desafiante que imágenes estáticas. Los modelos de generación de video como Wan y Kling están mejorando en consistencia temporal, y puedes usar LoRAs con algunos modelos de video. El enfoque actual más confiable es generar fotogramas clave con técnicas de imagen estática consistente con personajes e interpolación entre ellos con un modelo de video.

Finalizando

Obtener un personaje IA consistente en múltiples imágenes ya no es la tarea imposible que era hace incluso un año. Las herramientas han madurado, las técnicas están bien documentadas, y hay opciones en cada nivel de habilidad y presupuesto.

Si tomas una cosa de esta guía, déjalo ser esto: haz coincidir tu método con el alcance de tu proyecto. No sobre-ingenierices una solución para un proyecto simple, y no sub-inviertas en consistencia para un proyecto que lo exige. Comienza con el enfoque más simple que cumpla con tus necesidades y agrega complejidad solo cuando los resultados lo requieran.

El panorama del generador de personaje ia consistentes continuará evolucionando, y lo que se sienta de última generación hoy probablemente se sienta rutinario en un año. Pero los fundamentos de buenas imágenes de referencia, prompting consistente, y elegir la herramienta correcta para el trabajo permanecerán relevantes sin importar qué nuevas técnicas emerjan.

Para actualizaciones continuas en herramientas y técnicas de consistencia de personaje IA, sigue revisando aquí. Y si quieres saltar la configuración técnica completamente y enfocarte en crear personajes, prueba Apatero. Está construido específicamente para este tipo de flujo de trabajo creativo.

¿Listo para Crear Tu Influencer IA?

Únete a 115 estudiantes dominando ComfyUI y marketing de influencers IA en nuestro curso completo de 51 lecciones.

Artículos Relacionados

Arte IA para Desarrolladores de Juegos: Guia Completa de Creacion de Assets

Aprende como los desarrolladores indie usan IA para concept art, sprites, fondos y UI. Flujos de trabajo practicos para integrar IA en pipelines de assets para juegos.

Cómo Crear Cubiertas de Libros Profesionales con IA para Autopublicación

Diseña cubiertas de libros impresionantes usando generadores de imágenes con IA. Guía completa para autores autopublicados cubriendo cada género desde fantasía hasta romance hasta thriller.

Creación de Personajes Consistentes para Cómics con IA: Tutorial Completo

Aprende a generar personajes consistentes en múltiples paneles y páginas usando generadores de imágenes IA. Domina técnicas de prompting para creación de cómics.