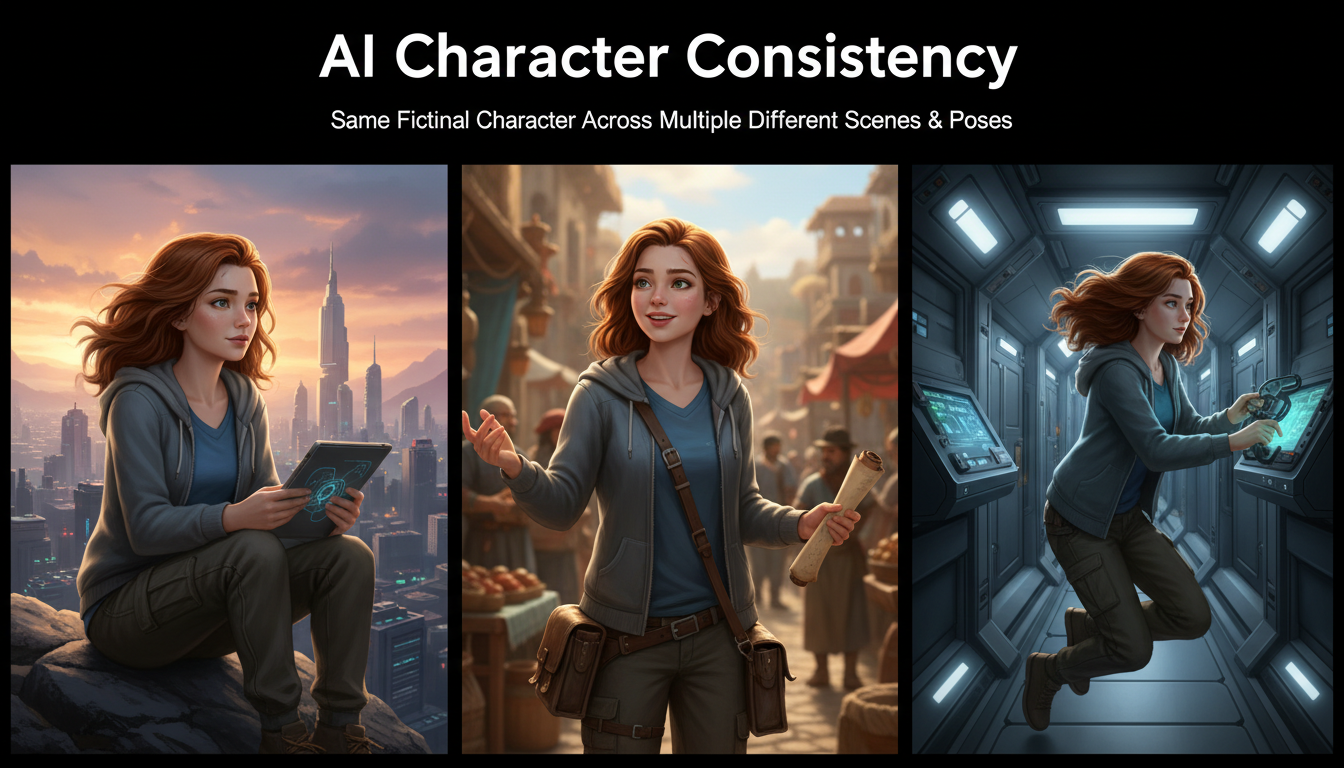

AI一貫したキャラクタージェネレーター:複数の画像で同じキャラクターを保つ方法

LoRAトレーニング、IPAdapter、Midjourneyのcrefパラメータ、参照画像技術を使用して、複数のシーンで同じAIキャラクターを生成する方法を学びます。完全な2026ガイド。

AIで生成された画像でビジュアルストーリーを語ろうとしたことがあるなら、その苦しみはすでに知っているでしょう。完璧な最初の画像のキャラクターを作成し、次のシーンに進むと、AIは多くの場合、遠い親戚のように見える誰かを与えてくれます。髪は違い、顔の形は変わり、衣装は完全に別の人のものかもしれません。これはAI美術ツールでコミック、ビジュアルノベル、ストーリーボード、またはソーシャルメディアコンテンツを構築しようとしている人にとって最も大きなイライラです。

クイックアンサー:AI一貫したキャラクタージェネレーターは、LoRA微調整、IPAdapterフェイスエンベッディング、Midjourneyのcrefパラメータ、または構造化された参照画像などの技術を使用して、複数の生成画像でキャラクター同一性を保ちます。最良の結果は、少なくとも2つの方法を組み合わせることから得られます。15〜30の参照画像でのLoRAトレーニングは、最高の一貫性をもたらします(約90%)。一方、crefやIPAdapterなどの参照ベースの方法は、セットアップが速く、忠実度がやや低い(70〜85%)ことを提供します。あなたの選択は、プロフェッショナルプロジェクトの完璧な一貫性が必要か、それとも迅速なクリエイティブ探索に「十分」が必要かによって異なります。

- LoRAトレーニングはキャラクターの一貫性が最高ですが、セットアップとトレーニング(2〜4時間)の事前投資が必要です

- IPAdapterとInstantIDはトレーニング不要で中間選択肢を提供し、参照画像が必要です

- Midjourneyのcrefパラメータは最も簡単なエントリーポイントですが、最も制御が少なくなります

- メソッドを組み合わせる(例:LoRAプラスIPAdapter)と、最も信頼できる結果が得られます

- キャラクターシートとターンアラウンド参照は、どの方法を使用していてもキャラクターの一貫性を劇的に改善します

- Apateroのようなツールは、パイプラインを構築したいクリエイターが結果を望まずに技術的な複雑さを背後で処理します

なぜキャラクターの一貫性がAI画像生成で最も難しい問題なのか

キャラクターの一貫性は、拡散モデルがどのように機能するかと根本的に対立しています。これらのモデルは、ノイズから開始し、テキストの説明に一致するものに徐々に洗練することで画像を生成します。すべての生成はさまざまなノイズパターンから開始されます。つまり、すべての出力は一意です。これは多様性に優れていますが、一貫したアイデンティティの維持には悪いです。

私は約2年前に安定拡散を使用して短いコミックを構築しようとしたとき、この問題に最初に遭遇しました。最初の生成から本当に好きだったキャラクターがありました:革のジャケットを着た赤い髪の女性で、左の眉毛の上に独特の傷がありました。非常に次のパネルでは彼女を別のポーズで必要とされ、80世代の後、彼女のようにリモートで見えた人を手に入れることができませんでした。そのプロジェクトは、テキストプロンプトだけがキャラクターの一貫性を解決できないことを私に重要なレッスンを教えました。それはどれだけ詳細にしても。

理由は単純明快です。「左の眉毛の上に傷のある赤い髪の女性」と書くとき、モデルはその説明を毎回新鮮に解釈します。潜伏空間が巨大であるため、その「赤い髪の女性」の内部表現は生成全体で異なります。同じテキストプロンプトに一致する2つの画像は、両方があなたの言葉の技術的に正しい解釈である間に非常に異なっているように見えることができます。

これがAIキャラクターの一貫性のための専用技術がそれほど重要になった理由です。AIビジュアルノベルキャラクターライブラリを構築しているか、ブランドマスコットでマーケティング資料を作成しているか、ゲームの概念アートを開発しているかに関係なく、単純なプロンプトを超えるツールが必要です。

AIキャラクター生成を一貫させるための4つの主な方法

特定のワークフローに飛び込む前に、風景を理解することが役に立ちます。一貫したAIキャラクターをシーン全体で保つための4つの主要なアプローチがあり、それぞれは努力対品質スペクトル上の異なるポイントにあります。

1. LoRA微調整(最高品質、最も努力)

LoRAトレーニングは、特定のキャラクターの見方を深いレベルでAIモデルに教えます。あなたは15〜30のキュレーションされたキャラクター画像をフィードして、モデルの動作を変更する小さなアダプターファイル(通常10〜150MB)を作成します。生成中にこのLoRAを活性化すると、モデルはあなたのキャラクターを「知り」、任意のポーズまたはシーンで彼らをレンダリングできますが、彼らのコアアイデンティティは保ちます。

私はLoRAトレーニングを真剣なキャラクタープロジェクトの必須と見なしています。得られる一貫性は、他のどの方法でも一致していません。これがどのように機能するかの基本を理解したい場合は、LoRAトレーニングの完全な初心者向けガイドを確認してください。

最適: 長期のキャラクタープロジェクト、ビジュアルノベル、コミック、ブランドマスコット、プロフェッショナルコンテンツパイプライン。

欠点: あなたのキャラクターのデータセット(新しいキャラクターの鶏と卵の問題)が必要です、トレーニング時間(1〜3時間)がかかり、体面なGPUまたはクラウドコンピューティングが必要です。

2. IPAdapterとInstantID(良好な品質、適度な努力)

IPAdapterは、参照画像から顔と文体的な特徴を抽出し、それらの特徴を生成プロセスに注入することによって機能します。あなたはあなたのキャラクターの1つ以上の参照写真を提供し、IPAdapterは拡散プロセスを条件付けして、それらの特徴に一致します。InstantIDは、顔のアイデンティティ保存に特別に最適化された同様のアプローチです。

ここでの利点はスピードです。何もトレーニングする必要はありません。参照画像を提供して生成を開始するだけです。トレードオフは、LoRAと比較して一貫性が低下し、特に衣類、身体のタイプ、アクセサリーなどの非顔の特徴については。

最適: 迅速なプロトタイピング、実在の人物に基づくキャラクター(同意付き)、顔の一貫性が最も重要なプロジェクト。

欠点: 極端なポーズ変更に苦しむ、衣類とアクセサリーの詳細を失う可能性があります、時々「不気味な谷」効果を生成し、顔は一貫していますが他はすべてシフトします。

3. Midjourney cref(最も簡単、最も制御が少ない)

Midjourneyのキャラクター参照パラメータ(cref)は、初心者にとって最もアクセス可能なオプションです。--crefフラグで参照画像URLを渡すだけで、Midjourneyは新しい生成でそのキャラクターの外観を保つことを試みます。--cw(キャラクター重み)パラメータでは、参照に従うことがどれほど強くそれが従うかを制御できます。

ホットテイク:Midjourneyのcrefは真摯な仕事にはオーバーハイプされています。 これはカジュアルな探索とソーシャルメディアコンテンツに素晴らしいですが、複雑なポーズ、異なる照明条件、またはスタイルの異なるシーンの中でキャラクターが必要な場合、一貫性は大幅に壊れます。私はそれを広範にテストし、シンプルなポートレートからポートレートへの転送で約70%の時間に機能することを発見しましたが、シーンを劇的に変更すると約40%の信頼性に低下します。プロフェッショナルなビジュアルストーリーテリングでは、あなたはすぐに壁にぶつかります。

最適: ソーシャルメディアコンテンツ、カジュアルなキャラクター探索、迅速なコンセプトアート、新しいツールを学びたくないMidjourneyユーザー。

欠点: Midjourneyのエコシステムにロックされている、キャラクターのどの側面が保存されるかについての制限された制御、微調整可能性なし。

4. 構造化参照画像およびキャラクターシート(補足)

AIキャラクターのターンアラウンドシートは、複数の角度から複数の角度からあなたのキャラクターを示す単一の画像です:正面、側面、背面、3クォーター。これらのシートは、上記の方法のいずれかで一貫性を改善するために使用できる包括的な参照として機能します。それらはスタンドアロンソリューションではなく、むしろ力乗数です。

良いキャラクターシートを作成するには、複数の角度から中立的なポーズで特性を生成してから、これらのビューを単一の参照画像に合成することが含まれます。これはあなたが使用している一貫性の方法により多くの情報を与えます。

ステップバイステップ:最大一貫性のためのキャラクターLoRAを構築

これは、信頼できる繰り返し可能なキャラクター一貫性が必要な誰にとっても金の基準ワークフローです。データセット作成から展開まで、プロセス全体をお勧めします。

ステップ1:キャラクターの初期デザインを作成します

キャラクターがまだ存在しない場合は、まず生成する必要があります。これはブートストラップのチャレンジです。推奨される方法は次のとおりです。

キャラクターの詳細なプロンプト(50〜100)を使用して、大量の画像を生成することで開始します。Flux、SDXL、またはこれらの2026年に利用可能な最高のAI画像生成ツールなどの高品質ベースモデルを使用してください。バッチを確認し、ビジョンを最もよく表す単一の画像を選択します。

その選択された画像から、img2imgまたはIPAdapterを使用して、異なるポーズと表現で変動を生成します。目標は、15〜30の画像のデータセットを構築することです。このデータセットではキャラクターは認識可能に同じ人ですが、LoRAがキャラクターのアイデンティティではなく、単一のポーズを記憶するのではなく、キャラクターのアイデンティティを学ぶのに十分な多様性が示されています。

ステップ2:キュレーションとデータセットの準備

LoRAトレーニングデータセットの品質は、数量よりもはるかに重要です。私は200のキャラクター画像でLoRAをトレーニングしようとしたことがありますが、20の慎重にキュレーションされたセットよりも悪い結果を得ました。大きなデータセットには多くの矛盾があり、モデルは「真の」キャラクターではなく、すべてのバリエーションの平均を学びました。

データセットに含める内容は次のとおりです:

- 異なる表情(中立、笑顔、真剣、驚いた)を持つ5〜8のクローズアップポートレート

- 異なる角度から上半身を示す5〜8のミディアムショット

- さまざまなポーズを持つ3〜5フルボディショット

- 異なる衣装の2〜3画像(衣装の柔軟性を望む場合)

- すべての画像は清潔な背景が必要です(無地の色が最適です)

- 解像度は512x512以上である必要があり、理想的には1024x1024

各画像にキャラクター用の一貫したトリガーワード(「chrNAME」または「sks_character」のような一意の何か)でタグを付け、ポーズ、表情、衣類の正確な説明を取得します。

ステップ3:トレーニングを構成して実行します

トレーニング構成のために、これらの設定はFluxまたはSDXLモデル上の文字LoRAsの開始点として機能します:

- 学習率: Fluxの場合は1e-4、SDXLの場合は5e-5

- トレーニングステップ: 1,500〜3,000(より多いことは必ずしも良くない)

- ネットワークランク: 32〜64(より高い詳細をキャプチャしますが、過度な適応のリスク)

- ネットワークアルファ: ランク値の半分(16〜32)

- 解像度: 1024x1024

- バッチサイズ: 1〜2(VRAMによって制限)

- オプティマイザー: AdamWまたはProdigy(Prodigyは自動的に学習率を調整します)

私は常に中点でテスト生成を実行します。ステップ1,500でキャラクターが既に認識可能である場合、おそらく3,000にトレーニングする必要はありません。オーバートレーニングはLoRAを硬くします。つまり、トレーニング画像を再現しすぎて新しいポーズに苦しむことになります。このプロセスを深く掘り下げるには、AIバーチャルモデルの作成ガイドをチェックしてください。

ステップ4:テストと反復

トレーニング後、トレーニングデータとは大きく異なるプロンプトでLoRAをテストします。トレーニングセットに含まれていなかったシーンとポーズでキャラクターを生成します。これはLoRAが一般化されたかメモリされたかを示しています。

一般的な問題と修正:

- 顔は正しいですが、体は間違っています: データセットにより多くのフルボディ画像を追加して、再トレーニングしてください

- キャラクターは1つのポーズでのみ機能します: トレーニングデータはバリエーションが不足していたため、より多様なポーズを追加します

- 出力は「燃えた」または過飽和に見えます: あなたは過度にトレーニングしました、ステップを減らすか学習率を下げます

- LoRAには目に見える効果がありません: トリガーワードをチェックしてLoRA重みを増やすか、LoRAがベースモデルと互換性があることを確認してください

ステップバイステップ:迅速なキャラクター一貫性のためのIPAdapterを使用

時間と結果が速く必要な場合、LoRAトレーニング時間を投資したくない場合、IPAdapterは最高の友達です。このワークフローは、30分以内にゼロから一貫したキャラクターを取得します。

ComfyUIでIPAdapterを設定

IPAdapterにはComfyUIで特定のセットアップが必要で、IPAdapter Plusカスタムノードがインストールされています。キャラクター一貫性の仕事のために顔モデルが特別に必要になります。

無料のComfyUIワークフロー

この記事のテクニックに関する無料のオープンソースComfyUIワークフローを見つけてください。 オープンソースは強力です。

- GitHubからComfyUI-IPAdapter-Plusカスタムノードをインストールします

- IPAdapterフェイスモデル(SD1.5の場合はip-adapter-faceid-plusv2_sd15.bin、またはSDXLバリアント)をダウンロードします

- 必要なInsightFace分析モデルをダウンロードします

- ComfyUIインストール内の正しいディレクトリにモデルを配置します

ワークフロー

インストールされたら、ワークフローは簡単です。あなたはあなたのキャラクターの参照画像を提供し、IPAdapterは特定の注意層の拡散プロセスに注入される顔の特徴を抽出します。

調整するキーパラメータ:

- 重み: 0.7で開始してから調整します。より高い値(0.85以上)はより閉じた顔のマッチを生成しますが、画像品質を減らすことができます。より低い値(0.5〜0.6)はより多くの創造的自由を与えますが、緩い一貫性。

- 開始/終了パーセンテージ: 拡散プロセスのいつIPAdapter影響が始まり、終了するかを制御します。0%で開始し、80%で終了することは通常、最良の結果をもたらします。

- フェイスIDモード: 一般的なIPAdapterモードではなく、スタイルと作曲も転送する、顔の一貫性のためにこれを特別に使用します。

ホットテイク:ほとんどの人々は、IPAdapter重みが高すぎます。 「最大一貫性」を望むため、0.9以上に設定することは、実際には出力を低下させます。顔の成果物、奇妙な肌のテクスチャ、特徴的な「貼られた顔」の外観を得ます。0.65〜0.75の重みは、矛盾のない一貫性の90%を与えます。モデルに仕事をさせることを信頼してください。

IPAdapterをLoRAと組み合わせる

これが強力になるところです。訓練されたLoRAを使用してキャラクターの全体的なアイデンティティを処理してから(顔の形、髪、一般的な比率)、層のIPAdapterを上に置くことができます。LoRAは「誰」を提供しますが、IPAdapterは「彼らがまさに見ているもの」を強化します。

テストでは、この組み合わせは、LoRAだけの約85%からおよそ95%以上に一貫性を押しやりました。ComfyUIのワークフローは、IPAdapterコンディショニングの前にLoRAローダーをチェーンしているため、両者は同時に生成に影響を与えます。

Apateroでは、キャラクターを作成し、バリエーションを生成する場合、この種の多層一貫性パイプラインが自動的に実行されます。プラットフォームは、ComfyUIワークフローからスクラッチで構築されたモデルスタッキングとパラメータチューニングを背後で処理し、かなりの時間を節約します。

ステップバイステップ:キャラクターリファレンスのためのMidjourney crefを使用

Midjourneyユーザーがプラットフォームを離れることなくキャラクター一貫性を望む人のために、crefシステムが最も速いパスです。

基本的な使用法

構文は単純です。生成またはキャラクターの参照画像を提供してから、将来のプロンプトに含めます:

/imagine prompt: [your character description], [scene description] --cref [image URL] --cw 100

--cwパラメータはキャラクターの重みを制御します:

- 100(デフォルト): 顔、髪、衣類、一般的な外観に一致します

- 50〜75: 顔と髪に一致しますが、衣類のバリエーションを許可します

- 0〜25: 一般的なスタイルのみに一致し、緩いキャラクター参照

crefの結果を改善するためのヒント

様々なキャラクタータイプを使用してMidjourneyのcrefをテストするのに数週間を費やした後、私は一貫して結果を改善する複数のパターンを発見しました。

まず、参照画像は非常に重要です。フレームの中心に配置された清潔でよく照らされたポートレートは、複雑なシーンでキャラクターが部分的に隠れているのは10倍優れています。あなたの最高のキャラクター画像が彼らがアクションポーズにあり、忙しい背景に対して、最初に清潔なポートレートバージョンを生成する時間をかけて、crefソースとしてそれを使用してください。

次に、何が変わるべきで何が同じままであるべきかについて明確にしてください。新しい衣装でキャラクターを望むが同じ顔で、キャラクター重みを約50に下げてください。新しい衣装をプロンプトで説明してください。すべてが同じでシーンだけが異なることを望む場合は、キャラクター重みを100に保ち、新しい環境のみを説明してください。

第3に、Midjourneyはクロススタイルの一貫性よりもサメスタイルの一貫性をより良く処理します。参照がフォトリアリスティック画像であり、そのキャラクターのアニメーション版を生成しようとする場合、一貫性は大幅に低下します。最良の結果のために、参照と同じ一般的なスタイルに固執してください。

効果的なAIキャラクターシートとターンアラウンド参照の作成

キャラクターシートは、使用しているAI一貫したキャラクタージェネレーターアプローチに関係なく、秘密兵器です。それはあなたのキャラクターのビジュアル辞書として考えてください。

キャラクターシートに何が行くか

優れたAIキャラクターターンアラウンドシートには、いくつかの重要なビューが含まれています。

複雑さをスキップしたいですか? Apatero は、技術的なセットアップなしでプロフェッショナルなAI結果を即座に提供します。

正面図は中立的な立っているポーズにある必要があります。腕は体から少し離れているため、完全な衣装が見えます。これはあなたの「デフォルト」参照であり、あなたのキャラクターの最も認識可能なバージョンを捉えています。中立的な表情で、顔の特徴をはっきりと示す、クローズアップの顔ビューを含めます。

側面プロフィール(左と右)は、キャラクターのシルエット、別の角度からのヘアスタイル、および宝石、傷、または髪の装飾品などのプロファイル固有の特徴を明らかにしています。背面図は、髪の長さ、マント、バックパック、またはタトゥーのような特徴的な背部の詳細を持つキャラクターがある場合に重要です。

異なる感情(幸せ、悲しい、怒った、驚いた、決定された)を持つ同じキャラクターを示す表現シートは、ストーリーシーンで感情的な範囲が必要な場合に役に立ちます。これらはLoRAsの優れたトレーニングデータも提供します。モデルがあなたのキャラクターのアイデンティティが感情的な状態全体で永続することを教えるため。

AIでキャラクターシートを生成

新しいオリジナルキャラクターのキャラクターシートを作成する場合に使用する実用的なアプローチはここにあります。

あなたのキャラクターの確実な画像を生成することで開始します。デザインをロックダウンしたら、特定のプロンプティングを使用して、好みのメソッド(LoRA、IPAdapter、またはcref)の組み合わせを使用して、各シート表示を生成します。このようなプロンプト構造はうまく機能します:

character sheet, multiple views, front view, side view, back view,

three-quarter view, [your character description], white background,

reference sheet, concept art, clean linework

単一プロンプトアプローチが良い結果を生成しない場合(多くの場合そうではありません)、各表示を個別に生成して、画像エディターで手動で合成します。これは時間がかかりますが、各表示の優れた制御が得られます。

注意する必要があります。このプロセスは2026年と比較して1年前でさえ劇的に簡単になっています。FluxおよびLatest SDXL微調整などのモデルは、古いモデルよりもマルチビュー生成をはるかに確実に処理します。2024年にこのアプローチを試して諦めた場合、再び訪問する価値があります。

すべてのアプローチを比較:どのメソッドを選択するべきか

すべての4つの方法で広範なテストに基づいて、どのメソッドが機能し、何がしていないかについて直接的にしましょう。

| メソッド | 一貫性スコア | セットアップ時間 | 画像ごとの速度 | 最適な用途 |

|---|---|---|---|---|

| LoRAトレーニング | 85-95% | 2-4時間 | 高速(トレーニング後) | 長期プロジェクト、プロフェッショナル仕事 |

| IPAdapter/InstantID | 70-85% | 30分 | 中程度 | 迅速なプロトタイピング、実際の顔参照 |

| Midjourney cref | 60-80% | 5分 | 高速 | カジュアル使用、ソーシャルメディアコンテンツ |

| キャラクターシートのみ | 40-60% | 1時間 | 異なります | 補助的な参照資料 |

ホットテイク:「最高」の方法はあなたのプロジェクト範囲に完全に依存し、ほとんどの人々が間違った選択をします。 初心者はそれが簡単であるためcrefに引き寄せられてから、10画像の後に一貫性が壊れるときにイライラしています。経験豊富なユーザーは時々5つの一貫した画像しか必要としないプロジェクトのためにLoRAパイプラインをオーバーエンジニアします。あなたの実際のニーズに合わせて方法を一致させます。50ページのコミックを作成している場合は、LoRAトレーニングに投資してください。3画像のソーシャルポストを作成している場合は、crefまたはIPAdapterがあなたに対応します。

AIアニメキャラクターを含むプロジェクトの場合、アニメのスタイルにはより多くの誇張された特定の機能があるため、一貫性要件はさらに高くなります。目のサイズ、髪のスタイル、または色の飽和度の小さな変動は、アニメでは写真のようなスタイルよりも顕著です。

AIキャラクター一貫性を維持するための高度なヒント

コア方法を超えて、いくつかの高度な技術は一貫性をさらに高めることができます。これらは、数百時間のキャラクター生成作業から学んだトリックです。

シードロックを戦略的に使用

ランダムシードを修正しても、キャラクター一貫性を保証しません(それは魔法のボタンではありません)が、他の方法と一緒に使用すると役立つことができます。同じプロンプトを持つ固定シードは同じ画像を生成しますが、プロンプトをほんのわずか変更すると異なる結果が生成されます。トリックは、キャラクターの説明を同一に保ちながら、シーン関連の部分のみを変更し、ノイズパターン変動を最小化するためにシードをロックすることです。

プロンプトテンプレートを構築します

キャラクター用の標準化されたプロンプト構造を作成して、すべての生成のテンプレートとして使用します。次のようなもの:

[SCENE DESCRIPTION], [CHARACTER TRIGGER WORD], [fixed character description block],

[pose/action], [camera angle], [lighting]

キャラクターの説明ブロックはすべてのプロンプト全体で同じである必要があります。毎回コピー貼り付けします。矛盾したプロンプティングはキャラクタードリフトの最大の源の1つであり、私は自分自身がこの間違いを認めたいよりも多くの時間を捕まえました。

コンテンツ制作で月$1,250以上稼ぐ

独占クリエイターアフィリエイトプログラムに参加。バイラル動画のパフォーマンスに応じて報酬。自分のスタイルで完全な創造的自由を持ってコンテンツを作成。

1つずつではなくバッチで生成します

ストーリーやプロジェクトの複数のシーンを作成するときは、各シーンのバッチを生成し、各画像を完璧にするのではなく最高の結果を選びます。これはあなたに品質をより多くのコントロールを与え、あなたが確立された参照でキャラクターが最も一貫しているように見える出力を選ぶことができます。

顔固定後処理を活用します

時々、キャラクターの顔がわずかにオフになっているほぼ完全な画像を取得します。CodeFormerやGFPGANなどのツールは、キャラクターのアイデンティティを変更せずに顔の詳細を整理できます。ComfyUIでは、これらのワークフローに後処理ステップとして統合して、すべての出力が自動顔の改善を得ることができます。

一貫した照明とカメラアングルを使用します

これは過小評価されています。シーンが照明を劇的に変更する場合(例えば、昼光から灯火へ)、キャラクターは完璧な一貫性の手法があっても自然に異なって見えます。セットアップをテストする場合、最初に照明を一定に保つことで、キャラクター方法が機能していることを検証してから、徐々に照明のバリエーションを導入します。

一般的な落とし穴とそれらを避ける方法

AIキャラクターの一貫性を使用して過去2年間、同じ間違いが繰り返し出てきたのを見ました。何に注意してください。

落とし穴1:プロンプトでキャラクターを過度に説明します。 人々が一貫性に苦しむとき、彼らの本能はプロンプトにより多くの詳細を追加することです。「青い目に金のフレック、上向きのわずかなチルトの口紅、心形の顔、高い頬骨...」この詳細レベルは実際に傷つけています。モデルは多くの特定の顔の特徴を一貫して再現することはできません。キャラクターの説明を3〜5つの重要な識別特徴に保ち、LoRAまたは参照システムが残りを処理できるようにします。

落とし穴2:互いに相容れないメソッドを混ぜます。 すべての一貫性技術は互いに喜んで遊ぶわけではありません。非常に高い重みで強力なLoRAと一緒にIPAdapterを使用すると、競合する信号を作成して、乱された出力を生成する可能性があります。メソッドを組み合わせるときは、両者の低い重みで開始し、バランスポイントを見つけるまで徐々に増加してください。

落とし穴3:アスペクト比の一貫性を無視します。 シーン間でポートレート、横向き、および正方形のアスペクト比を切り替えると、あなたが期待するかもしれません。あなたのキャラクターはおそらく特定のアスペクト比で生成および訓練され、それから逃げると、モデルがキャラクターと背景にどのようにピクセルを割り当てるかが変わります。

落とし穴4:矛盾したデータでLoRAsをトレーニングします。 トレーニング画像が既にキャラクターの外観に大きな変動を示している場合、LoRAはその変動を学びます。ゴミイン、ゴミアウト。あなたの意図した設計からキャラクターの特徴が異なる画像をチェックして削除するために、データセットを残酷にキュレーション時間を費やしてください。

落とし穴5:あなたの作業構成を保存していません。 ついに一貫した結果を生成するパイプラインを取得した場合、すべての設定を文書化します:モデル、LoRA重み、IPAdapter重み、シード、プロンプト、サンプラー、ステップ、CFGスケール、すべて。6ヶ月後にもっと画像を生成する必要があるとき、将来のあなたは現在のあなたを感謝します。

Apateroのようなサービスは、パイプラインを標準化し、キャラクター構成を自動的に保存することで、多くのこれらの落とし穴を解決します。セットアップの一貫性を実際にコンテンツを作成するよりもデバッグに時間を費やしていることに気付いた場合、マネージドソリューションを探索する価値があるかもしれません。

一貫したAIキャラクターの実世界アプリケーション

なぜ人々がAI一貫したキャラクタージェネレーターを必要とするかを理解することは、どのアプローチがあなたのユースケースに適合するかを明確にするのに役立ちます。

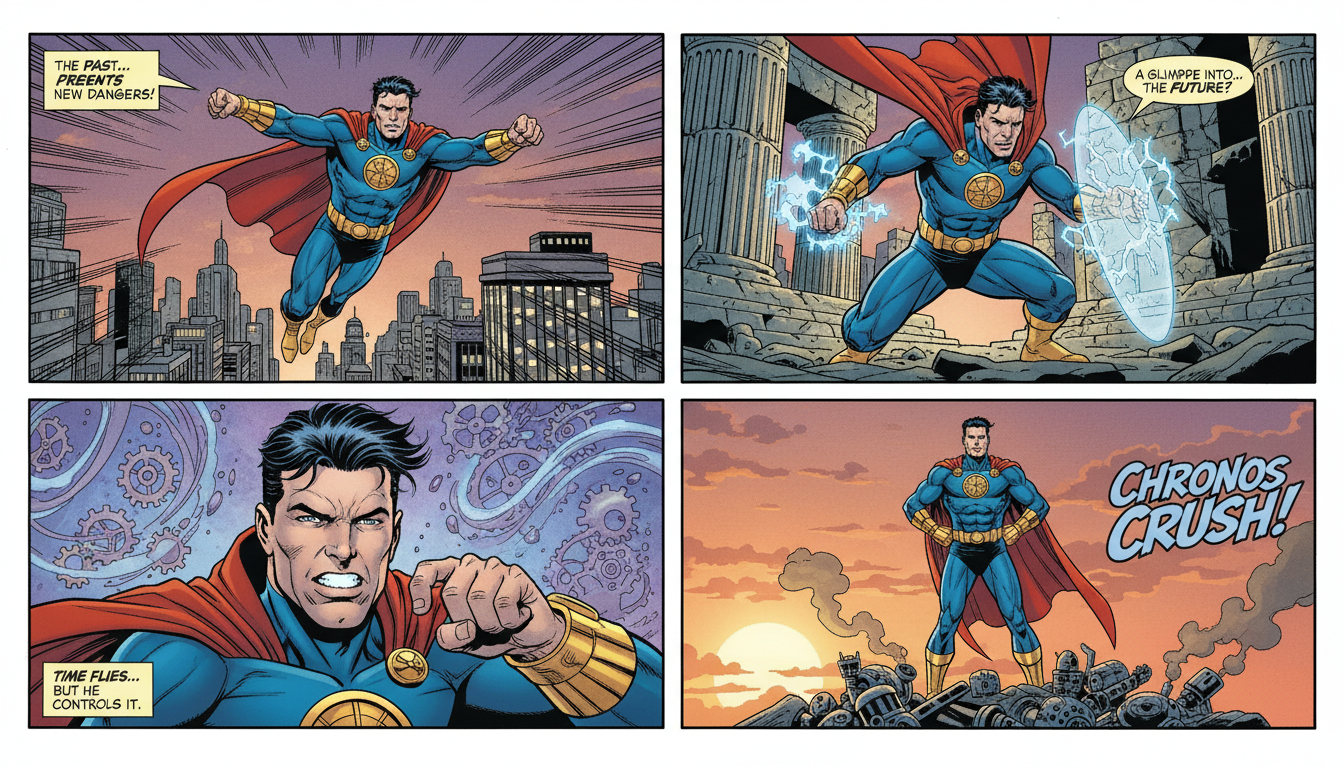

ビジュアルノベルとコミック作成

これはリーダーが読者がパネル間でキャラクターの外観が変わった場合、すぐに気付くので、最も要求の多いアプリケーションの1つです。単一のビジュアルノベルは、異なるシーン、表情、および衣装でのキャラクターの何百もの画像を必要とする場合があります。LoRAトレーニングはほぼ必須です。多くの場合、IPAdapterと組み合わせて、表現制御用です。AIの物語のキャラクター一貫性要件はこのカテゴリーで最も高いです。

ソーシャルメディアAIインフルエンサー

AIインフルエンサーはすべてのポストで同じ人のように見える必要があります。フォロワーはパーソナリティと関わり、ビジュアル一貫性はそのパーソナリティが現実のように感じることです。これはLoRAトレーニングと慎重なプロンプトテンプレートの組み合わせが輝く領域です。この特定のアプリケーションに関する包括的なガイドについては、AIモデルジェネレーターガイドをチェックしてください。

ゲームとアニメーション前制作

コンセプトアーティストはAIキャラクター一貫性ツールを使用して、複数の環境とシナリオ全体でキャラクター設計をすばやく反復します。一貫性は人間のアーティストによって精製されるため、AIの出力が参照資料として使用されるため、ここでピクセル完璧である必要はありません。IPAdapterまたはcrefもこのユースケースでは機能します。スピードが完璧さよりも重要であるため。

子供向けの本のイラスト

複数の図解全体で一貫したキャラクター(20〜30)、しばしば非常に異なるシーンと様々な感情表現。これはLoRA plus character sheet アプローチの甘い点です。LoRAを訓練し、また手動の一貫性チェックのために参照シートを維持します。

AIキャラクター一貫性の将来

この分野は速く動いています。2024年にキャラクターの一貫性技術について最初に書いたとき、LoRAトレーニングは唯一の信頼できるオプションであり、重要な技術スキルが必要でした。2026年は、異なるアクセシビリティレベルでの複数のアプローチを持っており、それらの間の品質ギャップが縮小しています。

いくつかの傾向は注視する価値があります。まず、ネイティブのキャラクター一貫性機能が外部ツール要求ではなく、生成モデル自体に組み込まれています。Midjourney crefシステムは初期の例でした。Stability AIとBlack Forest Labsからの新しいモデルはアーキテクチャに直接アイデンティティ保全を組み込んでいます。

次に、トレーニングはより速く、より安くなっています。かつてレンタル済みA100 GPUで3時間かかったもの、それは今コンシューマーハードウェアで45分を取ります。この民主化は、銀行を壊すことなくLoRAレベルの一貫性にアクセスできることをより多くのクリエイターが意味します。

第3に、これはおそらく最も興奮した開発は、マルチキャラクター一貫性が実行可能になっています。2つまたは3つの一貫したキャラクターを同じシーンで維持することは1年前にはほぼ不可能でしたが、注意操作とマルチLoRAロードの最近の進歩はそれを実用的にしています。あなたは単なる単一の主人公だけでなく、完全なキャストでストーリーを語ることができます。

Apatero.comでは、これらの開発を密接に追跡し、新しい一貫性技術が成熟すると統合しています。目標は、キャラクター一貫性をセットアップして忘れたいところを作ることです。ストーリーを語ったり、世界を構築したりというクリエイティブな仕事に焦点を当てることができます。

よくある質問

初心者向けの最高のAI一貫したキャラクタージェネレーターは何ですか?

Midjourneyとcrefパラメータは、技術的なセットアップが必要ないため、最も簡単な開始点です。参照画像をアップロードして、プロンプトに--cref [URL]を追加してください。合理的に一貫した結果が得られます。コントロールがより優れている場合は、ComfyUIでIPAdapterを試してください。プロフェッショナルグレードの一貫性については、LoRAトレーニングに投資してください。

トレーニングせずにAI画像全体で同じ顔を保つことができますか?

はい、IPAdapterとInstantIDでは、参照画像だけを使用して顔の一貫性を維持できます。一貫性は訓練されたLoRA(約70~85%対85~95%)ほど高くありませんが、多くの用途に対して機能します。Midjourneyのcrefもトレーニングなしでこれを達成しますが、制御は少なくなります。

キャラクターLoRAには何個の参照画像が必要ですか?

15〜30画像の間がうまく機能します。10未満の画像は通常、モデルにあなたのキャラクターを新しいポーズに一般化するのに十分な情報を与えません。50を超える画像は、すべての画像が非常に一貫していない限り、あまりにも多くの変動を導入しています。生品質とビューのバリエーションの角度に焦点を当てるよりも、生数量。

AIキャラクターが同じプロンプトであるにもかかわらず、すべての画像で異なって見えるのはなぜですか?

テキストプロンプト単独では、拡散モデルが毎回ランダムノイズから生成するため、一貫性を保証できません。同じプロンプトはすべての生成で有効ですが、異なる解釈を生成します。テキストで表現できる内容を超えてビジュアルアイデンティティ情報を提供する調整方法(LoRA、IPAdapter、cref、または参照画像)が必要です。

Midjourney crefとは何ですか。どのように機能しますか?

Midjourneyのcref(キャラクター参照)パラメータでは、モデルがキャラクターの外観を保つために使用する参照画像を渡すことができます。プロンプトに--cref [image URL]を追加し、--cw [0-100]を使用して、どれほど強く参照を追跡するかを制御します。CW 100で、顔、髪、衣装に一致することを試みます。より低い値では、主に顔に焦点を当てています。

いくつかの画像のためにLoRAトレーニングする価値はありますか?

3〜5の一貫した画像のみが必要な場合、LoRAトレーニングはおそらくやり過ぎです。代わりに迅速なプロジェクトのためのIPAdapterまたはcrefを使用してください。LoRAトレーニングは、20以上のキャラクター画像、長期的にキャラクターを使用する計画、またはプロの仕事のために最高の一貫性が必要な場合に支払いません。

異なるAI美術スタイル全体で同じキャラクターを使用できますか?

これはキャラクターの一貫性の最も難しい課題の1つです。写真のリアリズムスタイルで設計されたキャラクターは、アニメ、水彩画、またはピクセルアートでレンダリングされると異なって見えます。LoRAトレーニングはより深いレベルでキャラクターのアイデンティティを学ぶため、参照ベースの方法よりもクロススタイル一貫性をより良く処理します。ただし、劇的に異なるスタイルのために個別のLoRAsが必要になる場合があります。

参照用のAIキャラクターシートをどのように作成しますか?

複数の角度からキャラクターを生成し(正面、側面、背面、三分の四)、これらのビューを単一の画像に合成します。「キャラクターシート、複数のビュー、参照シート、白い背景」を含むプロンプトを使用して、キャラクターの説明とともに。モデルが単一の画像のすべてのビューを生成するのに苦しむ場合は、各ビューを個別に生成して、それらを手動で合成します。

IPAdapterとInstantIDの違いは何ですか?

両方が参照画像から特徴を抽出しますが、異なる側面に焦点を当てています。IPAdapterはスタイル、作曲、顔を含む一般的な視覚的特徴をキャプチャします。InstantIDは、特に顔のアイデンティティ保全のために設計されており、InsightFaceエンベッディングを使用して顔の幾何学を正確に一致させます。キャラクター一貫性については、InstantIDは通常、IPAdapterがより優れた全体的なスタイル一貫性を与える場合、より優れた顔のマッチをもたらします。

AI生成ビデオ全体でキャラクターの一貫性を維持できますか?

はい、ただしそれはまだ画像よりも挑戦的です。WanおよびKlingなどのビデオ生成モデルは時間的一貫性で改善されており、いくつかのビデオモデルでLoRAsを使用できます。最も信頼できる現在のアプローチは、文字一貫性のあるスティル画像技術を使用してキーフレームを生成してから、ビデオモデルでそれらの間を補間することです。

まとめ

複数の画像で一貫したAIキャラクターを取得することは、たった1年前でさえ不可能な作業ではなくなりました。ツールは成熟し、技術は十分に文書化され、すべてのスキルレベルとバジェットでオプションがあります。

このガイドから1つのことを取得する場合、これを聞いてください:あなたのメソッドをあなたのプロジェクトの範囲と一致させます。単純なプロジェクトのためにソリューションをオーバーエンジニアしないでください。プロジェクトが要求するのに十分なだけ複雑さを追加しないでください。シンプルなアプローチから開始して、結果が複雑さを要求する場合にのみ複雑さを追加します。

AIキャラクター一貫性の風景は進化し続けます。今日気に入ったものは、おそらく1年で日常的に感じます。しかし、良好な参照画像、一貫したプロンプティング、そして仕事のための正しいツールを選ぶことの基本は、新しい技術が出現するかどうかに関係なく関連性を保つでしょう。

AI文字一貫性ツールと技術の継続的な更新については、ここで戻って確認してください。キャラクターを作成することに集中したいだけで、技術的なセットアップをスキップしたい場合は、Apateroを試してみてください。それはこの種のクリエイティブワークフロー用に特別に構築されています。

AIインフルエンサーを作成する準備はできましたか?

115人の学生とともに、51レッスンの完全なコースでComfyUIとAIインフルエンサーマーケティングをマスター。

関連記事

ゲーム開発者のためのAIアート:アセット制作の完全ガイド

インディーゲーム開発者がコンセプトアート、スプライト、背景、UIにAIを活用する方法を解説。ゲームアセットパイプラインへのAI統合に関する実践的なワークフローを紹介。

自己出版のためのAIを使用してプロフェッショナルな本のカバーを作成する方法

自己出版のためにAI画像ジェネレーターを使用して見事な本のカバーを設計します。ファンタジーからロマンス、スリラー、ノンフィクションまで、すべてのジャンルをカバーするステップバイステップのチュートリアル。

AIを使用したコミックスの一貫したキャラクターの作成:完全なチュートリアル

AIイメージジェネレータを使用して、複数のパネルとページ全体で一貫したキャラクターを生成する方法を学びます。コミック作成のためのプロンプト技法をマスターしてください。