O Que Artistas de IA Contemporâneos Estão Usando para Criar Vídeos em 2025

Descubra as ferramentas e fluxos de trabalho exatos que artistas profissionais de IA usam para geração de vídeo, de ferramentas de navegador a configurações locais do ComfyUI.

Passei três horas ontem assistindo reels de vídeo de IA no Instagram e percebi algo estranho. O material elegante e polido que parece caro? Geralmente feito com ferramentas gratuitas. Os clipes travando e tremendo com marcas d'água? Muitas vezes de serviços pagos que alguém está tentando justificar a assinatura.

A paisagem de vídeo de IA virou em algum momento no final de 2024, e se você ainda acha que Runway é a única opção disponível, está perdendo cerca de 80% do que realmente está acontecendo em estúdios e quartos agora.

Resposta Rápida: Artistas de IA contemporâneos em 2025 usam principalmente uma abordagem híbrida combinando ferramentas baseadas em navegador como Runway ML e Pika para iterações rápidas, modelos de código aberto como Wan 2.2 e HunyuanVideo rodando localmente através do ComfyUI para controle criativo total, e plataformas como Apatero.com quando precisam de resultados confiáveis sem configuração técnica. A escolha da ferramenta depende de se velocidade, controle ou custo importa mais para cada projeto específico.

- Artistas profissionais de vídeo de IA usam múltiplas ferramentas dependendo dos requisitos do projeto, não apenas uma plataforma

- ComfyUI se tornou o padrão para trabalhos sérios devido ao controle completo do fluxo de trabalho

- Ferramentas de navegador como Runway permanecem populares para visualizações de clientes e conceitos rápidos

- Modelos de código aberto agora correspondem ou excedem a qualidade comercial para casos de uso específicos

- A maioria dos artistas bem-sucedidos mantém fluxos de trabalho locais e na nuvem para flexibilidade

A Verificação da Realidade de Que Ninguém Fala

Aqui está o que realmente importa quando você olha para quem está ganhando dinheiro ou obtendo reconhecimento com vídeo de IA agora. Não é sobre ter a assinatura mais sofisticada ou a GPU mais potente. É sobre combinar a ferramenta certa com o trabalho certo e saber quando mudar.

Os artistas que conseguem trabalho consistente pararam de ser leais às plataformas. Eles estão usando o que quer que resolva o problema imediato. Cliente quer uma demonstração de produto de 30 segundos até amanhã? Esse é território do Runway. Construindo uma série narrativa com personagem consistente? ComfyUI com LoRAs personalizados. Precisa de algo que simplesmente funciona sem passar um dia resolvendo problemas? Serviços como Apatero.com lidam com a complexidade nos bastidores.

Isso não é o que ninguém quer ouvir, mas o segredo não está nas ferramentas. Está em saber qual ferramenta falha em qual ponto e ter um backup pronto.

Quais São as Ferramentas Baseadas em Navegador Mais Populares Agora?

Runway ML ainda domina o trabalho voltado para clientes porque é rápido e a interface não requer explicação. Gen-3 Alpha lida com movimento melhor do que a maioria das pessoas precisa, e o fato de que você pode enviar um link por e-mail para um cliente que pode visualizar sem se inscrever em nada importa mais do que a qualidade de renderização em muitos casos.

O preço dói, no entanto. Você está vendo créditos queimando rápido se estiver iterando, e é por isso que a maioria dos artistas o usa para finalizações em vez de exploração.

Pika Labs encontrou um nicho estranho com o sistema "Pikaffects". É menos capaz para geração geral de vídeo do que Runway, mas para efeitos estilísticos específicos ou quando você quer aquela estética particular que ele produz, nada mais se compara. O recurso de sincronização labial é usado constantemente para conteúdo de cabeças falantes, embora todos reclamem que os movimentos da boca parecem ligeiramente estranhos.

Luma Dream Machine entrou tarde, mas ganhou terreno rapidamente com tempos de geração mais longos e melhor movimento de câmera. Se seu projeto envolve qualquer tipo de movimento cinematográfico ou você está tentando recriar técnicas de câmera reais, Luma frequentemente produz resultados mais convincentes do que a concorrência. O nível gratuito é generoso o suficiente para que amadores realmente fiquem com ele.

O que você notará sobre todos os três é que artistas profissionais raramente os usam isoladamente. Eles fazem parte de um pipeline que inclui processamento local, upscaling e composição em software de vídeo tradicional. A ferramenta de navegador gera o movimento central, todo o resto o polimenta em algo que você realmente entregaria.

Por Que o ComfyUI Se Tornou o Padrão para Trabalhos Sérios?

ComfyUI venceu a corrida de geração de vídeo local não porque é fácil de usar (definitivamente não é), mas porque quando algo quebra, você pode realmente ver onde e consertar. Com ferramentas de navegador de caixa preta, quando a qualidade de geração cai ou o movimento fica estranho, você está apenas re-rolando e esperando. Com ComfyUI, você pode ajustar os parâmetros exatos que causam problemas.

A abordagem de fluxo de trabalho faz muito mais sentido para vídeo do que inicialmente parece. Você não está apenas gerando um clipe. Você está controlando consistência temporal, gerenciando transições de espaço latente, aplicando orientação ControlNet por quadro e lidando com pré-processamento tudo em uma cadeia visual que você pode modificar. Tente fazer isso com um prompt de texto e um botão "gerar".

Wan 2.2 rodando através do ComfyUI se tornou algo como o ponto de partida padrão para trabalho orientado a personagens. Ele lida com consistência entre cenas melhor do que a maioria das ferramentas comerciais, especialmente se você estiver disposto a investir tempo em treinar um LoRA em seu personagem. A diferença de qualidade entre Wan adequadamente configurado e as melhores ofertas comerciais basicamente desapareceu por volta de dezembro de 2024.

HunyuanVideo preenche um papel diferente. Não é tão bom com personagens, mas para cenas ambientais, movimentos de câmera através de espaços ou qualquer coisa envolvendo mudanças complexas de iluminação, supera tudo o que testei localmente. O problema é os requisitos de VRAM. Você precisa de hardware sério ou otimização cuidadosa para executá-lo suavemente.

Stable Video Diffusion ainda é usado principalmente para trabalho img2vid onde você gerou um quadro estático perfeito e precisa que ele se mova ligeiramente. É tecnologia mais antiga neste ponto, mas às vezes a solução simples funciona melhor do que a complexa.

A curva de aprendizado para trabalho de vídeo no ComfyUI é real. Reserve uma semana de experimentação frustrada antes que as coisas comecem a fazer sentido. A maioria dos artistas que persiste diz que os primeiros três dias foi questionar todas as suas escolhas de vida, então de repente fez sentido. Claro, plataformas como Apatero.com fornecem resultados semelhantes sem essa curva de aprendizado se você preferir pular direto para a produção.

Como as Restrições Orçamentárias Mudam a Seleção de Ferramentas?

Dinheiro muda tudo. Se você tem créditos de renderização ilimitados ou uma estação de trabalho no máximo, a seleção de ferramentas se torna puramente sobre capacidade. Para todos os outros, é sobre trabalhar em torno de restrições de forma inteligente.

A abordagem completamente quebrada mas determinada parece ComfyUI em uma GPU de 12GB com fluxos de trabalho altamente otimizados, longos tempos de renderização e muita paciência. Funciona. Muitos artistas de vídeo de IA bem-sucedidos começaram exatamente aí. A limitação não é mais qualidade, é velocidade de iteração.

Configurações de orçamento médio (pense em $50-100/mês para créditos de nuvem mais alguma capacidade local) normalmente misturam ComfyUI local para o trabalho pesado com uso estratégico de ferramentas comerciais para problemas específicos. Execute animação de personagem localmente, use Runway para aquela cena complicada, componha tudo no DaVinci Resolve.

Abordagens de alto orçamento mal se preocupam com ferramentas porque o tempo importa mais do que os custos. Esses artistas mantêm instâncias RunPod com GPUs caras para ComfyUI e assinaturas de vários serviços comerciais. O que funcionar mais rápido vence.

O espaço interessante é o profissional que trabalha que precisa de saída consistente sem grande sobrecarga. É onde plataformas gerenciadas fornecem valor - você obtém a qualidade de fluxos de trabalho locais sem manter a infraestrutura. Apatero.com se encaixa aqui lidando com a complexidade enquanto mantém os custos previsíveis.

- Abordagem local primeiro: Use ComfyUI para tudo que seu hardware pode lidar, mesmo que seja mais lento

- Fluxo de trabalho híbrido: Gere localmente, faça upscale ou refine com serviços de nuvem apenas quando necessário

- Processamento em lote: Enfileire várias gerações durante a noite em vez de pagar por resultados instantâneos durante sua sessão de trabalho

- Serviços gerenciados: Considere plataformas como Apatero.com para trabalho de cliente onde confiabilidade importa mais do que custo por renderização

E Quanto aos Especialistas e Ferramentas de Nicho?

Algumas ferramentas resolvem um problema específico tão bem que os artistas as mantêm por perto apesar do uso geral limitado.

Deforum permanece a escolha para trabalho de animação psicodélica e alucinante. É mais antigo, o fluxo de trabalho é irritante, mas nada mais produz aquela estética particular de forma tão confiável. Artistas de videoclipes especialmente mantêm fluxos de trabalho Deforum prontos para o projeto certo.

Fluxos de Trabalho ComfyUI Gratuitos

Encontre fluxos de trabalho ComfyUI gratuitos e de código aberto para as técnicas deste artigo. Open source é poderoso.

Ebsynth não é tecnicamente uma ferramenta de geração de IA, mas preenche a lacuna entre quadros-chave gerados por IA e animação suave e estilisticamente consistente. Você gera alguns quadros perfeitos com Stable Diffusion ou Midjourney, então deixa Ebsynth interpolar o movimento mantendo o estilo. Funciona surpreendentemente bem para certas abordagens estéticas.

Morph Studio criou um nicho no espaço de "storyboarding de IA para produção real". É menos sobre fazer um vídeo final, mais sobre pré-visualização e desenvolvimento de conceito. Diretores que são céticos sobre IA para saída final ainda o usam para planejar cenas.

Gen-2 Image to Video do Runway merece menção separada porque a abordagem img2vid frequentemente produz melhores resultados do que texto-para-vídeo puro. Gere o quadro perfeito em Midjourney ou Flux, traga para o img2vid do Runway, obtenha resultados muito mais controlados. Essa abordagem híbrida é prática padrão agora.

Como o Hardware Realmente Limita Suas Escolhas?

Vamos ser específicos sobre o que roda onde, porque o conselho "você precisa de uma 4090" flutuando por aí é verdadeiro e enganoso.

Para ferramentas de navegador, o hardware mal importa. Eles estão rodando nos servidores de outra pessoa. Sua conexão de internet e saldo de crédito são as restrições reais.

Para trabalho local com ComfyUI, 12GB VRAM é o mínimo prático para modelos atuais. Você pode tecnicamente executar alguns fluxos de trabalho em 8GB com otimização e paciência suficientes, mas passará mais tempo lutando contra erros de memória do que gerando. 16GB fica confortável. 24GB significa que você para de pensar em VRAM inteiramente para a maioria dos projetos.

Wan 2.2 roda aceitavelmente em 12GB com otimização adequada. Espere 2-4 minutos por segundo de vídeo em uma 3060, o que parece terrível até você perceber que enfileiramento noturno resolve esse problema. Qualidade corresponde a serviços pagos.

HunyuanVideo quer 24GB se você está sendo honesto sobre uso prático. Os requisitos oficiais alegam menos, mas operação suave sem ajustes constantes precisa de mais espaço. É aqui que RunPod ou aluguel de GPU similar faz sentido - alugue uma placa potente por um dia, processe tudo em lote, saia na frente versus custos de assinatura.

O caminho do meio que muitos artistas tomam envolve uma placa local decente (3060 12GB ou melhor) para desenvolvimento e teste, depois alugando GPUs de nuvem para renderizações finais ou trabalho sensível ao tempo. Sua configuração local lida com 90% do trabalho, nuvem cobre os picos.

Serviços como Apatero.com contornam a questão do hardware inteiramente mantendo infraestrutura otimizada, o que importa quando você está focado em saída em vez de configuração técnica.

Quais Fluxos de Trabalho Realmente São Usados em Produção?

A teoria é uma coisa, a prática parece mais bagunçada e mais híbrida do que qualquer um admite.

Quer pular a complexidade? Apatero oferece resultados profissionais de IA instantaneamente sem configuração técnica.

A Abordagem Padrão de Demonstração de Produto: Gere animação base em Runway Gen-3 para movimento limpo e profissional. Exporte, faça upscale com Topaz Video AI, componha renderizações de produto sobre o fundo de IA no After Effects. Amigável ao cliente, turnaround rápido, parece caro. Leva um dia incluindo revisões.

O Método de Série de Personagem Narrativo: Treine um LoRA em imagens de referência de personagem. Gere cenas no ComfyUI usando Wan 2.2 com seu LoRA. Controle cena por cena significa consistência entre cenas. Pós-processe para gradação de cor e suavize quaisquer inconsistências remanescentes. Processo lento, resultado de alta qualidade, controle criativo total.

O Estilo de Videoclipe de Virada Rápida: Crie quadros de estilo no Midjourney. Anime-os usando img2vid do Runway. Geração rápida de múltiplas variações, edite os melhores momentos juntos ritmicamente. Vídeo inteiro feito em um fim de semana se você souber o que está fazendo. Qualidade é "boa o suficiente para mídias sociais" em vez de qualidade de cinema.

O Pipeline Híbrido de Upres: Gere em resolução mais baixa no ComfyUI para velocidade. Acerte movimento e composição certo rápido. Cenas finais aprovadas recebem upscale e refinamento através de serviços comerciais ou modelos de upscaling especializados. Separe a iteração criativa do polimento de qualidade.

A maioria dos artistas trabalhando tem três ou quatro modelos de fluxo de trabalho salvos para diferentes tipos de projeto. Você não está descobrindo do zero cada vez, você está conectando novo conteúdo em pipelines comprovados.

Existem Ferramentas Emergentes Que Vale a Pena Observar?

A paisagem muda mensalmente, mas algumas ferramentas em desenvolvimento mostram promessa real além do hype.

Genmo continua melhorando silenciosamente e recentemente adicionou recursos que desafiam a dominância do Runway em casos de uso específicos. Seu controle de câmera é notavelmente mais preciso para cenas planejadas em vez de esperar que a IA interprete seu prompt corretamente.

Haiper lançou com apoio significativo e foca em taxas de quadros mais altas e movimento mais suave. Resultados iniciais sugerem que eles estão resolvendo alguns dos problemas de consistência temporal que atormentam outras ferramentas. Vale a pena testar se seus projetos requerem movimento genuinamente suave.

Mochi 1 entrou no espaço de geração local de código aberto e lida com certos estilos estéticos melhor do que Wan ou HunyuanVideo. Movimento humano fotorrealista especialmente. É áspero nas bordas e a documentação é mínima, mas a capacidade bruta está lá.

Novos modelos de vídeo da StabilityAI continuam sendo provocados e atrasados. Quando realmente lançarem, provavelmente vão abalar o lado de código aberto significativamente. Stability tem um histórico de lançar modelos abertos genuinamente capazes, e sua pesquisa de vídeo sugere que algo sólido está chegando.

Ganhe Até $1.250+/Mês Criando Conteúdo

Junte-se ao nosso programa exclusivo de afiliados criadores. Seja pago por vídeo viral com base no desempenho. Crie conteúdo no seu estilo com total liberdade criativa.

O padrão com ferramentas emergentes é que um ou dois recursos funcionam brilhantemente enquanto todo o resto é áspero. Artistas os pegam para essas forças específicas em vez de tentar usá-los para trabalho geral. Haiper para aquela única tomada suave de dolly. Mochi para ciclos de caminhada realistas. Runway para todo o resto até algo quebrar, então mude para Pika ou ComfyUI local.

Qual Papel as Ferramentas de Vídeo Tradicionais Ainda Desempenham?

IA não existe em isolamento apesar do que o hype sugere. Todo fluxo de trabalho profissional envolve edição de vídeo tradicional substancial e pós-processamento.

DaVinci Resolve lida com a montagem, gradação de cor e polimento final para basicamente todos fazendo trabalho sério. IA gera o material bruto, Resolve o transforma em algo que você realmente mostraria a clientes. A gradação de cor especialmente importa porque ferramentas de IA tendem a produzir cor excessivamente saturada ou inconsistente que precisa de correção.

After Effects permanece essencial para composição de elementos de IA com ativos tradicionais, adicionando motion graphics adequados, texto e efeitos que IA não pode gerar de forma confiável. A maioria das demonstrações de produtos são 60% fundo de IA, 40% design de movimento tradicional em camadas por cima.

Topaz Video AI é usado constantemente para upscaling e aprimoramento de filmagem gerada por IA. Modelos de IA geram em resoluções mais baixas para economizar tempo, Topaz leva até a especificação de entrega. O recurso de redução de ruído também ajuda a suavizar alguma da cintilação temporal que vídeo de IA às vezes produz.

Ferramentas de interpolação de quadros como RIFE ou DAIN ajudam a suavizar o movimento entre quadros gerados por IA. Vídeo de IA frequentemente tem gagueiras sutis ou inconsistências de movimento. Interpolação inteligente corrige muito disso sem exigir regeneração.

Os artistas fazendo o melhor trabalho de vídeo de IA não são puristas de IA. Eles estão usando IA como uma ferramenta em um pipeline de produção completo que inclui técnicas tradicionais onde quer que essas funcionem melhor. O vídeo final pode ser 80% gerado por IA, mas aqueles últimos 20% de polimento tradicional é o que separa resultados amadores de profissionais.

Quanto a Consistência de Estilo Realmente Importa?

É aqui que a filosofia pessoal entra mais do que capacidade técnica. Alguns artistas abraçam a natureza caótica e inconsistente do vídeo de IA como parte da estética. Outros lutam com unhas e dentes por consistência de nível Hollywood.

Para trabalho comercial, clientes quase sempre querem consistência. Personagem precisa parecer o mesmo cena por cena. Iluminação deve fazer sentido lógico. Movimento deve ser suave e intencional. Isso o empurra em direção às ferramentas e fluxos de trabalho que priorizam controle sobre novidade. ComfyUI com LoRAs, prompting cuidadoso, pós-processamento significativo.

Para trabalho artístico ou experimental, inconsistência pode trabalhar a seu favor. A qualidade surreal e onírica do vídeo de IA que não faz totalmente sentido físico cria climas que seriam difíceis de alcançar deliberadamente. Alguma da arte de vídeo de IA mais interessante se inclina para a estranheza em vez de lutar contra ela.

O meio termo é saber quando cada abordagem serve o projeto. Videoclipe para um artista eletrônico experimental? Deixe ser estranho. Vídeo explicativo para um produto SaaS? Bloqueie essa consistência firmemente.

Treinar LoRAs personalizados melhora dramaticamente a consistência para personagens ou estilos visuais específicos. Leva tempo inicial mas compensa em múltiplos projetos. A maioria do trabalho sério orientado a personagens agora envolve treinamento de LoRA como um passo padrão, seja você usando ComfyUI localmente ou trabalhando através de plataformas gerenciadas que suportam modelos personalizados.

Perguntas Frequentes

Qual é o requisito mínimo real de hardware para começar com geração de vídeo de IA hoje?

Se você está disposto a usar ferramentas de navegador exclusivamente, qualquer computador com uma conexão de internet confiável funciona bem. Para geração local com ComfyUI, o mínimo prático é uma GPU Nvidia com 12GB VRAM. Qualquer coisa menos tecnicamente funcionará, mas você passará mais tempo otimizando do que criando. O modelo 3060 12GB representa o ponto de entrada mais acessível para trabalho local que não frustra constantemente você.

Quanto tempo realmente leva para gerar um vídeo acabado de 30 segundos?

Depende inteiramente do seu fluxo de trabalho e ferramentas. Com Runway ou Pika, a geração bruta leva 1-3 minutos, mas você provavelmente iterará 5-10 vezes para obter resultados aceitáveis. Tempo total incluindo edição menor pode ser 1-2 horas. Com ComfyUI localmente em hardware moderado, geração bruta poderia levar 30-60 minutos, mas você normalmente acerta em menos tentativas devido ao melhor controle. Adicione pós-processamento e você está em 3-4 horas no total. O trade-off velocidade-qualidade é real e depende se você otimiza para iteração rápida ou controle preciso.

Você pode realmente ganhar dinheiro com geração de vídeo de IA em 2025?

Sim, mas o mercado está ficando competitivo rápido. O dinheiro agora está em resolver problemas de negócios específicos em vez de "serviços de vídeo de IA" gerais. Visualização de produtos, walkthroughs de imóveis, concept art para empresas de produção, conteúdo de mídia social para marcas que postam diariamente. Trabalho narrativo artístico é mais difícil de monetizar a menos que você tenha construído uma audiência. A maioria dos artistas de vídeo de IA bem-sucedidos trabalham diretamente com negócios que precisam de conteúdo ou constroem marcas pessoais que direcionam receita de cursos/consultoria.

Você precisa de várias assinaturas de ferramentas ou pode ter sucesso com apenas uma?

Depende do seu volume e variedade de trabalho. Se você está fazendo o mesmo tipo de projeto repetidamente, um fluxo de trabalho bem otimizado frequentemente é suficiente. Para trabalho diverso de cliente, a maioria dos profissionais mantém pelo menos uma assinatura de nível médio do Runway mais capacidade local do ComfyUI, às vezes adicionando Pika ou Luma para casos de uso específicos. A fadiga de assinatura é real - muitos artistas estão se movendo em direção a abordagens local-primeiro ou plataformas gerenciadas como Apatero.com que consolidam capacidade para reduzir custos mensais.

Qual é a melhor maneira de aprender geração de vídeo de IA sem desperdiçar meses em tutoriais desatualizados?

Encontre criadores que postam trabalho que você realmente gosta, depois pergunte a eles diretamente o que eles usam. A maioria dos artistas de IA são surpreendentemente abertos sobre seus fluxos de trabalho porque as ferramentas mudam tão rápido que compartilhar não cria desvantagem competitiva. Tutoriais do YouTube mais antigos que três meses provavelmente estão desatualizados. Comunidades do Discord para ferramentas específicas fornecem informação atual mas requerem filtrar através de muito ruído. O caminho de aprendizado mais rápido é escolher uma ferramenta, comprometer-se com ela por duas semanas de prática diária, depois expandir uma vez que você dominou o básico.

Como você lida com expectativas do cliente quando geração de vídeo de IA ainda é um tanto imprevisível?

Defina expectativas extremamente claramente antecipadamente com exemplos do que é possível versus o que ainda não é confiável. Mostre a eles três vídeos de IA diferentes e explique o esforço necessário para cada nível de qualidade. Construa tempo de revisão em orçamentos porque você precisará dele. Muitos artistas de vídeo de IA bem-sucedidos fazem uma fase de conceito paga primeiro onde eles testam se a visão do cliente é alcançável antes de comprometer-se com a produção completa. Prometer menos e entregar mais funciona melhor do que exagerar a capacidade e decepcioná-los.

Você deve investir em hardware de GPU caro ou alugar computação em nuvem para trabalho de vídeo de IA?

Para iniciantes ou uso ocasional, aluguel faz mais sentido financeiramente. Preços de GPU vão cair e modelos vão ficar mais eficientes. Comprar hardware caro agora te prende à depreciação. Para profissionais fazendo trabalho diário, possuir uma boa placa local se paga em 3-6 meses versus custos de aluguel e te dá independência de mudanças de plataforma ou aumentos de preços. A abordagem híbrida de hardware local modesto mais aluguel ocasional de nuvem para projetos exigentes funciona bem para muitos.

Quanto tempo até que geração de vídeo de IA se torne acessível o suficiente para pessoas não técnicas?

Já está acontecendo mas fragmentado através de diferentes ferramentas. Runway e Pika são razoavelmente acessíveis agora se você não precisa de controle fino. A curva de aprendizado aparece quando você quer consistência, estilos específicos ou qualquer coisa além de geração básica. Plataformas simplificando o fluxo de trabalho sem sacrificar capacidade são a solução real - serviços como Apatero.com apontam para onde as coisas estão indo, onde a tecnologia funciona de forma confiável sem exigir que você se torne um especialista técnico primeiro.

O Que Isso Realmente Significa para Você

As ferramentas vão mudar. O que funciona hoje será superado em seis meses. As habilidades que importam são reconhecimento de padrões para que tipo de ferramenta resolve qual problema, e a flexibilidade para trocar seu stack quando algo melhor emerge.

Se você está começando agora, comece com uma ferramenta de navegador para entender o que é possível, depois mude para ComfyUI quando atingir as limitações. Ou pule a curva de aprendizado inteiramente com plataformas gerenciadas e foque no trabalho criativo em vez de configuração técnica.

Os artistas tendo sucesso com vídeo de IA não são os que têm as melhores ferramentas ou o hardware mais rápido. Eles são os que combinaram sua capacidade com necessidades reais de mercado e podem consistentemente entregar resultados pelos quais clientes vão pagar. Todo o resto são apenas detalhes.

O que quer que você escolha, passe mais tempo fazendo coisas do que pesquisando ferramentas. A lacuna entre alguém que fez 100 vídeos imperfeitos e alguém que planejou seu fluxo de trabalho perfeito mas não fez nada é a diferença entre conseguir trabalho e ficar preso. Comece bagunçado, melhore conforme avança.

Pronto para Criar Seu Influenciador IA?

Junte-se a 115 alunos dominando ComfyUI e marketing de influenciadores IA em nosso curso completo de 51 lições.

Artigos Relacionados

Todos Nós Nos Tornaremos Nossos Próprios Estilistas de Moda à Medida que a IA Melhorar?

Análise de como a IA está transformando o design e a personalização de moda. Explore capacidades técnicas, implicações de mercado, tendências de democratização e o futuro onde todos criam suas próprias roupas com assistência de IA.

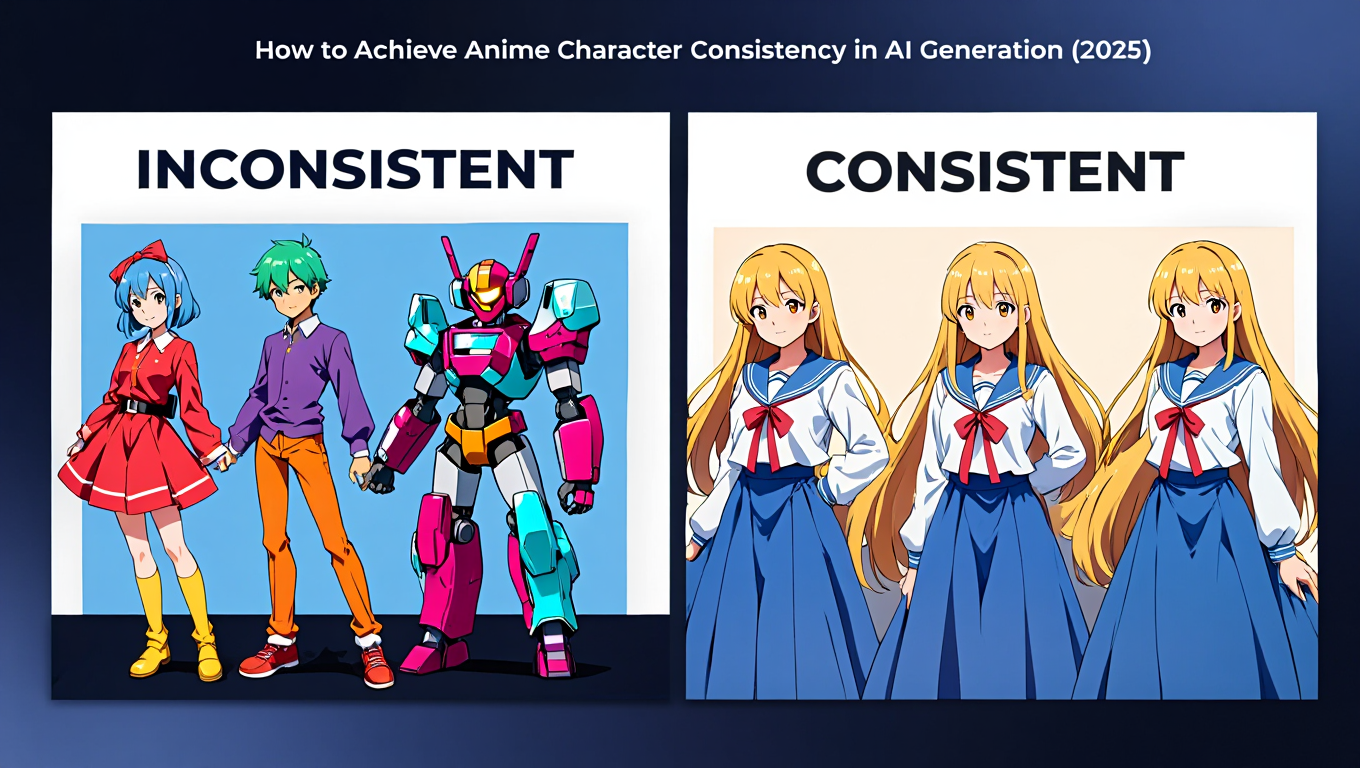

Como Alcançar Consistência de Personagens Anime em Geração de IA (2025)

Pare de obter personagens diferentes em cada geração. Domine treinamento LoRA, técnicas de referência e estratégias de workflow para personagens anime consistentes.

Melhores Ferramentas de IA para Criar Arte de Vídeo Cinematográfico Artístico em 2025

Comparação completa das principais ferramentas de geração de vídeo com IA para trabalho cinematográfico e artístico. WAN 2.2, Runway ML, Kling AI e Pika analisados em qualidade, workflow e controle criativo.