Generación de Videos Largos con RIFLEx - Guía Completa

Genera videos de IA más largos usando interpolación de posición RIFLEx que extiende los modelos de video más allá de sus límites de longitud de entrenamiento

Los modelos de generación de video tienen límites de longitud de su entrenamiento. La mayoría llegan a 4-5 segundos antes de que la calidad se degrade. RIFLEx usa interpolación de posición para extender estos límites, generando videos coherentes de 20+ segundos.

Respuesta Rápida: RIFLEx extiende la longitud de generación de video interpolando embeddings posicionales para soportar conteos de frames más allá del entrenamiento. En lugar de estar limitado a la longitud entrenada, RIFLEx reescala la información de posición para manejar secuencias extendidas. Habilítalo en flujos de trabajo de generación de video compatibles, establece tu conteo de frames más largo deseado y genera. La calidad se degrada gradualmente en lugar de repentinamente, permitiendo videos utilizables significativamente más largos que los límites nativos del modelo.

- Extiende video más allá de la longitud de entrenamiento del modelo

- Usa técnica de interpolación de posición

- La calidad se degrada gradualmente con la longitud

- Funciona con modelos de video basados en DiT

- Permite videos de 10-20+ segundos desde modelos de 4-5 segundos

La interpolación de posición es una técnica probada de la extensión de LLMs que aplica bien a la generación de video. Desbloquea un aumento significativo de capacidad.

¿Cómo Funciona RIFLEx?

Mecanismo técnico.

Embeddings de Posición

Los modelos de video usan embeddings de posición para rastrear la secuencia de frames.

El entrenamiento ocurre en longitudes específicas.

Las posiciones fuera del entrenamiento son indefinidas.

Enfoque de Interpolación

RIFLEx interpola posiciones para mapear secuencias más largas al rango aprendido.

El frame 100 se mapea a posición aprendida a través de escalado.

El modelo se comporta como si estuviera dentro del rango de entrenamiento.

Por Qué Funciona

Las relaciones de posición son relativas.

La interpolación preserva posiciones relativas.

La comprensión del modelo se transfiere.

Degradación Gradual

Videos más largos se degradan gradualmente.

No es fallo repentino en el límite de entrenamiento.

La calidad utilizable se extiende significativamente.

¿Qué Resultados Puedes Esperar?

Resultados prácticos.

Extensión de Longitud

2-4x longitud de entrenamiento típicamente alcanzable.

Modelo entrenado en 4 segundos puede producir 8-16 segundos.

Algunos logran más con compromiso de calidad.

Compromiso de Calidad

Más largo significa menor calidad.

La consistencia temporal se degrada.

El movimiento puede volverse menos coherente.

Mejores Resultados

Extensión moderada con buena calidad.

Extensión dramática con degradación notable.

Flujos de ComfyUI Gratuitos

Encuentra flujos de ComfyUI gratuitos y de código abierto para las técnicas de este artículo. El código abierto es poderoso.

Balance basado en necesidades.

Dependiente del Contenido

Algunos contenidos se extienden mejor.

Escenas estáticas se extienden bien.

Movimiento complejo se degrada más rápido.

¿Cómo Usar RIFLEx?

Implementación.

Modelos Soportados

Modelos de video basados en DiT.

Wan, Hunyuan Video, arquitecturas similares.

Verificar compatibilidad de arquitectura del modelo.

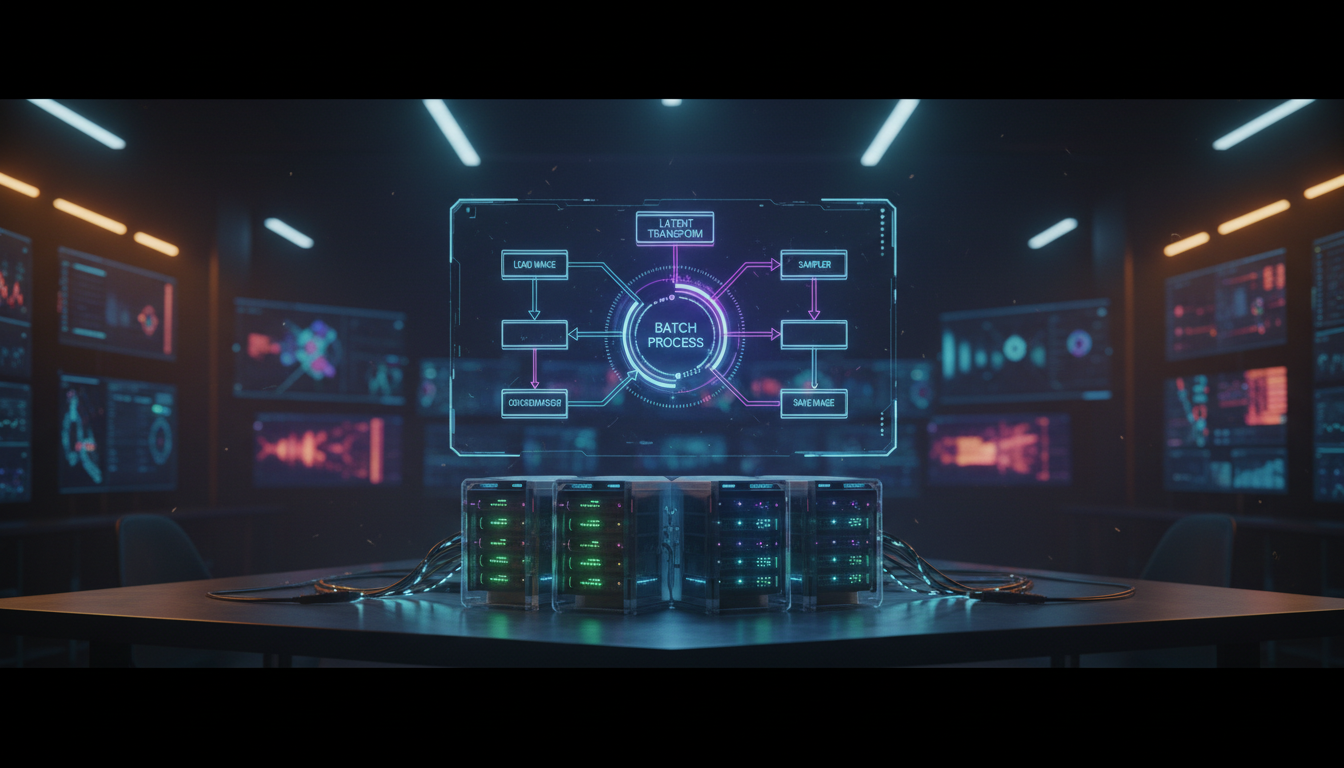

Integración con ComfyUI

Nodos RIFLEx disponibles.

Habilitar en flujo de trabajo de generación de video.

Configurar longitud objetivo.

Configuración

Establecer conteo de frames deseado.

¿Quieres evitar la complejidad? Apatero te ofrece resultados profesionales de IA al instante sin configuración técnica.

Establecer parámetros de interpolación.

Algunos requieren factor de escala de posición.

Generación

Generar normalmente.

El proceso toma más tiempo para más frames.

El uso de VRAM aumenta.

Optimización

Puede necesitar más VRAM para videos más largos.

Ajustar otras configuraciones para compensar.

Balance entre longitud y límites de hardware.

¿Cuáles Son las Mejores Prácticas?

Obtener buenos resultados.

Empezar Conservador

No intentar inmediatamente longitud máxima.

Probar 2x longitud de entrenamiento primero.

Gana Hasta $1,250+/Mes Creando Contenido

Únete a nuestro programa exclusivo de creadores afiliados. Cobra por video viral según rendimiento. Crea contenido a tu estilo con total libertad creativa.

Evaluar calidad antes de ir más largo.

Emparejar Contenido con Longitud

Elegir contenido adecuado para extensión.

Movimiento más simple para videos más largos.

Acción compleja para más cortos.

Promptear para Consistencia

Enfatizar consistencia temporal en prompts.

Describir movimiento sostenido.

Evitar cambios abruptos.

Puntos de Control de Calidad

Evaluar en diferentes longitudes.

Encontrar tu umbral de calidad aceptable.

Varía según caso de uso.

Para usuarios que quieren generación de video largo sin optimización manual, Apatero.com proporciona flujos de trabajo de video de longitud extendida.

Preguntas Frecuentes

¿Cuánto más largo puedo generar?

Típicamente 2-4x longitud de entrenamiento con calidad utilizable. Depende del modelo y contenido.

¿RIFLEx funciona con todos los modelos de video?

Principalmente modelos basados en DiT. Verificar compatibilidad.

¿La calidad es tan buena como la longitud nativa?

No, la calidad se degrada con la extensión. Compromiso por longitud.

¿Cuánta más VRAM se necesita?

Escala con conteo de frames. Más frames necesitan más memoria.

¿Puedo usar RIFLEx con otras optimizaciones?

Generalmente sí. TeaCache y otros siguen aplicando.

¿Por qué se degrada la calidad?

La interpolación es aproximación. El modelo no fue entrenado para posiciones extendidas.

¿Hay una longitud útil máxima?

Límites prácticos alrededor de 4x longitud de entrenamiento. Más allá se vuelve demasiado degradado.

¿Ayuda también con generación de imágenes?

La interpolación RoPE ayuda a LLMs y algunos modelos de imagen. Aplicación diferente.

¿Los modelos futuros necesitarán RIFLEx?

Los modelos pueden entrenar en secuencias más largas. RIFLEx extiende más allá de cualquier entrenamiento.

¿Cómo sé si mis resultados son aceptables?

Ver el video. Artefactos visibles significan demasiado largo. Reducir longitud o aceptar degradación.

Conclusión

RIFLEx extiende la generación de video más allá de límites de entrenamiento a través de interpolación de posición. Videos utilizables 2-4x más largos que límites nativos se vuelven posibles.

La calidad se degrada gradualmente con la longitud. Encontrar balance entre duración y calidad para tu caso de uso.

Funciona con modelos de video basados en DiT a través de integración ComfyUI. Configurar longitud objetivo y generar.

RIFLEx transforma las capacidades de generación de video significativamente, haciendo práctico el video de IA de formato más largo.

¿Listo para Crear Tu Influencer IA?

Únete a 115 estudiantes dominando ComfyUI y marketing de influencers IA en nuestro curso completo de 51 lecciones.

Artículos Relacionados

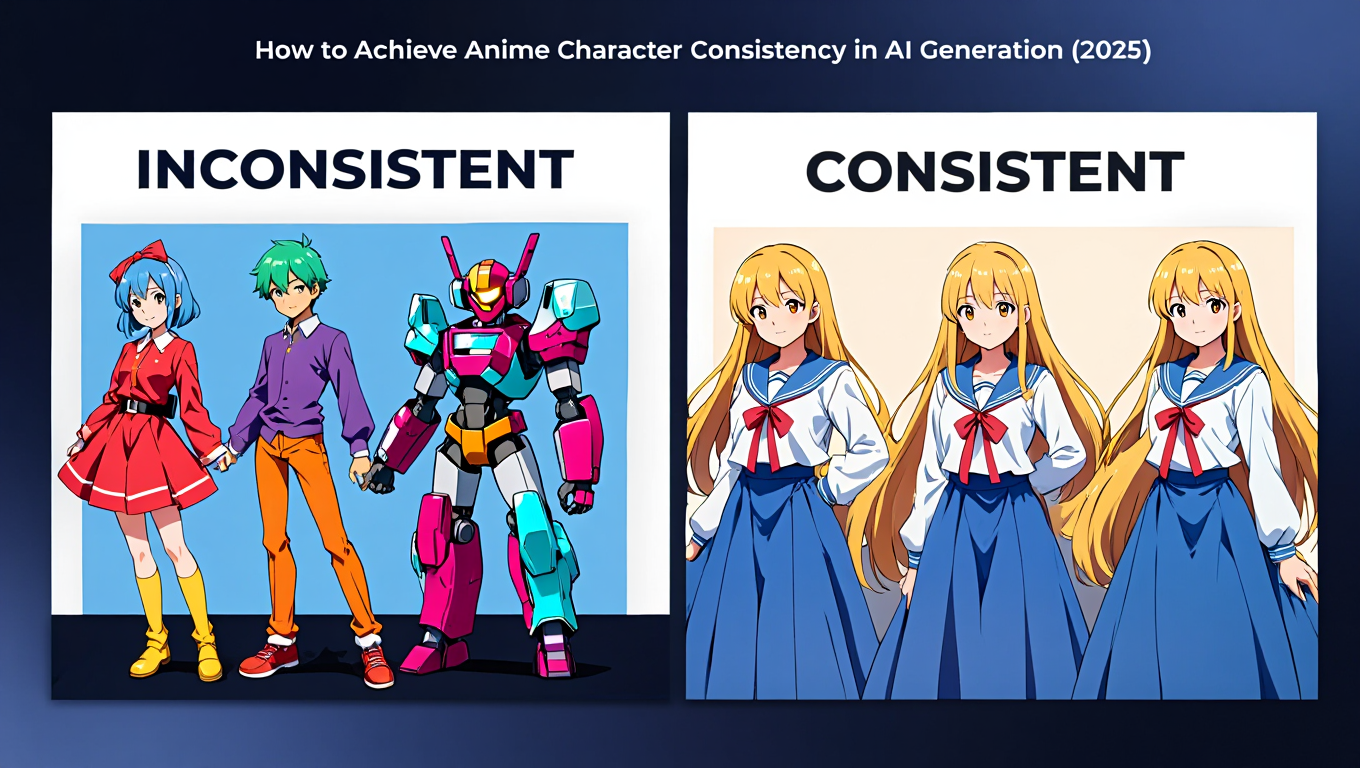

Cómo Lograr Consistencia de Personajes Anime en Generación IA (2025)

Deje de obtener personajes diferentes en cada generación. Domine el entrenamiento LoRA, técnicas de referencia y estrategias de flujo de trabajo para personajes anime consistentes.

Cómo Detectar Imágenes Generadas por IA e Identificar el Modelo Usado

Guía completa para detectar imágenes generadas por IA en 2025. Compara herramientas de detección: Hive Moderation, Illuminarty y AI or Not.

Ideogram 3.0 para Renderizado de Texto en Imágenes IA - Guía Completa

Domina las capacidades superiores de renderizado de texto de Ideogram 3.0 para logos, pósters y diseños con tipografía precisa en imágenes generadas por IA