Cómo Lograr Consistencia de Personajes Anime en Generación IA (2025)

Deje de obtener personajes diferentes en cada generación. Domine el entrenamiento LoRA, técnicas de referencia y estrategias de flujo de trabajo para personajes anime consistentes.

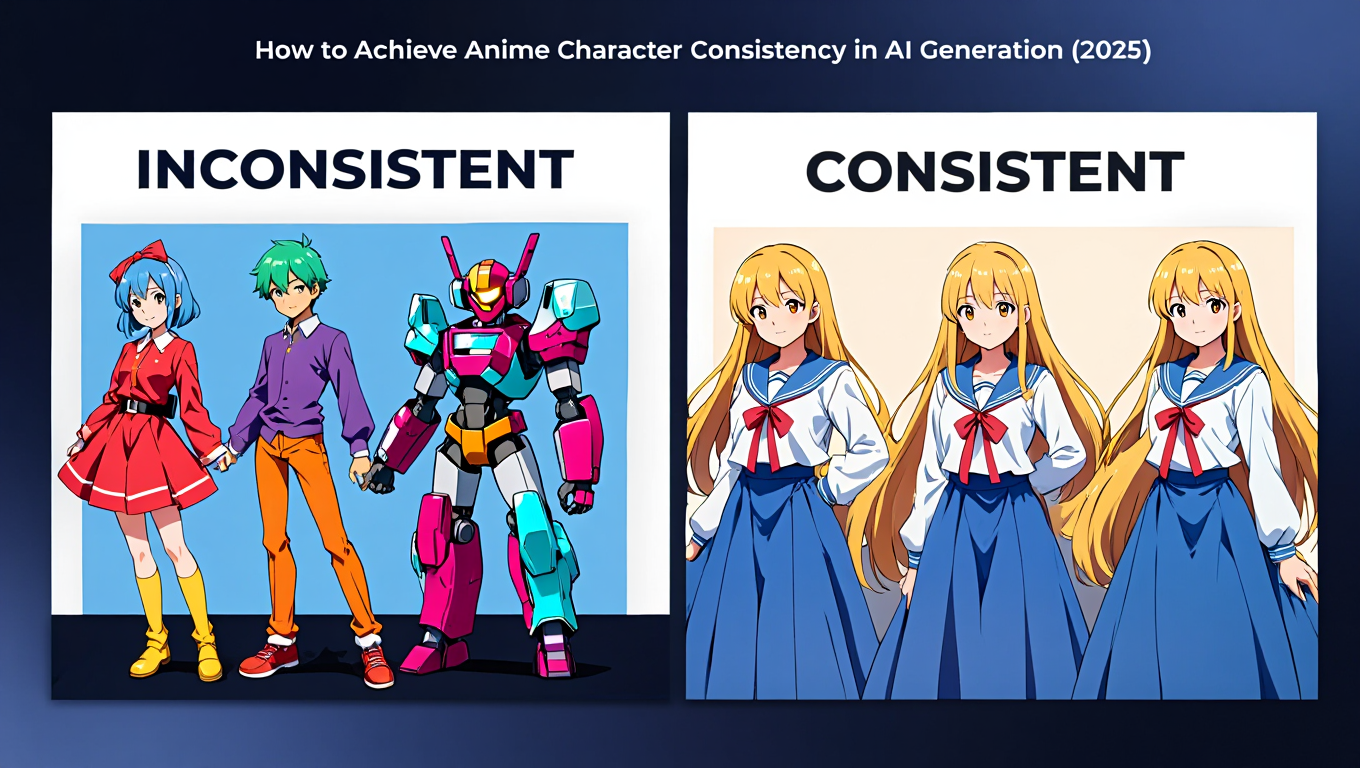

Usted genera la toma perfecta de su personaje original. Cabello azul en un estilo específico, ojos distintivos, ese diseño exacto de atuendo que ha estado refinando. Está construyendo una serie de cómics, o una novela visual, o simplemente explorando un concepto de personaje a través de diferentes escenas. La siguiente generación se carga y ella tiene características faciales completamente diferentes, longitud de cabello incorrecta, atuendo que apenas se asemeja a la referencia.

Cuarenta generaciones después tiene cuarenta variaciones de "chica anime de cabello azul" pero ni un solo personaje consistente. Este es el problema que determina si la generación de imágenes IA realmente funciona para narrativa y proyectos enfocados en personajes.

Respuesta Rápida: Lograr consistencia de personajes anime en generación IA requiere entrenar un LoRA personalizado con 15-30 imágenes de referencia de alta calidad de su personaje, usar IPAdapter para guía de pose y composición, mantener prompts consistentes con etiquetas de personaje a peso alto, y construir flujos de trabajo repetibles en ComfyUI que fijen características faciales mientras permiten variación de pose. La combinación de LoRA entrenado (para identidad), prompts ponderados (para características), y condicionamiento de referencia (para composición) produce 80-90% de consistencia entre generaciones.

- El entrenamiento LoRA personalizado es esencial para personajes originales consistentes, no opcional

- IPAdapter proporciona consistencia de composición y pose sin afectar la identidad del personaje

- La estructura del prompt importa más para anime que para modelos realistas - el orden de etiquetas y pesos son críticos

- 15-30 imágenes de referencia variadas funcionan mejor que 100 similares para entrenamiento LoRA

- La consistencia y flexibilidad de pose existen en tensión - los flujos de trabajo deben equilibrar ambos

El Enfoque de Tres Capas Que Realmente Funciona

La consistencia de personajes no es una técnica, es un sistema. Las personas que tienen éxito en esto usan tres enfoques complementarios en capas, no una solución mágica única.

La capa uno es identidad a través del entrenamiento LoRA. Esto enseña al modelo cómo se ve su personaje específico a un nivel fundamental. Estructura facial, características distintivas, diseño general. El LoRA activa esa identidad aprendida en cada generación.

La capa dos es refuerzo de características a través de prompts precisos. Incluso con un LoRA, los prompts necesitan enfatizar características distintivas. Cabello azul no significa automáticamente su tono y estilo específico de cabello azul. Etiquetas ponderadas como "(long blue hair with side ponytail:1.4)" fijan especificidades.

La capa tres es guía composicional a través de sistemas de referencia como IPAdapter o ControlNet. Estos controlan pose, ángulo y composición separadamente de la identidad. Puede variar cómo está posicionado su personaje o qué está haciendo mientras mantiene quién es.

La mayoría de intentos fallidos de consistencia usan solo una capa. Solo prompting da personajes genéricos. Solo LoRA sin buenos prompts produce características inconsistentes. Solo sistemas de referencia sin entrenamiento de identidad da poses similares de personajes diferentes. La combinación es lo que hace que funcione.

Servicios como Apatero.com implementan este enfoque en capas automáticamente, manejando la gestión de LoRA y condicionamiento de referencia detrás de escenas para que usted pueda enfocarse en la dirección creativa en lugar de configuración técnica.

Por Qué el Entrenamiento LoRA Se Volvió Imprescindible

Antes de que existieran buenas herramientas de entrenamiento LoRA para modelos anime, la consistencia de personajes era básicamente imposible para personajes originales. Podía describir su personaje perfectamente en prompts y aún obtener variaciones infinitas. Los LoRAs lo cambiaron todo al permitirle enseñar al modelo su personaje específico directamente.

El avance no fue solo la tecnología LoRA en sí, fue que el entrenamiento LoRA se volvió suficientemente accesible para que artistas no técnicos pudieran hacerlo. Herramientas como Kohya SS simplificaron el proceso de "requiere experiencia en aprendizaje automático" a "siga estos pasos y espere."

Entrenar un LoRA de personaje en modelos anime modernos como Animagine XL o Pony Diffusion toma 15-30 buenas imágenes de referencia. No cientos, no miles. La calidad y variedad importan más que la cantidad. Quiere su personaje desde diferentes ángulos, diferentes expresiones, quizás diferentes atuendos, mostrando la consistencia que está tratando de capturar.

Las imágenes de referencia mismas pueden ser generadas por IA. Esto suena circular pero funciona. Genere 50 imágenes de su concepto de personaje, seleccione manualmente las 20 mejores que coincidan con su visión, entrene un LoRA en esas selecciones curadas. El LoRA refuerza las características específicas que seleccionó en ese conjunto, produciendo generaciones futuras más consistentes.

El tiempo de entrenamiento depende del hardware y configuraciones pero típicamente toma 1-3 horas en una GPU decente. El archivo LoRA entrenado es pequeño, usualmente 50-200MB. Una vez entrenado, se carga en segundos y se aplica a cada generación. La inversión de tiempo inicial se paga inmediatamente si está generando múltiples imágenes del mismo personaje.

Los parámetros importan sin embargo. LoRAs subentrenados tienen influencia débil y los personajes aún varían. LoRAs sobreentrenados hacen personajes demasiado rígidos y difíciles de posar diferentemente. El punto óptimo es entrenar hasta que las características distintivas del personaje estén presentes confiablemente pero antes de que el LoRA comience a memorizar poses o composiciones exactas de su conjunto de entrenamiento.

IPAdapter Cambió el Juego de Consistencia

IPAdapter resolvió un problema diferente al LoRA pero es igualmente crítico para el flujo de trabajo completo. LoRA maneja "quién es este personaje," IPAdapter maneja "qué está haciendo este personaje y cómo está posicionado."

La explicación técnica es que IPAdapter inyecta características de imagen en el proceso de generación en un punto diferente que los prompts de texto o LoRAs. Influencia composición, pose y relaciones espaciales mientras en gran medida deja la identidad sola si esa identidad está fijada a través de LoRA.

En la práctica, esto significa que puede usar una imagen de referencia mostrando la pose exacta que quiere mientras su LoRA mantiene la identidad del personaje. ¿Generar su personaje sentado con piernas cruzadas? Alimente una referencia de cualquiera sentado con piernas cruzadas a IPAdapter, use su LoRA de personaje, y obtiene su personaje en esa pose. La pose viene de la referencia, la identidad viene del LoRA.

Esto es masivo para arte secuencial o cómics. No está luchando para describir poses complejas en prompts mientras simultáneamente mantiene consistencia de personaje. La referencia maneja pose, el LoRA maneja identidad, los prompts manejan detalles como expresión y qué están usando.

La fuerza de IPAdapter necesita calibración. Muy débil y apenas influencia composición. Muy fuerte y comienza a afectar características del personaje, socavando su LoRA. El punto óptimo para trabajo anime es usualmente fuerza 0.4-0.7 dependiendo de qué tan estricto el emparejamiento de pose necesita ser versus cuánta interpretación creativa quiere.

Existen múltiples modelos IPAdapter con diferentes características. IPAdapter Plus para uso general, IPAdapter Face para mantener características faciales de referencia (útil cuando aún no tiene un LoRA), IPAdapter Style para transferir estilo artístico separadamente del contenido. Entender qué adaptador sirve qué propósito le permite combinarlos para control en capas.

El flujo de trabajo se convierte en: LoRA para identidad de personaje, IPAdapter para pose y composición, prompts para especificidades como expresión y escenario, ControlNet opcionalmente para precisión adicional en cosas como posiciones de manos o ángulos específicos. Cada sistema maneja lo que hace mejor, combinados producen control que no era posible con ningún enfoque único.

- Comience con biblioteca de poses: Construya una colección de imágenes de referencia mostrando varias poses que comúnmente necesita

- Pruebe rangos de fuerza: Mismo personaje, misma referencia de pose, varíe fuerza IPAdapter de 0.3 a 0.8 para encontrar el punto óptimo de su modelo

- Separe referencias de cara y cuerpo: Use IPAdapter Face para mantener expresión mientras IPAdapter Plus maneja pose corporal

- Combine con ControlNet: IPAdapter para composición general, ControlNet para detalles precisos que deben ser exactos

Qué Hace Diferente el Prompting de Modelos Anime

Si viene de modelos realistas como SDXL o Flux, el prompting de modelos anime se siente al revés al principio. Las reglas son diferentes e ignorar eso produce resultados inconsistentes.

Los modelos anime entrenados en etiquetas estilo booru esperan estructura de etiqueta específica. Las características que definen al personaje deben aparecer temprano y con modificadores de peso. Etiquetas de calidad genéricas como "masterpiece" y "best quality" realmente importan para modelos anime donde son mayormente placebo en los realistas. El modelo fue entrenado en imágenes etiquetadas de esa manera, así que responde a esos patrones.

El orden de etiquetas influencia jerarquía. Las etiquetas anteriores generalmente tienen más influencia que las posteriores. Si entierra las características distintivas de su personaje al final de un prompt largo, serán débiles o ignoradas. Lidere con la información de identidad, siga con pose y detalles de escenario.

Los modificadores de peso como (tag:1.4) o [tag:0.8] le permiten enfatizar o des-enfatizar características específicas. Para consistencia, pondere fuertemente las características únicas de su personaje. "(purple eyes:1.4), (twin drills hairstyle:1.3), (frilly gothic dress:1.2)" fija esos específicos más fuerte que detalles circundantes. El modelo presta más atención a etiquetas ponderadas.

Los prompts negativos son más críticos para modelos anime que los realistas. Problemas comunes como "multiple girls, extra limbs, deformed hands" necesitan negación explícita. Los modelos anime no tienen el mismo entendimiento inherente de anatomía que los modelos realistas, usted los guía más explícitamente lejos de fallos comunes.

Las etiquetas de artista cambian dramáticamente el estilo pero pueden socavar la consistencia del personaje si se usan excesivamente. Una etiqueta de artista efectivamente dice "dibuje en el estilo de X persona" lo cual puede entrar en conflicto con el diseño específico de su personaje si el estilo de ese artista es muy distintivo. Use etiquetas de artista para dirección estética general pero no como muletas para resolver problemas de consistencia.

La ingeniería de prompt para consistencia se ve así: etiquetas de identidad de personaje fuertemente ponderadas, pose y composición moderadamente ponderadas, escenario y detalles peso normal, etiquetas de calidad al frente, prompt negativo comprensivo. Esta estructura refuerza al personaje mientras permite variación en otros elementos.

Qué Modelos Base Manejan Mejor la Consistencia

No todos los modelos anime son igualmente buenos manteniendo consistencia de personaje incluso con técnicas apropiadas. El modelo base importa.

Pony Diffusion V6 se volvió popular específicamente por características fuertes de consistencia. Mantiene características entre generaciones mejor que la mayoría de alternativas incluso sin entrenamiento LoRA. El compromiso es que tiene una estética distintiva que no a todos les gusta. Si la apariencia Pony funciona para su proyecto, la consistencia viene más fácil.

Flujos de ComfyUI Gratuitos

Encuentra flujos de ComfyUI gratuitos y de código abierto para las técnicas de este artículo. El código abierto es poderoso.

Animagine XL produce estilos estéticos más variados y posiblemente salida base más bonita, pero requiere prompting más cuidadoso para consistencia. Es más flexible, lo que significa que también tiene más espacio para desviarse de su personaje deseado. Excelente con entrenamiento LoRA apropiado, más desafiante solo con prompting.

Anything V5 y la serie Anything mantienen popularidad consistente porque son caballos de batalla confiables. No la salida más elegante, no las más características, pero estables y predecibles. Buena elección cuando quiere enfocarse en el flujo de trabajo en lugar de pelear peculiaridades del modelo.

Los modelos de NovelAI sobresalen en consistencia por diseño ya que la plataforma se enfoca en narrativa impulsada por personajes. Si está usando NovelAI Diffusion localmente, recompensa el enfoque de consistencia en capas más que la mayoría de alternativas. El modelo fue explícitamente entrenado con consistencia de personaje como prioridad.

Los modelos merge son salvajemente impredecibles para consistencia. El merge personalizado de alguien de tres modelos anime diferentes podría producir imágenes únicas hermosas pero terrible consistencia porque los pesos mezclados promedian las características que hacen posible la consistencia. Manténgase con modelos base bien probados o merges cuidadosamente validados para trabajo de personajes.

La elección del modelo interactúa con su entrenamiento LoRA. Un LoRA entrenado en Animagine no necesariamente funcionará en Pony Diffusion y viceversa. Está entrenando encima del entendimiento específico de ese modelo. Cambiar modelos base significa reentrenar su LoRA de personaje, lo cual es molesto pero necesario si quiere experimentar con diferentes estéticas de modelo.

Para principiantes, comience con Pony Diffusion V6 porque es indulgente. Una vez que haya dominado el flujo de trabajo de consistencia ahí, ramifíquese a otros modelos si la estética no coincide con sus necesidades. O use plataformas como Apatero.com que abstraen la selección de modelo manteniendo consistencia de personaje a través de sus elecciones de modelo optimizadas.

Construyendo un Flujo de Trabajo Repetible en ComfyUI

La teoría es genial, la práctica significa realmente construir flujos de trabajo que puede reutilizar. Así es cómo se ve la generación de personaje consistente como una estructura de flujo de trabajo ComfyUI real.

Comience con su cargador de checkpoint para su modelo anime elegido. Conéctelo a su cargador LoRA con su LoRA de personaje. Ambos alimentan a su KSampler. Esta es la fundación de identidad.

Agregue nodos IPAdapter entre su carga de imagen y la ruta de condicionamiento al sampler. Su imagen de pose de referencia alimenta a través de IPAdapter Model Loader y luego a IPAdapter Apply, que modifica el condicionamiento antes de que alcance el sampler. Esto agrega control composicional.

Su prompt positivo pasa a través de CLIP Text Encode con sus etiquetas cuidadosamente estructuradas. Características de personaje ponderadas alto, pose y detalles de escenario a pesos normales, etiquetas de calidad incluidas. Esto refuerza la identidad y especifica la variación que quiere.

Prompt negativo similarmente codificado con negativos comprensivos para fallos comunes de modelo anime. Múltiples personajes, problemas anatómicos, términos de degradación de calidad todos negados.

El sampler combina todas estas entradas - modelo base, modificación LoRA, condicionamiento IPAdapter, prompts de texto positivos y negativos - en generaciones que mantienen su personaje mientras varían basado en sus prompts y referencias.

Guarde este flujo de trabajo como plantilla. La próxima vez que necesite el mismo personaje en un escenario diferente, cargue la plantilla, intercambie la imagen de referencia IPAdapter, modifique los prompts de texto para el nuevo escenario, genere. La infraestructura permanece igual, solo las variables cambian. Así es como pasa de luchar con consistencia a producir múltiples tomas consistentes en una sesión.

ControlNet puede agregarse en capas encima si necesita precisión adicional. OpenPose para estructura esquelética específica, Depth para relaciones espaciales exactas, Canny para control de borde fuerte. Estos agregan a la pila de consistencia en lugar de reemplazar cualquier parte de ella.

¿Quieres evitar la complejidad? Apatero te ofrece resultados profesionales de IA al instante sin configuración técnica.

Cómo Construir Su Dataset de Referencia para Entrenamiento LoRA

Las imágenes de referencia en las que entrena su LoRA determinan qué consistencia obtiene. Construir este dataset cuidadosamente hace todo más fácil después.

Genere o recolecte 50-100 imágenes candidatas mostrando su concepto de personaje. Estas pueden venir de generación IA, arte comisionado, sus propios bocetos si dibuja, o arte existente cuidadosamente seleccionado que coincida con su visión. La fuente importa menos que la consistencia dentro del conjunto.

Cure despiadadamente a 15-30 mejores imágenes. Está buscando consistencia en las características que definen a su personaje mientras tiene variación en todo lo demás. Misma cara, ojos, cabello, tipo de cuerpo en todas las selecciones. Diferentes poses, expresiones, atuendos, ángulos. El LoRA aprende qué permanece constante a través de las variaciones.

La variedad en el conjunto de entrenamiento produce LoRAs flexibles. Todas vistas frontales entrena un LoRA que lucha con ángulos de perfil o tres cuartos. Todas expresiones similares hace diferentes emociones difíciles. Todo el mismo atuendo podría hornear ese atuendo en la identidad del personaje cuando quiere que el atuendo sea variable. Piense en qué necesita ser consistente versus qué necesita ser flexible.

La calidad de imagen importa más para entrenamiento LoRA que para generación normal. Referencias borrosas, artefactos, errores anatómicos, estos se aprenden y refuerzan. Referencias limpias de alta calidad producen LoRAs limpios que no introducen problemas. Si está usando referencias generadas por IA, solo incluya las que salieron correctamente.

Etiquete sus imágenes de referencia si está usando etiquetado automático en su configuración de entrenamiento. Etiquetas consistentes y precisas ayudan al LoRA a aprender qué características corresponden a qué conceptos. La mayoría de herramientas de entrenamiento modernas pueden auto-etiquetar usando modelos de interrogación, pero revisar y corregir manualmente esas etiquetas mejora resultados.

La resolución debe ser consistente o al menos similar a través de su conjunto de referencia. Entrenar en imágenes de tamaños salvajemente diferentes a veces confunde el proceso de aprendizaje. 512x512 o 768x768 son resoluciones base comunes para entrenamiento LoRA anime. Resolución más alta puede funcionar pero requiere más VRAM y tiempos de entrenamiento más largos.

Parámetros de Entrenamiento Que Realmente Afectan Consistencia

El entrenamiento LoRA involucra docenas de parámetros pero la mayoría apenas importan para resultados. Estos son los que realmente impactan consistencia de personaje.

Tasa de aprendizaje controla qué tan agresivamente el LoRA aprende de sus datos. Muy alta y sobreajusta, memorizando imágenes específicas. Muy baja y subajusta, apenas aprendiendo nada útil. Para consistencia de personaje en modelos anime, tasas de aprendizaje entre 0.0001 y 0.0005 funcionan confiablemente. Comience en 0.0002 y ajuste si los resultados son muy débiles o muy rígidos.

Épocas de entrenamiento es cuántas veces el proceso de entrenamiento recorre todo su dataset. Poco hecho y obtiene LoRAs débiles e inconsistentes. Sobre hecho y obtiene LoRAs rígidos que memorizan sus imágenes de entrenamiento. Para datasets de 15-30 imágenes, 10-20 épocas usualmente alcanza el punto óptimo. Observe sus generaciones de vista previa durante entrenamiento para capturar cuando ha aprendido suficiente.

Dimensión y alfa de red controlan capacidad LoRA y qué tan fuertemente se aplica. Valores comunes son 32 o 64 para dimensión, con alfa igual a dimensión. Valores más altos dan LoRAs más expresivos pero requieren más tiempo de entrenamiento y pueden sobreajustarse más fácilmente. Para consistencia de personaje, 32/32 o 64/64 ambos funcionan bien. Ir más alto usualmente no mejora resultados para este caso de uso.

Tamaño de lote afecta velocidad de entrenamiento y uso de memoria más que calidad final. Lotes más grandes entrenan más rápido pero necesitan más VRAM. Para trabajo de personaje, tamaño de lote de 1-4 es típico. El impacto de calidad es menor, configure esto basado en lo que su hardware puede manejar.

Elección de optimizador entre AdamW, AdamW8bit, y otros afecta mayormente uso de memoria y velocidad. AdamW8bit usa menos VRAM con diferencia mínima de calidad. A menos que esté optimizando para casos extremos específicos, los optimizadores predeterminados funcionan bien para LoRAs de personaje.

La mayoría de otros parámetros pueden permanecer en valores predeterminados sensatos. Los sistemas de entrenamiento han madurado suficiente que valores predeterminados funcionan para casos de uso estándar. No está haciendo investigación novedosa, está entrenando un LoRA de personaje usando un proceso que miles de personas han hecho antes. Siga recetas probadas en lugar de sobre-optimizar parámetros.

Gana Hasta $1,250+/Mes Creando Contenido

Únete a nuestro programa exclusivo de creadores afiliados. Cobra por video viral según rendimiento. Crea contenido a tu estilo con total libertad creativa.

Previsualice su progreso de entrenamiento. Buenas herramientas de entrenamiento generan imágenes de muestra cada pocas épocas para que pueda ver el LoRA desarrollándose. Si las vistas previas muestran características fuertes de personaje apareciendo consistentemente para época 10-12, está en camino. Si época 20 aún se ve vago, algo en su dataset o parámetros necesita ajuste.

Fallos Comunes de Consistencia y Soluciones Reales

Incluso con técnica apropiada, las cosas salen mal. Aquí está qué realmente se rompe y cómo arreglarlo sin adivinar.

Las características del personaje se desvían entre generaciones a pesar del LoRA. Su peso LoRA probablemente es muy bajo. Los LoRAs predeterminan a fuerza 1.0, pero puede empujar LoRAs de personaje a 1.2 o 1.3 para influencia más fuerte sin problemas. Alternativamente, sus prompts base no están reforzando suficiente las características del personaje. Agregue etiquetas fuertemente ponderadas para características distintivas.

La variación de pose rompe consistencia de personaje. La fuerza IPAdapter es muy alta, está afectando identidad junto con pose. Bájela a rango 0.4-0.5. O sus imágenes de referencia de pose muestran diferentes personajes con características variables, confundiendo el sistema. Use referencias neutrales que no tengan características faciales fuertes, o use ControlNet solo de pose como OpenPose en lugar de IPAdapter.

LoRA produce la misma pose repetidamente. Sobreentrenó en imágenes de referencia muy similares. El LoRA memorizó composiciones junto con identidad de personaje. Reentrene con referencias de pose más variadas, o reduzca épocas de entrenamiento para parar antes de que comience memorización. Solución a corto plazo es fuerza LoRA más baja y prompting más fuerte para poses variadas.

El personaje se ve bien en algunos ángulos pero mal en otros. El dataset de entrenamiento careció de variedad en ángulos. Si solo entrenó en vistas frontales, generaciones de tres cuartos y perfil lucharán. Reentrene incluyendo los ángulos faltantes, o acepte que necesita promptear más cuidadosamente y seleccionar más para esos ángulos. Alternativamente, use IPAdapter con imágenes de referencia de los ángulos faltantes para guiar generaciones.

Detalles como atuendo exacto o accesorios varían cuando no deberían. Estos detalles no están siendo captados por el LoRA porque no son suficientemente consistentes a través de imágenes de entrenamiento, o sus prompts no los están ponderando suficientemente fuerte. Para consistencia de atuendo, incluya detalles de atuendo en cada imagen de entrenamiento, o promptee especificidades de atuendo con pesos altos como (character-specific-outfit:1.4). Accesorios especialmente necesitan refuerzo de prompt porque son detalles pequeños que el modelo podría ignorar.

El personaje cambia completamente al cambiar escenarios o agregar otros personajes. Su LoRA es débil relativo a los otros conceptos en la generación. Aumente fuerza LoRA. Simplifique sus prompts para reducir conceptos competidores que diluyen el enfoque de personaje. Genere personaje en escenarios simples primero, luego componga o inpaint fondos complejos después de establecer el personaje consistente.

El enfoque de depuración es siempre aislar variables. Genere con solo el LoRA, sin IPAdapter, prompts simples. ¿Funciona? Agregue complejidad una capa a la vez hasta que se rompa. Eso identifica qué está causando el problema. ¿No funciona? El problema está en su LoRA o prompts base, no los sistemas adicionales.

Cómo las Escenas Multi-Personaje Complican Todo

Lograr un personaje consistente es suficientemente difícil. Múltiples personajes consistentes en la misma escena multiplica la dificultad.

Cada personaje necesita su propio LoRA entrenado separadamente. Cargará múltiples LoRAs simultáneamente, lo cual funciona pero requiere estructura de prompt cuidadosa para dirigir qué personaje obtiene qué descripción. Prompters regionales o técnicas de acoplamiento de atención ayudan asignando diferentes prompts a diferentes áreas de la imagen.

Latent couple y métodos de generación regional similares dividen la imagen espacialmente durante generación. El lado izquierdo obtiene el LoRA y prompts del personaje A, el lado derecho obtiene el LoRA y prompts del personaje B. Esto previene que los LoRAs interfieran entre sí pero requiere planificación cuidadosa de posiciones de personaje.

La interacción entre personajes es donde se vuelve verdaderamente difícil. Si se están tocando o superponiendo, los métodos regionales se descomponen. Termina haciendo múltiples pasadas, generando cada personaje separadamente en poses consistentes, luego componiendo o usando inpainting para combinarlos mientras mantiene consistencia para ambos.

El flujo de trabajo práctico para consistencia multi-personaje a menudo involucra generar cada personaje en la pose deseada separadamente, usar remoción de fondo o segmentación para extraerlos limpiamente, luego componer en software de edición de imagen tradicional con pasadas finales de inpainting para mezclar bordes y agregar detalles de interacción.

Los flujos de trabajo profesionales de cómic o novela visual básicamente nunca generan escenas multi-personaje finales en una pasada. Están haciendo capas de personaje, capas de fondo, composición, e inpainting selectivo. La IA maneja consistencia de elementos individuales, la composición humana maneja combinarlos coherentemente. Tratar de forzar todo en generaciones únicas produce resultados inconsistentes y frustración infinita.

Aquí es donde los servicios administrados proporcionan valor significativo. Plataformas como Apatero.com pueden manejar consistencia multi-personaje compleja a través de orquestación de flujo de trabajo backend que tomaría horas configurar manualmente. Para proyectos comerciales donde el tiempo es dinero, esa gestión de complejidad vale la pena pagar.

- Genere separadamente: Cada personaje en su pose con fondo simple

- Segmente limpiamente: Use segmentación apropiada para extraer personajes sin artefactos

- Componga deliberadamente: Combine en software de edición con gestión de capa apropiada

- Inpaint conexiones: Use inpainting IA para agregar sombras, puntos de contacto, detalles de interacción después de composición

- Acepte la complejidad: La consistencia multi-personaje es genuinamente difícil, estructure flujo de trabajo para manejarlo metódicamente

Preguntas Frecuentes

¿Cuántas imágenes de referencia realmente necesita para un LoRA de personaje?

Para consistencia funcional, 15-20 imágenes variadas de alta calidad funcionan bien. Más de 30 raramente mejora resultados a menos que esté específicamente tratando de enseñar diseños de personaje extremadamente complejos con muchos elementos distintivos. La calidad y variedad importan mucho más que la cantidad. Una persona reportó resultados excelentes de solo 10 imágenes perfectamente curadas, mientras otra luchó con 50 imágenes similares. La consistencia dentro de su conjunto determina qué puede aprender el LoRA.

¿Puede lograr consistencia sin entrenar LoRAs personalizados?

Para personajes populares existentes que ya tienen LoRAs disponibles, sí. Para personajes originales, técnicamente sí pero prácticamente es suficientemente frustrante que debería simplemente entrenar el LoRA. IPAdapter más prompting extremadamente detallado puede mantener consistencia aproximada, pero pasará más tiempo peleando con ello que las 2-3 horas para entrenar un LoRA apropiado. El techo de consistencia sin LoRA es mucho más bajo que con él.

¿El entrenamiento LoRA requiere hardware costoso?

Una GPU de 12GB puede entrenar LoRAs de personaje anime, aunque toma más tiempo que tarjetas de gama alta. Presupueste 1-3 horas en hardware de gama media. Si no tiene una GPU adecuada, servicios de alquiler como RunPod o Vast.ai le permiten alquilar tarjetas poderosas por unos pocos dólares por sesión de entrenamiento. Algunos servicios en línea entrenarán LoRAs por usted si proporciona el dataset, removiendo el requisito de hardware enteramente pero agregando costo por LoRA.

¿Por qué la consistencia de personaje se rompe al cambiar estilos de arte?

El estilo e identidad están enredados en las representaciones aprendidas del modelo. Empujar fuerte hacia un estilo diferente (a través de prompts, LoRAs, o etiquetas de artista) puede sobrescribir identidad de personaje. El modelo está balanceando múltiples conceptos competidores y las etiquetas de estilo a menudo tienen influencia fuerte. Use LoRAs de estilo a fuerza más baja, o entrene su LoRA de personaje en ejemplos ya en su estilo objetivo. IPAdapter Style puede ayudar a transferir estilo sin afectar tanto la identidad del personaje.

¿Cómo mantiene consistencia a través de diferentes modelos o checkpoints?

Generalmente no lo hace. Los LoRAs son específicos de checkpoint. Un LoRA entrenado en Animagine no funcionará apropiadamente en Pony Diffusion. Si necesita cambiar modelos base, necesita reentrenar su LoRA de personaje en la nueva base. Algo de cruce a veces funciona entre modelos estrechamente relacionados, pero los resultados se degradan. Para trabajo serio, comprométase a un modelo base por la duración de su proyecto o mantenga LoRAs separados para cada modelo que quiera usar.

¿Puede usar LoRAs de celebridades o personajes existentes como puntos de partida?

Técnicamente sí entrenando encima de un LoRA existente, pero raramente funciona tan bien como entrenar desde el modelo base. Las características aprendidas del LoRA existente interfieren con aprender las características de su nuevo personaje. Mejor entrenar fresco a menos que su personaje sea intencionalmente una variación de uno existente. Entonces comenzar desde el LoRA de ese personaje y entrenar sus modificaciones encima puede funcionar bien.

¿Qué tan seguido necesita regenerar porque la consistencia falló de todos modos?

Incluso con configuración perfecta, espere 10-30% de generaciones tener algo incorrecto que requiera regeneración. Quizás la expresión no está del todo correcta, o un detalle se desvió, o la pose salió incómoda. Esto es normal. Está apilando probabilidades, no garantías. El sistema mejora dramáticamente consistencia de "90% fallo" a "70-80% usable," no de "90% fallo" a "100% perfecto." Construir tiempo de iteración es parte del flujo de trabajo.

¿Cuál es la mejor manera de compartir personajes con otros que quieren usarlos consistentemente?

Proporcione el archivo LoRA entrenado, una plantilla de prompt detallada mostrando cómo estructura descripciones de personaje, imágenes de referencia mostrando el personaje desde múltiples ángulos, y su prompt negativo típico. El LoRA hace la mayor parte del trabajo pesado pero el enfoque de prompting importa para resultados consistentes. Algunos creadores empaquetan esto como una "tarjeta de personaje" con toda la información en un lugar. Especifique en qué modelo base fue entrenado el LoRA ya que no funcionará en otros.

La Realidad del Mantenimiento de Flujo de Trabajo

La consistencia de personaje no es un problema que resuelve una vez y olvida. Es una práctica continua que requiere mantenimiento mientras desarrolla proyectos.

Su LoRA podría necesitar reentrenamiento ocasional mientras refina su diseño de personaje. Genere 20 imágenes con su LoRA actual, cure las mejores que coincidan con su visión evolucionada, reentrene incorporando estas. El personaje puede desarrollarse naturalmente mientras mantiene consistencia a través de actualizaciones LoRA iterativas.

Guarde todo sistemáticamente. Archivos LoRA, datasets de entrenamiento, plantillas de flujo de trabajo, plantillas de prompt, imágenes de referencia. Seis meses dentro de un proyecto necesitará generar algo nuevo, y si ha perdido la configuración específica que estaba funcionando, está comenzando de cero desde el principio. El control de versiones importa para proyectos creativos igual que código.

Documente qué funciona para cada personaje. Diferentes personajes pueden necesitar diferentes fuerzas LoRA, configuraciones IPAdapter, o enfoques de prompting incluso usando la misma estructura de flujo de trabajo. Note qué configuraciones producen mejores resultados para cada uno. Tratar de recordar meses después desperdicia tiempo.

El flujo de trabajo de consistencia se vuelve natural después de suficiente práctica. Inicialmente se siente como hacer malabarismos con múltiples sistemas complejos. Después de entrenar algunos LoRAs y generar cientos de imágenes, se vuelve segunda naturaleza. Su intuición se desarrolla para cuándo ajustar fuerza LoRA versus pesos de prompt versus influencia IPAdapter. Comienza a reconocer patrones de fallo y saber inmediatamente qué ajustar.

La mayoría de proyectos exitosos impulsados por personajes IA usaron estas técnicas no porque sean fáciles, sino porque nada más funciona suficientemente confiable. La alternativa es aceptar inconsistencia o hacer todo manualmente. El tiempo invertido en dominar flujos de trabajo de consistencia se paga de vuelta a través de cada proyecto subsecuente impulsado por personajes.

Comience simple. Un personaje, flujo de trabajo básico, domine los fundamentos. Agregue complejidad solo cuando enfoques más simples alcancen límites. Construya su sistema incrementalmente basado en necesidades reales en lugar de tratar de implementar todo a la vez. La curva de aprendizaje es real pero la capacidad que desbloquea hace que valga la pena.

¿Listo para Crear Tu Influencer IA?

Únete a 115 estudiantes dominando ComfyUI y marketing de influencers IA en nuestro curso completo de 51 lecciones.

Artículos Relacionados

Cómo Detectar Imágenes Generadas por IA e Identificar el Modelo Usado

Guía completa para detectar imágenes generadas por IA en 2025. Compara herramientas de detección: Hive Moderation, Illuminarty y AI or Not.

Ideogram 3.0 para Renderizado de Texto en Imágenes IA - Guía Completa

Domina las capacidades superiores de renderizado de texto de Ideogram 3.0 para logos, pósters y diseños con tipografía precisa en imágenes generadas por IA

Generación de Videos Largos con RIFLEx - Guía Completa

Genera videos de IA más largos usando interpolación de posición RIFLEx que extiende los modelos de video más allá de sus límites de longitud de entrenamiento