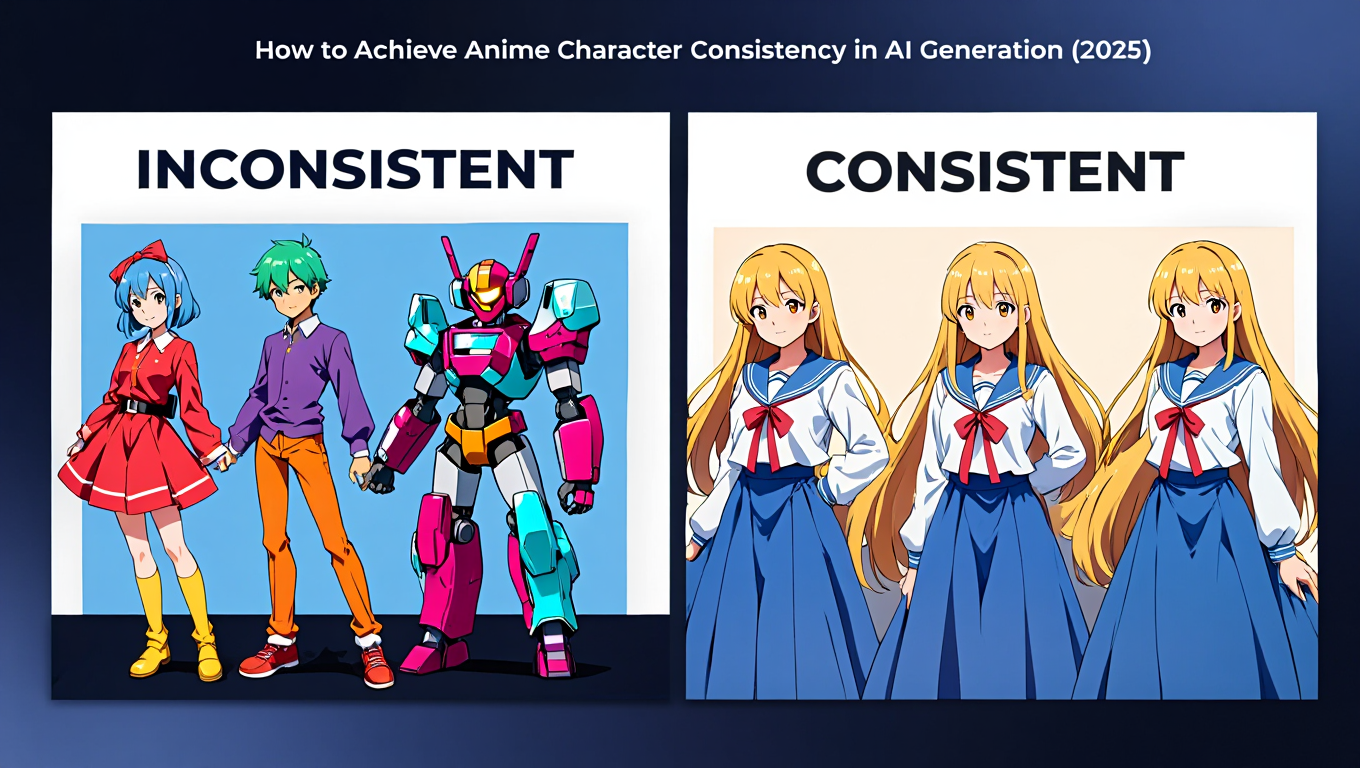

AI生成でアニメキャラクターの一貫性を実現する方法(2025年版)

生成ごとに異なるキャラクターになってしまう問題を解決します。LoRAトレーニング、リファレンステクニック、ワークフロー戦略をマスターして、一貫したアニメキャラクターを生成しましょう。

あなたはオリジナルキャラクターの完璧なショットを生成します。特定のスタイルの青い髪、特徴的な瞳、ずっと磨き上げてきた正確な衣装デザイン。コミックシリーズやビジュアルノベルを制作していたり、異なるシーンでキャラクターコンセプトを探求しているところです。次の生成を読み込むと、彼女は全く異なる顔の特徴、間違った髪の長さ、リファレンスにほとんど似ていない衣装になっています。

40回の生成の後、あなたは40種類の「青髪のアニメガール」を手に入れましたが、一貫したキャラクターは一つもありません。これは、AI画像生成がストーリーテリングやキャラクター主導のプロジェクトで実際に機能するかどうかを左右する問題です。

簡潔な答え: AI生成でアニメキャラクターの一貫性を実現するには、キャラクターの15〜30枚の高品質なリファレンス画像でカスタムLoRAをトレーニングし、ポーズと構図のガイダンスにIPAdapterを使用し、高いウェイトでキャラクタータグを含む一貫したプロンプトを維持し、顔の特徴を固定しながらポーズの変化を可能にするComfyUIで再利用可能なワークフローを構築する必要があります。トレーニングされたLoRA(アイデンティティ用)、ウェイト付きプロンプト(特徴用)、リファレンスコンディショニング(構図用)の組み合わせにより、生成全体で80〜90%の一貫性が得られます。

- カスタムLoRAトレーニングは一貫したオリジナルキャラクターに必須であり、オプションではありません

- IPAdapterはキャラクターのアイデンティティに影響を与えずに構図とポーズの一貫性を提供します

- プロンプト構造はリアルなモデルよりもアニメにとって重要です - タグの順序とウェイトが重要です

- LoRAトレーニングには、100枚の似た画像よりも15〜30枚の多様なリファレンス画像の方が効果的です

- 一貫性とポーズの柔軟性は対立関係にあります - ワークフローは両方のバランスを取る必要があります

実際に機能する3層アプローチ

キャラクターの一貫性は単一のテクニックではなく、システムです。これに成功している人々は、単一の魔法のソリューションではなく、3つの補完的なアプローチを組み合わせて使用しています。

第1層はLoRAトレーニングによるアイデンティティです。これは、モデルにあなたの特定のキャラクターが基本的にどのように見えるかを教えます。顔の構造、特徴的な特徴、全体的なデザイン。LoRAは、すべての生成でその学習されたアイデンティティを活性化します。

第2層は正確なプロンプトによる特徴の強化です。LoRAを使用していても、プロンプトは特徴的な特性を強調する必要があります。青い髪は、あなたの特定の色合いとスタイルの青い髪を自動的に意味するわけではありません。「(long blue hair with side ponytail:1.4)」のようなウェイト付きタグが詳細を固定します。

第3層はIPAdapterやControlNetのようなリファレンスシステムによる構図のガイダンスです。これらは、アイデンティティとは別にポーズ、アングル、構図を制御します。キャラクターのアイデンティティを維持しながら、キャラクターの配置や動作を変更できます。

一貫性への失敗した試みのほとんどは、1つの層しか使用していません。プロンプトだけでは一般的なキャラクターが生成されます。適切なプロンプトなしでLoRAだけでは、一貫性のない特徴が生成されます。アイデンティティトレーニングなしでリファレンスシステムだけでは、異なるキャラクターの似たポーズが生成されます。スタックが機能させるのです。

Apatero.comのようなサービスは、この層状アプローチを自動的に実装し、LoRA管理とリファレンスコンディショニングを裏で処理するため、技術的な設定ではなくクリエイティブな方向性に集中できます。

LoRAトレーニングが必須になった理由

アニメモデル用の優れたLoRAトレーニングツールが存在する前は、オリジナルキャラクターのキャラクター一貫性は基本的に不可能でした。プロンプトでキャラクターを完璧に説明しても、無限のバリエーションが生成されました。LoRAは、モデルに特定のキャラクターを直接教えることを可能にすることで、すべてを変えました。

画期的だったのはLoRA技術自体だけでなく、LoRAトレーニングが技術者でないアーティストでもできるほどアクセスしやすくなったことです。Kohya SSのようなツールは、プロセスを「機械学習の専門知識が必要」から「これらの手順に従って待つ」に簡素化しました。

AnimagineXLやPony Diffusionのような最新のアニメモデルでキャラクターLoRAをトレーニングするには、15〜30枚の良いリファレンス画像が必要です。数百枚でも数千枚でもありません。品質と多様性が量よりも重要です。異なるアングル、異なる表情、おそらく異なる衣装から、キャプチャしようとしている一貫性を示すキャラクターが必要です。

リファレンス画像自体はAI生成されたものでも構いません。これは循環的に聞こえますが、機能します。キャラクターコンセプトの50枚の画像を生成し、ビジョンに一致する最高の20枚を手動で選択し、それらの厳選された選択でLoRAをトレーニングします。LoRAは、そのセット全体で選択した特定の特徴を強化し、より一貫性のある将来の生成を生み出します。

トレーニング時間はハードウェアと設定によって異なりますが、通常、適切なGPUで1〜3時間実行されます。トレーニングされたLoRAファイルは小さく、通常50〜200MBです。トレーニングが完了すると、数秒でロードされ、すべての生成に適用されます。同じキャラクターの複数の画像を生成する場合、初期の時間投資はすぐに報われます。

ただし、パラメータは重要です。トレーニング不足のLoRAは影響が弱く、キャラクターは依然として変化します。過剰トレーニングされたLoRAは、キャラクターが硬直しすぎて、異なるポーズを取るのが難しくなります。スイートスポットは、キャラクターの特徴的な特徴が確実に存在するようになるまでトレーニングすることですが、LoRAがトレーニングセットから正確なポーズや構図を記憶し始める前に停止することです。

IPAdapterが一貫性のゲームを変えた

IPAdapterはLoRAとは異なる問題を解決しましたが、完全なワークフローにとって同様に重要です。LoRAは「このキャラクターは誰か」を処理し、IPAdapterは「このキャラクターは何をしていて、どのように配置されているか」を処理します。

技術的な説明は、IPAdapterがテキストプロンプトやLoRAとは異なるポイントで生成プロセスに画像特徴を注入することです。アイデンティティがLoRAを通じてロックされている場合、アイデンティティをほとんど残しながら、構図、ポーズ、空間関係に影響を与えます。

実際には、これは、LoRAがキャラクターのアイデンティティを維持しながら、必要な正確なポーズを示すリファレンス画像を使用できることを意味します。あなたのキャラクターを胡坐をかいて座らせたい場合は、誰かが胡坐をかいて座っているリファレンスをIPAdapterに供給し、キャラクターLoRAを使用すると、そのポーズであなたのキャラクターが得られます。ポーズはリファレンスから、アイデンティティはLoRAから来ます。

これは、連続したアートやコミックにとって非常に重要です。キャラクターの一貫性を維持しながら、プロンプトで複雑なポーズを説明しようと苦労する必要はありません。リファレンスがポーズを処理し、LoRAがアイデンティティを処理し、プロンプトが表情や着ているものなどの詳細を処理します。

IPAdapterの強度はキャリブレーションが必要です。弱すぎると構図にほとんど影響しません。強すぎるとキャラクターの特徴に影響し始め、LoRAを損ないます。アニメ作業のスイートスポットは、ポーズマッチングがどれだけ厳格である必要があるか、どれだけクリエイティブな解釈が必要かによって、通常0.4〜0.7の強度です。

異なる特性を持つ複数のIPAdapterモデルが存在します。一般的な使用にはIPAdapter Plus、リファレンスから顔の特徴を維持するためのIPAdapter Face(まだLoRAがない場合に便利)、コンテンツとは別に芸術的スタイルを転送するためのIPAdapter Styleです。どのアダプターがどの目的に役立つかを理解することで、それらを組み合わせて層状の制御を行うことができます。

ワークフローは次のようになります:キャラクターアイデンティティにはLoRA、ポーズと構図にはIPAdapter、表情や設定などの詳細にはプロンプト、手の位置や特定のアングルなどの追加の精度にはオプションでControlNet。各システムが最も得意なことを処理し、組み合わせることで、単一のアプローチでは不可能だった制御を生み出します。

- ポーズライブラリから始める: 一般的に必要なさまざまなポーズを示すリファレンス画像のコレクションを構築します

- 強度範囲をテスト: 同じキャラクター、同じポーズリファレンスで、IPAdapterの強度を0.3から0.8まで変化させて、モデルのスイートスポットを見つけます

- 顔と体のリファレンスを分離: 表情を維持するためにIPAdapter Faceを使用し、体のポーズにはIPAdapter Plusを使用します

- ControlNetと組み合わせる: 全体的な構図にはIPAdapter、正確でなければならない詳細にはControlNetを使用します

アニメモデルのプロンプトが異なる理由

SDXLやFluxのようなリアルなモデルから来た場合、アニメモデルのプロンプトは最初は逆に感じます。ルールが異なり、それを無視すると一貫性のない結果が生じます。

booru スタイルのタグでトレーニングされたアニメモデルは、特定のタグ構造を期待しています。キャラクターを定義する特徴は早い段階で、ウェイト修飾子とともに表示される必要があります。「masterpiece」や「best quality」のような一般的な品質タグは、リアルなモデルではほとんどプラセボですが、アニメモデルでは実際に重要です。モデルはそのようにタグ付けされた画像でトレーニングされたため、それらのパターンに応答します。

タグの順序は階層に影響します。一般的に、早いタグは後のタグよりも影響が大きくなります。長いプロンプトの最後にキャラクターの特徴的な特徴を埋めると、それらは弱くなるか無視されます。アイデンティティ情報で先導し、ポーズと設定の詳細で続けます。

(tag:1.4)や[tag:0.8]のようなウェイト修飾子を使用すると、特定の特徴を強調または弱調できます。一貫性のために、キャラクターの独自の特徴を大きくウェイト付けします。「(purple eyes:1.4), (twin drills hairstyle:1.3), (frilly gothic dress:1.2)」は、周囲の詳細よりもそれらの詳細を強くロックします。モデルはウェイト付きタグにより多くの注意を払います。

ネガティブプロンプトは、リアルなモデルよりもアニメモデルにとって重要です。「multiple girls, extra limbs, deformed hands」のような一般的な問題は、明示的な否定が必要です。アニメモデルには、リアルなモデルが持っている解剖学の固有の理解がないため、一般的な失敗からより明示的に導く必要があります。

アーティストタグはスタイルを劇的に変化させますが、過度に使用するとキャラクターの一貫性を損なう可能性があります。アーティストタグは事実上「Xの人のスタイルで描く」と言っており、そのアーティストのスタイルが非常に特徴的である場合、キャラクターの特定のデザインと矛盾する可能性があります。一般的な美的方向にはアーティストタグを使用しますが、一貫性の問題を解決するための松葉杖としては使用しないでください。

一貫性のためのプロンプトエンジニアリングは次のようになります:キャラクターアイデンティティタグを大きくウェイト付け、ポーズと構図を中程度にウェイト付け、設定と詳細を通常のウェイト、品質タグを前面に、包括的なネガティブプロンプト。この構造は、他の要素の変化を許しながら、キャラクターを強化します。

どのベースモデルが一貫性を最もよく処理するか

すべてのアニメモデルが、適切なテクニックを使用してもキャラクターの一貫性を維持するのに等しく優れているわけではありません。ベースモデルは重要です。

Pony Diffusion V6は、強力な一貫性の特性のために特に人気になりました。LoRAトレーニングなしでも、ほとんどの代替案よりも生成全体で特徴をよく維持します。トレードオフは、誰もが好きではない独特の美学を持っていることです。Ponyルックがプロジェクトに機能する場合、一貫性はより簡単に得られます。

無料のComfyUIワークフロー

この記事のテクニックに関する無料のオープンソースComfyUIワークフローを見つけてください。 オープンソースは強力です。

Animagine XLは、より多様な美的スタイルを生成し、おそらくより美しいベースライン出力を生成しますが、一貫性のためにはより慎重なプロンプトが必要です。より柔軟であり、つまり意図したキャラクターからドリフトする余地も増えます。適切なLoRAトレーニングでは優れていますが、プロンプトだけではより困難です。

Anything V5とAnythingシリーズは、信頼できる働き馬であるため、一貫した人気を維持しています。最も派手な出力ではなく、最も多くの機能でもありませんが、安定していて予測可能です。モデルの癖と戦うのではなく、ワークフローに集中したい場合の良い選択です。

NovelAIのモデルは、プラットフォームがキャラクター主導のストーリーテリングに焦点を当てているため、設計により一貫性に優れています。NovelAI Diffusionをローカルで使用している場合、ほとんどの代替案よりも層状の一貫性アプローチに報いられます。モデルは、キャラクターの一貫性を優先事項として明示的にトレーニングされました。

マージモデルは一貫性のために非常に予測不可能です。3つの異なるアニメモデルのカスタムマージは、ゴージャスな1回限りの画像を生成するかもしれませんが、マージされたウェイトが一貫性を可能にする特徴を平均化するため、ひどい一貫性を生じます。キャラクター作業には、よくテストされたベースモデルまたは慎重に検証されたマージに固執してください。

モデルの選択はLoRAトレーニングと相互作用します。AnimagineでトレーニングされたLoRAは、Pony Diffusionで必ずしも機能するわけではなく、その逆も同様です。その特定のモデルの理解の上にトレーニングしています。ベースモデルを切り替えるということは、キャラクターLoRAを再トレーニングする必要があることを意味します。これは煩わしいですが、異なるモデルの美学を実験したい場合は必要です。

初心者の場合は、Pony Diffusion V6から始めてください。許容範囲が広いからです。そこで一貫性ワークフローをマスターしたら、美学がニーズに合わない場合は他のモデルに分岐してください。または、Apatero.comのようなプラットフォームを使用して、最適化されたモデル選択全体でキャラクターの一貫性を維持することにより、モデル選択を抽象化します。

ComfyUIで再利用可能なワークフローを構築する

理論は素晴らしいですが、実践は再利用可能なワークフローを実際に構築することを意味します。一貫したキャラクター生成が実際のComfyUIワークフロー構造としてどのように見えるかを以下に示します。

選択したアニメモデルのチェックポイントローダーから始めます。それをキャラクターLoRAを含むLoRAローダーに接続します。両方がKSamplerに供給されます。これがアイデンティティの基盤です。

画像ロードとサンプラーへのコンディショニングパスの間にIPAdapterノードを追加します。リファレンスポーズ画像は、IPAdapter Model Loaderを通過し、次にIPAdapter Applyに入り、サンプラーに到達する前にコンディショニングを変更します。これにより、構図の制御が追加されます。

ポジティブプロンプトは、慎重に構造化されたタグを使用してCLIP Text Encodeを通過します。キャラクター特徴を高くウェイト付け、ポーズと設定の詳細を通常のウェイト、品質タグを含めます。これにより、アイデンティティが強化され、必要な変化が指定されます。

ネガティブプロンプトも同様に、一般的なアニメモデルの失敗のための包括的なネガティブでエンコードされます。複数のキャラクター、解剖学的問題、品質劣化の用語がすべて否定されます。

サンプラーは、これらすべての入力(ベースモデル、LoRA変更、IPAdapterコンディショニング、テキストプロンプトのポジティブとネガティブ)を、プロンプトとリファレンスに基づいて変化しながら、キャラクターを維持する生成に組み合わせます。

このワークフローをテンプレートとして保存します。次回、異なるシナリオで同じキャラクターが必要な場合は、テンプレートをロードし、IPAdapterリファレンス画像を交換し、新しいシナリオのテキストプロンプトを変更し、生成します。インフラストラクチャは同じままで、変数だけが変化します。これは、一貫性と苦労することから、セッションで複数の一貫したショットを生成することへの移行方法です。

追加の精度が必要な場合は、ControlNetを上に重ねることができます。特定の骨格構造にはOpenPose、正確な空間関係にはDepth、強いエッジコントロールにはCanny。これらは、一貫性スタックの一部を置き換えるのではなく、追加します。

複雑さをスキップしたいですか? Apatero は、技術的なセットアップなしでプロフェッショナルなAI結果を即座に提供します。

LoRAトレーニング用のリファレンスデータセットを構築する方法

LoRAをトレーニングするリファレンス画像は、得られる一貫性を決定します。このデータセットを慎重に構築することで、すべてが簡単になります。

キャラクターコンセプトを示す50〜100枚の候補画像を生成または収集します。これらは、AI生成、委託されたアート、描く場合は自分のスケッチ、またはビジョンに一致する慎重に選択された既存のアートから来る可能性があります。ソースは、セット内の一貫性よりも重要ではありません。

15〜30枚の最高の画像に徹底的にキュレートします。キャラクターを定義する特徴の一貫性を探しながら、他のすべてに変化を持たせます。すべての選択にわたって同じ顔、目、髪、体型。異なるポーズ、表情、衣装、アングル。LoRAは、バリエーション全体で一定のままであるものを学習します。

トレーニングセットの多様性は、柔軟なLoRAを生成します。すべての正面ビューは、プロファイルまたは斜めのアングルで苦労するLoRAをトレーニングします。すべての似た表情は、異なる感情を困難にします。すべて同じ衣装は、衣装を変数にしたいときに、その衣装をキャラクターのアイデンティティに焼き付ける可能性があります。一貫している必要があるものと柔軟である必要があるものについて考えてください。

画像品質は、通常の生成よりもLoRAトレーニングにとって重要です。ぼやけたリファレンス、アーティファクト、解剖学的エラーは、学習され強化されます。クリーンで高品質のリファレンスは、問題を導入しないクリーンなLoRAを生成します。AI生成されたリファレンスを使用している場合は、正しく出てきたものだけを含めてください。

トレーニング設定で自動タグ付けを使用している場合は、リファレンス画像にタグを付けます。一貫した正確なタグは、LoRAがどの特徴がどの概念に対応するかを学習するのに役立ちます。最新のトレーニングツールのほとんどは、尋問モデルを使用して自動タグ付けできますが、それらのタグを手動でレビューおよび修正すると、結果が向上します。

解像度は、リファレンスセット全体で一貫しているか、少なくとも類似している必要があります。非常に異なるサイズの画像でトレーニングすると、学習プロセスが混乱することがあります。512x512または768x768は、アニメLoRAトレーニングの一般的なベース解像度です。より高い解像度で機能しますが、より多くのVRAMとより長いトレーニング時間が必要です。

一貫性に実際に影響するトレーニングパラメータ

LoRAトレーニングには数十のパラメータが含まれますが、ほとんどは結果にほとんど影響しません。これらは、キャラクターの一貫性に実際に影響するものです。

学習率は、LoRAがデータからどれだけ積極的に学習するかを制御します。高すぎると過剰適合し、特定の画像を記憶します。低すぎると不足適合し、有用なものをほとんど学習しません。アニメモデルのキャラクター一貫性の場合、0.0001から0.0005の間の学習率が確実に機能します。0.0002から始めて、結果が弱すぎるか硬直しすぎる場合は調整します。

トレーニングエポックは、トレーニングプロセスがデータセット全体を何回ループするかです。不十分だと弱く、一貫性のないLoRAが得られます。やりすぎると、トレーニング画像を記憶する硬直したLoRAが得られます。15〜30枚の画像データセットの場合、10〜20エポックが通常スイートスポットに当たります。トレーニング中にプレビュー生成を監視して、十分に学習したタイミングをキャッチします。

ネットワーク次元とアルファは、LoRA容量とどれだけ強く適用されるかを制御します。一般的な値は、次元が32または64で、アルファは次元と等しいです。高い値はより表現力豊かなLoRAを与えますが、より多くのトレーニング時間が必要であり、より簡単に過剰適合できます。キャラクターの一貫性のために、32/32または64/64の両方がうまく機能します。高くすることは、通常、このユースケースの結果を改善しません。

バッチサイズは、最終品質よりもトレーニング速度とメモリ使用量に影響します。より大きなバッチはより速くトレーニングしますが、より多くのVRAMが必要です。キャラクター作業の場合、バッチサイズ1〜4が一般的です。品質への影響は小さいため、ハードウェアが処理できるものに基づいてこれを設定します。

オプティマイザーの選択はAdamW、AdamW8bit、その他の間で、主にメモリ使用量と速度に影響します。AdamW8bitは、品質の違いが最小限でVRAMの使用量が少なくなります。特定のエッジケースに最適化していない限り、デフォルトのオプティマイザーはキャラクターLoRAに問題なく機能します。

他のほとんどのパラメータは、賢明なデフォルトのままにできます。トレーニングシステムは、デフォルト値が標準のユースケースに機能するほど成熟しています。あなたは新しい研究をしているのではなく、数千人が以前に行ったプロセスを使用してキャラクターLoRAをトレーニングしています。パラメータを過度に最適化するのではなく、実証済みのレシピに従ってください。

コンテンツ制作で月$1,250以上稼ぐ

独占クリエイターアフィリエイトプログラムに参加。バイラル動画のパフォーマンスに応じて報酬。自分のスタイルで完全な創造的自由を持ってコンテンツを作成。

トレーニングの進行状況をプレビューします。優れたトレーニングツールは、数エポックごとにサンプル画像を生成するため、LoRAの開発を確認できます。プレビューがエポック10〜12までに強いキャラクター特徴が一貫して表示される場合、順調です。エポック20がまだ曖昧に見える場合、データセットまたはパラメータの何かを調整する必要があります。

一般的な一貫性の失敗と実際の修正

適切な技術を使用していても、問題が発生します。実際に何が壊れて、推測せずにそれを修正する方法は次のとおりです。

LoRAにもかかわらず、生成間でキャラクターの特徴がドリフトします。 LoRAのウェイトがおそらく低すぎます。LoRAはデフォルトで強度1.0ですが、キャラクターLoRAを問題なく1.2または1.3にプッシュして、より強い影響を与えることができます。または、ベースプロンプトがキャラクターの特徴を十分に強化していません。特徴的な特性のために大きくウェイト付けされたタグを追加します。

ポーズの変化がキャラクターの一貫性を壊します。 IPAdapterの強度が高すぎて、ポーズとともにアイデンティティに影響しています。0.4〜0.5の範囲に下げます。または、リファレンスポーズ画像が異なる特徴を持つ異なるキャラクターを示し、システムを混乱させています。強い顔の特徴を持たないニュートラルなリファレンスを使用するか、IPAdapterの代わりにOpenPoseのようなポーズのみのControlNetを使用します。

LoRAが同じポーズを繰り返し生成します。 類似しすぎるリファレンス画像で過剰トレーニングしました。LoRAは、キャラクターのアイデンティティとともに構図を記憶しました。より多様なリファレンスポーズで再トレーニングするか、記憶が始まる前に停止するためにトレーニングエポックを減らします。短期的な修正は、LoRAの強度を下げ、多様なポーズのためにより強いプロンプトを使用することです。

キャラクターは一部のアングルでは問題ありませんが、他のアングルでは間違っています。 トレーニングデータセットにアングルの多様性が欠けていました。正面ビューのみでトレーニングした場合、斜めとプロファイルの生成は苦労します。欠落しているアングルを含めて再トレーニングするか、それらのアングルに対してより慎重にプロンプトし、より多くを選択する必要があることを受け入れます。または、欠落しているアングルのリファレンス画像を使用してIPAdapterを使用して生成をガイドします。

正確な衣装やアクセサリーのような詳細が、そうすべきでないときに変化します。 これらの詳細は、トレーニング画像全体で十分に一貫していないか、プロンプトが十分に大きくウェイト付けしていないため、LoRAによって拾われていません。衣装の一貫性のために、すべてのトレーニング画像に衣装の詳細を含めるか、(character-specific-outfit:1.4)のような高いウェイトで衣装の詳細をプロンプトします。アクセサリーは、モデルが無視する可能性のある小さな詳細であるため、特にプロンプトの強化が必要です。

設定を変更したり他のキャラクターを追加すると、キャラクターが完全に変化します。 LoRAが生成の他の概念に比べて弱いです。LoRAの強度を上げます。キャラクターフォーカスを薄めている競合する概念を減らすために、プロンプトを簡素化します。最初に単純な設定でキャラクターを生成してから、一貫したキャラクターを確立した後、複雑な背景を合成またはインペイントします。

デバッグアプローチは、常に変数を分離することです。LoRAのみ、IPAdapterなし、シンプルなプロンプトで生成します。機能しますか?壊れるまで一度に1つの層の複雑さを追加します。それが問題を引き起こしているものを特定します。機能しませんか?問題は追加システムではなく、LoRAまたはベースプロンプトにあります。

マルチキャラクターシーンがすべてを複雑にする方法

1つのキャラクターの一貫性を得ることは十分に困難です。同じシーンで複数の一貫したキャラクターは、難易度を倍増させます。

各キャラクターには、別々にトレーニングされた独自のLoRAが必要です。複数のLoRAを同時にロードしますが、これは機能しますが、どのキャラクターがどの説明を取得するかを指示するために、慎重なプロンプト構造が必要です。リージョナルプロンプターまたはアテンションカップリング技術は、画像の異なる領域に異なるプロンプトを割り当てることで役立ちます。

Latent coupleおよび同様のリージョナル生成メソッドは、生成中に画像を空間的に分割します。左側はキャラクターAのLoRAとプロンプトを取得し、右側はキャラクターBのLoRAとプロンプトを取得します。これにより、LoRAが互いに干渉するのを防ぎますが、キャラクターの位置の慎重な計画が必要です。

キャラクター間の相互作用は、真に困難になるところです。触れているか重なっている場合、リージョナルメソッドが壊れます。複数のパスを実行し、一貫したポーズで各キャラクターを個別に生成してから、両方の一貫性を維持しながら合成またはインペイントを使用してそれらを組み合わせることになります。

マルチキャラクターの一貫性のための実用的なワークフローには、多くの場合、目的のポーズで各キャラクターを個別に生成し、背景除去またはセグメンテーションを使用してそれらをクリーンに抽出し、従来の画像編集ソフトウェアで合成し、最終的なインペイントパスでエッジをブレンドして相互作用の詳細を追加することが含まれます。

プロフェッショナルなコミックまたはビジュアルノベルのワークフローは、基本的に1回のパスで最終的なマルチキャラクターシーンを生成しません。キャラクターレイヤー、背景レイヤー、合成、選択的インペイントを行っています。AIは個々の要素の一貫性を処理し、人間の構図はそれらをコヒーレントに組み合わせることを処理します。すべてを単一の生成に強制しようとすると、一貫性のない結果と無限のフラストレーションが生じます。

これは、管理されたサービスが重要な価値を提供する場所です。Apatero.comのようなプラットフォームは、手動で設定するのに何時間もかかるバックエンドワークフローオーケストレーションを通じて、複雑なマルチキャラクターの一貫性を処理できます。時間がお金である商業プロジェクトの場合、その複雑さの管理は支払う価値があります。

- 個別に生成: シンプルな背景でポーズの各キャラクター

- クリーンにセグメント化: 適切なセグメンテーションを使用して、アーティファクトなしでキャラクターを抽出します

- 意図的に合成: 適切なレイヤー管理を使用して編集ソフトウェアで組み合わせます

- 接続をインペイント: AIインペイントを使用して、合成後に影、接触点、相互作用の詳細を追加します

- 複雑さを受け入れる: マルチキャラクターの一貫性は本当に難しいので、それを体系的に処理するためにワークフローを構造化します

よくある質問

キャラクターLoRAに実際に必要なリファレンス画像の枚数は?

機能的な一貫性のためには、15〜20枚の多様で高品質な画像がうまく機能します。多くの特徴的な要素を持つ非常に複雑なキャラクターデザインを教えようとしている場合を除いて、30枚以上はめったに結果を改善しません。品質と多様性は量よりもはるかに重要です。ある人は、完璧にキュレートされた10枚の画像から優れた結果を報告し、別の人は50枚の似た画像で苦労しました。セット内の一貫性が、LoRAが学習できるものを決定します。

カスタムLoRAをトレーニングせずに一貫性を実現できますか?

すでにLoRAが利用可能な既存の人気キャラクターの場合、はい。オリジナルキャラクターの場合、技術的にはイエスですが、実際にはLoRAをトレーニングするだけで十分にフラストレーションがたまります。IPAdapterと非常に詳細なプロンプトは、大まかな一貫性を維持できますが、適切なLoRAをトレーニングするための2〜3時間よりも多くの時間を戦うことに費やすことになります。LoRAなしの一貫性の上限は、それを使用するよりもはるかに低くなります。

LoRAトレーニングには高価なハードウェアが必要ですか?

12GBのGPUはアニメキャラクターLoRAをトレーニングできますが、ハイエンドカードよりも時間がかかります。ミッドレンジハードウェアで1〜3時間予算します。適切なGPUがない場合、RunPodやVast.aiのようなレンタルサービスを使用すると、トレーニングセッションごとに数ドルで強力なカードをレンタルできます。一部のオンラインサービスは、データセットを提供すれば、LoRAをトレーニングしてくれます。ハードウェア要件を完全に削除しますが、LoRAごとにコストが追加されます。

アートスタイルを変更するとキャラクターの一貫性が壊れるのはなぜですか?

スタイルとアイデンティティは、モデルの学習された表現で絡み合っています。異なるスタイル(プロンプト、LoRA、またはアーティストタグを通じて)に強くプッシュすると、キャラクターのアイデンティティをオーバーライドできます。モデルは複数の競合する概念のバランスを取っており、スタイルタグはしばしば強い影響を持っています。スタイルLoRAをより低い強度で使用するか、ターゲットスタイルですでに例でキャラクターLoRAをトレーニングします。IPAdapter Styleは、キャラクターのアイデンティティに影響を与えずにスタイルを転送するのに役立ちます。

異なるモデルまたはチェックポイント間で一貫性を維持する方法は?

一般的にはしません。LoRAはチェックポイント固有です。AnimagineでトレーニングされたLoRAは、Pony Diffusionで適切に機能しません。ベースモデルを切り替える必要がある場合は、新しいベースでキャラクターLoRAを再トレーニングする必要があります。密接に関連するモデル間でクロスオーバーが機能することがありますが、結果は劣化します。真剣な作業の場合は、プロジェクトの期間中ベースモデルにコミットするか、使用する各モデルの個別のLoRAを維持します。

有名人または既存のキャラクターLoRAを出発点として使用できますか?

技術的には既存のLoRAの上にトレーニングすることでイエスですが、ベースモデルからトレーニングするのと同じくらいうまく機能することはめったにありません。既存のLoRAの学習された特徴が、新しいキャラクターの特徴の学習を妨げます。キャラクターが意図的に既存のキャラクターのバリエーションである場合を除いて、新鮮にトレーニングする方が良いです。その場合、そのキャラクターのLoRAから始めて、上に変更をトレーニングすることがうまく機能します。

とにかく一貫性が失敗したために再生成する必要がある頻度は?

完璧なセットアップでも、生成の10〜30%に何かがずれていて、再生成が必要であることを期待してください。おそらく表情が正しくないか、詳細がドリフトしたか、ポーズがぎこちなく出ました。これは正常です。確率を積み重ねており、保証ではありません。システムは、「90%失敗」から「70〜80%使用可能」への一貫性を劇的に改善しますが、「90%失敗」から「100%完璧」へではありません。反復時間を組み込むことは、ワークフローの一部です。

一貫して使用したい他の人とキャラクターを共有する最良の方法は何ですか?

トレーニングされたLoRAファイル、キャラクターの説明を構造化する方法を示す詳細なプロンプトテンプレート、複数のアングルからキャラクターを示すリファレンス画像、および一般的なネガティブプロンプトを提供します。LoRAはほとんどの重い作業を行いますが、プロンプトアプローチは一貫した結果にとって重要です。一部のクリエイターは、これを1か所にすべての情報を含む「キャラクターカード」としてパッケージ化します。LoRAが他のモデルでは機能しないため、LoRAがトレーニングされたベースモデルを指定します。

ワークフロー維持の現実

キャラクターの一貫性は、一度解決して忘れる問題ではありません。プロジェクトを開発するにつれて維持が必要な継続的な実践です。

キャラクターデザインを洗練するにつれて、LoRAは時々再トレーニングが必要になる場合があります。現在のLoRAで20枚の画像を生成し、進化したビジョンに一致する最高のものをキュレートし、これらを組み込んで再トレーニングします。キャラクターは、反復的なLoRA更新を通じて一貫性を維持しながら、自然に発展できます。

すべてを体系的に保存します。LoRAファイル、トレーニングデータセット、ワークフローテンプレート、プロンプトテンプレート、リファレンス画像。プロジェクトの6か月後に何か新しいものを生成する必要があり、機能していた特定のセットアップを失った場合、ゼロから開始しています。バージョン管理は、コードと同じようにクリエイティブプロジェクトにとって重要です。

各キャラクターに機能するものを文書化します。同じワークフロー構造を使用していても、異なるキャラクターには異なるLoRA強度、IPAdapter設定、またはプロンプトアプローチが必要になる場合があります。それぞれに最良の結果を生み出す設定を記録します。数か月後に思い出そうとすると時間が無駄になります。

一貫性ワークフローは、十分な練習の後に自然になります。最初は、複数の複雑なシステムをジャグリングしているように感じます。いくつかのLoRAをトレーニングし、数百の画像を生成した後、第二の性質になります。LoRA強度、プロンプトウェイト、IPAdapter影響のいつ調整するかについての直感が発達します。失敗パターンを認識し始め、すぐに何を調整するかを知っています。

最も成功したキャラクター主導のAIプロジェクトは、簡単だからではなく、他に何も十分に信頼できるほど機能しないため、これらのテクニックを使用しました。代替案は、不一貫性を受け入れるか、すべてを手動で行うことです。一貫性ワークフローをマスターするために投資された時間は、その後のすべてのキャラクター主導のプロジェクトで報われます。

シンプルに始めましょう。1つのキャラクター、基本的なワークフロー、基本をマスターします。より単純なアプローチが限界に達した場合にのみ、複雑さを追加します。実際のニーズに基づいて、一度にすべてを実装しようとするのではなく、システムを段階的に構築します。学習曲線は現実ですが、それが解き放つ能力はそれを価値のあるものにします。

AIインフルエンサーを作成する準備はできましたか?

115人の学生とともに、51レッスンの完全なコースでComfyUIとAIインフルエンサーマーケティングをマスター。

関連記事

AI不動産写真:住宅販売を加速するバーチャルステージング

AI バーチャルステージングと写真加工で物件リスティングを変革します。1枚0.03ドルのツールから完全なビジュアル改造まで、市場滞在日数を73%削減する方法をご紹介します。

AnimateDiff Lightning - 10倍高速なアニメーション生成ガイド

蒸留モデルを使用したAnimateDiff Lightningで、AIアニメーションを10倍高速に生成し、迅速なイテレーションと効率的な動画作成を実現します

2025年版 Fluxで建築を正確に生成する最良の方法

構造精度、スタイル制御、フォトリアリスティックな建築生成のための実証済みのテクニックを使用して、建築レンダリング用のFlux AIをマスターしましょう。Dev、Schnell、ControlNetメソッドを活用します。