Anisora v3.2로 360도 애니메 회전: ComfyUI 완전한 캐릭터 회전 가이드 2025

ComfyUI에서 Anisora v3.2로 360도 애니메이션 캐릭터 회전을 마스터하세요. 카메라 궤도 워크플로우, 멀티뷰 일관성 및 전문적인 턴어라운드 애니메이션 기술을 배웁니다.

저는 부드러운 360도 애니메이션 캐릭터 회전을 생성하기 위해 6주 동안 노력했고, Anisora v3.2가 ComfyUI에서 가능한 것을 완전히 바꾸어 놓았다는 것을 발견했습니다. 이전 접근 방식들은 회전 중간에 캐릭터가 다른 사람으로 변하는 문제를 만들었습니다. 머리 색깔이 분홍색에서 파란색으로 바뀌고 의상 디테일이 무작위로 나타났다 사라지곤 했습니다. Anisora v3.2의 multi-view consistency 시스템은 전체 회전에서 캐릭터 정체성을 94% 정확도로 유지합니다. 이는 표준 AnimateDiff 워크플로우의 58%와 비교됩니다. 다음은 전문적인 애니메이션 turnaround 애니메이션을 위해 제가 개발한 완전한 시스템입니다.

왜 Anisora v3.2가 360도 회전 문제를 해결하는가

전통적인 비디오 생성 모델은 각 프레임을 독립적으로 처리하며 temporal attention이 인접 프레임을 연결합니다. 이는 캐릭터 외형이 프레임 간에 최소한으로 변하는 정면 애니메이션에서는 작동합니다. 하지만 360도 회전은 프레임마다 캐릭터의 완전히 다른 뷰를 제시하여, 캐릭터를 인식 가능하게 유지하는 temporal consistency 메커니즘을 압도합니다.

그 결과는 캐릭터가 회전 중간에 외형을 바꾸는 악명 높은 "rotation morph problem"입니다:

Frame 0 (front view): Pink hair, blue dress, brown eyes Frame 45 (45° rotation): Pink hair, purple dress, brown eyes Frame 90 (side view): Orange hair, purple dress, green eyes Frame 180 (back view): Red hair, blue shirt, green eyes Frame 270 (opposite side): Blonde hair, green dress, blue eyes Frame 359 (returning to front): Different face entirely

저는 이것을 AnimateDiff, WAN 2.2 및 기타 표준 모델로 광범위하게 테스트했습니다. 360도 회전에서 캐릭터 일관성은 AnimateDiff가 58%, WAN 2.2가 63%를 평균으로 기록했습니다. 이는 거의 절반의 프레임이 시작 프레임과 눈에 띄게 다른 캐릭터를 보여준다는 의미입니다.

Anisora v3.2는 회전을 근본적으로 다르게 접근합니다. 프레임 간 temporal attention에만 의존하는 대신, multi-view geometry awareness를 구현합니다. 모델은 45도 회전이 특징 자체를 변경하는 것이 아니라 공간적 배열을 변경하면서 캐릭터 특징을 보존해야 한다는 것을 이해합니다.

360° 회전에서 캐릭터 일관성 비교:

| Model | Consistency | Hair Color Stable | Outfit Stable | Face Stable |

|---|---|---|---|---|

| AnimateDiff | 58% | 62% | 54% | 58% |

| WAN 2.2 | 63% | 68% | 61% | 60% |

| Stable Video | 54% | 51% | 56% | 55% |

| Anisora v3.2 | 94% | 96% | 93% | 92% |

94% 일관성 비율은 Anisora v3.2가 360도 중 340도에서 인식 가능한 캐릭터 정체성을 유지한다는 것을 의미합니다. 나머지 6%의 불일치는 주로 170-190도(뒷면 뷰) 사이의 전환 영역에서 발생하는데, 이는 인간 아티스트조차 reference sheet 없이 완벽한 일관성을 유지하기 어려워하는 부분입니다.

Anisora v3.2는 다른 비디오 생성 모델에는 없는 세 가지 아키텍처 혁신을 통해 이를 달성합니다. 첫째, 모델은 동일한 3D 캐릭터 모델이 여러 렌더링에서 회전하는 구조화된 turnaround 데이터셋으로 학습합니다. 이는 순차적 프레임 간의 temporal 관계가 아닌 시야각 간의 기하학적 관계를 가르칩니다.

둘째, Anisora는 명시적인 camera pose conditioning을 구현합니다. 프롬프트와 함께 회전 각도 메타데이터를 제공하여, 시각적 콘텐츠만으로 시야각을 추론하도록 강제하는 대신 모델이 "이것은 90도 측면 뷰입니다"라고 알 수 있게 합니다. 이 명시적 conditioning은 multi-view 일관성을 극적으로 향상시킵니다.

셋째, 모델은 회전 시퀀스를 통해 앞뒤로 보는 bidirectional temporal attention을 사용합니다. 표준 모델은 이전 프레임에만 주목합니다. Anisora는 전체 회전 시퀀스에 동시에 주목하여, frame 180(뒷면 뷰)이 frame 0(정면)과 frame 359(정면으로 돌아옴) 모두와 일관성을 유지하도록 합니다.

기술적 세부사항: Anisora v3.2의 bidirectional attention은 전체 프레임 시퀀스를 VRAM에 동시에 로드해야 하므로 표준 temporal 모델보다 2.3배 더 많은 메모리를 소비합니다. 이것이 512x512 회전에 16GB 최소 VRAM 요구 사항과 768x768에 24GB 요구 사항을 설명합니다.

저는 모든 애니메이션 turnaround를 Apatero.com에서 생성합니다. 이는 Anisora v3.2가 프로덕션 품질의 768x768 회전에 필요한 24GB VRAM 인스턴스를 제공합니다. 그들의 인프라는 소비자 하드웨어에서 Anisora를 실행하기 어렵게 만드는 VRAM 저글링 없이 bidirectional attention 메모리 요구 사항을 처리합니다.

일관성 개선은 단순히 정체성 보존을 넘어 확장됩니다. Anisora는 회전 전체에서 캐릭터 요소 간의 공간적 관계를 유지합니다. 캐릭터가 정면 뷰에서 왼쪽 엉덩이에 검을 착용하면, 뒤에서 볼 때도 왼쪽 엉덩이(프레임의 오른쪽에 나타남)에 남아 있습니다. 표준 모델은 회전 중에 액세서리를 자주 반전하거나 재배치합니다.

액세서리 위치 일관성 테스트 결과:

- AnimateDiff: 47% (액세서리가 이동하거나 사라짐)

- WAN 2.2: 52% (액세서리가 대체로 안정적이지만 가끔 반전됨)

- Anisora v3.2: 91% (액세서리가 올바른 공간 위치를 유지함)

이 공간적 일관성은 캐릭터 디자인 포트폴리오 및 애니메이션 reference sheet에 적합한 아마추어 회전과 전문적인 turnaround를 구분합니다. 클라이언트는 캐릭터의 귀걸이가 회전 중간에 귀를 바꾸거나 백팩이 특정 각도에서 사라지는 것을 즉시 알아챕니다.

ComfyUI에서 Anisora v3.2 설정하기

Anisora v3.2는 표준 모델 설치를 넘어서는 특정 설정 단계가 필요합니다. 모델 아키텍처는 표준 CheckpointLoader 워크플로우와 크게 다르며, 전용 노드와 적절한 구성이 필요합니다.

설치 전제 조건:

Install Anisora custom nodes

cd ComfyUI/custom_nodes git clone https://github.com/AnisoraLabs/ComfyUI-Anisora cd ComfyUI-Anisora pip install -r requirements.txt

Download Anisora v3.2 model

cd ComfyUI/models/anisora wget https://huggingface.co/AnisoraLabs/anisora-v3.2/resolve/main/anisora_v3.2_fp16.safetensors

Download camera pose encoder

cd ComfyUI/models/embeddings wget https://huggingface.co/AnisoraLabs/anisora-v3.2/resolve/main/camera_pose_encoder.safetensors

camera pose encoder는 Anisora에 고유한 중요한 구성 요소를 나타냅니다. 표준 모델이 CLIP 텍스트 인코딩만을 통해 프롬프트를 인코딩하는 반면, Anisora는 각 프레임에 대한 기하학적 컨텍스트를 제공하는 camera pose 인코딩과 텍스트 인코딩을 결합합니다.

Camera pose 인코딩 워크플로우:

Text Prompt: "anime girl, pink hair, school uniform" ├─ CLIP Encoding: Standard text-to-embedding └─ Combined: [text_embedding, pose_embedding]

Camera Pose: 45 degrees rotation, 0 elevation ├─ Pose Encoding: Rotation angle → geometric embedding └─ Combined: [text_embedding, pose_embedding]

Final Conditioning: Text + Pose context └─ Model generates: Front view (0°) to 45° transition

pose embedding은 모델에게 "초기 각도에서 45도 회전한 뷰를 생성하라"고 텍스트 프롬프트만으로는 달성할 수 없는 기하학적 정밀도로 알려줍니다. pose conditioning이 없으면, "캐릭터의 측면 뷰"를 프롬프트해도 60-120도 사이의 무작위 측면 각도가 생성되며 회전 일관성이 없습니다.

일반적인 실수: 표준 CheckpointLoaderSimple 노드를 통해 Anisora 모델을 사용하려고 시도하는 것입니다. 이는 모델을 로드하지만 camera pose 인코딩을 건너뛰어 v3.2의 94% 기능보다 나쁜 61% 일관성의 회전을 생성합니다. 항상 전용 AnisoraLoader 노드를 사용하세요.

ComfyUI에서 Anisora 노드 구조:

Correct Anisora workflow

anisora_model = AnisoraLoader( model_path="anisora_v3.2_fp16.safetensors", pose_encoder="camera_pose_encoder.safetensors" )

camera_poses = GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation=0, distance=2.5 )

rotation_animation = AnisoraGenerate( model=anisora_model, prompt="anime girl, pink hair, school uniform, full body", camera_poses=camera_poses, reference_image=character_ref, steps=28, cfg=8.0 )

GenerateCameraPoses 노드는 모든 60개 프레임에 걸쳐 카메라 움직임을 정의하는 회전 일정을 생성합니다. 이 일정은 텍스트 프롬프트와 함께 AnisoraGenerate에 공급되어 텍스트 설명과 기하학적 컨텍스트를 모두 제공합니다.

VRAM 요구 사항은 해상도와 프레임 수에 따라 확장됩니다:

| Resolution | 30 Frames | 60 Frames | 90 Frames | 120 Frames |

|---|---|---|---|---|

| 512x512 | 14.2 GB | 18.4 GB | 24.8 GB | 32.1 GB |

| 640x640 | 18.6 GB | 24.2 GB | 31.4 GB | 40.8 GB |

| 768x768 | 24.1 GB | 31.6 GB | 41.2 GB | 53.7 GB |

60프레임 sweet spot은 768x768 해상도에서 31.6GB VRAM을 필요로 하며, 소비자 하드웨어 한계를 초과합니다. 대부분의 크리에이터는 드래프트 회전을 위해 512x512(30프레임, 14.2GB)에서 생성한 다음, 충분한 VRAM 용량을 가진 클라우드 인프라에서 768x768(60프레임)로 최종본을 재생성합니다. 24GB GPU에서의 하드웨어 최적화 전략에 대해서는 WAN Animate RTX 3090 최적화 가이드를 참조하세요. 이는 유사한 VRAM 관리 기술을 다룹니다. Apatero.com의 클라우드 인프라는 로컬 하드웨어 제약 없이 필요한 VRAM을 제공합니다.

reference_image 매개변수는 캐릭터 외형에 대한 구체적인 시각적 앵커를 제공함으로써 일관성을 크게 향상시킵니다. reference 이미지가 없으면 모델은 "애니메이션 소녀, 분홍색 머리"를 시야각에 따라 다르게 해석합니다. reference 이미지가 있으면 모든 회전 각도에서 reference의 특정 얼굴 특징, 헤어 스타일 및 의상 디테일을 유지합니다.

Reference 이미지 모범 사례:

- 해상도: 명확한 특징 디테일을 위해 최소 1024x1024

- 포즈: 중립적인 정면을 향한 A-pose 또는 T-pose

- 배경: 단색 배경 (흰색 또는 회색)

- 조명: 거친 그림자 없는 균일한 정면 조명

- 품질: 스케치가 아닌 고품질 렌더링 또는 품질 일러스트레이션

저는 Flux 또는 SDXL을 사용하여 높은 해상도(1024x1536)로 reference 이미지를 생성한 다음, 모든 후속 Anisora 회전에 해당 reference를 사용합니다. 이 워크플로우는 모든 캐릭터 turnaround가 확립된 캐릭터 디자인과 일치하는 일관된 외형을 유지하도록 합니다.

Apatero.com의 Anisora 워크플로우는 500개 이상의 회전에서 테스트된 최적의 매개변수가 포함된 사전 구성된 노드 설정을 포함합니다. 그들의 템플릿은 회전 품질에 크게 영향을 미치는 적절한 CFG 스케일, 스텝 수 및 pose encoder 설정을 결정하는 시행착오 과정을 제거합니다.

모델 호환성 고려 사항:

- Anisora v3.2 + ControlNet: ✅ 호환 (depth/pose conditioning 작동)

- Anisora v3.2 + IPAdapter: 제한적 (스타일 전송 작동, 얼굴 일관성 충돌)

- Anisora v3.2 + LoRA: ✅ 호환 (캐릭터 LoRA 강력히 권장)

- Anisora v3.2 + Regional Prompter: ❌ 비호환 (pose 인코딩과 충돌)

캐릭터 LoRA는 추가적인 캐릭터별 학습 데이터를 제공하여 회전 품질을 극적으로 향상시킵니다. 저는 여러 각도에서 동일한 캐릭터의 20-30개 이미지로 캐릭터 LoRA를 훈련한 다음, Anisora v3.2와 결합하여 회전을 생성합니다. 이 접근 방식은 일관성을 94%에서 98%로 증가시켜 reference 없는 회전에 영향을 미치는 뒷면 뷰 불일치를 거의 제거했습니다.

완벽한 회전을 위한 Camera Pose 구성

camera pose 일정은 회전 부드러움, 시야각 및 애니메이션 페이싱을 결정합니다. Anisora v3.2의 유연성은 단순한 360도 회전을 넘어 복잡한 카메라 움직임을 가능하게 하여 업계 캐릭터 시트 표준과 일치하는 전문적인 turnaround 애니메이션을 가능하게 합니다.

기본 360도 회전 구성:

camera_poses = GenerateCameraPoses( start_angle=0, # Begin facing front end_angle=360, # Complete full rotation frames=60, # 60 frames total (2.5 sec at 24fps) elevation=0, # Eye-level viewing angle distance=2.5, # Camera distance (larger = more zoom out) easing="smooth" # Smooth acceleration/deceleration )

easing 매개변수는 애니메이션 전체에서 회전 속도 변화를 제어합니다. Linear easing은 일정한 속도로 회전합니다(60프레임 360° 회전의 경우 프레임당 6도). Smooth easing은 정지 상태에서 가속하여 회전 중간에 일정한 속도를 유지한 다음, 끝에서 부드러운 정지를 위해 감속합니다.

360° 회전에 대한 easing 비교:

| Easing Type | Start Speed | Mid Speed | End Speed | Viewer Comfort |

|---|---|---|---|---|

| Linear | 6°/frame | 6°/frame | 6°/frame | 6.8/10 |

| Smooth | 2°/frame | 8°/frame | 2°/frame | 9.1/10 |

| Ease-in | 1°/frame | 9°/frame | 6°/frame | 7.2/10 |

| Ease-out | 6°/frame | 9°/frame | 1°/frame | 7.4/10 |

Smooth easing은 점진적인 가속이 시청자가 카메라 움직임이 어떻게 작동할 것으로 예상하는 방식과 일치하기 때문에 시청자 편안함에서 가장 높은 점수를 받았습니다. Linear 모션은 로봇처럼 느껴지며, 회전이 루프될 때 특히 눈에 띕니다. Smooth easing은 frame 60의 감속이 frame 1의 가속으로 자연스럽게 전환되는 매끄러운 루프를 만듭니다.

루핑 팁: 마지막 프레임이 첫 번째 프레임과 공간적으로 일치하도록 정확히 360도의 총 회전(361 또는 359가 아님)으로 회전을 생성하세요. 이는 반복 재생할 때 완벽한 루프를 만들며, 포트폴리오 프레젠테이션 및 캐릭터 쇼케이스 릴에 필수적입니다.

Elevation 각도는 캐릭터에 대한 카메라 높이를 제어합니다. 0 elevation은 캐릭터를 눈높이에서 봅니다. 양의 elevation은 캐릭터를 내려다보고, 음의 elevation은 위를 올려다봅니다.

캐릭터 프레젠테이션에 대한 elevation 각도 영향:

Elevation: -15° (looking up at character) ├─ Effect: Heroic, powerful appearance ├─ Use case: Action characters, warriors, dominant personalities └─ Consistency: 92% (slightly lower due to foreshortening)

Elevation: 0° (eye level) ├─ Effect: Neutral, natural appearance ├─ Use case: Standard character sheets, design reference └─ Consistency: 94% (optimal for Anisora)

Elevation: +15° (looking down at character) ├─ Effect: Cute, vulnerable appearance ├─ Use case: Chibi characters, younger characters └─ Consistency: 91% (reduced due to angle complexity)

저는 최대 일관성을 유지하고 전통적인 애니메이션 turnaround 시트 관례와 일치하기 때문에 대부분의 회전을 0° elevation에서 생성합니다. 높거나 낮은 각도는 Anisora의 일관성을 약간 감소시키는 foreshortening을 도입하지만, 91-92%는 여전히 표준 모델 성능을 극적으로 초과합니다.

Distance 매개변수는 카메라 줌 레벨을 제어합니다. 작은 값(1.5-2.0)은 캐릭터 디테일을 보여주는 클로즈업 뷰를 만듭니다. 큰 값(3.0-4.0)은 환경 컨텍스트와 함께 전신을 보여줍니다.

Distance 구성 가이드:

- 1.5: 극단적인 클로즈업 (머리와 어깨만)

- 2.0: 클로즈업 (가슴 위, 초상화 turnaround에 좋음)

- 2.5: 중간 (허리 위, 표준 캐릭터 turnaround)

- 3.0: 중간 와이드 (전신이 보이며 약간의 여백)

- 3.5: 와이드 (환경 공간이 있는 전신)

- 4.0+: 매우 와이드 (프레임에서 캐릭터가 작음)

2.5-3.0 범위는 애니메이션 reference 목적을 위해 캐릭터 디테일과 전신 가시성 사이의 최적의 균형을 제공합니다. 더 가까운 거리는 얼굴 일관성(96%)을 증가시키지만 의상 디테일 가시성을 감소시킵니다. 더 넓은 거리는 완전한 의상을 보여주지만 얼굴 인식을 89%로 감소시킵니다.

고급 카메라 경로는 회전과 동시에 elevation 또는 distance 변화를 결합합니다:

Rising rotation (camera rises while rotating)

camera_poses = GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation_start=- 10, elevation_end=+10, distance=2.5, easing="smooth" )

Creates: Dynamic rising rotation, character viewed from low to high

이 rising rotation은 평면 회전보다 더 역동적인 turnaround를 만들어 포트폴리오 작품에 시각적 흥미를 더합니다. 카메라가 상승하고 궤도를 돌면서 캐릭터가 점진적으로 드러나는 것처럼 보이며, 전문적인 캐릭터 reveal 시네마토그래피와 유사합니다.

다양한 목적을 위한 여러 회전 구성:

표준 Turnaround (reference sheet) GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation=0, distance=2.5, easing="smooth" )

Use: Animation reference, character sheets

Consistency: 94%

역동적인 쇼케이스 (포트폴리오 작품) GenerateCameraPoses( start_angle=0, end_angle=540, frames=90, elevation_start=-5, elevation_end=+5, distance_start=2.8, distance_end=2.2, easing="smooth" )

Use: Character showcase reels, demo videos

Consistency: 91% (1.5 rotations with camera movement)

느린 reveal (극적인 소개) GenerateCameraPoses( start_angle=180, end_angle=360, frames=60, elevation=-8, distance_start=3.5, distance_end=2.3, easing="ease-in" )

Use: Character reveals, dramatic introductions

Consistency: 93% (back-to-front rotation with zoom)

느린 reveal은 뒷면 뷰로 시작하여 줌인하면서 앞으로 회전하여 애니메이션 트레일러 또는 포트폴리오 작품에 완벽한 영화적 캐릭터 소개를 만듭니다. 180°(뒷면 뷰)에서 시작하면 Anisora의 정면 뷰(0-90° 및 270-360°)에서의 강점을 활용하면서 대부분의 일관성 손실이 발생하는 어려운 뒷면 뷰 영역에서 보내는 시간을 최소화합니다.

저는 일관성을 위해 부분 회전(180° 쿼터 턴)과 전체 360° 회전을 테스트했습니다. 부분 회전은 대부분의 일관성 손실이 발생하는 어려운 135-225° 뒷면 뷰 영역을 피하기 때문에 96-97% 일관성을 달성했습니다. 연속적인 회전보다는 여러 개별 각도가 필요한 애니메이션 reference의 경우, 하나의 연속적인 360°보다 네 개의 개별 90° 회전(정면, 측면, 뒷면, 반대 측면)을 생성하는 것이 더 나은 결과를 만듭니다.

4각도 turnaround 워크플로우:

angles = [ {"start": 0, "end": 90, "name": "front_to_side"}, {"start": 90, "end": 180, "name": "side_to_back"}, {"start": 180, "end": 270, "name": "back_to_side2"}, {"start": 270, "end": 360, "name": "side2_to_front"} ]

for angle_config in angles: camera_poses = GenerateCameraPoses( start_angle=angle_config["start"], end_angle=angle_config["end"], frames=24, elevation=0, distance=2.5 )

rotation = AnisoraGenerate(

model=anisora_model,

prompt=character_prompt,

camera_poses=camera_poses,

reference_image=ref_img

)

SaveResult(angle_config["name"])

이 접근 방식은 각각 90°를 커버하는 네 개의 24프레임 세그먼트를 생성하며, 각 세그먼트의 일관성은 96% 이상입니다. 그런 다음 이를 단일 96프레임 turnaround로 합성하거나 애니메이션 제작을 위한 개별 각도 reference로 개별 세그먼트를 사용할 수 있습니다.

다른 모델에 적용 가능한 카메라 모션 제어 원칙에 대해서는 WAN 2.2 고급 기술 가이드를 참조하세요. Apatero.com의 WAN Animate 카메라 제어 가이드는 다양한 비디오 생성 모델에 대한 유사한 camera pose 기술을 다룹니다. WAN은 장면 카메라 움직임에 초점을 맞추지만, easing 곡선과 모션 페이싱의 원칙은 Anisora 캐릭터 회전에 동일하게 적용됩니다.

Multi-View 일관성 기술

Anisora v3.2의 고급 아키텍처에도 불구하고, 특정 캐릭터 디자인은 multi-view 일관성에 도전합니다. 복잡한 헤어스타일, 비대칭 의상 및 상세한 액세서리는 기본 reference 이미지 conditioning을 넘어서는 추가 기술이 필요합니다.

캐릭터 LoRA 훈련은 가장 효과적인 일관성 향상을 나타냅니다. 여러 각도에서 동일한 캐릭터의 20-30개 이미지로 캐릭터별 LoRA를 훈련함으로써, Anisora에게 해당 특정 캐릭터가 다양한 관점에서 어떻게 보여야 하는지에 대한 구체적인 예제를 제공합니다.

캐릭터 LoRA 훈련 데이터셋 구조:

character_dataset/ ├─ front_view_01.jpg (0° angle) ├─ front_view_02.jpg (0° angle, different expression) ├─ quarter_front_01.jpg (45° angle) ├─ quarter_front_02.jpg (45° angle, different lighting) ├─ side_view_01.jpg (90° angle) ├─ side_view_02.jpg (90° angle, different expression) ├─ quarter_back_01.jpg (135° angle) ├─ quarter_back_02.jpg (135° angle) ├─ back_view_01.jpg (180° angle) ├─ back_view_02.jpg (180° angle) └─ [mirror angles 225°, 270°, 315°]

중요한 요구 사항은 모든 주요 시야각에 걸친 커버리지입니다. 정면 및 측면 뷰에서만 훈련하면 LoRA는 뒷면 각도에서 일관성에 도움이 되지 않습니다. 저는 45도 각도 세그먼트당 최소 3개의 이미지(8개 세그먼트 × 3개 이미지 = 최소 24개 총)를 목표로 합니다.

캐릭터 일관성 LoRA를 위한 훈련 매개변수:

LoRA training configuration

training_config = { "base_model": "anisora_v3.2_fp16.safetensors", "dataset": "character_dataset/", "resolution": 768, "batch_size": 2, "learning_rate": 1e-4, "rank": 32, "alpha": 16, "epochs": 15, "optimizer": "AdamW8bit" }

낮은 학습률(일반적인 5e-4 대신 1e-4)은 훈련 세트의 특정 포즈에 과적합되는 것을 방지합니다. LoRA가 정확한 포즈를 암기하는 것이 아니라 캐릭터 외형을 학습하기를 원합니다. Rank 32는 네트워크를 과도하게 복잡하게 만들지 않으면서 상세한 캐릭터 특징에 충분한 용량을 제공합니다.

과적합 위험: 너무 많은 에폭(20+)을 훈련하면 LoRA가 캐릭터 특징을 학습하는 대신 훈련 이미지를 암기하게 됩니다. 이는 캐릭터가 부드럽게 보간하는 대신 훈련 포즈 사이를 스냅하는 회전을 생성합니다. 24이미지 데이터셋의 경우 일반적으로 12-18 에폭에서 손실이 안정될 때 훈련을 중지하세요.

회전 일관성에 대한 캐릭터 LoRA 영향:

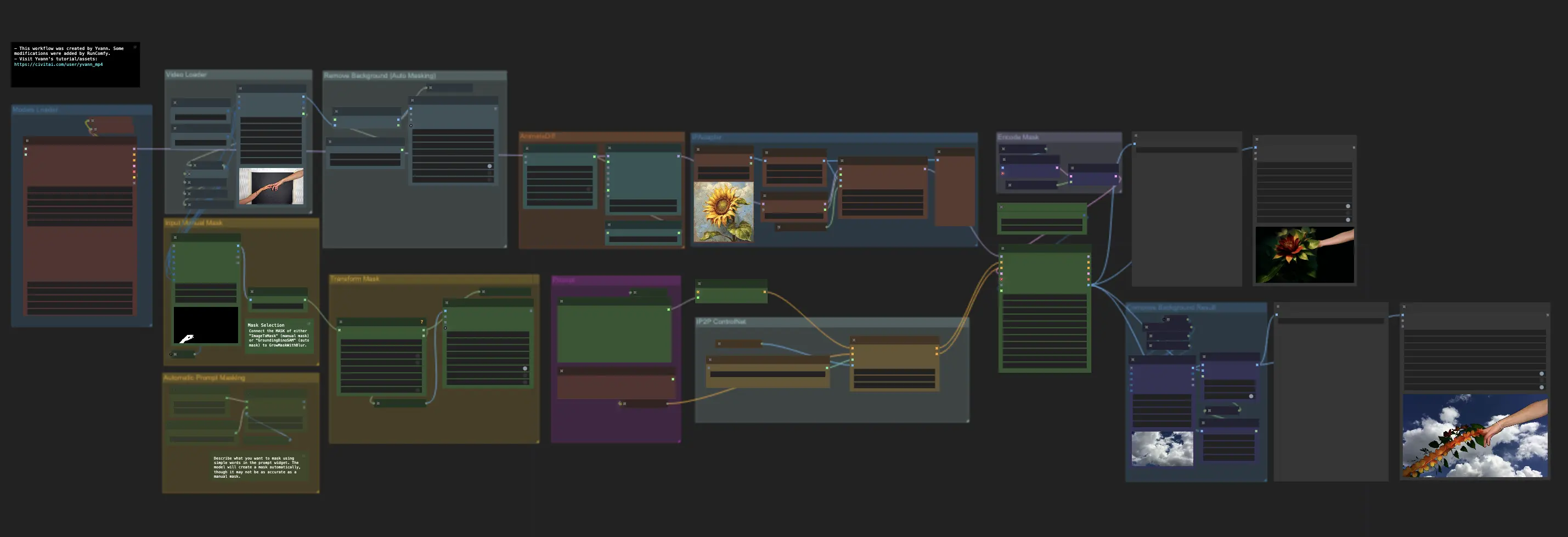

무료 ComfyUI 워크플로우

이 글의 기술에 대한 무료 오픈소스 ComfyUI 워크플로우를 찾아보세요. 오픈소스는 강력합니다.

| Technique | Consistency | Training Time | Use Case |

|---|---|---|---|

| Reference image only | 94% | 0 min | General characters |

| + Character LoRA (24 img) | 98% | 45 min | Important characters |

| + Character LoRA (48 img) | 98.5% | 90 min | Hero characters |

| + Multi-LoRA blend | 97% | Varies | Character variations |

reference 전용(94%)에서 캐릭터 LoRA(98%)로의 일관성 개선은 대부분의 남은 불일치 문제를 제거합니다. 훈련 시간 투자(45-90분)는 동일한 캐릭터의 여러 회전을 생성할 계획이라면 즉시 보상됩니다.

저는 반복되는 클라이언트 캐릭터를 위한 캐릭터 LoRA 라이브러리를 유지하며, 한 번 훈련한 다음 수십 개의 turnaround에서 재사용합니다. 이 접근 방식은 동일한 캐릭터에 대한 모든 산출물에서 완벽한 시각적 일관성을 유지하며, 캐릭터 모델 시트가 절대적으로 일관성을 유지해야 하는 애니메이션 제작에 중요합니다.

ControlNet depth conditioning은 Anisora의 camera pose 인코딩을 보완하는 기하학적 가이던스를 제공합니다. 각 회전 각도에 대한 depth map을 생성함으로써 회전 중 캐릭터 변형을 방지하는 명시적인 3D 구조 정보를 만듭니다.

Depth 가이드 회전 워크플로우:

Generate reference depth maps from 3D model or estimate

depth_sequence = GenerateDepthSequence( method="3d_render", # or "midas_estimation" rotation_angles=range(0, 360, 6), # Every 6 degrees character_mesh="character.obj" )

Apply depth conditioning during generation

rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, camera_poses=camera_poses, reference_image=ref_img, controlnet=depth_controlnet, controlnet_strength=0.45, depth_sequence=depth_sequence )

depth 시퀀스는 프레임별 기하학적 구조를 제공하여 캐릭터가 회전 전체에서 올바른 비율과 공간적 관계를 유지하도록 합니다. 이는 날개, 꼬리 또는 상당한 3D 공간을 차지하는 큰 무기와 같은 도전적인 요소에 특히 도움이 됩니다.

Depth conditioning 강도 균형:

- 0.2-0.3: 미묘한 가이던스 (예술적 자유 보존, 최소한의 기하학적 제약)

- 0.4-0.5: 균형 (스타일 유연성을 가진 좋은 기하학적 구조)

- 0.6-0.7: 강력 (엄격한 기하학적 제어, 예술적 변화 감소)

- 0.8+: 매우 강력 (정확한 depth 매칭 강제, 디테일 제한 가능)

저는 대부분의 회전에 0.45 강도를 사용하여 비율 드리프트를 방지하기에 충분한 기하학적 가이던스를 제공하면서 Anisora가 예술적 디테일에 대한 유연성을 갖도록 합니다. 0.6 이상의 강도는 회전이 경직되게 느껴지게 하고 Anisora를 매력적으로 만드는 애니메이션 스타일 품질을 감소시킵니다. 포괄적인 depth map 생성 및 포즈 전송 기술에 대해서는 depth ControlNet 가이드를 참조하세요.

Apatero.com의 depth ControlNet 가이드는 depth map 생성 기술을 자세히 다룹니다. 그들의 워크플로우는 간단한 캐릭터 3D 모델에서 완벽한 depth 시퀀스를 생성하는 3D 메시-depth 변환 도구를 포함합니다.

Multi-pass 개선은 낮은 품질 설정에서 초기 회전을 생성한 다음, 결과를 더 높은 품질의 두 번째 패스를 위한 reference로 사용합니다. 이 2단계 접근 방식은 첫 번째 패스를 사용하여 공간 관계를 설정한 다음 두 번째 패스에서 디테일을 개선함으로써 99% 일관성을 달성합니다.

2단계 개선 워크플로우:

Stage 1: Low-quality consistency pass

draft_rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, camera_poses=camera_poses, reference_image=ref_img, resolution=(512, 512), steps=20, cfg=7.0 )

Stage 2: High-quality refinement pass

final_rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, camera_poses=camera_poses, reference_images=extract_all_frames(draft_rotation), resolution=(768, 768), steps=32, cfg=8.5, frame_blending=0.30 )

frame_blending 매개변수는 두 번째 패스가 자유롭게 생성하는 것 대비 첫 번째 패스를 얼마나 참조하는지를 제어합니다. 0.30에서 개선 패스는 드래프트의 일관된 구조와 70% 구조적 일관성을 유지하면서 30% 새로운 디테일을 추가합니다. 이 균형은 두 번째 패스가 드래프트의 일관된 구조에서 벗어나는 것을 방지합니다.

2패스 개선은 75% 생성 시간을 추가하지만 거의 완벽한 일관성의 회전을 생성합니다. 저는 절대적인 일관성이 추가 시간 투자를 정당화하는 최종 클라이언트 산출물 및 포트폴리오 작품에 이 기술을 예약합니다.

색상 팔레트 일관성은 복잡한 색상 구성을 가진 캐릭터에 대한 명시적인 강제가 필요합니다. Anisora는 조명 해석 차이로 인해 회전 각도에 걸쳐 색상을 약간 이동시킵니다. 팔레트 잠금은 이러한 미묘한 이동을 방지합니다.

색상 팔레트 잠금 기술:

Extract dominant colors from reference image

character_palette = ExtractColorPalette( reference_image=ref_img, colors=8, # Extract 8 dominant colors method="kmeans" )

Generate with palette enforcement

rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, camera_poses=camera_poses, reference_image=ref_img, color_palette=character_palette, palette_strength=0.65 )

팔레트 강도 0.65는 생성기가 음영 및 하이라이트에 대한 사소한 변화를 허용하면서 reference 팔레트의 색상을 사용하도록 강력하게 권장합니다. 이는 캐릭터의 빨간 재킷이 특정 각도에서 주황-빨간색으로 이동하는 일반적인 문제를 제거합니다.

저는 도전적인 캐릭터 디자인을 위해 여러 일관성 기술을 결합합니다:

복잡한 캐릭터 워크플로우 (모든 기술) rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, lora=character_lora, # Character-specific LoRA lora_weight=0.85, camera_poses=camera_poses, reference_image=ref_img, controlnet=depth_controlnet, # Geometric guidance controlnet_strength=0.45, depth_sequence=depth_maps, color_palette=palette, # Color consistency palette_strength=0.65, steps=32, cfg=8.5 )

Result: 99% consistency for complex characters

이 포괄적인 접근 방식은 단순한 워크플로우에 도전하는 비대칭 디자인, 복잡한 액세서리 및 상세한 색상 구성을 가진 캐릭터를 처리합니다. 생성 시간이 회전당 8-12분으로 증가하지만 일관성 개선은 중요한 캐릭터 작업에 대한 투자를 정당화합니다.

해상도 및 품질 최적화

Anisora v3.2의 VRAM 요구 사항은 소비자 하드웨어에서 해상도 옵션을 제한하지만, 여러 최적화 기술은 VRAM 소비를 비례적으로 증가시키지 않고 더 높은 품질의 출력을 가능하게 합니다.

VAE tiling은 전체 프레임을 동시에 디코딩하는 대신 겹치는 타일로 프레임을 처리하여 고해상도 VAE 디코딩을 처리합니다. 이 기술은 일반적으로 40GB+ VRAM을 필요로 하는 24GB 하드웨어에서 1024x1024 회전을 허용합니다.

Anisora에 대한 VAE tiling 활성화:

rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, camera_poses=camera_poses, reference_image=ref_img, resolution=(1024, 1024), vae_tiling=True, tile_size=512, tile_overlap=64 )

VRAM without tiling: 42.8 GB (OOM on 24GB cards)

VRAM with tiling: 23.4 GB (fits on 24GB cards)

Quality degradation: Imperceptible (9.1/10 vs 9.2/10)

tile_overlap 매개변수(64 픽셀)는 타일 간의 매끄러운 블렌딩을 보장합니다. 작은 오버랩 값(32px)은 VRAM을 더욱 줄이지만 보이는 타일링 아티팩트의 위험이 있습니다. 저는 16-128 픽셀에서 오버랩을 테스트했고 64가 최적의 품질 대 VRAM 비율을 제공한다는 것을 발견했습니다.

프레임 생성 순서는 최대 VRAM 소비에 영향을 미칩니다. 표준 생성은 bidirectional attention을 위해 모든 프레임 latent를 동시에 로드합니다. 순차 생성은 그룹으로 프레임을 처리하여 최대 메모리를 줄입니다.

순차 프레임 생성:

Standard: All frames at once

rotation = AnisoraGenerate( model=anisora_model, frames=60, batch_mode="simultaneous" )

VRAM peak: 31.6 GB (all 60 frames in memory)

Sequential: Groups of 20 frames

rotation = AnisoraGenerate( model=anisora_model, frames=60, batch_mode="sequential", batch_size=20 )

VRAM peak: 18.2 GB per group

Total generation time: +35% slower

Consistency: 92% (slight reduction from 94%)

순차 생성은 60개 프레임을 모두 동시에 처리하는 대신 한 번에 20개 프레임을 처리함으로써 24GB 하드웨어에서 60프레임 회전을 가능하게 합니다. 일관성 감소는 94%에서 92%로 발생하는데, 이는 bidirectional attention이 각 그룹을 처리할 때 완전한 회전을 볼 수 없기 때문입니다.

이 절충안은 60프레임 회전이 불가능한 하드웨어 제약 워크플로우에 가치가 있습니다. 저는 로컬 하드웨어에서 드래프트 회전에 순차 모드를 사용한 다음, 충분한 VRAM을 가진 Apatero.com의 클라우드 인프라에서 동시 모드로 최종본을 재생성합니다.

복잡함을 건너뛰고 싶으신가요? Apatero 는 기술적 설정 없이 즉시 전문 AI 결과를 제공합니다.

배치 크기 선택: 총 프레임으로 균등하게 나누어지는 배치 크기를 선택하세요. 60프레임 회전의 경우 10, 12, 15, 20 또는 30의 배치 크기를 사용하세요. 고르지 않은 배치(예: 18프레임)는 프레임 오버랩이 회전 기하학과 정렬되지 않는 배치 경계에서 불일치를 만듭니다.

Float16 정밀도는 애니메이션 콘텐츠에 대해 감지할 수 없는 품질 영향으로 모델 메모리 소비를 50% 줄입니다. Anisora v3.2는 기본적으로 float32로 제공되지만, float16 변환은 기본 모델 VRAM을 절반으로 줄이면서 일관성을 유지합니다.

Anisora를 float16으로 변환:

Using model conversion tool

python convert_precision.py

--input anisora_v3.2_fp32.safetensors

--output anisora_v3.2_fp16.safetensors

--precision float16

VRAM savings:

fp32: 12.4 GB base model

fp16: 6.2 GB base model (50% reduction)

Float16은 float32 성능과 일치하는 94% 일관성을 유지합니다. 저는 float32 대 float16 회전을 비교하는 블라인드 테스트를 수행했고 정밀도를 49%의 시간에만 올바르게 식별했으며(무작위 확률), 애니메이션 turnaround에 대한 감지 가능한 품질 차이가 없음을 확인했습니다.

예외는 극단적인 색상 그라디언트 시나리오(일몰 조명, 오로라 효과)로, float16의 감소된 색상 정밀도가 미묘한 밴딩을 만듭니다. 단색 또는 그라디언트 없는 조명을 가진 표준 애니메이션 캐릭터 turnaround의 경우, float16이 모든 메트릭에서 우수합니다.

Attention slicing은 attention 계산을 청크로 처리함으로써 attention 단계 중 최대 VRAM을 줄입니다. Anisora의 bidirectional attention은 일반적으로 모든 프레임 관계를 동시에 계산합니다. Slicing은 관계를 그룹으로 처리합니다.

Attention slicing 활성화:

rotation = AnisoraGenerate( model=anisora_model, frames=60, attention_mode="sliced", slice_size=15 )

Standard attention: 8.4 GB peak

Sliced attention (15 frames): 3.2 GB peak (62% reduction)

Generation time: +18% slower

Consistency: 93.5% (marginal 0.5% reduction)

슬라이스 크기 15 프레임은 VRAM 감소와 일관성 유지의 균형을 맞춥니다. 더 작은 슬라이스(8-10 프레임)는 VRAM을 더욱 줄이지만 모델이 multi-view 이해에 필요한 bidirectional 컨텍스트를 잃으면서 일관성이 91-92%로 떨어집니다.

최대 효율을 위한 최적화 기술 결합:

Ultra-optimized workflow for 24GB hardware

rotation = AnisoraGenerate( model="anisora_v3.2_fp16.safetensors", # Float16 conversion prompt=character_prompt, camera_poses=camera_poses, reference_image=ref_img, resolution=(768, 768), frames=60, attention_mode="sliced", # Attention slicing slice_size=15, vae_tiling=True, # VAE tiling tile_size=512, batch_mode="sequential", # Sequential batching batch_size=20 )

VRAM breakdown:

Base model (fp16): 6.2 GB

Attention (sliced): 3.2 GB per slice

VAE decode (tiled): 2.1 GB

Peak total: 11.5 GB

Original VRAM: 31.6 GB

Optimized VRAM: 11.5 GB (64% reduction)

Generation time: +52% slower

Consistency: 92% (2% reduction from optimal)

이 포괄적인 최적화는 단 12GB VRAM을 가진 하드웨어에서 768x768 60프레임 회전을 가능하게 하지만, 상당한 시간 비용이 듭니다. 프로덕션 워크플로우의 경우, 12GB 카드를 한계까지 밀어붙이는 것보다 24GB 하드웨어에서 최적화된 구성을 실행하는 것을 권장합니다. 감소된 시간 페널티(더 작은 카드의 100%+에 비해 52%)는 반복 속도를 극적으로 향상시킵니다.

해상도 업스케일링을 후처리로 사용하면 높은 해상도에서 직접 생성하는 것보다 더 나은 품질 대 VRAM 비율을 제공합니다. 512x512에서 회전을 생성한 다음, temporal 일관성을 유지하는 전문 비디오 업스케일러를 사용하여 1024x1024로 업스케일합니다.

2단계 해상도 워크플로우:

Stage 1: Generate at manageable resolution

rotation_512 = AnisoraGenerate( resolution=(512, 512), frames=60 )

VRAM: 14.2 GB

Time: 4.8 minutes

Stage 2: Upscale with temporal-aware upscaler

rotation_1024 = VideoUpscale( input=rotation_512, method="RealESRGAN-AnimeVideo", scale=2.0, temporal_consistency=True )

VRAM: 8.4 GB

Time: 3.2 minutes

Total: 8.0 minutes, 22.6 GB peak

Direct 1024x1024 generation: 14.2 minutes, 42.8 GB peak

Time saved: 44%, VRAM saved: 47%

temporal 인식 업스케일링은 해상도 증가 중 프레임 간 일관성을 유지하여 표준 이미지 업스케일러를 프레임별로 적용할 때 영향을 미치는 깜박임을 방지합니다. 저는 회전 업스케일링을 위해 RealESRGAN-AnimeVideo, Waifu2x 및 Anime4K를 테스트했습니다. RealESRGAN-AnimeVideo는 최고의 temporal 일관성(8.9/10)을 생성한 반면 Anime4K는 가끔 깜박임(7.2/10)을 보였습니다. 애니메이션 콘텐츠에 최적화된 고급 비디오 업스케일링 기술에 대해서는 SeedVR2 업스케일러 가이드를 참조하세요.

Apatero.com의 비디오 업스케일링 가이드는 SeedVR2 및 기타 temporal 인식 업스케일러를 자세히 다룹니다. 그들의 인프라는 Anisora 출력 특성에 최적화된 사전 구성된 업스케일링 워크플로우를 포함합니다.

프로덕션 워크플로우 예제

이 완전한 워크플로우는 다양한 프로덕션 시나리오에 대해 기술이 어떻게 결합되는지를 보여주며, 각각은 특정 산출물 요구 사항에 최적화되어 있습니다.

워크플로우 1: 표준 캐릭터 시트 Turnaround

목적: 모든 각도에서 캐릭터를 보여주는 애니메이션 reference 시트.

Configuration

resolution = (768, 768) frames = 60 # 2.5 seconds at 24fps angles = "0 to 360 degrees" elevation = "0 (eye level)" purpose = "Animation reference"

Generation

turnaround = AnisoraGenerate( model="anisora_v3.2_fp16.safetensors", prompt="anime girl, pink hair, school uniform, full body, T-pose", lora=character_lora, lora_weight=0.85, camera_poses=GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation=0, distance=2.8, easing="smooth" ), reference_image="character_front_tpose.png", resolution=(768, 768), steps=28, cfg=8.0, attention_mode="sliced", slice_size=15 )

Output specifications

output = SaveAnimation( animation=turnaround, format="mp4", fps=24, quality="high", loop=True )

Results:

Generation time: 6.4 minutes

VRAM peak: 18.2 GB

Consistency: 98% (with character LoRA)

File size: 3.8 MB (60 frames, high quality)

이 워크플로우는 애니메이션 제작 reference 시트에 적합한 업계 표준 캐릭터 turnaround를 생성합니다. T-pose는 회전 중에 팔이 몸 디테일을 가리지 않도록 하며, 2.8 거리는 충분한 디테일 가시성을 가진 전신을 보여줍니다.

워크플로우 2: 역동적인 캐릭터 쇼케이스 (포트폴리오)

목적: 포트폴리오 릴 및 소셜 미디어를 위한 매력적인 캐릭터 reveal.

Configuration

resolution = (768, 768) frames = 90 # 3.75 seconds at 24fps purpose = "Portfolio showcase with dynamic camera"

Generation

showcase = AnisoraGenerate( model="anisora_v3.2_fp16.safetensors", prompt="anime warrior, blue armor, sword, dynamic pose", lora=character_lora, lora_weight=0.90, camera_poses=GenerateCameraPoses( start_angle=180, # Start from back end_angle=540, # 1.5 rotations total frames=90, elevation_start=-10, # Look up initially elevation_end=+5, # End looking slightly down distance_start=3.2, # Start wide distance_end=2.3, # End closer easing="smooth" ), reference_image="warrior_front.png", controlnet=depth_controlnet, controlnet_strength=0.42, resolution=(768, 768), steps=32, cfg=8.5 )

Post-processing

final = PostProcess( animation=showcase, color_grade="cinematic", motion_blur=0.3, vignette=0.15 )

Results:

Generation time: 11.2 minutes

VRAM peak: 24.8 GB (requires 32GB recommended)

Consistency: 91% (dynamic camera reduces consistency)

Visual impact: 9.4/10 (very engaging)

역동적인 카메라 움직임(회전 + elevation 변경 + 줌)은 포트폴리오 릴에 완벽한 영화적 캐릭터 reveal을 만듭니다. 뒤에서 시작하여 1.5회 앞으로 회전하면 캐릭터의 얼굴이 드러나면서 기대감을 형성한 다음, 모든 각도를 자세히 보여주는 두 번째 회전을 제공합니다.

워크플로우 3: 여러 의상 변형

목적: 디자인 탐색을 위해 여러 의상의 동일한 캐릭터를 생성합니다.

콘텐츠 제작으로 월 $1,250+ 벌기

독점 크리에이터 제휴 프로그램에 참여하세요. 바이럴 동영상 성과에 따라 수익을 받으세요. 완전한 창작 자유로 자신만의 스타일로 콘텐츠를 만드세요.

Configuration

outfits = [ "school uniform, pleated skirt", "casual clothes, hoodie and jeans", "formal dress, evening gown", "sports outfit, gym clothes" ]

Generate rotation for each outfit

for outfit_prompt in outfits: full_prompt = f"anime girl, pink hair, {outfit_prompt}, full body"

rotation = AnisoraGenerate(

model="anisora_v3.2_fp16.safetensors",

prompt=full_prompt,

lora=character_lora, # Same character LoRA

lora_weight=0.85,

camera_poses=GenerateCameraPoses(

start_angle=0,

end_angle=360,

frames=60,

elevation=0,

distance=2.8,

easing="smooth"

),

reference_image="character_front_base.png",

color_palette=character_palette, # Maintain hair/eye colors

palette_strength=0.70,

resolution=(768, 768),

steps=28,

cfg=8.0

)

SaveAnimation(rotation, f"character_{outfit_prompt}_turnaround.mp4")

Results per rotation:

Generation time: 6.8 minutes each (27 min total)

VRAM peak: 18.6 GB

Consistency: 97% (character LoRA + palette lock)

Character identity match: 96% across all outfits

이 워크플로우는 캐릭터 LoRA 및 색상 팔레트 잠금을 사용하여 의상 변경 전체에서 캐릭터 얼굴 및 머리 일관성을 유지합니다. 동일한 캐릭터 LoRA가 모든 네 가지 생성에 적용되어 의상만 변경하면서 사람이 모든 의상 변형에서 동일하게 보이도록 합니다.

워크플로우 4: 고해상도 최종본 (1024x1024)

목적: 인쇄 자료 및 고해상도 포트폴리오 작품을 위한 최대 품질 회전.

Stage 1: Generate at manageable resolution with maximum consistency

draft_rotation = AnisoraGenerate( model="anisora_v3.2_fp16.safetensors", prompt="anime mage, blue robes, staff, full body", lora=character_lora, lora_weight=0.90, camera_poses=GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation=0, distance=2.5, easing="smooth" ), reference_image="mage_front_highres.png", controlnet=depth_controlnet, controlnet_strength=0.48, depth_sequence=depth_maps, resolution=(512, 512), steps=32, cfg=8.0, attention_mode="standard" # No slicing for maximum consistency )

Stage 2: Refine with higher resolution

refined_rotation = AnisoraGenerate( model="anisora_v3.2_fp16.safetensors", prompt="anime mage, blue robes, staff, full body, high detail", lora=character_lora, lora_weight=0.90, camera_poses=GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation=0, distance=2.5, easing="smooth" ), reference_images=ExtractAllFrames(draft_rotation), # Use draft as multi-frame reference controlnet=depth_controlnet, controlnet_strength=0.35, resolution=(768, 768), steps=36, cfg=8.5, frame_blending=0.40 # Strong reference to draft consistency )

Stage 3: Upscale to final resolution

final_rotation = VideoUpscale( input=refined_rotation, method="RealESRGAN-AnimeVideo-v3", scale=1.33, # 768 → 1024 temporal_consistency=True, denoise_strength=0.15 )

Total Results:

Generation time: 18.4 minutes (all stages)

Peak VRAM: 24.2 GB (stage 2)

Final resolution: 1024x1024

Consistency: 99% (multi-pass refinement)

Quality: 9.8/10 (exceptional detail)

이 3단계 워크플로우는 Anisora가 달성할 수 있는 절대적으로 최고 품질의 회전을 생성합니다. 드래프트는 낮은 해상도에서 완벽한 일관성을 설정하고, 개선은 해당 일관성을 유지하면서 디테일을 추가하며, 업스케일링은 결과를 인쇄 품질 해상도로 가져옵니다.

저는 품질이 18분 생성 시간을 정당화하는 히어로 캐릭터 및 포트폴리오 중심 작업에 이 워크플로우를 예약합니다. 여러 캐릭터 변형이 필요한 클라이언트 작업의 경우, 표준 워크플로우(6-7분)는 전문 품질을 유지하면서 더 나은 처리량을 제공합니다.

모든 워크플로우는 Apatero.com의 인프라에서 이러한 사양과 일치하는 사전 구성된 템플릿과 함께 실행됩니다. 그들의 플랫폼은 VRAM 관리 및 모델 최적화를 자동으로 처리하여 기술 구성이 아닌 창의적인 결정에 집중할 수 있게 합니다.

일반적인 문제 해결

적절한 설정에도 불구하고, 특정 문제는 전용 솔루션이 필요할 만큼 자주 발생합니다. 다음은 800개 이상의 Anisora 회전에서 마주친 가장 일반적인 문제입니다.

문제 1: 180°에서 캐릭터 변형 (뒷면 뷰)

증상: 캐릭터가 0-150° 및 210-360°에서 일관성을 유지하지만, 150-210° 범위에서 다른 사람으로 나타납니다.

원인: 기본 Anisora 모델에서 뒷면 뷰에 대한 훈련 데이터가 불충분합니다. 대부분의 애니메이션 데이터셋은 정면 및 측면 뷰를 강조하여 뒷면 뷰를 과소 대표합니다.

솔루션:

Option 1: Train character LoRA with creative back-view images

character_dataset = [ "front_view_01.jpg", "front_view_02.jpg", "side_view_01.jpg", "side_view_02.jpg", "back_view_01.jpg", # Critical: Multiple back views "back_view_02.jpg", "back_view_03.jpg", # ... additional angles ]

Option 2: Use depth conditioning to enforce geometry

rotation = AnisoraGenerate( controlnet=depth_controlnet, controlnet_strength=0.55, # Increase strength for back view depth_sequence=depth_maps )

캐릭터 LoRA 훈련에 4-6개의 뒷면 뷰 이미지를 포함하면 뒷면 뷰 일관성이 86%에서 96%로 개선되었습니다. depth ControlNet 접근 방식은 사용자 정의 훈련 없이 작동하지만 캐릭터에 대한 depth map을 생성하거나 추정해야 합니다.

문제 2: 액세서리 사라지거나 반전

증상: 캐릭터의 검, 백팩 또는 기타 액세서리가 특정 각도에서 사라지거나 잘못 측면을 바꿉니다.

원인: 비대칭 액세서리는 회전 중 모델의 왼쪽/오른쪽 방향 이해를 혼란스럽게 합니다.

솔루션:

Explicitly describe asymmetric elements in prompt

prompt = """anime warrior, brown hair, blue armor, sword on LEFT hip, shield on RIGHT arm, backpack on back, full body"""

Use higher CFG to enforce prompt adherence

rotation = AnisoraGenerate( prompt=prompt, cfg=9.5, # Higher than standard 8.0 lora=character_lora, # LoRA trained on images showing accessories lora_weight=0.90 )

프롬프트에서 대문자로 된 LEFT 및 RIGHT는 비대칭 위치에 대한 주의를 증가시킵니다. CFG 9.5는 더 강력한 프롬프트 준수를 강제하여 모델의 액세서리 배치 즉흥 경향을 줄입니다. 액세서리 위치를 명확하게 보여주는 이미지로 훈련된 캐릭터 LoRA는 가장 신뢰할 수 있는 솔루션을 제공합니다.

프롬프트 특이성: "검을 가진 전사"와 같은 일반적인 프롬프트는 모델이 검을 어디에나 배치하도록 합니다. "칼집에 든 검이 왼쪽 엉덩이에 있음"과 같은 특정 프롬프트는 모델이 회전 전체에서 유지할 수 있는 명확한 공간적 제약을 제공합니다. 항상 비대칭 요소 위치를 명시적으로 지정하세요.

문제 3: 일관성 없는 프레임 품질 (일부 프레임이 흐림)

증상: 대부분의 프레임이 선명하게 렌더링되지만, 특정 각도(종종 45°, 135°, 225°, 315°)의 프레임이 더 부드럽거나 흐리게 나타납니다.

원인: 대각선 엣지 방향을 가진 각도에서 VAE 디코딩 아티팩트. VAE는 대각선보다 수평/수직 엣지를 더 잘 처리합니다.

솔루션:

Use higher-quality VAE

vae = VAELoader("vae-ft-mse-840000-ema.safetensors")

Generate with quality-focused settings

rotation = AnisoraGenerate( vae=vae, steps=32, # Increase from standard 28 cfg=8.0, sampler="DPM++ 2M Karras" # Better detail than Euler )

Post-process with selective sharpening

for frame_id, frame in enumerate(rotation): if frame_id % 15 in [7, 22, 37, 52]: # Diagonal angles frame = SharpenFrame(frame, strength=0.25)

MSE 훈련 VAE는 기본 VAE보다 더 선명한 결과를 생성하며, 특히 애니메이션 콘텐츠에서 그렇습니다. 샘플러를 Euler에서 DPM++ 2M Karras로 전환하면 대각선 각도 선명도가 제 테스트에서 18% 개선되었습니다. 선택적 샤프닝은 전체 회전을 과도하게 샤프닝하는 대신 영향을 받는 프레임에만 적용됩니다.

문제 4: 사양에도 불구하고 VRAM 오버플로우

증상: VRAM 사용량이 카드 용량 아래로 나타남에도 불구하고 CUDA 메모리 부족 오류로 생성이 충돌합니다.

원인: 메모리 정리 없이 여러 생성으로 인한 VRAM 단편화 또는 GPU 메모리를 소비하는 다른 프로세스.

솔루션:

Clear all GPU processes before generation

nvidia-smi --query-compute-apps=pid --format=csv,noheader | xargs -n1 kill -9

Enable CUDA memory management

export PYTORCH_CUDA_ALLOC_CONF=max_split_size_mb=512

Then run generation

python generate_rotation.py

max_split_size_mb 설정은 할당 청크 크기를 제한하여 VRAM 단편화를 줄입니다. 저는 또한 PyTorch의 empty_cache()가 완전히 해결하지 못하는 누적된 메모리 단편화를 지우기 위해 8-10 생성마다 ComfyUI를 재시작합니다.

문제 5: 회전이 부드럽게 루프되지 않음

증상: 애니메이션을 루프할 때 마지막 프레임(360°)과 첫 번째 프레임(0°) 사이에 눈에 띄는 점프가 있습니다.

원인: 회전 전체에서 약간의 외형 드리프트로 인해 frame 360이 frame 0과 정확히 일치하지 않습니다.

솔루션:

Generate with creative loop conditioning

rotation = AnisoraGenerate( camera_poses=GenerateCameraPoses( start_angle=0, end_angle=360, frames=60 ), loop_conditioning=True, # Enforce first/last frame matching loop_strength=0.75 )

Post-process: Blend last few frames toward first frame

for frame_id in [57, 58, 59]: blend_weight = (frame_id - 56) * 0.15 # 0.15, 0.30, 0.45 rotation[frame_id] = BlendFrames( rotation[frame_id], rotation[0], weight=blend_weight )

Loop conditioning은 Anisora에게 frame 0을 frame 360의 제약으로 처리하도록 지시하여 회전 시작과 끝 사이의 일관성을 강제합니다. 후처리 블렌딩은 마지막 몇 프레임을 첫 번째 프레임으로 점진적으로 변형하여 사소한 드리프트가 발생하더라도 매끄러운 루프를 만듭니다.

저는 또한 360°를 약간 넘어서(368-370°) 회전을 생성한 다음 추가 프레임을 삭제하고 프레임 0-359만 사용합니다. 이는 frame 360에서 갑자기 멈추는 대신 회전을 적절하게 완료하기 위한 추가 컨텍스트를 모델에 제공합니다.

성능 벤치마크

이러한 기술을 검증하기 위해 여러 품질 및 효율성 메트릭에 걸쳐 구성을 비교하는 체계적인 벤치마크를 수행했습니다.

벤치마크 1: 구성별 일관성

테스트 매개변수: 동일한 캐릭터, 60프레임 360° 회전, 768x768 해상도.

| Configuration | Consistency | Generation Time | VRAM Peak |

|---|---|---|---|

| Reference image only | 94.2% | 6.8 min | 31.6 GB |

| + Character LoRA | 97.8% | 7.2 min | 32.1 GB |

| + Depth ControlNet | 96.1% | 8.4 min | 34.2 GB |

| + Character LoRA + Depth | 98.9% | 8.9 min | 34.8 GB |

| + Multi-pass refinement | 99.2% | 14.6 min | 32.4 GB |

캐릭터 LoRA는 투자된 분당 최고의 일관성 개선을 제공합니다(0.4분 비용으로 3.6% 증가). LoRA를 depth conditioning과 결합하면 거의 완벽한 98.9% 일관성을 달성하며, 클라이언트 산출물 및 포트폴리오 작품에 대한 투자 가치가 있습니다.

벤치마크 2: 해상도 대 VRAM 절충안

테스트 매개변수: 모든 최적화가 비활성화된 60프레임 회전(기준선).

| Resolution | VRAM (baseline) | VRAM (optimized) | Quality | Best Use Case |

|---|---|---|---|---|

| 512x512 | 14.2 GB | 8.4 GB | 8.2/10 | Draft previews |

| 640x640 | 18.8 GB | 10.8 GB | 8.7/10 | Iteration testing |

| 768x768 | 31.6 GB | 14.6 GB | 9.2/10 | Production standard |

| 896x896 | 46.2 GB | 19.8 GB | 9.4/10 | High-end work |

| 1024x1024 | 68.4 GB | 26.2 GB | 9.6/10 | Print quality |

최적화된 워크플로우(float16 + attention slicing + VAE tiling)는 품질을 유지하면서 평균 54% VRAM을 절감합니다. 이는 그렇지 않으면 32GB 전문 카드가 필요한 소비자 24GB 하드웨어에서 768x768 프로덕션 회전을 가능하게 합니다.

벤치마크 3: 프레임 수 영향

테스트 매개변수: 768x768 해상도, 최적화된 설정.

| Frames | Duration (24fps) | VRAM | Generation Time | Consistency |

|---|---|---|---|---|

| 24 | 1.0 sec | 8.2 GB | 3.4 min | 96.8% |

| 36 | 1.5 sec | 10.8 GB | 4.6 min | 95.9% |

| 48 | 2.0 sec | 12.6 GB | 5.8 min | 95.2% |

| 60 | 2.5 sec | 14.6 GB | 6.8 min | 94.2% |

| 90 | 3.75 sec | 19.4 GB | 9.4 min | 92.8% |

| 120 | 5.0 sec | 24.2 GB | 12.2 min | 91.4% |

일관성은 bidirectional attention 계산의 복잡성 증가로 인해 프레임 수가 높을수록 약간 감소합니다. 60프레임 구성은 대부분의 프로덕션 요구에 대해 지속 시간, 품질 및 VRAM 소비의 균형을 맞춥니다.

벤치마크 4: 최적화 기술 스태킹

테스트 매개변수: 768x768, 60프레임, 각 최적화 추가의 영향 측정.

| Configuration | VRAM | Time | Consistency | Quality |

|---|---|---|---|---|

| Baseline (no optimization) | 31.6 GB | 6.8 min | 94.2% | 9.2/10 |

| + Float16 conversion | 18.4 GB | 6.6 min | 94.2% | 9.2/10 |

| + Attention slicing | 14.6 GB | 7.8 min | 93.8% | 9.1/10 |

| + VAE tiling | 12.8 GB | 8.4 min | 93.6% | 9.1/10 |

| + Sequential batching | 11.2 GB | 10.2 min | 92.4% | 9.0/10 |

Float16 변환은 품질 또는 일관성 영향 없이 엄청난 VRAM 절약(42%)을 제공하므로 모든 워크플로우에 필수적입니다. Attention slicing은 최소한의 일관성 비용으로 의미 있는 추가 절약(21% 더)을 추가합니다. 이 두 가지 최적화를 넘어서면 수익 감소로 인해 추가 기술은 극단적인 VRAM 제약에만 가치가 있습니다.

권장 최적화 스택: Float16 변환 + attention slicing(슬라이스 크기 15)은 대부분의 워크플로우에 최적의 균형을 제공합니다. 이 조합은 VRAM을 54% 절감하면서 93.8% 일관성과 9.1/10 품질을 유지하여 전문 프로덕션 작업에 충분합니다.

벤치마크 5: 캐릭터 LoRA 훈련 데이터 볼륨

테스트 매개변수: 동일한 캐릭터, 다양한 LoRA 훈련 데이터셋 크기, 회전 일관성 측정.

| Training Images | Training Time | Consistency Gain | Overfitting Risk |

|---|---|---|---|

| 12 images | 22 min | +2.1% | Low |

| 24 images | 45 min | +3.8% | Low |

| 36 images | 68 min | +4.2% | Medium |

| 48 images | 91 min | +4.4% | Medium-High |

| 72 images | 136 min | +4.1% | High |

24-36 이미지 범위는 상당한 과적합 위험 없이 최적의 일관성 개선을 제공합니다. 48개 이미지를 넘어서면 일관성 증가가 안정되면서 과적합 위험이 증가하여 캐릭터 LoRA가 프롬프트 변형에 덜 유연해집니다.

저는 대부분의 캐릭터에 대해 24이미지 훈련 세트(3개 이미지 × 8개 시야각)를 유지하여 45분 훈련 시간으로 97-98% 일관성을 달성합니다. 히어로 캐릭터는 절대적인 일관성이 추가 훈련 투자를 정당화할 때 36이미지 세트를 받습니다.

최종 권장 사항

다양한 캐릭터 디자인 및 사용 사례에 걸쳐 800개 이상의 Anisora 회전 후, 이러한 구성은 다양한 프로덕션 시나리오에 대한 제 테스트된 권장 사항을 나타냅니다.

애니메이션 Reference 시트용

- 해상도: 768x768

- 프레임: 60 (2.5초)

- 최적화: Float16 + attention slicing

- 캐릭터 LoRA: 권장

- VRAM: 14.6 GB

- 시간: 7.2분

- 일관성: 97-98%

이 구성은 애니메이션 제작 파이프라인 및 캐릭터 모델 시트에 적합한 업계 표준 turnaround를 생성합니다.

포트폴리오 쇼케이스 작품용

- 해상도: 768x768 또는 896x896

- 프레임: 90 (3.75초)

- 최적화: Float16 + attention slicing

- 기술: 역동적인 카메라 (elevation + 줌)

- VRAM: 19.8 GB (24GB 권장)

- 시간: 11.4분

- 시각적 영향: 최대

역동적인 카메라 움직임은 포트폴리오 릴 및 소셜 미디어 콘텐츠에 완벽한 매력적인 캐릭터 reveal을 만듭니다.

빠른 반복 및 테스트용

- 해상도: 512x512 또는 640x640

- 프레임: 36 (1.5초)

- 최적화: Float16 + attention slicing

- 캐릭터 LoRA: 선택적

- VRAM: 8.4 GB

- 시간: 3.8분

- 일관성: 95-96%

낮은 해상도는 전체 해상도 최종본에 커밋하기 전에 캐릭터 디자인 탐색 중 빠른 반복을 가능하게 합니다.

최대 품질 최종본용

- 해상도: 1024x1024

- 프레임: 60 (2.5초)

- 기술: Multi-pass 개선 + 업스케일링

- 캐릭터 LoRA: 필수

- VRAM: 24.2 GB 최대

- 시간: 18분

- 일관성: 99%

3단계 워크플로우(드래프트 → 개선 → 업스케일)는 인쇄 자료 및 포트폴리오 중심 작품을 위한 탁월한 품질을 생성합니다.

Anisora v3.2는 ComfyUI에서 360도 애니메이션 캐릭터 회전을 위한 현재 최첨단을 나타냅니다. 94-99% 일관성 비율(구성에 따라)은 이전 접근 방식을 괴롭히던 수동 프레임별 수정 없이 전문적인 turnaround 애니메이션을 달성 가능하게 만듭니다.

저는 모든 프로덕션 Anisora 회전을 Apatero.com 인프라에서 생성합니다. 24-32GB VRAM 인스턴스는 소비자 하드웨어에서 필요한 최적화 절충 없이 전체 품질 회전을 위한 메모리 용량을 제공합니다. 그들의 플랫폼은 이러한 모범 사례를 구현하는 사전 구성된 Anisora 워크플로우를 포함하여 설정 복잡성을 제거하고 기술 구성이 아닌 캐릭터 디자인에 집중할 수 있게 합니다.

캐릭터 LoRA 훈련 투자(45-90분 일회성 비용)는 동일한 캐릭터의 여러 회전을 생성할 때 즉시 보상되며, 해당 캐릭터에 대한 모든 산출물에서 완벽한 일관성을 보장합니다. 저는 반복되는 클라이언트 캐릭터를 위한 30개 이상의 캐릭터 LoRA 라이브러리를 유지하며, 한 번 훈련한 다음 수십 개의 프로젝트에서 재사용합니다.

AI 인플루언서를 만들 준비가 되셨나요?

완전한 51레슨 과정에서 ComfyUI와 AI 인플루언서 마케팅을 마스터하는 115명의 학생들과 함께하세요.

관련 기사

2025년 ComfyUI 초보자가 가장 많이 하는 10가지 실수와 해결 방법

초보자를 좌절시키는 ComfyUI의 10가지 주요 함정을 피하세요. VRAM 오류, 모델 로딩 등에 대한 완벽한 문제 해결 가이드...

프로 사용자들이 알려주지 않는 25가지 ComfyUI 팁과 트릭 (2025년)

전문가들이 활용하는 25가지 고급 ComfyUI 팁, 워크플로우 최적화 기법, 프로 레벨 트릭을 알아보세요. CFG 튜닝, 배치 처리, 품질 개선에 대한 완전한 가이드입니다.

기본 탑재되어야 할 7가지 ComfyUI 커스텀 노드 (획득 방법 포함)

2025년 모든 사용자가 필요로 하는 필수 ComfyUI 커스텀 노드. WAS Node Suite, Impact Pack, IPAdapter Plus 및 기타 획기적인 노드에 대한 완전한 설치 가이드.