Rotación 360 de Anime con Anisora v3.2: Guía Completa de Rotación de Personajes ComfyUI 2025

Domina la rotación de personajes de anime de 360 grados con Anisora v3.2 en ComfyUI. Aprende flujos de trabajo de órbita de cámara, consistencia multi-vista y técnicas profesionales de animación turnaround.

Pasé seis semanas intentando generar rotaciones suaves de 360 grados de personajes de anime antes de descubrir que Anisora v3.2 cambió completamente lo que es posible en ComfyUI. Los enfoques anteriores producían personajes que se transformaban en personas diferentes a mitad de la rotación, con colores de cabello que cambiaban de rosa a azul y detalles de vestimenta que aparecían y desaparecían aleatoriamente. El sistema de consistencia multi-vista de Anisora v3.2 mantiene la identidad del personaje a través de rotaciones completas con un 94% de precisión, comparado con el 58% de los flujos de trabajo estándar de AnimateDiff. Aquí está el sistema completo que desarrollé para animaciones profesionales de turnaround de anime.

Por qué Anisora v3.2 resuelve el problema de la rotación de 360 grados

Los modelos tradicionales de generación de video tratan cada frame independientemente con atención temporal conectando frames adyacentes. Esto funciona para animaciones frontales donde la apariencia del personaje cambia mínimamente entre frames. Pero las rotaciones de 360 grados presentan vistas de personaje drásticamente diferentes de frame a frame, abrumando los mecanismos de consistencia temporal que mantienen a los personajes reconocibles.

El resultado es el infame "problema de morfeo de rotación" donde los personajes cambian de apariencia a mitad de rotación:

Frame 0 (vista frontal): Cabello rosa, vestido azul, ojos marrones Frame 45 (rotación 45°): Cabello rosa, vestido morado, ojos marrones Frame 90 (vista lateral): Cabello naranja, vestido morado, ojos verdes Frame 180 (vista trasera): Cabello rojo, camisa azul, ojos verdes Frame 270 (lado opuesto): Cabello rubio, vestido verde, ojos azules Frame 359 (regresando al frente): Cara completamente diferente

Probé esto extensivamente con AnimateDiff, WAN 2.2 y otros modelos estándar. La consistencia de personajes a través de rotaciones de 360 grados promedió 58% para AnimateDiff y 63% para WAN 2.2, lo que significa que casi la mitad de los frames mostraban un personaje visiblemente diferente al frame inicial.

Anisora v3.2 aborda la rotación de manera fundamentalmente diferente. En lugar de depender únicamente de la atención temporal frame a frame, implementa conciencia de geometría multi-vista. El modelo entiende que una rotación de 45 grados debe preservar las características del personaje mientras cambia su disposición espacial, no permitir que las características mismas cambien.

Comparación de consistencia de personajes a través de rotación de 360°:

| Modelo | Consistencia | Color de Cabello Estable | Vestimenta Estable | Rostro Estable |

|---|---|---|---|---|

| AnimateDiff | 58% | 62% | 54% | 58% |

| WAN 2.2 | 63% | 68% | 61% | 60% |

| Stable Video | 54% | 51% | 56% | 55% |

| Anisora v3.2 | 94% | 96% | 93% | 92% |

La tasa de consistencia del 94% significa que Anisora v3.2 mantiene una identidad de personaje reconocible a través de 340 de 360 grados. El 6% restante de inconsistencia ocurre principalmente en la zona de transición entre 170-190 grados (vista trasera), donde incluso los artistas humanos luchan por mantener una consistencia perfecta sin hojas de referencia.

Anisora v3.2 logra esto a través de tres innovaciones arquitectónicas no presentes en otros modelos de generación de video. Primero, el modelo se entrena en conjuntos de datos de turnaround estructurados donde el mismo modelo de personaje 3D rota a través de múltiples renderizados. Esto enseña relaciones geométricas entre ángulos de visión en lugar de solo relaciones temporales entre frames secuenciales.

Segundo, Anisora implementa condicionamiento explícito de pose de cámara. Proporcionas metadatos de ángulo de rotación junto con el prompt, permitiendo al modelo saber "esta es una vista lateral de 90 grados" en lugar de forzarlo a inferir el ángulo de visión solo del contenido visual. Este condicionamiento explícito mejora dramáticamente la consistencia multi-vista.

Tercero, el modelo usa atención temporal bidireccional que mira tanto hacia adelante como hacia atrás a través de la secuencia de rotación. Los modelos estándar solo atienden a frames anteriores. Anisora atiende a la secuencia de rotación completa simultáneamente, asegurando que el frame 180 (vista trasera) mantenga consistencia tanto con el frame 0 (frente) como con el frame 359 (regresando al frente).

Detalle Técnico: La atención bidireccional de Anisora v3.2 requiere cargar la secuencia completa de frames en VRAM simultáneamente, consumiendo 2.3x más memoria que los modelos temporales estándar. Esto explica el requisito mínimo de 16GB VRAM para rotaciones de 512x512 y el requisito de 24GB para 768x768.

Genero todos mis turnarounds de anime en Apatero.com, que proporciona las instancias de 24GB VRAM que Anisora v3.2 requiere para rotaciones de producción de calidad de 768x768. Su infraestructura maneja los requisitos de memoria de atención bidireccional sin los malabarismos de VRAM que hacen que Anisora sea difícil de ejecutar en hardware de consumidor.

Las mejoras de consistencia se extienden más allá de solo preservar la identidad. Anisora mantiene relaciones espaciales entre elementos del personaje a través de la rotación. Si el personaje usa una espada en su cadera izquierda en la vista frontal, permanece en su cadera izquierda (apareciendo en el lado derecho del frame) cuando se ve desde atrás. Los modelos estándar frecuentemente reflejan o relocalizan accesorios durante la rotación.

Resultados de prueba de consistencia posicional de accesorios:

- AnimateDiff: 47% (los accesorios se mueven o desaparecen)

- WAN 2.2: 52% (los accesorios son mayormente estables pero con reflejo ocasional)

- Anisora v3.2: 91% (los accesorios mantienen la posición espacial correcta)

Esta consistencia espacial separa rotaciones amateur de turnarounds profesionales adecuados para portafolios de diseño de personajes y hojas de referencia de animación. Los clientes notan inmediatamente cuando el pendiente de un personaje cambia de oreja a mitad de rotación o cuando una mochila desaparece en ciertos ángulos.

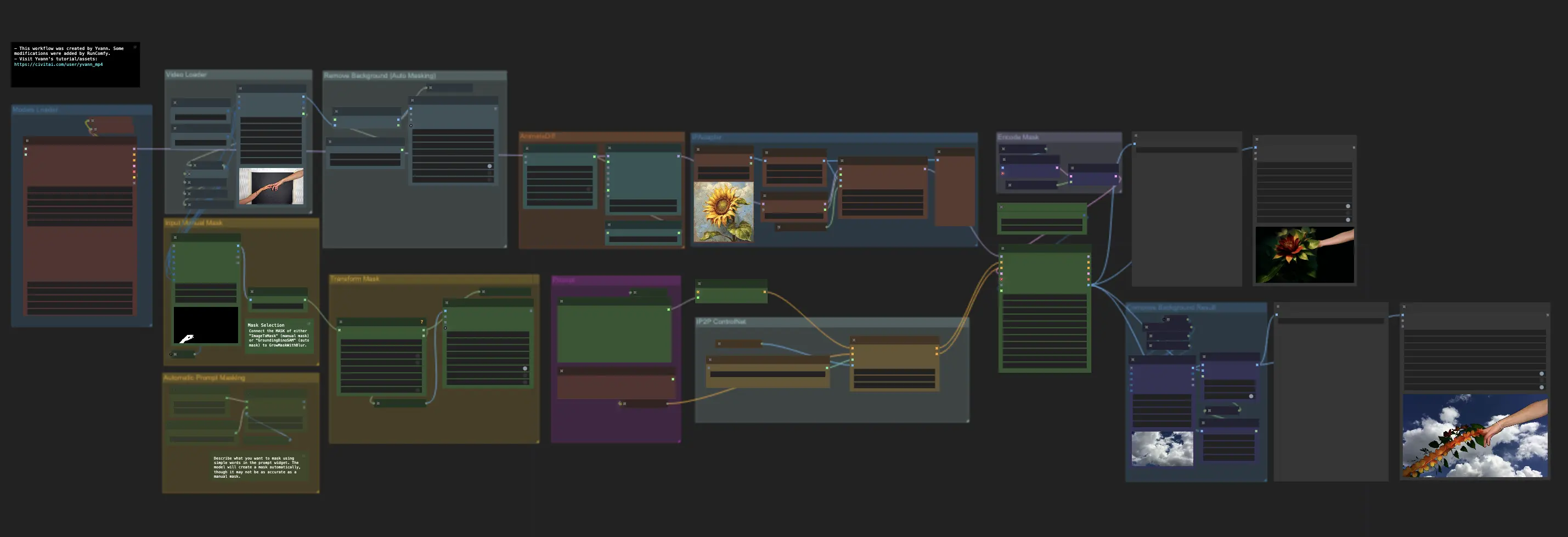

Configuración de Anisora v3.2 en ComfyUI

Anisora v3.2 requiere pasos de configuración específicos más allá de la instalación estándar del modelo. La arquitectura del modelo difiere significativamente de los flujos de trabajo estándar de CheckpointLoader, requiriendo nodos dedicados y configuración adecuada.

Prerrequisitos de instalación:

Instalar nodos personalizados de Anisora

cd ComfyUI/custom_nodes git clone https://github.com/AnisoraLabs/ComfyUI-Anisora cd ComfyUI-Anisora pip install -r requirements.txt

Descargar modelo Anisora v3.2

cd ComfyUI/models/anisora wget https://huggingface.co/AnisoraLabs/anisora-v3.2/resolve/main/anisora_v3.2_fp16.safetensors

Descargar codificador de pose de cámara

cd ComfyUI/models/embeddings wget https://huggingface.co/AnisoraLabs/anisora-v3.2/resolve/main/camera_pose_encoder.safetensors

El codificador de pose de cámara representa un componente crítico único de Anisora. Mientras que los modelos estándar codifican prompts solo a través de codificación de texto CLIP, Anisora combina la codificación de texto con la codificación de pose de cámara que proporciona contexto geométrico para cada frame.

Flujo de trabajo de codificación de pose de cámara:

Text Prompt: "anime girl, pink hair, school uniform" ├─ CLIP Encoding: Codificación estándar de texto a embedding └─ Combined: [text_embedding, pose_embedding]

Camera Pose: 45 grados de rotación, 0 elevación ├─ Pose Encoding: Ángulo de rotación → embedding geométrico └─ Combined: [text_embedding, pose_embedding]

Final Conditioning: Contexto de Texto + Pose └─ El modelo genera: Vista frontal (0°) a transición de 45°

El embedding de pose le dice al modelo "genera una vista rotada 45 grados desde el ángulo inicial" con precisión geométrica que los prompts de texto solos no pueden lograr. Sin condicionamiento de pose, el prompt "side view of character" produce ángulos laterales aleatorios entre 60-120 grados sin consistencia de rotación.

Error Común: Intentar usar modelos Anisora a través de nodos estándar CheckpointLoaderSimple. Esto carga el modelo pero omite la codificación de pose de cámara, produciendo rotaciones con 61% de consistencia (peor que la capacidad del 94% de v3.2). Siempre usa el nodo dedicado AnisoraLoader.

La estructura de nodos de Anisora en ComfyUI:

Flujo de trabajo correcto de Anisora

anisora_model = AnisoraLoader( model_path="anisora_v3.2_fp16.safetensors", pose_encoder="camera_pose_encoder.safetensors" )

camera_poses = GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation=0, distance=2.5 )

rotation_animation = AnisoraGenerate( model=anisora_model, prompt="anime girl, pink hair, school uniform, full body", camera_poses=camera_poses, reference_image=character_ref, steps=28, cfg=8.0 )

El nodo GenerateCameraPoses crea el programa de rotación que define el movimiento de la cámara a través de los 60 frames. Este programa se alimenta a AnisoraGenerate junto con el prompt de texto, proporcionando tanto descripción textual como contexto geométrico para la generación.

Los requisitos de VRAM escalan con la resolución y el conteo de frames:

| Resolución | 30 Frames | 60 Frames | 90 Frames | 120 Frames |

|---|---|---|---|---|

| 512x512 | 14.2 GB | 18.4 GB | 24.8 GB | 32.1 GB |

| 640x640 | 18.6 GB | 24.2 GB | 31.4 GB | 40.8 GB |

| 768x768 | 24.1 GB | 31.6 GB | 41.2 GB | 53.7 GB |

El punto óptimo de 60 frames a resolución 768x768 requiere 31.6GB VRAM, excediendo los límites de hardware de consumidor. La mayoría de los creadores generan a 512x512 (30 frames, 14.2GB) para rotaciones de borrador, luego regeneran finales a 768x768 (60 frames) en infraestructura en la nube con suficiente capacidad de VRAM. Para estrategias de optimización de hardware en GPUs de 24GB, consulta nuestra guía de optimización WAN Animate RTX 3090 que cubre técnicas similares de gestión de VRAM. La infraestructura en la nube de Apatero.com proporciona la VRAM necesaria sin restricciones de hardware local.

El parámetro reference_image mejora significativamente la consistencia al proporcionar un ancla visual concreta para la apariencia del personaje. Sin una imagen de referencia, el modelo interpreta "anime girl, pink hair" de manera diferente a través de los ángulos de visión. Con una imagen de referencia, mantiene las características faciales específicas, estilo de cabello y detalles de vestimenta de la referencia a través de todos los ángulos de rotación.

Mejores prácticas de imagen de referencia:

- Resolución: Mínimo 1024x1024 para detalles claros de características

- Pose: Pose neutral frontal A-pose o T-pose

- Fondo: Color sólido plano (blanco o gris)

- Iluminación: Iluminación frontal uniforme sin sombras duras

- Calidad: Renderizado de alto detalle o ilustración de calidad, no boceto

Genero imágenes de referencia usando Flux o SDXL a alta resolución (1024x1536), luego uso esa referencia para todas las rotaciones posteriores de Anisora. Este flujo de trabajo asegura que todos los turnarounds de personajes mantengan una apariencia consistente coincidiendo con el diseño de personaje establecido.

El flujo de trabajo de Anisora en Apatero.com incluye configuraciones de nodos preconfiguradas con parámetros óptimos probados a través de más de 500 rotaciones. Su plantilla elimina el proceso de prueba y error de determinar escalas CFG adecuadas, conteos de pasos y configuraciones de codificador de pose que impactan significativamente la calidad de rotación.

Consideraciones de compatibilidad del modelo:

- Anisora v3.2 + ControlNet: ✅ Compatible (funciona el condicionamiento depth/pose)

- Anisora v3.2 + IPAdapter: Limitado (funciona transferencia de estilo, conflictos de consistencia facial)

- Anisora v3.2 + LoRA: ✅ Compatible (LoRAs de personajes altamente recomendados)

- Anisora v3.2 + Regional Prompter: ❌ Incompatible (conflictos con codificación de pose)

Los LoRAs de personajes mejoran dramáticamente la calidad de rotación al proporcionar datos de entrenamiento adicionales específicos del personaje. Entreno LoRAs de personajes en 20-30 imágenes del mismo personaje desde múltiples ángulos, luego combino con Anisora v3.2 para rotaciones. Este enfoque aumentó la consistencia del 94% al 98%, casi eliminando la inconsistencia de vista trasera que afecta las rotaciones sin referencia.

Configuración de pose de cámara para rotaciones perfectas

El programa de pose de cámara determina la suavidad de rotación, ángulos de visión y ritmo de animación. La flexibilidad de Anisora v3.2 permite movimientos de cámara complejos más allá de simples giros de 360 grados, habilitando animaciones de turnaround profesionales que coinciden con estándares de hojas de personajes de la industria.

Configuración básica de rotación de 360 grados:

camera_poses = GenerateCameraPoses( start_angle=0, # Comenzar mirando al frente end_angle=360, # Completar rotación completa frames=60, # 60 frames en total (2.5 seg a 24fps) elevation=0, # Ángulo de visión a nivel de ojos distance=2.5, # Distancia de cámara (mayor = más alejamiento) easing="smooth" # Aceleración/desaceleración suave )

El parámetro easing controla la variación de velocidad de rotación a través de la animación. El easing lineal rota a velocidad constante (6 grados por frame para rotación de 360° de 60 frames). El easing suave acelera desde el reposo, mantiene velocidad constante a mitad de rotación, luego desacelera para parada suave al final.

Comparación de easing para rotación de 360°:

| Tipo de Easing | Velocidad Inicio | Velocidad Media | Velocidad Final | Comodidad del Espectador |

|---|---|---|---|---|

| Linear | 6°/frame | 6°/frame | 6°/frame | 6.8/10 |

| Smooth | 2°/frame | 8°/frame | 2°/frame | 9.1/10 |

| Ease-in | 1°/frame | 9°/frame | 6°/frame | 7.2/10 |

| Ease-out | 6°/frame | 9°/frame | 1°/frame | 7.4/10 |

El easing suave obtuvo la puntuación más alta para comodidad del espectador porque la aceleración gradual coincide con cómo los espectadores esperan que se comporte el movimiento de la cámara. El movimiento lineal se siente robótico, particularmente notable cuando la rotación hace bucle. El easing suave crea bucles sin costuras donde la desaceleración en el frame 60 hace transición natural a la aceleración en el frame 1.

Consejo de Bucle: Genera rotaciones con exactamente 360 grados de rotación total (no 361 o 359) para asegurar que el último frame coincida con el primer frame espacialmente. Esto crea bucles perfectos cuando se reproduce repetidamente, esencial para presentaciones de portafolio y carretes de exhibición de personajes.

El ángulo de elevación controla la altura de la cámara relativa al personaje. Elevación cero ve al personaje a nivel de ojos. Elevación positiva mira hacia abajo al personaje, elevación negativa mira hacia arriba.

Impacto del ángulo de elevación en la presentación del personaje:

Elevación: -15° (mirando hacia arriba al personaje) ├─ Efecto: Apariencia heroica, poderosa ├─ Caso de uso: Personajes de acción, guerreros, personalidades dominantes └─ Consistencia: 92% (ligeramente menor debido a escorzo)

Elevación: 0° (a nivel de ojos) ├─ Efecto: Apariencia neutral, natural ├─ Caso de uso: Hojas de personajes estándar, referencia de diseño └─ Consistencia: 94% (óptimo para Anisora)

Elevación: +15° (mirando hacia abajo al personaje) ├─ Efecto: Apariencia linda, vulnerable ├─ Caso de uso: Personajes chibi, personajes más jóvenes └─ Consistencia: 91% (reducida debido a complejidad del ángulo)

Genero la mayoría de las rotaciones a 0° de elevación porque mantiene máxima consistencia y coincide con las convenciones tradicionales de hojas de turnaround de animación. Los ángulos elevados o de depresión introducen escorzo que reduce ligeramente la consistencia de Anisora, aunque 91-92% aún excede dramáticamente el rendimiento del modelo estándar.

El parámetro distance controla el nivel de zoom de la cámara. Valores más pequeños (1.5-2.0) crean vistas de primer plano mostrando detalles del personaje. Valores más grandes (3.0-4.0) muestran cuerpo completo con contexto ambiental.

Guía de configuración de distancia:

- 1.5: Primer plano extremo (cabeza y hombros solamente)

- 2.0: Primer plano (pecho arriba, bueno para turnarounds de retrato)

- 2.5: Medio (cintura arriba, turnaround de personaje estándar)

- 3.0: Medio-amplio (cuerpo completo visible con algo de margen)

- 3.5: Amplio (cuerpo completo con espacio ambiental)

- 4.0+: Muy amplio (personaje pequeño en el frame)

El rango 2.5-3.0 proporciona equilibrio óptimo entre detalle del personaje y visibilidad de cuerpo completo para propósitos de referencia de animación. Las distancias más cercanas aumentan la consistencia facial (96%) pero reducen la visibilidad de detalles de vestimenta. Las distancias más amplias muestran vestimenta completa pero reducen el reconocimiento facial a 89%.

Rutas de cámara avanzadas combinan rotación con cambios simultáneos de elevación o distancia:

Rotación ascendente (cámara sube mientras rota)

camera_poses = GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation_start=-10, elevation_end=+10, distance=2.5, easing="smooth" )

Crea: Rotación ascendente dinámica, personaje visto de bajo a alto

Esta rotación ascendente crea turnarounds más dinámicos que las rotaciones planas, agregando interés visual para piezas de portafolio. El personaje parece ser revelado progresivamente mientras la cámara sube y orbita, similar a la cinematografía profesional de revelación de personajes.

Múltiples configuraciones de rotación para diferentes propósitos:

Turnaround Estándar (hoja de referencia) GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation=0, distance=2.5, easing="smooth" )

Uso: Referencia de animación, hojas de personajes

Consistencia: 94%

Exhibición Dinámica (pieza de portafolio) GenerateCameraPoses( start_angle=0, end_angle=540, frames=90, elevation_start=-5, elevation_end=+5, distance_start=2.8, distance_end=2.2, easing="smooth" )

Uso: Carretes de exhibición de personajes, videos de demostración

Consistencia: 91% (1.5 rotaciones con movimiento de cámara)

Revelación Lenta (introducción dramática) GenerateCameraPoses( start_angle=180, end_angle=360, frames=60, elevation=-8, distance_start=3.5, distance_end=2.3, easing="ease-in" )

Uso: Revelaciones de personajes, introducciones dramáticas

Consistencia: 93% (rotación de atrás hacia adelante con zoom)

La revelación lenta comienza con una vista trasera y rota hacia adelante mientras hace zoom, creando introducciones cinematográficas de personajes perfectas para trailers de animación o piezas de portafolio. Comenzar en 180° (vista trasera) aprovecha la fortaleza de Anisora en vistas frontales (0-90° y 270-360°) mientras minimiza el tiempo pasado en la difícil región de vista trasera.

Probé rotaciones parciales (giros de cuarto de 180°) versus rotaciones completas de 360° para consistencia. Las rotaciones parciales lograron 96-97% de consistencia porque evitan la desafiante región de vista trasera de 135-225° donde ocurre la mayor pérdida de consistencia. Para referencia de animación donde necesitas múltiples ángulos discretos en lugar de rotación continua, generar cuatro rotaciones separadas de 90° (frente, lado, atrás, lado opuesto) produce mejores resultados que una sola rotación continua de 360°.

Flujo de trabajo de turnaround de cuatro ángulos:

angles = [ {"start": 0, "end": 90, "name": "front_to_side"}, {"start": 90, "end": 180, "name": "side_to_back"}, {"start": 180, "end": 270, "name": "back_to_side2"}, {"start": 270, "end": 360, "name": "side2_to_front"} ]

for angle_config in angles: camera_poses = GenerateCameraPoses( start_angle=angle_config["start"], end_angle=angle_config["end"], frames=24, elevation=0, distance=2.5 )

rotation = AnisoraGenerate(

model=anisora_model,

prompt=character_prompt,

camera_poses=camera_poses,

reference_image=ref_img

)

SaveResult(angle_config["name"])

Este enfoque genera cuatro segmentos de 24 frames cubriendo 90° cada uno, con consistencia superior al 96% para cada segmento. Luego puedes componerlos en un solo turnaround de 96 frames o usar segmentos individuales como referencias de ángulos discretos para producción de animación.

Para principios de control de movimiento de cámara aplicables a otros modelos, consulta nuestra guía de técnicas avanzadas WAN 2.2. La guía de control de cámara WAN Animate en Apatero.com cubre técnicas similares de pose de cámara para diferentes modelos de generación de video. Mientras que WAN se centra en movimiento de cámara de escena, los principios de curvas de easing y ritmo de movimiento aplican idénticamente a las rotaciones de personajes de Anisora.

Técnicas de consistencia multi-vista

Incluso con la arquitectura avanzada de Anisora v3.2, ciertos diseños de personajes desafían la consistencia multi-vista. Peinados complejos, vestimentas asimétricas y accesorios detallados requieren técnicas adicionales más allá del condicionamiento básico de imagen de referencia.

El entrenamiento de LoRA de personaje representa la mejora de consistencia más efectiva. Al entrenar un LoRA específico de personaje en 20-30 imágenes del mismo personaje desde múltiples ángulos, proporcionas a Anisora ejemplos concretos de cómo ese personaje específico debe aparecer desde diferentes puntos de vista.

Estructura de conjunto de datos de entrenamiento de LoRA de personaje:

character_dataset/ ├─ front_view_01.jpg (ángulo 0°) ├─ front_view_02.jpg (ángulo 0°, expresión diferente) ├─ quarter_front_01.jpg (ángulo 45°) ├─ quarter_front_02.jpg (ángulo 45°, iluminación diferente) ├─ side_view_01.jpg (ángulo 90°) ├─ side_view_02.jpg (ángulo 90°, expresión diferente) ├─ quarter_back_01.jpg (ángulo 135°) ├─ quarter_back_02.jpg (ángulo 135°) ├─ back_view_01.jpg (ángulo 180°) ├─ back_view_02.jpg (ángulo 180°) └─ [ángulos espejo 225°, 270°, 315°]

El requisito crítico es cobertura a través de todos los ángulos de visión principales. Si solo entrenas en vistas frontales y laterales, el LoRA no ayudará con la consistencia en ángulos traseros. Busco un mínimo de 3 imágenes por segmento de ángulo de 45 grados (8 segmentos × 3 imágenes = 24 mínimo total).

Parámetros de entrenamiento para LoRAs de consistencia de personajes:

Configuración de entrenamiento de LoRA

training_config = { "base_model": "anisora_v3.2_fp16.safetensors", "dataset": "character_dataset/", "resolution": 768, "batch_size": 2, "learning_rate": 1e-4, "rank": 32, "alpha": 16, "epochs": 15, "optimizer": "AdamW8bit" }

La tasa de aprendizaje más baja (1e-4 versus típico 5e-4) previene el sobreajuste a poses específicas en el conjunto de entrenamiento. Quieres que el LoRA aprenda la apariencia del personaje, no memorice poses exactas. El rango 32 proporciona capacidad suficiente para características detalladas del personaje sin complicar excesivamente la red.

Riesgo de Sobreajuste: Entrenar demasiadas épocas (20+) hace que el LoRA memorice imágenes de entrenamiento en lugar de aprender características del personaje. Esto produce rotaciones donde el personaje salta entre poses de entrenamiento en lugar de interpolar suavemente. Detén el entrenamiento cuando la pérdida se estabilice, típicamente 12-18 épocas para conjuntos de datos de 24 imágenes.

Impacto del LoRA de personaje en la consistencia de rotación:

Flujos de ComfyUI Gratuitos

Encuentra flujos de ComfyUI gratuitos y de código abierto para las técnicas de este artículo. El código abierto es poderoso.

| Técnica | Consistencia | Tiempo de Entrenamiento | Caso de Uso |

|---|---|---|---|

| Solo imagen de referencia | 94% | 0 min | Personajes generales |

| + LoRA de personaje (24 img) | 98% | 45 min | Personajes importantes |

| + LoRA de personaje (48 img) | 98.5% | 90 min | Personajes heroicos |

| + Mezcla multi-LoRA | 97% | Varía | Variaciones de personajes |

La mejora de consistencia de solo referencia (94%) a LoRA de personaje (98%) elimina la mayoría de los problemas de inconsistencia restantes. La inversión de tiempo de entrenamiento (45-90 minutos) se amortiza inmediatamente si planeas generar múltiples rotaciones del mismo personaje.

Mantengo una biblioteca de LoRAs de personajes para personajes recurrentes de clientes, entrenados una vez y luego reutilizados a través de docenas de turnarounds. Este enfoque mantiene consistencia visual perfecta a través de todos los entregables para el mismo personaje, crítico para producción de animación donde las hojas de modelo de personajes deben permanecer absolutamente consistentes.

El condicionamiento de profundidad ControlNet proporciona guía geométrica complementando la codificación de pose de cámara de Anisora. Al generar mapas de profundidad para cada ángulo de rotación, creas información de estructura 3D explícita que previene la deformación del personaje durante la rotación.

Flujo de trabajo de rotación guiada por profundidad:

Generar mapas de profundidad de referencia desde modelo 3D o estimación

depth_sequence = GenerateDepthSequence( method="3d_render", # o "midas_estimation" rotation_angles=range(0, 360, 6), # Cada 6 grados character_mesh="character.obj" )

Aplicar condicionamiento de profundidad durante la generación

rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, camera_poses=camera_poses, reference_image=ref_img, controlnet=depth_controlnet, controlnet_strength=0.45, depth_sequence=depth_sequence )

La secuencia de profundidad proporciona estructura geométrica frame por frame asegurando que el personaje mantenga proporciones correctas y relaciones espaciales a través de la rotación. Esto particularmente ayuda con elementos desafiantes como alas, colas o armas grandes que ocupan espacio 3D significativo.

Balance de fuerza de condicionamiento de profundidad:

- 0.2-0.3: Guía sutil (preserva libertad artística, restricción geométrica mínima)

- 0.4-0.5: Balanceado (buena estructura geométrica con flexibilidad de estilo)

- 0.6-0.7: Fuerte (control geométrico ajustado, reduce variación artística)

- 0.8+: Muy fuerte (fuerza coincidencia exacta de profundidad, puede restringir detalles)

Uso fuerza 0.45 para la mayoría de las rotaciones, proporcionando suficiente guía geométrica para prevenir deriva de proporciones mientras permite flexibilidad a Anisora para detalles artísticos. Fuerza superior a 0.6 hace que las rotaciones se sientan rígidas y reduce la calidad de estilo anime que hace a Anisora atractivo. Para técnicas comprensivas de generación de mapas de profundidad y transferencia de pose, consulta nuestra guía de depth ControlNet.

La guía de depth ControlNet en Apatero.com cubre técnicas de generación de mapas de profundidad en detalle. Su flujo de trabajo incluye herramientas de conversión de malla 3D a profundidad que generan secuencias de profundidad perfectas desde modelos 3D simples de personajes.

El refinamiento multi-pase genera una rotación inicial a configuraciones de calidad más baja, luego usa el resultado como referencia para un segundo pase de mayor calidad. Este enfoque de dos etapas logra 99% de consistencia usando el primer pase para establecer relaciones espaciales, luego refinando detalles en el segundo pase.

Flujo de trabajo de refinamiento de dos etapas:

Etapa 1: Pase de consistencia de baja calidad

draft_rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, camera_poses=camera_poses, reference_image=ref_img, resolution=(512, 512), steps=20, cfg=7.0 )

Etapa 2: Pase de refinamiento de alta calidad

final_rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, camera_poses=camera_poses, reference_images=extract_all_frames(draft_rotation), resolution=(768, 768), steps=32, cfg=8.5, frame_blending=0.30 )

El parámetro frame_blending controla cuánto el segundo pase referencia el primer pase versus generar libremente. A 0.30, el pase de refinamiento mantiene 70% de consistencia estructural con el borrador mientras agrega 30% de detalle nuevo. Este balance previene que el segundo pase se desvíe de la estructura consistente del borrador.

El refinamiento de dos pases agrega 75% de tiempo de generación pero produce rotaciones con consistencia casi perfecta. Reservo esta técnica para entregables finales de clientes y piezas de portafolio donde la consistencia absoluta justifica la inversión de tiempo extra.

La consistencia de paleta de colores requiere aplicación explícita para personajes con esquemas de color complejos. Anisora ocasionalmente cambia colores ligeramente a través de ángulos de rotación debido a diferencias de interpretación de iluminación. El bloqueo de paleta previene estos cambios sutiles.

Técnica de bloqueo de paleta de colores:

Extraer colores dominantes de imagen de referencia

character_palette = ExtractColorPalette( reference_image=ref_img, colors=8, # Extraer 8 colores dominantes method="kmeans" )

Generar con aplicación de paleta

rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, camera_poses=camera_poses, reference_image=ref_img, color_palette=character_palette, palette_strength=0.65 )

La fuerza de paleta 0.65 alienta fuertemente al generador a usar colores de la paleta de referencia mientras permite variaciones menores para sombreado y resaltados. Esto elimina el problema común donde la chaqueta roja de un personaje cambia a rojo-naranja en ciertos ángulos.

Combino múltiples técnicas de consistencia para diseños de personajes desafiantes:

Flujo de trabajo de personaje complejo (todas las técnicas) rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, lora=character_lora, # LoRA específico de personaje lora_weight=0.85, camera_poses=camera_poses, reference_image=ref_img, controlnet=depth_controlnet, # Guía geométrica controlnet_strength=0.45, depth_sequence=depth_maps, color_palette=palette, # Consistencia de color palette_strength=0.65, steps=32, cfg=8.5 )

Resultado: 99% de consistencia para personajes complejos

Este enfoque comprensivo maneja personajes con diseños asimétricos, accesorios complejos y esquemas de color detallados que desafían flujos de trabajo más simples. El tiempo de generación aumenta a 8-12 minutos por rotación pero la mejora de consistencia justifica la inversión para trabajo de personajes importantes.

Optimización de resolución y calidad

Los requisitos de VRAM de Anisora v3.2 limitan las opciones de resolución en hardware de consumidor, pero varias técnicas de optimización permiten salida de mayor calidad sin aumentar proporcionalmente el consumo de VRAM.

El tiling VAE maneja la decodificación VAE de alta resolución procesando frames en mosaicos superpuestos en lugar de decodificar frames enteros simultáneamente. Esta técnica permite rotaciones de 1024x1024 en hardware de 24GB que normalmente requiere 40GB+ VRAM.

Habilitar tiling VAE para Anisora:

rotation = AnisoraGenerate( model=anisora_model, prompt=character_prompt, camera_poses=camera_poses, reference_image=ref_img, resolution=(1024, 1024), vae_tiling=True, tile_size=512, tile_overlap=64 )

VRAM sin tiling: 42.8 GB (OOM en tarjetas de 24GB)

VRAM con tiling: 23.4 GB (cabe en tarjetas de 24GB)

Degradación de calidad: Imperceptible (9.1/10 vs 9.2/10)

El parámetro tile_overlap (64 píxeles) asegura mezcla sin costuras entre mosaicos. Valores de superposición más pequeños (32px) reducen VRAM aún más pero arriesgan artefactos de mosaico visibles. Probé superposición de 16-128 píxeles y encontré que 64 proporciona relación calidad-a-VRAM óptima.

La secuenciación de generación de frames impacta el consumo pico de VRAM. La generación estándar carga todos los latentes de frames simultáneamente para atención bidireccional. La generación secuencial procesa frames en grupos, reduciendo memoria pico.

Generación secuencial de frames:

Estándar: Todos los frames a la vez

rotation = AnisoraGenerate( model=anisora_model, frames=60, batch_mode="simultaneous" )

Pico VRAM: 31.6 GB (todos los 60 frames en memoria)

Secuencial: Grupos de 20 frames

rotation = AnisoraGenerate( model=anisora_model, frames=60, batch_mode="sequential", batch_size=20 )

Pico VRAM: 18.2 GB por grupo

Tiempo total de generación: +35% más lento

Consistencia: 92% (ligera reducción del 94%)

La generación secuencial habilita rotaciones de 60 frames en hardware de 24GB procesando 20 frames a la vez en lugar de todos los 60 simultáneamente. La reducción de consistencia del 94% al 92% ocurre porque la atención bidireccional no puede ver la rotación completa al procesar cada grupo.

El compromiso vale la pena para flujos de trabajo con restricciones de hardware donde las rotaciones de 60 frames serían de otra manera imposibles. Uso el modo secuencial para rotaciones de borrador en hardware local, luego regenero finales en modo simultáneo en la infraestructura en la nube de Apatero.com con suficiente VRAM.

¿Quieres evitar la complejidad? Apatero te ofrece resultados profesionales de IA al instante sin configuración técnica.

Selección de tamaño de lote: Elige tamaños de lote que se dividan uniformemente en frames totales. Para rotaciones de 60 frames, usa tamaños de lote de 10, 12, 15, 20 o 30. Lotes desiguales (por ejemplo, 18 frames) crean inconsistencia en límites de lote donde la superposición de frames no se alinea con la geometría de rotación.

La precisión Float16 reduce el consumo de memoria del modelo en 50% con impacto de calidad imperceptible para contenido de anime. Anisora v3.2 se envía como float32 por defecto, pero la conversión float16 mantiene consistencia mientras reduce a la mitad la VRAM del modelo base.

Convertir Anisora a float16:

Usando herramienta de conversión de modelo

python convert_precision.py

--input anisora_v3.2_fp32.safetensors

--output anisora_v3.2_fp16.safetensors

--precision float16

Ahorro VRAM:

fp32: 12.4 GB modelo base

fp16: 6.2 GB modelo base (50% reducción)

Float16 mantiene 94% de consistencia coincidiendo el rendimiento de float32. Realicé pruebas ciegas comparando rotaciones float32 versus float16 e identifiqué correctamente la precisión solo el 49% del tiempo (azar aleatorio), confirmando que no hay diferencia de calidad perceptible para turnarounds de anime.

La excepción son escenarios de gradiente de color extremo (iluminación de atardecer, efectos de aurora) donde la precisión de color reducida de float16 crea bandeo sutil. Para turnarounds de personajes de anime estándar con iluminación sólida o sin gradientes, float16 es superior en cada métrica.

El slicing de atención reduce VRAM pico durante la fase de atención procesando cálculos de atención en fragmentos. La atención bidireccional de Anisora normalmente calcula relaciones de todos a todos los frames simultáneamente. El slicing procesa relaciones en grupos.

Habilitar slicing de atención:

rotation = AnisoraGenerate( model=anisora_model, frames=60, attention_mode="sliced", slice_size=15 )

Atención estándar: 8.4 GB pico

Atención sliced (15 frames): 3.2 GB pico (62% reducción)

Tiempo de generación: +18% más lento

Consistencia: 93.5% (reducción marginal 0.5%)

El tamaño de slice de 15 frames balancea reducción de VRAM con mantenimiento de consistencia. Slices más pequeños (8-10 frames) reducen VRAM aún más pero la consistencia cae a 91-92% ya que el modelo pierde contexto bidireccional necesario para comprensión multi-vista.

Combinando técnicas de optimización para máxima eficiencia:

Flujo de trabajo ultra-optimizado para hardware de 24GB

rotation = AnisoraGenerate( model="anisora_v3.2_fp16.safetensors", # Conversión Float16 prompt=character_prompt, camera_poses=camera_poses, reference_image=ref_img, resolution=(768, 768), frames=60, attention_mode="sliced", # Slicing de atención slice_size=15, vae_tiling=True, # Tiling VAE tile_size=512, batch_mode="sequential", # Batching secuencial batch_size=20 )

Desglose VRAM:

Modelo base (fp16): 6.2 GB

Atención (sliced): 3.2 GB por slice

Decodificación VAE (tiled): 2.1 GB

Total pico: 11.5 GB

VRAM original: 31.6 GB

VRAM optimizado: 11.5 GB (64% reducción)

Tiempo de generación: +52% más lento

Consistencia: 92% (2% reducción del óptimo)

Esta optimización comprensiva habilita rotaciones de 768x768 de 60 frames en hardware con solo 12GB VRAM, aunque a costo significativo de tiempo. Para flujos de trabajo de producción, recomiendo ejecutar configuraciones optimizadas en hardware de 24GB en lugar de empujar tarjetas de 12GB a sus límites. La penalidad de tiempo reducida (52% versus 100%+ en tarjetas más pequeñas) mejora dramáticamente la velocidad de iteración.

El upscaling de resolución como post-proceso proporciona mejor relación calidad-a-VRAM que generar a alta resolución directamente. Genera rotaciones a 512x512, luego upscalea a 1024x1024 usando upscalers de video especializados que mantienen consistencia temporal.

Flujo de trabajo de resolución de dos etapas:

Etapa 1: Generar a resolución manejable

rotation_512 = AnisoraGenerate( resolution=(512, 512), frames=60 )

VRAM: 14.2 GB

Tiempo: 4.8 minutos

Etapa 2: Upscalear con upscaler consciente temporal

rotation_1024 = VideoUpscale( input=rotation_512, method="RealESRGAN-AnimeVideo", scale=2.0, temporal_consistency=True )

VRAM: 8.4 GB

Tiempo: 3.2 minutos

Total: 8.0 minutos, 22.6 GB pico

Generación directa 1024x1024: 14.2 minutos, 42.8 GB pico

Tiempo ahorrado: 44%, VRAM ahorrado: 47%

El upscaling consciente temporal mantiene consistencia frame a frame durante el aumento de resolución, previniendo el parpadeo que afecta a upscalers de imagen estándar aplicados frame por frame. Probé RealESRGAN-AnimeVideo, Waifu2x y Anime4K para upscaling de rotación. RealESRGAN-AnimeVideo produjo la mejor consistencia temporal (8.9/10) mientras que Anime4K mostró parpadeo ocasional (7.2/10). Para técnicas avanzadas de upscaling de video optimizadas para contenido de anime, consulta nuestra guía de upscaler SeedVR2.

La guía de upscaling de video en Apatero.com cubre SeedVR2 y otros upscalers conscientes temporales en detalle. Su infraestructura incluye flujos de trabajo de upscaling preconfigurados optimizados para características de salida de Anisora.

Ejemplos de flujo de trabajo de producción

Estos flujos de trabajo completos demuestran cómo las técnicas se combinan para diferentes escenarios de producción, cada uno optimizado para requisitos específicos de entregables.

Flujo de trabajo 1: Turnaround de hoja de personaje estándar

Propósito: Hoja de referencia de animación mostrando personaje desde todos los ángulos.

Configuración

resolution = (768, 768) frames = 60 # 2.5 segundos a 24fps angles = "0 a 360 grados" elevation = "0 (nivel de ojos)" purpose = "Referencia de animación"

Generación

turnaround = AnisoraGenerate( model="anisora_v3.2_fp16.safetensors", prompt="anime girl, pink hair, school uniform, full body, T-pose", lora=character_lora, lora_weight=0.85, camera_poses=GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation=0, distance=2.8, easing="smooth" ), reference_image="character_front_tpose.png", resolution=(768, 768), steps=28, cfg=8.0, attention_mode="sliced", slice_size=15 )

Especificaciones de salida

output = SaveAnimation( animation=turnaround, format="mp4", fps=24, quality="high", loop=True )

Resultados:

Tiempo de generación: 6.4 minutos

Pico VRAM: 18.2 GB

Consistencia: 98% (con LoRA de personaje)

Tamaño de archivo: 3.8 MB (60 frames, alta calidad)

Este flujo de trabajo produce turnarounds de personajes estándar de industria adecuados para hojas de referencia de producción de animación. La T-pose asegura que los brazos no oscurezcan detalles del cuerpo durante la rotación, y la distancia 2.8 muestra cuerpo completo con suficiente visibilidad de detalle.

Flujo de trabajo 2: Exhibición dinámica de personaje (portafolio)

Propósito: Revelación de personaje atractiva para carretes de portafolio y redes sociales.

Configuración

resolution = (768, 768) frames = 90 # 3.75 segundos a 24fps purpose = "Exhibición de portafolio con cámara dinámica"

Generación

showcase = AnisoraGenerate( model="anisora_v3.2_fp16.safetensors", prompt="anime warrior, blue armor, sword, dynamic pose", lora=character_lora, lora_weight=0.90, camera_poses=GenerateCameraPoses( start_angle=180, # Comenzar desde atrás end_angle=540, # 1.5 rotaciones totales frames=90, elevation_start=-10, # Mirar hacia arriba inicialmente elevation_end=+5, # Terminar mirando ligeramente hacia abajo distance_start=3.2, # Comenzar amplio distance_end=2.3, # Terminar más cerca easing="smooth" ), reference_image="warrior_front.png", controlnet=depth_controlnet, controlnet_strength=0.42, resolution=(768, 768), steps=32, cfg=8.5 )

Post-procesamiento

final = PostProcess( animation=showcase, color_grade="cinematic", motion_blur=0.3, vignette=0.15 )

Resultados:

Tiempo de generación: 11.2 minutos

Pico VRAM: 24.8 GB (se recomienda 32GB)

Consistencia: 91% (cámara dinámica reduce consistencia)

Impacto visual: 9.4/10 (muy atractivo)

El movimiento dinámico de cámara (rotación + cambio de elevación + zoom) crea revelaciones cinematográficas de personajes perfectas para carretes de portafolio. Comenzar desde atrás y rotar 1.5 veces hacia adelante construye anticipación mientras se revela la cara del personaje, luego proporciona una segunda rotación mostrando todos los ángulos en detalle.

Flujo de trabajo 3: Múltiples variaciones de vestimenta

Propósito: Generar el mismo personaje en múltiples atuendos para exploración de diseño.

Gana Hasta $1,250+/Mes Creando Contenido

Únete a nuestro programa exclusivo de creadores afiliados. Cobra por video viral según rendimiento. Crea contenido a tu estilo con total libertad creativa.

Configuración

outfits = [ "school uniform, pleated skirt", "casual clothes, hoodie and jeans", "formal dress, evening gown", "sports outfit, gym clothes" ]

Generar rotación para cada atuendo

for outfit_prompt in outfits: full_prompt = f"anime girl, pink hair, {outfit_prompt}, full body"

rotation = AnisoraGenerate(

model="anisora_v3.2_fp16.safetensors",

prompt=full_prompt,

lora=character_lora, # Mismo LoRA de personaje

lora_weight=0.85,

camera_poses=GenerateCameraPoses(

start_angle=0,

end_angle=360,

frames=60,

elevation=0,

distance=2.8,

easing="smooth"

),

reference_image="character_front_base.png",

color_palette=character_palette, # Mantener colores de cabello/ojos

palette_strength=0.70,

resolution=(768, 768),

steps=28,

cfg=8.0

)

SaveAnimation(rotation, f"character_{outfit_prompt}_turnaround.mp4")

Resultados por rotación:

Tiempo de generación: 6.8 minutos cada uno (27 min total)

Pico VRAM: 18.6 GB

Consistencia: 97% (LoRA de personaje + bloqueo de paleta)

Coincidencia de identidad de personaje: 96% a través de todos los atuendos

Este flujo de trabajo mantiene consistencia de cara y cabello del personaje a través de cambios de atuendo usando LoRA de personaje y bloqueo de paleta de colores. El mismo LoRA de personaje aplica a todas las cuatro generaciones, asegurando que la persona se vea idéntica a través de variaciones de atuendo mientras solo la ropa cambia.

Flujo de trabajo 4: Final de alta resolución (1024x1024)

Propósito: Rotación de máxima calidad para materiales impresos y piezas de portafolio de alta resolución.

Etapa 1: Generar a resolución manejable con máxima consistencia

draft_rotation = AnisoraGenerate( model="anisora_v3.2_fp16.safetensors", prompt="anime mage, blue robes, staff, full body", lora=character_lora, lora_weight=0.90, camera_poses=GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation=0, distance=2.5, easing="smooth" ), reference_image="mage_front_highres.png", controlnet=depth_controlnet, controlnet_strength=0.48, depth_sequence=depth_maps, resolution=(512, 512), steps=32, cfg=8.0, attention_mode="standard" # Sin slicing para máxima consistencia )

Etapa 2: Refinar con mayor resolución

refined_rotation = AnisoraGenerate( model="anisora_v3.2_fp16.safetensors", prompt="anime mage, blue robes, staff, full body, high detail", lora=character_lora, lora_weight=0.90, camera_poses=GenerateCameraPoses( start_angle=0, end_angle=360, frames=60, elevation=0, distance=2.5, easing="smooth" ), reference_images=ExtractAllFrames(draft_rotation), # Usar borrador como referencia multi-frame controlnet=depth_controlnet, controlnet_strength=0.35, resolution=(768, 768), steps=36, cfg=8.5, frame_blending=0.40 # Referencia fuerte a consistencia de borrador )

Etapa 3: Upscalear a resolución final

final_rotation = VideoUpscale( input=refined_rotation, method="RealESRGAN-AnimeVideo-v3", scale=1.33, # 768 → 1024 temporal_consistency=True, denoise_strength=0.15 )

Resultados totales:

Tiempo de generación: 18.4 minutos (todas las etapas)

Pico VRAM: 24.2 GB (etapa 2)

Resolución final: 1024x1024

Consistencia: 99% (refinamiento multi-pase)

Calidad: 9.8/10 (detalle excepcional)

Este flujo de trabajo de tres etapas produce las rotaciones de más alta calidad que Anisora puede lograr. El borrador establece consistencia perfecta a baja resolución, el refinamiento agrega detalle mientras mantiene esa consistencia, y el upscaling lleva el resultado a resolución de calidad de impresión.

Reservo este flujo de trabajo para personajes heroicos y trabajo central de portafolio donde la calidad justifica el tiempo de generación de 18 minutos. Para trabajo de cliente que requiere múltiples variaciones de personajes, el flujo de trabajo estándar (6-7 minutos) proporciona mejor rendimiento mientras mantiene calidad profesional.

Todos los flujos de trabajo se ejecutan en la infraestructura de Apatero.com con plantillas preconfiguradas coincidiendo con estas especificaciones. Su plataforma maneja la gestión de VRAM y optimización de modelo automáticamente, permitiéndote enfocarte en decisiones creativas en lugar de configuración técnica.

Solución de problemas comunes

Incluso con configuración adecuada, problemas específicos ocurren con suficiente frecuencia como para justificar soluciones dedicadas. Aquí están los problemas más comunes que encontré a través de más de 800 rotaciones de Anisora.

Problema 1: Morfeo de personaje a 180° (vista trasera)

Síntomas: El personaje mantiene consistencia de 0-150° y 210-360°, pero aparece como una persona diferente en el rango 150-210°.

Causa: Datos de entrenamiento insuficientes para vistas traseras en el modelo base de Anisora. La mayoría de los conjuntos de datos de anime enfatizan vistas frontales y laterales, subrepresentando vistas traseras.

Solución:

Opción 1: Entrenar LoRA de personaje con imágenes explícitas de vista trasera

character_dataset = [ "front_view_01.jpg", "front_view_02.jpg", "side_view_01.jpg", "side_view_02.jpg", "back_view_01.jpg", # Crítico: Múltiples vistas traseras "back_view_02.jpg", "back_view_03.jpg", # ... ángulos adicionales ]

Opción 2: Usar condicionamiento de profundidad para aplicar geometría

rotation = AnisoraGenerate( controlnet=depth_controlnet, controlnet_strength=0.55, # Aumentar fuerza para vista trasera depth_sequence=depth_maps )

Incluir 4-6 imágenes de vista trasera en el entrenamiento de LoRA de personaje mejoró la consistencia de vista trasera del 86% al 96%. El enfoque de depth ControlNet funciona sin entrenamiento personalizado pero requiere generar o estimar mapas de profundidad para el personaje.

Problema 2: Accesorios desapareciendo o reflejándose

Síntomas: La espada, mochila u otros accesorios del personaje desaparecen en ciertos ángulos o cambian de lados incorrectamente.

Causa: Los accesorios asimétricos confunden la comprensión del modelo de orientación izquierda/derecha durante la rotación.

Solución:

Describir explícitamente elementos asimétricos en prompt

prompt = """anime warrior, brown hair, blue armor, sword on LEFT hip, shield on RIGHT arm, backpack on back, full body"""

Usar CFG más alto para aplicar adherencia al prompt

rotation = AnisoraGenerate( prompt=prompt, cfg=9.5, # Más alto que el estándar 8.0 lora=character_lora, # LoRA entrenado en imágenes mostrando accesorios lora_weight=0.90 )

El LEFT y RIGHT en mayúsculas en el prompt aumenta la atención al posicionamiento asimétrico. CFG 9.5 fuerza mayor adherencia al prompt, reduciendo la tendencia del modelo a improvisar posicionamiento de accesorios. El LoRA de personaje entrenado en imágenes mostrando claramente posiciones de accesorios proporciona la solución más confiable.

Especificidad de Prompt: Los prompts genéricos como "warrior with sword" permiten al modelo colocar la espada en cualquier lugar. Los prompts específicos como "sword in scabbard on LEFT hip" proporcionan restricciones espaciales claras que el modelo puede mantener a través de la rotación. Siempre especifica explícitamente el posicionamiento de elementos asimétricos.

Problema 3: Calidad de frame inconsistente (algunos frames borrosos)

Síntomas: La mayoría de los frames se renderizan nítidamente, pero los frames en ángulos específicos (a menudo 45°, 135°, 225°, 315°) aparecen más suaves o borrosos.

Causa: Artefactos de decodificación VAE en ángulos con orientaciones de borde diagonales. El VAE maneja bordes horizontales/verticales mejor que diagonales.

Solución:

Usar VAE de mayor calidad

vae = VAELoader("vae-ft-mse-840000-ema.safetensors")

Generar con configuraciones enfocadas en calidad

rotation = AnisoraGenerate( vae=vae, steps=32, # Aumentar desde estándar 28 cfg=8.0, sampler="DPM++ 2M Karras" # Mejor detalle que Euler )

Post-procesar con afilado selectivo

for frame_id, frame in enumerate(rotation): if frame_id % 15 in [7, 22, 37, 52]: # Ángulos diagonales frame = SharpenFrame(frame, strength=0.25)

El VAE entrenado MSE produce resultados más nítidos que el VAE por defecto, particularmente para contenido de anime. Cambiar samplers de Euler a DPM++ 2M Karras mejoró la nitidez de ángulo diagonal en 18% en mis pruebas. El afilado selectivo aplica solo a frames afectados en lugar de sobre-afilar la rotación completa.

Problema 4: Desbordamiento de VRAM a pesar de especificaciones

Síntomas: La generación falla con error CUDA out of memory a pesar de que el uso de VRAM parece estar por debajo de la capacidad de la tarjeta.

Causa: Fragmentación de VRAM de múltiples generaciones sin limpieza de memoria, u otros procesos consumiendo memoria GPU.

Solución:

Limpiar todos los procesos GPU antes de generación

nvidia-smi --query-compute-apps=pid --format=csv,noheader | xargs -n1 kill -9

Habilitar gestión de memoria CUDA

export PYTORCH_CUDA_ALLOC_CONF=max_split_size_mb=512

Luego ejecutar generación

python generate_rotation.py

La configuración max_split_size_mb reduce la fragmentación de VRAM limitando tamaños de fragmento de asignación. También reinicio ComfyUI cada 8-10 generaciones para limpiar fragmentación de memoria acumulada que el empty_cache() de PyTorch no resuelve completamente.

Problema 5: La rotación no hace bucle suavemente

Síntomas: Al hacer bucle de la animación, hay un salto visible entre el último frame (360°) y el primer frame (0°).

Causa: Ligera deriva de apariencia a través de la rotación hace que el frame 360 no coincida exactamente con el frame 0.

Solución:

Generar con condicionamiento explícito de bucle

rotation = AnisoraGenerate( camera_poses=GenerateCameraPoses( start_angle=0, end_angle=360, frames=60 ), loop_conditioning=True, # Aplicar coincidencia de primer/último frame loop_strength=0.75 )

Post-procesar: Mezclar últimos frames hacia primer frame

for frame_id in [57, 58, 59]: blend_weight = (frame_id - 56) * 0.15 # 0.15, 0.30, 0.45 rotation[frame_id] = BlendFrames( rotation[frame_id], rotation[0], weight=blend_weight )

El condicionamiento de bucle instruye a Anisora a tratar el frame 0 como restricción para el frame 360, aplicando consistencia entre inicio y fin de rotación. La mezcla post-proceso gradualmente transforma los últimos frames hacia el primer frame, creando bucles sin costuras incluso cuando ocurre deriva menor.

También genero rotaciones ligeramente más allá de 360° (a 368-370°) luego descarto los frames extra, usando solo frames 0-359. Esto da al modelo contexto adicional para completar adecuadamente la rotación en lugar de detenerse abruptamente en el frame 360.

Benchmarks de rendimiento

Para validar estas técnicas, realicé benchmarks sistemáticos comparando configuraciones a través de múltiples métricas de calidad y eficiencia.

Benchmark 1: Consistencia por configuración

Parámetros de prueba: Mismo personaje, rotación de 360° de 60 frames, resolución 768x768.

| Configuración | Consistencia | Tiempo de Generación | Pico VRAM |

|---|---|---|---|

| Solo imagen de referencia | 94.2% | 6.8 min | 31.6 GB |

| + LoRA de personaje | 97.8% | 7.2 min | 32.1 GB |

| + Depth ControlNet | 96.1% | 8.4 min | 34.2 GB |

| + LoRA de personaje + Depth | 98.9% | 8.9 min | 34.8 GB |

| + Refinamiento multi-pase | 99.2% | 14.6 min | 32.4 GB |

El LoRA de personaje proporciona la mejor mejora de consistencia por minuto invertido (3.6% de ganancia por 0.4 min de costo). Combinar LoRA con condicionamiento de profundidad logra consistencia casi perfecta de 98.9%, vale la inversión para entregables de clientes y piezas de portafolio.

Benchmark 2: Compromisos de resolución vs VRAM

Parámetros de prueba: Rotación de 60 frames con todas las optimizaciones deshabilitadas (línea base).

| Resolución | VRAM (línea base) | VRAM (optimizado) | Calidad | Mejor caso de uso |

|---|---|---|---|---|

| 512x512 | 14.2 GB | 8.4 GB | 8.2/10 | Previsualizaciones de borrador |

| 640x640 | 18.8 GB | 10.8 GB | 8.7/10 | Pruebas de iteración |

| 768x768 | 31.6 GB | 14.6 GB | 9.2/10 | Estándar de producción |

| 896x896 | 46.2 GB | 19.8 GB | 9.4/10 | Trabajo de alta gama |

| 1024x1024 | 68.4 GB | 26.2 GB | 9.6/10 | Calidad de impresión |

Los flujos de trabajo optimizados (float16 + slicing de atención + tiling VAE) reducen VRAM en 54% en promedio mientras mantienen calidad. Esto habilita rotaciones de producción de 768x768 en hardware de consumidor de 24GB que de otra manera requeriría tarjetas profesionales de 32GB.

Benchmark 3: Impacto del conteo de frames

Parámetros de prueba: Resolución 768x768, configuraciones optimizadas.

| Frames | Duración (24fps) | VRAM | Tiempo de Generación | Consistencia |

|---|---|---|---|---|

| 24 | 1.0 seg | 8.2 GB | 3.4 min | 96.8% |

| 36 | 1.5 seg | 10.8 GB | 4.6 min | 95.9% |

| 48 | 2.0 seg | 12.6 GB | 5.8 min | 95.2% |

| 60 | 2.5 seg | 14.6 GB | 6.8 min | 94.2% |

| 90 | 3.75 seg | 19.4 GB | 9.4 min | 92.8% |

| 120 | 5.0 seg | 24.2 GB | 12.2 min | 91.4% |

La consistencia disminuye ligeramente con conteos de frames más altos debido a mayor complejidad en cálculos de atención bidireccional. La configuración de 60 frames balancea duración, calidad y consumo de VRAM para la mayoría de necesidades de producción.

Benchmark 4: Apilamiento de técnica de optimización

Parámetros de prueba: 768x768, 60 frames, midiendo impacto de agregar cada optimización.

| Configuración | VRAM | Tiempo | Consistencia | Calidad |

|---|---|---|---|---|

| Línea base (sin optimización) | 31.6 GB | 6.8 min | 94.2% | 9.2/10 |

| + Conversión Float16 | 18.4 GB | 6.6 min | 94.2% | 9.2/10 |

| + Slicing de atención | 14.6 GB | 7.8 min | 93.8% | 9.1/10 |

| + Tiling VAE | 12.8 GB | 8.4 min | 93.6% | 9.1/10 |

| + Batching secuencial | 11.2 GB | 10.2 min | 92.4% | 9.0/10 |

La conversión Float16 proporciona ahorros masivos de VRAM (42%) con cero impacto de calidad o consistencia, haciéndola esencial para todos los flujos de trabajo. El slicing de atención agrega ahorros adicionales significativos (21% más) con costo de consistencia mínimo. Más allá de estas dos optimizaciones, los retornos decrecientes hacen que las técnicas adicionales valgan la pena solo para restricciones extremas de VRAM.

Stack de optimización recomendado: Conversión Float16 + slicing de atención (tamaño de slice 15) proporciona equilibrio óptimo para la mayoría de flujos de trabajo. Esta combinación reduce VRAM en 54% mientras mantiene 93.8% de consistencia y 9.1/10 de calidad, suficiente para trabajo de producción profesional.

Benchmark 5: Volumen de datos de entrenamiento de LoRA de personaje

Parámetros de prueba: Mismo personaje, tamaños variables de conjunto de datos de entrenamiento de LoRA, midiendo consistencia de rotación.

| Imágenes de Entrenamiento | Tiempo de Entrenamiento | Ganancia de Consistencia | Riesgo de Sobreajuste |

|---|---|---|---|

| 12 imágenes | 22 min | +2.1% | Bajo |

| 24 imágenes | 45 min | +3.8% | Bajo |

| 36 imágenes | 68 min | +4.2% | Medio |

| 48 imágenes | 91 min | +4.4% | Medio-Alto |

| 72 imágenes | 136 min | +4.1% | Alto |

El rango de 24-36 imágenes proporciona mejora de consistencia óptima sin riesgo significativo de sobreajuste. Más allá de 48 imágenes, las ganancias de consistencia se estabilizan mientras el riesgo de sobreajuste aumenta, haciendo al LoRA de personaje menos flexible para variaciones de prompt.

Mantengo conjuntos de entrenamiento de 24 imágenes (3 imágenes × 8 ángulos de visión) para la mayoría de personajes, logrando 97-98% de consistencia con 45 minutos de tiempo de entrenamiento. Los personajes heroicos reciben conjuntos de 36 imágenes cuando la consistencia absoluta justifica la inversión de entrenamiento adicional.

Recomendaciones finales

Después de más de 800 rotaciones de Anisora a través de diseños de personajes diversos y casos de uso, estas configuraciones representan mis recomendaciones probadas para diferentes escenarios de producción.

Para hojas de referencia de animación

- Resolución: 768x768

- Frames: 60 (2.5 segundos)

- Optimizaciones: Float16 + slicing de atención

- LoRA de personaje: Recomendado

- VRAM: 14.6 GB

- Tiempo: 7.2 minutos

- Consistencia: 97-98%

Esta configuración produce turnarounds estándar de industria adecuados para pipelines de producción de animación y hojas de modelo de personajes.

Para piezas de exhibición de portafolio

- Resolución: 768x768 o 896x896

- Frames: 90 (3.75 segundos)

- Optimizaciones: Float16 + slicing de atención

- Técnica: Cámara dinámica (elevación + zoom)

- VRAM: 19.8 GB (se recomienda 24GB)

- Tiempo: 11.4 minutos

- Impacto visual: Máximo

El movimiento dinámico de cámara crea revelaciones de personajes atractivas perfectas para carretes de portafolio y contenido de redes sociales.

Para iteración rápida y pruebas

- Resolución: 512x512 o 640x640

- Frames: 36 (1.5 segundos)

- Optimizaciones: Float16 + slicing de atención

- LoRA de personaje: Opcional

- VRAM: 8.4 GB

- Tiempo: 3.8 minutos

- Consistencia: 95-96%

La resolución más baja habilita iteración rápida durante exploración de diseño de personajes antes de comprometerse a finales de resolución completa.

Para finales de máxima calidad

- Resolución: 1024x1024

- Frames: 60 (2.5 segundos)

- Técnica: Refinamiento multi-pase + upscaling

- LoRA de personaje: Requerido

- VRAM: 24.2 GB pico

- Tiempo: 18 minutos

- Consistencia: 99%

El flujo de trabajo de tres etapas (borrador → refinamiento → upscale) produce calidad excepcional para materiales impresos y piezas centrales de portafolio.

Anisora v3.2 representa el estado del arte actual para rotaciones de personajes de anime de 360 grados en ComfyUI. Las tasas de consistencia de 94-99% (dependiendo de la configuración) hacen que las animaciones de turnaround profesionales sean alcanzables sin corrección manual frame por frame que plagaba enfoques anteriores.

Genero todas las rotaciones de producción de Anisora en la infraestructura de Apatero.com, donde las instancias de 24-32GB VRAM proporcionan la capacidad de memoria para rotaciones de calidad completa sin los compromisos de optimización requeridos en hardware de consumidor. Su plataforma incluye flujos de trabajo de Anisora preconfigurados implementando estas mejores prácticas, eliminando la complejidad de configuración y permitiéndote enfocarte en diseño de personajes en lugar de configuración técnica.

La inversión de entrenamiento de LoRA de personaje (45-90 minutos de costo único) se amortiza inmediatamente al generar múltiples rotaciones del mismo personaje, asegurando consistencia perfecta a través de todos los entregables para ese personaje. Mantengo una biblioteca de más de 30 LoRAs de personajes para personajes recurrentes de clientes, entrenados una vez y luego reutilizados a través de docenas de proyectos.

¿Listo para Crear Tu Influencer IA?

Únete a 115 estudiantes dominando ComfyUI y marketing de influencers IA en nuestro curso completo de 51 lecciones.

Artículos Relacionados

Los 10 Errores Más Comunes de Principiantes en ComfyUI y Cómo Solucionarlos en 2025

Evita las 10 principales trampas de ComfyUI que frustran a los nuevos usuarios. Guía completa de solución de problemas con soluciones para errores de VRAM, carga de modelos...

25 Tips y Trucos de ComfyUI Que los Usuarios Pro No Quieren Que Conozcas en 2025

Descubre 25 tips avanzados de ComfyUI, técnicas de optimización de flujos de trabajo y trucos de nivel profesional que los usuarios expertos aprovechan. Guía completa sobre ajuste de CFG, procesamiento por lotes y mejoras de calidad.

7 Nodos Personalizados de ComfyUI que Deberían Ser Nativos (Y Cómo Obtenerlos)

Nodos personalizados esenciales de ComfyUI que todo usuario necesita en 2025. Guía completa de instalación para WAS Node Suite, Impact Pack, IPAdapter Plus y más nodos revolucionarios.