Nós Essenciais Básicos do ComfyUI que Todo Iniciante Precisa Conhecer

Domine os nós fundamentais do ComfyUI em 2025. Guia completo para iniciantes sobre Load Checkpoint, CLIP Text Encode, KSampler, VAE Decode e criação de fluxo de trabalho básico.

Quais São os 5 Nós Essenciais do ComfyUI?

Os 5 nós essenciais do ComfyUI são: Load Checkpoint (carrega modelos AI), CLIP Text Encode (converte texto em linguagem AI), Empty Latent Image (define o tamanho da tela), KSampler (gera imagens) e VAE Decode (torna as imagens visíveis). Domine esses nós e você poderá criar qualquer imagem AI.

- Load Checkpoint: Carrega seu modelo AI (SD 1.5, SDXL, FLUX) e fornece saídas MODEL, CLIP e VAE

- CLIP Text Encode: Converte seus prompts de texto em formato compreensível pela AI (use dois: positivo e negativo)

- Empty Latent Image: Cria o tamanho da sua tela (512x512 para testes, 1024x1024 para qualidade)

- KSampler: O motor de geração - use 20-30 passos, CFG 7-12, sampler euler_a ou dpmpp_2m

- VAE Decode: Converte dados AI em imagens visíveis que você pode salvar e compartilhar

Início Rápido: Conecte Load Checkpoint → CLIP Text Encode → KSampler → VAE Decode. Defina tamanho 512x512, 25 passos, CFG 8. Gere sua primeira imagem em menos de 5 minutos.

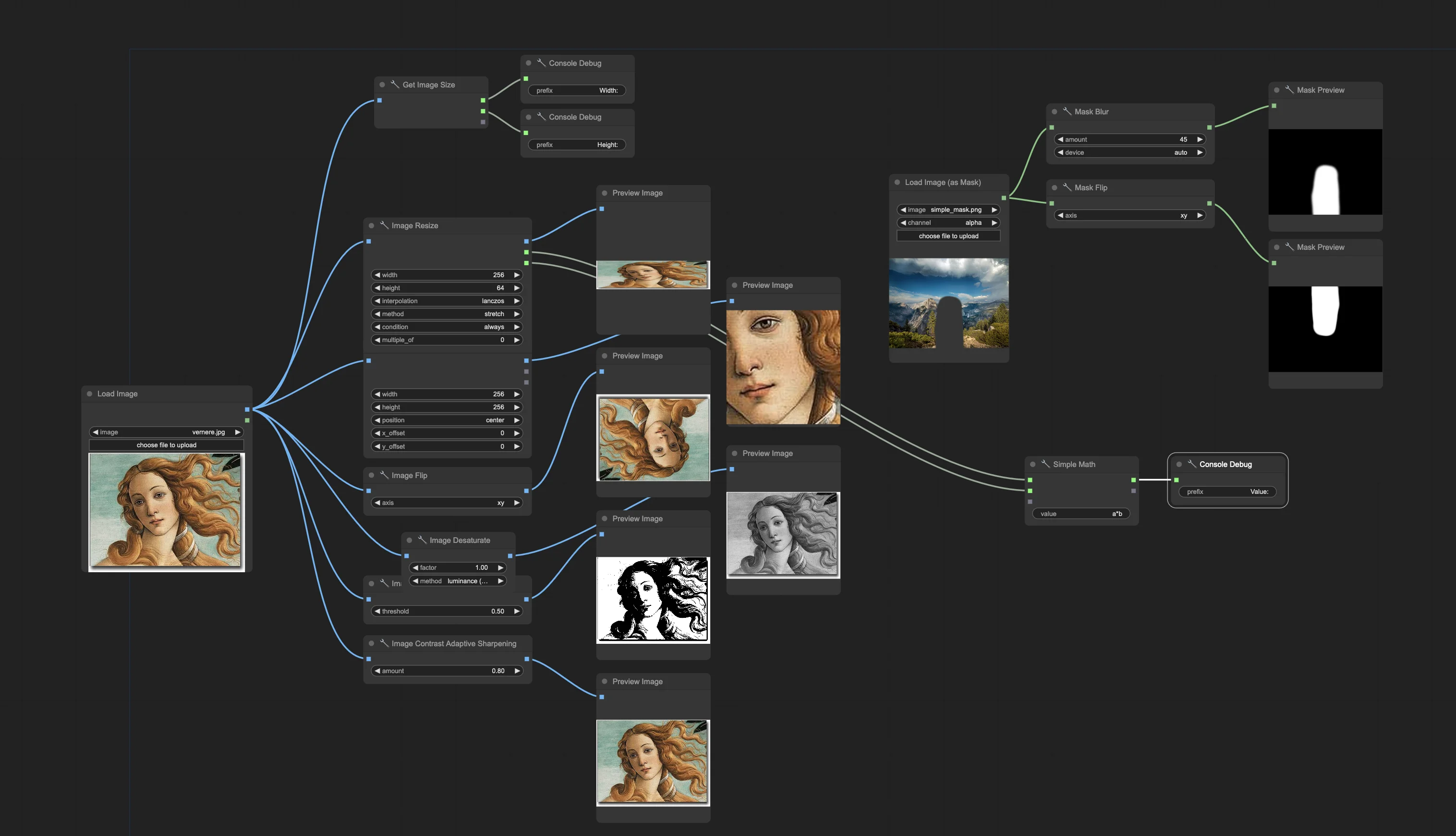

Você ouviu sobre o incrível poder do ComfyUI para geração de imagens AI, mas abri-lo pela primeira vez parece estar olhando para uma placa de circuito.

Nós por toda parte, conexões que não fazem sentido e fluxos de trabalho que parecem mais diagramas de engenharia do que ferramentas criativas.

Cada especialista começou exatamente onde você está agora - confuso com a interface, mas empolgado com as possibilidades.

A diferença entre desistir e dominar o ComfyUI se resume a entender cinco nós essenciais que formam a espinha dorsal de cada fluxo de trabalho.

Uma vez que você compreenda esses fundamentos, o ComfyUI se transforma de um labirinto intimidante em uma tela intuitiva onde suas ideias criativas se tornam imagens impressionantes geradas por AI.

O Que São Nós do ComfyUI e Como Eles Funcionam?

Pense nos nós do ComfyUI como blocos LEGO para geração de imagens AI.

Cada nó executa uma tarefa específica, e você os conecta para criar fluxos de trabalho completos.

Ao contrário de outras ferramentas AI que escondem o processo atrás de botões simples, o ComfyUI mostra exatamente como a geração de imagens funciona.

O Que Torna os Nós Poderosos: Cada nó tem três partes - entradas (lado esquerdo), saídas (lado direito) e parâmetros (controles centrais). Você conecta saídas de um nó às entradas de outro, criando um fluxo de dados que transforma seu prompt de texto em uma imagem final.

Por Que Isso Importa: Entender os nós lhe dá controle completo sobre o processo de geração. Em vez de ser limitado por opções predefinidas, você pode personalizar cada aspecto de como suas imagens são criadas.

Embora plataformas como Apatero.com forneçam geração instantânea de imagens AI sem qualquer complexidade de configuração, aprender o sistema de nós do ComfyUI oferece controle criativo notável e possibilidades de personalização.

Os 5 Nós Essenciais Que Você Deve Conhecer

1. Load Checkpoint - Sua Fundação de Modelo AI

O Que Faz: O nó Load Checkpoint carrega seu modelo AI (como Stable Diffusion 1.5, SDXL ou FLUX) e fornece três componentes essenciais para geração de imagens.

Três Saídas Explicadas:

- MODEL: O gerador de imagens real que cria imagens a partir de ruído

- CLIP: O processador de texto que entende seus prompts

- VAE: O tradutor entre imagens visíveis por humanos e dados legíveis por AI

Como Usar:

- Adicione um nó Load Checkpoint à sua tela

- Clique no dropdown do nome do modelo para selecionar seu modelo preferido

- Conecte as três saídas a outros nós que precisam delas

Modelos Comuns para Iniciantes:

- Stable Diffusion 1.5: Rápido, confiável, ótimo para aprender

- SDXL: Maior qualidade, ligeiramente mais lento

- FLUX: Tecnologia mais recente, resultados excelentes

2. CLIP Text Encode - Convertendo Palavras em Linguagem AI

O Que Faz: Os nós CLIP Text Encode convertem seus prompts de texto em representações matemáticas que o modelo AI pode entender e usar para geração de imagens.

Dois Tipos Que Você Precisa:

- Prompt Positivo: Descreve o que você quer na imagem

- Prompt Negativo: Descreve o que você não quer

Configuração Básica:

- Adicione dois nós CLIP Text Encode ao seu fluxo de trabalho

- Conecte a saída CLIP do Load Checkpoint a ambos os nós

- Digite seu prompt positivo no primeiro nó

- Digite seu prompt negativo no segundo nó (como "desfocado, baixa qualidade")

Dicas de Escrita de Prompt:

- Mantenha os prompts simples e descritivos

- Use vírgulas para separar diferentes elementos

- Comece com descrições básicas antes de adicionar elementos de estilo

3. Empty Latent Image - Definindo o Tamanho da Sua Tela

O Que Faz: Cria uma "tela" em branco no espaço matemático da AI (chamado espaço latente) onde sua imagem será gerada. Pense nisso como definir suas dimensões de imagem.

Configurações Principais:

- Largura & Altura: Tamanho final da sua imagem em pixels

- Tamanho do Lote: Quantas imagens gerar de uma vez

Tamanhos Recomendados para Iniciantes:

- 512x512: Geração rápida, bom para testes

- 768x768: Melhor qualidade, ligeiramente mais lento

- 1024x1024: Alta qualidade, requer mais VRAM

Conexão: A saída latente se conecta ao nó KSampler como ponto de partida para geração de imagens.

4. KSampler - O Coração da Geração de Imagens

O Que Faz: KSampler é onde a mágica acontece. Ele pega seu prompt de texto, a tela em branco e o modelo AI, então gradualmente transforma ruído aleatório em sua imagem desejada através de um processo de remoção de ruído.

Configurações Essenciais:

| Configuração | Valor Recomendado | O Que Faz |

|---|---|---|

| Steps (Passos) | 20-30 | Quantas passagens de refinamento fazer |

| CFG Scale | 7-12 | Quão fielmente seguir seu prompt |

| Sampler Name | euler_a ou dpmpp_2m | O algoritmo de geração |

| Scheduler | normal | Como os passos são espaçados |

| Seed | -1 (aleatória) | Ponto de partida para geração |

Para saber mais sobre seeds e como obter resultados reproduzíveis, leia nosso guia abrangente de gerenciamento de seeds.

Conexões Necessárias:

- Entrada MODEL: Do Load Checkpoint

- Entrada Positive: Do CLIP Text Encode positivo

- Entrada Negative: Do CLIP Text Encode negativo

- Imagem Latente: Do Empty Latent Image

5. VAE Decode - Tornando Imagens Visíveis

O Que Faz: Converte a representação matemática da AI (espaço latente) de volta em uma imagem regular que você pode ver e salvar. Sem esse passo, você teria apenas dados que a AI entende.

Configuração Simples:

- Adicione um nó VAE Decode

- Conecte a entrada VAE à saída VAE do Load Checkpoint

- Conecte a entrada samples à saída LATENT do KSampler

- A saída IMAGE mostra sua imagem gerada final

Construindo Seu Primeiro Fluxo de Trabalho Básico

Criação de Fluxo de Trabalho Passo a Passo

Passo 1: Adicione Seus Nós Clique com o botão direito na tela vazia e adicione esses cinco nós:

- Load Checkpoint

- CLIP Text Encode (adicione dois destes)

- Empty Latent Image

- KSampler

- VAE Decode

Passo 2: Configure Seu Modelo Clique no nó Load Checkpoint e selecione um modelo Stable Diffusion do menu dropdown.

Passo 3: Defina o Tamanho da Sua Tela No nó Empty Latent Image, defina largura e altura para 512 (bom tamanho inicial para iniciantes).

Passo 4: Escreva Seus Prompts

- Primeiro CLIP Text Encode: "um lindo pôr do sol sobre montanhas, fotorrealista"

- Segundo CLIP Text Encode: "desfocado, baixa qualidade, distorcido"

Passo 5: Conecte Tudo Faça essas conexões arrastando dos pontos de saída para os pontos de entrada:

| Do Nó | Saída | Para o Nó | Entrada |

|---|---|---|---|

| Load Checkpoint | MODEL | KSampler | model |

| Load Checkpoint | CLIP | CLIP Text Encode #1 | clip |

| Load Checkpoint | CLIP | CLIP Text Encode #2 | clip |

| Load Checkpoint | VAE | VAE Decode | vae |

| CLIP Text Encode #1 | CONDITIONING | KSampler | positive |

| CLIP Text Encode #2 | CONDITIONING | KSampler | negative |

| Empty Latent Image | LATENT | KSampler | latent_image |

| KSampler | LATENT | VAE Decode | samples |

Passo 6: Gere Sua Imagem Clique em "Queue Prompt" e assista sua primeira imagem ComfyUI ser gerada!

Parâmetros Essenciais dos Nós Explicados

Mergulho Profundo nas Configurações do KSampler

Steps (20-30 recomendado): Mais passos = maior qualidade mas geração mais lenta. Comece com 20 para testes, aumente para 30 para imagens finais.

CFG Scale (7-12 recomendado): Controla a aderência ao prompt. Valores menores (7-8) = mais liberdade criativa. Valores maiores (10-12) = seguimento mais estrito do prompt.

Métodos de Sampler:

- euler_a: Rápido, boa qualidade, ótimo para iniciantes

- dpmpp_2m: Qualidade ligeiramente melhor, diferença mínima de velocidade

- ddim: Método mais antigo, ainda confiável

Opções de Scheduler:

- normal: Espaçamento padrão, funciona para a maioria dos casos

- karras: Espaçamento de passos ligeiramente diferente, às vezes melhores resultados Para um mergulho profundo em como os schedulers afetam suas imagens, confira nosso guia de explicação do scheduler Karras.

Combinações Comuns de Parâmetros

| Tipo de Imagem | Passos | CFG | Sampler | Melhor Para |

|---|---|---|---|---|

| Teste Rápido | 15 | 7 | euler_a | Iteração rápida |

| Qualidade Equilibrada | 25 | 8 | dpmpp_2m | Uso geral |

| Alta Qualidade | 30 | 10 | dpmpp_2m | Saídas finais |

| Liberdade Criativa | 20 | 6 | euler_a | Exploração artística |

Trabalhando com Diferentes Tamanhos de Imagem

Diretrizes de Resolução

Tamanhos Padrão para Diferentes Modelos:

| Tipo de Modelo | Tamanhos Recomendados | Uso de VRAM | Tempo de Geração |

|---|---|---|---|

| SD 1.5 | 512x512, 512x768 | Baixo | Rápido |

| SDXL | 1024x1024, 768x1344 | Médio | Moderado |

| FLUX | 1024x1024, 896x1152 | Alto | Mais Lento |

Dicas de Proporção:

- Quadrado (1:1): 512x512, 1024x1024

- Retrato (3:4): 512x768, 768x1024

- Paisagem (4:3): 768x512, 1024x768

- Tela Larga (16:9): 512x896, 1024x576

Compreendendo Conexões de Nós

Tipos e Cores de Conexão

Guia Visual de Conexão:

| Cor da Conexão | Tipo de Dados | Uso Comum |

|---|---|---|

| Roxo | MODEL | Motor de geração AI |

| Amarelo | CLIP | Processamento de texto |

| Vermelho | VAE | Codificação/decodificação de imagem |

| Laranja | CONDITIONING | Prompts processados |

| Branco | LATENT | Espaço de trabalho da AI |

| Verde | IMAGE | Imagens visíveis finais |

Regras de Conexão

O Que Pode Conectar:

- Saídas e entradas da mesma cor podem se conectar

- Uma saída pode se conectar a múltiplas entradas

- Cada entrada aceita apenas uma conexão

Erros Comuns de Conexão:

- Tentar conectar conexões de cores diferentes

- Esquecer de conectar todas as entradas necessárias

- Conectar saídas a saídas (impossível)

Se você está tendo dificuldades com erros, confira nosso guia de 10 erros comuns de iniciantes no ComfyUI para soluções completas de resolução de problemas.

Solucionando Problemas Comuns de Iniciantes

Erros de "Missing Input"

Problema: Texto vermelho mostrando conexões faltantes Solução: Verifique se todas as entradas necessárias (pontos à esquerda) têm conexões de saídas apropriadas

Fluxos de Trabalho ComfyUI Gratuitos

Encontre fluxos de trabalho ComfyUI gratuitos e de código aberto para as técnicas deste artigo. Open source é poderoso.

Lista de Verificação de Conexões Necessárias:

- KSampler precisa de: model, positive, negative, latent_image

- VAE Decode precisa de: vae, samples

- CLIP Text Encode precisa de: clip

Imagens Pretas ou Corrompidas

Problema: Imagens geradas aparecem pretas ou distorcidas Solução:

- Verifique se o VAE Decode está conectado corretamente

- Verifique se você está usando combinações compatíveis de modelo/VAE

- Certifique-se de que o tamanho da imagem corresponde aos requisitos do modelo

Erros de Falta de Memória

Problema: Geração falha com erros CUDA/memória Solução:

- Reduza as dimensões da imagem (tente 512x512)

- Diminua o tamanho do lote para 1

- Reinicie o ComfyUI para limpar a memória

- Feche outros aplicativos que usam muita GPU

Velocidade de Geração Lenta

Dicas de Otimização de Desempenho:

- Use tamanhos menores de imagem para testes

- Reduza o número de passos para iterações rápidas

- Escolha samplers eficientes (euler_a, dpmpp_2m)

- Gere uma imagem de cada vez inicialmente

Exemplos Práticos de Fluxo de Trabalho

Geração Básica de Retrato

Configuração de Fluxo de Trabalho:

- Load Checkpoint: Modelo realista

- Prompt Positivo: "foto profissional de retrato de uma pessoa, iluminação de estúdio, foco nítido"

- Prompt Negativo: "desfocado, distorcido, baixa qualidade, cartoon"

- Tamanho: 512x768 (orientação retrato)

- Passos: 25, CFG: 8

Criação Simples de Paisagem

Configuração de Fluxo de Trabalho:

- Load Checkpoint: Modelo focado em paisagem

- Prompt Positivo: "paisagem cênica de montanha, hora dourada, detalhado, fotorrealista"

- Prompt Negativo: "pessoas, prédios, texto, desfocado"

- Tamanho: 768x512 (orientação paisagem)

- Passos: 30, CFG: 9

Arte Conceitual Rápida

Configuração de Fluxo de Trabalho:

- Load Checkpoint: Modelo artístico

- Prompt Positivo: "arte conceitual, castelo de fantasia, iluminação dramática, detalhado"

- Prompt Negativo: "fotorrealista, desfocado, baixo detalhe"

- Tamanho: 512x512 (quadrado)

- Passos: 20, CFG: 7

Próximos Passos Após Dominar o Básico

Construção Gradual de Habilidades

Semana 1-2: Domine o Essencial

- Pratique conectar os 5 nós básicos

- Experimente com diferentes prompts

- Teste vários tamanhos e configurações de imagem

Semana 3-4: Expanda Seu Kit de Ferramentas

- Adicione nós Preview Image para ver resultados intermediários

- Experimente diferentes modelos e entenda seus pontos fortes

- Experimente com geração em lote

Mês 2: Explore Recursos Intermediários

- Aprenda sobre diferentes modelos VAE

- Entenda o controle de seed para resultados consistentes

- Explore métodos avançados de amostragem

Construindo Bibliotecas de Fluxo de Trabalho

Dicas de Organização:

- Salve fluxos de trabalho bem-sucedidos com nomes descritivos

- Crie modelos para diferentes tipos de imagem

- Documente configurações que funcionam bem para modelos específicos

Convenção de Nomenclatura de Fluxo de Trabalho:

- "Basic_Portrait_SD15.json"

- "Landscape_SDXL_HighQuality.json"

- "ConceptArt_FLUX_Fast.json"

Escolhendo Seu Caminho de Aprendizado

Embora dominar o sistema de nós do ComfyUI forneça controle criativo incrível e profundo entendimento da geração de imagens AI, vale a pena considerar seus objetivos e investimento de tempo.

Benefícios do Caminho ComfyUI:

- Controle completo sobre cada parâmetro de geração

- Compreensão de como a geração de imagens AI realmente funciona

- Capacidade de criar fluxos de trabalho personalizados para necessidades específicas

- Acesso a modelos e técnicas modernas

Considerações Alternativas: Para criadores focados em resultados em vez de maestria técnica, plataformas como Apatero.com fornecem geração de imagens AI de qualidade profissional com os modelos e otimizações mais recentes, sem exigir criação de fluxo de trabalho baseada em nós.

A escolha depende de você querer se tornar um especialista em ComfyUI ou simplesmente criar imagens incríveis com eficiência.

Técnicas Avançadas de Nós para Usuários Intermediários

Uma vez que você dominou o uso básico de nós, essas técnicas intermediárias expandem suas capacidades.

Gerenciamento de Tokens de Prompt

O CLIP Text Encode tem complexidade oculta em torno dos limites de tokens:

Considerações de Tokens:

- Limite padrão: 77 tokens por prompt

- Tokens são unidades de subpalavra, não palavras

- Palavras comuns usam menos tokens

- Termos incomuns usam mais tokens

Estratégias para Prompts Longos:

- Use CLIP Text Encode (SDXL) para prompts estendidos

- Encadeie múltiplos nós CLIP para expansão de tokens

- Priorize termos importantes no início do prompt

- Remova termos redundantes ou de baixo impacto

Entender os tokens ajuda você a criar prompts mais eficazes dentro das limitações do modelo.

Quer pular a complexidade? Apatero oferece resultados profissionais de IA instantaneamente sem configuração técnica.

Otimização de Empty Latent

As configurações de Empty Latent Image afetam mais do que apenas a resolução:

Usos de Tamanho de Lote:

- Tamanho de lote 1: Geração única para iteração

- Tamanho de lote 2-4: Exploração rápida de variação

- Tamanho de lote 8+: Execuções de produção quando satisfeito

Impacto na Memória: Cada item do lote multiplica o uso de VRAM. Um lote de 4 em 1024x1024 usa aproximadamente 4x a memória de uma geração única.

Estratégia de Resolução: Gere em resolução mais baixa para testar composição, depois amplie para resolução final. Isso economiza tempo significativo durante a iteração.

Técnicas Avançadas do KSampler

Além das configurações básicas, o KSampler oferece controle sutil:

Combinações de Scheduler: Diferentes combinações de scheduler/sampler produzem resultados diferentes. Teste combinações para sua estética preferida:

- Euler a + normal: Suave, pictórico

- DPM++ 2M + karras: Nítido, detalhado

- UniPC + simple: Rápido, equilibrado

Interação da Escala CFG: A escala CFG interage com passos e scheduler. CFG mais alto precisa de mais passos para evitar artefatos. CFG mais baixo com menos passos pode produzir resultados suaves e pictóricos.

Gerenciamento de Seed:

- Salve seeds de gerações bem-sucedidas

- Use a mesma seed com diferentes configurações para comparação

- Seeds aleatórias para exploração

- Seeds fixas para consistência de produção

Otimização de Carregamento de Modelo

A estratégia de Load Checkpoint afeta o desempenho do fluxo de trabalho:

Cache de Modelo: O ComfyUI faz cache de modelos carregados. A primeira geração carrega modelos (lento), gerações subsequentes reutilizam o cache (rápido).

Design de Fluxo de Trabalho: Projete fluxos de trabalho para minimizar a troca de modelos. Carregar um novo checkpoint limpa o cache e incorre em tempo de carregamento.

Memória vs Velocidade: Mais VRAM permite mais cache. Menos VRAM significa mais sobrecarga de carregamento mas requisitos de sistema mais baixos.

Construindo Sobre Fundamentos: Padrões Comuns de Fluxo de Trabalho

Padrões padrão que estendem nós básicos em fluxos de trabalho práticos.

Fluxo de Trabalho Img2Img

Transforme imagens existentes usando o processo de difusão:

Adições de Nó:

- Nó Load Image para imagem de origem

- VAE Encode para criar latente inicial

- Use esse latente em vez de Empty Latent

- Menor denoise no KSampler (0.3-0.7)

Este fluxo de trabalho refina imagens existentes em vez de gerar do zero.

Integração ControlNet

Adicione controle estrutural às gerações:

Extensão de Fluxo de Trabalho:

- Adicione nós ControlNet (requer nós personalizados)

- Processe imagem de referência para sinal de controle

- Injete sinal de controle na geração

- Balance força de controle com criatividade

ControlNet transforma fluxos de trabalho básicos em ferramentas de composição precisas. Saiba mais em nosso guia de combinações ControlNet.

Modificação de Estilo LoRA

Aplique estilos treinados às suas gerações:

Ganhe Até $1.250+/Mês Criando Conteúdo

Junte-se ao nosso programa exclusivo de afiliados criadores. Seja pago por vídeo viral com base no desempenho. Crie conteúdo no seu estilo com total liberdade criativa.

Fluxo de Trabalho LoRA:

- Nó Load LoRA após Load Checkpoint

- Conecte saídas do checkpoint através do LoRA

- Ajuste força do LoRA (0.5-1.0 típico)

- Múltiplos LoRAs podem se encadear juntos

LoRAs fornecem controle estético refinado sem mudar modelos base.

Fluxo de Trabalho de Inpainting

Regenere seletivamente regiões da imagem:

Configuração de Inpainting:

- Carregue imagem com máscara

- Use VAE Encode for Inpainting

- Aplique modelo de inpainting apropriado

- Controle área regenerada com prompts

Inpainting permite edição precisa de imagem. Veja nosso guia de editor de máscara para técnicas profissionais.

Fundamentos de Otimização de Desempenho

Obtenha melhor desempenho de nós básicos com essas otimizações.

Eficiência de Resolução

A resolução impacta dramaticamente o desempenho:

Diretrizes de Desempenho:

- 512x512: ~1 segundo por passo (baseline)

- 768x768: ~2 segundos por passo

- 1024x1024: ~4 segundos por passo

- 1536x1536: ~9 segundos por passo

Fluxo de Trabalho Ótimo: Gere em resolução eficiente, depois amplie. Muitos usuários geram em 512 ou 768 e então ampliam para 1024 ou maior.

Otimização de Contagem de Passos

Mais passos nem sempre é melhor:

Diretrizes de Passos por Sampler:

- Euler a: 20-30 passos ótimos

- DPM++ 2M: 25-35 passos ótimos

- DDIM: 40-50 passos para qualidade

Além dos pontos ótimos, passos adicionais adicionam tempo sem melhoria de qualidade.

Desempenho VAE

Codificação/decodificação VAE adiciona sobrecarga:

Otimização VAE:

- VAE padrão: Boa qualidade, velocidade moderada

- VAE tiling: Permite resoluções mais altas

- VAE slicing: Reduz VRAM para processamento em lote

Para otimização abrangente de desempenho, muitas técnicas se baseiam em entender esses comportamentos fundamentais de nós.

Solucionando Problemas Básicos de Nós

Problemas comuns com nós essenciais e suas soluções.

Erros de Conexão

Quando os nós não se conectam:

Diagnosticar Tipo de Conexão:

- As cores devem corresponder (roxo a roxo, amarelo a amarelo)

- Verifique compatibilidade de tipo de dados

- Verifique se o nó não está esperando dados diferentes

Correções Comuns:

- Use nós conversores apropriados

- Verifique a documentação do nó para entradas esperadas

- Verifique versão correta do nó

Falhas de Geração

Quando a geração produz erros:

Erros do KSampler:

- Verifique compatibilidade modelo/CLIP/VAE

- Verifique se a resolução é divisível por 8

- Reduza tamanho do lote para problemas de VRAM

- Atualize ComfyUI para correções mais recentes

Erros de Carregamento de Modelo:

- Verifique integridade do arquivo do modelo

- Verifique espaço de armazenamento suficiente

- Confirme compatibilidade de formato do modelo

Problemas de Qualidade

Quando a geração funciona mas os resultados são ruins:

Problemas de Prompt:

- Adicione termos de qualidade (obra-prima, alta qualidade)

- Use prompts negativos para problemas comuns

- Balance especificidade do prompt

Problemas de Configurações:

- Aumente passos para detalhes

- Ajuste CFG para aderência ao prompt

- Tente diferente sampler/scheduler

Estendendo Seu Conhecimento

Recursos para aprendizado contínuo além do básico.

Próximos Passos

Após dominar esses nós:

- ControlNet - Controle preciso de composição

- Upscaling - Saída de alta resolução

- Aprimoramento de Rosto - Detalhes faciais melhorados

- Geração de Vídeo - Usando Wan 2.2

Cada extensão se baseia nesses nós fundamentais.

Recursos da Comunidade

Conecte-se com a comunidade ComfyUI:

Recursos de Aprendizado:

- Documentação oficial do ComfyUI

- Bibliotecas de fluxo de trabalho da comunidade

- Canais de vídeo tutorial

- Comunidades Discord

Bibliotecas de Fluxo de Trabalho

Estude fluxos de trabalho existentes:

Benefícios:

- Aprenda com exemplos funcionais

- Entenda padrões profissionais

- Descubra novas técnicas

- Construa sobre fundações testadas

Conclusão e Sua Jornada ComfyUI

Dominar esses cinco nós essenciais - Load Checkpoint, CLIP Text Encode, Empty Latent Image, KSampler e VAE Decode - dá a você a fundação para criar qualquer imagem AI que você possa imaginar. Cada fluxo de trabalho avançado do ComfyUI se baseia nesses mesmos blocos de construção básicos.

Seu Roteiro de Aprendizado:

- Esta Semana: Domine conectar os 5 nós essenciais

- Próxima Semana: Experimente com diferentes modelos e prompts

- Mês 1: Construa confiança com vários tipos e tamanhos de imagem

- Mês 2: Explore nós intermediários e otimização de fluxo de trabalho

- Mês 3+: Crie fluxos de trabalho personalizados para suas necessidades criativas específicas

Principais Conclusões:

- Comece simples com os 5 nós essenciais

- Foque em entender conexões antes de adicionar complexidade

- Pratique com diferentes prompts e configurações

- Salve fluxos de trabalho que funcionam bem para uso futuro

- Seja paciente - maestria no ComfyUI vem através de experiência prática

Passos de Ação Imediata:

- Baixe o ComfyUI e instale um modelo Stable Diffusion

- Crie seu primeiro fluxo de trabalho usando os 5 nós essenciais

- Gere 10 imagens diferentes mudando apenas os prompts

- Experimente com diferentes tamanhos de imagem e configurações do KSampler

- Salve seu primeiro fluxo de trabalho bem-sucedido como modelo

Lembre-se, cada especialista em ComfyUI começou com esses mesmos nós básicos. A complexidade que parece avassaladora hoje se tornará segunda natureza conforme você pratica. Seja você continuando a construir expertise avançada em ComfyUI ou escolhendo alternativas simplificadas como Apatero.com, entender esses fundamentos lhe dá o conhecimento para tomar decisões informadas sobre seu fluxo de trabalho de geração de imagens AI.

Sua jornada criativa com geração de imagens AI começa com esses cinco nós - domine-os, e você dominou a fundação de criatividade visual ilimitada.

Perguntas Frequentes Sobre Nós Essenciais do ComfyUI

Quais são os 5 nós essenciais do ComfyUI para iniciantes?

Os 5 nós essenciais são Load Checkpoint, CLIP Text Encode, Empty Latent Image, KSampler e VAE Decode. Esses nós formam o pipeline completo para gerar imagens AI.

Como eu conecto os nós do ComfyUI para geração básica de imagens?

Conecte o MODEL do Load Checkpoint à entrada model do KSampler, CLIP a dois nós CLIP Text Encode, VAE ao VAE Decode. Conecte ambas as saídas CLIP Text Encode às entradas positive e negative do KSampler, Empty Latent Image ao latent_image do KSampler, e a saída do KSampler ao VAE Decode.

Quais configurações do KSampler eu deveria usar como iniciante?

Use 20-30 passos, escala CFG 7-12, sampler euler_a ou dpmpp_2m, scheduler normal e seed -1 para geração aleatória. Essas configurações fornecem qualidade e velocidade equilibradas para aprendizado.

Por que meu fluxo de trabalho ComfyUI está mostrando erros de entrada faltante?

Erros de entrada faltante ocorrem quando conexões necessárias não são feitas. Verifique se o KSampler tem conexões para model, positive, negative e latent_image. VAE Decode precisa de conexões vae e samples. CLIP Text Encode precisa de conexão clip do Load Checkpoint.

Que tamanho de imagem eu deveria usar para primeiras gerações ComfyUI?

Comece com 512x512 pixels para geração rápida e testes. Uma vez confortável, tente 768x768 para melhor qualidade. Modelos SD 1.5 funcionam bem em 512x512-768x768, SDXL em 1024x1024 e FLUX em 1024x1024 ou maior.

Quanto tempo leva para gerar uma imagem com ComfyUI?

O tempo de geração depende do hardware e configurações. Com RTX 3060, espere 15-30 segundos para imagens 512x512 em 25 passos. RTX 4090 gera o mesmo em 4-8 segundos. Imagens maiores e mais passos aumentam o tempo de geração proporcionalmente.

Posso salvar meu fluxo de trabalho ComfyUI para uso posterior?

Sim, salve fluxos de trabalho usando o botão "Save" no menu do ComfyUI. Fluxos de trabalho salvam como arquivos .json contendo todas as configurações e conexões dos nós. Carregue fluxos de trabalho salvos usando o botão "Load" para reutilizar configurações exatas.

Qual é a diferença entre prompts positivos e negativos?

Prompts positivos descrevem o que você quer na imagem (assunto, estilo, iluminação, detalhes). Prompts negativos descrevem o que você não quer (desfocado, baixa qualidade, características distorcidas). Ambos ajudam a guiar a AI em direção ao seu resultado desejado fornecendo orientação direcional.

Eu preciso de nós diferentes para diferentes modelos AI?

Não, os mesmos 5 nós essenciais funcionam com todos os modelos AI (SD 1.5, SDXL, FLUX). Load Checkpoint carrega qualquer tipo de modelo. A estrutura do fluxo de trabalho permanece idêntica - apenas o modelo carregado e tamanhos de imagem ótimos mudam entre tipos de modelo.

Como eu corrijo imagens de saída pretas ou corrompidas?

Imagens pretas ou corrompidas geralmente indicam problemas de conexão do VAE Decode ou combinações incompatíveis de modelo/VAE. Verifique se o VAE Decode tem conexões da saída VAE do Load Checkpoint e da saída LATENT do KSampler. Tente usar um modelo VAE diferente se os problemas persistirem.

Pronto para Criar Seu Influenciador IA?

Junte-se a 115 alunos dominando ComfyUI e marketing de influenciadores IA em nosso curso completo de 51 lições.

Artigos Relacionados

10 Erros Mais Comuns de Iniciantes no ComfyUI e Como Corrigi-los em 2025

Evite os 10 principais erros de iniciantes no ComfyUI que frustram novos usuários. Guia completo de solução de problemas com soluções para erros de VRAM, carregamento de modelos...

25 Dicas e Truques do ComfyUI Que Usuários Pro Não Querem Que Você Saiba em 2025

Descubra 25 dicas avançadas do ComfyUI, técnicas de otimização de workflow e truques de nível profissional que usuários experts utilizam. Guia completo de ajuste de CFG, processamento em lote e melhorias de qualidade.

Rotação 360 de Anime com Anisora v3.2: Guia Completo de Rotação de Personagens no ComfyUI 2025

Domine a rotação 360 graus de personagens de anime com Anisora v3.2 no ComfyUI. Aprenda fluxos de trabalho de órbita de câmera, consistência multi-view e técnicas profissionais de animação de turnaround.