ComfyUI 初学者指南:2025年基于节点的AI图像生成入门教程

完整的ComfyUI初学者指南。安装、第一个工作流、基本节点以及开始使用基于节点的Stable Diffusion的技巧。

ComfyUI是Stable Diffusion最强大的界面。 它对初学者来说也很令人生畏。基于节点的界面看起来很复杂,但一旦你理解了基础知识,它提供的控制比任何其他选项都多。

快速回答: ComfyUI是一个基于节点的Stable Diffusion界面,提供最大的灵活性和性能。首先通过便携版本(Windows)或git clone(Mac/Linux)进行安装,下载检查点模型,加载默认工作流,然后生成你的第一张图像。学习曲线约为2-4小时即可达到基本熟练程度。

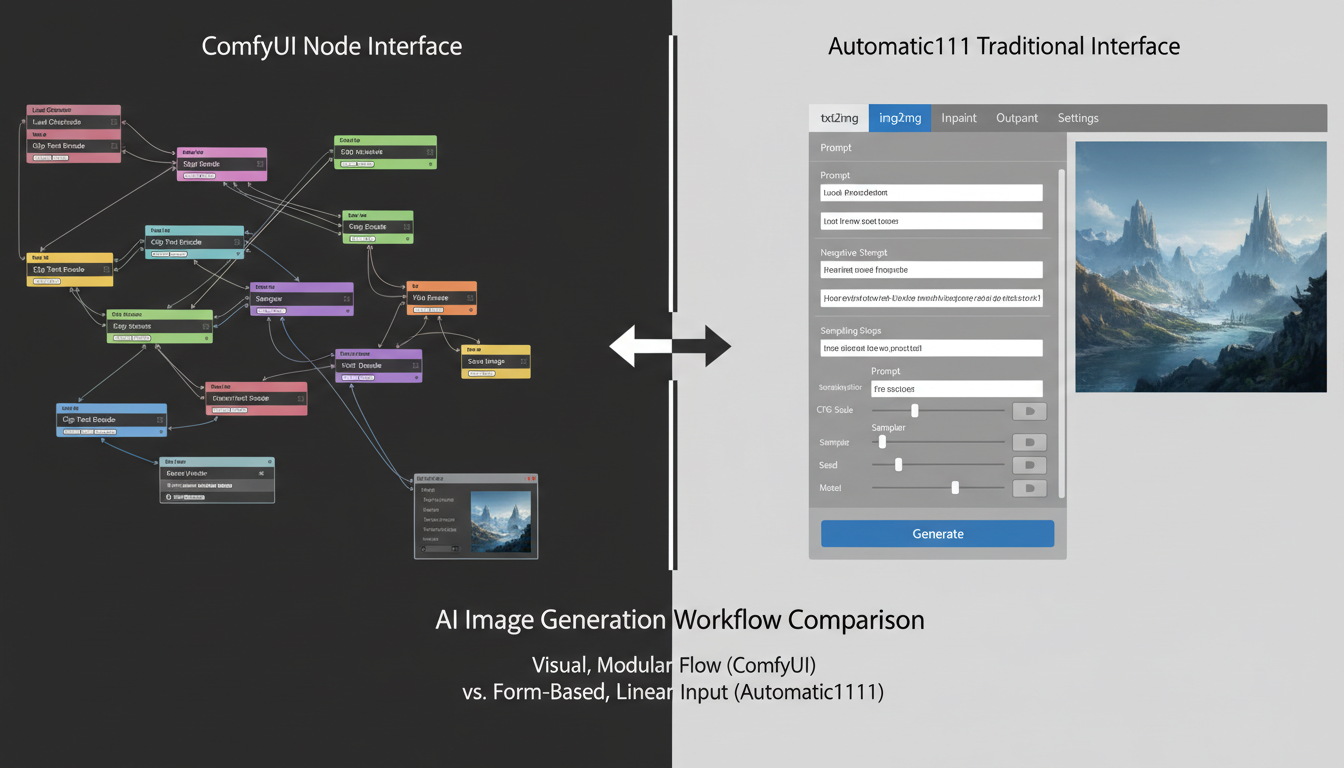

- ComfyUI比Automatic1111提供更多控制,但有学习曲线

- 使用便携版本安装需要15-30分钟

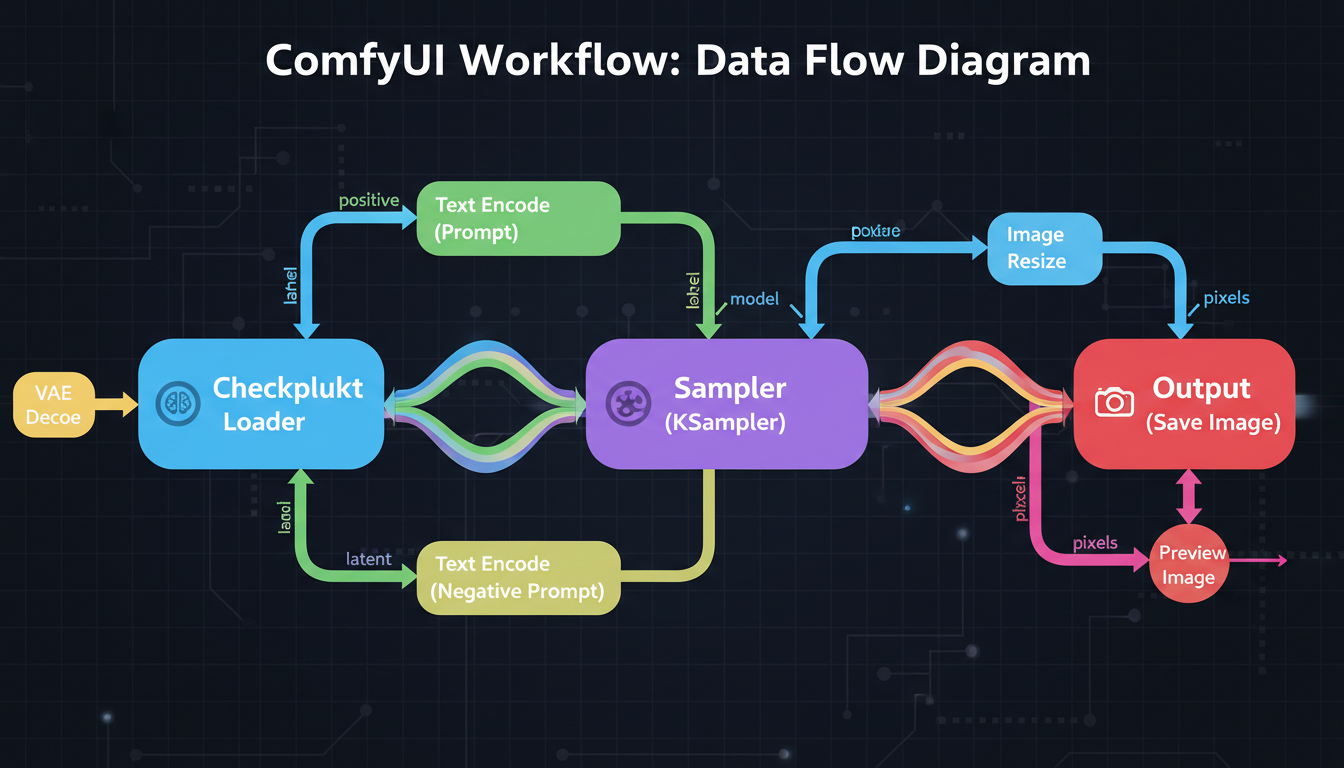

- 基本工作流:加载检查点 → 文本编码 → KSampler → VAE解码 → 保存

- 节点连接代表数据流——颜色表示数据类型

- 最低8GB显存,建议12GB+

- 一旦学会,工作流可以轻松保存和分享

为什么选择ComfyUI而不是Automatic1111?

让我解释为什么ComfyUI值得学习:

ComfyUI的优势

性能:

- 相同任务使用更少显存

- 在许多情况下生成更快

- 更好的内存管理

- 高效的批处理

灵活性:

- 完全控制每一步

- 轻松混合不同模型

- 可能实现复杂工作流

- 易于实验

可重复性:

- 工作流是自包含的

- 分享精确配置

- 可视化调试

- 理解正在发生的事情

高级功能:

- 更好的ControlNet处理

- 复杂的LoRA组合

- 多模型管道

- 自定义节点生态系统

什么时候Automatic1111就够了

- 快速、简单的生成

- 你想要熟悉的界面

- 不需要复杂的工作流

- 技术兴趣有限

我的建议

学习ComfyUI。最初的学习曲线会带来更多能力和对Stable Diffusion工作原理的更好理解。

ComfyUI以初始复杂性为代价提供更多功能

ComfyUI以初始复杂性为代价提供更多功能

安装

Windows(便携版 - 推荐)

步骤1:下载

- 访问ComfyUI GitHub releases

- 下载最新的便携包

- 解压到一个文件夹(避免路径中有空格)

步骤2:首次运行

- 双击

run_nvidia_gpu.bat - 等待初始设置(首次可能需要几分钟)

- 浏览器打开到

http://127.0.0.1:8188

步骤3:下载模型

- 从CivitAI或Hugging Face获取检查点

- 放置在

ComfyUI/models/checkpoints/ - 刷新界面

Mac/Linux(Git Clone)

步骤1:先决条件

## 需要Python 3.10+

python3 --version

## 需要Git

git --version

步骤2:克隆和安装

git clone https://github.com/comfyanonymous/ComfyUI.git

cd ComfyUI

pip install -r requirements.txt

步骤3:运行

python main.py

## 浏览器打开到 http://127.0.0.1:8188

文件夹结构

安装后,了解文件夹:

ComfyUI/

├── models/

│ ├── checkpoints/ # 主模型 (.safetensors)

│ ├── loras/ # LoRA文件

│ ├── vae/ # VAE文件

│ ├── controlnet/ # ControlNet模型

│ ├── upscale_models/ # 放大模型

│ └── embeddings/ # 文本反转

├── input/ # 输入图像

├── output/ # 生成的图像

└── custom_nodes/ # 扩展

理解节点

ComfyUI使用通过线连接的节点。每个节点做一件事。线在节点之间传递数据。

节点如何工作

输入(左侧):

- 从其他节点接收数据

- 彩色点表示数据类型

- 必须连接兼容的类型

输出(右侧):

- 向其他节点发送数据

- 颜色匹配数据类型

- 可以连接到多个输入

节点主体:

- 包含设置/参数

- 用于选择的下拉菜单

- 用于值的数字输入

数据类型(颜色)

| 颜色 | 数据类型 | 描述 |

|---|---|---|

| 粉色 | MODEL | 已加载的检查点模型 |

| 黄色 | CLIP | 文本编码器组件 |

| 紫色 | VAE | 图像编码器/解码器 |

| 橙色 | CONDITIONING | 编码的文本提示 |

| 青色 | LATENT | 潜在空间中的图像 |

| 绿色 | IMAGE | 实际图像数据 |

连接节点时,颜色必须匹配。你不能直接将MODEL连接到CONDITIONING。

基本节点

加载检查点:

- 加载你的模型文件

- 输出:MODEL、CLIP、VAE

CLIP文本编码:

- 将文本转换为条件

- 输入:CLIP、文本

- 输出:CONDITIONING

KSampler:

- 实际生成在这里发生

- 输入:MODEL、正/负条件、LATENT

- 输出:LATENT(生成的图像)

VAE解码:

- 将潜在转换为可查看图像

- 输入:VAE、LATENT

- 输出:IMAGE

保存图像:

- 保存到输出文件夹

- 输入:IMAGE

理解节点连接是ComfyUI的关键

理解节点连接是ComfyUI的关键

你的第一个工作流

让我带你创建一个基本的图像生成工作流。

步骤1:加载默认工作流

当ComfyUI启动时,会出现默认工作流。如果没有:

- 点击"Load Default"按钮

- 或拖入工作流PNG

默认工作流包括基本生成所需的一切。

步骤2:选择你的模型

- 找到"Load Checkpoint"节点

- 点击下拉菜单

- 选择你下载的模型

- 如果没有模型出现,你还没有在

models/checkpoints/中放置任何模型

步骤3:编写提示词

正面提示(你想要什么):

- 找到连接到"positive"的CLIP文本编码

- 在文本框中输入你的提示词

- 例如:

美丽的风景,山脉,日落,细节,8k

负面提示(要避免什么):

- 找到连接到"negative"的CLIP文本编码

- 输入质量负面词

- 例如:

模糊,低质量,差,丑

步骤4:配置设置

在KSampler节点中:

seed: 用于可重复性的随机数。使用-1表示随机。

steps: 生成步骤。大多数模型为20-30。

cfg: 提示词遵守度。典型值为5-8。

sampler_name: 算法。euler或dpmpp_2m是好的默认值。

scheduler: 步骤调度器。normal或karras效果很好。

denoise: 改变多少。文本到图像为1.0。

步骤5:生成

- 点击"Queue Prompt"按钮(或按Ctrl+Enter)

- 在节点边框中观察进度

- 图像出现在预览/保存节点中

- 在

output/文件夹中找到保存的图像

首次生成故障排除

"未加载检查点":

- 确保模型在正确的文件夹中

- 添加模型后刷新页面

- 检查文件扩展名是.safetensors或.ckpt

内存不足:

- 尝试较小的分辨率(768x768 → 512x512)

- 关闭其他使用GPU的程序

- 使用较小的模型

黑色或噪点图像:

- 检查VAE是否已连接

- 验证模型与分辨率兼容

- 尝试不同的种子

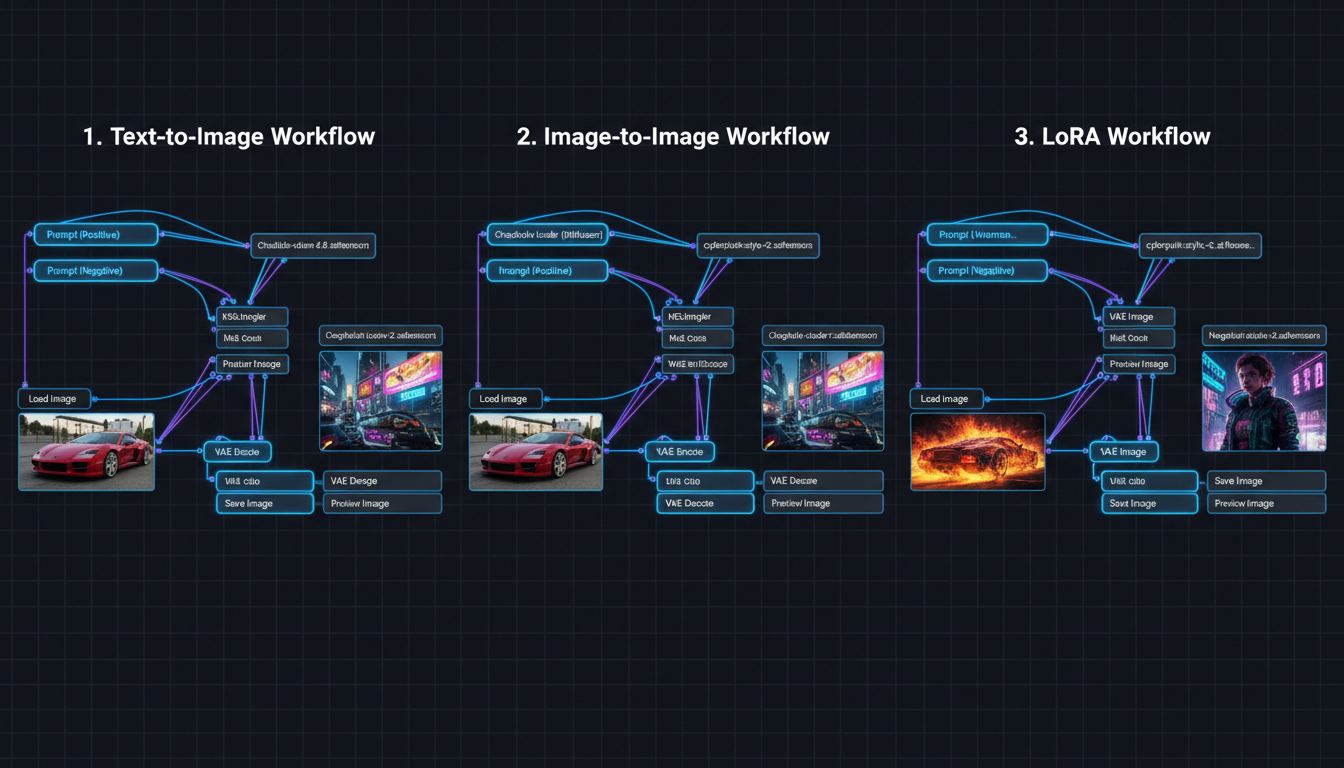

实用工作流

文本到图像(基础)

默认工作流。你有:

- 检查点加载你的模型

- 两个CLIP编码器(正/负)

- 空白潜在图像(空白画布)

- KSampler进行生成

- VAE解码显示图像

- 保存图像存储结果

图像到图像

修改现有图像:

- 添加"Load Image"节点

- 连接到"VAE Encode"节点

- VAE编码输出 → KSampler latent_image输入

- 设置denoise < 1.0(典型为0.5-0.8)

较低的denoise = 保留更多原始内容。

使用LoRA

添加风格/角色LoRA:

- 添加"Load LoRA"节点

- 连接检查点MODEL → LoRA MODEL输入

- 连接检查点CLIP → LoRA CLIP输入

- 连接LoRA输出 → 工作流的其余部分

- 设置强度(0.5-1.0)

多个LoRA?将它们链接在一起。

放大

提高分辨率:

- 添加"Upscale Image"或基于模型的放大器

- 在VAE解码后连接

- 保存放大的版本

或使用潜在放大以获得更好的质量(更复杂的工作流)。

不同用例的不同工作流

不同用例的不同工作流

自定义节点

ComfyUI的强大来自自定义节点——添加功能的扩展。

安装自定义节点

方法1:ComfyUI Manager(推荐)

- 首先安装ComfyUI Manager

- 重启ComfyUI

- 点击"Manager"按钮

- 浏览并安装节点

- 安装后重启

方法2:手动

cd ComfyUI/custom_nodes

git clone https://github.com/[author]/[node-repo].git

## 重启ComfyUI

基本自定义节点

ComfyUI Manager:

- 节点/模型安装器

- 故障排除工具

- 每个人都必需

Impact Pack:

- 额外的采样器

- 放大工具

- 面部修复

ControlNet辅助预处理器:

- 姿势检测

- 深度图

- 边缘检测

IPAdapter:

- 面部/风格转移

- 角色一致性

- 基于参考的生成

WAS节点套件:

- 许多实用节点

- 文本工具

- 图像操作

查找工作流

工作流作为带有嵌入数据的PNG文件共享:

- CivitAI(共享许多工作流)

- OpenArt.ai(工作流库)

- Reddit r/comfyui

- GitHub存储库

将工作流PNG拖入ComfyUI即可加载。

AI配置

ComfyUI没有内置内容过滤器。对于AI生成:

创作内容每月赚取$1,250+

加入我们的独家创作者联盟计划。根据病毒视频表现获得报酬。以完全的创作自由按您的风格创作内容。

使用适当的模型

- CyberRealistic(写实)

- Pony Diffusion(动漫)

- epiCRealism(写实)

放置在models/checkpoints/中。

AI LoRA

- 在CivitAI上查找

- 放置在

models/loras/中 - 添加加载LoRA节点

- 设置适当的强度

无需额外配置

与Automatic1111不同,ComfyUI没有需要禁用的安全检查器。模型本身决定能力。

常见问题和解决方案

问题:节点无法连接

原因: 不兼容的数据类型。

解决方案: 检查颜色匹配。不能直接将MODEL连接到IMAGE。

问题:工作流错误

原因: 缺少模型或节点。

解决方案:

- 安装缺少的自定义节点

- 下载所需模型

- 检查文件路径

问题:生成缓慢

原因: 高分辨率、许多步骤、有限的显存。

解决方案:

- 降低分辨率

- 更少的步骤(20通常足够)

- 关闭其他程序

- 如果可用,使用fp16/fp8

问题:每次输出相同

原因: 固定种子。

解决方案: 将种子设置为-1表示随机。

问题:找不到保存的图像

原因: 在错误的文件夹中查找。

解决方案: 检查ComfyUI/output/文件夹。

初学者技巧

从简单开始

不要立即尝试复杂的工作流。首先掌握基本的文本到图像。

保存工作的工作流

当某些东西有效时:

- 点击"Save"按钮

- 保存为.json文件

- 或保存工作流图像(具有嵌入数据)

使用预览节点

在任何地方添加"Preview Image"节点以查看中间结果。有助于调试。

学习键盘快捷键

- Ctrl+Enter: 队列提示

- Ctrl+Shift+Enter: 队列前面

- Ctrl+D: 复制选定的节点

- Ctrl+A: 全选

- Delete/Backspace: 删除选定

阅读节点描述

将鼠标悬停在节点和输入上以获取解释其功能的工具提示。

加入社区

- Reddit:r/comfyui

- Discord服务器

- YouTube教程

- CivitAI工作流

何时使用云替代方案

ComfyUI很强大,但需要:

- 硬件投资

- 学习时间

- 持续维护

像Apatero这样的平台提供:

- 无需设置

- 内置角色一致性

- 视频生成

- 按使用付费定价

考虑云服务,如果:

- 你没有强大的GPU

- 你想要立即的结果

- 角色一致性是优先事项

- 你需要视频生成

考虑本地,如果:

- 你有硬件

- 你想要最大控制

- 隐私至关重要

- 你喜欢技术学习

常见问题解答

ComfyUI比Automatic1111更难吗?

最初是的。但是一旦你理解了节点,它就会变得更直观。可视化流程帮助你理解正在发生的事情。

我需要什么GPU?

最低8GB显存(GTX 1070、RTX 2060级别)。建议12GB+以便舒适使用(RTX 3060、4070)。更多显存 = 更高分辨率和更快生成。

我可以使用Automatic1111扩展吗?

不,它们不兼容。但大多数A1111功能通过自定义节点在ComfyUI中有等效功能。

如何更新ComfyUI?

对于便携版:下载新版本,复制模型文件夹。

对于git:在ComfyUI目录中执行git pull。

我在哪里可以找到模型?

CivitAI和Hugging Face是主要来源。下载.safetensors文件并放置在适当的文件夹中。

ComfyUI可以做视频吗?

可以,使用AnimateDiff、WAN或类似的自定义节点。比图像更复杂,但可能。

入门检查清单

设置:

- 下载ComfyUI(便携版或git)

- 安装/解压到合适的位置

- 至少下载一个检查点模型

- 将模型放置在models/checkpoints/中

- 成功运行ComfyUI

首次生成:

- 加载默认工作流

- 在加载检查点中选择你的模型

- 编写简单的正面提示词

- 添加基本的负面提示词

- 点击队列提示

- 在output/中找到保存的图像

下一步:

- 安装ComfyUI Manager

- 尝试img2img工作流

- 添加LoRA

- 探索自定义节点

- 保存你的第一个自定义工作流

最后的想法

ComfyUI有学习曲线,但它是最有能力的Stable Diffusion界面。可视化节点系统使复杂的工作流成为可能,并帮助你理解AI图像生成的实际工作方式。

从默认工作流开始。生成一些图像。实验设置。逐渐增加复杂性。几个小时内,你会感到舒适。几天内,你会更喜欢它而不是其他界面。

时间投资在能力和理解方面得到回报。你创建的工作流可以随时间保存、共享和完善。

准备好创建你的AI网红了吗?

加入115名学生,在我们完整的51节课程中掌握ComfyUI和AI网红营销。

相关文章

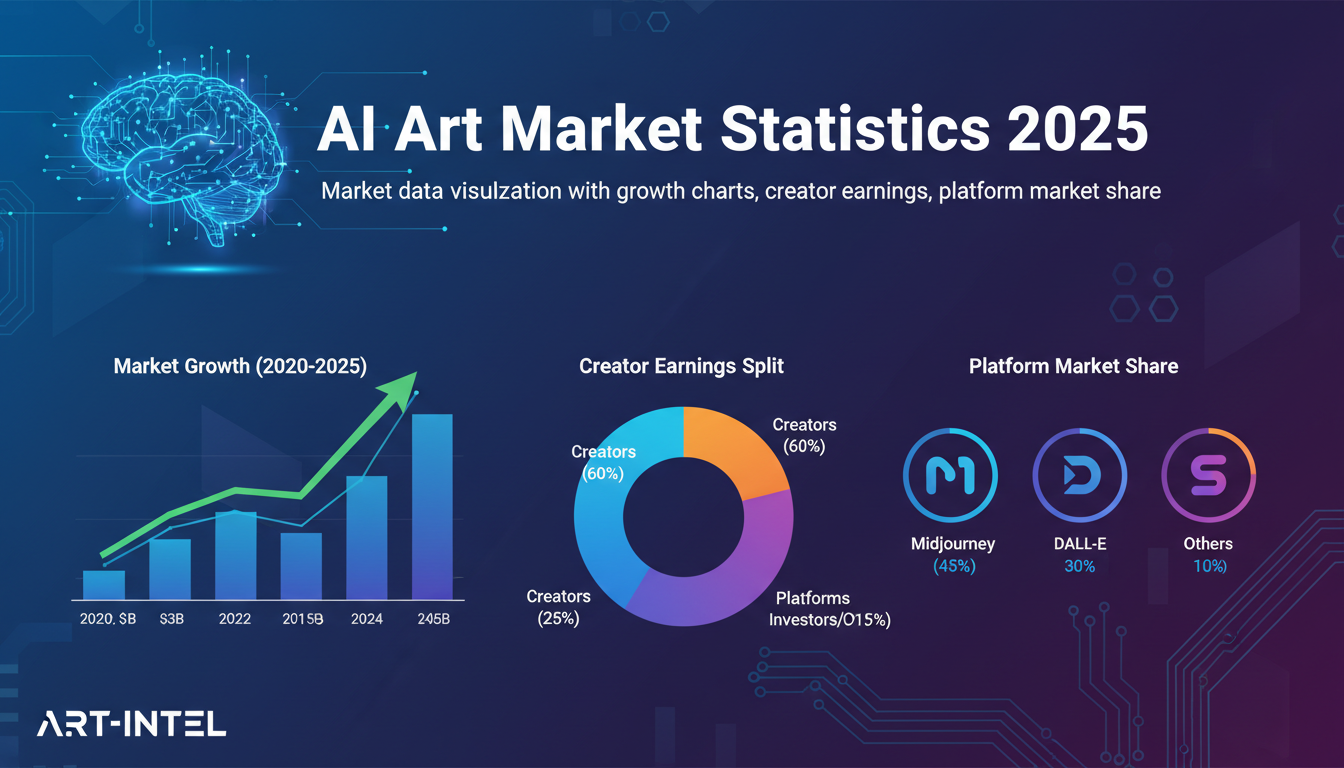

2025年AI艺术市场统计数据:行业规模、趋势与增长预测

全面的AI艺术市场统计数据,包含市场规模、创作者收入、平台数据和增长预测,涵盖75+个数据点。

AI自动化工具:在2025年变革您的业务工作流程

发现最佳AI自动化工具,变革您的业务工作流程。学习如何使用AI自动化重复性任务、提升效率并扩展运营规模。

AI头像生成器:我测试了15款用于个人资料图片、游戏和社交媒体的工具(2026)

2026年最佳AI头像生成器全面评测。我测试了15款工具,涵盖个人资料图片、3D头像、卡通风格、游戏角色和专业应用场景。