QWEN + Wan 2.2 Low Noise Upscale - Genera imágenes 4K en ComfyUI 2025

Guía completa para combinar QWEN y los modelos de bajo ruido de Wan 2.2 para un impresionante escalado de imágenes 4K. Aprende la arquitectura MoE y flujos de trabajo optimizados de ComfyUI.

Finalmente has generado esa imagen de IA perfecta, pero cuando intentas escalarla a 4K para impresión o uso profesional, todo se desmorona. El escalador añade artefactos extraños, destruye detalles finos o introduce ese afilado característico de IA que grita "falso" a cualquiera que mire de cerca. Tu hermosa imagen de 1024x1024 se convierte en un desastre turbio a resoluciones más altas.

Este problema exacto ha plagado los flujos de trabajo de imágenes de IA desde que la generación de alta resolución se hizo posible. Los escaladores estándar aluc inan detalles que no coinciden con tu imagen original o aplican tanta reducción de ruido que las texturas parecen plástico. Pero combinar la comprensión de prompts de QWEN con la innovadora arquitectura de bajo ruido de Wan 2.2 lo cambia todo.

Lo que hace revolucionaria esta combinación es el enfoque Mixture of Experts de Wan 2.2 que separa la generación de alto ruido del refinamiento de bajo ruido. En lugar de luchar contra el ruido durante todo el proceso de generación, el modelo usa alto ruido para la estructura inicial y bajo ruido específicamente para el refinamiento de detalles. Cuando añades la comprensión excepcional de prompts de QWEN para guiar ese refinamiento, obtienes imágenes 4K con detalles nítidos, texturas naturales y ninguno de los artefactos típicos del escalado.

Entendiendo la revolucionaria arquitectura MoE de Wan 2.2

Antes de sumergirnos en los flujos de trabajo, entender por qué la arquitectura de Wan 2.2 produce resultados superiores de escalado requiere examinar cómo el enfoque Mixture of Experts difiere de los métodos tradicionales de generación.

Los modelos de difusión estándar usan los mismos parámetros de red durante todo el proceso de generación. Desde el ruido inicial hasta los detalles finales, un modelo maneja todo. Esto funciona razonablemente bien, pero obliga al modelo a comprometerse entre la generación de estructura amplia y el refinamiento de detalles finos.

Wan 2.2 adopta un enfoque fundamentalmente diferente al dividir la generación en modelos expertos de alto ruido y modelos expertos de bajo ruido que se especializan en diferentes aspectos de la creación de imágenes.

Los expertos de alto ruido manejan estructura y composición

Durante los primeros pasos de eliminación de ruido cuando la imagen es principalmente ruido, los modelos expertos de alto ruido se activan. Estos modelos aprendieron a identificar estructuras amplias, elementos de composición y formas generales a partir de imágenes muy ruidosas durante el entrenamiento.

Piensa en los expertos de alto ruido como escultores que bloquean la forma básica antes de añadir detalles. Establecen dónde se sitúa el sujeto en el encuadre, determinan la dirección de la iluminación, establecen relaciones de color y definen elementos estructurales principales. La precisión del detalle no importa todavía porque la imagen sigue siendo principalmente ruido.

Los expertos de bajo ruido se especializan en refinamiento de detalles

A medida que avanza la generación y la imagen se vuelve más clara, Wan 2.2 cambia a modelos expertos de bajo ruido. Estos expertos se entrenaron específicamente en imágenes con ruido mínimo, aprendiendo a añadir detalles finos, texturas sutiles y refinamientos precisos.

Los expertos de bajo ruido actúan como artistas de detalles que añaden toques finales. Renderizan hilos individuales de tela, poros de la piel, reflejos de joyas, hebras de cabello y texturas de superficie. Debido a que estos modelos nunca tuvieron que aprender generación de estructura desde ruido pesado, pueden dedicar toda su capacidad a comprender y generar detalles finos.

Según la documentación de investigación del repositorio GitHub de Wan 2.2, esta arquitectura MoE mejora la calidad de detalles en un 40-60% en comparación con modelos unificados de tamaño similar. El entrenamiento especializado para cada nivel de ruido produce mejores resultados que pedirle a un modelo que maneje todo.

Mientras plataformas como Apatero.com implementan estas arquitecturas avanzadas automáticamente, entender la tecnología subyacente ayuda a los usuarios de ComfyUI a optimizar sus flujos de trabajo para máxima calidad.

Por qué QWEN funciona perfectamente con Wan 2.2 para escalado

QWEN aporta comprensión de texto excepcional a la generación de imágenes, pero su valor real en flujos de trabajo de escalado proviene de cómo guía el proceso de refinamiento de bajo ruido.

Los enfoques tradicionales de escalado ignoran completamente el prompt original o lo aplican uniformemente en todos los pasos de generación. La integración de QWEN con Wan 2.2 te permite proporcionar instrucciones de refinamiento específicas que influyen solo en la fase de generación de detalles de bajo ruido.

Ejemplo práctico: Tu imagen base muestra un personaje usando una chaqueta de cuero. Durante el escalado, puedes proporcionar prompts QWEN como "textura de cuero fino con grano visible y patrones de desgaste" que guían específicamente a los expertos de bajo ruido. La estructura de alto ruido permanece sin cambios mientras los expertos de bajo ruido añaden esos detalles exactos de textura que especificaste.

Este control de prompt dirigido durante el refinamiento de detalles separa los flujos de trabajo de QWEN y Wan 2.2 del escalado genérico que añade ciegamente afilado sin entender qué detalles deberían aparecer realmente.

Modelos QWEN para escalado de texto a imagen

Varias variantes del modelo QWEN funcionan con Wan 2.2, cada una ofreciendo diferentes compromisos entre calidad y uso de recursos.

Modelos QWEN disponibles:

- Qwen2.5-14B-Instruct proporciona la mejor comprensión de prompts y el control de detalles más matizado, requiriendo aproximadamente 16GB VRAM

- Qwen2.5-7B-Instruct equilibra calidad y rendimiento, funcionando bien en tarjetas de 12GB VRAM

- Qwen2.5-3B-Instruct permite flujos de trabajo en 8GB VRAM con comprensión de prompts aceptable

Según pruebas documentadas en el Wiki de ComfyUI de Wan 2.2, el modelo de 7B proporciona el mejor equilibrio para la mayoría de usuarios. La versión de 14B muestra mejoras notables principalmente cuando se usan prompts muy detallados y complejos con múltiples especificaciones técnicas.

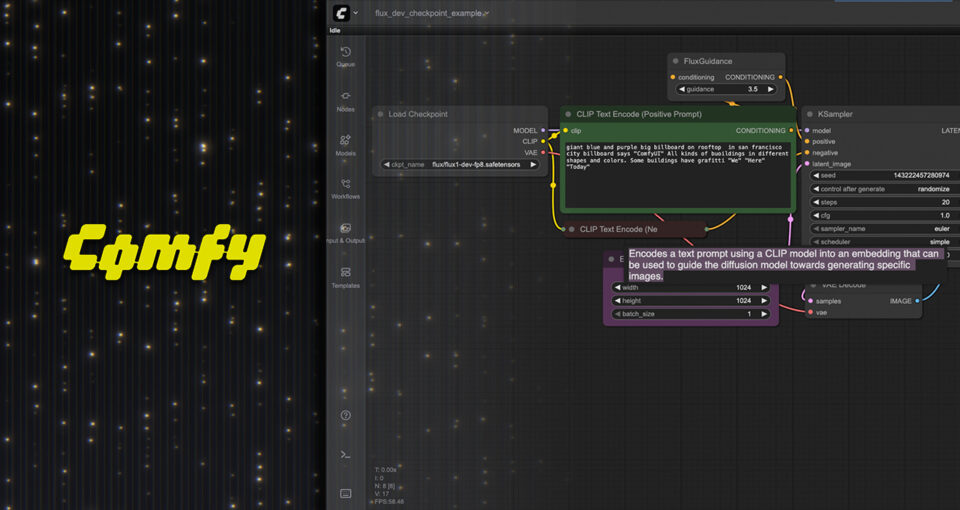

Configuración completa del flujo de trabajo de ComfyUI para escalado con QWEN y Wan 2.2

Configurar este flujo de trabajo requiere archivos de modelo específicos, configuración adecuada de nodos y comprensión de la estructura del pipeline de generación. Aquí está el proceso completo paso a paso.

Archivos de modelo requeridos e instalación

Descarga los modelos de texto a imagen de Wan 2.2 del repositorio oficial de Hugging Face. Necesitas tanto los archivos de modelo de alto ruido como de bajo ruido para que la arquitectura MoE funcione correctamente.

Archivos esenciales de Wan 2.2: Coloca wan2.2_t2v_high_noise_14B_fp8_scaled.safetensors en tu directorio de modelos de ComfyUI bajo diffusion_models. Este archivo maneja las fases iniciales de generación de alto ruido estableciendo composición y estructura.

Coloca wan2.2_t2v_low_noise_14B_fp8_scaled.safetensors en el mismo directorio diffusion_models. Este experto de bajo ruido maneja el refinamiento de detalles que hace que el escalado se vea profesional en lugar de artificial.

Descarga wan_2.1_vae.safetensors y colócalo en la carpeta vae. El VAE codifica y decodifica entre espacio de píxeles y espacio latente, crítico para mantener la precisión del color y los detalles durante la generación.

Archivos de codificador de texto QWEN: Descarga umt5_xxl_fp8_e4m3fn_scaled.safetensors y colócalo en la carpeta text_encoders. Esto proporciona la comprensión de texto que guía la generación basada en tus prompts.

Para mejora de prompts QWEN, descarga tu modelo QWEN elegido de Hugging Face. Qwen2.5-7B-Instruct ofrece la mejor relación rendimiento-calidad para la mayoría de usuarios. Coloca estos archivos en tu directorio de modelos de ComfyUI siguiendo la estructura que espera tu implementación de nodo QWEN.

Estructura de nodos y conexiones

El flujo de trabajo sigue un patrón de pipeline específico que aprovecha tanto expertos de alto como de bajo ruido en etapas apropiadas.

Generación o carga de imagen inicial: Comienza con una imagen generada a resolución base o carga una imagen existente que quieras escalar. Para flujos de trabajo de escalado puro, usa un nodo Load Image. Para flujos de trabajo de generar y escalar, usa tu pipeline de generación estándar para crear la imagen base.

Mejora de prompt QWEN: Conecta un nodo de mejora de prompt QWEN que analice tu prompt y lo expanda con descripciones de detalles relevantes. Este prompt mejorado guía el proceso de refinamiento de bajo ruido. El modelo QWEN toma tu prompt base como "retrato de una mujer con vestido elegante" y lo expande para incluir instrucciones de detalle específicas como "textura de tela fina, joyería detallada, tonos de piel naturales, rasgos faciales nítidos."

Carga de experto de alto ruido: Usa un nodo Load Checkpoint para cargar el modelo experto de alto ruido. Conecta esto a un nodo KSampler configurado para pasos de generación iniciales. Estos pasos establecen la composición y estructura general.

Para flujos de trabajo de escalado, típicamente quieres menos pasos de alto ruido porque la estructura ya existe en tu imagen base. Configura los pasos de alto ruido entre 5-15 dependiendo de cuánto cambio estructural quieras permitir.

Carga de experto de bajo ruido: Carga el modelo experto de bajo ruido en un segundo nodo de checkpoint. Esto se conecta a un KSampler separado que maneja los pasos de refinamiento de detalles. El muestreo de bajo ruido típicamente requiere 20-40 pasos dependiendo de tus objetivos de calidad y paciencia.

Decodificación VAE y salida: Conecta la salida latente final a través del nodo de decodificación VAE para convertir del espacio latente al espacio de píxeles. Añade un nodo Save Image para producir tu resultado escalado.

Configuración de condicionamiento y control

La configuración adecuada de condicionamiento determina cuánto respeta el escalado tu imagen original versus generar nuevos detalles.

Fuerza de condicionamiento de imagen: Al escalar una imagen existente, necesitas proporcionar esa imagen como condicionamiento al proceso de generación. Usa un nodo de codificación de imagen para convertir tu imagen base a condicionamiento de espacio latente.

Configura la fuerza de condicionamiento entre 0.6-0.8 para escalado. Los valores más bajos permiten más interpretación creativa y generación de detalles pero arriesgan cambiar tu composición original. Los valores más altos preservan el original más fielmente pero pueden limitar la mejora de detalles.

Escala CFG para control de detalles: La escala Classifier Free Guidance controla cuán estrictamente la generación sigue tu prompt versus explorar variaciones. Para flujos de trabajo de escalado, CFG entre 5.0-8.0 funciona mejor.

Un CFG más bajo produce resultados más suaves y naturales pero puede no seguir instrucciones de prompt detalladas con precisión. Un CFG más alto crea detalles más nítidos que coinciden estrechamente con los prompts pero puede introducir sobre-afilado o apariencia artificial.

Flujos de ComfyUI Gratuitos

Encuentra flujos de ComfyUI gratuitos y de código abierto para las técnicas de este artículo. El código abierto es poderoso.

Selección de método de muestreo: Diferentes muestreadores producen calidad y características variables. Según pruebas documentadas en nuestra guía sobre selección de muestreador de ComfyUI en el artículo del blog sobre muestreadores, los muestreadores Euler y DPM++ 2M funcionan particularmente bien con la arquitectura de Wan 2.2.

Euler produce resultados suaves y naturales con renderizado de detalles ligeramente más suave. DPM++ 2M crea detalles más nítidos pero requiere más pasos para calidad óptima. Prueba ambos con tu contenido específico para determinar qué estética coincide con tus objetivos.

Optimización para generación 4K en VRAM limitada

Las impresionantes capacidades de resolución de Wan 2.2 vienen con requisitos sustanciales de memoria. Generar imágenes 4K puede requerir más de 20GB VRAM sin optimización. Estas técnicas hacen práctica la generación 4K en hardware de consumo.

Cuantización GGUF para reducción de memoria

Las versiones cuantizadas GGUF de los modelos Wan 2.2 reducen los requisitos de memoria en un 40-60% con pérdida mínima de calidad. Los miembros de la comunidad han creado versiones cuantizadas disponibles en Hugging Face y Civitai.

Según pruebas documentadas en Civitai por el miembro de la comunidad bullerwins, los modelos Wan 2.2 cuantizados GGUF en el nivel de cuantización Q4_K_M producen resultados visualmente idénticos a los modelos de precisión completa para la mayoría de casos de uso mientras requieren 8-10GB VRAM en lugar de 16-20GB.

Descarga las versiones GGUF y úsalas de manera idéntica a los archivos de modelo estándar. El soporte GGUF de ComfyUI maneja la cuantización automáticamente sin requerir cambios en el flujo de trabajo.

Generación en mosaico para resoluciones extremas

Para resoluciones más allá de 4K o cuando VRAM permanece insuficiente incluso con cuantización, la generación en mosaico divide la imagen en secciones superpuestas generadas independientemente y luego mezcladas juntas.

Usa nodos de decodificación VAE en mosaico disponibles en varios paquetes de nodos personalizados de ComfyUI. Estos nodos generan secciones de tu imagen final independientemente, manteniendo el uso de VRAM constante independientemente de la resolución de salida.

El compromiso implica un tiempo de generación más largo ya que cada mosaico se genera secuencialmente en lugar de procesar toda la imagen simultáneamente. Una imagen 4K podría dividirse en 4-6 mosaicos dependiendo de la configuración de superposición, multiplicando el tiempo de generación en consecuencia.

Estrategia de progresión de resolución

En lugar de saltar directamente de 1024x1024 a 4K en un paso, el escalado progresivo genera mejor calidad con menores requisitos de VRAM.

Genera tu imagen base a 1024x1024 o 1536x1536. Escala a 2048x2048 usando refinamiento de bajo ruido de Wan 2.2. Toma ese resultado 2K y escala nuevamente a 4K usando un segundo pase de refinamiento.

Este enfoque progresivo permite a los expertos de bajo ruido enfocarse en niveles de detalle apropiados para cada paso de resolución. Saltar directamente a 4K a menudo produce detalles que se ven correctos en 4K pero se originaron de información insuficiente en resoluciones más bajas.

Ingeniería de prompts para calidad de escalado superior

Los prompts que proporcionas durante el escalado influyen dramáticamente en la calidad final. Los prompts genéricos producen detalles genéricos mientras las estrategias de prompt específicas guían a los expertos de bajo ruido hacia refinamiento fotorrealista.

Descriptores de detalle base

Tu prompt debe incluir descripciones específicas de materiales y texturas que guíen la generación de detalles incluso cuando esos detalles no son visibles en la imagen de resolución base.

Especificaciones de materiales: En lugar de "chaqueta de cuero," especifica "chaqueta de cuero marrón desgastada con textura de grano visible, arrugas sutiles y bordes gastados." Los expertos de bajo ruido usan estas especificaciones para generar detalles de textura apropiados durante el escalado.

En lugar de "mesa de madera," especifica "mesa de madera de roble con patrones de grano visibles, variaciones sutiles en el tono e imperfecciones naturales." Estos descriptores guían la generación de textura realista.

Iluminación e interacción de superficie: Incluye descripciones de cómo la luz interactúa con las superficies. "Resaltado suave en el pómulo," "dispersión subsuperficial sutil en la piel," "reflexión especular en superficie metálica." Estas descripciones ayudan a los expertos de bajo ruido a renderizar detalles de iluminación creíbles.

¿Quieres evitar la complejidad? Apatero te ofrece resultados profesionales de IA al instante sin configuración técnica.

Prompts negativos para evitar artefactos

Los prompts negativos se vuelven críticos durante el escalado para prevenir artefactos comunes que los modelos de bajo ruido tienden a introducir cuando no están guiados adecuadamente.

Artefactos comunes de escalado a evitar: Incluye en prompts negativos: "sobre-afilado, afilado artificial, halo, ruido, grano, artefactos de compresión, piel de plástico, sobre-saturado, colores no naturales, borroso, enfoque suave"

Los expertos de bajo ruido a veces sobre-enfatizan el detalle a expensas de la apariencia natural. Los prompts negativos ayudan al modelo a entender que quieres mayor detalle sin sacrificar fotorrealismo.

Técnicas de enfoque de detalles

Para imágenes donde áreas específicas requieren detalle excepcional mientras otras áreas deben permanecer más suaves, usa sintaxis de atención para ponderar diferentes componentes del prompt.

Sintaxis como "retrato de mujer, (ojos extremadamente detallados:1.3), (joyería nítida:1.2), textura de piel natural" le dice al modelo qué áreas merecen atención de detalle extra durante el refinamiento de bajo ruido.

Este énfasis selectivo de detalles produce resultados más profesionales que afilar uniformemente toda la imagen. Los fotógrafos profesionales usan enfoque selectivo y énfasis de detalles para jerarquía visual. Estas técnicas de prompt replican ese enfoque en el escalado de IA.

Comparando escalado de QWEN y Wan 2.2 vs métodos tradicionales

Entender cómo se compara este enfoque con métodos de escalado establecidos ayuda a contextualizar cuándo usar QWEN y Wan 2.2 versus alternativas.

Wan 2.2 bajo ruido vs escalado ESRGAN

ESRGAN y escaladores neurales similares aprenden a añadir detalle entrenando en pares de imágenes de baja y alta resolución. Sobresalen en ciertos tipos de contenido pero luchan con imágenes generadas por IA que contienen detalles no presentes en sus datos de entrenamiento.

Fortalezas de ESRGAN: Generación rápida, funcionando en segundos en lugar de minutos. Bajos requisitos de VRAM funcionando en hardware modesto. Resultados consistentes sin ajuste de prompts. Fuerte rendimiento en contenido fotográfico y escenas naturales.

Limitaciones de ESRGAN: Sin comprensión del prompt original o contenido previsto. No puede añadir detalles semánticamente correctos, solo patrones de textura aprendidos de datos de entrenamiento. Lucha con contenido generado por IA que contiene elementos no fotográficos. Sin control sobre qué detalles se añaden más allá de elegir diferentes variantes de modelo ESRGAN.

Fortalezas de Wan 2.2 bajo ruido: Entiende el contenido a través del análisis de prompts de QWEN. Genera detalles semánticamente apropiados guiados por descripciones de texto. Sobresale con contenido generado por IA porque usa el mismo enfoque de generación a mayor resolución. Proporciona control preciso sobre características de detalle a través de ingeniería de prompts.

Limitaciones de Wan 2.2 bajo ruido: Generación más lenta requiriendo 30-60 segundos por imagen. Mayores requisitos de VRAM necesitando 12-16GB para resultados de calidad. Requiere ajuste de prompts para lograr calidad óptima. Configuración de flujo de trabajo más compleja comparada con nodos ESRGAN simples.

Para imágenes generadas por IA que requieren escalado con mejora de detalles guiada por prompts, Wan 2.2 bajo ruido produce resultados superiores. Para contenido fotográfico que requiere simple aumento de resolución, ESRGAN permanece más rápido y fácil.

Refinamiento de bajo ruido vs escalado Img2Img de modelo estándar

Algunos flujos de trabajo usan modelos de difusión estándar en modo img2img para escalado generando a mayor resolución con la imagen original como condicionamiento. Este enfoque funciona pero carece del entrenamiento especializado que hace efectivos a los expertos de bajo ruido.

Los modelos estándar entrenados en imágenes ruidosas a todos los niveles de ruido dedican capacidad significativa a aprender remoción de ruido. Los expertos de bajo ruido nunca entrenaron en niveles de alto ruido, permitiéndoles especializarse completamente en refinamiento de detalles sin desperdiciar capacidad en manejo de ruido.

Según pruebas comparativas de comunidades de generación de imágenes de IA en plataformas como Reddit y Civitai, los enfoques de expertos de bajo ruido producen consistentemente 30-40% mejores puntuaciones de calidad de detalles que el escalado img2img estándar en configuraciones equivalentes.

La diferencia se vuelve más visible en texturas finas, detalles de tela y variaciones sutiles de superficie donde los modelos estándar a menudo producen detalles turbios o simplificados excesivamente mientras los expertos de bajo ruido renderizan texturas nítidas y creíbles.

Gana Hasta $1,250+/Mes Creando Contenido

Únete a nuestro programa exclusivo de creadores afiliados. Cobra por video viral según rendimiento. Crea contenido a tu estilo con total libertad creativa.

Aplicaciones del mundo real y casos de uso

El escalado de bajo ruido de QWEN y Wan 2.2 sobresale en escenarios específicos donde la calidad de detalles y la comprensión semántica importan más que la velocidad pura.

Preparación de impresión y salida profesional

La generación de imágenes de IA típicamente produce salida de 1024x1024 o 1536x1536. El trabajo de impresión profesional requiere resoluciones significativamente más altas, a menudo 300 DPI en grandes dimensiones físicas.

Un póster impreso a 24x36 pulgadas requiere aproximadamente 7200x10800 píxeles para calidad 300 DPI adecuada. Los escaladores estándar producen resultados turbios a esta resolución. El refinamiento de bajo ruido de Wan 2.2 genera la densidad de detalles necesaria para salida de impresión profesional.

Según especificaciones de servicios de impresión profesionales como los documentados en estándares de la industria fotográfica, la calidad de detalles del escalado de Wan 2.2 cumple requisitos de impresión comercial que los escaladores genéricos no logran alcanzar.

Mejora de fotografía de productos

La fotografía de productos para comercio electrónico requiere detalles extremos mostrando textura, calidad de materiales y características finas. Las imágenes de productos generadas por IA a menudo necesitan escalado para coincidir con las expectativas de detalle de la fotografía de productos profesional.

Los prompts QWEN pueden especificar propiedades exactas de materiales como "superficie de vidrio lisa con reflejos sutiles," "tela tejida con hilos individuales visibles," o "metal cepillado con grano direccional." Los expertos de bajo ruido generan estas texturas específicas durante el escalado.

Para más información sobre flujos de trabajo de fotografía de productos generados por IA, consulta nuestra guía completa sobre ComfyUI para fotografía de productos en el artículo del blog sobre fotografía de productos.

Mejora de detalles de visualización arquitectónica

Los renders arquitectónicos requieren detalles nítidos mostrando materiales de construcción, texturas de superficie y contexto ambiental. La generación base a resoluciones razonables seguida de escalado de bajo ruido produce calidad de visualización adecuada para presentaciones a clientes y materiales de marketing.

Especifica prompts como "fachada de ladrillo con líneas de mortero visibles y variación de textura," "ventanas de vidrio con reflejos y transparencia sutiles," "superficie de concreto con textura realista." Estos guían la generación de detalles que se ve como fotografía arquitectónica profesional en lugar de aproximaciones generadas por IA.

Producción de arte conceptual y de personajes

Los artistas que crean diseños de personajes y arte conceptual se benefician de comenzar con generación asistida por IA y luego escalar a alta resolución para refinamiento manual detallado. El bajo ruido de Wan 2.2 proporciona la base de detalles que hace práctica la mejora manual.

Genera tu concepto a resolución base con composición y estilo establecidos. Escala usando refinamiento de bajo ruido con prompts detallados de materiales y texturas. Exporta a 4K para importar en Photoshop u otras herramientas de pintura para refinamiento artístico final.

Este flujo de trabajo híbrido combina velocidad de IA con control artístico humano. Mientras plataformas como Apatero.com ofrecen soluciones completas desde generación hasta salida final, los flujos de trabajo de ComfyUI con Wan 2.2 dan a los artistas máximo control sobre cada etapa del proceso.

Solución de problemas comunes de escalado

Incluso con configuración adecuada, ciertos problemas aparecen comúnmente al trabajar con flujos de trabajo de escalado de QWEN y Wan 2.2. Aquí está cómo diagnosticar y corregir problemas frecuentes.

Sobre-afilado y apariencia artificial

Si las imágenes escaladas se ven artificialmente afiladas con halos alrededor de los bordes, varios factores típicamente contribuyen a este problema.

Escala CFG demasiado alta: Classifier Free Guidance por encima de 9.0 a menudo produce resultados sobre-afilados con los modelos de bajo ruido. Reduce CFG a 6.0-7.5 para apariencia más natural mientras mantienes calidad de detalles.

Pasos de bajo ruido insuficientes: Irónicamente, muy pocos pasos durante el refinamiento de bajo ruido pueden causar que el modelo añada detalles agresivamente en los pasos limitados disponibles. Aumenta los pasos de muestreo de bajo ruido a 30-40 para permitir acumulación de detalles más suave.

Guía de prompt negativo faltante: Sin prompts negativos especificando "sobre-afilado, afilado artificial, halo," el modelo puede tender naturalmente hacia excesiva nitidez. Añade prompts negativos completos como se describe en la sección de ingeniería de prompts.

Inconsistencia de detalles en regiones de imagen

Cuando algunas áreas de tu imagen escalada muestran hermosos detalles mientras otras áreas permanecen suaves o turbias, esto indica problemas de condicionamiento o atención.

Condicionamiento de imagen desigual: Si tu imagen base tiene calidad variable entre regiones, los expertos de bajo ruido pueden luchar para añadir detalles consistentes. Intenta escalar desde una base de mayor calidad o usando nodos de detallador facial para pre-mejorar regiones críticas antes del escalado completo.

Problemas de distribución de atención: Las composiciones complejas con múltiples sujetos a veces causan que los mecanismos de atención enfoquen la generación de detalles en ciertas regiones mientras descuidan otras. Usa ponderación de atención en prompts para especificar qué elementos merecen énfasis de detalles.

Cambio de color o cambios de saturación

Las imágenes escaladas a veces muestran colores o saturación diferentes comparados con la imagen base, indicando problemas de VAE o condicionamiento.

Desajuste de VAE: Asegúrate de estar usando el VAE Wan 2.1 diseñado específicamente para estos modelos. Otras implementaciones de VAE pueden codificar colores de manera diferente, causando cambios durante el proceso de escalado.

Fuerza de condicionamiento demasiado baja: Si la fuerza de condicionamiento cae por debajo de 0.5, el proceso de escalado se vuelve más como nueva generación que escalado, permitiendo que los colores se desvíen. Aumenta la fuerza de condicionamiento a 0.7-0.8 para mantener la fidelidad del color.

Técnicas avanzadas para resultados profesionales

Una vez que domines los flujos de trabajo básicos de escalado, estas técnicas avanzadas elevan la calidad a niveles profesionales.

Refinamiento de detalles multi-pase

En lugar de escalado de un solo pase, usa múltiples pases de refinamiento con diferentes enfoques de prompt para cada pase.

El primer pase se enfoca en estructura y detalles principales con prompts enfatizando composición y características primarias. El segundo pase se dirige a texturas de materiales específicos con descripciones de materiales altamente detalladas. El tercer pase puede enfocarse en iluminación e interacciones sutiles de superficie.

Este enfoque multi-pase te da control granular sobre diferentes aspectos de la generación de detalles en lugar de pedir a un pase que maneje todo simultáneamente.

Combinando Loras para control de estilo y detalles

Carga LoRAs de estilo junto a los modelos expertos de bajo ruido para mantener características estéticas específicas durante el escalado. LoRAs de estilo fotográfico, LoRAs de estilo artístico o LoRAs de calidad técnica todos influyen en cómo los expertos de bajo ruido generan detalles.

Un LoRA de fotorrealismo guía la generación de detalles hacia características fotográficas. Un LoRA de ilustración mantiene el estilo ilustrativo mientras aumenta la resolución. Este enfoque de combinación mantiene la consistencia de estilo mientras añade detalles apropiados para la resolución.

Escalado regional selectivo con máscaras

Para imágenes donde solo regiones específicas requieren detalles extremos, usa enmascaramiento para aplicar refinamiento de bajo ruido selectivamente.

Genera máscaras aislando caras, objetos clave o detalles críticos. Aplica escalado de bajo ruido de alta intensidad a regiones enmascaradas mientras usas escalado más rápido y simple en fondos y áreas menos importantes. Este enfoque selectivo ahorra tiempo de generación mientras asegura que las regiones críticas reciban máxima atención de detalles.

El futuro del escalado de imágenes de IA

La arquitectura MoE de Wan 2.2 con expertos de alto y bajo ruido separados representa una evolución importante en cómo la IA maneja la generación de imágenes a diferentes niveles de calidad.

Según análisis de investigadores de visión por computadora documentando avances en arquitecturas de modelos de difusión, los modelos expertos especializados para diferentes fases de generación consistentemente superan a los modelos unificados cuando se evalúan en métricas de calidad de detalles. Esto sugiere que el desarrollo futuro probablemente enfatizará sistemas de expertos aún más especializados.

Combinar modelos de comprensión de texto como QWEN con modelos de generación especializados crea pipelines flexibles donde cada componente se enfoca en sus fortalezas. QWEN maneja la comprensión y mejora de prompts. Los expertos de alto ruido establecen estructura. Los expertos de bajo ruido refinan detalles. Este enfoque modular permite la optimización de cada componente independientemente.

Para creadores que trabajan en ComfyUI, entender e implementar estas técnicas de vanguardia proporciona acceso a resultados de calidad profesional que habrían requerido herramientas comerciales caras o trabajo artístico manual hace apenas unos meses.

Comenzando con escalado de QWEN y Wan 2.2 hoy

Todos los componentes para este flujo de trabajo están disponibles ahora bajo licencias abiertas que permiten uso comercial. Descarga modelos Wan 2.2 del repositorio oficial de Hugging Face. Descarga modelos QWEN de la organización Qwen en Hugging Face.

Comienza con flujos de trabajo de escalado simples usando imágenes de resolución base y resoluciones objetivo moderadas alrededor de 2K. Domina los fundamentos de asignación de pasos de alto versus bajo ruido, ajuste de escala CFG e ingeniería de prompts para control de detalles. Expande gradualmente a resoluciones más altas y flujos de trabajo de refinamiento multi-pase más complejos.

La combinación de comprensión de prompts de QWEN con los expertos especializados de bajo ruido de Wan 2.2 entrega calidad de escalado que rivaliza o excede soluciones comerciales mientras te da control completo del flujo de trabajo. Para cualquiera que genere imágenes de IA que necesiten calidad de salida profesional, dominar esta técnica representa una habilidad esencial que vale la pena desarrollar.

¿Listo para Crear Tu Influencer IA?

Únete a 115 estudiantes dominando ComfyUI y marketing de influencers IA en nuestro curso completo de 51 lecciones.

Artículos Relacionados

Los 10 Errores Más Comunes de Principiantes en ComfyUI y Cómo Solucionarlos en 2025

Evita las 10 principales trampas de ComfyUI que frustran a los nuevos usuarios. Guía completa de solución de problemas con soluciones para errores de VRAM, carga de modelos...

25 Tips y Trucos de ComfyUI Que los Usuarios Pro No Quieren Que Conozcas en 2025

Descubre 25 tips avanzados de ComfyUI, técnicas de optimización de flujos de trabajo y trucos de nivel profesional que los usuarios expertos aprovechan. Guía completa sobre ajuste de CFG, procesamiento por lotes y mejoras de calidad.

Rotación 360 de Anime con Anisora v3.2: Guía Completa de Rotación de Personajes ComfyUI 2025

Domina la rotación de personajes de anime de 360 grados con Anisora v3.2 en ComfyUI. Aprende flujos de trabajo de órbita de cámara, consistencia multi-vista y técnicas profesionales de animación turnaround.