QWEN + Wan 2.2 低ノイズアップスケール - ComfyUIで4K画像を生成する 2025年版

QWENとWan 2.2の低ノイズモデルを組み合わせて、美しい4K画像アップスケールを実現する完全ガイド。MoEアーキテクチャと最適化されたComfyUIワークフローを学びます。

完璧なAI画像をついに生成できたのに、印刷やプロフェッショナル用途のために4Kにアップスケールしようとすると、すべてが台無しになってしまいます。アップスケーラーが奇妙なアーティファクトを追加したり、細かいディテールを破壊したり、近くで見ると「偽物」だとすぐにわかるAI特有のシャープニングを導入したりします。美しい1024x1024の画像が、高解像度では濁った混乱になってしまいます。

この正確な問題は、高解像度生成が可能になって以来、AI画像ワークフローを悩ませてきました。標準的なアップスケーラーは、元の画像と一致しないディテールを幻覚したり、ノイズリダクションを過度に適用してテクスチャがプラスチックのように見えたりします。しかし、QWENのプロンプト理解とWan 2.2の革新的な低ノイズアーキテクチャを組み合わせることで、すべてが変わります。

この組み合わせが革命的である理由は、Wan 2.2のMixture of Expertsアプローチが高ノイズ生成と低ノイズリファインメントを分離していることです。生成プロセス全体でノイズと戦う代わりに、モデルは初期構造に高ノイズを使用し、ディテールのリファインメントには特に低ノイズを使用します。QWENの優れたプロンプト理解を追加してそのリファインメントをガイドすると、鮮明なディテール、自然なテクスチャ、そして典型的なアップスケーリングアーティファクトのない4K画像が得られます。

Wan 2.2の革命的なMoEアーキテクチャを理解する

ワークフローに入る前に、Wan 2.2のアーキテクチャが優れたアップスケーリング結果を生み出す理由を理解するには、Mixture of Expertsアプローチが従来の生成方法とどのように異なるかを調べる必要があります。

標準的な拡散モデルは、生成プロセス全体を通じて同じネットワークパラメータを使用します。初期ノイズから最終的なディテールまで、1つのモデルがすべてを処理します。これはかなりうまく機能しますが、広範な構造生成と細かいディテールのリファインメントの間でモデルに妥協を強いることになります。

Wan 2.2は、画像作成のさまざまな側面に特化した高ノイズエキスパートモデルと低ノイズエキスパートモデルに生成を分割することで、根本的に異なるアプローチを取ります。

高ノイズエキスパートが構造と構成を処理する

画像がほとんどノイズである最初のデノイジングステップ中、高ノイズエキスパートモデルがアクティブになります。これらのモデルは、トレーニング中に大きくノイズのある画像から広範な構造、構成要素、一般的な形状を識別することを学習しました。

高ノイズエキスパートを、ディテールを追加する前に基本的な形状をブロックアウトする彫刻家と考えてください。被写体がフレーム内のどこに位置するか、照明の方向を決定し、色の関係を設定し、主要な構造要素を定義します。画像がまだほとんどノイズであるため、ディテールの正確さはまだ重要ではありません。

低ノイズエキスパートがディテールのリファインメントに特化する

生成が進行し、画像がより鮮明になると、Wan 2.2は低ノイズエキスパートモデルに切り替わります。これらのエキスパートは、最小限のノイズを持つ画像で特別にトレーニングされ、細かいディテール、微妙なテクスチャ、正確なリファインメントを追加することを学習しました。

低ノイズエキスパートは、最終的なタッチを追加するディテールアーティストのように動作します。個々の布地の糸、肌の毛穴、ジュエリーの反射、髪の毛、表面のテクスチャをレンダリングします。これらのモデルは重いノイズから構造生成を学習する必要がなかったため、全体の能力を細かいディテールの理解と生成に捧げることができます。

Wan 2.2 GitHubリポジトリの研究文書によると、このMoEアーキテクチャは、同様のサイズの統一モデルと比較して、ディテール品質を40〜60%向上させます。各ノイズレベルの特殊なトレーニングは、1つのモデルにすべてを処理させるよりも優れた結果を生み出します。

Apatero.comのようなプラットフォームはこれらの高度なアーキテクチャを自動的に実装していますが、基礎となる技術を理解することで、ComfyUIユーザーは最大の品質のためにワークフローを最適化できます。

QWENがアップスケーリングのためにWan 2.2と完璧に機能する理由

QWENは画像生成に優れたテキスト理解をもたらしますが、アップスケーリングワークフローにおける真の価値は、低ノイズリファインメントプロセスをガイドする方法から来ています。

従来のアップスケーリングアプローチは、元のプロンプトを完全に無視するか、すべての生成ステップに均一に適用します。QWENのWan 2.2との統合により、低ノイズディテール生成フェーズのみに影響を与える特定のリファインメント指示を提供できます。

実用例: ベース画像には、レザージャケットを着たキャラクターが表示されています。アップスケーリング中に、「可視的な粒子とウェアパターンを持つ細かい革のテクスチャ」のようなQWENプロンプトを提供でき、これが低ノイズエキスパートを具体的にガイドします。高ノイズ構造は変更されないままですが、低ノイズエキスパートは指定した正確なテクスチャディテールを追加します。

アップスケーリング中のこのターゲットを絞ったプロンプト制御は、プロンプトを理解せずに盲目的にシャープニングを追加する一般的なアップスケーリングからQWENとWan 2.2ワークフローを分離します。

テキストから画像へのアップスケーリングのためのQWENモデル

いくつかのQWENモデルバリアントがWan 2.2と連携し、それぞれが品質とリソース使用の間で異なるトレードオフを提供します。

利用可能なQWENモデル:

- Qwen2.5-14B-Instructは、最高のプロンプト理解と最も繊細なディテール制御を提供し、約16GB VRAMを必要とします

- Qwen2.5-7B-Instructは、品質とパフォーマンスのバランスを取り、12GB VRAMカードでうまく機能します

- Qwen2.5-3B-Instructは、許容可能なプロンプト理解で8GB VRAMでのワークフローを可能にします

Wan 2.2 ComfyUI Wikiで文書化されたテストによると、7Bモデルはほとんどのユーザーに最適なバランスを提供します。14Bバージョンは、複数の技術仕様を持つ非常に詳細で複雑なプロンプトを使用する場合に主に顕著な改善を示します。

QWENとWan 2.2アップスケーリングのための完全なComfyUIワークフローセットアップ

このワークフローの設定には、特定のモデルファイル、適切なノード構成、生成パイプライン構造の理解が必要です。完全なステップバイステップのセットアッププロセスは次のとおりです。

必要なモデルファイルとインストール

公式のHugging FaceリポジトリからWan 2.2テキストから画像へのモデルをダウンロードします。MoEアーキテクチャが適切に機能するには、高ノイズと低ノイズの両方のモデルファイルが必要です。

必須のWan 2.2ファイル: wan2.2_t2v_high_noise_14B_fp8_scaled.safetensorsをComfyUIモデルディレクトリのdiffusion_modelsの下に配置します。このファイルは、構成と構造を確立する初期の高ノイズ生成フェーズを処理します。

wan2.2_t2v_low_noise_14B_fp8_scaled.safetensorsを同じdiffusion_modelsディレクトリに配置します。この低ノイズエキスパートは、アップスケーリングを人工的ではなくプロフェッショナルに見せるディテールリファインメントを処理します。

wan_2.1_vae.safetensorsをダウンロードし、vaeフォルダに配置します。VAEは、ピクセル空間と潜在空間の間でエンコードおよびデコードし、生成中の色の精度とディテールを維持するために重要です。

QWENテキストエンコーダーファイル: umt5_xxl_fp8_e4m3fn_scaled.safetensorsをダウンロードし、text_encodersフォルダに配置します。これにより、プロンプトに基づいて生成をガイドするテキスト理解が提供されます。

QWENプロンプト拡張のために、Hugging Faceから選択したQWENモデルをダウンロードします。Qwen2.5-7B-Instructは、ほとんどのユーザーにとって最高のパフォーマンス対品質比を提供します。QWENノード実装が期待する構造に従って、これらのファイルをComfyUIモデルディレクトリに配置します。

ノード構造と接続

ワークフローは、適切な段階で高ノイズと低ノイズの両方のエキスパートを活用する特定のパイプラインパターンに従います。

初期画像生成または読み込み: ベース解像度で生成された画像から始めるか、アップスケールしたい既存の画像を読み込みます。純粋なアップスケーリングワークフローの場合は、Load Imageノードを使用します。生成してアップスケールするワークフローの場合は、標準の生成パイプラインを使用してベース画像を作成します。

QWENプロンプト拡張: プロンプトを分析し、関連するディテール記述で拡張するQWENプロンプト拡張ノードを接続します。この拡張されたプロンプトは、低ノイズリファインメントプロセスをガイドします。QWENモデルは、「エレガントなドレスを着た女性のポートレート」のようなベースプロンプトを取り、「細かい布地のテクスチャ、詳細なジュエリー、自然な肌のトーン、シャープな顔の特徴」などの特定のディテール指示を含むように拡張します。

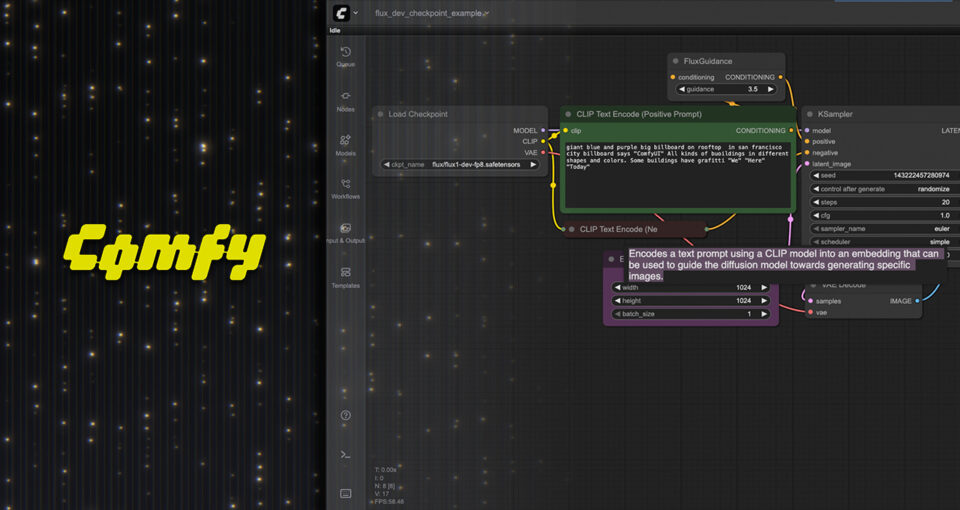

高ノイズエキスパートの読み込み: Load Checkpointノードを使用して高ノイズエキスパートモデルを読み込みます。これを初期生成ステップ用に構成されたKSamplerノードに接続します。これらのステップは、全体的な構成と構造を確立します。

アップスケーリングワークフローの場合、構造がベース画像に既に存在するため、通常は高ノイズステップが少なくて済みます。許可したい構造変更の量に応じて、高ノイズステップを5〜15の間に設定します。

低ノイズエキスパートの読み込み: 2番目のチェックポイントノードに低ノイズエキスパートモデルを読み込みます。これは、ディテールリファインメントステップを処理する別のKSamplerに接続されます。低ノイズサンプリングは通常、品質目標と忍耐に応じて20〜40ステップが必要です。

VAEデコードと出力: 最終的な潜在出力をVAEデコードノードに接続して、潜在空間からピクセル空間に変換します。Save Imageノードを追加して、アップスケールされた結果を出力します。

コンディショニングとコントロール設定

適切なコンディショニング設定により、アップスケールが元の画像をどれだけ尊重するか、新しいディテールを生成するかが決まります。

画像コンディショニング強度: 既存の画像をアップスケールする場合、その画像を生成プロセスのコンディショニングとして提供する必要があります。画像エンコードノードを使用して、ベース画像を潜在空間コンディショニングに変換します。

アップスケーリングの場合、コンディショニング強度を0.6〜0.8の間に設定します。低い値は、よりクリエイティブな解釈とディテール生成を可能にしますが、元の構成を変更するリスクがあります。高い値は、元の画像をより忠実に保持しますが、ディテールの強化を制限する可能性があります。

ディテール制御のためのCFGスケール: Classifier Free Guidanceスケールは、生成がプロンプトにどれだけ厳密に従うか、バリエーションを探索するかを制御します。アップスケーリングワークフローの場合、5.0〜8.0の間のCFGが最適です。

低いCFGは、より柔らかく自然な結果を生み出しますが、詳細なプロンプト指示に正確に従わない可能性があります。高いCFGは、プロンプトに密接に一致するシャープなディテールを作成しますが、過度のシャープニングや人工的な外観を導入する可能性があります。

無料のComfyUIワークフロー

この記事のテクニックに関する無料のオープンソースComfyUIワークフローを見つけてください。 オープンソースは強力です。

サンプリング方法の選択: 異なるサンプラーは、さまざまな品質と特性を生み出します。ブログのサンプラー記事のComfyUIサンプラー選択に関するガイドで文書化されたテストによると、EulerとDPM++ 2MサンプラーはWan 2.2のアーキテクチャで特にうまく機能します。

Eulerは、わずかに柔らかいディテールレンダリングで滑らかで自然な結果を生み出します。DPM++ 2Mは、よりシャープなディテールを作成しますが、最適な品質のためにより多くのステップが必要です。特定のコンテンツで両方をテストして、目標に一致する美学を決定してください。

制限されたVRAMでの4K生成の最適化

Wan 2.2の印象的な解像度機能には、かなりのメモリ要件が伴います。4K画像の生成には、最適化なしで20GB以上のVRAMが必要になる場合があります。これらの技術により、コンシューマーハードウェアで4K生成が実用的になります。

メモリ削減のためのGGUF量子化

Wan 2.2モデルのGGUF量子化バージョンは、品質の損失を最小限に抑えながら、メモリ要件を40〜60%削減します。コミュニティメンバーは、Hugging FaceとCivitaiで利用可能な量子化バージョンを作成しました。

コミュニティメンバーbullerwinsによってCivitaiで文書化されたテストによると、Q4_K_M量子化レベルでのGGUF量子化Wan 2.2モデルは、ほとんどのユースケースで完全精度モデルと視覚的に同一の結果を生み出し、16〜20GBではなく8〜10GB VRAMを必要とします。

GGUFバージョンをダウンロードし、標準モデルファイルと同じように使用します。ComfyUIのGGUFサポートは、ワークフローの変更を必要とせずに自動的に量子化を処理します。

極端な解像度のためのタイル生成

4Kを超える解像度の場合、または量子化でもVRAMが不十分な場合、タイル生成は画像を重複するセクションに分割し、独立して生成してからブレンドします。

いくつかのComfyUIカスタムノードパックで利用可能なタイル化VAEデコードノードを使用します。これらのノードは、最終画像のセクションを独立して生成し、出力解像度に関係なくVRAM使用量を一定に保ちます。

トレードオフには、各タイルが画像全体を同時に処理するのではなく順次生成されるため、生成時間が長くなることが含まれます。4K画像は、重複設定に応じて4〜6タイルに分割される可能性があり、それに応じて生成時間が倍増します。

解像度進行戦略

1024x1024から4Kに1ステップで直接ジャンプする代わりに、プログレッシブアップスケーリングは、低いVRAM要件でより良い品質を生成します。

1024x1024または1536x1536でベース画像を生成します。Wan 2.2低ノイズリファインメントを使用して2048x2048にアップスケールします。その2K結果を取り、2回目のリファインメントパスを使用して再度4Kにアップスケールします。

このプログレッシブアプローチにより、低ノイズエキスパートは各解像度ステップに適したディテールレベルに焦点を合わせることができます。4Kに直接ジャンプすると、4Kで正しく見えるディテールが生成されることがよくありますが、低解像度での情報が不十分なために発生します。

優れたアップスケール品質のためのプロンプトエンジニアリング

アップスケーリング中に提供するプロンプトは、最終的な品質に劇的に影響します。一般的なプロンプトは一般的なディテールを生成し、特定のプロンプト戦略は低ノイズエキスパートをフォトリアリスティックなリファインメントに向けてガイドします。

ベースディテール記述子

プロンプトには、ベース解像度画像でそれらのディテールが見えない場合でも、ディテール生成をガイドする特定の材料とテクスチャの説明を含める必要があります。

材料仕様: 「レザージャケット」の代わりに、「可視的な粒子テクスチャ、微妙なしわ、擦り切れたエッジを持つ使い古された茶色のレザージャケット」を指定します。低ノイズエキスパートは、これらの仕様を使用して、アップスケーリング中に適切なテクスチャディテールを生成します。

「木製テーブル」の代わりに、「可視的な粒子パターン、トーンの微妙な変化、自然な欠陥を持つオーク材テーブル」を指定します。これらの記述子は、リアルなテクスチャ生成をガイドします。

照明と表面の相互作用: 光が表面とどのように相互作用するかの説明を含めます。「頬骨の柔らかいハイライト」、「肌の微妙な拡散散乱」、「金属表面の鏡面反射」。これらの説明は、低ノイズエキスパートが信じられる照明ディテールをレンダリングするのに役立ちます。

複雑さをスキップしたいですか? Apatero は、技術的なセットアップなしでプロフェッショナルなAI結果を即座に提供します。

アーティファクトを回避するためのネガティブプロンプト

ネガティブプロンプトは、アップスケーリング中に重要になり、低ノイズモデルが適切にガイドされていない場合に導入する傾向がある一般的なアーティファクトを防ぎます。

回避すべき一般的なアップスケーリングアーティファクト: ネガティブプロンプトに含める: 「過度のシャープニング、人工的なシャープニング、ハロー、ノイズ、粒子、圧縮アーティファクト、プラスチックの肌、過飽和、不自然な色、ぼやけ、ソフトフォーカス」

低ノイズエキスパートは、フォトリアリズムを犠牲にしてディテールを過度に強調することがあります。ネガティブプロンプトは、モデルがフォトリアリズムを犠牲にせずにディテールを増やしたいことを理解するのに役立ちます。

ディテールフォーカステクニック

特定の領域が例外的なディテールを必要とし、他の領域はより柔らかいままでなければならない画像の場合、注意構文を使用して異なるプロンプトコンポーネントに重み付けします。

「女性のポートレート、(非常に詳細な目:1.3)、(シャープなジュエリー:1.2)、自然な肌のテクスチャ」のような構文は、低ノイズリファインメント中にどの領域が追加のディテール注意に値するかをモデルに伝えます。

この選択的なディテール強調は、画像全体を均一にシャープにするよりもプロフェッショナルな結果を生み出します。プロフェッショナルな写真家は、視覚的階層のために選択的なフォーカスとディテール強調を使用します。これらのプロンプトテクニックは、AIアップスケーリングでそのアプローチを複製します。

QWENとWan 2.2アップスケーリングと従来の方法の比較

このアプローチが確立されたアップスケーリング方法とどのように比較されるかを理解することで、QWENとWan 2.2と代替案をいつ使用するかを文脈化するのに役立ちます。

Wan 2.2低ノイズ vs ESRGANアップスケーリング

ESRGANおよび類似のニューラルアップスケーラーは、低解像度と高解像度の画像のペアでトレーニングすることにより、ディテールを追加することを学習します。特定のコンテンツタイプで優れていますが、トレーニングデータに存在しないディテールを含むAI生成画像に苦労します。

ESRGANの強み: 高速生成、分ではなく秒で動作します。控えめなハードウェアで実行される低VRAM要件。プロンプトチューニングなしで一貫した結果。写真コンテンツと自然なシーンでの強力なパフォーマンス。

ESRGANの制限: 元のプロンプトまたは意図されたコンテンツの理解がありません。意味的に正しいディテールを追加できず、トレーニングデータから学習したテクスチャパターンのみです。非写真要素を含むAI生成コンテンツに苦労します。異なるESRGANモデルバリアントを選択する以外に、どのディテールが追加されるかの制御がありません。

Wan 2.2低ノイズの強み: QWENプロンプト分析を通じてコンテンツを理解します。テキスト記述によってガイドされる意味的に適切なディテールを生成します。より高い解像度で同じ生成アプローチを使用するため、AI生成コンテンツで優れています。プロンプトエンジニアリングを通じてディテール特性の正確な制御を提供します。

Wan 2.2低ノイズの制限: 画像あたり30〜60秒を必要とする遅い生成。品質の高い結果のために12〜16GB VRAMを必要とする高いVRAM要件。最適な品質を達成するためにプロンプトチューニングが必要です。シンプルなESRGANノードと比較して、より複雑なワークフローセットアップ。

プロンプトガイド付きディテール強化でアップスケーリングが必要なAI生成画像の場合、Wan 2.2低ノイズは優れた結果を生み出します。シンプルな解像度の増加が必要な写真コンテンツの場合、ESRGANは高速で簡単です。

低ノイズリファインメント vs 標準モデルImg2Imgアップスケーリング

一部のワークフローは、元の画像をコンディショニングとして使用してより高い解像度で生成することにより、アップスケーリングにimg2imgモードで標準拡散モデルを使用します。このアプローチは機能しますが、低ノイズエキスパートを効果的にする特殊なトレーニングが欠けています。

すべてのノイズレベルでノイズのある画像でトレーニングされた標準モデルは、ノイズ除去の学習にかなりの能力を費やします。低ノイズエキスパートは高ノイズレベルでトレーニングされたことがないため、ノイズ処理に能力を浪費することなく、ディテールリファインメントに完全に特化できます。

RedditやCivitaiなどのプラットフォームのAI画像生成コミュニティからの比較テストによると、低ノイズエキスパートアプローチは、同等の設定で標準img2imgアップスケーリングよりも一貫して30〜40%優れたディテール品質スコアを生み出します。

違いは、細かいテクスチャ、布地のディテール、微妙な表面の変化で最も顕著になり、標準モデルがしばしば濁った、または過度に単純化されたディテールを生成する一方で、低ノイズエキスパートは鮮明で信じられるテクスチャをレンダリングします。

コンテンツ制作で月$1,250以上稼ぐ

独占クリエイターアフィリエイトプログラムに参加。バイラル動画のパフォーマンスに応じて報酬。自分のスタイルで完全な創造的自由を持ってコンテンツを作成。

実際のアプリケーションとユースケース

QWENとWan 2.2低ノイズアップスケーリングは、ディテール品質と意味理解が生の速度よりも重要な特定のシナリオで優れています。

印刷とプロフェッショナル出力の準備

AI画像生成は通常、1024x1024または1536x1536の出力を生成します。プロフェッショナルな印刷作業には、大きな物理的寸法で300 DPIのはるかに高い解像度が必要です。

24x36インチで印刷されたポスターには、適切な300 DPI品質のために約7200x10800ピクセルが必要です。標準のアップスケーラーは、この解像度で濁った結果を生み出します。Wan 2.2低ノイズリファインメントは、プロフェッショナルな印刷出力に必要なディテール密度を生成します。

写真業界標準で文書化されているようなプロフェッショナルな印刷サービスからの仕様によると、Wan 2.2アップスケーリングからのディテール品質は、一般的なアップスケーラーが達成できない商業印刷要件を満たしています。

製品写真の強化

eコマースの製品写真には、テクスチャ、材料品質、細かい特徴を示す極端なディテールが必要です。AI生成された製品画像は、プロフェッショナルな製品写真のディテール期待に一致するためにアップスケーリングが必要になることがよくあります。

QWENプロンプトは、「微妙な反射を持つ滑らかなガラス表面」、「可視的な個々の糸を持つ織物生地」、または「方向性の粒子を持つブラシ仕上げ金属」のような正確な材料特性を指定できます。低ノイズエキスパートは、アップスケーリング中にこれらの特定のテクスチャを生成します。

AI生成製品写真ワークフローの詳細については、ブログの製品写真記事でComfyUIの製品写真に関する包括的なガイドを参照してください。

建築ビジュアライゼーションのディテール強化

建築レンダリングには、建築材料、表面テクスチャ、環境コンテキストを示す鮮明なディテールが必要です。合理的な解像度でのベース生成に続いて低ノイズアップスケーリングを行うことで、クライアントプレゼンテーションやマーケティング資料に適したビジュアライゼーション品質が生成されます。

「可視的なモルタルラインとテクスチャの変化を持つレンガのファサード」、「微妙な反射と透明性を持つガラス窓」、「リアルなテクスチャを持つコンクリート表面」のようなプロンプトを指定します。これらは、AI生成された近似ではなく、プロフェッショナルな建築写真のように見えるディテール生成をガイドします。

キャラクターとコンセプトアートの制作

キャラクターデザインとコンセプトアートを作成するアーティストは、AI支援生成から始めて、詳細な手動リファインメントのために高解像度にアップスケールすることで恩恵を受けます。Wan 2.2低ノイズは、手動強化を実用的にするディテール基盤を提供します。

構成とスタイルが確立されたベース解像度でコンセプトを生成します。詳細な材料とテクスチャプロンプトで低ノイズリファインメントを使用してアップスケールします。最終的な芸術的リファインメントのためにPhotoshopまたは他のペイントツールにインポートするために4Kでエクスポートします。

このハイブリッドワークフローは、AI速度と人間の芸術的制御を組み合わせます。Apatero.comのようなプラットフォームは生成から最終出力までの完全なソリューションを提供しますが、Wan 2.2を使用したComfyUIワークフローは、プロセスのすべての段階でアーティストに最大の制御を提供します。

一般的なアップスケーリングの問題のトラブルシューティング

適切なセットアップでも、QWENとWan 2.2アップスケーリングワークフローで作業する際に、特定の問題が一般的に現れます。頻繁な問題を診断して修正する方法は次のとおりです。

過度のシャープニングと人工的な外観

アップスケールされた画像がエッジの周りにハローを伴う人工的にシャープに見える場合、いくつかの要因が通常この問題に寄与します。

CFGスケールが高すぎる: 9.0を超えるClassifier Free Guidanceは、低ノイズモデルで過度にシャープ化された結果を生成することがよくあります。より自然な外観を得るために、CFGを6.0〜7.5に減らし、ディテール品質を維持します。

低ノイズステップが不十分: 皮肉なことに、低ノイズリファインメント中のステップが少なすぎると、モデルが利用可能な限られたステップでディテールを積極的に追加する原因となる可能性があります。より穏やかなディテールの蓄積を可能にするために、低ノイズサンプリングステップを30〜40に増やします。

ネガティブプロンプトガイダンスの欠落: 「過度のシャープニング、人工的なシャープニング、ハロー」を指定するネガティブプロンプトがないと、モデルは自然に過度のシャープネスに傾く可能性があります。プロンプトエンジニアリングセクションで説明されているように、包括的なネガティブプロンプトを追加します。

画像領域全体のディテールの不一致

アップスケールされた画像の一部の領域が美しいディテールを示す一方で、他の領域が柔らかいまたは濁ったままである場合、これはコンディショニングまたは注意の問題を示しています。

不均一な画像コンディショニング: ベース画像が領域全体で品質が異なる場合、低ノイズエキスパートは一貫したディテールを追加するのに苦労する可能性があります。より高品質のベースからアップスケーリングを試すか、フルアップスケーリングの前に重要な領域を事前強化するためにface detailerノードを使用してみてください。

注意分布の問題: 複数の被写体を持つ複雑な構成は、注意メカニズムが特定の領域にディテール生成を集中させながら他の領域を無視する原因となることがあります。プロンプトで注意の重み付けを使用して、どの要素がディテール強調に値するかを指定します。

色のシフトまたは彩度の変化

アップスケールされた画像が、ベース画像と比較して異なる色または彩度を示すことがあり、VAEまたはコンディショニングの問題を示しています。

VAEの不一致: これらのモデル専用に設計されたWan 2.1 VAEを使用していることを確認してください。他のVAE実装は色を異なってエンコードする可能性があり、アップスケーリングプロセス中にシフトを引き起こします。

コンディショニング強度が低すぎる: コンディショニング強度が0.5を下回ると、アップスケーリングプロセスはアップスケーリングよりも新しい生成のようになり、色がドリフトすることを許可します。色の忠実度を維持するために、コンディショニング強度を0.7〜0.8に増やします。

プロフェッショナルな結果のための高度な技術

基本的なアップスケーリングワークフローをマスターしたら、これらの高度な技術が品質をプロフェッショナルレベルに押し上げます。

マルチパスディテールリファインメント

シングルパスアップスケーリングの代わりに、各パスに異なるプロンプトフォーカスを持つ複数のリファインメントパスを使用します。

最初のパスは、構成と主要な特徴を強調するプロンプトで構造と主要なディテールに焦点を当てます。2番目のパスは、非常に詳細な材料記述で特定の材料テクスチャをターゲットにします。3番目のパスは、照明と微妙な表面の相互作用に焦点を当てることができます。

このマルチパスアプローチにより、すべてを同時に処理するように1つのパスに依頼するのではなく、ディテール生成のさまざまな側面をきめ細かく制御できます。

スタイルとディテール制御のためのLoraの組み合わせ

低ノイズエキスパートモデルと一緒にスタイルLoRAを読み込んで、アップスケーリング中に特定の美的特性を維持します。写真スタイルLoRA、芸術スタイルLoRA、または技術品質LoRAはすべて、低ノイズエキスパートがディテールを生成する方法に影響を与えます。

フォトリアリズムLoRAは、ディテール生成を写真の特性に向けてガイドします。イラストLoRAは、解像度を上げながらイラストスタイルを維持します。この組み合わせアプローチは、解像度に適したディテールを追加しながらスタイルの一貫性を維持します。

マスクを使用した選択的な地域アップスケーリング

特定の領域のみが極端なディテールを必要とする画像の場合、マスキングを使用して低ノイズリファインメントを選択的に適用します。

顔、キーオブジェクト、または重要なディテールを分離するマスクを生成します。マスクされた領域に高強度の低ノイズアップスケーリングを適用し、背景やあまり重要でない領域には高速でシンプルなアップスケーリングを使用します。この選択的アプローチは、重要な領域が最大のディテール注意を受けることを保証しながら、生成時間を節約します。

AI画像アップスケーリングの未来

分離された高ノイズと低ノイズのエキスパートを持つWan 2.2のMoEアーキテクチャは、AIがさまざまな品質レベルで画像生成を処理する方法の重要な進化を表しています。

拡散モデルアーキテクチャの進歩を文書化しているコンピュータビジョン研究者からの分析によると、異なる生成フェーズの特殊なエキスパートモデルは、ディテール品質メトリックで評価される場合、統一モデルを一貫して上回ります。これは、将来の開発がさらに特殊化されたエキスパートシステムを強調する可能性があることを示唆しています。

QWENのようなテキスト理解モデルと特殊な生成モデルを組み合わせることで、各コンポーネントがその強みに焦点を当てる柔軟なパイプラインが作成されます。QWENはプロンプトの理解と強化を処理します。高ノイズエキスパートは構造を確立します。低ノイズエキスパートはディテールを洗練します。このモジュラーアプローチにより、各コンポーネントを独立して最適化できます。

ComfyUIで作業するクリエイターにとって、これらの最先端技術を理解して実装することで、わずか数か月前には高価な商用ツールや手動の芸術作業が必要だったプロフェッショナル品質の結果にアクセスできます。

今日からQWENとWan 2.2アップスケーリングを始めましょう

このワークフローのすべてのコンポーネントは、商用利用を許可するオープンライセンスの下で現在利用可能です。公式のHugging FaceリポジトリからWan 2.2モデルをダウンロードしてください。Hugging FaceのQwen組織からQWENモデルをダウンロードしてください。

ベース解像度画像と2K前後の中程度のターゲット解像度を使用したシンプルなアップスケーリングワークフローから始めます。高ノイズ対低ノイズステップの割り当て、CFGスケールチューニング、ディテール制御のためのプロンプトエンジニアリングの基本をマスターします。徐々により高い解像度とより複雑なマルチパスリファインメントワークフローに拡張します。

QWENのプロンプト理解とWan 2.2の特殊な低ノイズエキスパートの組み合わせは、完全なワークフロー制御を提供しながら、商用ソリューションに匹敵またはそれを超えるアップスケーリング品質を提供します。プロフェッショナルな出力品質が必要なAI画像を生成する人にとって、この技術をマスターすることは、開発する価値のある重要なスキルを表しています。

AIインフルエンサーを作成する準備はできましたか?

115人の学生とともに、51レッスンの完全なコースでComfyUIとAIインフルエンサーマーケティングをマスター。

関連記事

ComfyUI初心者が陥る最も一般的な10の間違いと2025年版の修正方法

新規ユーザーを悩ませるComfyUI初心者の落とし穴トップ10を回避しましょう。VRAMエラー、モデル読み込みなどの完全なトラブルシューティングガイド...

2025年版:プロユーザーが教えたがらないComfyUIの25のテクニックとコツ

エキスパートユーザーが活用している25の高度なComfyUIテクニック、ワークフロー最適化手法、プロレベルのコツを解説します。CFGチューニング、バッチ処理、品質改善の完全ガイド。

Anisora v3.2で360度アニメ回転:ComfyUI完全キャラクター回転ガイド2025

ComfyUIでAnisora v3.2を使用して360度アニメキャラクター回転をマスターしましょう。カメラ軌道ワークフロー、マルチビュー一貫性、プロフェッショナルなターンアラウンドアニメーション技術を学びます。