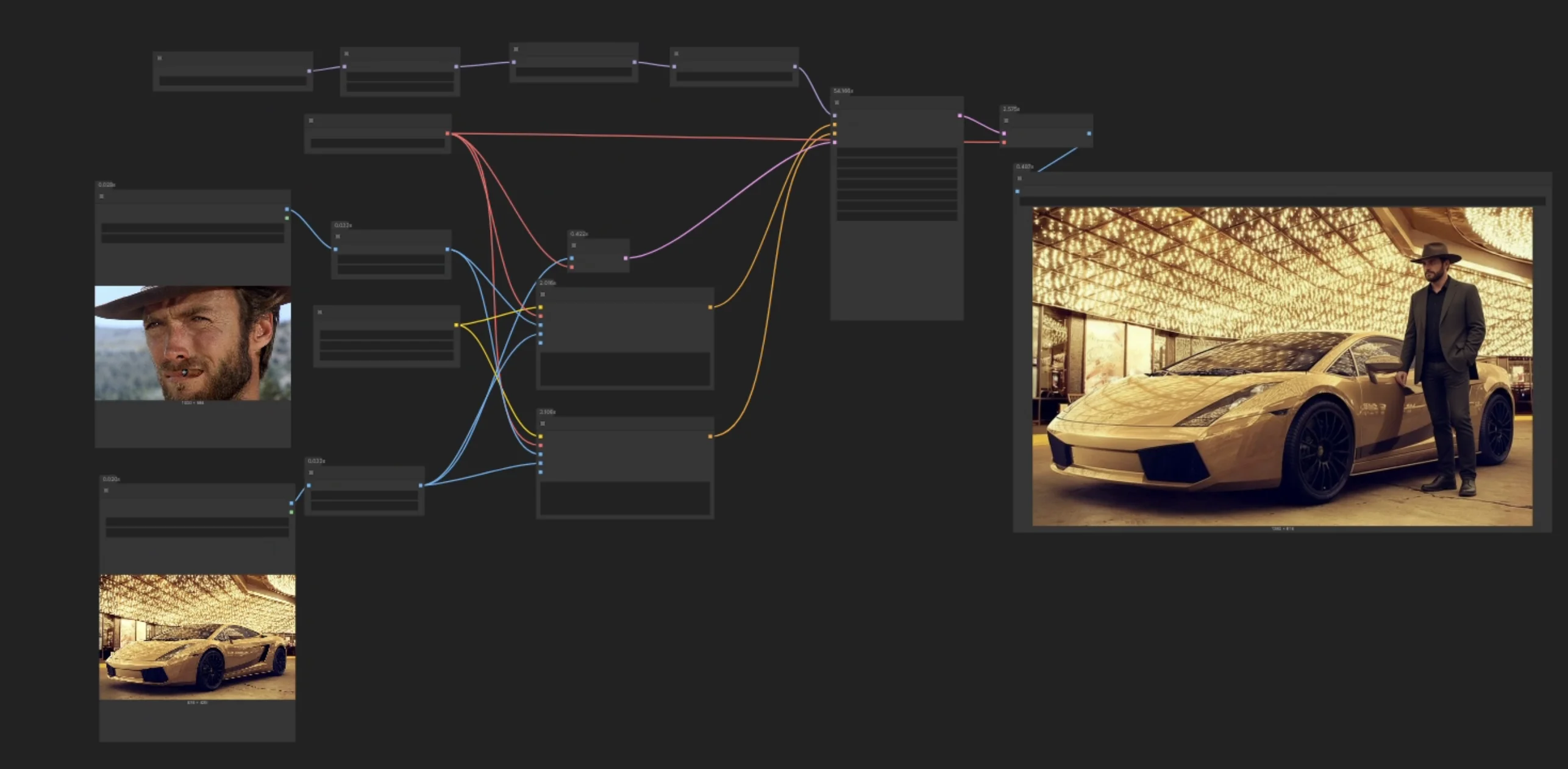

Qwen-Image-Edit 2509 Plus: Bessere Bildbearbeitung mit GGUF-Unterstützung

Meistern Sie Qwen-Image-Edit 2509 Plus in ComfyUI mit GGUF-Quantisierungsunterstützung. Vollständiger Leitfaden zu Installation, erweiterten Bearbeitungs-Workflows und Optimierungstechniken für 2025.

Sie verbringen Stunden in Photoshop, um diese perfekte Bearbeitung zu erstellen. Beleuchtung ändern, Farben anpassen, Objekte entfernen, Details hinzufügen. Jede Anpassung erfordert mehrere Ebenen, Masken und manuelle Anpassungen. Was wäre, wenn Sie die gewünschten Änderungen in einfachem Deutsch beschreiben und in Minuten professionelle Ergebnisse erzielen könnten?

Alibabas Qwen-Image-Edit 2509 Plus macht dies möglich. Dieses bahnbrechende Modell versteht natürlichsprachige Bearbeitungsanweisungen und wendet sie mit einer Präzision an, die mit manueller Bearbeitung konkurriert. Noch besser: Die GGUF-Quantisierungsunterstützung bedeutet, dass Sie es auf GPUs mit nur 8 GB VRAM ausführen können, während Sie beeindruckende Qualität beibehalten.

- Was Qwen-Image-Edit 2509 Plus besser macht als frühere Bearbeitungsmodelle

- Schritt-für-Schritt-Installation in ComfyUI mit GGUF-Unterstützung

- Natürlichsprachige Bearbeitungs-Workflows für gängige Aufgaben

- Erweiterte Techniken für Stilübertragung und Objektmanipulation

- GGUF-Quantisierungsstrategien für verschiedene Hardware-Konfigurationen

- Praxisnahe Bearbeitungs-Workflows und Best Practices

- Fehlerbehebung bei häufigen Problemen mit bewährten Lösungen

Was ist Qwen-Image-Edit 2509 Plus?

Qwen-Image-Edit 2509 Plus stellt die neueste Entwicklung in der anweisungsbasierten Bildbearbeitung dar. Es wurde vom Qwen-Team von Alibaba Cloud im September 2025 veröffentlicht und baut auf der Grundlage ihrer Vision-Language-Modelle mit spezialisiertem Training für präzise Bildmanipulationsaufgaben auf.

Im Gegensatz zu traditionellen Bildbearbeitungsmodellen, die Masken, Ebenen oder komplexe Parametereinstellungen erfordern, interpretiert Qwen-Image-Edit natürlichsprachige Anweisungen und wendet Bearbeitungen intelligent an. Sie beschreiben, was Sie ändern möchten, und das Modell findet heraus, wie es gemacht wird, während es die Teile des Bildes bewahrt, die Sie behalten möchten.

Die Technologie hinter Qwen-Image-Edit 2509 Plus

Das Modell verwendet eine hybride Architektur, die Vision-Verständnis, Sprachverständnis und diffusionsbasierte Bildgenerierung kombiniert. Laut Forschung aus der technischen Dokumentation von Alibaba Cloud führt die 2509 Plus-Version mehrere wichtige Verbesserungen gegenüber dem ursprünglichen Qwen-Image-Edit ein.

Wichtige technische Fortschritte:

- Verbessertes semantisches Verständnis komplexer Bearbeitungsanweisungen

- Bessere Erhaltung nicht bearbeiteter Bereiche

- Verbesserte Handhabung mehrerer gleichzeitiger Bearbeitungen

- Native GGUF-Quantisierungsunterstützung für Speichereffizienz

- Schnellere Inferenz durch optimierte Aufmerksamkeitsmechanismen

Stellen Sie es sich vor, als hätten Sie einen professionellen Fotoeditor, der Ihre Vision sofort versteht und perfekt umsetzt. Sie geben die kreative Richtung vor, das Modell übernimmt die technische Ausführung.

Qwen-Image-Edit Modellvarianten

Alibaba hat mehrere Modellgrößen veröffentlicht, die für verschiedene Anwendungsfälle und Hardware-Konfigurationen optimiert sind.

| Modellversion | Parameter | Max. Auflösung | Präzision | VRAM erforderlich | Am besten für |

|---|---|---|---|---|---|

| Qwen-IE-2509-7B | 7B | 2048x2048 | FP16 | 16GB | Tests und Experimente |

| Qwen-IE-2509-14B | 14B | 2048x2048 | FP16 | 28GB | Professionelle Bearbeitung |

| Qwen-IE-2509-Plus-14B | 14B | 4096x4096 | FP16 | 32GB+ | Hochauflösende Produktion |

| Qwen-IE-2509-Plus-14B-GGUF | 14B | 4096x4096 | Q4_K_M bis Q8 | 8-18GB | Budget-Hardware |

Die Plus 14B-Variante mit GGUF-Quantisierung trifft die perfekte Balance für die meisten Benutzer. Sie liefert professionelle Ergebnisse und läuft auf Consumer-GPUs durch intelligente Quantisierung.

Vergleich von Qwen-Image-Edit mit traditionellen Bearbeitungstools

Vor der Installation müssen Sie verstehen, wo Qwen-Image-Edit in Ihren Workflow im Vergleich zu vorhandenen Lösungen passt.

Qwen-Image-Edit vs Adobe Photoshop

Photoshop bleibt der Industriestandard für manuelle Bildbearbeitung, aber die Workflows könnten nicht unterschiedlicher sein.

Stärken von Photoshop:

- Pixelgenaue Kontrolle über jedes Element

- Unbegrenzte Ebenen und nicht-destruktive Bearbeitung

- Riesiges Ökosystem von Plugins und Erweiterungen

- Industrie-Standard-Dateiformatunterstützung

- Professionelles Farbmanagement

Einschränkungen von Photoshop:

- Steile Lernkurve, die Jahre der Beherrschung erfordert

- Zeitaufwändig für komplexe Bearbeitungen

- Erfordert manuelle Auswahl und Maskierung

- Abonnementkosten summieren sich im Laufe der Zeit

- Kein KI-Verständnis von semantischem Inhalt

Vorteile von Qwen-Image-Edit:

- Natürlichsprachige Anweisungen, keine technischen Fähigkeiten erforderlich

- Sekunden bis Minuten vs. Stunden für komplexe Bearbeitungen

- Automatisches Verständnis der Bildsemantik

- Einmalige Einrichtungskosten, keine Abonnements

- Läuft vollständig offline auf Ihrer Hardware

Natürlich bieten Plattformen wie Apatero.com professionelle KI-Bildbearbeitung über eine einfache Web-Oberfläche, ohne lokale Installationen zu verwalten. Sie erhalten sofortige Ergebnisse ohne technische Komplexität.

Qwen-Image-Edit vs andere KI-Bearbeitungsmodelle

Mehrere KI-Modelle versuchen anweisungsbasierte Bearbeitung, jedoch mit unterschiedlichen Fähigkeiten.

InstructPix2Pix: Frühes anweisungsbasiertes Bearbeitungsmodell von Berkeley AI Research. Gut für einfache Bearbeitungen, hat aber Schwierigkeiten mit komplexen mehrstufigen Anweisungen. Begrenzte Auflösungsunterstützung (512x512 nativ). Erfordert sorgfältiges Prompt-Engineering für konsistente Ergebnisse.

ControlNet Inpainting: Leistungsstark, erfordert aber manuelle Maskenerstellung. Ausgezeichnete Kontrolle, verliert aber die Einfachheit natürlichsprachiger Anweisungen. Besser für gezielte Bearbeitungen, wenn Sie genau wissen, was geändert werden muss.

Stable Diffusion Inpainting: Allzweck-Inpainting funktioniert gut zum Füllen entfernter Bereiche, fehlt aber semantisches Verständnis. Kann komplexe Bearbeitungsanweisungen wie "Beleuchtung dramatischer machen" oder "Subjekt um 10 Jahre altern lassen" nicht interpretieren.

Qwen-Image-Edit 2509 Plus Differenzierungsmerkmale:

- Überlegenes Verständnis komplexer mehrstufiger Anweisungen

- Bessere Erhaltung nicht bearbeiteter Bereiche

- Native Hochauflösungsunterstützung bis 4096x4096

- GGUF-Quantisierung für zugängliche Hardware-Anforderungen

- Schnellere Inferenz als vergleichbare Modelle

- Konsistentere Ergebnisse über verschiedene Bildtypen hinweg

Die Kosten-Leistungs-Realität

Analysieren wir die Wirtschaftlichkeit über ein Jahr moderater Nutzung (200 bearbeitete Bilder pro Monat).

Adobe Photoshop + KI-Tools:

- Creative Cloud Photography Plan: 20$/Monat = 240$/Jahr

- Zusätzliche KI-Bearbeitungs-Plugins: 15-30$/Monat = 180-360$/Jahr

- Gesamt: 420-600$/Jahr (erfordert Fachwissen)

Kommerzielle KI-Bearbeitungsdienste:

- Remove.bg, Photoroom usw.: 10-30$/Monat = 120-360$/Jahr

- Begrenzt auf bestimmte Bearbeitungstypen

- Qualität variiert je nach Dienst

Lokales Qwen-Image-Edit-Setup:

- RTX 4070 Ti oder ähnlich (einmalig): 800-900$

- Strom für ein Jahr: ~30$

- Gesamt erstes Jahr: ~930$, dann ~30$/Jahr

Apatero.com:

- Pay-per-Edit-Preisgestaltung ohne Infrastrukturinvestition

- Professionelle Ergebnisse ohne Hardware oder technisches Wissen

- Sofortiger Zugang mit garantierter Leistung

Für hochvolumige Bearbeitungsbedürfnisse amortisiert sich lokales Qwen-Image-Edit innerhalb von zwei Jahren. Allerdings eliminiert Apatero.com die Einrichtungskomplexität vollständig für Benutzer, die verwaltete Dienste bevorzugen.

Installation von Qwen-Image-Edit 2509 Plus in ComfyUI

Systemanforderungen

Minimale Spezifikationen (GGUF Q4_K_M):

- ComfyUI Version 0.3.48+

- 8GB VRAM (mit GGUF-Quantisierung)

- 16GB System-RAM

- 40GB freier Speicher für Modelle

- NVIDIA GPU mit CUDA 11.8+ Unterstützung

Empfohlene Spezifikationen (FP16):

- 20GB+ VRAM für volle Präzision

- 32GB System-RAM

- NVMe SSD für schnelleres Laden von Modellen

- RTX 4090 oder A6000 für optimale Leistung

Schritt 1: ComfyUI-Qwen-Erweiterung installieren

Qwen-Modelle benötigen ein benutzerdefiniertes Node-Pack für die ComfyUI-Integration. Wenn Sie neu bei benutzerdefinierten ComfyUI-Nodes sind, bietet unser Leitfaden für wesentliche Nodes hilfreichen Kontext.

- Öffnen Sie das Terminal und navigieren Sie zu ComfyUI/custom_nodes/

- Klonen Sie die Qwen-Erweiterung mit git clone https://github.com/QwenLM/ComfyUI-Qwen

- Navigieren Sie in das ComfyUI-Qwen-Verzeichnis

- Installieren Sie Abhängigkeiten mit pip install -r requirements.txt

- Starten Sie ComfyUI vollständig neu

Überprüfen Sie die Installation, indem Sie ComfyUI öffnen und nach "Qwen"-Nodes im Node-Browser suchen (Rechtsklick-Menü, suchen Sie "qwen").

Schritt 2: Qwen-Image-Edit-Modelle herunterladen

Qwen bietet Modelle in mehreren Formaten über Hugging Face an.

Text Encoder (Erforderlich):

- Laden Sie Qwen2-VL-7B-Instruct von Hugging Face herunter

- Platzieren Sie in ComfyUI/models/text_encoders/qwen/

Hauptmodelldateien:

Für FP16 Volle Präzision (erfordert 28GB+ VRAM):

- Laden Sie Qwen-IE-2509-Plus-14B-FP16 von Hugging Face herunter

- Platzieren Sie in ComfyUI/models/checkpoints/

Für GGUF Quantisiert (empfohlen für die meisten Benutzer):

- Laden Sie Qwen-IE-2509-Plus-14B-Q5_K_M.gguf von Hugging Face herunter

- Platzieren Sie in ComfyUI/models/checkpoints/

- Q5_K_M bietet die beste Qualität-Leistungs-Balance

Alle offiziellen Modelle finden Sie im Qwen Hugging Face Repository.

Schritt 3: GGUF-Unterstützung installieren (für quantisierte Modelle)

GGUF-Modelle benötigen zusätzliche Laufzeitunterstützung in ComfyUI.

- Navigieren Sie zu ComfyUI/custom_nodes/

- Klonen Sie GGUF-Unterstützung mit git clone https://github.com/city96/ComfyUI-GGUF

- Installieren Sie Abhängigkeiten mit pip install -r requirements.txt

- Starten Sie ComfyUI neu

Sie sollten jetzt GGUF-spezifische Loader-Nodes im Node-Browser sehen.

Schritt 4: Verzeichnisstruktur überprüfen

Ihre ComfyUI-Installation sollte jetzt diese Verzeichnisse und Dateien haben:

Hauptstruktur:

- ComfyUI/models/text_encoders/qwen/Qwen2-VL-7B-Instruct/

- ComfyUI/models/checkpoints/Qwen-IE-2509-Plus-14B-Q5_K_M.gguf

- ComfyUI/custom_nodes/ComfyUI-Qwen/

- ComfyUI/custom_nodes/ComfyUI-GGUF/

Der Text-Encoder sollte sich in einem qwen-Unterordner innerhalb von text_encoders befinden, und beide benutzerdefinierten Node-Ordner sollten in custom_nodes vorhanden sein.

Schritt 5: Offizielle Workflow-Vorlagen laden

Das Qwen-Team bietet Starter-Workflows, die für gängige Bearbeitungsaufgaben optimiert sind.

- Laden Sie Workflow-JSON-Dateien von Qwens GitHub-Beispielen herunter

- Starten Sie die ComfyUI-Web-Oberfläche

- Ziehen Sie Workflow-JSON in das Browserfenster

- ComfyUI lädt alle Nodes und Verbindungen automatisch

- Überprüfen Sie, ob Nodes grünen Status zeigen (keine fehlenden Komponenten)

Rote Nodes zeigen fehlende Abhängigkeiten oder falsche Dateipfade an. Überprüfen Sie die Installationsschritte und Dateispeicherorte.

Ihre erste Bearbeitung mit Qwen-Image-Edit

Führen wir Ihre erste anweisungsbasierte Bearbeitung durch, um zu verstehen, wie Qwen-Image-Edit funktioniert.

Grundlegender Bildbearbeitungs-Workflow

- Laden Sie die Workflow-Vorlage "Qwen-IE Basic Edit"

- Klicken Sie auf den Node "Load Image" und laden Sie Ihr Quellbild hoch

- Im Textnode "Editing Instruction" geben Sie Ihren Bearbeitungsbefehl ein

- Konfigurieren Sie den Node "Qwen Sampler" mit diesen Einstellungen:

- Steps: 30 (höher = bessere Qualität, längere Generierung)

- CFG Scale: 7.5 (steuert Anweisungstreue)

- Preservation Strength: 0.8 (wie viel unveränderte Bereiche intakt bleiben)

- Seed: -1 für zufällige Ergebnisse

- Setzen Sie Ausgabeparameter im Node "Save Image"

- Klicken Sie auf "Queue Prompt", um die Bearbeitung zu starten

Ihre erste Bearbeitung dauert 2-8 Minuten, abhängig von Hardware, Bildauflösung und Modellquantisierungsstufe.

Bearbeitungsparameter verstehen

Steps (Entrauschungsiterationen): Die Anzahl der Verfeinerungsdurchgänge. Mehr Schritte erzeugen sauberere, kohärentere Bearbeitungen. Beginnen Sie mit 30 zum Testen, erhöhen Sie auf 50-70 für finale Ausgaben. Abnehmende Renditen über 70 Schritte.

CFG (Classifier-Free Guidance) Scale: Steuert, wie genau das Modell Ihrer Anweisung folgt. Niedrigere Werte (5-6) erlauben kreative Interpretation. Höhere Werte (8-10) erzwingen strikte Einhaltung. Der optimale Punkt ist 7-7.5 für ausgewogene Ergebnisse.

Preservation Strength: Qwen-spezifischer Parameter zur Steuerung, wie aggressiv nicht bearbeitete Bereiche erhalten werden. Bereich 0.0-1.0. Standard 0.8 funktioniert gut. Erhöhen Sie auf 0.9, wenn zu viel sich ändert. Verringern Sie auf 0.6-0.7, wenn Bearbeitungen nicht stark genug sind.

Auflösungshandhabung: Qwen-Image-Edit handhabt automatisch verschiedene Auflösungen bis 4096x4096. Bilder über 2048px auf der längsten Seite können von Tiling für bessere Detailerhaltung profitieren.

Kostenlose ComfyUI Workflows

Finden Sie kostenlose Open-Source ComfyUI-Workflows für Techniken in diesem Artikel. Open Source ist stark.

Effektive Bearbeitungsanweisungen schreiben

Die Qualität Ihrer Bearbeitungen hängt stark von klaren, spezifischen Anweisungen ab.

Gute Anweisungsbeispiele:

- "Himmel in Sonnenuntergang mit warmen orangen und rosa Tönen ändern"

- "Person im Hintergrund auf der linken Seite entfernen"

- "Subjekt zum Lächeln bringen und direkt in die Kamera schauen lassen"

- "Dramatische Seitenbeleuchtung von rechts hinzufügen"

- "Jahreszeit in Herbst mit fallenden Blättern ändern"

Schlechte Anweisungsbeispiele:

- "Besser machen" (zu vage)

- "Alles reparieren" (kein spezifisches Ziel)

- "Farben ändern" (welche Farben? zu was?)

- "Zeug entfernen" (welches Zeug?)

Best Practices für Anweisungsschreiben:

- Seien Sie spezifisch, was geändert werden soll

- Erwähnen Sie den Ort, wenn relevant ("Hintergrund", "linke Seite", "Gesicht des Subjekts")

- Beschreiben Sie das gewünschte Ergebnis, nicht nur die Entfernung

- Verwenden Sie klare Adjektive für Stiländerungen

- Halten Sie Anweisungen bei 1-2 Sätzen für beste Ergebnisse

Ihre ersten Ergebnisse

Wenn die Bearbeitung abgeschlossen ist, vergleichen Sie die Ausgabe sorgfältig mit Ihrem Quellbild.

Qualitätsprüfungen:

- Hat das Modell Ihre Anweisung genau ausgeführt?

- Sind nicht bearbeitete Bereiche gut erhalten?

- Gibt es sichtbare Qualitätsverschlechterung oder Artefakte?

- Sieht die Bearbeitung natürlich und kohärent aus?

Wenn die Ergebnisse nicht zufriedenstellend sind, passen Sie die Klarheit Ihrer Anweisung an oder ändern Sie Parameter, bevor Sie erneut ausführen.

Für Benutzer, die professionelle Ergebnisse ohne Workflow-Komplexität wünschen, denken Sie daran, dass Apatero.com KI-Bildbearbeitung über eine intuitive Oberfläche bereitstellt. Keine Node-Konfigurationen oder Parametereinstellungen erforderlich.

Erweiterte Qwen-Image-Edit-Techniken

Sobald Sie grundlegende Bearbeitungen beherrschen, erweitern diese erweiterten Techniken Ihre kreativen Fähigkeiten erheblich.

Mehrstufige sequentielle Bearbeitung

Anstatt alle Änderungen in einer Anweisung zu beschreiben, zerlegen Sie komplexe Bearbeitungen in sequentielle Schritte.

Sequentieller Bearbeitungs-Workflow:

- Laden Sie Ihr Quellbild

- Wenden Sie erste Bearbeitung an (z.B. "Hintergrund-Unordnung entfernen")

- Führen Sie Ausgabebild zum zweiten Bearbeitungs-Node

- Wenden Sie zweite Bearbeitung an (z.B. "dramatische Beleuchtung hinzufügen")

- Führen Sie zur dritten Bearbeitung für finale Verfeinerung

- Verketten Sie so viele Schritte wie nötig

Dieser Ansatz erzeugt bessere Ergebnisse als mehrere Anweisungen in einen Prompt zu stopfen. Jeder Schritt kann sich darauf konzentrieren, eine Änderung perfekt auszuführen.

Beispiel sequentielle Kette:

- Schritt 1: "Telefonmast von rechts entfernen"

- Schritt 2: "Himmel in dramatischen stürmischen Sonnenuntergang ändern"

- Schritt 3: "Gesicht des Subjekts mit besserer Beleuchtung verbessern"

- Schritt 4: "Subtile Tiefenschärfe-Unschärfe zum Hintergrund hinzufügen"

Stilübertragung und ästhetische Änderungen

Qwen-Image-Edit zeichnet sich durch die Anwendung stilistischer Änderungen aus, während die Bildstruktur erhalten bleibt.

Stil-Anweisungsbeispiele:

- "In Schwarzweiß mit hochkontrastigem Film-Look konvertieren"

- "Lebendigen Fantasy-Kunststil mit gesättigten Farben anwenden"

- "Transformieren, um wie ein Ölgemälde auszusehen"

- "Kinematische Farbkorrektur mit Türkis- und Orangetönen hinzufügen"

- "Wie ein Vintage-Foto aus den 1970ern aussehen lassen"

Beleuchtungsmodifikationen:

- "Golden Hour Beleuchtung von der linken Seite hinzufügen"

- "Zu dramatischer Low-Key-Beleuchtung mit tiefen Schatten wechseln"

- "Weiche diffuse bedeckte Beleuchtung anwenden"

- "Konturbeleuchtung hinzufügen, um Subjekt vom Hintergrund zu trennen"

Objektmanipulation und Kompositionsänderungen

Über einfaches Entfernen hinaus kann Qwen Objekte intelligent modifizieren, hinzufügen und transformieren.

Objekt-Hinzufügung:

- "Rotes Vintage-Auto auf der Straße geparkt hinzufügen"

- "Großen verzierten Spiegel an der Wand hinter dem Subjekt platzieren"

- "Blühende Pflanzen im Vordergrund hinzufügen"

Objekt-Transformation:

- "Hemd des Subjekts von blau in rot ändern"

- "Holzstuhl in modernen Bürostuhl verwandeln"

- "Gebäude altern lassen, um verwittert und verlassen auszusehen"

Kompositionsanpassungen:

- "Subjekt zur rechten Seite verschieben, nach Drittelregel"

- "Vordergrund-Elemente für Tiefe hinzufügen"

- "Auf vertikales Hochformat zuschneiden"

Erhaltungsmaskierung für selektive Bearbeitungen

Für maximale Kontrolle kombinieren Sie Qwen-Image-Edit mit manuellen Masken, um genau anzugeben, was sich ändern soll.

Möchten Sie die Komplexität überspringen? Apatero liefert Ihnen sofort professionelle KI-Ergebnisse ohne technische Einrichtung.

Maskierter Bearbeitungs-Workflow:

- Erstellen Sie eine Maske in ComfyUI oder externem Tool, die den Bearbeitungsbereich hervorhebt

- Verbinden Sie Maske mit Qwens "Edit Mask"-Eingang

- Geben Sie Bearbeitungsanweisung

- Modell modifiziert nur maskierte Bereiche

- Perfekte Erhaltung von allem außerhalb der Maske

Dieser hybride Ansatz kombiniert KI-Intelligenz mit manueller Kontrolle für pixelgenaue Ergebnisse.

Stapelverarbeitung für konsistente Bearbeitungen

Wenden Sie dieselbe Bearbeitungsanweisung automatisch auf mehrere Bilder an.

Stapel-Workflow-Setup:

- Laden Sie mehrere Bilder in einen Stapellader-Node

- Verbinden Sie mit Qwen-Image-Edit-Node

- Geben Sie einzelne Anweisung an, die auf alle Bilder angewendet wird

- Verarbeiten Sie sequentiell oder parallel (wenn VRAM erlaubt)

- Ausgabe-Stapel bearbeiteter Bilder

Perfekt für die Anwendung konsistenter Stiländerungen, Wasserzeichenentfernung, Hintergrundersetzung oder Farbkorrektur über Foto-Sets.

GGUF-Quantisierungsstrategie für Qwen-Image-Edit

GGUF-Quantisierung macht Qwen-Image-Edit auf Budget-Hardware zugänglich. Das Verständnis der Kompromisse hilft Ihnen, die richtige Quantisierungsstufe zu wählen. Für einen tiefen Einblick, wie GGUF die KI-Modellbereitstellung verändert hat, lesen Sie unseren Artikel über die GGUF-Revolution.

GGUF-Quantisierungsstufen erklärt

GGUF verwendet verschiedene Quantisierungsformate, die Qualität und Speichernutzung ausbalancieren.

| GGUF-Format | VRAM-Nutzung | Qualität vs FP16 | Generierungsgeschwindigkeit | Am besten für |

|---|---|---|---|---|

| Q4_K_M | 8-10GB | 85-88% | 1.4x schneller | Schnelle Iteration auf niedrigem VRAM |

| Q5_K_M | 10-13GB | 92-95% | 1.2x schneller | Beste Qualität-Leistungs-Balance |

| Q6_K | 13-16GB | 96-98% | 1.1x schneller | Nahezu original mit Speichereinsparungen |

| Q8_0 | 16-18GB | 98-99% | 1.05x schneller | Maximale GGUF-Qualität |

| FP16 (Original) | 28GB+ | 100% Basislinie | 1.0x Basislinie | Produktion mit unbegrenztem VRAM |

Qualitätsverschlechterungsmerkmale:

Niedrigere Quantisierungsstufen beeinflussen verschiedene Aspekte der Bildqualität:

- Feine Details: Am stärksten betroffen, leichte Weichzeichnung bei Q4_K_M

- Farbgenauigkeit: Gut erhalten selbst bei Q4_K_M

- Kantenschärfe: Mäßige Auswirkung, bemerkbar bei Q4_K_M

- Anweisungstreue: Minimale Auswirkung über alle Quantisierungsstufen

Wählen Sie Ihre Quantisierungsstufe

Passen Sie die Quantisierung an Ihre Hardware und Ihren Anwendungsfall an.

Für 8GB VRAM GPUs (RTX 4060 Ti, RTX 3070):

- Verwenden Sie Q4_K_M für Bilder bis 1024x1024

- Erwarten Sie leichte Qualitätsverschlechterung, aber nutzbare Ergebnisse

- Perfekt für Tests und Iteration

- Erwägen Sie Tiling für größere Bilder

Schauen Sie sich unseren Low-VRAM-Optimierungsleitfaden für weitere Tipps zum Ausführen von Modellen auf Budget-Hardware an.

Für 12GB VRAM GPUs (RTX 4070, RTX 3080):

- Verwenden Sie Q5_K_M für beste Balance

- Bewältigt bis 2048x2048 komfortabel

- Qualitätsunterschied zu FP16 kaum wahrnehmbar

- Empfohlen für die meisten Benutzer

Für 16GB VRAM GPUs (RTX 4080):

- Verwenden Sie Q6_K oder Q8_0 für nahezu perfekte Qualität

- Unterstützt volle 4096x4096 Auflösung

- Fast nicht von FP16 zu unterscheiden

- Ideal für professionelle Arbeit

Für 24GB+ VRAM (RTX 4090, professionelle Karten):

- Verwenden Sie FP16 für absolute maximale Qualität

- Keine Kompromisse

- Schnellstes Feintuning bei Bedarf

Installation und Verwendung von GGUF-Modellen

GGUF-Modelle benötigen den GGUF-Loader-Node, der in Schritt 3 des Installationsabschnitts installiert wurde.

- Laden Sie Ihre gewählte GGUF-Quantisierungsstufe von Hugging Face herunter

- Platzieren Sie in ComfyUI/models/checkpoints/

- Verwenden Sie in Ihrem Workflow "GGUF Checkpoint Loader" anstelle des Standard-Loaders

- Wählen Sie Ihre GGUF-Datei aus dem Dropdown

- Alles andere bleibt identisch mit dem FP16-Workflow

Der GGUF-Loader behandelt automatisch Quantisierungsformat und Speicheroptimierung.

Speicherverwaltung für maximale Effizienz

Zusätzliche Techniken zur Maximierung der VRAM-Effizienz mit GGUF-Modellen.

Attention Slicing aktivieren: Reduziert die Spitzennutzung von VRAM während der Berechnung des Aufmerksamkeitsmechanismus. Aktivieren Sie in den ComfyUI-Einstellungen unter "Optimization". Ermöglicht die Verarbeitung größerer Bilder mit minimalem Geschwindigkeitseinfluss.

CPU-Offloading verwenden: Verschieben Sie Modellkomponenten in den System-RAM, wenn sie nicht aktiv verarbeiten. ComfyUI behandelt dies automatisch, aber der aggressive Modus spart zusätzliches VRAM auf Kosten einer Geschwindigkeitsreduzierung von 15-20 Prozent.

Mit niedrigerer Auflösung verarbeiten: Bearbeiten Sie bei 1024x1024 oder 1536x1536 während der Iteration, führen Sie dann die finale Bearbeitung in voller Auflösung durch. Die Bearbeitungsergebnisse sind über Auflösungen hinweg sehr konsistent.

Verdiene Bis Zu 1.250 $+/Monat Mit Content

Tritt unserem exklusiven Creator-Affiliate-Programm bei. Werde pro viralem Video nach Leistung bezahlt. Erstelle Inhalte in deinem Stil mit voller kreativer Freiheit.

Cache zwischen Operationen löschen: Verwenden Sie die Cache-Löschfunktion von ComfyUI zwischen verschiedenen Bearbeitungsaufgaben. Verhindert Speicherfragmentierung über längere Sitzungen.

Wenn die GGUF-Optimierung immer noch komplex erscheint, bedenken Sie, dass Apatero.com die gesamte Infrastruktur automatisch verwaltet. Sie erhalten maximale Qualität, ohne Quantisierungsformate oder Speicherbeschränkungen zu verwalten.

Reale Anwendungsfälle von Qwen-Image-Edit

Die anweisungsbasierte Bearbeitung von Qwen ermöglicht praktische Workflows in mehreren Branchen.

E-Commerce und Produktfotografie

Hintergrundersetzung: "Hintergrund durch sauberen weißen Studio-Hintergrund ersetzen"

- Sofortige professionelle Produktaufnahmen aus jedem Quellfoto

- Konsistente Hintergründe im gesamten Produktkatalog

- Keine manuelle Maskierung oder Green Screen erforderlich

Saisonale Variationen: Generieren Sie mehrere Versionen von Produktfotos für verschiedene Kampagnen.

- "Weihnachtsdekorationen und Schnee hinzufügen"

- "Produkt in sommerlicher Strandumgebung platzieren"

- "Produkt in modernem minimalistischem Heiminterieur zeigen"

Farbvarianten-Generierung: "Produktfarbe von blau in rot ändern" erzeugt zusätzliche Produktfotos ohne erneutes Fotografieren des Inventars.

Immobilien und Architektur

Virtuelles Staging: "Moderne Möbel und Dekoration zum leeren Wohnzimmer hinzufügen" verwandelt leerstehende Immobilien in ansprechende Räume für Inserate.

Tageszeit-Variationen: Zeigen Sie Immobilien in besten Lichtverhältnissen, unabhängig davon, wann Fotos aufgenommen wurden.

- "Zu Golden Hour Sonnenuntergangsbeleuchtung wechseln"

- "Außenbereich zur blauen Stunde in der Dämmerung zeigen"

Saisonale Attraktivität: "Herbstlaub und warme Töne hinzufügen" oder "Landschaftsgestaltung in voller Frühlingsblüte zeigen" macht Immobilien attraktiver für Käufer.

Content-Erstellung und Social Media

Thumbnail-Optimierung: Verbessern Sie Video-Thumbnails für maximale Klickraten.

- "Ausdruck aufgeregter und energiegeladener machen"

- "Dramatische Beleuchtung hinzufügen und Kontrast erhöhen"

- "Ablenkende Hintergrundelemente entfernen"

Markenkonsistenz: Wenden Sie konsistente Farbkorrektur und Stil auf alle Inhalte an.

- "Lebendige warme Farbkorrektur entsprechend Markenrichtlinien anwenden"

- Verarbeiten Sie ganze Content-Bibliotheken für kohäsive visuelle Identität

Schnelle Korrekturen: Beheben Sie Probleme in bereits veröffentlichten Inhalten ohne erneutes Drehen.

- "Fleck auf dem Hemd entfernen"

- "Harte Schatten im Gesicht korrigieren"

- "Schiefen Bilderrahmen begradigen"

Kreative Künste und Konzeptentwicklung

Mood Board-Generierung: Nehmen Sie ein einzelnes Konzeptbild und generieren Sie Variationen, die verschiedene Richtungen erkunden.

- "Dunkler und mysteriöser machen"

- "In helle und fröhliche Ästhetik transformieren"

- "Futuristische Sci-Fi-Elemente hinzufügen"

Stil-Erkundung: Testen Sie verschiedene künstlerische Stile auf derselben Komposition, bevor Sie sich auf die finale Ausführung festlegen.

Konzept-Iteration: Iterieren Sie schnell kreative Konzepte durch natürlichsprachige Anpassungen, ohne von vorne zu beginnen.

Fehlerbehebung bei häufigen Qwen-Image-Edit-Problemen

Selbst bei ordnungsgemäßer Einrichtung können Sie auf spezifische Herausforderungen stoßen. Hier sind bewährte Lösungen.

Übermäßige Änderungen an erhaltenen Bereichen

Symptome: Teile des Bildes, die Sie unverändert lassen wollten, werden modifiziert.

Lösungen:

- Erhöhen Sie den Parameter "Preservation Strength" auf 0.85-0.95

- Machen Sie Ihre Anweisung spezifischer, was sich ändern soll

- Verwenden Sie Erhaltungsmaskierung zum Schutz bestimmter Bereiche

- Reduzieren Sie CFG-Skala leicht (auf 6.5-7.0)

- Probieren Sie verschiedene Seed-Werte (einige Seeds erhalten besser)

Bearbeitungen nicht stark genug

Symptome: Die Anweisung wird befolgt, aber Änderungen sind zu subtil.

Lösungen:

- Erhöhen Sie CFG-Skala auf 8.5-9.5

- Reduzieren Sie "Preservation Strength" auf 0.6-0.7

- Verwenden Sie nachdrücklichere Sprache ("dramatisch ändern", "vollständig transformieren")

- Erhöhen Sie Sampling-Schritte auf 50-70

- Zerlegen Sie Bearbeitung in sequentielle Schritte, jeder baut auf dem vorherigen auf

Qualitätsverschlechterung oder Artefakte

Symptome: Ausgabebild weist sichtbare Artefakte, Unschärfe oder Qualitätsverlust im Vergleich zur Eingabe auf.

Lösungen:

- Verwenden Sie höhere GGUF-Quantisierung (Q6_K oder Q8_0 statt Q4_K_M)

- Erhöhen Sie Sampling-Schritte auf 60+

- Überprüfen Sie, ob Quellbildauflösung nicht bereits verschlechtert ist

- Prüfen Sie, dass Modelldateien vollständig und korrekt heruntergeladen wurden

- Aktivieren Sie Tiling für hochauflösende Bilder

Modell folgt Anweisungen nicht

Symptome: Ausgabe ignoriert Ihre Anweisung oder erzeugt unabhängige Änderungen.

Lösungen:

- Vereinfachen Sie Anweisung auf einzelne klare Änderung

- Überprüfen Sie Anweisungssprache (Englisch funktioniert am besten)

- Überprüfen Sie, dass Sie das Plus 14B-Modell verwenden, nicht das kleinere 7B

- Probieren Sie verschiedene Formulierungen desselben Konzepts

- Geben Sie Referenzstil in Anweisung an (z.B. "wie ein professionelles Porträt")

CUDA Out of Memory-Fehler

Symptome: Generierung schlägt auf halbem Weg mit CUDA-Speicherfehler fehl.

Lösungen:

- Wechseln Sie zu niedrigerer GGUF-Quantisierung (Q5_K_M zu Q4_K_M)

- Reduzieren Sie Eingabebildauflösung vor der Bearbeitung

- Aktivieren Sie CPU-Offloading in ComfyUI-Einstellungen

- Schließen Sie andere VRAM-intensive Anwendungen

- Aktivieren Sie Attention-Slicing-Optimierung

- Verarbeiten Sie in Kacheln für sehr große Bilder

Langsame Generierungszeiten

Symptome: Bearbeitungen dauern übermäßig lang im Vergleich zu erwarteten Zeiten.

Lösungen:

- Überprüfen Sie, dass Sie GGUF-Modell verwenden, nicht unquantisiertes FP16

- Aktualisieren Sie CUDA-Treiber auf neueste Version

- Prüfen Sie, dass ComfyUI tatsächlich GPU verwendet (überwachen Sie GPU-Auslastung)

- Deaktivieren Sie unnötige Vorschau-Nodes im Workflow

- Schließen Sie Browser-Tabs oder andere Anwendungen, die Rechenressourcen stehlen

Für persistente Probleme, die hier nicht behandelt werden, überprüfen Sie die Qwen GitHub Issues für Community-Lösungen und Fehlerberichte.

Best Practices für Qwen-Image-Edit in der Produktion

Verwaltung der Anweisungsbibliothek

Bauen Sie eine wiederverwendbare Bibliothek bewährter Anweisungen für gängige Bearbeitungsaufgaben auf.

Organisationssystem:

- /instructions/backgrounds/ - Hintergrundersetzungs-Prompts

- /instructions/lighting/ - Beleuchtungsmodifikations-Prompts

- /instructions/style/ - Künstlerische Stilübertragung-Prompts

- /instructions/objects/ - Objektmanipulations-Prompts

- /instructions/corrections/ - Allgemeine Korrekturanweisungen

Dokumentieren Sie jede erfolgreiche Anweisung mit:

- Genauer Wortlaut, der beste Ergebnisse erzielt hat

- Beispiel Vorher/Nachher-Bilder

- Empfohlene Parametereinstellungen

- Notizen, was funktioniert und was nicht

Qualitätskontroll-Workflow

Implementieren Sie gestaffelte Bearbeitung, um Probleme früh zu erkennen.

Dreistufiger Bearbeitungsprozess:

Stufe 1 - Schnelle Vorschau (2 Minuten):

- Verwenden Sie Q4_K_M-Quantisierung

- 20 Schritte

- 1024px Auflösung

- Überprüfen Sie Anweisungsinterpretation

Stufe 2 - Qualitätsprüfung (5 Minuten):

- Verwenden Sie Q5_K_M-Quantisierung

- 40 Schritte

- Volle Auflösung

- Überprüfen Sie Qualität und Erhaltung

Stufe 3 - Finales Rendering (8-10 Minuten):

- Verwenden Sie Q6_K oder höher

- 60-70 Schritte

- Volle Auflösung

- Nur für genehmigte Bearbeitungen

Dieser Ansatz verhindert Zeitverschwendung bei hochwertigen Renderings falsch interpretierter Anweisungen.

Kombination mit traditionellen Tools

Qwen-Image-Edit funktioniert am besten als Teil eines hybriden Workflows.

Empfohlene Pipeline:

- Initiale Bearbeitung in Qwen: Wenden Sie größere Änderungen durch natürliche Sprache an

- Feinabstimmung in Photoshop: Manuelle Pixel-Level-Korrekturen bei Bedarf

- Farbkorrektur: Finale Farbanpassungen in dedizierten Tools

- Export: In geeignetem Format für Endnutzung speichern

Dieser hybride Ansatz nutzt KI für die Hauptarbeit, während menschliche Kontrolle über die finale Qualität erhalten bleibt.

Integration mit Videogenerierung: Bearbeitete Bilder von Qwen sind ausgezeichnete Ausgangspunkte für KI-Videogenerierung. Nachdem Sie Ihre Bildbearbeitungen perfektioniert haben, führen Sie sie in WAN 2.2 für Bild-zu-Video-Animation oder WAN 2.2 Animate für Charakteranimation ein.

Stapelverarbeitungsstrategie

Richten Sie für große Bearbeitungsprojekte effiziente Stapel-Workflows ein.

- Organisieren Sie Quellbilder in kategorisierten Ordnern

- Erstellen Sie Bearbeitungsanweisungsvorlagen für jede Kategorie

- Verwenden Sie ComfyUIs Stapelverarbeitungs-Nodes

- Verarbeiten Sie über Nacht oder in Nebenzeiten

- Implementieren Sie Qualitätskontroll-Überprüfungssystem für Ausgaben

Dieser systematisierte Ansatz ermöglicht die konsistente Verarbeitung von Hunderten von Bildern.

Was kommt als Nächstes nach der Beherrschung von Qwen-Image-Edit

Sie haben jetzt umfassendes Wissen über die Installation von Qwen-Image-Edit 2509 Plus, Workflows, GGUF-Optimierung und Produktionstechniken. Sie verstehen, wie anweisungsbasierte Bearbeitung Ihren Bildbearbeitungs-Workflow dramatisch beschleunigen kann.

Empfohlene nächste Schritte:

- Erstellen Sie Ihre persönliche Anweisungsbibliothek für gängige Bearbeitungsaufgaben

- Experimentieren Sie mit sequentiellen mehrstufigen Bearbeitungs-Workflows

- Testen Sie verschiedene GGUF-Quantisierungsstufen, um Ihren Sweet Spot zu finden

- Integrieren Sie Qwen in Ihre bestehende kreative Pipeline

- Treten Sie der Qwen-Community bei, um Ergebnisse zu teilen und fortgeschrittene Techniken zu lernen

Zusätzliche Ressourcen:

- Offizielle Qwen-Dokumentation für technische Details

- Hugging Face Model Hub für alle Modellvarianten

- ComfyUI Community Wiki für Workflow-Beispiele

- Qwen Discord-Community für Fehlerbehebung und Tipps

- Wählen Sie lokales Qwen-Image-Edit wenn: Sie regelmäßig Bilder bearbeiten, vollständige Kontrolle über den Prozess benötigen, geeignete Hardware haben (8GB+ VRAM mit GGUF), Privatsphäre schätzen und null wiederkehrende Kosten wünschen

- Wählen Sie Apatero.com wenn: Sie sofortige Ergebnisse ohne technische Einrichtung benötigen, garantierte Leistung bevorzugen, Pay-as-you-go-Preise ohne Hardware-Investition wünschen oder keine dedizierte GPU-Hardware haben

- Wählen Sie Photoshop wenn: Sie pixelgenaue manuelle Kontrolle benötigen, mit Industrie-Standard-Workflows arbeiten, erweiterte Funktionen über KI-Bearbeitung hinaus benötigen oder bereits Expertise in traditionellen Tools haben

Qwen-Image-Edit 2509 Plus repräsentiert ein neues Paradigma in der Bildbearbeitung. Natürlichsprachige Anweisungen ersetzen komplexe manuelle Workflows, GGUF-Quantisierung macht es auf Budget-Hardware zugänglich, und die Ergebnisse rivalisieren in den meisten Szenarien mit professioneller manueller Bearbeitung. Ob Sie Produktfotos bearbeiten, Social-Media-Inhalte erstellen, Konzepte entwickeln oder große Bildbibliotheken verarbeiten - Qwen bringt professionelle KI-Bearbeitungsfähigkeiten direkt in Ihre Hände.

Die Zukunft der Bildbearbeitung besteht nicht darin, zwischen KI und traditionellen Tools zu wählen. Es geht darum, KI für schnelle Iteration und Hauptarbeit zu nutzen, während menschliche kreative Richtung und finale Qualitätskontrolle erhalten bleiben. Qwen-Image-Edit 2509 Plus macht diese Zukunft heute in ComfyUI verfügbar, bereit für Sie zum Erkunden und Meistern.

Bereit, Ihren KI-Influencer zu Erstellen?

Treten Sie 115 Studenten bei, die ComfyUI und KI-Influencer-Marketing in unserem kompletten 51-Lektionen-Kurs meistern.

Verwandte Artikel

10 beste KI-Influencer-Generator-Tools im Vergleich (2025)

Umfassender Vergleich der Top-KI-Influencer-Generator-Tools im Jahr 2025. Funktionen, Preisgestaltung, Qualität und beste Anwendungsfälle für jede Plattform im Überblick.

5 bewährte KI-Influencer-Nischen, die 2025 wirklich Geld verdienen

Entdecken Sie die profitabelsten Nischen für KI-Influencer im Jahr 2025. Echte Daten zum Monetisierungspotenzial, Zielgruppenbindung und Wachstumsstrategien für virtuelle Content-Creator.

KI-Action-Figure-Generator: Wie du 2026 dein virales Toy-Box-Porträt erstellst

Vollständiger Leitfaden zum KI-Action-Figure-Generator-Trend. Lerne, wie du dich in eine Sammel-Figur in Blisterpack-Verpackung mit ChatGPT, Flux und mehr verwandelst.