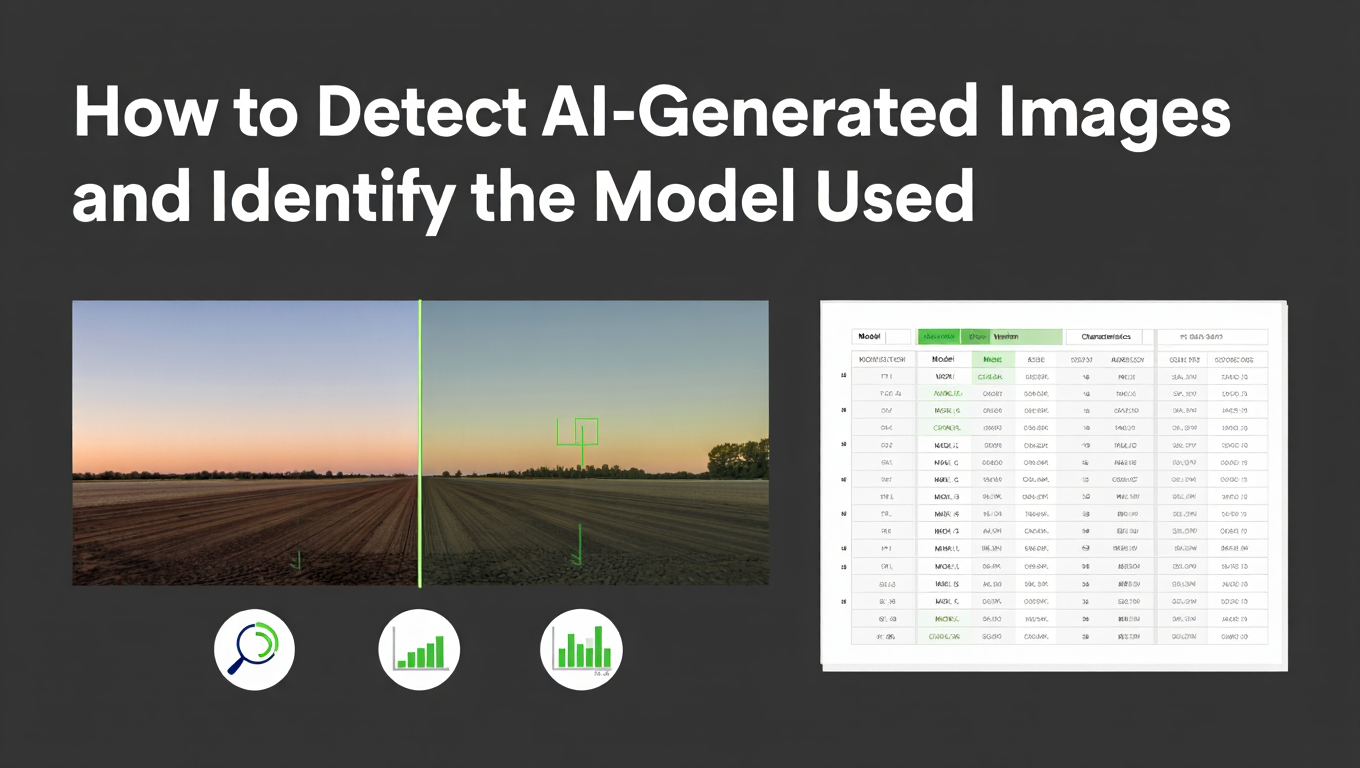

So erkennen Sie KI-generierte Bilder und identifizieren das verwendete Modell

Vollständiger Leitfaden zur Erkennung KI-generierter Bilder in 2025. Vergleichen Sie Hive Moderation, Illuminarty und AI or Not Erkennungstools.

Sie haben gerade ein Bild erhalten, das fast zu perfekt aussieht. Die Beleuchtung ist makellos, die Komposition ist atemberaubend, und irgendetwas daran lässt Sie innehalten. Ist dies eine Fotografie eines talentierten Künstlers, oder hat eine KI sie in Sekunden erstellt? Noch wichtiger: Welches KI-Modell hat es erstellt?

Diese Frage ist wichtiger denn je im Jahr 2025. Ob Sie ein Content-Creator sind, der Quellmaterial überprüft, ein Journalist, der Bilder fact-checkt, oder ein Plattform-Moderator, der Fehlinformationen bekämpft – die Fähigkeit, KI-generierte Bilder zu erkennen und ihre Quellmodelle zu identifizieren, ist zu einer essentiellen Fähigkeit geworden. Die Einsätze sind hoch, da KI-generierte Bilder jetzt soziale Medien, Nachrichtenagenturen und E-Commerce-Plattformen in bemerkenswertem Ausmaß überfluten. Das Erlernen der Erkennung von KI-generierten Bildern ist für jeden, der mit digitalen Inhalten arbeitet, nicht mehr optional.

Die gute Nachricht ist, dass mehrere leistungsstarke Erkennungstools entstanden sind, die Ihnen nicht nur sagen können, ob ein Bild KI-generiert ist, sondern auch das spezifische Modell identifizieren können, das es erstellt hat. Diese Tools analysieren Muster auf Pixelebene, Kompressionsartefakte und modellspezifische Fingerabdrücke, die für das menschliche Auge unsichtbar bleiben, sich aber unter algorithmischer Prüfung offenbaren.

Schnelle Antwort

Wenn Sie KI-generierte Bilder schnell und genau erkennen müssen, verwenden Sie Hive Moderation für maximale Genauigkeit bei 98-99,9%, AI or Not für zuverlässige Erkennung mit Deepfake-Fähigkeiten bei 88,89% Genauigkeit, oder Illuminarty für lokalisierte Erkennung, die genau zeigt, welche Teile eines Bildes KI-generiert sind, bei 75% Genauigkeit. Hive Moderation liefert die genauesten Ergebnisse, wenn Sie KI-generierte Bilder erkennen müssen und kann das spezifische verwendete KI-Modell identifizieren, was es zur besten Wahl für professionelle Anwendungen macht, die die Fähigkeit erfordern, KI-generierte Bilder zuverlässig zu erkennen.

Warum KI-Bilderkennung im Jahr 2025 wichtig ist

Die Verbreitung KI-generierter Bilder hat bemerkenswerte Herausforderungen in mehreren Branchen geschaffen. Die Notwendigkeit, KI-generierte Bilder zu erkennen, ist kritisch geworden, da Social-Media-Plattformen Schwierigkeiten haben, synthetische Inhalte zu identifizieren, die Fehlinformationen verbreiten. Nachrichtenorganisationen müssen die Authentizität eingereichter Fotografien überprüfen und KI-generierte Bilder vor der Veröffentlichung erkennen. E-Commerce-Sites kämpfen gegen gefälschte Produktbilder, die Verbraucher irreführen, was die Fähigkeit, KI-generierte Bilder zu erkennen, für die Aufrechterhaltung des Vertrauens unerlässlich macht.

Das Verständnis, warum Erkennung wichtig ist, hilft Ihnen, die Raffinesse moderner Erkennungstools zu schätzen. KI-Bildgeneratoren wie Midjourney, DALL-E 3 und Stable Diffusion erstellen Bilder, indem sie Muster aus Millionen echter Fotografien lernen. In diesem Prozess betten sie subtile statistische Signaturen ein, die sich von natürlichen fotografischen Prozessen unterscheiden. Erkennungstools nutzen diese Unterschiede, um synthetische Inhalte zu identifizieren.

Die Fähigkeit, nicht nur zu erkennen, sondern auch das Quellmodell zu identifizieren, fügt eine weitere Ebene wertvoller Informationen hinzu. Verschiedene KI-Modelle haben unterschiedliche Anwendungsfälle und Implikationen. Ein mit DALL-E 3 generiertes Produktbild deutet auf eine andere Absicht hin als eines, das mit Stable Diffusion erstellt wurde. Das Wissen um das Quellmodell hilft Ihnen, den Kontext zu verstehen und informierte Entscheidungen über den Umgang mit synthetischen Inhalten zu treffen.

Die drei führenden Erkennungstools im Vergleich

Bevor wir uns in detaillierte Anleitungen für jedes Tool vertiefen, vergleichen wir zunächst ihre Kernfähigkeiten, damit Sie das richtige Tool für Ihre Bedürfnisse auswählen können.

Umfassende Vergleichstabelle

| Merkmal | Hive Moderation | AI or Not | Illuminarty |

|---|---|---|---|

| Gesamtgenauigkeit | 98-99,9% | 88,89% | 75% |

| Modellidentifikation | Ja (spezifische Modelle) | Begrenzt | Ja |

| Deepfake-Erkennung | Ja | Ja | Nein |

| Lokalisierte Erkennung | Nein | Nein | Ja |

| API-Zugang | Ja (Enterprise) | Ja | Ja |

| Erkennung veränderter Bilder | Ja | Begrenzt | Begrenzt |

| Verarbeitungsgeschwindigkeit | Schnell | Schnell | Moderat |

| Am besten für | Professionelle Verifizierung | Allgemeine Erkennung | Regionale Analyse |

| Monatliche API-Aufrufe | Milliarden unterstützt | Millionen unterstützt | Moderate Größenordnung |

Genauigkeitsrankings erklärt

Hive Moderation erreicht seine 98-99,9% Genauigkeit durch fortschrittliche Machine-Learning-Modelle, die auf riesigen Datensätzen sowohl echter als auch KI-generierter Bilder trainiert wurden. Das System verarbeitet monatlich Milliarden von API-Aufrufen, was bedeutet, dass es kontinuierlich von neuen Bildmustern lernt und hohe Genauigkeit beibehält, selbst wenn KI-Generatoren sich weiterentwickeln.

AI or Not erreicht 88,89% Genauigkeit durch Deep-Learning-Algorithmen, die Beobachtungen auf Pixelebene durchführen. Dieser Ansatz untersucht die fundamentalen Bausteine von Bildern statt High-Level-Features, was ihn effektiv beim Erkennen von KI-generierten Inhalten macht, selbst wenn das Gesamtbild überzeugend erscheint.

Illuminartys 75% Genauigkeit repräsentiert einen Kompromiss für seine einzigartige Fähigkeit, lokalisierte Erkennung durchzuführen. Anstatt eine einfache Ja- oder Nein-Antwort zu geben, verwendet Illuminarty Computer-Vision-Algorithmen, um spezifische Regionen innerhalb eines Bildes hervorzuheben, die Anzeichen von KI-Generierung zeigen. Diese niedrigere Gesamtgenauigkeit spiegelt die zusätzliche Komplexität der regionalen Analyse wider.

Wie Sie Hive Moderation für maximale Genauigkeit verwenden

Hive Moderation repräsentiert den Goldstandard in der KI-Bilderkennung und bietet die höchsten verfügbaren Genauigkeitsraten sowie die Fähigkeit, spezifische KI-Modelle zu identifizieren. So verwenden Sie es effektiv.

Schritt-für-Schritt-Anleitung zu Hive Moderation

Schritt 1: Zugriff auf die Plattform

Navigieren Sie zur Hive Moderation-Website und erstellen Sie ein Konto, wenn Sie API-Zugang benötigen. Für die Grunderkennung liefert die Weboberfläche sofortige Ergebnisse ohne Registrierung. Die Plattform bietet je nach Ihrem Volumenbedarf sowohl kostenloses Testen als auch Enterprise-Lösungen.

Schritt 2: Laden Sie Ihr Bild hoch

Klicken Sie auf die Upload-Schaltfläche und wählen Sie Ihre Bilddatei aus. Hive unterstützt gängige Formate einschließlich JPEG, PNG und WebP. Die Plattform kann Bilder analysieren, die zugeschnitten, in der Größe verändert oder verschiedenen Veränderungen unterzogen wurden, und behält die Erkennungsgenauigkeit auch nach Modifikationen bei.

Schritt 3: Überprüfen Sie die Erkennungsergebnisse

Innerhalb von Sekunden gibt Hive eine umfassende Analyse zurück. Die Ergebnisse beinhalten einen Konfidenzwert, der die Wahrscheinlichkeit angibt, dass das Bild KI-generiert ist, das identifizierte Quellmodell wie Midjourney v5, DALL-E 3 oder Stable Diffusion XL, und eine detaillierte Aufschlüsselung der Erkennungsfaktoren, die zur Klassifizierung beigetragen haben.

Schritt 4: Interpretieren Sie die Modellidentifikation

Wenn Hive ein spezifisches Modell identifiziert, achten Sie sowohl auf den Modellnamen als auch auf das Konfidenzniveau. Eine hochkonfidente Identifikation von Midjourney v5 sagt Ihnen genau, welches Tool das Bild erstellt hat. Geringere Konfidenz könnte darauf hindeuten, dass das Bild von einem weniger verbreiteten Modell generiert wurde oder erheblich verarbeitet wurde.

Schritt 5: Verstehen Sie die Erkennung veränderter Bilder

Eine der herausragenden Funktionen von Hive ist die Erkennung von KI-generierten Inhalten auch nach der Veränderung von Bildern. Dies beinhaltet Bilder, die als Screenshot aufgenommen, zwischen Formaten konvertiert, mit Filtern versehen, zugeschnitten oder in der Größe verändert wurden, oder Kompression unterzogen wurden. Das System sucht nach fundamentalen Mustern, die diese Modifikationen überleben.

Wann Sie Hive Moderation wählen sollten

Wählen Sie Hive, wenn Genauigkeit Ihre oberste Priorität ist und Sie spezifische Modellidentifikation benötigen. Dies macht es ideal für Journalisten, die Quellmaterial verifizieren, Rechtsteams, die Herkunft feststellen, Plattformen, die Content-Richtlinien implementieren, Forscher, die die Verteilung KI-generierter Inhalte studieren, und jede professionelle Anwendung, bei der Fehlalarme ernsthafte Konsequenzen haben könnten.

Die Enterprise-API unterstützt Milliarden monatlicher Aufrufe, was sie für große Plattformen geeignet macht, die von Nutzern hochgeladene Inhalte überprüfen müssen. Für kleinere Betriebe oder einzelne Nutzer bietet die Weboberfläche dieselbe Erkennungsqualität für gelegentliche Nutzung. Viele Profis, die mit KI-generierten Inhalten über Plattformen wie Apatero.com arbeiten, verlassen sich auf Hive Moderation als ihr primäres Verifizierungstool. Für die Erstellung eigener KI-Inhalte erkunden Sie unseren Wan 2.2 ComfyUI-Leitfaden für Videogenerierung oder FLUX LoRA-Trainings-Leitfaden für benutzerdefiniertes Modelltraining.

Wie Sie AI or Not für zuverlässige Erkennung mit Deepfake-Fähigkeiten verwenden

AI or Not kombiniert solide Erkennungsgenauigkeit mit spezialisierter Deepfake-Erkennung, was es besonders wertvoll macht, wenn Sie vermuten, dass ein Bild manipulierte menschliche Gesichter enthalten könnte.

Schritt-für-Schritt-Anleitung zu AI or Not

Schritt 1: Navigieren Sie zum Tool

Greifen Sie über ihre Website auf AI or Not zu. Die Oberfläche ist unkompliziert und für schnelle Analysen konzipiert. Sie können Bilder sofort ohne Kontoerstellung testen, obwohl die Registrierung zusätzliche Funktionen und API-Zugang freischaltet.

Schritt 2: Reichen Sie Ihr Bild ein

Laden Sie Ihr Bild per Drag-and-Drop oder über den Dateiauswahldialog hoch. Das Tool akzeptiert Standard-Bildformate und verarbeitet sie schnell. Für die Stapelverarbeitung ermöglicht die API das gleichzeitige Einreichen mehrerer Bilder.

Schritt 3: Analysieren Sie Deep-Learning-Ergebnisse

AI or Not verwendet Deep-Learning-Algorithmen, die Bilder auf Pixelebene untersuchen. Die Ergebnisse zeigen einen prozentualen Konfidenzwert, dass das Bild KI-generiert ist. Im Gegensatz zu einfacher binärer Erkennung hilft Ihnen diese Wahrscheinlichkeit, subtile Entscheidungen über Grenzfälle zu treffen.

Schritt 4: Nutzen Sie die Deepfake-Erkennung

Bei der Analyse von Bildern mit menschlichen Gesichtern wendet AI or Not spezialisierte Deepfake-Erkennungsalgorithmen an. Diese untersuchen Gesichtsmerkmale auf verräterische Anzeichen synthetischer Generierung, einschließlich subtiler Inkonsistenzen bei Augenreflexionen, Haardarstellung, Hauttexturmustern und anatomischen Proportionen, die KI-Modelle oft schwer perfekt zu machen haben.

Schritt 5: Verstehen Sie die Analyse auf Pixelebene

Der Deep-Learning-Ansatz bedeutet, dass AI or Not raffinierte Generierungen erkennen kann, die einfachere Erkennungsmethoden täuschen. Durch die Analyse, wie einzelne Pixel zu ihren Nachbarn in Beziehung stehen, identifiziert das System statistische Muster, die charakteristisch für KI-Generierung sind, statt natürlicher Fotografie.

Wann Sie AI or Not wählen sollten

Wählen Sie AI or Not, wenn Sie zuverlässige allgemeine Erkennung mit starken Deepfake-Fähigkeiten benötigen. Ideale Anwendungsfälle umfassen Social-Media-Verifizierung, wo gefälschte Profile oft KI-generierte Porträts verwenden, Dating-Plattform-Sicherheit, wo KI-generierte Profilbilder häufig sind, Identitätsverifizierungs-Workflows, Medienauthentifizierung für Bilder mit Menschen und Situationen, in denen Sie Gesichtsmanipulation statt vollständiger Bildgenerierung vermuten.

Die 88,89% Genauigkeitsrate bietet zuverlässige Erkennung für die meisten Anwendungen, während die spezialisierte Deepfake-Analyse Mehrwert für gesichtszentrierte Bilder hinzufügt. Die API skaliert gut für Anwendungen mit mittlerem Volumen, was sie für Plattformen geeignet macht, die Nutzerinhalte verifizieren müssen, aber nicht die Enterprise-Größenordnung von Hive benötigen.

Wie Sie Illuminarty für lokalisierte Erkennung verwenden

Illuminarty bietet eine einzigartige Fähigkeit, die es von anderen Erkennungstools unterscheidet. Anstatt einfach zu identifizieren, ob ein gesamtes Bild KI-generiert ist, hebt es spezifische Regionen innerhalb des Bildes hervor, die KI-Generierungssignaturen zeigen.

Schritt-für-Schritt-Anleitung zu Illuminarty

Schritt 1: Zugriff auf die Illuminarty-Plattform

Besuchen Sie die Illuminarty-Website und greifen Sie auf ihr Erkennungstool zu. Die Oberfläche bietet klare Optionen zum Hochladen von Bildern und zur Überprüfung lokalisierter Analysen. Die Registrierung ist optional für die Basisnutzung, aber für API-Zugang und erweiterte Funktionen erforderlich.

Schritt 2: Laden Sie Ihr Bild zur Analyse hoch

Wählen und laden Sie Ihr Bild hoch. Illuminarty arbeitet mit gängigen Formaten und verarbeitet sie durch Computer-Vision-Algorithmen, die darauf ausgelegt sind, regionale Variationen in Generierungsmerkmalen zu identifizieren.

Schritt 3: Überprüfen Sie die visuelle Heatmap

Illuminarty gibt eine Heatmap-Überlagerung auf Ihrem Originalbild zurück. In wärmeren Farben hervorgehobene Regionen zeigen eine höhere Wahrscheinlichkeit von KI-Generierung an. Diese Visualisierung zeigt Ihnen sofort, welche Teile des Bildes das System als synthetisch betrachtet.

Schritt 4: Analysieren Sie regionale Muster

Kostenlose ComfyUI Workflows

Finden Sie kostenlose Open-Source ComfyUI-Workflows für Techniken in diesem Artikel. Open Source ist stark.

Studieren Sie die Heatmap auf Muster. Bei zusammengesetzten Bildern, bei denen KI-generierte Elemente zu echten Fotografien hinzugefügt wurden, sehen Sie klare Grenzen zwischen hervorgehobenen und nicht hervorgehobenen Regionen. Dies hilft Ihnen zu verstehen, was genau generiert wurde im Vergleich zu dem, was von einer Kamera aufgenommen wurde.

Schritt 5: Interpretieren Sie Konfidenzniveaus

Zusammen mit der visuellen Heatmap liefert Illuminarty Konfidenzwerte für verschiedene Regionen. Hohe Konfidenz in einem Bereich mit niedriger Konfidenz in einem anderen deutet stark auf ein zusammengesetztes Bild hin. Das Verständnis dieser Muster hilft Ihnen, genaue Bewertungen zu treffen, selbst bei der niedrigeren Gesamtgenauigkeitsrate des Tools.

Wann Sie Illuminarty wählen sollten

Verwenden Sie Illuminarty, wenn Sie partielle KI-Generierung vermuten oder genau identifizieren müssen, welche Elemente synthetisch sind. Dies ist besonders wertvoll für die Erkennung von Produktbildern, bei denen Hintergründe KI-generiert wurden, zusammengesetzte Bilder, die Fotografie mit KI-Elementen mischen, bearbeitete Bilder, bei denen KI verwendet wurde, um spezifische Regionen zu modifizieren, Verständnis des Ausmaßes der KI-Manipulation in modifizierten Fotos und Bildungszwecke, um zu lernen, wie sich KI-Generierungssignaturen in verschiedenen Bildregionen manifestieren.

Die 75% Genauigkeitsrate spiegelt die zusätzliche Komplexität der regionalen Analyse im Vergleich zur binären Erkennung wider. Wenn Illuminarty jedoch spezifische KI-generierte Regionen mit hoher Konfidenz identifiziert, sind diese Informationen sehr wertvoll, um zu verstehen, wie ein Bild erstellt wurde. Für Profis, die KI-generierte Inhalte auf Plattformen wie Apatero.com erstellen und analysieren, bietet Illuminarty einzigartige Einblicke, die Tools mit höherer Genauigkeit ergänzen. Für schnellere KI-Generierungs-Workflows schauen Sie sich unseren Leitfaden zur TeaCache- und SageAttention-Optimierung an.

Praktische Workflows für verschiedene Anwendungsfälle

Das Verständnis, wie man diese Tools kombiniert, schafft effektivere Erkennungs-Workflows als sich auf ein einzelnes Tool allein zu verlassen. Hier sind praktische Workflows für häufige Szenarien.

Workflow für Content-Verifizierung

Bei der Verifizierung von Inhalten für Veröffentlichung oder Plattform-Moderation beginnen Sie mit dem genauesten Tool und eskalieren Sie bei Bedarf zu Spezialisten.

Primäranalyse mit Hive Moderation

Beginnen Sie, indem Sie das Bild durch Hive Moderation laufen lassen. Wenn Hive mit hoher Konfidenz zurückgibt, dass das Bild KI-generiert ist und das Quellmodell identifiziert, haben Sie zuverlässige Informationen für Ihre Entscheidung. Dokumentieren Sie die Ergebnisse einschließlich Konfidenzniveau und identifiziertem Modell.

Sekundäre Verifizierung mit AI or Not

Wenn Hive Grenzwertergebnisse zwischen 70-90% Konfidenz zurückgibt, lassen Sie das Bild durch AI or Not für eine zweite Meinung laufen. Übereinstimmung zwischen beiden Tools stärkt die Konfidenz in die Klassifizierung. Uneinigkeit signalisiert die Notwendigkeit zusätzlicher Untersuchung oder menschlicher Überprüfung.

Lokalisierte Analyse mit Illuminarty

Wenn Sie verstehen müssen, was genau in einem Bild KI-generiert ist, besonders bei zusammengesetzten Bildern, verwenden Sie Illuminarty. Dies ist besonders nützlich, wenn Sie vermuten, dass eine authentische Fotografie mit KI-generierten Elementen verbessert oder modifiziert wurde.

Workflow für Deepfake-Erkennung

Wenn Sie speziell über Gesichtsmanipulation besorgt sind, priorisieren Sie Tools mit Deepfake-Fähigkeiten.

Erstes Screening mit AI or Not

Beginnen Sie mit AI or Not aufgrund seiner spezialisierten Deepfake-Erkennungsalgorithmen. Untersuchen Sie die Ergebnisse speziell auf Indikatoren für Gesichtsmanipulation. Achten Sie auf Konfidenzniveaus für Gesichtsregionen versus das Gesamtbild.

Bestätigung mit Hive Moderation

Lassen Sie das Bild durch Hive laufen, um eine Gesamtbewertung der KI-Generierung und potenzielle Modellidentifikation zu erhalten. Einige Deepfake-Tools erstellen eindeutige Signaturen, die Hive identifizieren kann.

Regionale Analyse falls nötig

Verwenden Sie Illuminarty, wenn Sie feststellen müssen, ob nur das Gesicht manipuliert wurde, während der Rest des Bildes authentisch ist. Die Heatmap kann klar Gesichtsregionen als KI-generiert zeigen, während die Authentizität umgebender Elemente bestätigt wird.

Möchten Sie die Komplexität überspringen? Apatero liefert Ihnen sofort professionelle KI-Ergebnisse ohne technische Einrichtung.

Workflow für Forschung und Analyse

Für Forscher, die Muster KI-generierter Inhalte studieren, bietet ein umfassender Ansatz mit allen Tools die vollständigsten Daten.

Analysieren Sie jedes Bild mit allen drei Tools und vergleichen Sie die Ergebnisse. Dokumentieren Sie Übereinstimmungen und Uneinigkeiten, um die Stärken und Schwächen jedes Tools für verschiedene Bildtypen zu verstehen. Achten Sie besonders darauf, welche Modelle Bilder generieren, die spezifische Erkennungstools herausfordern.

Verständnis von Einschränkungen und Fehlalarmen

Kein Erkennungstool ist perfekt, und das Verständnis von Einschränkungen hilft Ihnen, bessere Entscheidungen darüber zu treffen, wann Sie automatisierten Ergebnissen vertrauen und wann Sie zusätzliche Prüfung anwenden sollten.

Häufige Quellen für Fehlalarme

Erkennungstools können authentische Bilder in mehreren Szenarien fälschlicherweise als KI-generiert klassifizieren.

Stark verarbeitete Fotografie

Bilder, die umfangreicher Nachbearbeitung unterzogen wurden, einschließlich HDR-Verstärkung, aggressiver Rauschreduzierung und künstlerischer Filter, können Fehlalarme auslösen. Die Verarbeitung erzeugt statistische Muster, die denen der KI-Generierung ähneln.

Digitale Kunst und Illustrationen

Handgezeichnete digitale Kunst löst manchmal die Erkennung aus, weil digitale Erstellungstools Regelmäßigkeiten einführen, die denen von KI-Generierungsmustern ähneln. Dies ist besonders häufig bei sanften Verläufen und sauberer Vektorkunst.

Stock-Fotografie

Professionelle Stock-Fotos unterliegen oft standardisierter Verarbeitung, die Muster erzeugen kann, die Erkennungstools mit KI-Generierung assoziieren. Dies gilt besonders für Fotos mit sehr sauberen, kontrollierten Beleuchtungsbedingungen.

Screenshots und Bildschirmaufnahmen

Vom Bildschirm aufgenommene Bilder führen Kompression und Farbartefakte ein, die die Erkennung auslösen können. Dies gilt für Screenshots authentischer Fotografien sowie Bildschirmaufnahmen aus Videos.

Häufige Quellen für falsch negative Ergebnisse

Erkennungstools können KI-generierte Bilder unter bestimmten Bedingungen übersehen.

Neuartige oder seltene Modelle

KI-Modelle, die neu sind oder begrenzte Verbreitung haben, sind möglicherweise in den Trainingsdaten der Erkennungstools nicht gut repräsentiert. Dies schafft blinde Flecken, bis die Tools mit neuen Proben aktualisiert werden.

Extreme Nachbearbeitung

Während Hive veränderte Bilder gut handhabt, kann umfangreiche Modifikation manchmal die Erkennungsgenauigkeit über alle Tools hinweg verringern. Starke Modifikation verschleiert die ursprünglichen Generierungsmuster.

Bilder mit niedrigerer Auflösung

Kleine Bilder liefern weniger Daten für die Analyse, was die Erkennungsgenauigkeit reduzieren kann. Miniaturbilder sind besonders herausfordernd.

Hybride Generierungsmethoden

Verdiene Bis Zu 1.250 $+/Monat Mit Content

Tritt unserem exklusiven Creator-Affiliate-Programm bei. Werde pro viralem Video nach Leistung bezahlt. Erstelle Inhalte in deinem Stil mit voller kreativer Freiheit.

Bilder, die mit Kombinationen von Tools erstellt wurden, wie KI-generierte Basisbilder, die mit traditioneller Bearbeitungssoftware verfeinert wurden, können manchmal zwischen Erkennungskriterien fallen.

Umgang mit unsicheren Ergebnissen

Wenn Erkennungstools Grenzwert-Konfidenzniveaus zurückgeben, wenden Sie zusätzliche Prüfung an.

Untersuchen Sie das Bild manuell auf häufige KI-Artefakte, einschließlich ungewöhnlicher Texturen in detaillierten Bereichen, inkonsistenter Beleuchtung oder Schatten und anatomischer Unregelmäßigkeiten bei Menschen oder Tieren. Überprüfen Sie Bild-Metadaten auf Hinweise auf Erstellungssoftware, obwohl beachtet werden muss, dass Metadaten modifiziert oder entfernt werden können.

Berücksichtigen Sie die Quelle und den Kontext. Ein Bild von einem bekannten Fotografen mit einem konsistenten Portfolio ist weniger wahrscheinlich KI-generiert als ein anonymer Upload, der behauptet, eine Fotografie zu sein.

Wenn Genauigkeit kritisch ist, verlassen Sie sich nicht allein auf automatisierte Erkennung. Kombinieren Sie Tool-Ergebnisse mit menschlicher Expertise und kontextuelle Analyse für die zuverlässigste Bewertung.

Modellidentifikation im Detail

Eine der wertvollsten Fähigkeiten moderner Erkennungstools ist die Identifizierung des spezifischen KI-Modells, das ein Bild generiert hat. Diese Information liefert wichtigen Kontext zum Verständnis von Absicht und Bewertung von Authentizitätsansprüchen.

Wie Modellidentifikation funktioniert

KI-Bildgeneratoren erstellen Bilder durch erlernte Muster, und jedes Modell lernt leicht unterschiedliche Muster aus seinen Trainingsdaten und seiner Architektur. Diese Unterschiede erzeugen modellspezifische Fingerabdrücke, die Erkennungstools identifizieren können.

Hive Moderation zeichnet sich bei der Modellidentifikation aus, weil es auf gekennzeichneten Datensätzen von jedem großen Generator trainiert. Bei der Analyse eines neuen Bildes vergleicht es erkannte Muster mit bekannten Signaturen für Midjourney-Versionen 1 bis 6, DALL-E 2 und DALL-E 3, Stable Diffusion-Versionen und -Varianten, Adobe Firefly und andere aufkommende Generatoren.

Interpretation der Modellidentifikationsergebnisse

Hochkonfidente Modellidentifikation liefert starke Beweise über Bildursprünge. Wenn Hive ein Bild mit 95% Konfidenz als Midjourney v5.2 identifiziert, können Sie ziemlich sicher über die Generierungsquelle sein.

Geringere Konfidenz oder generische Identifikationen deuten entweder auf ein ungewöhnliches Modell, signifikante Nachbearbeitung oder Eigenschaften hin, die mehrere Modelle teilen. In diesen Fällen ist die Erkennung der KI-Generierung immer noch zuverlässig, aber die spezifische Quelle ist weniger sicher.

Warum Modellidentifikation wichtig ist

Verschiedene KI-Modelle haben unterschiedliche Eigenschaften und Anwendungsfälle, die Ihre Reaktion auf erkannte synthetische Inhalte beeinflussen.

Midjourney zeichnet sich bei künstlerischen und ästhetischen Bildern aus. Erkennung deutet oft auf kreative oder illustrative Absicht hin statt auf täuschende Verwendung.

DALL-E 3 integriert tief mit ChatGPT und deutet oft auf konversationell generierte Bilder hin. Der Stil tendiert zu hilfreicher Visualisierung statt Fotorealismus.

Stable Diffusion hat viele Varianten und ist für lokale Ausführung zugänglich. Erkennung könnte auf technisch versiertere Nutzer oder spezifische Anwendungsfälle hinweisen, die lokale Generierung erfordern.

Das Verständnis dieser Muster hilft Ihnen, erkannte KI-Inhalte zu kontextualisieren und angemessen zu reagieren.

Best Practices für effektive Erkennung

Die Befolgung von Best Practices verbessert die Erkennungsgenauigkeit und hilft Ihnen, bessere Entscheidungen über synthetische Inhalte zu treffen.

Bildqualitätserhaltung

Wann immer möglich, analysieren Sie die höchste verfügbare Qualitätsversion eines Bildes. Jede Generation von Kompression und Größenänderung verschlechtert die Muster, auf die Erkennungstools angewiesen sind. Wenn Sie Zugriff auf die Originaldatei haben, verwenden Sie diese anstelle einer heruntergeladenen oder gescreenshoteten Version.

Verifizierung mit mehreren Tools

Für hochriskante Entscheidungen verlassen Sie sich nicht auf ein einzelnes Tool. Lassen Sie verdächtige Bilder durch mindestens zwei Erkennungstools laufen und vergleichen Sie die Ergebnisse. Übereinstimmung zwischen Tools erhöht die Konfidenz in die Klassifizierung erheblich.

Kontextberücksichtigung

Erkennungsergebnisse sollten Ihre Reaktion informieren, aber nicht vollständig bestimmen. Berücksichtigen Sie die Quelle, behauptete Herkunft und beabsichtigte Verwendung des Bildes neben automatisierten Erkennungsergebnissen. Ein KI-generiertes Bild, das ausdrücklich als solches von seinem Ersteller gekennzeichnet ist, erfordert eine andere Handhabung als eines, das als authentische Fotografie präsentiert wird.

Dokumentation

Für professionelle Anwendungen dokumentieren Sie Ihren Erkennungsprozess. Notieren Sie, welche Tools Sie verwendet haben, ihre Konfidenzniveaus, alle identifizierten Modelle und Ihre endgültige Bewertung. Diese Dokumentation unterstützt Ihre Entscheidungen und hilft, konsistente Praktiken zu etablieren.

Aktuell bleiben

Erkennungstools aktualisieren sich kontinuierlich, um mit verbesserten KI-Generatoren Schritt zu halten. Überprüfen Sie regelmäßig auf Updates Ihrer Tools und seien Sie sich bewusst, dass die Genauigkeit variieren kann, wenn neue KI-Modelle auftauchen, bevor sich Erkennungstools an sie anpassen.

Häufig gestellte Fragen

Welches KI-Erkennungstool ist am genauesten?

Hive Moderation führt mit 98-99,9% Genauigkeit. Es verarbeitet monatlich Milliarden von API-Aufrufen und kann KI-generierte Inhalte auch nach der Veränderung, dem Zuschneiden oder der Kompression von Bildern erkennen. Für professionelle Anwendungen, die maximale Genauigkeit und Modellidentifikation erfordern, ist Hive die empfohlene Wahl.

Können diese Tools identifizieren, welches KI-Modell ein Bild erstellt hat?

Ja, Hive Moderation kann spezifische Modelle identifizieren, einschließlich Midjourney-Versionen, DALL-E 2 und 3, Stable Diffusion-Varianten und andere große Generatoren. Illuminarty bietet auch Modellidentifikationsfähigkeiten. Diese Funktion hilft, den Kontext und Ursprung von KI-generierten Bildern zu verstehen.

Wie erkenne ich, ob nur ein Teil eines Bildes KI-generiert ist?

Verwenden Sie Illuminarty für lokalisierte Erkennung. Es generiert eine Heatmap, die zeigt, welche spezifischen Regionen eines Bildes KI-Generierungsmuster aufweisen. Dies ist besonders wertvoll für die Erkennung zusammengesetzter Bilder, die Fotografie mit KI-generierten Elementen mischen.

Können KI-Erkennungstools Deepfakes identifizieren?

AI or Not beinhaltet spezialisierte Deepfake-Erkennungsfähigkeiten. Es analysiert Gesichtsmerkmale auf Anzeichen synthetischer Generierung, einschließlich Inkonsistenzen bei Augenreflexionen, Haardarstellung und anatomischen Proportionen. Für vermutete Gesichtsmanipulation beginnen Sie mit AI or Not, bevor Sie andere Tools verwenden.

Was verursacht Fehlalarme bei der KI-Erkennung?

Häufige Ursachen umfassen stark nachbearbeitete Fotografie, professionelle digitale Kunst und Illustrationen, standardisierte Stock-Foto-Verarbeitung und Screenshots oder Bildschirmaufnahmen. Diese Prozesse können Muster erzeugen, die KI-Generierungssignaturen ähneln.

Funktionieren diese Tools bei veränderten oder komprimierten Bildern?

Hive Moderation behält speziell die Genauigkeit bei veränderten Bildern bei, einschließlich Zuschnitte, Größenänderungen, Formatkonvertierungen und gefilterten Versionen. Andere Tools haben begrenztere Fähigkeiten bei veränderten Bildern. Für modifizierte Inhalte bietet Hive die zuverlässigsten Ergebnisse.

Wie oft sollte ich Erkennungsergebnisse mit mehreren Tools verifizieren?

Für hochriskante Entscheidungen wie Veröffentlichung, rechtliche Angelegenheiten oder Richtliniendurchsetzung verifizieren Sie immer mit mindestens zwei Tools. Für Verwendungen mit geringerem Risiko wie persönliche Neugier reicht normalerweise ein einzelnes hochgenaues Tool wie Hive aus. Wenn Tools nicht übereinstimmen, wenden Sie zusätzliche menschliche Analyse an.

Was sind die Einschränkungen der aktuellen KI-Erkennungstechnologie?

Aktuelle Tools können Schwierigkeiten haben mit neuartigen KI-Modellen, die noch nicht in Trainingsdaten sind, extrem niedrig aufgelösten Bildern, stark modifizierten Bildern für einige Tools und hybriden Bildern, die mit mehreren Techniken erstellt wurden. Das Verständnis dieser Einschränkungen hilft Ihnen, Ergebnisse angemessen zu interpretieren und zu wissen, wann zusätzliche Prüfung erforderlich ist. Die Community bei Apatero.com diskutiert regelmäßig diese sich entwickelnden Einschränkungen und Workarounds. Für diejenigen, die ihre eigenen KI-Bilder erstellen möchten, beginnen Sie mit unserem Einstiegsleitfaden.

Fazit

Die Fähigkeit, KI-generierte Bilder zu erkennen, hat sich von einer neuartigen Fähigkeit zu einer essentiellen Fertigkeit für jeden entwickelt, der im Jahr 2025 mit digitalen Inhalten arbeitet. Die drei in diesem Leitfaden behandelten Tools repräsentieren den aktuellen Stand der Technik für diejenigen, die KI-generierte Bilder erkennen müssen, jedes mit unterschiedlichen Stärken, die es für spezifische Anwendungsfälle wertvoll machen.

Hive Moderation sticht durch maximale Genauigkeit und zuverlässige Modellidentifikation hervor. Wenn Sie mit hoher Konfidenz wissen müssen, ob ein Bild KI-generiert ist und welches Tool es erstellt hat, liefert Hive. Seine Fähigkeit, synthetische Inhalte auch nach Veränderungen zu erkennen, macht es unschätzbar wertvoll für professionelle Verifizierungs-Workflows.

AI or Not bietet zuverlässige allgemeine Erkennung mit spezialisierten Deepfake-Fähigkeiten. Wenn Gesichtsauthentizität Ihre primäre Sorge ist, erfasst seine Deep-Learning-Analyse auf Pixelebene Manipulationen, die anderen Tools entgehen könnten.

Illuminarty bietet einzigartige lokalisierte Erkennung, die genau zeigt, welche Regionen eines Bildes KI-generierten Inhalt enthalten. Für die Analyse zusammengesetzter Bilder und das Verständnis des Ausmaßes der KI-Modifikation bietet seine Heatmap-Visualisierung Einblicke, die kein anderes Tool bietet.

Der effektivste Ansatz kombiniert diese Tools strategisch. Verwenden Sie Hive für das primäre Screening, AI or Not für gesichtsfokussierte Analyse und Illuminarty, wenn Sie regionales Verständnis benötigen. Dokumentieren Sie Ihren Prozess und behalten Sie das Bewusstsein für die Einschränkungen jedes Tools bei.

Da sich die KI-Bildgenerierung weiterentwickelt, entwickelt sich die Erkennungstechnologie parallel. Die hier behandelten Tools und Techniken repräsentieren aktuelle Best Practices, aber es bleibt wichtig, über Updates und neue Fähigkeiten informiert zu bleiben. Indem Sie diese Erkennungstools beherrschen und ihre richtige Anwendung verstehen, positionieren Sie sich, um den komplexen Raum synthetischer Medien mit Vertrauen zu navigieren.

Ob Sie Ihre Plattform vor Fehlinformationen schützen, Inhalte für die Veröffentlichung verifizieren oder einfach Ihre Neugier über ein verdächtiges Bild befriedigen, diese Tools bieten die Fähigkeiten, die Sie benötigen. Der Schlüssel liegt darin, das richtige Tool an Ihren spezifischen Anwendungsfall anzupassen und sowohl die Macht als auch die Einschränkungen der automatisierten Erkennung zu verstehen. Beginnen Sie mit Genauigkeit für kritische Entscheidungen, fügen Sie spezialisierte Analyse für spezifische Anliegen hinzu und kombinieren Sie immer automatisierte Ergebnisse mit menschlichem Urteilsvermögen für die zuverlässigsten Resultate.

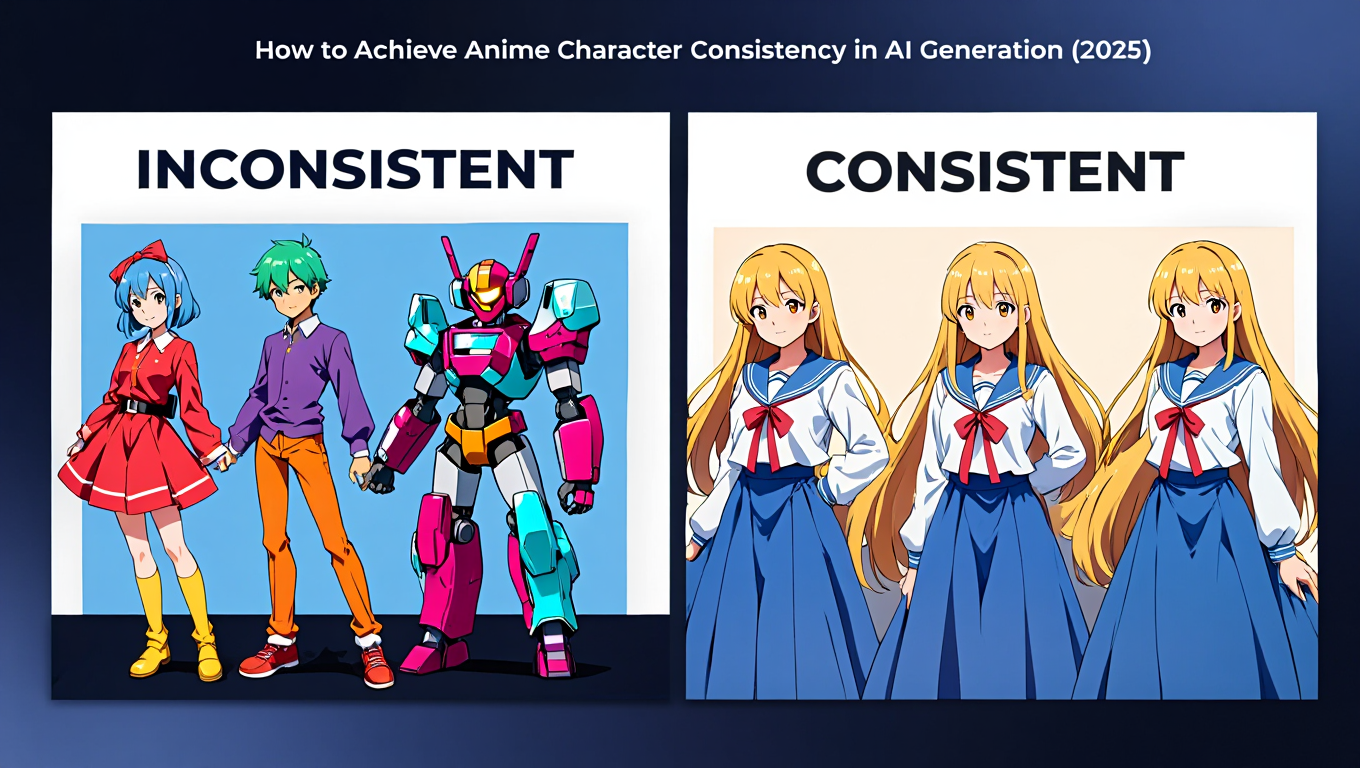

Für diejenigen, die tief in die KI-Bildgenerierung eingebunden sind und sowohl synthetische Inhalte erstellen als auch verifizieren möchten, bieten Plattformen wie Apatero.com wertvolle Ressourcen und Community-Diskussionen über den sich entwickelnden Raum der KI-Bildgebung. Das Verständnis beider Seiten dieser Technologie, Erstellung und Erkennung, macht Sie zu einem informierteren und fähigeren Praktiker in diesem sich schnell entwickelnden Bereich. Um mehr über die Erstellung von KI-Bildern zu erfahren, sehen Sie sich unseren ComfyUI Grundlagen und essentielle Nodes-Leitfaden und unseren Leitfaden zur Charakterkonsistenz in der KI-Generierung an.

Bereit, Ihren KI-Influencer zu Erstellen?

Treten Sie 115 Studenten bei, die ComfyUI und KI-Influencer-Marketing in unserem kompletten 51-Lektionen-Kurs meistern.

Verwandte Artikel

Anime-Charakterkonsistenz in der KI-Generierung erreichen (2025)

Vermeiden Sie unterschiedliche Charaktere bei jeder Generierung. Meistern Sie LoRA-Training, Referenztechniken und Workflow-Strategien für konsistente Anime-Charaktere.

Beste KI-Tools zur Massenproduktion kommerzieller Game Assets 2025

Entdecken Sie die besten KI-Tools zur Generierung kommerzieller Game Assets im großen Maßstab, mit Batch-Processing-Workflows, Lizenzvergleichen und bewährten ROI-Strategien für Spieleentwickler.

Beste Methode für präzise Architekturdarstellung mit Flux 2025

Meistern Sie Flux AI für architektonisches Rendering mit bewährten Techniken für strukturelle Genauigkeit, Stilkontrolle und fotorealistische Gebäudegenerierung mit Dev-, Schnell- und ControlNet-Methoden.