एकाधिक AI-जनित छवियों में कैरेक्टर कंसिस्टेंसी को कैसे ठीक करें

IP-Adapter, LoRA ट्रेनिंग, रेफरेंस इमेज और सिद्ध वर्कफ़्लो तकनीकों का उपयोग करके Stable Diffusion और Flux में कैरेक्टर कंसिस्टेंसी में महारत हासिल करें

आपने AI में एक परफेक्ट कैरेक्टर जनरेट किया है। बढ़िया चेहरा, परफेक्ट स्टाइल, बिल्कुल वही जो आपको चाहिए था। अब आपको उसी कैरेक्टर की अलग-अलग पोज़ और स्थितियों में और इमेज चाहिए। लेकिन हर नई जनरेशन एक बिल्कुल अलग व्यक्ति जैसी दिखती है। बालों का रंग बदल जाता है, चेहरे का आकार बदल जाता है, कपड़े बदल जाते हैं। कई इमेज में एक जैसे कैरेक्टर को बनाए रखना AI जनरेशन की सबसे निराशाजनक चुनौतियों में से एक है।

त्वरित उत्तर: तकनीकों के संयोजन का उपयोग करके कैरेक्टर कंसिस्टेंसी प्राप्त करें। सबसे मजबूत कंसिस्टेंसी के लिए 10-20 रेफरेंस इमेज से कैरेक्टर LoRA को ट्रेन करें। ट्रेनिंग के बिना त्वरित कंसिस्टेंसी के लिए फेस एम्बेडिंग मोड के साथ IP-Adapter का उपयोग करें। विस्तृत विवरण के साथ अपने प्रॉम्प्ट में रेफरेंस इमेज का उपयोग करें। सुसंगत सीड वैल्यू और प्रॉम्प्ट संरचनाओं का उपयोग करें। प्रोफेशनल परिणामों के लिए, सीखी गई और विज़ुअल दोनों विशेषताओं को मजबूत करने के लिए LoRA को IP-Adapter के साथ मिलाएं।

- कैरेक्टर LoRA सबसे मजबूत कंसिस्टेंसी प्रदान करते हैं लेकिन ट्रेनिंग समय की आवश्यकता होती है

- IP-Adapter फेस मोड ट्रेनिंग के बिना तुरंत कंसिस्टेंसी देता है

- प्रॉम्प्ट में विस्तृत कैरेक्टर विवरण विशिष्ट विशेषताओं को एंकर करते हैं

- सुसंगत नेगेटिव प्रॉम्प्ट जनरेशन के बीच फीचर ड्रिफ्ट को रोकते हैं

- कई तकनीकों को मिलाने से सबसे विश्वसनीय परिणाम मिलते हैं

मूल समस्या यह है कि AI इमेज मॉडल में पहचान की कोई अवधारणा नहीं है। हर जनरेशन नॉइज़ से फ्रेश शुरू होती है। कंसिस्टेंसी बनाए रखने के लिए स्पष्ट तंत्र के बिना, प्रत्येक इमेज मॉडल की सामान्य समझ से खींचती है कि चेहरे और शरीर कैसे काम करते हैं, हर बार वेरिएशन पैदा करती है।

आइए इसे उन तकनीकों से हल करें जो वास्तव में प्रोडक्शन वर्कफ़्लो में काम करती हैं।

AI कैरेक्टर क्यों बदलते रहते हैं?

मूल कारण को समझना आपको सही समाधान चुनने में मदद करता है।

डिफ्यूज़न मॉडल चेहरे कैसे जनरेट करते हैं

जब आप "लाल बालों और नीली आँखों वाली महिला" का प्रॉम्प्ट देते हैं, तो मॉडल इन शब्दों को अपने ट्रेनिंग डिस्ट्रीब्यूशन के विरुद्ध व्याख्या करता है। लेकिन "लाल बाल" अलग-अलग शेड्स और स्टाइल वाली हजारों ट्रेनिंग इमेज से मैप होता है।

हर जनरेशन इस डिस्ट्रीब्यूशन से सैंपल लेती है। कभी आपको ऑबर्न मिलता है, कभी चेरी रेड, कभी ऑरेंज-रेड। मॉडल अपनी समझ के अनुसार आपके प्रॉम्प्ट का सही तरीके से पालन कर रहा है, लेकिन वेरिएशन अंतर्निहित हैं।

चेहरे की विशेषताएं और भी परिवर्तनशील हैं। "एक जैसा चेहरा" एक अवधारणा नहीं है जो मॉडल ने सीखी। इसने सामान्य रूप से चेहरे सीखे हैं, इसलिए हर जनरेशन एक विश्वसनीय चेहरा पैदा करती है जो पिछली जनरेशन से जुड़ा नहीं है।

सीड का मिथक

कई उपयोगकर्ता मानते हैं कि एक ही सीड का उपयोग करने से एक ही कैरेक्टर मिलता है। यह आंशिक रूप से सच है लेकिन भ्रामक है।

एक ही सीड के साथ बिल्कुल एक ही प्रॉम्प्ट समान आउटपुट देता है। लेकिन प्रॉम्प्ट को थोड़ा भी बदलें और सीड कुछ अलग पैदा करता है। एक ही सीड के साथ "खड़ी महिला" बनाम "बैठी महिला" जनरेट करने से आपको दो अलग महिलाएं मिलती हैं।

सीड विशिष्ट प्रॉम्प्ट के लिए पुनरुत्पादकता प्रदान करते हैं, विभिन्न परिदृश्यों में कैरेक्टर कंसिस्टेंसी नहीं।

प्रॉम्प्ट वेरिएशन

प्राकृतिक भाषा के प्रॉम्प्ट डिज़ाइन द्वारा वेरिएशन पेश करते हैं। दो प्रॉम्प्ट जो समान लगते हैं, काफी अलग परिणाम दे सकते हैं।

"लंबे सुनहरे बालों वाली महिला" और "लंबे बालों वाली सुनहरे बालों वाली महिला" अलग-अलग मॉडल वेट्स को सक्रिय करते हैं। एक ही कैरेक्टर विवरण अलग तरीके से लिखा जाने से अलग चेहरे आते हैं।

यह भाषाई संवेदनशीलता शुद्ध प्रॉम्प्ट-आधारित कंसिस्टेंसी को लगभग असंभव बना देती है।

IP-Adapter कैरेक्टर कंसिस्टेंसी कैसे प्राप्त करता है?

IP-Adapter ट्रेनिंग के बिना कैरेक्टर कंसिस्टेंसी का सबसे तेज़ रास्ता है।

IP-Adapter क्या करता है

IP-Adapter रेफरेंस इमेज से विज़ुअल फीचर्स निकालता है और उन्हें जनरेशन प्रक्रिया में इंजेक्ट करता है। आप अपने कैरेक्टर की एक इमेज प्रदान करते हैं, और IP-Adapter सुनिश्चित करता है कि नई जनरेशन उन विज़ुअल फीचर्स को साझा करें।

यह तकनीक आपके रेफरेंस से एम्बेडिंग बनाने के लिए CLIP इमेज एनकोडर का उपयोग करती है, फिर इन एम्बेडिंग को डिफ्यूज़न प्रक्रिया को कंडीशन करने के लिए ट्रांसफॉर्म करती है। जनरेट की गई इमेज सीधे कॉपी किए बिना रेफरेंस से विशेषताओं को इनहेरिट करती हैं।

विभिन्न IP-Adapter मॉडल विभिन्न फीचर्स को टारगेट करते हैं। फेस एम्बेडिंग मॉडल विशेष रूप से चेहरे की संरचना, त्वचा का रंग और चेहरे की विशेषताओं को निकालते हैं। ये कैरेक्टर कंसिस्टेंसी के लिए सबसे अच्छे काम करते हैं।

कैरेक्टर के लिए IP-Adapter सेट करना

ComfyUI Manager के माध्यम से या GitHub निर्देशों का पालन करते हुए मैन्युअल रूप से IP-Adapter इंस्टॉल करें। आपको नोड पैक और मॉडल वेट्स दोनों की आवश्यकता होगी।

कैरेक्टर कंसिस्टेंसी के लिए, IP-Adapter-FaceID मॉडल डाउनलोड करें। ये विशेष रूप से फेशियल आइडेंटिटी को निकालने और संरक्षित करने के लिए ट्रेन किए गए हैं।

अपने वर्कफ़्लो में, अपनी CLIP एनकोडिंग के बाद और KSampler से पहले एक IP-Adapter नोड जोड़ें। अपनी रेफरेंस इमेज को IP-Adapter के इमेज इनपुट से कनेक्ट करें।

weight पैरामीटर नियंत्रित करता है कि रेफरेंस जनरेशन को कितना प्रभावित करता है। चेहरों के लिए 0.7-0.8 से शुरू करें। उच्च मान अधिक पहचान को संरक्षित करते हैं लेकिन प्रॉम्प्ट अनुपालन को कम कर सकते हैं।

IP-Adapter कैरेक्टर के लिए सर्वोत्तम अभ्यास

जब संभव हो कई रेफरेंस इमेज का उपयोग करें। IP-Adapter कई रेफरेंस से फीचर्स को मिला सकता है, जो सिंगल इमेज रेफरेंस की तुलना में अधिक मजबूत कंसिस्टेंसी पैदा करता है।

स्पष्ट चेहरों वाले रेफरेंस चुनें। अच्छी तरह से लाइटेड, फ्रंट-फेसिंग इमेज स्टाइलाइज़्ड या आंशिक रूप से छुपे चेहरों से बेहतर काम करती हैं।

रेफरेंस और टारगेट के बीच स्टाइल मैच करें। एनीमे स्टाइल जनरेट करते समय फोटो रेफरेंस का उपयोग करने से कॉन्फ्लिक्ट होता है। जब संभव हो स्टाइल-मैच्ड रेफरेंस का उपयोग करें।

विभिन्न स्थितियों के लिए वेट एडजस्ट करें। क्लोज़-अप पोर्ट्रेट को 0.85 के आसपास उच्च वेट की आवश्यकता होती है। फुल बॉडी शॉट्स 0.6 के आसपास कम वेट का उपयोग कर सकते हैं क्योंकि फ्रेम में चेहरा छोटा होता है।

IP-Adapter की सीमाएं

IP-Adapter विज़ुअल फीचर्स को संरक्षित करता है लेकिन कैरेक्टर सेमांटिक्स को नहीं समझता। यह आउटफिट कंसिस्टेंसी या कैरेक्टर बैकस्टोरी को बनाए नहीं रख सकता, केवल वही जो रेफरेंस में विज़ुअली मौजूद है।

मजबूत वेट्स प्रॉम्प्ट निर्देशों को ओवरव्हेल्म कर सकते हैं। अगर आपका प्रॉम्प्ट अलग लाइटिंग मांगता है लेकिन रेफरेंस में कठोर छायाएं हैं, तो परिणाम उन छायाओं को रख सकता है।

कई कैरेक्टर के साथ क्वालिटी खराब होती है। IP-Adapter सिंगल सब्जेक्ट कंसिस्टेंसी के लिए सबसे अच्छा काम करता है। एक सीन में कई कैरेक्टर चुनौतीपूर्ण है।

कैरेक्टर LoRA कैसे ट्रेन करें?

कैरेक्टर LoRA सबसे मजबूत कंसिस्टेंसी प्रदान करते हैं लेकिन अपफ्रंट ट्रेनिंग निवेश की आवश्यकता होती है।

LoRA बेहतर क्यों काम करते हैं

एक ट्रेंड LoRA कई इमेज और संदर्भों में आपके कैरेक्टर की विशिष्ट विशेषताओं को सीखता है। यह समझता है कि आपका कैरेक्टर अलग-अलग लाइटिंग, पोज़ और एक्सप्रेशन में कैसा दिखता है।

जब आप जनरेशन के दौरान LoRA को ट्रिगर करते हैं, तो यह पूरी प्रक्रिया में मॉडल को आपके कैरेक्टर की विशेषताओं की ओर बायस करता है। यह रेफरेंस-आधारित तरीकों की तुलना में अधिक प्राकृतिक परिणाम देता है क्योंकि मॉडल वास्तव में कैरेक्टर को "जानता" है।

ट्रेनिंग आवश्यकताएं

आपके कैरेक्टर की 10-20 इमेज ट्रेनिंग को ओवरव्हेल्म किए बिना पर्याप्त वेरिएंस प्रदान करती हैं। लाइटिंग, एंगल, एक्सप्रेशन और बैकग्राउंड में विविधता शामिल करें।

मुफ़्त ComfyUI वर्कफ़्लो

इस लेख में तकनीकों के लिए मुफ़्त ओपन-सोर्स ComfyUI वर्कफ़्लो खोजें। ओपन सोर्स शक्तिशाली है।

ट्रेनिंग इमेज में सुसंगत विशेषताएं मात्रा से अधिक मायने रखती हैं। अगर ट्रेनिंग इमेज में असंगत विवरण हैं, तो LoRA असंगतता सीखता है।

प्रत्येक इमेज का वर्णन करने वाले अच्छे कैप्शन LoRA क्वालिटी में काफी सुधार करते हैं। अपना ट्रिगर वर्ड और पोज़, एक्सप्रेशन और सेटिंग के बारे में प्रासंगिक विवरण शामिल करें।

ट्रेनिंग प्रक्रिया

Kohya SS या समान ट्रेनिंग टूल्स का उपयोग करें। Flux LoRA ट्रेनिंग गाइड्स की सेटिंग्स का उपयोग करके अपने GPU के VRAM के लिए कॉन्फ़िगर करें।

"ohwxcharacter" जैसा एक यूनीक ट्रिगर वर्ड सेट करें जो प्राकृतिक भाषा से कॉन्फ्लिक्ट न करे। आप इस वर्ड का उपयोग प्रॉम्प्ट में कैरेक्टर को एक्टिवेट करने के लिए करेंगे।

कैरेक्टर के लिए 800-1500 स्टेप्स ट्रेन करें। ट्रेनिंग के दौरान सैंपल आउटपुट देखें। जब कैरेक्टर पहचानने योग्य हो लेकिन ओवरफिट डिग्रेडेशन शुरू न हुआ हो तब रुकें।

16-24 का नेटवर्क रैंक कैरेक्टर के लिए अच्छा काम करता है। वे स्टाइल से सरल हैं, इसलिए कम रैंक उन्हें पर्याप्त रूप से कैप्चर करते हैं।

कैरेक्टर LoRA का उपयोग

अपने जनरेशन वर्कफ़्लो में LoRA लोड करें। ComfyUI में, LoRA लोडर नोड का उपयोग करें। आप कैरेक्टर फीचर्स कितने मजबूत चाहते हैं इसके आधार पर स्ट्रेंथ को 0.7-0.9 पर सेट करें।

प्रॉम्प्ट में अपना ट्रिगर वर्ड शामिल करें। "ohwxcharacter standing in a garden" LoRA को एक्टिवेट करता है और कैरेक्टर को सीन में रखता है।

अन्य प्रॉम्प्ट एलिमेंट्स को स्वतंत्र रूप से बदलें। LoRA कैरेक्टर कंसिस्टेंसी को संभालता है जबकि आप प्रॉम्प्टिंग के माध्यम से बाकी सब कुछ नियंत्रित करते हैं।

LoRA को IP-Adapter के साथ मिलाना

अधिकतम कंसिस्टेंसी के लिए, दोनों का एक साथ उपयोग करें। LoRA सीखी गई कैरेक्टर समझ प्रदान करता है, जबकि IP-Adapter एक रेफरेंस से विज़ुअल फीचर्स को मजबूत करता है।

LoRA स्ट्रेंथ को 0.6-0.7 और IP-Adapter वेट को 0.5-0.6 पर सेट करें। ये मध्यम मान दोनों तकनीकों को एक-दूसरे से लड़े बिना योगदान देने देते हैं।

यह संयोजन उन एज केसेस को संभालता है जो कोई भी तकनीक अकेले मिस कर सकती है। अलग-अलग एंगल, एक्सप्रेशन या स्टाइल सुसंगत रहते हैं क्योंकि दोनों सिस्टम कैरेक्टर आइडेंटिटी को मजबूत करते हैं।

कौन सी प्रॉम्प्ट तकनीकें कंसिस्टेंसी बनाए रखने में मदद करती हैं?

IP-Adapter या LoRA के बिना भी, प्रॉम्प्ट इंजीनियरिंग कंसिस्टेंसी में सुधार करती है।

विस्तृत फीचर विवरण

अस्पष्ट विवरण वेरिएशन की अनुमति देते हैं। "भूरे बालों वाली महिला" मॉडल को बहुत अधिक स्वतंत्रता देता है। "कंधे तक लंबे चेस्टनट ब्राउन वेवी बालों वाली महिला, बाईं ओर से विभाजित" व्याख्या को सीमित करता है।

हर प्रॉम्प्ट में विशिष्ट फीचर्स का वर्णन करें। आँखों का रंग, आँखों का आकार, नाक का प्रकार, चेहरे का आकार, त्वचा का रंग, विशिष्ट चिह्न। अधिक विशिष्टता का मतलब कम मॉडल व्याख्या।

जटिलता को छोड़ना चाहते हैं? Apatero बिना किसी तकनीकी सेटअप के तुरंत पेशेवर AI परिणाम देता है।

प्रॉम्प्ट में सटीक शब्दों को बनाए रखें। एक प्रॉम्प्ट में "नीली आँखें" और दूसरे में "आसमानी आँखें" न लिखें। सुसंगत भाषा अधिक सुसंगत परिणाम देती है।

स्ट्रक्चर्ड प्रॉम्प्ट टेम्पलेट्स

एक कैरेक्टर टेम्पलेट बनाएं जिसका उपयोग आप हर जनरेशन के लिए करें। केवल उन हिस्सों को बदलें जो परिदृश्य का वर्णन करते हैं।

उदाहरण के लिए, आपका टेम्पलेट हो सकता है "[परिदृश्य], कंधे तक लंबे ऑबर्न वेवी बालों वाली युवा महिला, दिल के आकार का चेहरा, नाक और गालों पर हल्की झाइयां, हरी आँखें, [आउटफिट] पहने हुए।"

कैरेक्टर फीचर्स को समान रखते हुए परिदृश्य और आउटफिट भरें। यह सुनिश्चित करता है कि हर बार एक ही फीचर्स अनुरोध किए जाएं।

नेगेटिव प्रॉम्प्ट कंसिस्टेंसी

नेगेटिव प्रॉम्प्ट कैरेक्टर की उपस्थिति को महत्वपूर्ण रूप से प्रभावित करते हैं। असंगत नेगेटिव प्रॉम्प्ट फीचर ड्रिफ्ट का कारण बनते हैं।

अपने कैरेक्टर के लिए एक स्टैंडर्ड नेगेटिव प्रॉम्प्ट बनाएं। "कई लोग, विकृत फीचर्स, गलत बालों का रंग" जैसी विशेषताओं को शामिल करें जिनसे आप बचना चाहते हैं और इसे सुसंगत रखें।

नए नेगेटिव टर्म्स जोड़ने से यह बदल सकता है कि मॉडल पॉज़िटिव प्रॉम्प्ट की व्याख्या कैसे करता है। अपने नेगेटिव प्रॉम्प्ट को जल्दी लॉक करें और प्रति-जनरेशन संशोधित न करें।

क्रम और जोर

प्रॉम्प्ट में शब्द क्रम जोर को प्रभावित करता है। पहले उल्लिखित फीचर्स को अधिक ध्यान मिलता है।

परिदृश्य विवरण से पहले अपने प्रॉम्प्ट में कैरेक्टर फीचर्स को जल्दी रखें। यह सेटिंग पर आइडेंटिटी पर जोर देता है।

अगर आपका मॉडल सपोर्ट करता है तो एम्फेसिस सिंटैक्स का उपयोग करें। "(auburn hair:1.2)" जैसे पैरेंथेसिस विशिष्ट फीचर्स के वेट को बढ़ाते हैं।

प्रॉम्प्ट में रेफरेंस इमेज के बारे में क्या?

इमेज-टू-इमेज तकनीकें एक और कंसिस्टेंसी टूल प्रदान करती हैं।

कम डीनॉइज़िंग के साथ Img2Img

पिछली जनरेशन को 0.3-0.4 के आसपास कम डीनॉइज़िंग स्ट्रेंथ के साथ img2img में इनपुट के रूप में उपयोग करें। नई इमेज इनपुट से स्ट्रक्चर इनहेरिट करती है जबकि प्रॉम्प्ट बदलाव को गाइड करता है।

यह बेस इमेज से पोज़ वेरिएशन के लिए काम करता है। एक मजबूत कैरेक्टर इमेज जनरेट करें, फिर इसे अन्य पोज़ के लिए रेफरेंस के रूप में उपयोग करें।

कम डीनॉइज़िंग इनपुट इमेज से अधिक संरक्षित करता है, जिसमें फेशियल फीचर्स शामिल हैं। उच्च डीनॉइज़िंग अधिक बदलाव की अनुमति देता है लेकिन कैरेक्टर कंसिस्टेंसी खोने का जोखिम है।

रेफरेंस के साथ ControlNet

ControlNet का रेफरेंस-ओनली मोड प्री-प्रोसेस्ड कंट्रोल इमेज की आवश्यकता के बिना जनरेशन को गाइड करने के लिए रेफरेंस इमेज का उपयोग करता है।

कंटेंट बनाकर $1,250+/महीना कमाएं

हमारे विशेष क्रिएटर एफिलिएट प्रोग्राम में शामिल हों। वायरल वीडियो प्रदर्शन के आधार पर भुगतान पाएं। पूर्ण रचनात्मक स्वतंत्रता के साथ अपनी शैली में कंटेंट बनाएं।

यह IP-Adapter के समान काम करता है लेकिन एक अलग मैकेनिज्म के माध्यम से। कुछ उपयोगकर्ताओं को यह विशिष्ट उपयोग मामलों के लिए अधिक नियंत्रणीय लगता है।

पोज़ को नियंत्रित करने के लिए OpenPose जैसे अन्य ControlNet मोड्स के साथ मिलाएं जबकि रेफरेंस मोड अपीयरेंस को संभालता है।

कंसिस्टेंसी के लिए इनपेंटिंग

जब एक सेट में एक इमेज में गलत फीचर्स हों, तो पूरी तरह से रीजनरेट करने के बजाय इनपेंटिंग का उपयोग करें।

बालों के रंग जैसे असंगत फीचर को मास्क करें, फिर एक टारगेटेड प्रॉम्प्ट के साथ इनपेंट करें। आसपास का संदर्भ फिक्स को अन्य इमेज से मैच करने के लिए एंकर करता है।

यह छोटे सुधारों के लिए विशेष रूप से उपयोगी है जो रीजनरेट करने में थकाऊ होंगे।

उन क्रिएटर्स के लिए जिन्हें इन तकनीकी दृष्टिकोणों में महारत हासिल किए बिना विश्वसनीय कैरेक्टर कंसिस्टेंसी की आवश्यकता है, Apatero.com कई जनरेशन में कैरेक्टर को बनाए रखने के लिए विशेष रूप से डिज़ाइन किए गए टूल्स प्रदान करता है। आप क्रिएटिव डायरेक्शन पर फोकस करते हैं जबकि प्लेटफॉर्म तकनीकी कंसिस्टेंसी को संभालता है।

विभिन्न परिदृश्यों के लिए कौन से टूल्स सबसे अच्छे काम करते हैं?

अपनी तकनीक को अपनी विशिष्ट आवश्यकताओं से मैच करें।

कॉमिक और सीक्वेंशियल आर्ट

LoRA ट्रेनिंग लॉन्ग-टर्म कैरेक्टर उपयोग के लिए सबसे अच्छी नींव प्रदान करती है। असीमित सुसंगत जनरेशन के लिए एक बार ट्रेनिंग में समय निवेश करें।

जब आपको रेफरेंस पैनल से विशिष्ट एक्सप्रेशन या एंगल की आवश्यकता हो तो IP-Adapter से पूरक करें।

कैरेक्टर फीचर्स के साथ आउटफिट और प्रॉप कंसिस्टेंसी बनाए रखने के लिए स्ट्रक्चर्ड प्रॉम्प्ट का उपयोग करें।

त्वरित वन-ऑफ प्रोजेक्ट्स

IP-Adapter को ट्रेनिंग की आवश्यकता नहीं है और तुरंत काम करता है। एक अच्छी रेफरेंस इमेज जनरेट करें, फिर प्रोजेक्ट में शेष इमेज के लिए इसका उपयोग करें।

तेज़ वर्कफ़्लो के बदले में थोड़ी कम कंसिस्टेंसी स्वीकार करें।

प्रोफेशनल प्रोडक्शन

सभी तकनीकों को मिलाएं। बेस कंसिस्टेंसी के लिए कैरेक्टर LoRA ट्रेन करें। शॉट-स्पेसिफिक रिफाइनमेंट के लिए IP-Adapter का उपयोग करें। विश्वसनीयता के लिए सख्त प्रॉम्प्ट टेम्पलेट्स का उपयोग करें।

यह मैक्सिमल एप्रोच अधिक समय खर्च करता है लेकिन प्रोफेशनल काम के लिए आवश्यक कंसिस्टेंसी लेवल सुनिश्चित करता है।

एनीमे और स्टाइलाइज़्ड कैरेक्टर

समान तकनीकें लागू होती हैं लेकिन स्टाइल-स्पेसिफिक मॉडल की आवश्यकता हो सकती है। एनीमे IP-Adapter मॉडल मौजूद हैं जो फोटोरियलिस्टिक की तुलना में स्टाइलाइज़्ड फेस के लिए बेहतर काम करते हैं।

एनीमे कैरेक्टर पर ट्रेंड LoRA को रियलिस्टिक से अलग सेटिंग्स की आवश्यकता हो सकती है। उच्च लर्निंग रेट्स और छोटी ट्रेनिंग के साथ प्रयोग करें।

अक्सर पूछे जाने वाले प्रश्न

क्या मैं LoRA ट्रेन किए बिना परफेक्ट कंसिस्टेंसी प्राप्त कर सकता हूं?

क्लोज़-अप पोर्ट्रेट के लिए IP-Adapter फेस मोड के साथ लगभग परफेक्ट। फुल बॉडी और अलग-अलग एंगल में अधिक वेरिएशन होता है। सभी परिदृश्यों में वास्तव में परफेक्ट कंसिस्टेंसी के लिए, LoRA ट्रेनिंग आवश्यक है।

कैरेक्टर LoRA के लिए मुझे कितनी इमेज चाहिए?

10-20 इमेज अच्छे परिणाम देती हैं। अधिक इमेज केवल तभी मदद करती हैं जब वे पोज़, लाइटिंग और एक्सप्रेशन में वास्तविक विविधता जोड़ती हैं। 50 समान इमेज 15 विविध इमेज से बेहतर ट्रेन नहीं करतीं।

IP-Adapter मेरे कैरेक्टर को रेफरेंस से बहुत समान क्यों बनाता है?

आपका वेट बहुत अधिक है। आइडेंटिटी बनाए रखते हुए अधिक वेरिएशन के लिए 0.5-0.6 तक कम करें। बहुत उच्च वेट्स बुनियादी तौर पर नई इमेज जनरेट करने के बजाय रेफरेंस को कॉपी करते हैं।

क्या मैं एक सीन में कई कैरेक्टर को सुसंगत रूप से उपयोग कर सकता हूं?

हां, लेकिन यह चुनौतीपूर्ण है। रीजनल प्रॉम्प्टिंग के साथ प्रत्येक कैरेक्टर के लिए अलग IP-Adapter एप्लीकेशन का उपयोग करें। या दोनों कैरेक्टर को एक साथ रखने वाली इमेज पर ट्रेंड मल्टी-कैरेक्टर LoRA का उपयोग करें।

IP-Adapter या LoRA का उपयोग करते समय क्या सीड वैल्यू मायने रखती है?

सीड समग्र कंपोज़िशन और मामूली विवरणों को प्रभावित करता है लेकिन इन तकनीकों का उपयोग करते समय कैरेक्टर आइडेंटिटी को नहीं। कंसिस्टेंसी IP-Adapter या LoRA से आती है, सीड से नहीं।

मेरे कैरेक्टर का आउटफिट इमेज के बीच बदलता रहता है। मैं इसे कैसे ठीक करूं?

कैरेक्टर LoRA आमतौर पर आउटफिट को अच्छी तरह से कैप्चर नहीं करते क्योंकि ट्रेनिंग को फीचर विविधता की आवश्यकता होती है। एक अलग आउटफिट LoRA या हर प्रॉम्प्ट में विस्तृत आउटफिट विवरण का उपयोग करें। IP-Adapter आउटफिट में मदद नहीं करता।

विभिन्न आर्ट स्टाइल के बीच कंसिस्टेंसी कैसे बनाए रखूं?

यह बहुत कठिन है। एक ही कैरेक्टर के रियलिस्टिक फोटो और एनीमे वर्जन के लिए या तो स्टाइल ट्रांसफर तकनीकों या प्रत्येक स्टाइल के लिए अलग LoRA की आवश्यकता होती है जो दोनों कैरेक्टर पर ट्रेंड किए गए हों।

क्या मैं मौजूदा मीडिया से कैरेक्टर निकाल सकता हूं और नई इमेज जनरेट कर सकता हूं?

हां, मीडिया से प्राप्त ट्रेनिंग डेटा के साथ। कैरेक्टर को स्पष्ट रूप से दिखाने वाले 15-20 फ्रेम इकट्ठा करें, LoRA ट्रेन करें, फिर नई इमेज जनरेट करें। अपने उपयोग मामले के लिए कॉपीराइट विचारों का सम्मान करें।

क्लोज़-अप में मेरा कैरेक्टर सही दिखता है लेकिन फुल बॉडी शॉट्स में गलत क्यों?

IP-Adapter फेस एम्बेडिंग फेशियल फीचर्स पर फोकस करती है। फुल बॉडी शॉट्स में चेहरा छोटा होता है, इसलिए एम्बेडिंग का कम प्रभाव होता है। उच्च IP-Adapter वेट का उपयोग करें या प्रॉम्प्ट में विस्तृत बॉडी विवरण जोड़ें।

कैरेक्टर LoRA ट्रेन करने में कितना समय लगता है?

RTX 4090 पर, एक साधारण कैरेक्टर LoRA के लिए लगभग 30-60 मिनट। अच्छे कैप्शन के साथ ट्रेनिंग डेटा तैयार करने में अतिरिक्त समय लगता है। डेटा प्रेप सहित कुल प्रोजेक्ट समय आमतौर पर 2-3 घंटे होता है।

निष्कर्ष और अनुशंसित वर्कफ़्लो

AI जनरेशन में कैरेक्टर कंसिस्टेंसी के लिए जानबूझकर तकनीक की आवश्यकता होती है बजाय यह आशा करने के कि प्रॉम्प्ट अकेले काम करेंगे। ट्रेंड LoRA, IP-Adapter रेफरेंस और स्ट्रक्चर्ड प्रॉम्प्ट का संयोजन विश्वसनीय परिणाम देता है।

जिन कैरेक्टर का आप बार-बार उपयोग करेंगे, उनके लिए LoRA ट्रेनिंग में समय निवेश करें। प्रारंभिक लागत बाद में असीमित सुसंगत जनरेशन के माध्यम से वसूल होती है।

त्वरित प्रोजेक्ट्स के लिए, IP-Adapter फेस मोड ट्रेनिंग के बिना तुरंत कंसिस्टेंसी प्रदान करता है। स्पीड के बदले में थोड़ा अधिक वेरिएशन स्वीकार करें।

अपने प्रॉम्प्ट में हमेशा विस्तृत, सुसंगत कैरेक्टर विवरण का उपयोग करें। LoRA और IP-Adapter के साथ भी, विशिष्ट भाषा फीचर्स को एंकर करने में मदद करती है।

विभिन्न पोज़ और परिदृश्यों के साथ अपने कंसिस्टेंसी सेटअप को जल्दी टेस्ट करें। पूर्ण प्रोजेक्ट के लिए प्रतिबद्ध होने से पहले कमजोरियों की पहचान करें।

उन उपयोगकर्ताओं के लिए जो इन तकनीकी सिस्टम में महारत हासिल किए बिना प्रोफेशनल-ग्रेड कैरेक्टर कंसिस्टेंसी चाहते हैं, Apatero.com जनरेशन में कैरेक्टर को बनाए रखने के लिए विशेष रूप से बनाए गए टूल्स प्रदान करता है। आप अपने कैरेक्टर का एक बार वर्णन करें और असीमित सुसंगत इमेज जनरेट करें।

कैरेक्टर कंसिस्टेंसी हल करने योग्य है। अपनी स्थिति के लिए सही तकनीकों के साथ, आप किसी भी संख्या की इमेज और परिदृश्यों में एक ही कैरेक्टर को विश्वसनीय रूप से जनरेट कर सकते हैं।

अपना AI इन्फ्लुएंसर बनाने के लिए तैयार हैं?

115 छात्रों के साथ शामिल हों जो हमारे पूर्ण 51-पाठ पाठ्यक्रम में ComfyUI और AI इन्फ्लुएंसर मार्केटिंग में महारत हासिल कर रहे हैं।

संबंधित लेख

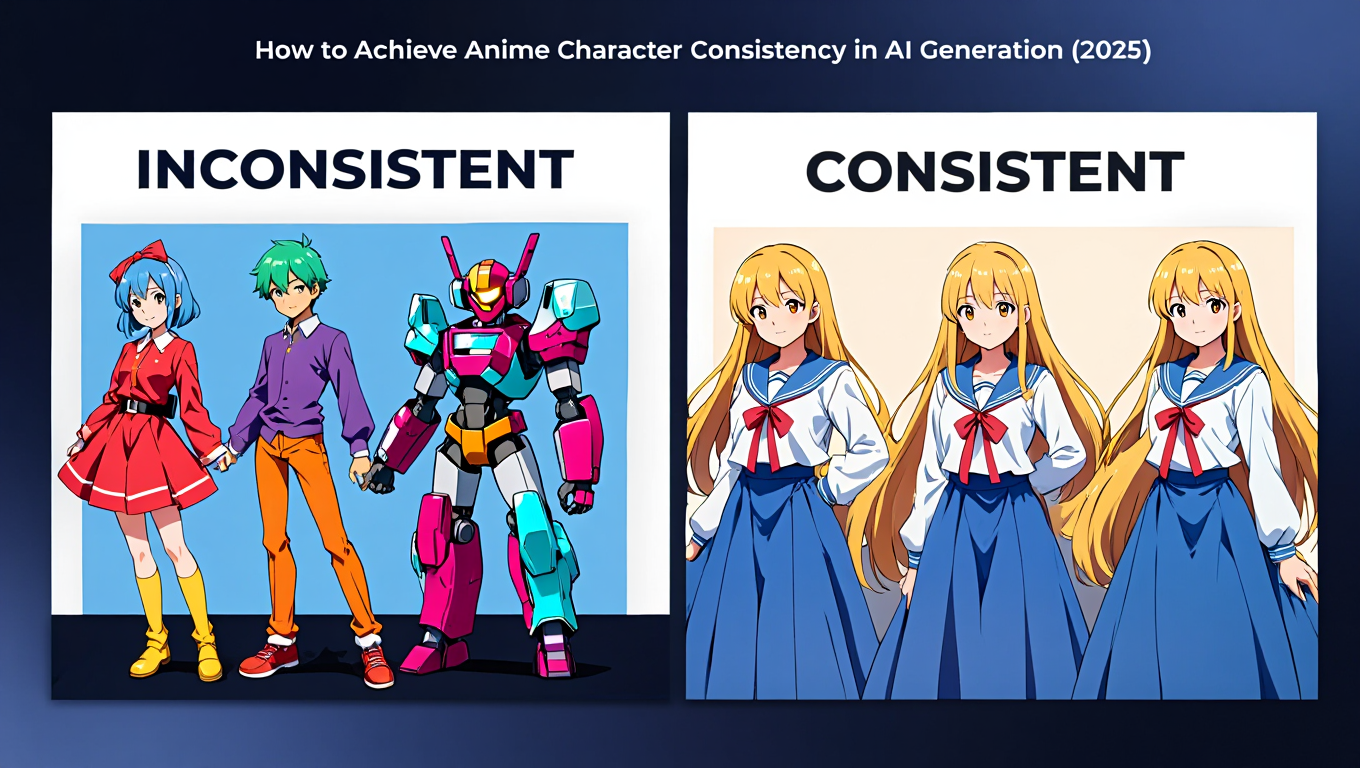

AI जनरेशन में एनीमे कैरेक्टर कंसिस्टेंसी कैसे प्राप्त करें (2025)

हर जनरेशन में अलग-अलग कैरेक्टर आने से रोकें। कंसिस्टेंट एनीमे कैरेक्टर्स के लिए LoRA ट्रेनिंग, रेफरेंस तकनीकें और वर्कफ्लो रणनीतियां मास्टर करें।

सर्वश्रेष्ठ ओपन सोर्स वीडियो मॉडल 2025: Kandinsky 5.0 vs HunyuanVideo 1.5 vs LTX 2 vs WAN 2.2

2025 के सर्वश्रेष्ठ ओपन सोर्स वीडियो जनरेशन मॉडल की तुलना करें। विस्तृत बेंचमार्क, VRAM आवश्यकताएं, स्पीड टेस्ट और लाइसेंसिंग विश्लेषण आपको सही मॉडल चुनने में मदद करने के लिए।

बच्चों की पुस्तक चित्रण के लिए सर्वश्रेष्ठ प्रॉम्प्ट - लेखकों के लिए 50+ मनमोहक उदाहरण 2025

चित्र पुस्तकों, कहानी के पात्रों और शैक्षिक सामग्री के लिए 50+ परीक्षित प्रॉम्प्ट के साथ बच्चों की पुस्तक चित्रण निर्माण में महारत हासिल करें। लेखकों और चित्रकारों के लिए संपूर्ण मार्गदर्शिका।