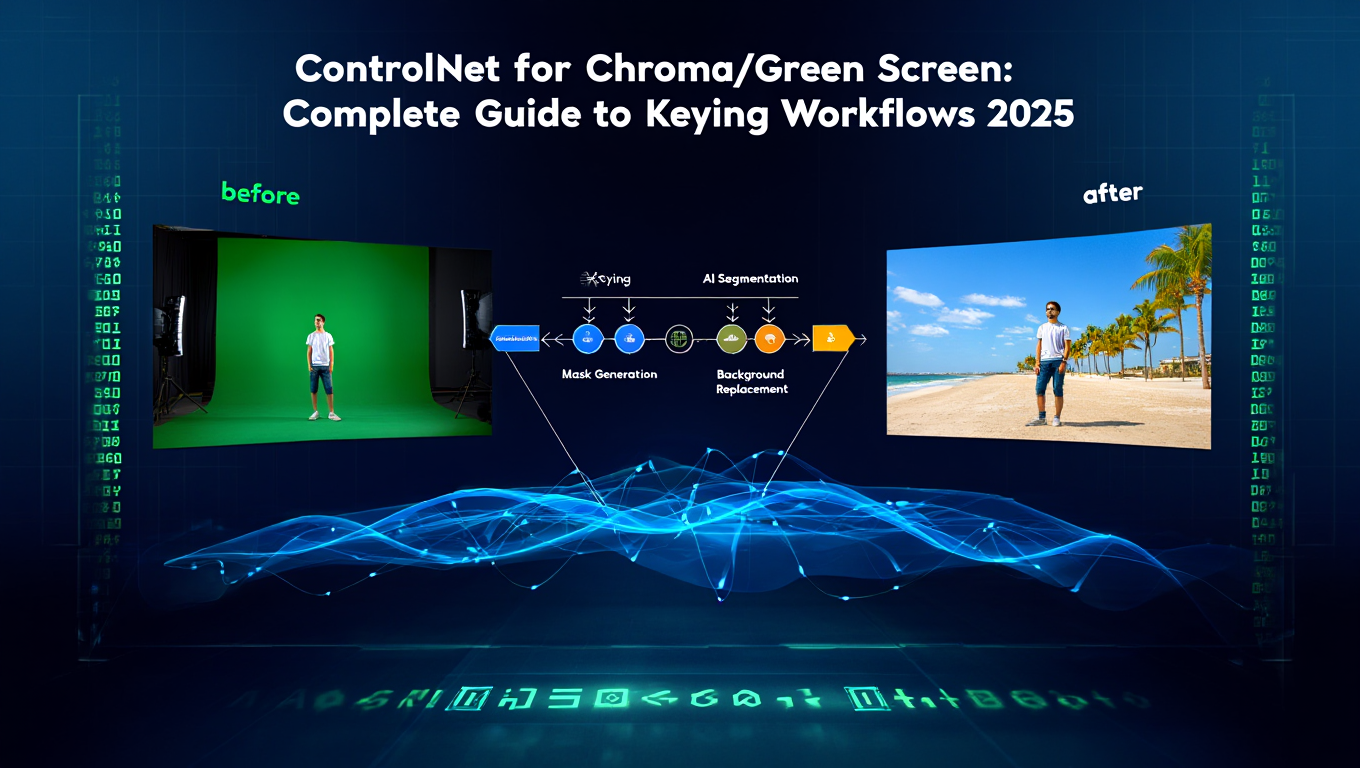

ControlNetによるクロマキー/グリーンスクリーン:完全ガイド2025

ComfyUIでのControlNetとクロマキー、グリーンスクリーンワークフローの包括的なガイド。セットアップ、実用的な応用、トラブルシューティング、プロフェッショナルなテクニック。

簡単な回答: ControlNetは、背景置換時に被写体の詳細を保持しながら構造的なガイダンスを提供することで、ComfyUIにおける知的なクロマキーとグリーンスクリーン合成を可能にします。深度、法線、線画の前処理を使用して背景置換時に被写体の境界を維持し、従来のキーイングだけよりもクリーンな合成を生成します。

- セットアップ: ComfyUI + ControlNetモデル + クロマキーノード

- 最適なControlNetタイプ: クロマワークには深度、法線、線画

- 主な利点: 背景置換中に被写体の構造を維持

- 使用例: クリーンなグリーンスクリーン除去、背景置換、ビデオ合成

- 品質: 適切な前処理によるプロフェッショナルな結果

シンプルなグリーンスクリーン背景置換を試みました。従来のクロマキーは緑を完璧に除去しましたが...同時に被写体の髪の半分も除去し、エッジ周辺に奇妙なハロー効果を作り、透明なオブジェクトが間違って見えました。

何時間もスピル抑制、エッジフェザリング、すべての従来のキーイングコントロールを調整しました。改善されましたが、まだ完璧ではありませんでした。次に、背景を置換しながら被写体の構造を維持するためにControlNetの深度ガイダンスを追加してみました。

突然、髪が無傷のままになり、エッジがクリーンに見え、透明なオブジェクトがそのプロパティを維持しました。ControlNetはクロマキーを置き換えるものではありません...それを適切に機能させるものです。

- ControlNetが従来のクロマキーワークフローを強化する方法

- ComfyUIでのクロマ + ControlNetの完全セットアップ

- 異なるキーイングシナリオに最適なControlNetタイプ

- プロフェッショナルな合成テクニックと品質のヒント

- 一般的なクロマとControlNetの問題のトラブルシューティング

- 実世界の応用とワークフローの例

ControlNetとクロマキーを組み合わせる理由

これらのテクニックの相乗効果を理解することで、その組み合わせの力が明らかになります。

従来のクロマキーの制限

カラースピル: グリーンスクリーンは被写体に緑色の光を反射し、クリーンに除去することが難しい緑色のエッジと色の汚染を作り出します。

エッジディテールの損失: 髪、毛皮、透明なオブジェクトなどの細かいディテールは、背景を完全に除去するために必要な積極的なキーイング中に定義を失います。

モーションブラーの問題: 動いている被写体は、前景と背景の色を混ぜるモーションブラーを作り出します。従来のキーイングではクリーンに分離できません。

照明の不一致: 不均一なグリーンスクリーンの照明は、一貫したキーイングをほぼ不可能にするホットスポットと影を作り出します。

ControlNetがこれらの問題を解決する方法

構造的ガイダンス: ControlNetの深度または法線マップは、色とは独立した被写体境界情報を提供します。カラーキーイングが苦戦しているときでも構造を保持します。

エッジの保持: 深度と法線マップは、合成プロセスを生き抜く細かいエッジディテールをキャプチャし、従来のキーイングが失うディテールを回復します。

意味的理解: ControlNetは、単に色だけでなく、構造的に被写体と背景を理解します。混合色とスピルをより適切に処理します。

一貫した品質: ControlNetからの構造的ガイダンスは、照明やキーイングの変動にもかかわらず、フレーム全体でより一貫した結果を生み出します。

クロマワークフローのためのControlNetのセットアップ

ComfyUIクロマ + ControlNetワークフローの完全な技術的セットアップ。

前提条件

必要なコンポーネント:

- ComfyUI 0.3.0+

- ControlNetカスタムノードがインストール済み

- ControlNetモデルファイル(深度、法線、線画)

- クロマキーノード(ネイティブまたはカスタム)

- 8GB以上のVRAM推奨

インストール手順:

- マネージャー経由でComfyUI ControlNetノードをインストール

- Hugging FaceからControlNetモデルをダウンロード

- モデルをComfyUI/models/controlnet/に配置

- クロマキーノードが利用可能であることを確認(標準ComfyUIに含まれることが多い)

- ComfyUIを再起動し、ノードが表示されることを確認

クロマワークに必須のControlNetモデル

深度ControlNet: 被写体と背景の分離を維持するのに最適。グリーンスクリーンに対する人、オブジェクト、製品で優れた働きをします。

法線マップControlNet: 表面の向きをキャプチャします。複雑な表面と細かいディテール保持に優れています。

線画ControlNet: エッジと境界を強調します。被写体に明確で定義されたエッジがある場合にうまく機能します。

ダウンロードの優先順位: 深度ControlNet(クロマワークに最も汎用性がある)から始め、必要に応じて法線と線画を追加します。

基本的なワークフロー構造

ノードフロー:

- 入力ノード: グリーンスクリーン画像またはビデオフレームを読み込む

- クロマキーノード: グリーンスクリーンの色を除去

- ControlNet前処理: 元の画像から深度/法線/線画マップを生成

- ControlNet適用: 構造的ガイダンスを使用

- 背景ノード: 置換背景を読み込むまたは生成

- 合成ノード: 被写体と新しい背景を結合

- 出力: 最終的な合成画像

重要な概念: ControlNetの前処理は、被写体の構造を保持するために、クロマキーの前に元の画像で行われます。

異なるクロマシナリオのためのControlNetタイプ

適切なControlNetタイプを選択することで、結果が劇的に変わります。

スタジオショットのための深度ControlNet

最適な用途:

- プロフェッショナルなスタジオグリーンスクリーン映像

- 明確な被写体と背景の分離

- 人物と製品写真

- 標準的なトーキングヘッドビデオ

仕組み: 深度マップはカメラからの距離を識別します。被写体(近い)が背景(遠い)から構造的に分離され、カラーキーイングの成功とは無関係です。

ワークフロー:

- 元のグリーンスクリーン画像で深度前処理を実行

- クロマキーが緑を除去

- ControlNet深度ガイダンスを適用

- 新しい背景と合成

- 深度マップが被写体の境界を鮮明に保つ

品質のヒント: 最高の分離精度のために、高品質の深度前処理(MiDaSまたはZoeDepth)を使用します。

細かいディテールのための法線マップControlNet

最適な用途:

- 髪と毛皮のディテール保持

- 布地のテクスチャと折り目

- 製品の表面ディテール

- 複雑な被写体の表面

仕組み: 法線マップは、すべてのピクセルで表面の向きをエンコードします。カラーキーイングがエッジで失敗しても、細かい表面ディテールを保持します。

ワークフロー:

- 元の画像から法線マップを生成

- クロマキーを適用

- ガイダンスのために法線マップControlNetを使用

- 表面ディテールを保持して合成

- 細かいエッジディテールが合成を生き抜く

使用する場合: 従来のキーイングが髪のディテール、布地のテクスチャ、その他の細かい表面特性を失う場合。

クリーンなエッジのための線画ControlNet

最適な用途:

- 定義されたエッジを持つアニメーションコンテンツ

- 明確な境界を持つ製品

- グラフィックまたはスタイライズされた被写体

- 鮮明なエッジ定義が重要な場合

仕組み: 元の画像からエッジラインを抽出します。これらのエッジが合成をガイドし、クリーンな被写体の境界を保証します。

ワークフロー:

- 元のグリーンスクリーンから線画を抽出

- クロマキーが背景を除去

- 線画ControlNetがエッジの精度を維持

- シャープで定義された被写体の境界で合成

制限: 明確なエッジを持つ被写体で最もよく機能します。煙や半透明の材料のような柔らかく徐々に変化する境界では苦戦します。

マルチControlNetアプローチ(高度)

戦略: 最高品質のために複数のControlNetタイプを組み合わせます。

ワークフローの例:

- 深度ControlNet:全体的な被写体と背景の分離(強度0.7)

- 法線ControlNet:細かいディテール保持(強度0.5)

- 線画ControlNet:エッジの鮮明さ(強度0.4)

利点: 各ControlNetタイプがその強みを提供します。深度は分離を処理し、法線はディテールを保持し、線画はエッジを鮮明にします。

複雑さ: 複数のControlNet強度のバランスを取るには実験が必要です。単一のControlNetから始め、必要な場合にのみ他を追加します。

プロフェッショナルなクロマ + ControlNetテクニック

プロダクション品質の結果のための高度なテクニック。

照明とカラーマッチング

課題: 被写体と新しい背景は、信頼できる合成のために同じ環境で照明されているように見える必要があります。

ControlNetソリューション: 深度マップを使用して被写体を識別します。被写体レイヤーのみに照明調整を適用し、背景の照明方向と色温度に合わせます。

テクニック:

- ControlNet深度ガイダンスを使用して被写体を分離

- 背景照明を分析(方向、色、強度)

- 対応する照明調整を被写体に適用

- シームレスな統合のためのエッジフェザリング

ControlNetによるスピル抑制

問題: 被写体のエッジの緑のスピルが合成を汚染します。

従来の修正: カラー補正とスピル抑制フィルター(しばしば積極的すぎて、ディテールを失う)。

ControlNetの強化:

無料のComfyUIワークフロー

この記事のテクニックに関する無料のオープンソースComfyUIワークフローを見つけてください。 オープンソースは強力です。

- ControlNetを使用して被写体のエッジを正確に識別

- エッジピクセルのみにスピル抑制を適用

- 被写体の内部色を保持

- ControlNetガイダンスから細かいエッジディテールを維持

結果: 被写体の色を過度に補正したりディテールを失ったりせずにクリーンなエッジ。

モーションブラーの回復

課題: モーションブラーは前景と背景の色を混ぜ、クリーンなキーイングを不可能にします。

ControlNetアプローチ:

- 被写体の位置を示す深度マップを生成

- 深度の不連続性を介してブラー領域を識別

- ControlNetを使用してブラー領域の再構築をガイド

- 新しい背景に一致する適切なモーションブラーで合成

高度: 最終合成でよりスムーズなモーションブラーのためにフレーム補間と組み合わせます。

マルチフレーム一貫性

ビデオの課題: フレームごとのキーイングの変動がちらつきと不一致を作り出します。

ControlNet安定化:

- フレームごとにControlNetガイダンスを抽出してビデオ全体を処理

- フレーム全体でControlNetマップの時間的平滑化

- 平滑化されたControlNetによってガイドされた一貫したクロマキーを適用

- 結果:ちらつきのない時間的に安定した合成

ツール: フレームバッチ処理と時間的フィルタリングノードを持つカスタムComfyUIワークフロー。

実践的なワークフローの例

完全なワークフローを持つ実世界のシナリオ。

製品写真の背景置換

シナリオ: グリーンスクリーン上の100枚の製品写真がeコマース用の白い背景を必要としています。

ワークフロー:

- 製品画像をバッチ読み込み

- 深度ControlNet前処理(製品の境界を識別)

- クロマキーが緑を除去

- 製品のエッジが鮮明になるように深度ガイダンスを適用

- 白い背景に合成

- バッチエクスポート

効率性: 一貫した品質で30〜60分で100枚の画像を処理。

品質要因: 深度ControlNetが製品のディテールと鮮明なエッジを保持。均一な白い背景が手動編集の必要性を排除。

インタビュービデオの合成

シナリオ: グリーンスクリーンでのインタビュー映像、トピックごとにカスタム背景が必要。

ワークフロー:

- ビデオからフレームを抽出

- すべてのフレームで深度前処理を実行

- クロマキーを適用

- 深度ControlNetが被写体の抽出をガイド

- トピックに適した背景で合成

- ビデオを再組み立て

バリエーション: シーン遷移で背景を変更。ControlNetがすべての背景で一貫した被写体品質を保証。

バーチャルプロダクション背景拡張

シナリオ: 狭いグリーンスクリーンがフレーム全体をカバーしていません。背景をシームレスに拡張する必要があります。

ワークフロー:

- クロマキーが可視グリーンスクリーンを除去

- 深度ControlNetが被写体とグリーンスクリーンの境界を識別

- 構造的ガイダンスを使用して、カバーされていない領域に背景を修復/拡張

- 深度の一貫性を保証して合成

- 結果:物理的なグリーンスクリーンを超えたシームレスな拡張

高度: 拡張境界での最大のエッジ品質のために複数のControlNetタイプ(深度 + 法線)を使用。

透明なオブジェクトの合成

課題: ガラス、水、煙は部分的に透明です。従来のキーイングは透明度を破壊します。

ControlNetソリューション:

複雑さをスキップしたいですか? Apatero は、技術的なセットアップなしでプロフェッショナルなAI結果を即座に提供します。

- 法線マップControlNetが表面プロパティをキャプチャ

- クロマキーが不透明な領域を処理

- 法線ガイダンスが透明度グラデーションを再構築

- 部分的な透明度を保持して合成

- 極端なケースのみ手動調整

品質: クロマだけでは不可能な写真のような透明度の再現。

一般的な問題のトラブルシューティング

頻繁な問題に対するプロフェッショナルなソリューション。

緑のスピルが完全に除去されない

症状: スピル抑制後も被写体の周りに緑のエッジ。

解決策:

クロマキー範囲を増やす。 より多くの緑の値をキャプチャするために色の許容範囲を拡大します。

ターゲットスピル抑制。 ControlNetを使用してエッジピクセルを識別し、そこだけに積極的な補正を適用します。

エッジマッティング。 ControlNet深度から柔らかいエッジマットを生成し、フェザリングされた合成に使用します。

カラーグレーディング。 後処理で問題のあるエッジの色を緑から離します。

柔らかいまたはぼやけた被写体のエッジ

症状: 被写体のエッジが定義を欠き、合成で柔らかくまたはぼやけて見えます。

解決策:

線画ControlNetを使用。 明示的にエッジ定義を強調します。

ControlNet強度を増加。 より強い構造的ガイダンスがエッジをより良く保持します。

被写体レイヤーをシャープ化。 ControlNetエッジマップによってガイドされたターゲットシャープ化を適用します。

より良いソース映像。 適切に照明され、フォーカスされたグリーンスクリーン映像がよりよくキー可能です。

複雑なエッジでのアーティファクト(髪、毛皮)

症状: 髪の毛が失われるか、細かいディテール領域でアーティファクトが見えます。

解決策:

法線マップControlNet。 深度だけよりも細かい表面ディテールを適切にキャプチャします。

マルチControlNetアプローチ。 深度(分離)+ 法線(ディテール)+ 線画(エッジ)を組み合わせます。

クロマキーの積極性を減らす。 積極的でないキーがより多くのディテールを保持します。ControlNetにあいまいな領域を処理させます。

コンテンツ制作で月$1,250以上稼ぐ

独占クリエイターアフィリエイトプログラムに参加。バイラル動画のパフォーマンスに応じて報酬。自分のスタイルで完全な創造的自由を持ってコンテンツを作成。

マッティング調整。 細かいディテール領域のためにControlNetガイダンスを使用して高品質のアルファマットを生成します。

フレーム全体で一貫性のない結果

症状: ビデオ合成がちらつきまたはフレームごとに品質の変動を示します。

解決策:

時間的平滑化。 時間全体でControlNetマップに平滑化を適用します。

バッチ処理。 一貫した設定で複数のフレームを一緒に処理します。

光学フロー安定化。 光学フローを使用して良好なキーイング結果を隣接フレームに伝播します。

固定ControlNet強度。 フレーム全体でControlNetパラメータを変更しないでください。

背景が被写体の照明に一致しない

症状: 照明の不一致により合成が偽物に見えます。

解決策:

背景照明を分析。 方向、色温度、強度を識別します。

被写体レイヤーを再照明。 ControlNetからの深度マップを使用して被写体を識別し、一致する照明を適用します。

HDR環境マップ。 背景の照明情報を使用して被写体を現実的に再照明します。

手動タッチアップ。 ControlNet深度によってガイドされたハイライト、影、アンビエントオクルージョンを追加します。

実世界のパフォーマンスとコスト分析

プロダクション使用の実用的な影響を理解する。

処理速度

ハードウェア:RTX 4090

- 深度前処理:1080p画像あたり2〜3秒

- クロマキー:1秒未満

- ControlNet適用:3〜5秒

- 合成:1〜2秒

- 合計:画像あたり7〜11秒

ビデオ処理:

- 30秒のビデオ(720フレーム):1.5〜2.5時間

- バッチ最適化が可能:1〜1.5時間

ローエンドハードウェア(RTX 3060): 処理時間が約2〜3倍長くなります。

コスト比較

ローカル処理:

- ハードウェア償却:最小(100画像あたり$0.10〜0.30)

- 電気代:100画像あたり$0.05〜0.15

- 合計:100画像あたり約$0.15〜0.45

クラウドサービス:

- プロフェッショナルクロマサービス:画像あたり$0.50〜2.00

- クラウドGPU(RunPod):画像あたり$0.02〜0.05

- 合計:画像あたり$0.02〜2.00

損益分岐点: ローカルセットアップは1,000枚以上の画像で費用対効果が高い。クラウドは時々の使用に適しています。

品質と手動合成の比較

従来の手動アプローチ:

- プロフェッショナル品質のために画像あたり5〜15分

- 100画像 = 8〜25時間の手動作業

ControlNetクロマ自動化:

- 画像あたり10秒の処理

- 必要に応じて画像あたり2〜5分の手動調整

- 100画像 = 30分の処理 + 3〜8時間の調整

時間節約: 手動作業が50〜90%削減。

ControlNetクロマと代替手段を使用する場合

適切なテクニックを選択するための決定フレームワーク。

ControlNetクロマを使用する場合:

- 大量のグリーンスクリーン処理が必要

- 細かいエッジディテールの保持が重要

- 照明スピルの問題が存在

- ソース映像のモーションブラー

- マルチ背景合成が必要

従来のクロマを使用する場合:

- 完璧な照明を持つクリーンなスタジオ映像

- シンプルな背景置換

- 絶対的な品質よりも速度が優先

- 学習/実験段階

手動合成を使用する場合:

- 単一の高価値画像(映画VFX)

- 極端な品質要件

- 異常なキーイング状況(部分的な透明度、反射)

- 予算が手動労働投資を許可

管理サービスを使用する場合:

- ローカルハードウェアが利用できない

- 保証されたターンアラウンドタイムが必要

- 技術的な複雑さを避けたい

- 時々の使用がセットアップを正当化しない

Apatero.comのようなプラットフォームは、プロフェッショナルなクロマ合成を提供し、インフラストラクチャ投資なしで品質結果を求めるユーザーに理想的です。

ControlNetクロマワークフローの次は何ですか?

分野は新しい機能が登場し続け、進化し続けています。

新興テクニック:

- ライブストリーミング用のリアルタイムクロマ + ControlNet

- AI駆動の自動スピル抑制

- エッジケースのための深度推定の改善

- 深度、法線、学習された特徴を組み合わせたマルチモーダルControlNet

より広範なControlNetアプリケーションについては、ControlNetガイドを、ビデオ固有のテクニックについては、ビデオ合成ワークフローを確認してください。

推奨される次のステップ:

- テスト画像で基本的なControlNet + クロマワークフローをセットアップ

- 使用例に対して異なるControlNetタイプを実験

- 一般的なシナリオ用の再利用可能なワークフローテンプレートを構築

- 既存のビデオ/画像制作パイプラインと統合

- 高度なマルチControlNetの組み合わせを探索

追加リソース:

- ControlNet公式リポジトリ

- ComfyUI ControlNetドキュメント

- プロフェッショナル合成チュートリアル

- ワークフロー共有のためのコミュニティフォーラム

- DIY ControlNetクロマの場合: 大量、技術スキルがある、適切なハードウェアを所有、カスタマイズが必要

- クラウドGPUサービスを使用する場合: 中程度の量、ローカルハードウェアなし、技術知識がある、予算が許可

- 管理プラットフォームを使用する場合: セットアップなしでプロフェッショナルな結果が欲しい、シンプルさを好む、時々の使用、コストよりも時間を重視

ControlNetは、クロマキーを色ベースのマスキングから知的な構造的合成に変換しました。この組み合わせにより、以前は高価なソフトウェアと専門知識を必要としていたテクニックを、コンシューマーハードウェアでプロフェッショナル品質のグリーンスクリーン作業が可能になり、民主化されました。

ControlNetモデルと前処理が改善するにつれて、さらに良いエッジディテール保持、より速い処理、ライブストリーミングとバーチャルプロダクションのためのリアルタイムアプリケーションなどの拡張された機能が期待されます。自動化と手動合成の間のギャップは狭まり続けています。

よくある質問

ControlNetは従来のクロマキーを完全に置き換えますか?

いいえ、従来のキーイングを強化します。背景を除去するには、色ベースのクロマキーがまだ必要です。ControlNetは、エッジの品質とディテール保持を改善する構造的ガイダンスを追加します。最良の結果のために一緒に使用してください。

ControlNetクロマワークフローにはどれくらいのVRAMが必要ですか?

基本的なワークフローには最低8GB。プロダクションには12GBが快適。マルチControlNetアプローチまたは高解像度ビデオには16GB以上。量子化と最適化により低いVRAMも可能です。

これはブルースクリーンまたは他のクロマ色で機能しますか?

はい、ControlNetガイダンスは色に依存しません。ブルースクリーン、レッドスクリーン、または任意の色のキーイングで同じように機能します。ターゲット色のクロマキーノードを調整し、ControlNetワークフローは同じままです。

これはNukeのようなプロフェッショナル合成ソフトウェアと比較してどうですか?

Nukeはより多くの手動制御と数十年の改良を提供します。ControlNetクロマは、Nukeにはない自動化されたインテリジェンスを提供します。多くのプロフェッショナルは今、両方を組み合わせています - 手動調整のためのNuke、自動化された重い作業のためのControlNet。

これをリアルタイム合成に使用できますか?

現在のComfyUIワークフローはリアルタイムではありません(フレームあたり7〜11秒)。リアルタイムControlNetへの研究が進行中です。将来の最適化により、ライブストリーミングのための低遅延アプリケーションが可能になるかもしれません。

グリーンスクリーンの照明がひどい場合はどうなりますか?

ControlNetは役立ちますが、すべてを修正できるわけではありません。照明が不良(不均一、ホットスポット、影)の場合、クロマキーとControlNetの両方が苦戦します。まずソース映像の品質を改善してください。ControlNetは従来のキーイングよりも多くを回復しますが、限界があります。

ビデオと画像で異なるControlNetモデルが必要ですか?

同じControlNetモデルが両方で機能します。ビデオは、フレーム間の平滑化とバッチ処理を必要とする時間的一貫性の懸念を追加しますが、コアControlNetアプローチは同じです。

これは反射性または透明な被写体を処理できますか?

部分的に。ControlNetは結果を改善しますが、反射性と透明な被写体は依然として困難です。法線マップControlNetは表面プロパティの保持に役立ちます。困難なケースでは手動調整が必要になることを期待してください。

1000枚以上のグリーンスクリーン画像をバッチ処理するにはどうすればよいですか?

バッチ画像ローダーを使用してComfyUIワークフローを作成します。VRAMを管理するために50〜100のグループで処理します。バッチ全体で一貫した設定を使用します。最初のいくつかの出力を監視してから、残りを自動化します。大量の場合は一晩処理を検討してください。

これは時々のグリーンスクリーン作業のために学ぶ価値がありますか?

量と品質のニーズによります。時々の使用(月10画像未満)の場合、従来のツールまたは管理サービスがよりシンプルです。定期的な使用(月50枚以上の画像)の場合、学習曲線は効率性の向上を正当化します。

AIインフルエンサーを作成する準備はできましたか?

115人の学生とともに、51レッスンの完全なコースでComfyUIとAIインフルエンサーマーケティングをマスター。

関連記事

ComfyUI初心者が陥る最も一般的な10の間違いと2025年版の修正方法

新規ユーザーを悩ませるComfyUI初心者の落とし穴トップ10を回避しましょう。VRAMエラー、モデル読み込みなどの完全なトラブルシューティングガイド...

2025年版:プロユーザーが教えたがらないComfyUIの25のテクニックとコツ

エキスパートユーザーが活用している25の高度なComfyUIテクニック、ワークフロー最適化手法、プロレベルのコツを解説します。CFGチューニング、バッチ処理、品質改善の完全ガイド。

Anisora v3.2で360度アニメ回転:ComfyUI完全キャラクター回転ガイド2025

ComfyUIでAnisora v3.2を使用して360度アニメキャラクター回転をマスターしましょう。カメラ軌道ワークフロー、マルチビュー一貫性、プロフェッショナルなターンアラウンドアニメーション技術を学びます。