Installation de SageAttention, TeaCache et Triton sur Windows - Guide complet

Guide etape par etape pour installer SageAttention, TeaCache et Triton sur Windows pour une generation d'images IA plus rapide avec les GPU NVIDIA

Vous avez entendu que SageAttention et TeaCache offrent des accelerations de 2-4x pour la generation IA, mais chaque guide suppose Linux. L'installation Windows est possible mais necessite des etapes specifiques que les guides generiques omettent. Faisons fonctionner ces optimisations sur votre systeme Windows.

Reponse rapide: L'installation de SageAttention, TeaCache et Triton sur Windows necessite Visual Studio Build Tools avec la charge de travail C++, CUDA Toolkit 12.1+ et une configuration Python specifique. Installez Triton depuis des wheels compatibles Windows, puis compilez SageAttention et TeaCache pour votre architecture GPU. Le processus prend 30-60 minutes mais fournit des accelerations de generation significatives une fois termine.

- Visual Studio Build Tools avec charge de travail C++ est requis pour la compilation

- CUDA Toolkit doit etre installe separement du CUDA inclus dans PyTorch

- Les builds Triton Windows sont disponibles depuis des repositories specifiques

- Les variables d'environnement doivent etre configurees pour l'acces au compilateur

- Le ciblage de l'architecture GPU assure des performances optimales du kernel

L'installation Windows est plus complexe que Linux parce que Triton n'a pas ete concu a l'origine pour Windows. Les efforts communautaires ont permis le support Windows, mais vous devez suivre des etapes specifiques plutot que des instructions generiques.

Quels prerequis avez-vous besoin?

Rassemblez-les avant de commencer l'installation.

Visual Studio Build Tools

Microsoft Visual Studio Build Tools fournit le compilateur C++ necessaire pour la compilation Triton et des kernels CUDA.

Telechargez Build Tools depuis la page de telechargements Visual Studio. Vous n'avez pas besoin de l'IDE Visual Studio complet, juste Build Tools.

Pendant l'installation, selectionnez la charge de travail "Developpement Desktop avec C++". Cela installe le compilateur, l'editeur de liens et le SDK Windows necessaires.

L'installation fait plusieurs gigaoctets et prend 10-20 minutes selon votre connexion et vitesse de disque.

Apres l'installation, vous avez besoin que le compilateur soit accessible depuis la ligne de commande. L'installateur l'ajoute generalement au PATH, mais verifiez avec la commande cl dans un nouveau terminal.

CUDA Toolkit 12.1+

PyTorch inclut le runtime CUDA mais pas le toolkit complet necessaire pour la compilation. Installez CUDA Toolkit separement.

Telechargez depuis le site developpeur de NVIDIA. Choisissez la version 12.1 ou plus recente pour correspondre aux exigences PyTorch modernes.

Pendant l'installation, vous pouvez deselectioner les composants de pilotes si vous avez deja des pilotes actuels. Installez toolkit, bibliotheques et documentation.

L'installateur ajoute CUDA au PATH. Verifiez avec la commande nvcc --version.

Environnement Python

Utilisez Python 3.10 ou 3.11. Triton a des exigences de version Python specifiques et peut ne pas fonctionner avec 3.12+.

Un environnement virtuel isole cette installation des autres projets Python. Creez-en un specifiquement pour votre travail ComfyUI ou IA.

Assurez-vous que pip est mis a jour avec python -m pip install --upgrade pip.

Git

Git est necessaire pour cloner les repositories pour SageAttention et TeaCache.

Telechargez depuis git-scm.com et installez avec les options par defaut. Cela ajoute git au PATH.

Comment installez-vous Triton sur Windows?

Triton est la base dont dependent les autres optimisations.

Trouver des wheels Windows

Les versions officielles de Triton n'incluent pas de wheels Windows. Vous avez besoin de versions construites par la communaute.

Recherchez "triton windows wheel" pour trouver les builds actuels. Le repository triton-windows sur GitHub et diverses communautes Discord partagent des builds.

Faites correspondre la wheel a votre version Python. Une wheel pour Python 3.10 ne fonctionnera pas sur Python 3.11.

Processus d'installation

Telechargez le fichier wheel approprie pour votre version Python.

Installez avec pip en utilisant le chemin du fichier local. Par exemple, pip install path/to/triton-2.1.0-cp310-cp310-win_amd64.whl.

Si pip se plaint de dependances, installez-les d'abord et reessayez.

Testez l'installation en important triton dans Python. Si aucune erreur n'apparait, l'installation de base a reussi.

Depannage des erreurs d'importation

Les echecs de chargement DLL indiquent des dependances manquantes. Souvent c'est le Visual C++ Redistributable.

Installez le dernier Visual C++ Redistributable de Microsoft. Les versions x64 et x86 si vous n'etes pas sur.

Si les erreurs persistent, verifiez que CUDA Toolkit est installe correctement et nvcc est accessible.

Verification de la fonctionnalite

Au-dela de l'importation, verifiez que Triton peut compiler des kernels pour votre GPU.

Executez un exemple simple de kernel Triton depuis la documentation. S'il s'execute sans erreur et retourne des resultats corrects, Triton fonctionne correctement.

Les erreurs de compilation a cette etape indiquent des problemes de CUDA Toolkit ou de configuration du compilateur.

Comment installez-vous SageAttention?

SageAttention fournit les kernels d'attention optimises.

Cloner le repository

Clonez SageAttention depuis son repository GitHub en utilisant git.

Naviguez dans le dossier clone. Vous verrez des fichiers de setup et du code source.

Workflows ComfyUI Gratuits

Trouvez des workflows ComfyUI gratuits et open source pour les techniques de cet article. L'open source est puissant.

Configuration de l'environnement

Avant de compiler, definissez les variables d'environnement pour votre architecture GPU.

Definissez TORCH_CUDA_ARCH_LIST a la capacite de calcul de votre GPU. Pour RTX 4090, c'est "8.9". Pour RTX 3090, c'est "8.6".

Plusieurs architectures peuvent etre specifiees si vous voulez des kernels pour differents GPU, mais cela augmente le temps de compilation.

Compilation et installation

Executez le script de setup pour compiler et installer SageAttention.

Utilisez pip install . depuis le repertoire du repository. Cela declenche la compilation en utilisant votre toolchain configure.

La compilation prend plusieurs minutes. Les messages de progression montrent ce qui est compile.

Si la compilation echoue, le message d'erreur indique generalement ce qui manque. Les problemes courants sont le compilateur manquant dans PATH ou une specification d'architecture CUDA incorrecte.

Verification de SageAttention

Importez sageattention dans Python pour verifier l'installation.

Executez une operation d'attention simple en utilisant SageAttention. La premiere execution peut etre lente car elle compile JIT, mais les appels suivants devraient etre rapides.

Comment installez-vous TeaCache?

TeaCache necessite une configuration similaire a SageAttention.

Cloner et setup

Clonez TeaCache depuis son repository GitHub.

La structure est similaire a SageAttention avec des fichiers de setup pour la compilation.

Integration ComfyUI

Pour les utilisateurs ComfyUI, TeaCache est souvent package comme nodes personnalises.

Installez le pack de nodes ComfyUI-TeaCache via Manager ou manuellement. Le pack de nodes gere l'integration avec le systeme de sampling de ComfyUI.

Les nodes apparaissent dans ComfyUI apres l'installation et fournissent l'acces a la configuration TeaCache.

Envie d'éviter la complexité? Apatero vous offre des résultats IA professionnels instantanément sans configuration technique.

Options de configuration

Les parametres TeaCache controlent le comportement du cache. Les valeurs par defaut fonctionnent bien pour la plupart des cas d'utilisation.

Le seuil de cache controle a quel point les timesteps doivent etre similaires pour la reutilisation. Les valeurs plus basses sont plus agressives.

L'intervalle de cache force un calcul nouveau periodiquement. Les valeurs plus elevees utilisent plus de cache.

Commencez avec les valeurs par defaut et ajustez selon les resultats.

Quelle configuration ComfyUI est necessaire?

Faire fonctionner ces optimisations dans ComfyUI necessite une configuration specifique.

Activer SageAttention

Certaines implementations ComfyUI necessitent l'activation explicite de SageAttention.

Verifiez la documentation ou les parametres de votre ComfyUI pour la selection du mode d'attention. Choisissez SageAttention si disponible.

Si aucun parametre explicite n'existe, SageAttention peut s'activer automatiquement lorsqu'il est detecte.

Ajouter des nodes TeaCache

Les nodes TeaCache s'integrent dans votre workflow comme les autres nodes de sampling.

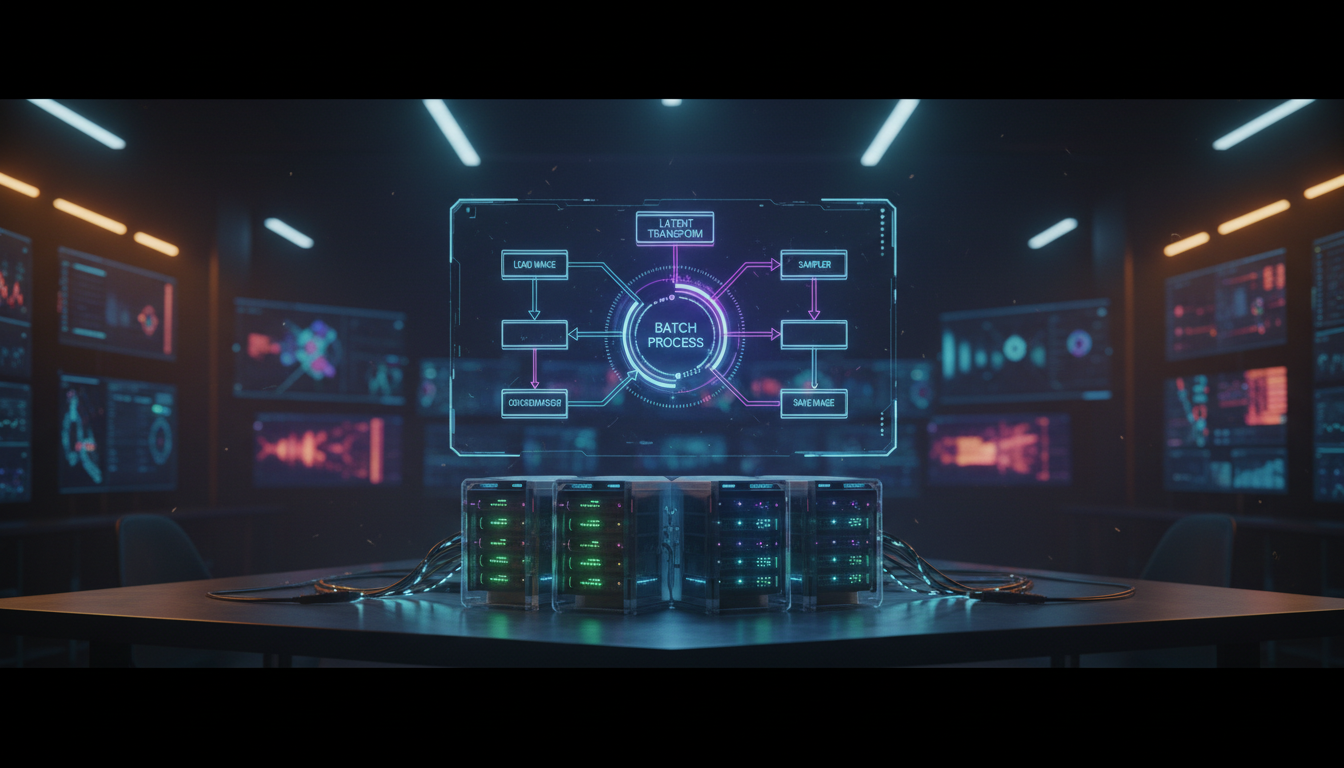

Placez le node TeaCache entre votre chargeur de modele et sampler. Il enveloppe le processus de sampling avec du cache.

Connectez toutes les memes entrees que votre configuration de sampling normale.

Tester l'optimisation

Executez une generation de test avec et sans optimisations pour verifier l'acceleration.

Chronometrez le meme prompt avec des parametres identiques. Vous devriez voir une reduction significative avec les optimisations activees.

Si aucune acceleration ne se produit, les optimisations peuvent ne pas se charger. Verifiez la console pour les erreurs.

Depannage des problemes d'integration

Les erreurs pendant la generation indiquent souvent des problemes de compilation.

Gagnez Jusqu'à 1 250 $+/Mois en Créant du Contenu

Rejoignez notre programme exclusif d'affiliés créateurs. Soyez payé par vidéo virale selon la performance. Créez du contenu à votre style avec une totale liberté créative.

Effacez tous les fichiers de compilation en cache et regenerez. Les caches obsoletes causent des problemes.

Verifiez que votre parametre d'architecture GPU correspond a votre GPU reel. Une architecture incorrecte signifie que les kernels ne peuvent pas s'executer.

Pour les utilisateurs qui veulent ces optimisations sans complexite d'installation, Apatero.com fournit une infrastructure de generation optimisee. Vous obtenez les avantages de vitesse sans gerer les defis de compilation Windows.

Quels sont les problemes courants specifiques a Windows?

Ces problemes apparaissent specifiquement sur les installations Windows.

Erreurs de chemin long

Les limites de longueur de chemin Windows peuvent causer des echecs d'installation.

Activez le support des chemins longs dans les parametres Windows ou le registre. Cela supprime la limite de 260 caracteres.

Alternativement, installez dans des chemins plus courts. C:\ai\ au lieu de C:\Users\Username\Documents\Projects\ComfyUI\.

Interference antivirus

Les logiciels de securite bloquent parfois la compilation ou signalent les fichiers compiles.

Ajoutez votre environnement Python et le dossier ComfyUI aux exclusions antivirus.

Si des fichiers disparaissent pendant la compilation, l'antivirus les supprime probablement. Verifiez la quarantaine.

Problemes de permissions

Compiler dans des repertoires proteges necessite un acces administrateur.

Executez votre terminal en tant qu'administrateur pour les commandes d'installation.

Ou installez dans des emplacements inscriptibles par l'utilisateur comme Documents ou un dossier dedie.

Installations Python multiples

Plusieurs versions Python peuvent causer l'utilisation de la mauvaise.

Verifiez quel Python votre terminal utilise avec python --version.

Utilisez le chemin complet vers votre Python venv si necessaire.

Mode developpeur

Certaines fonctionnalites de compilation necessitent l'activation du Mode Developpeur Windows.

Activez dans Parametres > Mise a jour et securite > Pour les developpeurs.

Cela deverrouille certaines fonctionnalites de developpement que Windows restreint par defaut.

Questions frequentes

Ai-je besoin de Visual Studio ou juste Build Tools?

Build Tools seul est suffisant. L'IDE Visual Studio complet inclut Build Tools mais aussi beaucoup de fonctionnalites dont vous n'avez pas besoin pour ce but.

Quelle version de CUDA Toolkit devrais-je utiliser?

Faites correspondre a la version CUDA de votre PyTorch. Si vous avez installe PyTorch avec CUDA 12.1, utilisez CUDA Toolkit 12.1. Les incompatibilites de version causent des problemes subtils.

Puis-je utiliser ces optimisations avec des GPU AMD?

Non, SageAttention et Triton necessitent des GPU NVIDIA. AMD a des approches d'optimisation differentes via ROCm.

Pourquoi la compilation Triton prend-elle si longtemps la premiere fois?

Triton compile JIT les kernels pour votre GPU specifique a la premiere utilisation. Les executions suivantes utilisent les compilations en cache et sont rapides.

Windows Defender supprimera-t-il mes fichiers installes?

Il pourrait s'il signale faussement les fichiers compiles comme suspects. Ajoutez vos repertoires d'installation aux exclusions pour empecher cela.

Comment savoir quelle capacite de calcul a mon GPU?

Recherchez votre modele de GPU et "capacite de calcul". NVIDIA liste cela dans sa documentation. La serie RTX 40 est 8.9, la serie RTX 30 est 8.6.

Puis-je installer sans Build Tools en utilisant des wheels preconstruites?

Pour Triton oui, si vous trouvez des wheels compatibles. SageAttention necessite typiquement une compilation depuis le code source pour des performances optimales.

Pourquoi mon terminal ne reconnait-il pas nvcc apres l'installation de CUDA?

L'installateur peut ne pas avoir mis a jour votre PATH, ou vous n'avez pas ouvert un nouveau terminal. Ajoutez le dossier bin de CUDA au PATH manuellement si necessaire.

Dois-je reinstaller apres les mises a jour de pilotes GPU?

Generalement non. Les mises a jour de pilotes n'affectent pas vos kernels compiles. Mais les versions majeures de pilotes necessitent occasionnellement une recompilation.

Quelle acceleration devrais-je attendre sur Windows vs Linux?

Les performances sont generalement similaires une fois installe. La surcharge Windows est minimale pour le calcul GPU.

Conclusion

L'installation Windows de SageAttention, TeaCache et Triton necessite des prerequis specifiques et une configuration soigneuse. Visual Studio Build Tools, CUDA Toolkit et les variables d'environnement appropriees sont essentiels.

Le processus prend 30-60 minutes mais fournit des avantages durables. Une fois installes, ces optimisations fonctionnent automatiquement, accelerant vos generations sans effort continu.

Suivez les etapes precisement et depannez les erreurs specifiques au fur et a mesure qu'elles surviennent. La plupart des echecs ont des corrections simples une fois identifies.

L'acceleration de 2-4x de ces optimisations ameliore significativement votre workflow, rendant l'effort d'installation valable.

Pour les utilisateurs qui preferent eviter les defis de compilation Windows, Apatero.com fournit l'acces a une generation optimisee sans configuration locale. Vous obtenez les avantages de vitesse via une infrastructure configuree professionnellement.

Avec patience et attention aux details, les utilisateurs Windows peuvent atteindre les memes avantages d'optimisation que les utilisateurs Linux.

Prêt à Créer Votre Influenceur IA?

Rejoignez 115 étudiants maîtrisant ComfyUI et le marketing d'influenceurs IA dans notre cours complet de 51 leçons.