AI-Spielart-Generator: Wie ich 2026 Sprites, Texturen und Konzeptkunst erstelle

Vollständiger Leitfaden zur Verwendung von KI-Spielart-Generatoren für Sprites, Texturen, Pixelkunst und Konzeptkunst. Echte Arbeitsabläufe, Werkzeugvergleiche und praktische Tipps aus praktischen Tests.

Wenn mir jemand vor drei Jahren erzählt hätte, dass ein einzelner Indie-Entwickler in wenigen Minuten statt Wochen produktionsreife Spielkunst generieren könnte, hätte ich gelacht. Ich habe Jahre damit verbracht, Pixelkunst und Charaktersprites auf Freelancing-Plattformen auszulagern, auf Überarbeitungen zu warten und Budgets auszugeben, die für echte Spielmechaniken hätten gehen sollen. Diese Realität hat sich komplett geändert. Ein KI-Spielart-Generator kann jetzt Sprites, Texturen, Tilesets, UI-Elemente und Konzeptkunst schneller produzieren als die meisten Künstler einen groben Entwurf skizzieren können.

Kurze Antwort: Die besten KI-Spielart-Generatoren 2026 sind Flux 2 für hochwertige Konzeptkunst, Z Image Turbo mit Pixel-Art-LoRAs für Retro-Style-Sprites und Tilesets und Stable Diffusion XL für vielseitige Spielasset-Pipelines. Für eine gehostete Lösung, die alle diese Optionen ohne GPU-Kopfschmerzen handhabt, bietet Apatero ComfyUI-basierte Arbeitsabläufe von Anfang an. Der Schlüssel zu brauchbarer Spielkunst ist die Nachbearbeitung. Die rohe KI-Ausgabe funktioniert fast nie als Drop-in-Asset ohne Cleanup.

- KI-Spielart-Generatoren können Sprites, Texturen, Tilesets, Symbole, UI-Elemente, Hintergründe und Konzeptkunst produzieren

- Pixelkunst- und Sprite-Generierung funktioniert am besten mit speziellen LoRAs und kontrollierten Auflösungen

- Nahtlose Texturen erfordern Tiling-bewusste Arbeitsabläufe oder manuelle Nachbearbeitung in Tools wie GIMP

- Konzeptkunst ist derzeit der stärkste Use-Case für KI in der Spieleentwicklung

- Konsistente Charakterdesigns über mehrere Posen hinweg erfordern immer noch LoRA-Training oder referenzbasierte Methoden

- Von KI generierte Assets benötigen Cleanup, Palettenreduzierung und Formatanpassung, bevor sie in ein Spiel gehen

Was ist genau ein KI-Spielart-Generator?

Ein KI-Spielart-Generator ist jedes KI-gestützte Bildkreationswerkzeug, das visuelles Material produziert, das für die Verwendung in Videospielen geeignet ist. Das klingt unkompliziert, aber der Teufel steckt im Detail. Allgemeine Bildgeneratoren wie Midjourney oder DALL-E können wunderbare Kunstwerke erstellen, aber „wunderbare Kunstwerke" und „spielreifes Asset" sind sehr verschiedene Dinge.

Spielkunst hat spezifische technische Anforderungen. Sprites benötigen transparente Hintergründe und konsistente Größen. Texturen müssen nahtlos kacheln. Tilesets benötigen präzise Ausrichtungsgitter. Charakterdesigns müssen in kleinen Anzeigeformat funktionieren. UI-Elemente müssen sich über Dutzende Bildschirme kohärent anfühlen. Keine dieser Anforderungen werden von einem allgemeinen KI-Bildgenerator direkt gut gelöst.

Ich habe das vor etwa 18 Monaten auf die harte Tour gelernt. Ich arbeitete an einem kleinen Tower-Defense-Projekt und dachte, ich könnte einfach alle meine gegnerischen Sprites mit Midjourney generieren. Die Kunst sah isoliert gesehen wunderbar aus. Aber in dem Moment, in dem ich diese Sprites in Unity einbaute, hatte jeder einzelne eine andere Perspektive, eine andere Beleuchtungsrichtung und eine andere Detailtreue. Es sah aus, als hätte ich zufällige Clipart von fünf verschiedenen Websites genommen. Diese Erfahrung lehrte mich, dass effektive KI-Spielkunstgenerierung eher von Arbeitsabläufen als von reiner Prompt-Qualität abhängt.

Die Werkzeuge, die tatsächlich für die Spieleentwicklung funktionieren, fallen in einige Kategorien. Es gibt allgemeine Generatoren, die durch Prompting und LoRAs auf Spielkunst abgestimmt werden können. Es gibt spezialisierte Tools, die speziell für Spielassets gebaut wurden, wie Scenario.gg und Leonardo AIs Spielasset-Modi. Und es gibt Pipeline-Ansätze, bei denen mehrere KI-Tools mit traditioneller Bearbeitungssoftware kombiniert werden, um endgültige Assets zu erzeugen.

Welche KI-Tools funktionieren am besten für Spielkunst?

Ich habe fast alle verfügbaren Optionen getestet, und die Landschaft hat sich 2026 genug verschoben, dass frühere Empfehlungen aktualisiert werden müssen. Hier ist, wo die Dinge heute stehen.

Flux 2 für Konzeptkunst und hochwertige Assets

Flux 2 ist das Tool, auf das ich zurückgreife, wenn ich Konzeptkunst, Charakterentwurfsblätter oder Umgebungsgemälde benötige. Die Prompt-Anhaftung ist unübertroffen. Wenn ich „einen mittelalterlichen Schmied-Charakter, der nach rechts schaut, einen leuchtenden Hammer hält, mit ledernem Kittel und rußbedecktem Gesicht" beschreibe, bekomme ich genau das. Nicht einen Schmied nach links. Nicht einen sauberen Schmied. Genau das, was ich angegeben habe. Wenn Sie vergleichen möchten, wie Flux 2 gegen andere Top-Generatoren steht, schauen Sie sich meinen besten KI-Bildgenerator-Vergleich für 2026 an.

Speziell für Konzeptkunst verarbeitet Flux 2 komplexe Szenenbeschreibungen und Stilmischungen besser als alles, was ich verwendet habe. Sie können nach „Studio Ghibli trifft Dark Souls" prompen und etwas bekommen, das beide Ästhetiken wirklich einfängt, statt ein verworrenes Durcheinander.

Z Image Turbo für Pixelkunst und Retro-Sprites

Dies ist mein Go-to für jeden KI-Pixelkunst-Generator-Arbeitsablauf. Z Image Turbo mit der Pixel-Art-LoRA produziert authentisch aussehende Retro-Sprites in weniger als einer Sekunde. Die Dithering-Muster sehen richtig aus, die Farbpaletten wirken zeitgerecht, und die Proportionen funktionieren bei echten Spielauflösungen.

Der Trick bei Z Image für Spielsprites ist die Ausführung bei niedrigeren Auflösungen und die Verwendung von LoRA-Stärke um 0,8 bis 1,0. Höhere LoRA-Stärke gibt Ihnen chunkigere, klassischere 8-Bit-Pixel. Ein Abfall auf 0,6 erzeugt etwas, das näher an 16-Bit- oder GBA-Ästhetik ist.

Stable Diffusion XL für vielseitige Pipelines

SDXL bleibt das Arbeitspferd für jeden, der eine komplette KI-Spielasset-Pipeline baut. Das Ökosystem von LoRAs, ControlNets und benutzerdefinierten Arbeitsabläufen ist riesig. Sie können feingestimmte Modelle speziell für isometrische Spielkunst, Top-Down-Tilesets, Seitenansicht-Platformer-Sprites und so ziemlich jeden anderen Spielkunststil finden.

Der Hauptvorteil von SDXL ist Flexibilität. Sie können es lokal ausführen, endlos anpassen und es in automatisierte Pipelines integrieren. Der Kompromiss ist die Komplexität der Einrichtung. Wenn Sie sich nicht selbst mit Modellverwaltung und ComfyUI-Arbeitsabläufen befassen möchten, bieten Plattformen wie Apatero cloudbasierte SDXL-Zugang mit vorgefertigten Spielkunst-Arbeitsabläufen.

Scenario.gg für teamfreundliche Asseterzeugung

Scenario hat sich eine echte Nische im Spieleentwicklungsbereich geschaffen. Ihr Tool ermöglicht es Ihnen, benutzerdefinierte Generatoren anhand Ihres vorhandenen Kunststils zu trainieren, was bedeutet, dass jedes von Ihnen generierte Asset konsistent mit der visuellen Identität Ihres Spiels bleibt. Ich habe es in einem Jam-Projekt letzten Herbst verwendet und war beeindruckt, wie schnell ich ein Stilmodell mit nur 20 Referenzbildern trainieren konnte.

Die Preise sind steil für Solo-Entwickler, aber für Studios mit etablierten Kunststilen, die große Mengen an Assets produzieren müssen, macht es viel Sinn.

Wie man Spielsprites generiert, die tatsächlich funktionieren

Die Sprite-Generierung ist dort, wo sich die meisten Menschen mit KI-Spielkunst frustriert fühlen, denn die rohe Ausgabe ist fast nie einsatzbereit. Hier ist der Arbeitsablauf, den ich über Dutzende Projekte verfeinert habe.

Schritt 1: Definieren Sie zunächst Ihre Sprite-Spezifikationen

Bevor Sie ein KI-Tool berühren, legen Sie Ihre technischen Spezifikationen fest. Welche Auflösung haben Ihre Sprites? Welche Farbpalette nutzen Sie? Wie viele Animationsframes benötigen Sie? Welche Perspektive nutzt Ihr Spiel?

Ich führe für jedes Projekt ein Referenzdokument, das in etwa so aussieht:

- Zielauflösung: 64x64 Pixel pro Sprite

- Farbpalette: max. 16 Farben (ich nutze Lospec-Paletten)

- Perspektive: 3/4 von oben

- Benötigte Animationsframes: Idle (4), Gehen (8), Angriff (6)

- Hintergrund: transparent

Schritt 2: Generieren Sie Basis-Sprites mit kontrollierten Prompts

Die Prompt-Struktur zählt enorm für Spielsprites. Vage Prompts produzieren wunderbare, aber unbrauchbare Kunst. Hier ist, was funktioniert.

Für einen KI-Sprite-Generator-Arbeitsablauf sollte Ihr Prompt den Stil, die Perspektive, die Hintergrundspezifikation und das Thema enthalten. Etwa so: „Pixel-Art-Spielsprite, 3/4-Draufsicht, einzelner Charakter, Krieger mit Schwert und Schild, transparenter Hintergrund, 16-Bit-Stil, saubere Kontur, zentrierte Komposition."

Fügen Sie negative Prompts hinzu, um häufige Probleme zu vermeiden: „verschwommen, mehrere Charaktere, komplexer Hintergrund, realistisch, Fotografie, Text, Wasserzeichen, Rahmen, Rand."

Schritt 3: Nachbearbeiten Sie alles

Dies ist der Schritt, der brauchbare Spielkunst von KI-Demo-Bildern trennt. Jeder Sprite, den ich generiere, durchläuft diese Pipeline:

- Entfernen oder reinigen Sie den Hintergrund (auch wenn Sie transparent geprompt haben, verifizieren Sie es)

- Größe anpassen an Ihre Zielauflösung mit Nearest-Neighbor-Interpolation (niemals Bilinear für Pixelkunst)

- Farbpalette auf Ihr Spielpalette reduzieren

- Artefakte, verirrte Pixel oder inkonsistente Umrisse bereinigen

- Als PNG mit ordentlicher Transparenz exportieren

Tools wie Aseprite, LibreSprite und sogar GIMP funktionieren perfekt für diese Reinigung. Ich verwende etwa 2 bis 5 Minuten pro Sprite für die Nachbearbeitung, verglichen mit den 30 bis 60 Minuten, die es dauern würde, jeden von Hand zu zeichnen.

Schritt 4: Testen bei echten Spielmaßstäben

Testen Sie Ihre Sprites immer in Ihrer Game-Engine, bevor Sie mehr generieren. Ich habe den Fehler gemacht, 50 gegnerische Sprites in Menge zu generieren, nur um bei Spielmaßstab festzustellen, dass die Liniengewichtung über alle hinweg inkonsistent war. Generieren Sie zunächst drei bis fünf Test-Sprites, verifizieren Sie, dass sie im Motor gut aussehen, dann skalieren Sie die Produktion auf.

Erstellen Sie nahtlose Spieltexturen mit KI

Die Texturengenerierung ist eigentlich dort, wo KI-Spielart-Generatoren am hellsten leuchten, denn die Anforderungen sind nachsichtiger als Charaktersprites. Eine Grrastextur muss nicht eine spezifische Pose oder einen Ausdruck haben. Sie muss nur sauber kacheln und bei verschiedenen Skalen gut aussehen.

Das Kachel-Problem

Die größte Herausforderung bei KI-generierten Texturen ist, sie nahtlos zu kacheln. Die meisten KI-Generatoren produzieren Bilder mit natürlicher Vignettierung und Brennpunkten, die beim Kacheln offensichtliche Nähte erzeugen. Es gibt verschiedene Ansätze, die dies lösen.

Der erste Ansatz ist die Verwendung eines Kachel-bewussten Arbeitsablaufs in ComfyUI. Es gibt benutzerdefinierte Knoten, die den Generierungsprozess modifizieren, um nahtlose Ausgabe direkt zu erzeugen. Dies funktioniert gut für organische Texturen wie Stein, Gras, Erde und Holz. Die Ergebnisse sind nicht perfekt zu 100%, aber etwa 70% meiner Generierungen kommen beim ersten Versuch kachelbar raus.

Der zweite Ansatz ist die Generierung einer größer als nötigen Textur und das Extrahieren eines Kachel-Abschnitts mit Textursynthese-Tools. Ich verwende Materialize (kostenlos) oder Substance Designer für diesen Schritt, wenn ich garantiert perfektes Kacheln brauche.

KI-Spieltextur-Arbeitsablauf

Meine Textur-Pipeline sieht so aus. Ich generiere eine hochauflösende Basis-Textur bei 1024x1024 oder größer, teste das Kacheln, indem ich vier Kopien in einem 2x2-Gitter platziere, repariere alle Nähte manuell oder generiere neu, dann erstelle ich Normal Maps und Rauheitskarten mit kostenlosen Tools wie Materialize oder NormalMap-Online.

Kostenlose ComfyUI Workflows

Finden Sie kostenlose Open-Source ComfyUI-Workflows für Techniken in diesem Artikel. Open Source ist stark.

Für PBR-Arbeitsabläufe (Physically Based Rendering) benötigen Sie mehr als eine Diffuse-Textur. Sie benötigen Normal Maps, Rauheit, Ambient Occlusion und manchmal Height Maps. Ich generiere die Basis-Farbe mit KI, dann leite ich die anderen Karten prozedural ab. Der Versuch, jede Karte separat mit KI zu generieren, produziert inkonsistente Ergebnisse, denn die KI hat kein Konzept davon, wie diese Karten räumlich zueinander in Beziehung stehen.

Textur-Stile, die gut funktionieren

Einige Textur-Typen funktionieren besser als andere mit aktuellen KI-Tools. Natürliche Texturen wie Stein, Holz, Gras, Wasser und Sand produzieren hervorragende Ergebnisse mit minimalem Cleanup. Architektur-Texturen wie Ziegel, Kacheln und Beton funktionieren gut, benötigen manchmal aber Naht-Korrektur. Stilisierte und handgemalte Texturen funktionieren überraschend gut, besonders mit Stil-spezifischen LoRAs. Hochgradig technische Texturen wie Schaltkreise, mechanische Oberflächen und Sci-Fi-Panels können unzuverlässig sein und erfordern oft mehr Nachbearbeitung.

KI-Konzeptkunst für Spiele: Der stärkste Use-Case

Hier ist meine heißeste Meinung zum Thema. KI-Konzeptkunst für Spiele ist nicht nur eine tragfähige Abkürzung. Sie ist wirklich besser als das, was sich die meisten Indie-Entwickler vorher leisten konnten. Ein Solo-Entwickler, der vorher entweder seine eigene mittelmäßige Konzeptkunst zeichnen oder die Konzept-Phase ganz überspringen musste, kann jetzt in wenigen Stunden professionelle visuelle Erkundungen generieren.

Ich verbrachte normalerweise die ersten zwei Wochen eines Spieleprojekts damit, die visuelle Richtung mit groben Skizzen und Moodboards festzulegen. Jetzt verbringe ich einen Nachmittag damit, 100+ Konzeptvariationen mit Flux 2 zu generieren und erreiche eine kohärente visuelle Identität, bevor ich eine einzelne Zeile Spielcode schreibe. Die Qualität meiner Spiele hat sich verbessert, weil ich früher bessere visuelle Entscheidungen treffe.

Der Arbeitsablauf, den ich empfehle, beginnt mit breiter Erkundung. Generieren Sie 20 bis 30 Bilder mit losen Prompts, die die Stimmung, Einstellung und den Ton Ihres Spiels beschreiben. Seien Sie noch nicht spezifisch über Charaktere oder Objekte. Sie suchen nach dem Vibe. Sobald Sie zwei oder drei Bilder finden, die das Gewünschte erfassen, verwenden Sie diese als Stil-Referenzen. Wenn Sie lernen möchten, wie Sie Prompts schreiben, die konsistent die Ergebnisse erzeugen, auf die Sie abzielen, zerlegt mein Leitfaden zum KI-Bild-Prompt-Engineering die Techniken, die tatsächlich funktionieren.

Dann verengen Sie. Generieren Sie Charakterkonzepte, Umgebungslayouts, Requisiten-Designs und UI-Mockups unter Verwendung der Stil-Sprache, die Sie in der Erkundungsphase entwickelt haben. Dies ist dort, wo Prompt-Engineering wirklich zählt, und die Spezifität zu Kunststil, Farbpalette und Komposition macht den Unterschied zwischen nützlichen Konzepten und zufälligen hübschen Bildern.

KI-Spielcharakter-Design: Konsistenz richtig hinbekommen

Charakterdesign ist das Gebiet, wo KI-Spielart-Generatoren am meisten kämpfen, denn Spiele benötigen, dass derselbe Charakter über möglicherweise Hunderte von verschiedenen Posen, Ausdrücken und Kontexten konsistent aussieht. Ein einzelnes wunderschönes Charakterporträt ist einfach. Zu bekommen, dass dieser Charakter von hinten, von der Seite, im Kampf, beim Springen und beim Schadennehmen richtig aussieht, ist enormer schwerer.

Es gibt drei Ansätze, die jetzt funktionieren.

LoRA-Training für Hauptcharaktere

Wenn Ihr Spiel einen kleine Besetzung wichtiger Charaktere hat, ist das Training eines LoRA für jeden Charakter die zuverlässigste Methode. Sie generieren 10 bis 20 Referenzbilder des Charakters aus verschiedenen Winkeln, reinigen sie, um Konsistenz sicherzustellen, und trainieren dann ein LoRA speziell für diesen Charakter. Das trainierte Modell kann dann diesen Charakter in neuen Posen und Kontexten mit angemessener Konsistenz produzieren.

Dies ist mein bevorzugter Ansatz für Hauptcharaktere und wichtige NPCs. Es dauert ein paar Stunden Einrichtung pro Charakter, aber die Konsistenz-Auszahlung lohnt sich. Ich habe einen ausführlichen Leitfaden zum Generieren konsistenter Charaktere über mehrere Bilder geschrieben, wenn Sie die vollständige Anleitung möchten.

Referenzbasierte Generierung für Nebencharaktere

Für Charaktere, die nur in ein paar Kontexten erscheinen, ist die referenzbasierte Generierung mit Tools wie IP-Adapter oder Flux Kontext schneller als das Training eines vollständigen LoRA. Sie stellen ein Referenzbild bereit und die KI versucht, das Erscheinungsbild dieses Charakters beizubehalten, während sie neue Posen und Szenen generiert.

Die Konsistenz ist nicht so eng wie ein trainiertes LoRA, aber für Charaktere, die nur in Zwischenszenen oder statischen Porträts erscheinen, ist es mehr als ausreichend. Ich habe diesen Ansatz für alle Ladenbesitzer-NPCs in einem Roguelike verwendet, an dem ich prototyp machte, und niemand bemerkte die geringfügigen Inkonsistenzen zwischen ihrem Porträt und ihrem Spiel-Sprite.

Sprite-Sheet-Generierung

Der heilige Gral für Spieleentwickler ist die Generierung vollständiger Sprite-Sheets. Ein einzelner Prompt, der einen Charakter in acht Geh-Frames, sechs Angriffs-Frames und vier Idle-Frames erzeugt, alle konsistent und ordnungsgemäß ausgerichtet. Wir sind 2026 noch nicht ganz dort, aber wir sind nah dran.

Möchten Sie die Komplexität überspringen? Apatero liefert Ihnen sofort professionelle KI-Ergebnisse ohne technische Einrichtung.

Die zuverlässigste Methode, die ich gefunden habe, ist die Generierung jedes Frames einzeln mit sehr spezifischen Pose-Beschreibungen, dann die Zusammenstellung und Reinigung des Sprite-Sheets manuell. Es ist mühsam, aber es ist immer noch dramatisch schneller als das Zeichnen jedes Frames von Hand.

KI-Tilemap-Generierung und Level-Design

Tilemaps sind eine spezielle Herausforderung, denn sie erfordern nicht nur visuellen Konsistenz, sondern auch strukturelle Logik. Eine Grastile muss sauber zu einer Erde-Tile übergehen, die zu einer Wasser-Tile übergehen muss. Diese Übergänge müssen in jeder möglichen Konfiguration funktionieren.

Mein aktueller Ansatz ist die Generierung einzelner Tile-Typen und dann das manuelle Erstellen der Transitions-Tiles. Ich generiere eine Basis-Grastextur, eine Basis-Erde-Textur, eine Basis-Wasser-Textur und so weiter. Dann nutze ich traditionelle Tile-Editor-Tools, um die Kanten- und Ecken-Übergangsstücke zu erstellen. Der Versuch, die KI dazu zu bringen, richtige Tilemap-Übergänge direkt zu generieren, war in meinen Tests unzuverlässig, obwohl sich einige spezialisierte Tools verbessern.

Für Autotile-Systeme wie die in RPG Maker oder Godots TileMap-Knoten verwendet, generiere ich die Basis-Texturen und erstelle dann die Autotile-Templates mit traditionellen Methoden. Die KI handhabt den kreativen Teil (wie sieht dieses Gras aus?) und traditionelle Tools handhaben den technischen Teil (wie verbindet sich dieses Gras mit Erde?).

KI-Spiel-UI-Design und Symbole

UI-Design und Spiel-Symbol-Generierung sind unterschätzte Use-Cases für KI in der Spieleentwicklung. Die meisten Indie-Spiele werden mit Platzhalter- oder Stock-UI-Elementen ausgeliefert, denn das Erstellen kohärenter UI-Kunst ist zeitaufwändig und erfordert eine andere Skill-Set als Charakter- oder Umgebungskunst.

Ein KI-Spiel-Symbol-Maker-Arbeitsablauf ist eigentlich ziemlich unkompliziert. Generieren Sie Symbole in hoher Auflösung mit konsistenten Stil-Prompts, dann Massen-Größe ändern zu Ihren Ziel-Symbol-Dimensionen. Der Schlüssel ist Stil-Konsistenz über alle Ihre Symbole, was bedeutet, die gleiche Prompt-Vorlage zu verwenden und nur das Thema zu wechseln.

Zum Beispiel sieht meine Standard-Symbol-Prompt-Vorlage so aus: „[Kunststil]-Spielsymbol von [Thema], [Farbschema], zentriert, saubere Kanten, [Hintergrundstil], hohes Detail." Ich halte den Kunststil, Farbschema und Hintergrundstil identisch über alle Symbole hinweg und ändere nur das Thema. Dies produziert überraschend konsistente Symbol-Sets.

Für vollständiges UI-Design generiere ich Mockup-Bildschirme als Konzeptkunst und baue dann die echte UI in meiner Game-Engine wieder auf. KI ist ausgezeichnet für die Erkundung von UI-Layouts und visuellen Behandlungen, aber schrecklich bei der Erzeugung pixel-perfekter, auflösungsunabhängiger UI-Elemente direkt.

Heiße Meinungen zur KI-Spielkunst 2026

Lassen Sie mich einige Meinungen teilen, die kontrovers sein könnten, aber reflektieren, was ich tatsächlich nach einem Jahr der Nutzung dieser Tools in der Produktion gesehen habe.

Heiße Meinung Nummer Eins: KI wird Spielkünstler nicht ersetzen. Sie wird Spielkünstler ersetzen, die nur Produktionsarbeit machen. Die kreative Richtung, Stil-Entwicklung und Qualitätskontrolle, die Menschkünstler liefern, ist nicht etwas, das KI gut handhabt. Was KI beseitigt, ist die mühsame Produktions-Pipeline zum Umwandeln genehmigter Konzepte in endgültige Assets. Künstler, die KI-Tools dirigieren und deren Ausgabe kuratieren können, werden produktiver als je zuvor. Künstler, die sich als „Ich zeichne Assets" positionieren, ohne höhere kreative Skills, werden kämpfen.

Heiße Meinung Nummer Zwei: Die meisten „KI-Spielart-Generator"-Tools, die an Spieleentwickler vermarktet werden, sind schlechter als allgemeine Generatoren mit guten Prompts. Ich habe mehrere Tools getestet, die sich speziell für Spieleentwicklung vermarkten. Die meisten von ihnen sind einfach Stable Diffusion mit einer dünnen UI-Schicht und einigen voreingestellten Prompts. Sie bekommen bessere Ergebnisse, indem Sie Ihre eigenen Arbeitsabläufe über Apatero oder ein lokales ComfyUI-Setup mit Spielkunst-spezifischen LoRAs ausführen. Die spezialierten Tools verlangen Premiumpreise für das, was als Prompt-Engineering ausläuft, das Sie selbst tun könnten. Es gibt Ausnahmen, wie Scenario.ggs Stil-Training, aber es sind Ausnahmen.

Heiße Meinung Nummer Drei: Der größte Engpass in KI-Spielkunst ist nicht Generierungsqualität. Es ist Pipeline-Integration. Die Lücke zwischen „Ich habe ein cooles Bild generiert" und „dieses Asset ist in meinem Spiel und funktioniert richtig" ist größer als die meisten Menschen realisieren. Das Erreichen transparenter Hintergründe, richtiger Farbräume, ordnungsgemäßen Atlas-Packung und konsistenten Stils über Hunderte von Assets erfordert Werkzeuge und Arbeitsablauf-Design, über das kaum jemand spricht. Der Generierungsschritt ist vielleicht 20% des Gesamtaufwands.

Verdiene Bis Zu 1.250 $+/Monat Mit Content

Tritt unserem exklusiven Creator-Affiliate-Programm bei. Werde pro viralem Video nach Leistung bezahlt. Erstelle Inhalte in deinem Stil mit voller kreativer Freiheit.

Bauen Sie eine vollständige KI-Spielkunst-Pipeline

Lassen Sie mich Sie durch die Pipeline gehen, auf die ich mich nach Monaten der Iteration geeinigt habe. Das ist, was ich für meine Persönlichen Projekte nutze und was ich anderen Indie-Entwicklern empfehle.

Werkzeuge in der Pipeline

- Flux 2 oder SDXL für Konzeptkunst und hochauflösende Basis-Assets

- Z Image Turbo mit LoRAs für Pixelkunst und Retro-Style-Assets

- ComfyUI als Orchestrierungs-Layer für Generierungs-Arbeitsabläufe

- Aseprite oder LibreSprite für Sprite-Reinigung und Animation

- GIMP oder Photoshop für Textur-Nachbearbeitung

- TexturePacker für Sprite-Atlas-Generierung

- Materialize für PBR-Karten-Generierung aus KI-Texturen

Die gesamte Pipeline von Prompt zu spielreifem Asset dauert mich etwa 5 bis 15 Minuten pro Asset, je nach Komplexität. Vergleichen Sie das mit den 1 bis 4 Stunden pro Asset, die traditionelle Erstellung dauert (oder die Tage Bearbeitungszeit, wenn auslagernd). Sie können mehr Open-Source-KI-Bildgeneratoren erkunden, um Ihre Pipeline-Optionen zu erweitern.

Massen-Verarbeitung für Effizienz

Sobald Sie eine funktionierende Prompt-Vorlage für einen bestimmten Asset-Typ haben, können Sie Dutzende Variationen in Menge generieren und die beste auswählen. Ich generiere normalerweise 8 bis 12 Variationen jedes Assets und wähle die 1 bis 2 besten Ergebnisse für Nachbearbeitung.

Für Textur-Bibliotheken generiere ich 50 bis 100 Variationen jedes Material-Typs in einer einzelnen Sitzung. Die meiste meiner Textur-Generierung läuft über Apatero, denn der Cloud-GPU-Zugang bedeutet, dass ich in Menge generieren kann, ohne meine lokale Maschine zu binden. Nach Filterung und Nachbearbeitung beende ich normalerweise mit 15 bis 25 brauchbaren Texturen pro Batch, was genug ist, um die meisten Spiel-Umgebungen zu bevölkern.

Versionskontrolle für KI-Assets

Eine Sache, die ich auf harte Tour gelernt habe, ist, dass Sie Ihre KI-Generierungs-Parameter genauso versionskontrollieren müssen wie Ihren Code. Ich führe ein Spreadsheet für jedes Projekt, das den Prompt, Modell, LoRA, Seed und Einstellungen für jeden Asset, den ich generiere, verfolgt. Wenn ich zusätzliche Assets erstellen muss, die zu einem bestehenden Set passen, kann ich die exakten Generierungs-Bedingungen reproduzieren.

Dies wurde kritisch während eines Spieljam letzten November, als ich drei neue Feind-Typen hinzufügen musste, um zu den 12 zu passen, die ich bereits erstellt hatte. Ohne meine Generierungs-Logs hätte ich Stunden damit verbracht, den richtigen Prompt und die Einstellungen zu reverse-engineern. Mit meinen Logs hatte ich passende Feinde in 20 Minuten.

Häufige Fehler und wie man sie vermeidet

Nach dem Helfen von mehreren anderen Entwicklern, die mit KI-Spielkunst anfangen, habe ich die gleichen Fehler wiederholt auftauchen sehen.

Fehler 1: Mit finaler Auflösung generieren. Generieren Sie immer bei der höchsten Qualität, die Sie können, und skalieren Sie dann ab. Ein KI-generiertes 1024x1024-Bild skaliert auf 64x64 sieht dramatisch besser aus als ein 64x64-Bild direkt generiert. Der Skalierungs-Prozess glättet natürlich Artefakte und Inkonsistenzen.

Fehler 2: Stil-Guide-Phase überspringen. Bevor Sie irgendwelche Produktions-Assets generieren, verbringen Sie Zeit damit, einen visuellen Stil-Guide mit KI-Konzeptkunst zu erstellen. Definieren Sie Ihre Farbpalette, Liniengewichtung, Schattierstil und Proportionen. Dann referenzieren Sie diese in jedem Generierungs-Prompt. Ohne diesen Schritt werden Ihre Assets inkohärent aussehen, wenn sie zusammenplatziert werden.

Fehler 3: Versuch, Animationsframes direkt zu generieren. Aktuelle KI-Tools sind nicht zuverlässig für das Generieren von sequenziellen Animationsframes. Generieren Sie Schlüssel-Posen einzeln und interpolieren Sie zwischen ihnen mit traditionellen Animationstechniken oder KI-gestützten Interpolations-Tools. Der Versuch, nach „Frame 3 eines 8-Frame-Geh-Zyklus" zu prompen, produziert inkonsistente Ergebnisse.

Fehler 4: Lizenzierungs-Implikationen ignorieren. Das ist ein rechtliches Minenfeld, das sich je nach Jurisdiktion ändert. Einige KI-generierte Inhalte könnten nicht urheberrechtlich schützbar sein. Einige Trainings-Datensätze enthalten urheberrechtlich geschütztes Material. Für kommerzielle Spieleprojekte verstehen Sie die Lizenzbedingungen des Modells, das Sie verwenden. Open-Source-Modelle mit permissiven Lizenzen (wie Flux mit Apache 2.0) sind allgemein die sicherste Wahl. Das U.S. Copyright Office hat Orientierung zu KI-generierten Werken, die lesenswert ist.

Fehler 5: Nicht Assets in-Engine früh testen. Ich kann dies nicht genug betonen. Generieren Sie ein kleines Test-Batch, importieren Sie es in Ihre Game-Engine, und verifizieren Sie, dass alles richtig aussieht, bevor Sie sich zu einer vollständigen Produktions-Run verpflichten. Überprüfen Sie Maßstab, überprüfen Sie Farb-Konsistenz unter Ihrer Spiel-Beleuchtung, und überprüfen Sie, wie Sprites in Bewegung aussehen.

RPG-spezifische KI-Kunst-Arbeitsabläufe

RPGs verdienen besondere Erwähnung, denn sie haben die höchsten Kunst-Mengen-Anforderungen aller Spielgenres. Ein typisches RPG benötigt Hunderte von Charakterportraits, Dutzende Umgebungs-Tilesets, Ausrüstungs-Symbole für jeden Artikel, Zauber-Effekte, UI-Elemente und Welt-Karten-Assets. Für einen Solo-Entwickler oder kleines Team ist diese Kunstmenge traditionell der größte Engpass.

KI-RPG-Kunst-Generierung hat wirklich geändert, was für kleine Teams möglich ist. Ich kenne Entwickler, die komplette RPG-visuelle Pakete von 500+ Assets in ein paar Wochen fokussierter KI-gestützter Produktion erstellt haben. Diese gleiche Menge hätte für einen traditionellen Künstler Monate dauert oder Tausende in Auslagerung gekostet.

Der Ansatz, den ich für KI-RPG-Kunst empfehle, ist mit den sichtbarsten, hochstauswirkungs-Assets zu beginnen. Charakterportraits für Ihren Hauptcast, das Tileset für Ihren Start-Bereich und die Schlüssel-UI-Frames. Bekommen Sie diese richtig und sie setzen den visuellen Standard für alles andere. Dann arbeiten Sie nach außen, generieren zunehmend periphere Assets, während Sie Stil-Konsistenz durch Ihre Prompt-Templates und Referenzbilder beibehalten.

Für Ausrüstungs- und Artikel-Symbole ist Konsistenz höchst wichtig. Ich generiere alle Symbole in einer einzelnen erweiterten Sitzung mit identischen Prompt-Templates und Einstellungen. Dies produziert Sets, wo ein Schwert-Symbol, ein Schild-Symbol und ein Trank-Symbol sich alle anfühlen, als würden sie zum gleichen Spiel gehören.

Häufig Gestellte Fragen

Kann ich ein Spiel verkaufen, das KI-generierte Kunst nutzt?

Ja, Sie können Spiele mit KI-generierter Kunst verkaufen. Die rechtliche Landschaft entwickelt sich immer noch, aber es gibt kein Pauschal-Verbot für kommerzielle Nutzung von KI-generierten Bildern. Überprüfen Sie die spezifischen Lizenzbedingungen des Modells, den Sie nutzen. Open-Source-Modelle wie Stable Diffusion und Flux erlauben allgemein kommerzielle Nutzung der generierten Ausgaben. Die größere Frage ist, ob KI-generierte Kunst Urheberrecht erhalten kann, das je nach Jurisdiktion variiert. Konsultieren Sie einen Anwalt für kommerzielle Projekte mit signifikantem Umsatzpotential.

Was ist der beste KI-Spielart-Generator für Pixelkunst?

Z Image Turbo mit der Pixel-Art-LoRA ist mein Top-Pick für KI-Pixelkunst-Generator-Arbeitsabläufe. Es produziert authentische Retro-Ästhetik, läuft extrem schnell, und handhabt verschiedene Pixelkunst-Stile von 8-Bit bis 16-Bit bis GBA-Ära. Für Nicht-LoRA-Ansätze ist SDXL mit Pixelkunst-feingestimmten Modellen eine solide Alternative. Allgemeine Tools wie Midjourney können Pixelkunst-Stil-Bilder produzieren, aber kämpfen mit der präzisen Pixel-Gitter-Ausrichtung, die Spielsprites benötigen.

Wie mache ich KI-generierte Texturen nahtlos kachelbar?

Nutzen Sie einen Kachel-bewussten Generierungs-Arbeitsablauf in ComfyUI, der den Diffusions-Prozess modifiziert, um nahtlose Ausgabe zu erzeugen. Alternativ generieren Sie in hoher Auflösung und nutzen Textursynthese-Tools wie Materialize, um Kachel-Abschnitte zu extrahieren. Für organische Texturen funktioniert die ComfyUI-Kachel-Knoten etwa 70% der Zeit beim ersten Generieren. Für geometrische oder architekturische Texturen benötigen Sie normalerweise manuelle Naht-Korrektur.

Brauche ich eine leistungsstarke GPU, um mit KI Spielkunst zu generieren?

Es kommt auf das Tool an. Cloud-Plattformen wie Apatero lassen Sie ohne lokale GPU generieren. Für lokale Generierung läufen die meisten aktuellen Modelle gut auf GPUs mit 8GB oder mehr VRAM. Z Image Turbo kann auf so wenig wie 6GB VRAM laufen. Flux 2 profitiert von 12GB oder mehr. Wenn Sie eine aktuelle Gaming-GPU (RTX 3060 oder besser) haben, können Sie die meisten Spielkunst-Generierungs-Arbeitsabläufe lokal ausführen.

Kann KI vollständige Sprite-Sheets mit Animationsframes generieren?

Nicht zuverlässig ab Anfang 2026. KI kann individuelle Charakter-Posen generieren, die Sie manuell in Sprite-Sheets zusammensetzen. Einige spezialisierte Tools versuchen Sprite-Sheet-Generierung, aber die Frame-zu-Frame-Konsistenz ist nicht produktionsbereit für die meisten Spiele. Der beste Ansatz ist Generierung von Schlüssel-Posen einzeln und Nutzung traditioneller Tools für Frame-Interpolation und Sheet-Zusammenstellung.

Wie viel kostet KI-Spielkunst-Generierung?

Kosten reichen von kostenlos (lokale Open-Source-Modelle ausführen) bis zu etwa $0,01 bis $0,10 pro Bild auf Cloud-Plattformen. Für ein typisches Indie-Spiel, das 200 bis 500 Assets benötigt, schauen Sie auf $5 bis $50 in Generierungs-Kosten, plus der Zeit-Investition für Nachbearbeitung. Vergleichen Sie das mit $2.000 bis $10.000+ für traditionelle Kunst-Auslagerung. Die Einsparungen sind substanziell, sogar für die teuersten KI-Optionen.

Ist KI-Spielkunst „Cheating" oder wird es in der Spieleentwicklungs-Community herabgesehen?

Die Spieleentwicklungs-Community ist pragmatisch. Spieler kümmern sich darum, ob Ihr Spiel Spaß macht, nicht wie Sie die Kunst gemacht haben. Einige laute Kritiker existieren, aber die Mehrheit der Spieleentwickler erkennen KI als ein Tool, das Spieleerstellung demokratisiert. Studios wie Ubisoft integrieren aktiv KI in ihre Produktions-Pipelines. Für Spielejams und Indie-Projekte ist KI-Kunst als legitimer Ansatz weitgehend akzeptiert.

Welche Dateiformate sollte ich KI-Spielkunst in exportieren?

PNG für Sprites und UI-Elemente (unterstützt Transparenz). PNG oder TGA für Texturen (verlustfreie Kompression). PSD oder gelagerte Formate für Konzeptkunst, die weitere Bearbeitung benötigt. Nutzen Sie niemals JPEG für Spielassets, denn die verlustbehaftete Kompression führt Artefakte ein, die besonders bei Pixelkunst und Sprites sichtbar sind. Für Textur-Atlases nutzen Sie, was Ihre Game-Engine bevorzugt, aber PNG ist universell unterstützt.

Wie behalte ich visuelle Konsistenz über Hunderte von KI-generierten Assets?

Erstellen Sie ein Stil-Guide-Dokument, das Ihre exakten Prompt-Templates, Modell-Einstellungen, LoRA-Konfigurationen und Farbpaletten-Spezifikationen enthält. Nutzen Sie die gleichen Generierungs-Parameter für alle Assets innerhalb einer Kategorie. Generieren Sie Assets in Batches während einzelner Sitzungen statt über mehrere Tage (Modell-Updates können Ausgabe-Charakteristiken ändern). Führen Sie Generierungs-Logs mit Seeds und Einstellungen für jeden Asset. Für mehr Tipps zum Beibehalten visueller Konsistenz, siehe meinen Prompt-Engineering-Leitfaden.

Kann KI einen dedizierten Spielkünstler auf einem Team ersetzen?

Für kleine Indie-Teams kann KI dramatisch die Notwendigkeit für einen dedizierten Künstler reduzieren, besonders während Prototypisierung und früher Entwicklung. Für größere Studios ergänzt KI Künstler statt sie zu ersetzen. Die kreative Richtung, Qualitätskontrolle und Stil-Verfeinerung, die Menschkünstler liefern, bleibt essentiell. Denken Sie an KI-Spielkunst-Generatoren als Werkzeugen. Eine Elektrobohrmaschine ersetzt keinen Zimmermann, aber sie macht den Zimmermann viel produktiver.

Abschließende Gedanken

Die KI-Spielkunst-Generator-Landschaft 2026 ist reif genug, um wirklich nützlich zu sein, aber rau genug, um echte Geschick und Anstrengung zu erfordern. Wenn Sie erwartend gehen, dass es ein magischer „Mein Spiel sieht erstaunlich aus"-Button ist, werden Sie enttäuscht sein. Wenn Sie mit der Erwartung gehen, dass es ein leistungsstarkes Tool ist, das Ihre Kunst-Pipeline um das 5x bis 10x beschleunigt, während es sorgfältige Arbeitsablauf-Design und Nachbearbeitung erfordert, werden Sie glücklich sein.

Meine Empfehlung für jeden anfangen ist, ein Tool zu wählen, seine Stärken und Limitationen zu meistern, und Ihren Arbeitsablauf um es zu bauen. Für die meisten Indie-Entwickler bedeutet das entweder Flux 2 für hochwertige Kunst oder Z Image Turbo für Pixelkunst. Fügen Sie ComfyUI als Ihren Orchestrierungs-Layer hinzu, investieren Sie Zeit ins Lernen ordnungsgemäßer Prompt-Engineering, und immer, immer nachbearbeiten Sie Ihre Ausgabe, bevor Sie sie in ein Spiel packen.

Die Entwickler, die 2026 mit Einträgen von großartiger Aussehens-KI-gestützten Spielen versehen werden, sind nicht die mit den besten Prompts. Sie sind die mit den besten Pipelines. Bauen Sie Ihren Arbeitsablauf, verfeinern Sie ihn Projekt für Projekt, und Sie werden Spielkunst erzeugen, die Spieler wirklich genießen, anzuschauen.

Bereit, Ihren KI-Influencer zu Erstellen?

Treten Sie 115 Studenten bei, die ComfyUI und KI-Influencer-Marketing in unserem kompletten 51-Lektionen-Kurs meistern.

Verwandte Artikel

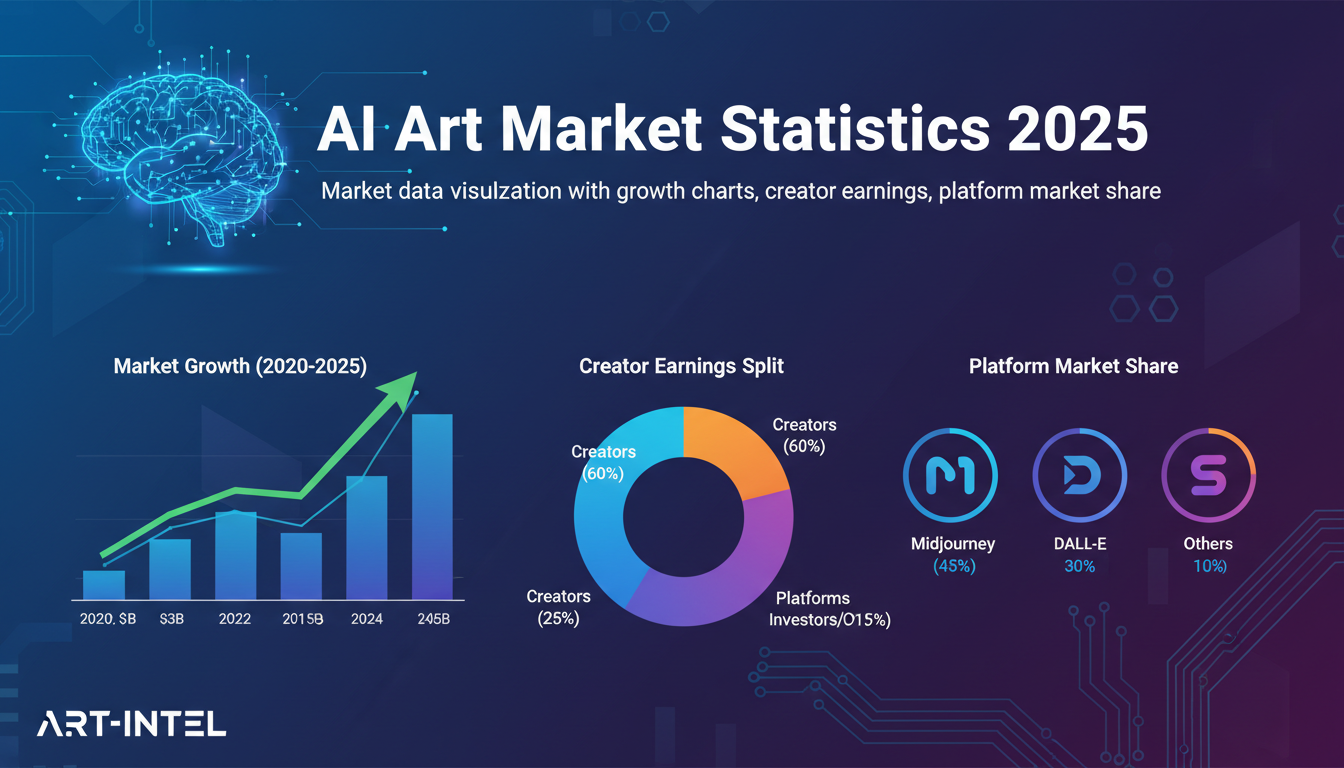

KI-Kunstmarkt Statistiken 2025: Branchengröße, Trends und Wachstumsprognosen

Umfassende KI-Kunstmarkt-Statistiken einschließlich Marktgröße, Creator-Einnahmen, Plattformdaten und Wachstumsprognosen mit mehr als 75 Datenpunkten.

KI-Automatisierungstools: Transformiere deine Geschäftsworkflows in 2025

Entdecke die besten KI-Automatisierungstools, um deine Geschäftsworkflows zu transformieren. Lerne, wie du repetitive Aufgaben automatisierst, Effizienz verbesserst und Operationen mit KI skalierst.

KI Avatar Generator: Ich habe 15 Tools für Profilbilder, Gaming und Social Media 2026 getestet

Umfassende Bewertung der besten KI Avatar Generatoren 2026. Ich habe 15 Tools für Profilbilder, 3D Avatare, Cartoon Stile, Gaming Charaktere und professionelle Anwendungsfälle getestet.