Melhores Modelos para Design de Interiores com Múltiplas Referências em 2025

Descubra os melhores modelos de IA para design de interiores usando múltiplas imagens de referência, incluindo IP-Adapter, ControlNet, SDXL e workflows Flux para resultados profissionais.

Você tem três imagens de referência para uma sala de estar dos sonhos, cada uma mostrando elementos diferentes que você quer combinar. Uma captura a paleta de cores perfeita, outra mostra a disposição ideal de móveis, e a terceira tem exatamente a iluminação que você imagina. A geração tradicional de imagens com IA força você a escolher apenas uma referência ou escrever prompts longos esperando que o modelo entenda sua visão. Com os modelos e workflows de IA certos, você pode usar todas as três referências simultaneamente para criar exatamente o que você imagina.

Resposta Rápida: Os melhores modelos para design de interiores com múltiplas referências em 2025 são IP-Adapter combinado com detecção de profundidade e borda do ControlNet, rodando em modelos base SDXL ou Flux. Esta combinação permite que você referencie diferentes imagens para estilo, layout, móveis e iluminação mantendo precisão espacial e consistência de design em suas gerações de ambientes.

- IP-Adapter possibilita múltiplas imagens de referência para estilo, móveis e materiais em uma única geração

- Detecção de profundidade e borda do ControlNet preservam layouts de ambientes e detalhes arquitetônicos

- SDXL oferece bibliotecas extensas de LoRAs para estilos de interiores enquanto Flux fornece detalhes superiores e velocidade

- Workflows de múltiplas referências combinam diferentes imagens para controle abrangente do design

- Resultados profissionais requerem balanceamento adequado de pesos entre imagens de referência e mapas de profundidade

O Que Torna os Modelos de IA Eficazes para Design de Interiores com Múltiplas Referências

Design de interiores apresenta desafios únicos para geração de imagens com IA. Diferente de retratos ou paisagens onde uma única referência frequentemente é suficiente, projetos de ambientes requerem coordenar múltiplos elementos incluindo layout espacial, posicionamento de móveis, esquemas de cores, materiais e iluminação. Os modelos de IA mais eficazes lidam com essas complexidades através de arquiteturas especializadas.

A tecnologia IP-Adapter revolucionou workflows de múltiplas referências ao possibilitar capacidades leves de prompt de imagem para modelos de difusão texto-para-imagem pré-treinados. Em vez de depender apenas de descrições de texto, o IP-Adapter processa imagens de referência diretamente e injeta suas características visuais no processo de geração. Isso permite que você mostre à IA exatamente quais materiais, estilos ou peças de mobília você quer em vez de descrevê-los com palavras.

O ControlNet complementa o IP-Adapter ao preservar informações estruturais e espaciais. Enquanto o IP-Adapter lida com estilo e conteúdo, o ControlNet mantém a geometria do ambiente, perspectiva e características arquitetônicas. A combinação garante que seus designs gerados pareçam profissionais e espacialmente coerentes em vez de surreais ou impossíveis de construir.

O modelo base que você escolhe importa significativamente. O SDXL dominou aplicações de design de interiores devido ao seu vasto ecossistema de LoRAs especializados treinados em renders arquitetônicos, fotografia imobiliária e portfólios de design. Modelos como RealVisXL V5.0 se destacam em renders fotorrealistas de interiores com materiais e iluminação precisos. Entretanto, o Flux.1 emergiu como uma alternativa poderosa com renderização de detalhes superior e velocidades de geração mais rápidas.

- Controle preciso: Referencie móveis, materiais ou layouts específicos sem prompts de texto ambíguos

- Consistência de estilo: Mantenha estéticas coesas através de múltiplas vistas de ambientes ou iterações de design

- Eficiência de tempo: Gere variações em segundos em vez de horas de edição manual

- Flexibilidade criativa: Combine elementos de diferentes fontes que seriam difíceis de descrever

Como IP-Adapter e ControlNet Funcionam Juntos para Design de Ambientes

A mágica dos workflows modernos de design de interiores acontece quando você combina o referenciamento visual do IP-Adapter com a preservação estrutural do ControlNet. Entender como essas tecnologias interagem ajuda você a alcançar melhores resultados e solucionar problemas quando as gerações não correspondem às expectativas.

O IP-Adapter processa suas imagens de referência através de encoders especializados que extraem características visuais incluindo texturas, cores, padrões e características de objetos. Cada imagem de referência recebe um valor de peso determinando sua influência na geração final. Para design de interiores, você pode usar uma referência com peso 0.8 para estilo geral, outra com 0.6 para detalhes de móveis, e uma terceira com 0.4 para sugestões de paleta de cores.

O nó IPAdapter Encoder no ComfyUI prepara múltiplas imagens para mesclagem ao codificar seus dados separadamente. Você pode então combinar essas referências codificadas usando diferentes métodos incluindo concatenação, média ou adição ponderada. Esta flexibilidade permite controle preciso sobre quais aspectos de cada referência aparecem em seu design final.

O ControlNet opera em um princípio diferente. Em vez de extrair características de estilo e conteúdo, os preprocessadores do ControlNet analisam informações estruturais como mapas de profundidade, detecção de borda ou arte linear de suas imagens de entrada. Para design de interiores, o ControlNet de profundidade prova ser inestimável porque mantém relações espaciais 3D críticas para iluminação realista e posicionamento de objetos.

A configuração de ControlNet duplo popular em workflows profissionais combina profundidade e detecção de borda. O ControlNet de profundidade estabelece relações espaciais adequadas garantindo que os móveis não flutuem ou atravessem paredes. A detecção de borda usando preprocessadores Canny ou MLSD preserva detalhes arquitetônicos como molduras, esquadrias de janelas e características embutidas. Juntos eles criam uma estrutura que a IA preenche com conteúdo guiado por suas referências do IP-Adapter.

Um workflow típico começa com uma foto de ambiente vazio ou existente processada através de preprocessadores ControlNet de profundidade e borda. Estes criam mapas de orientação que o modelo usa para manter precisão espacial. Simultaneamente, suas imagens de referência passam através de encoders IP-Adapter, cada um ponderado de acordo com importância. O modelo base (SDXL ou Flux) então gera novas imagens respeitando tanto a orientação estrutural quanto as referências visuais.

Usuários avançados aproveitam a flexibilidade deste sistema ao mascarar regiões específicas. Você pode aplicar uma referência de móveis apenas onde um sofá deveria aparecer enquanto outra referência influencia os tratamentos de parede. O sistema de mascaramento do IPAdapter no ComfyUI permite que você crie zonas espaciais onde diferentes referências dominam, possibilitando composições baseadas em quatro ou mais imagens de entrada afetando áreas específicas.

Plataformas como Apatero.com simplificam este workflow complexo ao fornecer pipelines pré-configurados que automaticamente balanceiam pesos do IP-Adapter e força do ControlNet. Embora ferramentas poderosas como ComfyUI ofereçam controle máximo, elas requerem conhecimento técnico significativo para otimizar. Para designers focados em resultados em vez de configuração técnica, Apatero.com entrega gerações profissionais de design de interiores sem gerenciar nós individuais e preprocessadores.

Quais Modelos de IA Têm Melhor Desempenho para Tarefas de Design de Interiores

O panorama de modelos de IA adequados para design de interiores se expandiu dramaticamente, mas vários se destacam por seu desempenho com workflows de múltiplas referências e precisão arquitetônica.

O SDXL permanece o modelo base mais popular para design de interiores devido ao seu ecossistema maduro e ajustes especializados. O LoRA Interior-Design-Universal SDXL especificamente aborda a fraqueza histórica do SDXL em expressar cenas internas. Este LoRA, treinado em milhares de fotografias e renders profissionais de interiores, melhora dramaticamente as proporções de móveis, precisão de materiais e coerência espacial. Quando combinado com RealVisXL V5.0, produz renders fotorrealistas comparáveis a software de visualização profissional.

Outra variante forte do SDXL, o checkpoint Interior Design v1, foca em estilos específicos do minimalismo escandinavo a designs tradicionais ornamentados. Estes checkpoints especializados entendem terminologia de design melhor que modelos genéricos, interpretando corretamente termos como "aparador mid-century modern" ou "bancada de mármore Carrara em cascata" que podem confundir modelos de uso geral.

O Flux.1 representa a geração mais nova de modelos de difusão com vantagens significativas para design de interiores. Sua arquitetura de transformador de fluxo retificado supera o SDXL em integração de texto, permitindo controle de prompt mais preciso sobre elementos de design. Mais importante para workflows de múltiplas referências, o Flux.1 processa imagens de referência com maior fidelidade, capturando propriedades sutis de materiais e nuances de iluminação que o SDXL às vezes aproxima.

As diferenças de velocidade favorecem o Flux significativamente. O Flux.1 Schnell gera renders de interiores de alta qualidade em uma fração do tempo comparado ao SDXL, tornando-o ideal para iteração rápida durante o processo de design. Ao explorar múltiplas disposições de móveis ou esquemas de cores, esta vantagem de velocidade se torna crucial para produtividade.

O workflow híbrido SDXL-para-Flux ganhou popularidade entre usuários avançados. Eles geram imagens iniciais com SDXL usando sua vasta biblioteca de LoRAs de estilo, depois refinam resultados com Flux através de processamento imagem-para-imagem. O Flux melhora detalhes, corrige problemas anatômicos e estruturais, e adiciona fidelidade enquanto preserva o estilo geral estabelecido pelo SDXL. Esta abordagem combina o conhecimento especializado do SDXL com a qualidade de renderização superior do Flux.

Modelos Multi-ControlNet merecem menção especial para aplicações de design de interiores. O multi-controlnet-x-ip-adapter-vision-v2 especificamente combina múltiplos módulos ControlNet com integração IP-Adapter. Este modelo desenvolvido especificamente lida com cenários complexos onde você precisa de controle simultâneo sobre profundidade, bordas, segmentação e referências de estilo. Ele tem desempenho excepcionalmente bom para layouts de ambientes requerendo posicionamento preciso de móveis guiado por múltiplas referências.

Para visualização realista, controlnet-x-ip-adapter-realistic-vision-v5 se especializa em saídas fotorrealistas. Este modelo se destaca em gerar imagens adequadas para apresentações a clientes ou listagens imobiliárias onde fidelidade visual importa mais que interpretação artística. Ele renderiza com precisão materiais como grão de madeira, texturas de tecidos e superfícies reflexivas que podem parecer artificiais em outros modelos.

- Escolha SDXL para máxima variedade de estilos e workflows estabelecidos

- Selecione Flux para geração mais rápida e qualidade de detalhes mais fina

- Use híbrido SDXL-para-Flux para o melhor de ambas as abordagens

- Escolha modelos multi-ControlNet especializados para cenários complexos de múltiplas referências

Plataformas especializadas como InstantInterior AI construíram combinações proprietárias destes modelos aprimoradas com ControlNet para preservação de layout e treinamento personalizado em designs de interiores profissionais. Seus sistemas selecionam automaticamente modelos apropriados baseados em tipos de entrada e saídas desejadas. Embora esta automação reduza controle, ela elimina a curva de aprendizado necessária para dominar modelos individuais.

Da mesma forma, Apatero.com aproveita estes modelos avançados através de uma interface intuitiva que não requer conhecimento técnico de qual variante de modelo específica roda nos bastidores. A plataforma automaticamente roteia sua solicitação para a combinação de modelos mais apropriada baseada em suas imagens de referência e descrição de texto, entregando resultados profissionais sem requerer expertise em arquiteturas de modelos de IA.

Como Você Pode Alcançar Consistência de Estilo Através de Múltiplas Vistas de Ambientes

Criar um design de interiores coeso requer mais que gerar belos ambientes individuais. Ao projetar múltiplos espaços ou mostrar diferentes ângulos do mesmo ambiente, manter estilo, materiais e estética consistentes se torna crítico. Workflows de IA de múltiplas referências se destacam neste desafio quando adequadamente configurados.

A fundação da consistência de estilo está na seleção de imagens de referência. Escolha uma referência de estilo primária que incorpora sua direção geral de design e use-a através de todas as gerações com configurações de peso consistentes. Esta referência âncora pode mostrar sua estética alvo seja minimalismo moderno, casa rústica de campo ou loft industrial. Aplique esta referência com peso de 0.7 a 0.8 para cada ambiente ou vista que você gerar.

Referências secundárias devem focar em elementos específicos em vez de estilo geral. Uma referência pode demonstrar seu tom de madeira escolhido para móveis e pisos. Outra poderia mostrar seus acabamentos de metal preferidos para acessórios e ferragens. Uma terceira pode ilustrar sua abordagem de iluminação. Ao manter essas referências específicas de elementos consistentes através de gerações enquanto ajusta referências espaciais para diferentes ambientes, você mantém linguagem de design coesa através de um projeto.

Camadas de ControlNet desempenham um papel subestimado na consistência ao prevenir alucinações indesejadas e desvio de estilo. Ao gerar múltiplas vistas do mesmo ambiente, usar o mesmo mapa de profundidade ou detecção de borda garante que características arquitetônicas permaneçam constantes. A porta não se move entre vistas, tamanhos de janelas permanecem consistentes e alturas de teto permanecem uniformes. Esta consistência espacial reforça consistência de estilo ao manter a estrutura subjacente que suporta seus elementos de design.

O Refiner do SDXL melhora a consistência através de múltiplas gerações ao polir iluminação, texturas e clareza de material em uma passagem final. Rodar todas as suas gerações de ambientes através das mesmas configurações do refiner garante níveis uniformes de detalhe e qualidade de acabamento. Sem esta passagem de consistência, alguns ambientes podem parecer mais nítidos ou mais saturados que outros mesmo quando usando imagens de referência idênticas.

Técnicas de re-iluminação usando modelos IC-Light permitem que você modifique iluminação em visualizações completas enquanto mantém consistência de design. Você pode gerar o mesmo ambiente mostrando luz da manhã, ambiente da tarde e iluminação de humor noturno sem mudar móveis, materiais ou cores. Esta capacidade prova inestimável para apresentações onde clientes querem entender como espaços se sentem em diferentes momentos do dia.

Ferramentas de renderização alimentadas por GPT com integração ControlNet mantêm coerência espacial e lógica de iluminação consistente através de variações. Estes sistemas entendem que uma janela voltada para o norte deve projetar luz mais fria que uma exposição voltada para o sul, garantindo que a consistência de iluminação siga a realidade arquitetônica em vez de variação aleatória entre gerações.

- Biblioteca de referências: Crie uma pasta de referências de estilo e elementos usadas consistentemente através de todas as gerações

- Documentação de configurações: Registre pesos do IP-Adapter e força do ControlNet para cada geração bem-sucedida

- Processamento em lote: Gere múltiplas vistas na mesma sessão usando configurações de modelo idênticas

- Pós-processamento: Aplique a mesma correção de cor e toques finais a todos os renders

Workflows profissionais frequentemente usam controle de seed para consistência. O valor de seed determina aspectos aleatórios da geração, e usar a mesma seed com prompts variados produz estilo consistente com conteúdo diferente. Esta técnica funciona bem para gerar diferentes ambientes na mesma casa onde você quer estéticas coesas aplicadas a espaços variados.

Plataformas focadas em design de interiores profissional como Paintit.ai combinam qualidade excepcional de render com recursos de consistência projetados especificamente para projetos multi-ambientes. Seus sistemas automaticamente mantêm coerência de estilo através de gerações enquanto permitem variação controlada em elementos específicos. Entretanto, estas plataformas frequentemente vêm com custos de assinatura e curvas de aprendizado.

Para designers que querem consistência sem complexidade técnica, Apatero.com fornece geração com estilo travado onde seu primeiro design aprovado se torna a referência de estilo para ambientes subsequentes. O sistema automaticamente extrai e aplica elementos de design consistentes enquanto se adapta a diferentes requisitos espaciais. Esta abordagem entrega os benefícios de consistência de workflows avançados através de uma interface simplificada acessível a designers sem expertise em IA.

Quais São as Melhores Práticas para Posicionamento de Móveis e Decoração

Posicionamento preciso de móveis e decoração separa gerações amadoras de IA de visualizações profissionais de interiores. A tecnologia possibilita controle preciso sobre posicionamento de objetos, mas alcançar resultados realistas requer entender como guiar os modelos efetivamente.

Fluxos de Trabalho ComfyUI Gratuitos

Encontre fluxos de trabalho ComfyUI gratuitos e de código aberto para as técnicas deste artigo. Open source é poderoso.

O workflow Flux Redux RoomDesigner exemplifica capacidades modernas de posicionamento de móveis. Este sistema aceita uma imagem de ambiente vazio mais múltiplas imagens de referência de móveis, depois cria arranjos razoáveis ao analisar os estilos de móveis e relações espaciais. O modelo entende princípios de design como fluxo de tráfego, pontos focais e composição balanceada sem instrução explícita.

Entretanto, arranjos automatizados nem sempre correspondem às necessidades específicas do cliente ou intenções de design. Para controle preciso, configurações de ControlNet duplo fornecem a resposta. O ControlNet de profundidade estabelece relações espaciais garantindo que móveis não flutuem sobre pisos ou atravessem paredes. A detecção de borda Canny preserva limites exatos de posicionamento que você define. Juntos eles criam diretrizes invisíveis que a IA segue ao posicionar objetos.

A abordagem de mascaramento oferece precisão ainda maior. No ComfyUI, você cria máscaras definindo exatamente onde cada peça de mobília deveria aparecer. Diferentes referências de IP-Adapter então influenciam apenas suas zonas designadas. Esta técnica permite que você componha ambientes peça por peça, referenciando produtos ou designs específicos para cada elemento enquanto mantém coerência espacial geral.

A integração do Krita com ComfyUI possibilita um workflow intuitivo baseado em colagem. Você literalmente corta e cola imagens de produtos de móveis em uma foto de ambiente vazio, depois processa o composto através do pipeline de IA. O modelo entende este arranjo espacial como sua intenção e gera um design coeso correspondendo ao seu posicionamento de móveis. Esta abordagem visual prova mais intuitiva que descrever posições através de prompts de texto.

Perspectiva e escala apresentam os maiores desafios no posicionamento de móveis. Um sofá que parece apropriadamente dimensionado de um ângulo pode parecer comicamente grande de outro ponto de vista. Mapas de profundidade ajudam ao fornecer informação espacial 3D, mas você deve garantir que suas imagens de referência de móveis aproximadamente correspondam à perspectiva de sua foto de ambiente. Perspectivas incompatíveis confundem o modelo e produzem objetos distorcidos.

O workflow "Interior Decoration Dreamer" aborda isso ao requerer tanto sua foto de ambiente quanto uma imagem de referência de estilo mais prompts detalhados de móveis. As palavras do prompt ajudam o modelo a entender escala e posicionamento pretendidos quando referências visuais sozinhas criam ambiguidade. Combinar orientação visual e de texto produz resultados mais confiáveis que qualquer um sozinho.

Visualizadores profissionais frequentemente trabalham iterativamente, gerando o ambiente com móveis principais primeiro, depois usando inpainting para adicionar elementos de decoração menores. Esta abordagem em etapas previne que o modelo fique sobrecarregado por muitos requisitos de posicionamento simultaneamente. A geração inicial estabelece composição geral e peças principais, enquanto passagens subsequentes de inpainting adicionam luminárias, obras de arte, acessórios e toques finais com atenção focada.

Workflows de virtual staging transformam este processo em um pipeline simplificado. A sofisticada configuração de ControlNet duplo garante forte aderência de profundidade durante fases iniciais de geração, estabelecendo relações espaciais adequadas para posicionamento de móveis. Esta fundação permite que camadas subsequentes adicionem decoração e refinamento sem perturbar a lógica espacial subjacente.

Civitai hospeda workflows especializados para preencher ambientes com móveis baseados em fotos sem mudar proporções. Estes workflows especificamente preservam as proporções arquitetônicas do ambiente enquanto adicionam mobiliário, resolvendo um problema comum onde geração de IA sutilmente distorce espaço para acomodar objetos adicionados. A preservação de proporções cria resultados mais críveis adequados para apresentações profissionais.

Embora estas abordagens técnicas ofereçam controle máximo, elas requerem investimento significativo de tempo para dominar. Designers trabalhando sob pressão de prazo frequentemente preferem plataformas que lidam com lógica de posicionamento automaticamente enquanto ainda aceitam imagens de referência para peças específicas de móveis. Apatero.com fornece este equilíbrio através de uma interface onde você pode carregar referências de móveis e indicar preferências gerais de posicionamento sem gerenciar máscaras, nós ou preprocessadores manualmente.

Como a Geração de Múltiplas Referências Lida com Iluminação e Materiais

Iluminação e renderização de materiais separam visualizações convincentes de interiores de gerações óbvias de IA. Estes elementos requerem entendimento sutil de física, propriedades de materiais e como luz interage com superfícies. Workflows de múltiplas referências se destacam aqui ao mostrar à IA exatamente quais qualidades de materiais e características de iluminação você quer.

Referências de materiais funcionam melhor quando claramente mostram as propriedades de superfície que você quer replicar. Uma imagem de referência de mármore deve claramente mostrar o veio, translucidez e qualidades reflexivas da pedra sob boa iluminação. O encoder IP-Adapter extrai estas características visuais e as aplica a superfícies apropriadas em seu ambiente gerado. Entretanto, a IA precisa de informação visual clara para trabalhar.

Múltiplas referências de materiais permitem variação sofisticada de superfície. Você pode referenciar latão polido para luminárias, carvalho natural para piso, tecido de linho para estofamento e concreto fosco para paredes de destaque. Cada referência de material influencia superfícies que o modelo determina apropriadas baseado em contexto e seus prompts de texto. Esta abordagem de múltiplas referências cria paletas de materiais ricas impossíveis de alcançar apenas com descrições de texto.

Iluminação apresenta desafios únicos porque afeta cada superfície e objeto na cena. Em vez de ser um objeto em si, iluminação é uma propriedade do ambiente. A abordagem mais eficaz usa imagens de referência que demonstram sua qualidade de iluminação desejada em vez de luminárias específicas. Uma referência mostrando luz natural suave e difusa de grandes janelas guia o humor geral de iluminação melhor que descrever "luz natural brilhante mas não severa entrando através de cortinas translúcidas."

O Refiner do SDXL desempenha um papel crucial na qualidade de iluminação e materiais ao melhorar clareza, precisão de iluminação e texturas em designs gerados. Esta passagem de refinamento corrige problemas comuns como iluminação excessivamente plana ou materiais que carecem de profundidade e dimensionalidade. Rodar suas gerações através do refiner consistentemente melhora a aparência profissional de superfícies e iluminação.

Quer pular a complexidade? Apatero oferece resultados profissionais de IA instantaneamente sem configuração técnica.

Modelos IC-Light representam ferramentas especializadas para manipulação de iluminação após geração. Estes modelos modificam iluminação em visualizações completas, permitindo que você gere múltiplos cenários de iluminação mostrando diferentes momentos do dia e variações atmosféricas. Você cria seu design de ambiente uma vez, depois usa IC-Light para mostrar como sol da manhã, brilho do meio-dia e iluminação ambiente da noite transformam o espaço sem mudar nenhum elemento de design.

Técnicas de re-iluminação provam particularmente valiosas para apresentações onde clientes precisam entender como padrões de luz natural afetam o espaço ao longo do dia. Em vez de gerar imagens inteiramente novas para cada cenário de iluminação, você modifica renders existentes, mantendo consistência perfeita em móveis, materiais e estilo enquanto varia apenas iluminação.

- Fotografe amostras de materiais sob iluminação neutra para capturar cor e textura verdadeiras

- Use imagens de referência com iluminação clara e focada que mostra propriedades de superfície distintamente

- Inclua pelo menos uma referência mostrando seu humor e qualidade geral de iluminação desejados

- Evite referências com correção de cor pesada ou filtros que podem transferir qualidades não intencionais

Workflows avançados separam iluminação em camadas ambiente, de destaque e de tarefa. Referências de iluminação ambiente estabelecem níveis gerais de iluminação e humor. Referências de iluminação de destaque mostram como você quer destacar características arquitetônicas ou obras de arte. Referências de iluminação de tarefa demonstram iluminação apropriada para áreas funcionais como bancadas de cozinha ou cantos de leitura. Esta abordagem em camadas cria designs de iluminação sofisticados que parecem intencionais em vez de arbitrários.

Consistência de materiais através de múltiplas vistas de ambientes requer as mesmas referências de materiais usadas com pesos de IP-Adapter idênticos. Se piso de carvalho aparece em múltiplos ambientes, a mesma referência de carvalho com o mesmo peso garante que o tom de madeira e padrão de grão permaneçam consistentes. Esta atenção ao detalhe cria designs multi-ambientes críveis que parecem coesos.

Materiais metálicos requerem atenção especial porque interagem com luz através de reflexão em vez de absorção. Uma referência de níquel escovado precisa de realces e sombras claros que demonstram suas propriedades reflexivas. Sem esta informação, a IA pode renderizar metais como superfícies cinzas planas carentes do brilho e jogo de luz que os torna reconhecíveis como metal.

Tecidos e materiais têxteis se beneficiam de referências mostrando textura em escala apropriada. Uma referência de estofamento de linho deve ser próxima o suficiente para revelar o padrão de tecelagem mas não tão próxima que se torne abstrata. A IA usa esta informação de escala para renderizar o tecido realisticamente em móveis em seus ambientes gerados.

Plataformas como Paintit.ai focam especificamente em qualidade de render para iluminação e materiais, combinando técnicas avançadas para garantir resultados profissionais. Entretanto, sua complexidade reflete os processos subjacentes sofisticados requeridos para renderização convincente de materiais e iluminação.

Para designers que querem qualidade profissional de iluminação e materiais sem gerenciar múltiplos modelos especializados, Apatero.com processa imagens de referência através de pipelines otimizados que automaticamente balanceiam elementos de materiais e iluminação. A plataforma entende quais imagens de referência contêm informação de materiais versus orientação de iluminação e as aplica apropriadamente sem requerer configuração manual de nós separados de iluminação e materiais.

Por Que Escolher SDXL ou Flux para Projetos de Design de Interiores

A escolha entre SDXL e Flux como seu modelo base impacta significativamente eficiência de workflow, qualidade de saída e opções criativas disponíveis. Entender as forças e limitações de cada ajuda você a selecionar a fundação certa para seus projetos.

A maior vantagem do SDXL está em seu extenso ecossistema de LoRAs, embeddings e checkpoints ajustados especializados. A comunidade de design de interiores criou centenas de recursos baseados em SDXL treinados em estilos específicos, tipos de móveis e abordagens arquitetônicas. Precisa gerar minimalismo escandinavo? Há um LoRA para isso. Quer aperfeiçoar estéticas mid-century modern? Múltiplos checkpoints se especializam nesse estilo.

Esta maturidade de ecossistema significa que você pode rapidamente encontrar e aplicar conhecimento especializado para quase qualquer nicho de design de interiores. Designs de locais para casamento, interiores de restaurantes, escritórios domésticos, banheiros de luxo - alguém provavelmente criou um LoRA SDXL especificamente treinado naquela categoria. Esta especialização acelera seu workflow ao fornecer pontos de partida otimizados para suas necessidades exatas.

O SDXL também se beneficia de documentação extensa e conhecimento da comunidade. Quando você encontra problemas ou quer alcançar efeitos específicos, você encontrará tutoriais, discussões em fóruns e guias de solução de problemas criados por milhares de usuários que trabalharam através de desafios similares. Este suporte da comunidade reduz o tempo gasto resolvendo problemas técnicos.

Entretanto, o SDXL mostra sua idade em certas áreas. A arquitetura do modelo às vezes luta com detalhes finos, particularmente em cenas complexas com múltiplos objetos e materiais variados. Texturas de tecidos podem aparecer levemente borradas, pequenos objetos decorativos podem perder definição e padrões intrincados às vezes ficam confusos. O Refiner do SDXL ajuda a abordar estes problemas mas adiciona tempo de processamento.

O Flux.1 representa tecnologia mais nova com melhorias arquitetônicas significativas. Seu transformador de fluxo retificado processa informação mais eficientemente, resultando em detalhes mais nítidos e melhor coerência em cenas complexas. Designs de interiores com muitos objetos pequenos, ladrilhos intrincados ou têxteis detalhados frequentemente parecem notavelmente mais nítidos do Flux comparado ao SDXL.

Vantagens de velocidade tornam o Flux atraente para trabalho iterativo de design. O Flux.1 Schnell gera imagens de alta qualidade em uma fração do tempo comparado ao SDXL, tornando-o ideal para iteração rápida e saída rápida. Ao explorar múltiplas direções de design ou criar variações para revisão do cliente, esta diferença de velocidade melhora dramaticamente a produtividade. Você pode gerar e revisar o dobro de opções no mesmo período de tempo.

Ganhe Até $1.250+/Mês Criando Conteúdo

Junte-se ao nosso programa exclusivo de afiliados criadores. Seja pago por vídeo viral com base no desempenho. Crie conteúdo no seu estilo com total liberdade criativa.

O Flux também se destaca em integração de texto, renderizando com precisão sinalização, etiquetas ou elementos de texto em designs de interiores. Embora nem sempre crítica para interiores residenciais, esta capacidade se torna importante para espaços comerciais, ambientes de varejo ou design de hospitalidade onde gráficos e sinalização integram com a arquitetura.

- Pontos fortes do SDXL: Vasta biblioteca de LoRAs, checkpoints especializados, documentação extensa, workflows estabelecidos

- Pontos fortes do Flux: Qualidade de detalhes superior, geração mais rápida, melhor renderização de texto, saídas mais limpas

- Limitações do SDXL: Geração mais lenta, detalhes menos nítidos, problemas ocasionais de coerência

- Limitações do Flux: Ecossistema de LoRAs menor, menos tutoriais, menos recursos especializados

A abordagem híbrida combina as vantagens de ambos os modelos através de um processo em dois estágios. Gere imagens iniciais com SDXL usando seus LoRAs especializados para estabelecer estilo e composição geral. Depois processe resultados através do Flux usando técnicas de imagem-para-imagem para melhorar detalhes, corrigir problemas estruturais e adicionar fidelidade. O Flux preserva o estilo estabelecido pelo SDXL enquanto melhora qualidade de renderização.

Este workflow híbrido prova particularmente eficaz para trabalho voltado ao cliente requerendo tanto controle específico de estilo (força do SDXL) quanto detalhe fotorrealista (força do Flux). O passo extra de processamento adiciona tempo mas produz resultados superiores a qualquer modelo sozinho.

Flexibilidade de proporção de aspecto favorece o Flux significativamente. O SDXL funciona melhor em proporções de aspecto específicas e luta com proporções incomuns. O Flux lida com proporções de aspecto variadas graciosamente, importante para visualização arquitetônica onde proporções de ambientes podem não corresponder a proporções de imagem padrão.

Para usuários construindo workflows no ComfyUI, ambos os modelos integram similarmente com sistemas IP-Adapter e ControlNet. As diferenças de implementação técnica permanecem mínimas, permitindo que você troque modelos base facilmente para comparar resultados. Esta flexibilidade permite que você escolha por projeto em vez de se comprometer com um modelo para todo o trabalho.

Plataformas profissionais fazem esta escolha por você baseadas em sua avaliação técnica. InstantInterior AI usa combinações de modelos proprietários aprimoradas com treinamento personalizado, enquanto sistemas como Apatero.com automaticamente selecionam o modelo mais apropriado baseado em suas características de entrada e qualidades de saída desejadas. Esta abstração elimina o fardo da decisão mas reduz controle sobre comportamento específico do modelo.

Para designers que querem experimentar e otimizar, manter workflows para ambos SDXL e Flux fornece flexibilidade máxima. Para aqueles focados em design em vez de otimização técnica, plataformas como Apatero.com entregam resultados profissionais sem requerer conhecimento das diferenças subjacentes do modelo.

Quais Workflows Entregam os Melhores Resultados de Interiores Multi-Referência

Design de interiores bem-sucedido com múltiplas referências requer mais que apenas bons modelos. A estrutura do workflow determinando como referências, controles e etapas de geração se combinam faz a diferença entre resultados medianos e excepcionais.

O workflow fundamental de múltiplas referências começa com controle espacial através de detecção de profundidade e borda do ControlNet aplicada à sua imagem base de ambiente. Isso cria a estrutura. Simultaneamente, múltiplos nós IP-Adapter processam suas imagens de referência, cada um ponderado de acordo com importância. Referências de estilo tipicamente recebem pesos mais altos em torno de 0.7 a 0.8, enquanto referências específicas de elementos usam pesos moderados entre 0.4 e 0.6.

A abordagem IPAdapter Encoder fornece controle mais sofisticado ao codificar separadamente cada imagem de referência antes de mesclar. Esta técnica permite que você experimente com diferentes métodos de mesclagem incluindo concatenação para influência igual, média ponderada para resultados balanceados, ou adição para efeitos cumulativos. Cada estratégia de mesclagem produz resultados estéticos diferentes, e a escolha ideal depende de suas imagens de referência específicas e objetivos de design.

Workflows mascarados de múltiplas referências representam o próximo nível de controle. Você cria quatro ou mais máscaras definindo regiões específicas de sua imagem de saída. Cada máscara conecta a diferentes referências IP-Adapter, permitindo controle espacial preciso sobre quais referências influenciam quais áreas. Esta técnica possibilita composições complexas onde a área do sofá referencia um estilo de móveis, o tratamento de parede referencia materiais diferentes, e o piso referencia uma terceira fonte.

O workflow de geração em etapas divide o processo em múltiplas passagens para resultados mais limpos. A primeira passagem gera composição geral do ambiente usando ControlNets de estrutura e referências de estilo primárias em resolução mais baixa. A segunda passagem aumenta escala e refina usando o Refiner do SDXL ou aprimoramento de detalhes do Flux. A terceira passagem usa inpainting para adicionar ou modificar elementos específicos como obras de arte, acessórios ou luminárias. Esta abordagem multi-estágio previne a complexidade avassaladora que ocorre ao tentar controlar cada detalhe simultaneamente.

Workflows de virtual staging otimizam especificamente para transformar ambientes vazios em espaços mobiliados. A sofisticada configuração de ControlNet duplo garante forte aderência de profundidade durante geração inicial, estabelecendo relações adequadas de posicionamento de móveis. Passagens secundárias adicionam decoração, refinam materiais e polim iluminação sem perturbar a lógica espacial subjacente estabelecida na fundação.

- Múltiplas referências básico para geração geral de ambiente com controle de estilo e elementos

- Mesclagem IPAdapter Encoder para controle preciso sobre métodos de influência de referências

- Workflows mascarados para composições complexas requerendo controle espacial de referências

- Geração em etapas para saídas de mais alta qualidade requerendo múltiplas passagens de refinamento

- Virtual staging para transformações de vazio para mobiliado

ComfyUI fornece o ambiente mais flexível para construir estes workflows mas requer conhecimento técnico significativo. A interface baseada em nós permite que você conecte encoders IP-Adapter, preprocessadores ControlNet, modelos base e refiners em configurações personalizadas. Entretanto, entender quais nós usar, como conectá-los e quais parâmetros definir demanda experimentação e aprendizado extensivos.

Workflows pré-construídos disponíveis em plataformas como OpenArt, RunningHub e Civitai oferecem pontos de partida que você pode personalizar. O workflow Flux Redux RoomDesigner fornece um sistema completo para posicionamento de móveis com múltiplas referências. O workflow Interior Decoration Dreamer combina imagens de referência com prompts detalhados para geração controlada. Estas soluções prontas aceleram seu início mas ainda requerem conhecimento de ComfyUI para modificar e otimizar.

AUTOMATIC1111 e Forge oferecem interfaces mais acessíveis com extensões ControlNet e IP-Adapter. Embora menos flexíveis que ComfyUI para cenários complexos de múltiplas referências, estas plataformas fornecem controles mais simples adequados para muitos projetos de design de interiores. O trade-off entre poder e usabilidade favorece AUTOMATIC1111 para designers que querem ferramentas capazes sem se tornarem experts em engenharia de workflows.

Plataformas em nuvem como Replicate hospedam modelos incluindo multi-controlnet-x-ip-adapter-vision-v2 através de interfaces API simples. Você carrega referências, define parâmetros e recebe resultados sem gerenciar instalações locais. Esta abordagem funciona bem para uso ocasional mas se torna cara para geração de alto volume.

Plataformas profissionais de design de interiores incluindo InstantInterior AI e Paintit.ai fornecem workflows otimizados especificamente para visualização de interiores. Estes sistemas automaticamente configuram processamento de múltiplas referências, orientação ControlNet e passagens de refinamento baseados em suas entradas. A automação entrega resultados profissionais consistentes mas limita experimentação com workflows alternativos.

Para designers buscando resultados profissionais de múltiplas referências sem gerenciamento técnico de workflow, Apatero.com simplifica todo o processo através de uma interface focada em intenção de design em vez de configuração técnica. Carregue suas imagens de referência, indique preferências gerais, e a plataforma automaticamente configura pesos apropriados do IP-Adapter, módulos ControlNet e etapas de processamento. Esta abstração entrega capacidades avançadas de múltiplas referências através de uma interface acessível que não requer entender a complexidade subjacente do workflow.

Perguntas Frequentes

Posso usar mais de três imagens de referência para geração de design de interiores?

Sim, você pode usar quatro ou mais imagens de referência simultaneamente em workflows de múltiplas referências. Entretanto, limites práticos existem baseados em memória GPU e capacidade do modelo. A maioria dos workflows lida com três a cinco referências efetivamente, com cada referência adicional requerendo balanceamento cuidadoso de peso para prevenir conflitos. Usar mais de cinco referências frequentemente produz resultados confusos onde nenhum estilo claro emerge. Para projetos requerendo muitas inspirações, selecione as três a quatro referências mais críticas que melhor representam seus elementos centrais de design em vez de incluir tudo.

Como evito que imagens de referência sejam copiadas exatamente em vez de inspirar variações?

Diminua o peso do IP-Adapter para cada referência para entre 0.4 e 0.7 em vez de usar pesos altos acima de 0.8. Pesos mais altos dizem ao modelo para copiar referências de perto, enquanto pesos moderados encorajam inspiração em vez de duplicação. Adicionalmente, combine múltiplas referências com características diferentes para que o modelo deva mesclar e interpretar em vez de copiar qualquer fonte única. Usar prompts de texto ao lado de referências visuais também guia o modelo em direção à interpretação criativa em vez de reprodução.

Qual preprocessador ControlNet funciona melhor para preservar layouts de ambientes?

O ControlNet de profundidade tem melhor desempenho para preservação espacial geral, mantendo relações 3D e garantindo perspectiva adequada. Para detalhes arquitetônicos como molduras de portas, molduras e características embutidas, adicione detecção de borda Canny ou detecção de linha MLSD como um ControlNet secundário. A combinação de profundidade mais bordas preserva tanto espaço geral quanto características arquitetônicas específicas. Comece apenas com profundidade e adicione detecção de borda somente se detalhes arquitetônicos não estiverem sendo preservados adequadamente.

Posso misturar estilos de móveis de diferentes épocas usando workflows de múltiplas referências?

Sim, workflows de múltiplas referências se destacam em mesclar móveis de diferentes períodos de estilo para interiores ecléticos. Use referências IP-Adapter separadas para cada estilo de móveis que você quer incluir, com pesos indicando a proeminência de cada estilo no design final. Entretanto, misturar muitos estilos díspares frequentemente produz resultados visualmente caóticos. Limite-se a duas ou três influências de estilo distintas com um estilo dominante em peso mais alto e outros como destaques em pesos mais baixos para designs ecléticos coesos.

Quão importante é a qualidade das imagens de referência para bons resultados?

A qualidade da imagem de referência impacta significativamente a qualidade da saída. Use referências em alta resolução com assuntos claros e bem iluminados e artefatos mínimos de compressão. Referências borradas, escuras ou de baixa qualidade produzem orientação pouco clara para a IA, resultando em gerações menos detalhadas ou imprecisas. Fotografia profissional ou imagens de produtos de alta qualidade funcionam melhor. Evite capturas de tela, imagens fortemente filtradas ou referências com forte correção de cor a menos que você especificamente queira essas qualidades transferidas para seu design.

Preciso de modelos diferentes para design de interiores residencial versus comercial?

Os mesmos modelos e workflows funcionam para ambos interiores residenciais e comerciais. Entretanto, projetos comerciais frequentemente se beneficiam de modelos com maior precisão arquitetônica e a habilidade de lidar com espaços maiores e mais complexos. A renderização de texto superior do Flux se torna mais valiosa para trabalho comercial envolvendo sinalização ou elementos de marca. A principal diferença está na seleção de referências e prompts em vez de escolha fundamental de modelo. Projetos comerciais tipicamente requerem mais referências para tipos específicos de móveis e acessórios comparado ao trabalho residencial.

Workflows de múltiplas referências podem manter consistência através de diferentes ambientes no mesmo projeto?

Sim, manter as mesmas referências de estilo com pesos consistentes através de todas as gerações de ambientes garante estéticas coesas através de um projeto multi-ambientes. Crie uma biblioteca de referências para seu projeto incluindo estilo geral, materiais e elementos, depois use estas mesmas referências para cada ambiente. Varie apenas as referências espaciais e móveis específicos de ambiente enquanto mantém referências de linguagem de design constantes. Algumas plataformas oferecem recursos de travamento de estilo que automaticamente aplicam estéticas estabelecidas a novos ambientes.

Como lido com referências com iluminação diferente do que meu design alvo precisa?

Use IC-Light ou modelos de re-iluminação similares para modificar iluminação de referência antes de usá-las em seu workflow, ou aceite que características de iluminação de referências transferirão para sua geração. Alternativamente, diminua o peso de referências com iluminação indesejada e suplemente com prompts de texto descrevendo sua iluminação pretendida. Para melhores resultados, selecione referências fotografadas sob iluminação similar ao que você quer em seu design final. Você também pode gerar com iluminação de referência existente e usar ferramentas de re-iluminação depois para ajustar o resultado final.

Qual é a melhor maneira de especificar cores de tinta exatas ou acabamentos de materiais?

Amostras físicas de materiais fotografadas sob iluminação neutra fornecem as referências de cor e acabamento mais precisas. Fotografia de produtos de sites de fabricantes funciona bem para acabamentos específicos de móveis ou acessórios. Para cores de tinta, fotografe cartelas ou amostras sob condições de luz do dia. Inclua estas referências de materiais em pesos moderados em torno de 0.5 a 0.6 ao lado de suas outras referências. Prompts de texto podem suplementar com nomes de cores específicas ou descrições de acabamentos, mas referências visuais provam mais confiáveis para correspondência exata de cores.

Existem tarefas de design de interiores que workflows de IA de múltiplas referências não conseguem lidar bem?

Desenhos altamente técnicos como documentos de construção, plantas elétricas ou esquemas de encanamento permanecem além das capacidades atuais de IA para design de interiores. Requisitos de medições extremamente precisas e conformidade com códigos precisam de ferramentas CAD tradicionais. IA se destaca em visualização conceitual, exploração de mood e renderização realista mas não deveria substituir documentação técnica. Adicionalmente, designs muito incomuns ou avant-garde sem dados de treinamento similares nos modelos de IA podem produzir resultados imprevisíveis. Para design experimental de ponta, IA serve melhor como ferramenta de ideação em vez de visualização final.

Dando Vida aos Seus Designs de Interiores Multi-Referência

Workflows de IA de múltiplas referências transformaram design de interiores de renderização manual demorada em exploração criativa rápida. Ao combinar as capacidades de referenciamento visual do IP-Adapter com a preservação estrutural do ControlNet rodando em modelos base poderosos como SDXL e Flux, você pode gerar visualizações profissionais de interiores que teriam requerido software de modelagem 3D caro e horas de tempo de renderização apenas alguns anos atrás.

A chave para o sucesso está em entender como essas tecnologias funcionam juntas. O IP-Adapter processa suas referências de estilo e elementos, extraindo características visuais que guiam estéticas. O ControlNet mantém precisão espacial através de mapas de profundidade e detecção de borda. O modelo base sintetiza estas entradas em imagens coerentes. Passagens de refinamento polim materiais e iluminação para qualidade de apresentação profissional.

Escolher entre SDXL e Flux depende de suas prioridades. O SDXL oferece ecossistemas maduros com recursos especializados para cada estilo de design, enquanto o Flux fornece qualidade de detalhes superior e geração significativamente mais rápida. A abordagem híbrida combinando ambos entrega resultados excepcionais ao aproveitar os pontos fortes de cada modelo.

A complexidade do workflow varia de sistemas pré-construídos simples a pipelines personalizados sofisticados no ComfyUI. Usuários técnicos se beneficiam do controle e flexibilidade de workflows baseados em nós, enquanto profissionais focados em design frequentemente preferem plataformas que lidam com configuração técnica automaticamente. Ferramentas como Apatero.com conectam esta lacuna ao fornecer capacidades avançadas de múltiplas referências através de interfaces acessíveis que não requerem expertise técnica.

À medida que essas tecnologias continuam evoluindo, espere melhorias em precisão de materiais, realismo de iluminação e entendimento espacial. Os modelos já produzem resultados comparáveis a software de visualização profissional para muitas aplicações, e desenvolvimento contínuo promete capacidades ainda melhores. Seja você um designer profissional, home stager imobiliário ou proprietário de casa explorando ideias de renovação, workflows de IA de múltiplas referências fornecem ferramentas poderosas para visualizar espaços interiores antes de se comprometer com mudanças físicas caras.

Comece experimentando com geração de múltiplas referências usando suas fotos favoritas de interiores como referências. Você rapidamente descobrirá como combinar diferentes inspirações cria designs únicos impossíveis de alcançar através de prompts de texto sozinhos. A tecnologia alcançou maturidade onde resultados profissionais são acessíveis a qualquer um disposto a aprender os fundamentos de seleção de referências, balanceamento de pesos e controle estrutural.

Pronto para Criar Seu Influenciador IA?

Junte-se a 115 alunos dominando ComfyUI e marketing de influenciadores IA em nosso curso completo de 51 lições.

Artigos Relacionados

Todos Nós Nos Tornaremos Nossos Próprios Estilistas de Moda à Medida que a IA Melhorar?

Análise de como a IA está transformando o design e a personalização de moda. Explore capacidades técnicas, implicações de mercado, tendências de democratização e o futuro onde todos criam suas próprias roupas com assistência de IA.

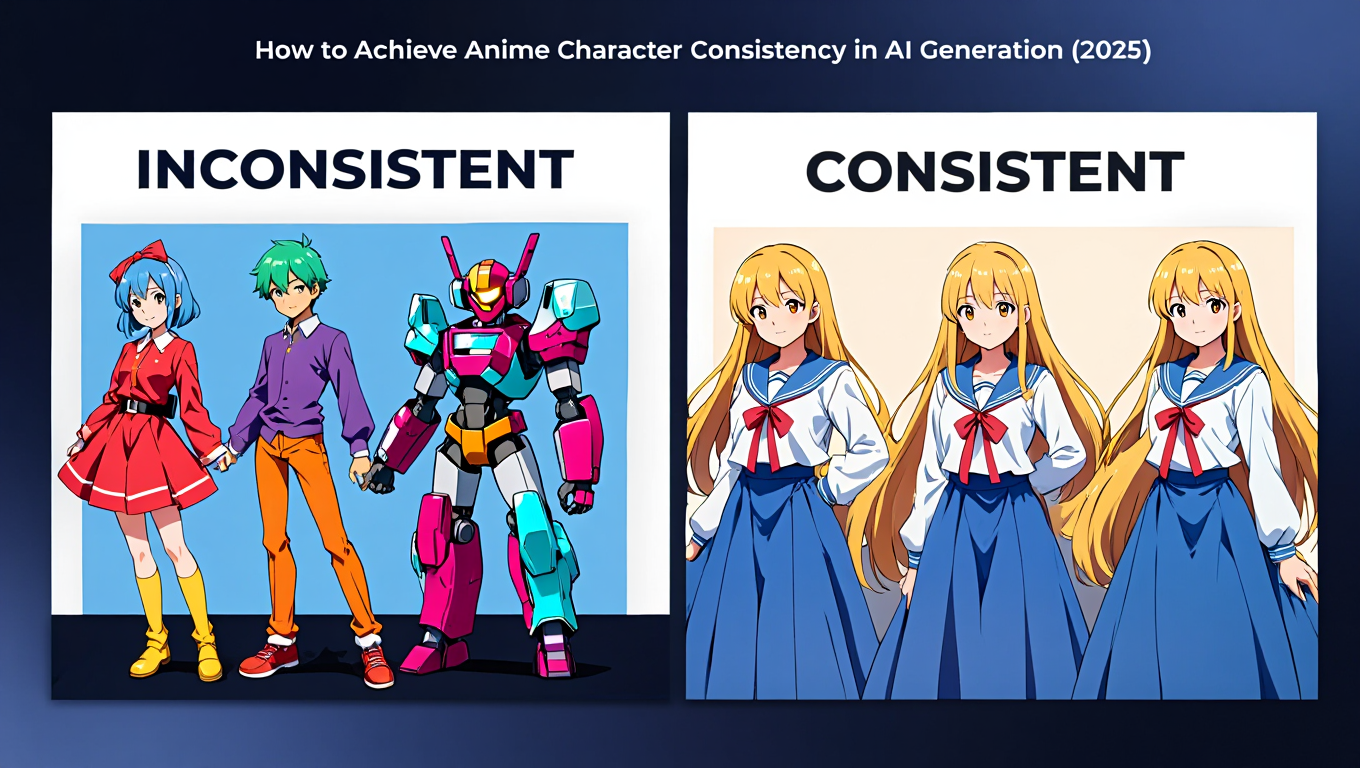

Como Alcançar Consistência de Personagens Anime em Geração de IA (2025)

Pare de obter personagens diferentes em cada geração. Domine treinamento LoRA, técnicas de referência e estratégias de workflow para personagens anime consistentes.

Melhores Ferramentas de IA para Criar Arte de Vídeo Cinematográfico Artístico em 2025

Comparação completa das principais ferramentas de geração de vídeo com IA para trabalho cinematográfico e artístico. WAN 2.2, Runway ML, Kling AI e Pika analisados em qualidade, workflow e controle criativo.