Model Multimodal Qwen3-VL: Panduan Lengkap AI Vision-Language

Kuasai model multimodal Qwen3-VL untuk pemahaman gambar, analisis video, dan penalaran visual dengan panduan lengkap 2025 ini

Anda mungkin pernah mengalami kendala ini sebelumnya. Anda membutuhkan AI yang benar-benar dapat melihat dan memahami isi gambar Anda, menganalisis konten video, atau melakukan penalaran tentang informasi visual. Tetapi kebanyakan model vision hanya menghasilkan deskripsi generik atau sama sekali melewatkan konteks yang Anda cari.

Jawaban Singkat: Qwen3-VL adalah model vision-language multimodal terbaru dari Alibaba yang memproses gambar, video, dan teks secara bersamaan dengan akurasi terdepan. Model ini unggul dalam pemahaman gambar detail, penalaran visual, analisis dokumen, dan pemahaman video sambil berjalan efisien di hardware konsumen dengan VRAM serendah 8GB menggunakan versi quantized.

- Qwen3-VL menawarkan berbagai ukuran model dari 2B hingga 72B parameter untuk berbagai kapabilitas hardware

- Pemrosesan resolusi native berarti tidak ada kehilangan kualitas gambar selama analisis

- Mendukung pemahaman gambar dan video dalam satu model

- Dapat dijalankan secara lokal dengan quantisasi GGUF untuk GPU konsumen

- Mengungguli GPT-4V di berbagai benchmark penalaran visual

Frustrasinya memang nyata. Anda mencoba GPT-4V dan hasilnya hanya deskripsi permukaan. Anda bereksperimen dengan LLaVA dan model tersebut berhalusinasi detail yang tidak ada. Anda membutuhkan sesuatu yang benar-benar dapat memahami konten visual seperti Anda, menangkap detail halus, membaca teks dalam gambar, dan membuat inferensi logis tentang apa yang dilihat.

Di sinilah tepatnya Qwen3-VL mengubah permainan. Model vision-language terbaru dari Alibaba tidak hanya melihat gambar. Model ini memahaminya dengan tingkat nuansa yang akhirnya membuat AI multimodal praktis untuk pekerjaan nyata.

Apa yang Membuat Qwen3-VL Berbeda dari Model Vision Lainnya?

Ruang AI multimodal telah semakin ramai, tetapi Qwen3-VL menonjol karena beberapa alasan teknis yang langsung diterjemahkan menjadi hasil yang lebih baik untuk kasus penggunaan aktual Anda.

Pemrosesan resolusi dinamis native adalah pembeda utama pertama. Sebagian besar model vision mengubah ukuran gambar Anda ke resolusi tetap seperti 336x336 atau 448x448 piksel sebelum diproses. Ini menghancurkan detail halus dalam gambar beresolusi tinggi. Qwen3-VL memproses gambar pada resolusi aslinya hingga 28 token per gambar, menjaga detail yang tidak dapat dilihat model lain.

Arsitekturnya menggunakan encoder Vision Transformer yang digabungkan dengan backbone model bahasa Qwen2.5 dari Alibaba. Kombinasi ini menciptakan sistem di mana fitur visual dan pemahaman bahasa bekerja sama secara mulus daripada terasa seperti disambung paksa.

Pemahaman temporal untuk video adalah fitur unggulan lainnya. Qwen3-VL tidak hanya mengambil sampel frame acak dan mendeskripsikannya secara independen. Model ini mempertahankan koherensi temporal di seluruh konten video, memahami bagaimana scene berkembang dan bagaimana aksi terungkap seiring waktu.

Model ini juga unggul dalam pembuatan output terstruktur. Perlu data format JSON yang diekstrak dari gambar? Qwen3-VL menghasilkan data terstruktur yang bersih dan dapat di-parse tanpa kesalahan format yang umum di model vision lainnya.

Sementara API cloud seperti dari OpenAI dan Anthropic menawarkan kemampuan yang mengesankan, platform seperti Apatero.com menyediakan akses instan ke model-model canggih ini tanpa setup yang rumit, membuat AI multimodal dapat diakses semua orang terlepas dari latar belakang teknis.

Bagaimana Cara Menjalankan Qwen3-VL Secara Lokal?

Menjalankan Qwen3-VL di hardware Anda sendiri memberikan privasi, nol biaya API, dan kemampuan memproses gambar tanpa batas. Berikut cara membuatnya berfungsi.

Kebutuhan Hardware Berdasarkan Ukuran Model

Qwen3-VL-2B membutuhkan sekitar 6GB VRAM pada presisi penuh atau 4GB dengan quantisasi 4-bit. Versi ini berjalan dengan nyaman di GPU seperti RTX 3060 atau bahkan kartu lama dengan memori yang cukup.

Qwen3-VL-7B memerlukan sekitar 16GB VRAM pada presisi penuh. Dengan quantisasi 4-bit, Anda dapat menjalankannya di kartu 8GB seperti RTX 4070. Ukuran ini menawarkan keseimbangan yang sangat baik antara kapabilitas dan aksesibilitas.

Qwen3-VL-72B membutuhkan hardware yang serius. Perkirakan membutuhkan 150GB+ VRAM untuk presisi penuh, meskipun versi quantized menurunkannya menjadi 40-50GB. Setup multi-GPU atau instance cloud menjadi kebutuhan pada skala ini.

Proses Instalasi

Mulai dengan menyiapkan environment Python yang bersih. Buat environment conda atau venv baru dengan Python 3.10 atau lebih baru.

Install library transformers dengan dukungan Qwen. Anda memerlukan transformers versi 4.37.0 atau lebih baru untuk kompatibilitas penuh Qwen3-VL.

Package qwen-vl-utils menangani preprocessing gambar dan video. Install bersama library accelerate untuk loading model yang efisien.

Untuk penggunaan VRAM yang lebih rendah, install auto-gptq atau bitsandbytes untuk mengaktifkan opsi quantisasi 4-bit dan 8-bit.

Download ukuran model yang Anda pilih dari Hugging Face. Tim Qwen memelihara repositori resmi dengan versi presisi penuh dan quantized yang siap digunakan.

Menjalankan Inferensi Pertama Anda

Load model dan processor menggunakan pipeline transformers standar. Set device_map ke auto untuk penempatan GPU otomatis dan trust_remote_code ke true karena Qwen menggunakan kode model kustom.

Siapkan gambar Anda dengan memuatnya menggunakan PIL dan memasukkannya melalui processor bersama dengan prompt teks Anda. Format prompt menggunakan token khusus untuk menunjukkan posisi gambar dalam input.

Model menghasilkan respons token per token. Untuk tugas deskripsi gambar, perkirakan waktu generasi 2-5 detik di GPU modern. Tugas penalaran kompleks mungkin memakan waktu 10-15 detik tergantung pada kedalaman analisis yang diperlukan.

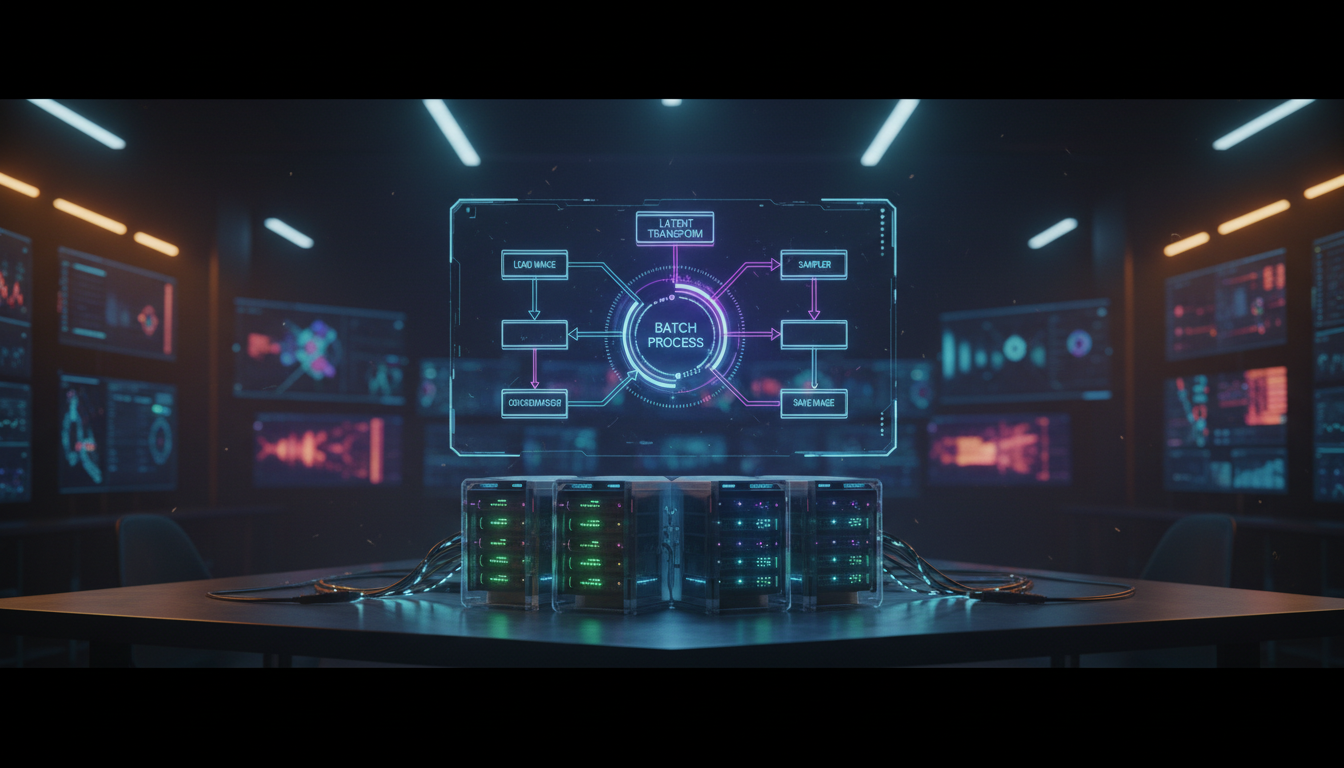

Integrasi ComfyUI

Jika Anda lebih suka workflow visual, Qwen3-VL terintegrasi dengan indah dengan ComfyUI melalui custom node. Paket node ComfyUI-Qwen-VL menyediakan node drag-and-drop untuk analisis gambar, visual question answering, dan batch processing.

Hubungkan image loader ke node Qwen-VL, tambahkan prompt Anda, dan lihat model menganalisis konten visual Anda. Pendekatan ini bekerja sangat baik untuk memproses banyak gambar atau mengintegrasikan pemahaman visual ke dalam workflow generasi yang lebih besar.

Bagi mereka yang ingin hasil tanpa mengelola instalasi lokal, Apatero.com menawarkan kemampuan yang sama melalui antarmuka intuitif, memungkinkan Anda fokus pada pekerjaan kreatif daripada konfigurasi teknis.

Apa Sebenarnya yang Dapat Anda Lakukan dengan Qwen3-VL?

Kemampuannya jauh melampaui captioning gambar sederhana. Berikut adalah aplikasi praktis di mana Qwen3-VL benar-benar bersinar.

Analisis Gambar Detail

Berikan Qwen3-VL scene yang kompleks dan ajukan pertanyaan spesifik. Berbeda dengan model yang memberi Anda deskripsi generik, model ini mengidentifikasi objek spesifik, membaca teks dalam gambar, memahami hubungan spasial, dan mengenali detail halus seperti emosi di wajah atau gaya karya seni.

Alur Kerja ComfyUI Gratis

Temukan alur kerja ComfyUI gratis dan open source untuk teknik dalam artikel ini. Open source itu kuat.

Analisis fotografi produk menjadi benar-benar berguna. Model mengidentifikasi material, memperkirakan dimensi, mencatat kualitas manufaktur, dan bahkan menyarankan perbaikan. Tim e-commerce menggunakan ini untuk pembuatan listing otomatis dengan deskripsi yang akurat dan detail.

Pemahaman Dokumen dan OCR

Qwen3-VL menangani dokumen dengan konten campuran dengan sangat baik. Formulir pindaian dengan tulisan tangan, grafik, tabel, dan teks cetak semuanya di-parse dengan akurat. Model memahami struktur dokumen dan dapat mengekstrak field spesifik yang Anda minta.

Diagram teknis dan flowchart tidak menjadi masalah. Minta model untuk menjelaskan skema sirkuit atau diagram arsitektur software dan model memberikan penjelasan yang koheren daripada hanya mendaftar elemen yang terlihat.

Paper penelitian dengan persamaan, gambar, dan tabel dapat diringkas dengan akurat. Model mengikuti referensi antara teks dan gambar, memahami bagaimana elemen visual mendukung argumen tertulis.

Analisis Konten Video

Upload klip video dan Qwen3-VL menganalisis seluruh sequence. Model melacak subjek di seluruh frame, memahami aksi dan kejadian, dan dapat menjawab pertanyaan tentang momen spesifik.

Moderasi konten menjadi lebih bernuansa. Daripada menandai frame individual, model memahami konteks dan maksud di seluruh timeline video.

Konten tutorial dan edukasi dapat diringkas dengan breakdown langkah demi langkah yang akurat. Model mengidentifikasi apa yang sedang didemonstrasikan, mencatat detail penting, dan bahkan dapat menandai potensi kesalahan atau langkah yang terlewat.

Penalaran Visual dan Logika

Di sinilah Qwen3-VL unggul dari banyak kompetitor. Berikan puzzle visual, diagram yang memerlukan inferensi, atau gambar di mana pemahaman memerlukan menghubungkan beberapa potongan informasi.

Analisis visualisasi data ilmiah melampaui deskripsi ke ekstraksi insight aktual. Model menginterpretasi tren, mengidentifikasi anomali, dan menarik kesimpulan dari grafik dan chart.

Tugas perbandingan bekerja dengan sangat baik. Tunjukkan model dua versi desain, dua foto dari waktu berbeda, atau set gambar terkait apapun dan model memberikan analisis komparatif yang bermakna.

Bagaimana Perbandingan Qwen3-VL dengan GPT-4V dan Claude Vision?

Angka benchmark menceritakan sebagian cerita, tetapi performa dunia nyata lebih penting. Berikut bagaimana model-model terdepan ini dibandingkan.

Akurasi dan Detail

Pada benchmark vision standar seperti DocVQA dan ChartQA, Qwen3-VL-72B menyamai atau melampaui performa GPT-4V. Versi Qwen3-VL-7B yang lebih kecil datang dengan mengejutkan dekat, sering dalam beberapa persen saja.

Ingin melewati kerumitan? Apatero memberi Anda hasil AI profesional secara instan tanpa pengaturan teknis.

Untuk akurasi OCR, Qwen3-VL memimpin. Ekstraksi teks dari dokumen kompleks, pengenalan tulisan tangan, dan membaca teks miring semuanya berkinerja sangat baik.

Pengenalan fine-grained objek, wajah, dan scene menguntungkan model Qwen, kemungkinan karena pemrosesan resolusi native yang menjaga detail yang hilang di arsitektur lain.

Kecepatan dan Efisiensi

Berjalan secara lokal, Qwen3-VL-7B memproses gambar 3-5x lebih cepat dari panggilan API ke GPT-4V, bahkan memperhitungkan beberapa detik waktu inferensi. Untuk batch processing ratusan gambar, perbedaan ini menjadi sangat besar.

Ukuran model yang lebih kecil membuat Qwen3-VL praktis untuk deployment edge. Menjalankan AI visual langsung di perangkat tanpa konektivitas cloud membuka kemungkinan aplikasi baru.

Pertimbangan Biaya

GPT-4V berharga $0.01 per gambar ditambah biaya token untuk input dan output teks. Memproses 1000 gambar setiap hari bertambah menjadi $300+ bulanan.

Pricing Claude Vision mengikuti pola serupa dengan biaya per-gambar yang meningkat dengan cepat untuk workload produksi.

Qwen3-VL yang berjalan secara lokal hanya memerlukan biaya listrik setelah setup awal. Untuk aplikasi volume tinggi, penghematannya menjadi substansial dalam bulan pertama.

Tentu saja, deployment lokal memerlukan keahlian teknis dan investasi hardware. Layanan seperti Apatero.com menjembatani kesenjangan ini dengan menawarkan akses ke model-model canggih dengan tarif yang wajar tanpa kompleksitas self-hosting.

| Fitur | Qwen3-VL-72B | GPT-4V | Claude 3 Vision |

|---|---|---|---|

| Skor DocVQA | 94.1% | 88.4% | 89.3% |

| Skor ChartQA | 83.2% | 78.5% | 80.1% |

| Deployment Lokal | Ya | Tidak | Tidak |

| Resolusi Native | Ya | Tidak | Tidak |

| Dukungan Video | Ya | Terbatas | Tidak |

| Biaya per 1K Gambar | ~$0 lokal | ~$10 | ~$10 |

Apa Keterbatasan yang Harus Anda Ketahui?

Tidak ada model yang sempurna, dan memahami keterbatasan membantu Anda menggunakan Qwen3-VL dengan efektif.

Variasi Dukungan Bahasa

Sementara Qwen3-VL menangani bahasa Inggris dan Mandarin dengan sangat baik, performa pada bahasa lain bervariasi. Pengenalan teks dalam skrip yang kurang umum mungkin menunjukkan akurasi yang berkurang dibandingkan karakter Latin dan CJK.

Penalaran Multi-Gambar Kompleks

Ketika menganalisis banyak gambar secara bersamaan, model dapat kehilangan jejak observasi mana yang berlaku untuk gambar mana. Untuk tugas yang memerlukan perbandingan lebih dari 3-4 gambar, pertimbangkan pemrosesan dalam batch yang lebih kecil.

Pemrosesan Video Real-Time

Meskipun pemahaman video yang kuat, Qwen3-VL tidak dirancang untuk analisis streaming real-time. Memproses video memerlukan file lengkap, dan analisis terjadi setelah upload daripada frame-by-frame selama playback.

Hasilkan Hingga $1.250+/Bulan Membuat Konten

Bergabunglah dengan program afiliasi kreator eksklusif kami. Dapatkan bayaran per video viral berdasarkan performa. Buat konten dengan gaya Anda dengan kebebasan kreatif penuh.

Interpretasi Kreatif

Model unggul dalam analisis faktual tetapi tidak menghasilkan interpretasi kreatif atau kritik artistik secara efektif. Untuk evaluasi subjektif estetika atau nilai artistik, hasilnya dapat terasa mekanis.

VRAM Selama Sesi Panjang

Sesi inferensi yang diperpanjang dapat menyebabkan fragmentasi VRAM. Jika Anda melihat perlambatan atau error setelah memproses banyak gambar, membersihkan model dari memori dan memuat ulang sering menyelesaikan masalah.

Bagaimana Cara Mengoptimalkan Performa Qwen3-VL?

Mendapatkan hasil terbaik memerlukan perhatian pada strategi prompting dan konfigurasi teknis.

Praktik Terbaik Prompting

Spesifik tentang apa yang ingin Anda analisis. Daripada "deskripsikan gambar ini," tanyakan "identifikasi semua teks yang terlihat dalam gambar ini dan catat lokasi perkiraan setiap blok teks."

Untuk analisis kompleks, pecah tugas menjadi langkah-langkah. Pertama minta model untuk mengidentifikasi elemen kunci, kemudian lanjutkan dengan pertanyaan tentang hubungan atau kesimpulan.

Sertakan persyaratan format output dalam prompt Anda. Menentukan "respons dalam JSON dengan field untuk object_name, location, dan confidence" menghasilkan data terstruktur yang lebih bersih daripada berharap model memformat dengan benar.

Optimisasi Teknis

Aktifkan Flash Attention 2 jika GPU Anda mendukungnya. Ini memberikan inferensi 20-30% lebih cepat tanpa kehilangan kualitas.

Gunakan quantisasi yang sesuai untuk kasus penggunaan Anda. Quantisasi 8-bit menjaga kualitas hampir penuh sambil mengurangi penggunaan VRAM setengah. Quantisasi 4-bit menukar beberapa akurasi untuk berjalan di GPU yang lebih kecil.

Batch gambar serupa bersama. Memproses 8 gambar dalam satu batch berjalan lebih cepat dari 8 panggilan single-image terpisah, dan Qwen3-VL menangani batching dengan baik.

Rekomendasi Hardware

Untuk penggunaan profesional, RTX 4090 yang menjalankan model 7B menawarkan keseimbangan terbaik antara kecepatan, kualitas, dan biaya. Perkirakan untuk memproses 10-15 gambar per menit dengan analisis detail.

Pengguna Mac dengan chip M2 Pro atau lebih baru dapat menjalankan versi quantized secara efektif melalui implementasi yang dioptimasi MLX. Performanya mendekati kartu NVIDIA kelas menengah.

Deployment cloud di layanan seperti RunPod memberikan akses ke performa model 72B tanpa investasi hardware besar. Instance spot dapat mengurangi biaya secara signifikan untuk pekerjaan batch processing.

Pertanyaan yang Sering Diajukan

Apakah Qwen3-VL gratis untuk digunakan?

Ya, Qwen3-VL dirilis di bawah lisensi Apache 2.0 untuk penggunaan komersial dan personal. Anda dapat mengunduh model dari Hugging Face dan menjalankannya secara lokal tanpa biaya lisensi atau batasan penggunaan.

Bisakah Qwen3-VL memproses video lebih dari beberapa menit?

Model menangani video hingga beberapa menit dengan mengambil sampel frame pada interval reguler. Untuk konten yang lebih panjang seperti film penuh atau rekaman berjam-jam, Anda akan ingin membagi video dan memproses bagian secara terpisah untuk menjaga kualitas analisis.

Bagaimana Qwen3-VL menangani screenshot kode?

Model membaca dan memahami kode dalam screenshot dengan sangat baik. Model dapat mengidentifikasi bahasa pemrograman, menjelaskan apa yang dilakukan kode, menemukan potensi bug, dan bahkan menyarankan perbaikan. Ini membuatnya sangat baik untuk menganalisis kode yang dibagikan sebagai gambar di forum atau dokumentasi.

Apakah Qwen3-VL mendukung analisis webcam real-time?

Tidak secara langsung. Model memproses gambar dan video lengkap daripada input streaming. Untuk aplikasi real-time, Anda perlu menangkap frame secara berkala dan menjalankan inferensi pada setiap snapshot, meskipun ini memperkenalkan latensi yang tidak cocok untuk kebutuhan yang benar-benar real-time.

Bisakah saya fine-tune Qwen3-VL untuk tugas spesifik?

Ya, model mendukung fine-tuning dengan LoRA dan pelatihan parameter penuh. Untuk domain khusus seperti pencitraan medis atau analisis foto satelit, fine-tuning pada data spesifik domain secara signifikan meningkatkan akurasi pada kasus penggunaan tertentu tersebut.

Format gambar apa yang diterima Qwen3-VL?

Model bekerja dengan semua format umum termasuk JPEG, PNG, WebP, BMP, dan GIF. Untuk GIF, model memproses frame pertama atau mengambil sampel frame di seluruh untuk pemahaman multi-frame.

Seberapa akurat pengenalan teks dibandingkan dengan tool OCR khusus?

Untuk sebagian besar dokumen, Qwen3-VL menyamai atau melampaui akurasi OCR tradisional sambil juga memahami konteks. Model lebih kesulitan dengan gambar yang sangat terdegradasi atau font yang tidak biasa dibandingkan sistem OCR khusus yang dilatih pada tantangan spesifik tersebut.

Bisakah Qwen3-VL menghasilkan gambar seperti DALL-E atau Midjourney?

Tidak, Qwen3-VL adalah model pemahaman, bukan model generasi. Model menganalisis dan mendeskripsikan konten visual tetapi tidak membuat gambar baru. Untuk generasi yang dikombinasikan dengan pemahaman, Anda akan menggunakan Qwen3-VL bersama model generasi gambar terpisah.

Apakah model bekerja offline setelah unduhan awal?

Operasi sepenuhnya offline bekerja dengan sempurna. Setelah Anda mengunduh weight model, tidak diperlukan koneksi internet untuk inferensi. Ini membuatnya cocok untuk lingkungan air-gapped atau situasi dengan konektivitas yang tidak dapat diandalkan.

Bagaimana Qwen3-VL menangani konten gambar sensitif atau tidak pantas?

Model menyertakan penyaringan konten yang dilatih untuk mengenali dan menangani materi sensitif dengan tepat. Untuk kasus penggunaan moderasi konten, model mengidentifikasi konten yang mengkhawatirkan sambil memberikan detail yang cukup untuk keputusan review tanpa reproduksi eksplisit.

Kesimpulan dan Langkah Selanjutnya

Qwen3-VL mewakili kemajuan signifikan dalam aksesibilitas AI multimodal. Anda mendapatkan performa level GPT-4V yang berjalan di hardware Anda sendiri, tanpa biaya API dan privasi lengkap untuk data gambar Anda.

Mulai dengan model 7B untuk mempelajari kemampuannya tanpa memerlukan investasi hardware yang besar. Seiring Anda mengembangkan workflow dan memahami apa yang dilakukan Qwen3-VL dengan baik, Anda dapat meningkatkan ke model yang lebih besar atau mengoptimalkan deployment Anda untuk penggunaan produksi.

Kombinasi pemrosesan resolusi native, pemahaman video yang kuat, dan output terstruktur yang sangat baik membuat model ini sangat berharga untuk tugas pemrosesan dokumen, analisis konten, dan ekstraksi data visual.

Jika Anda ingin bereksperimen dengan kemampuan AI multimodal tanpa kompleksitas setup lokal, Apatero.com menyediakan akses instan ke model vision mutakhir. Anda dapat mengeksplorasi apa yang mungkin sebelum berkomitmen ke infrastruktur Anda sendiri.

Bagi mereka yang siap untuk deploy secara lokal, jalannya jelas. Siapkan environment Python Anda, unduh model yang sesuai dengan hardware Anda, dan mulai membangun pemahaman visual ke dalam aplikasi Anda. Lisensi terbuka berarti Anda dapat menggunakannya sesuai kebutuhan, dari proyek personal hingga produk komersial, tanpa batasan.

Siap Membuat Influencer AI Anda?

Bergabung dengan 115 siswa yang menguasai ComfyUI dan pemasaran influencer AI dalam kursus lengkap 51 pelajaran kami.

Artikel Terkait

Prompt Terbaik untuk Seni Cyberpunk - 50+ Contoh Bernuansa Neon untuk Sci-Fi 2025

Kuasai pembuatan seni cyberpunk dengan 50+ prompt teruji untuk kota neon, karakter tech noir, dan masa depan distopia. Panduan lengkap dengan kata kunci pencahayaan, palet warna, dan efek atmosfer.

Memperbaiki Error CUDA GPU Blackwell - Panduan Troubleshooting RTX 5090 dan 5080

Selesaikan error CUDA pada GPU NVIDIA Blackwell termasuk RTX 5090 dan 5080 dengan perbaikan driver, update CUDA Toolkit, dan konfigurasi PyTorch

Membuat Seni dengan Palet Warna Konsisten Menggunakan AI

Kuasai kontrol palet warna konsisten dalam pembuatan gambar AI dengan IP-Adapter, ControlNet warna, ekstraksi palet, dan transfer gaya. Panduan lengkap untuk menjaga harmoni warna di semua proyek seni AI Anda.